O que é uma Rede Neural Bayesiana?

Redes neurais que utilizam distribuições de probabilidade como pesos em vez de estimativas pontuais, permitindo a quantificação da incerteza e a confiabilidade nas previsões.

- Modela pesos e vieses como distribuições de probabilidade (por exemplo, Gaussianas) com parâmetros treináveis para médias e variâncias, em vez de estimativas de ponto fixo de redes neurais padrão.

- Treinado usando inferência variacional, aproximando distribuições posteriores, ou métodos de amostragem MCMC, computacionalmente mais custosos, mas fornecendo estimativas de incerteza fundamentadas.

- Essencial para aplicações de segurança, aprendizado ativo onde a incerteza guia a coleta de dados, detecção de entradas fora da distribuição e cenários que exigem intervalos de confiança nas previsões.

O que são redes neurais bayesianas?

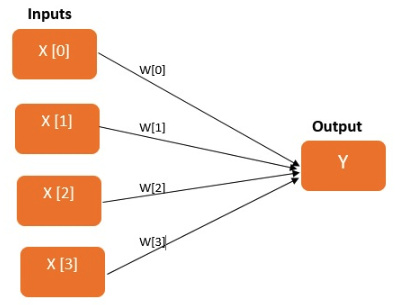

Redes neurais bayesianas se referem a uma extensão de redes-padrão com posterior inferência de probabilidade com a finalidade de controlar o sobreajuste. Em um sentido mais amplo, a abordagem bayesiana usa metodologia estatística para garantir que tudo, incluindo os parâmetros do modelo (pesos e vieses da rede neural), tenha uma distribuição de probabilidade associada a ela. Em linguagens de programação, uma variável que pode assumir um determinado valor terá o mesmo resultado toda vez que você acessar essa variável específica. Vamos começar analisando um modelo linear simples que prevê a saída por uma soma ponderada de um conjunto de recursos de entrada.

A título de comparação, no mundo bayesiano, você pode ter entidades semelhantes, também conhecidas como variáveis aleatórias, que fornecem valores diferentes a cada acesso. Em termos bayesianos, os dados históricos representam conhecimento prévio sobre o comportamento geral, com cada variável tendo suas próprias propriedades estatísticas que mudam com o tempo. Assumindo que X é uma variável aleatória que representa uma distribuição normal, cada acesso a X retornará um valor de resultado diferente. Esse processo de obtenção de novos valores a partir de variáveis aleatórias é chamado de amostragem. O valor resultante depende da distribuição de probabilidade associada à variável aleatória. Em outras palavras, o espaço de parâmetros nos permite inferir a natureza e a forma dos parâmetros de treinamento da rede neural. Recentemente ,tem havido muita atividade nesta área com o lançamento de várias bibliotecas de programação probabilística, como PyMC3, Edward, Stan etc. Os métodos bayesianos são usados em muitos campos, desde desenvolvimento de jogos até descoberta de medicamentos.

Quais são as principais vantagens das redes neurais bayesianas?

- As redes neurais bayesianas ajudam a resolver problemas em áreas com dados insuficientes como uma proteção contra sobreajuste. Exemplos de aplicações incluem biologia molecular e medicina diagnóstica, nas quais a aquisição de dados é cara e requer estudos experimentais difíceis.

- As redes bayesianas são universalmente úteis.

- São extremamente difíceis escalar para grandes problemas, mas é possível obter resultados desejáveis para um grande número de tarefas.

- Podem calcular automaticamente os erros associados às previsões ao lidar com dados de destino desconhecidos.

- Permitem estimar a incerteza das previsões, o que é útil em áreas como a medicina.

O manual de IA agêntica para empresas

Por que usar redes neurais bayesianas?

Os métodos bayesianos permitem considerar a distribuição de todas as respostas, em vez de considerar as respostas por pergunta, por isso são adequados para resolver problemas como:

- Regularização (evitar sobreajuste);

- Seleção e comparação de modelos (sem necessidade de validação cruzada separada de conjuntos de dados).

Recursos adicionais

Receba os posts mais recentes na sua caixa de entrada

Assine nosso blog e receba os posts mais recentes diretamente na sua caixa de entrada.