Expandindo a Governança de Agentes com o Unity AI Gateway

Controle e audite agentes de IA e assistentes de codificação com governança unificada, visibilidade e guardrails

por David Nasi

- Agora com suporte à governança MCP: Controle quais agentes podem acessar sistemas externos com permissões granulares, incluindo acesso on-behalf-of (OBO).

- Observabilidade de ponta a ponta para agentes: Monitore chamadas de LLM e MCP, monitore o uso e atribua custos entre modelos, equipes e fluxos de trabalho.

- Acesso a modelos mais flexível e confiável: Use uma API unificada em todos os modelos com fallbacks integrados, limites de taxa e guardrails.

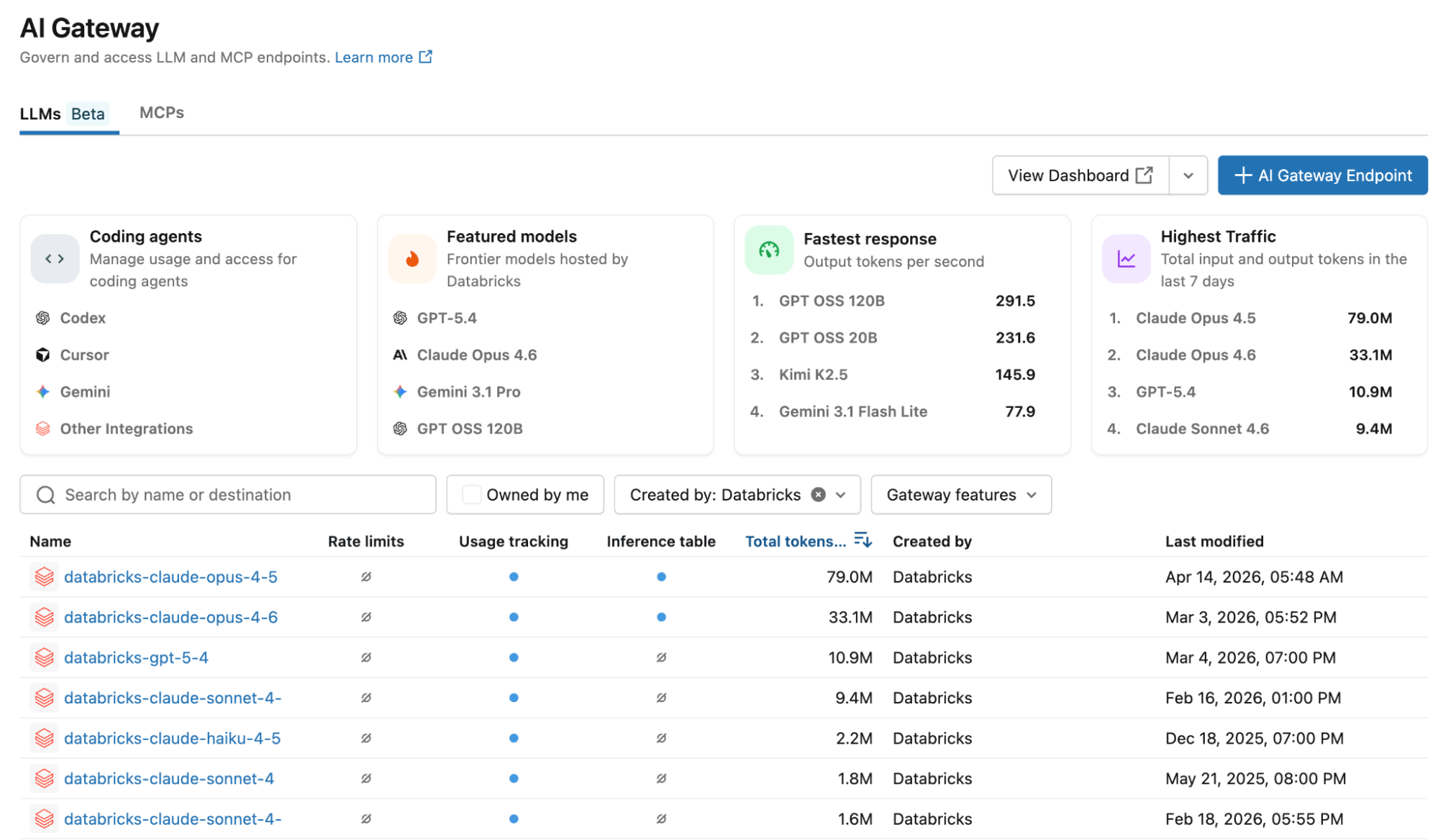

Hoje, anunciamos grandes aprimoramentos para o AI Gateway. Como parte desta versão, o AI Gateway agora faz parte do Unity Catalog como Unity AI Gateway. Isso estende o modelo de governança do Unity Catalog para IA agentiva, para que você possa aplicar as mesmas permissões, auditoria e controles de política à forma como os agentes acessam LLMs e interagem com ferramentas como servidores MCP e APIs.

Veja o que acontece quando um agente de IA responde a uma pergunta do cliente: ele chama um LLM para interpretar a consulta, busca o histórico de pedidos do Salesforce por meio de um servidor MCP, verifica dados de envio em tempo real por meio de uma API interna e, em seguida, chama o LLM novamente para redigir uma resposta. Tempo total: menos de um segundo. Visibilidade total sobre quem acessou quais dados, quais sistemas foram chamados e se as políticas foram seguidas: quase nenhuma.

O que mudou não são apenas as ferramentas, mas a arquitetura. Agentes de IA agora orquestram fluxos de trabalho de várias etapas entre modelos e sistemas, muitas vezes tocando em dados confidenciais em cada etapa. Isso pode envolver a consulta a um banco de dados, a chamada a uma API externa ou o uso de agentes de codificação como Cursor, Codex ou Claude Code para gerar ou modificar código.

E isso levanta novas questões: Quem autorizou cada ação? Quais dados foram compartilhados com qual modelo? As políticas foram aplicadas de forma consistente? Se algo quebrar, você consegue rastrear a cadeia completa?

Ferramentas de governança tradicionais não foram criadas para este mundo. Elas operam em silos e não conseguem fornecer uma visão unificada em todo o ciclo de vida das ações de um agente.

Com esta versão, estamos expandindo os recursos de governança do Unity Catalog para cobrir agentes de IA. O Unity AI Gateway permite controlar o acesso a LLMs, governar como os agentes usam servidores e APIs MCP e aplicar políticas consistentes em modelos e ferramentas. Isso inclui novo suporte para governança MCP, para que você possa controlar quais agentes podem acessar quais sistemas externos e rastrear como esses dados são usados. Para uma análise mais aprofundada, leia nosso blog de como fazer sobre como conectar agentes a MCPs externos com segurança.

Você também obtém observabilidade detalhada em chamadas LLM e MCP, juntamente com rastreamento granular de custos em modelos, equipes e fluxos de trabalho. Além disso, o Unity AI Gateway fornece uma maneira unificada de trabalhar entre modelos, com fallbacks integrados, limites de taxa e guardrails para ajudá-lo a executar agentes de forma confiável em produção.

Alguns dos recursos descritos abaixo estão disponíveis em Beta

Agora você pode configurar um novo endpoint LLM ou servidor MCP em segundos — escolha seu modelo (Claude Opus 4.6, GPT-4, Gemini, Llama ou qualquer API nativa do provedor) e configure a governança uma vez. O mesmo framework se aplica a modelos Anthropic, OpenAI, Google e de código aberto.

Dê à sua equipe de suporte um endpoint Claude para IA conversacional. Use GPT-4 para extração de dados estruturados. Equipe seus engenheiros com Codex ou Claude para agentes de codificação. Traga Gemini para fluxos de trabalho multimodais. Você pode escolher o modelo certo para cada tarefa sem refazer a governança a cada vez. As políticas permanecem consistentes entre os provedores — sem configuração duplicada, sem configurações separadas para gerenciar.

Permissões Granulares e Guardrails

Permissões granulares e guardrails evitam que o que não deveria acontecer aconteça em primeiro lugar.

Controle de acesso granular para ferramentas

Quando os agentes chamam servidores MCP para acessar sistemas internos, o Unity AI Gateway suporta execução em nome do usuário. O MCP executa com as permissões exatas do usuário solicitante, não de uma conta de serviço compartilhada. Se um usuário não puder acessar um registro do Salesforce, o agente também não poderá — mesmo com privilégios elevados.

Guardrails flexíveis com juízes LLM (Beta)

Os guardrails do Unity AI Gateway usam uma abordagem de prompt + modelo — configure-os para serem executados em solicitações, respostas ou ambos:

- Detecção e Redação de PII: Detecta e mascara e-mails, SSNs, números de telefone antes que cheguem a modelos externos

- Segurança de Conteúdo: Bloqueia conteúdo tóxico, prejudicial ou inadequado com filtros personalizáveis

- Detecção de Injeção de Prompt: Captura tentativas de jailbreak que tentam substituir as instruções do sistema

- Prevenção de Exfiltração de Dados: Evita a exposição de dados de treinamento ou conteúdo proprietário

- Guardrail de Alucinação: Valida respostas contra fontes de aterramento

- Guardrails Personalizados: Defina os seus próprios com um prompt e modelo personalizados

Cada guardrail é apoiado por um prompt editável e um modelo configurável — não por lógica rígida pré-construída. Quando violado, o Unity AI Gateway pode rejeitar a solicitação ou mascarar dados confidenciais. Todas as ações são registradas para auditoria. Este recurso está sendo lançado e estará disponível em todas as regiões suportadas na próxima semana.

Observabilidade de Ponta a Ponta

Três equipes precisam de respostas quando os agentes de IA entram em produção: FinOps quer saber o que está custando dinheiro, a engenharia precisa depurar falhas, a segurança precisa de trilhas de auditoria. O Unity AI Gateway dá a cada equipe o que ela precisa da mesma infraestrutura de log unificada.

Para FinOps: Rastreie custos pelo que importa para você

Cada solicitação é registrada em tabelas do sistema do Unity Catalog com custos reais em dólares — não apenas contagens de tokens. Tempo de atividade de throughput provisionado, uso de pagamento por token e preços de modelos externos calculados automaticamente. Fatie os custos como sua organização orça:

- Tags de endpoint: Agrupe por equipe, ambiente ou centro de custo

- Tags de solicitação: Atribuição dinâmica para plataformas SaaS que atuam como proxy para clientes finais

- Identidade: Agregue por usuário ou principal de serviço — mapeie gastos para proprietários de orçamento

- Modelo e provedor: Rastreie quais modelos (Opus vs Sonnet) e provedores (Anthropic vs OpenAI) impulsionam os custos

Para Engenharia: Cargas úteis completas para depuração

Ative tabelas de inferência que capturam cargas úteis completas de solicitação/resposta, latência, códigos de status e erros em tabelas Delta. Quando um agente falha, rastreie exatamente qual prompt foi enviado, o que o modelo retornou e onde ele falhou — e use ferramentas como Genie Code e MLflow para depurar e resolver problemas rapidamente.

Para Segurança: Trilhas de auditoria completas

Cada solicitação registra a identidade solicitante, timestamp e — para chamadas MCP — nome da conexão, método HTTP e se a chamada foi em nome do usuário. As permissões do Unity Catalog controlam quem vê o quê.

Uma única infraestrutura de log alimenta três casos de uso críticos — construída em tabelas Delta que você possui e controla.

Confiabilidade e Flexibilidade para Produção

O Unity AI Gateway oferece flexibilidade na forma como você chama modelos, dependendo do que seu aplicativo precisa.

APIs unificadas para troca contínua de provedores (Beta)

Se a portabilidade importa — e deveria — use a API compatível com OpenAI do Unity AI Gateway. Seu código permanece o mesmo em todos os provedores. Escreva seu aplicativo uma vez, depois alterne entre qualquer modelo atualizando a configuração do endpoint. Sem alterações de código, sem reimplantação.

Failover automático mantém os sistemas em execução (Beta)

Configure modelos de fallback, e o Unity AI Gateway lida com falhas automaticamente. Se o seu modelo principal atingir limites de taxa ou retornar erros, as solicitações serão roteadas para o seu modelo de backup em sequência até que um tenha sucesso. Cota Opus esgotada? O tráfego volta para Sonnet. Provedor com interrupção? Seu aplicativo é roteado para uma alternativa. Nenhuma intervenção manual, nenhum tempo de inatividade.

Por fim, o Unity AI Gateway permite definir limites de taxa no nível do endpoint, usuário ou grupo para evitar custos descontrolados e proteger seu SLA antes que os problemas comecem.

Comece a usar o Unity AI Gateway

As novas funcionalidades descritas acima estão disponíveis em regiões compatíveis do Databricks. Abra seu workspace, navegue até o Unity AI Gateway na barra lateral e comece a governar sua pilha de GenAI — LLMs e MCPs — de um só lugar. Saiba mais na documentação e no blog de como conectar agentes a MCPs externos com segurança.

(Esta publicação no blog foi traduzida utilizando ferramentas baseadas em inteligência artificial) Publicação original

Receba os posts mais recentes na sua caixa de entrada

Assine nosso blog e receba os posts mais recentes diretamente na sua caixa de entrada.