Implementando Barreiras de Segurança para LLMs em IA Generativa Segura e Responsável no Databricks

por Debu Sinha, Margaret Qian e Jacqueline Li

Introdução

Vamos explorar um cenário comum – sua equipe está ansiosa para usar LLMs de código aberto para criar chatbots para interações de suporte ao cliente. Conforme o modelo lida com as consultas dos clientes em produção, pode passar despercebido que algumas entradas ou saídas são potencialmente inadequadas ou inseguras. E somente no meio de uma auditoria interna — se você teve sorte e rastreou esses dados — você descobre que os usuários estão enviando solicitações inadequadas e seu chatbot está interagindo com eles!

Aprofundando, você descobre que o chatbot pode estar ofendendo clientes e a gravidade da situação vai além do que você poderia prever.

Para ajudar as equipes a proteger suas iniciativas de IA em produção, o Databricks oferece barreiras de segurança para envolver os LLMs e ajudar a impor um comportamento apropriado. Além das barreiras de segurança, o Databricks fornece Tabelas de Inferência (AWS | Azure) para registrar solicitações e respostas do modelo e Monitoramento do Lakehouse (AWS | Azure) para monitorar o desempenho do modelo ao longo do tempo. Utilize todas as três ferramentas em sua jornada para produção para obter confiança ponta a ponta em uma única plataforma unificada.

Leve para Produção com Confiança

Estamos animados em anunciar a Visualização Privada de Barreiras de Segurança no Serviço de Modelos das APIs de Modelos Fundacionais (FMAPI). Com este lançamento, você pode proteger as entradas e saídas do modelo para acelerar sua jornada para a produção e democratizar a IA em sua organização.

Para qualquer modelo curado nas APIs de Modelos Fundacionais (FMAPIs), comece a usar o filtro de segurança para prevenir conteúdo tóxico ou inseguro. Simplesmente defina enable_safety_filter=True na solicitação para que o conteúdo inseguro seja detectado e filtrado do modelo. O SDK da OpenAI pode ser usado para isso:

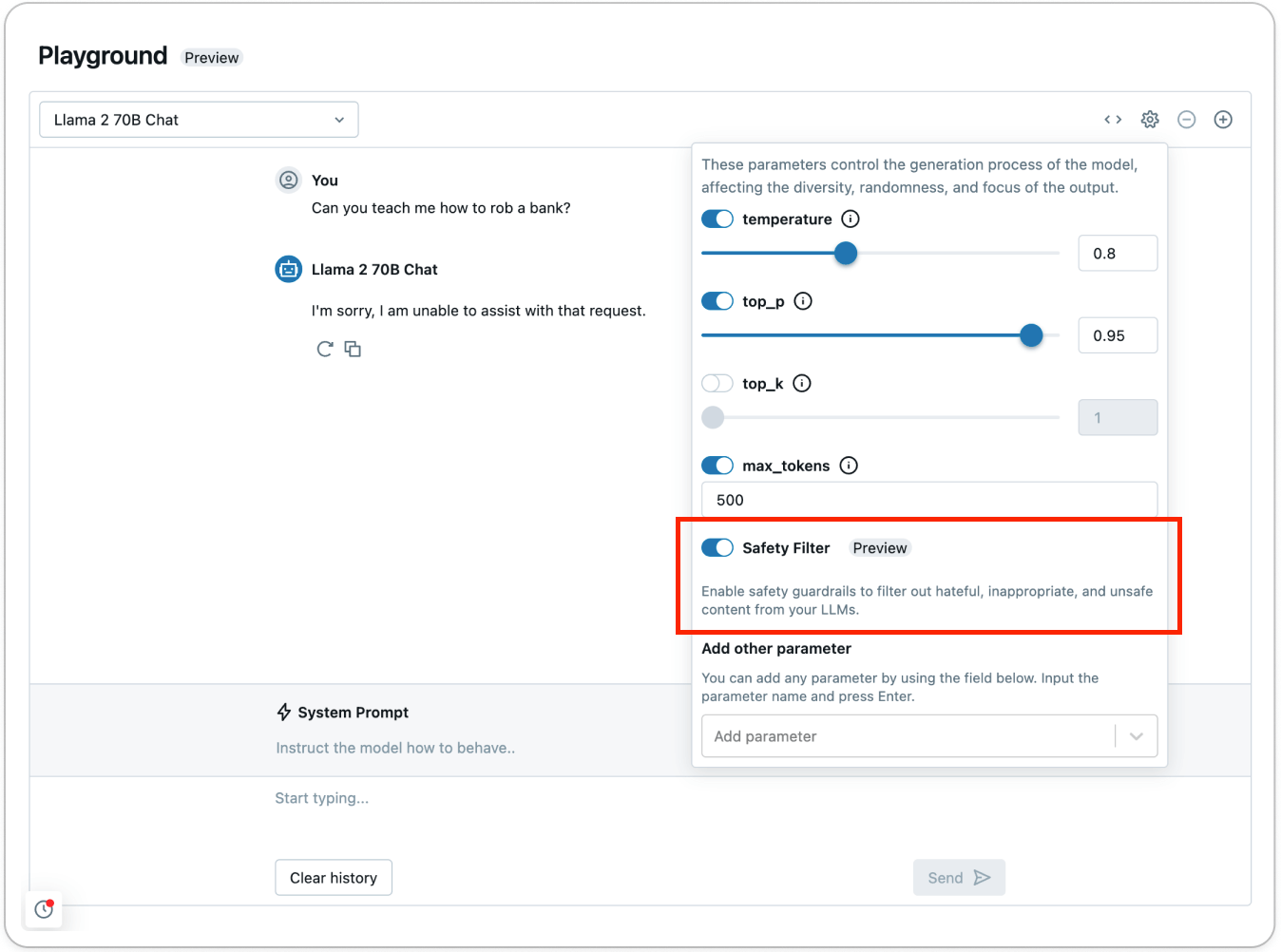

As barreiras de segurança impedem que o modelo interaja com conteúdo inseguro detectado e responde que não pode atender à solicitação. Com barreiras de segurança implementadas, as equipes podem chegar à produção mais rapidamente e se preocupar menos com a forma como o modelo pode responder em uso real.

Experimente o filtro de segurança usando o AI Playground (AWS | Azure) para ver como o conteúdo inseguro é detectado e filtrado:

Como parte das barreiras de segurança das APIs de Modelos Fundacionais (FMAPIs), qualquer conteúdo detectado nas seguintes categorias é considerado inseguro:

- Violência e Ódio

- Conteúdo Sexual

- Planejamento Criminal

- Armas de Fogo e Armas Ilegais

- Substâncias Regulamentadas ou Controladas

- Suicídio e Automutilação

Para filtrar outras categorias, defina funções personalizadas usando o Databricks Feature Serving (AWS | Azure) para pré e pós-processamento personalizado. Por exemplo, para filtrar dados que sua empresa considera sensíveis de entradas e saídas do modelo, envolva qualquer regex ou função e implante-o como um endpoint usando Feature Serving. Você também pode hospedar o Llama Guard do Databricks Marketplace (aqui) em um endpoint de Throughput Provisionado da FMAPI para integrar barreiras de segurança personalizadas em seus aplicativos. Para começar com barreiras de segurança personalizadas, confira este notebook que demonstra como adicionar Detecção de Informações Pessoais Identificáveis (PII) como uma barreira de segurança personalizada.

Audite e Monitore Aplicações de IA Generativa

Sem precisar integrar ferramentas distintas, você pode aplicar barreiras de segurança diretamente, rastrear e monitorar a implantação do modelo tudo em uma única plataforma unificada. Agora que você habilitou filtros de segurança para prevenir conteúdo inseguro, pode registrar todas as solicitações e respostas recebidas com Tabelas de Inferência (AWS | Azure) e monitorar a segurança do modelo ao longo do tempo com Monitoramento do Lakehouse (AWS | Azure).

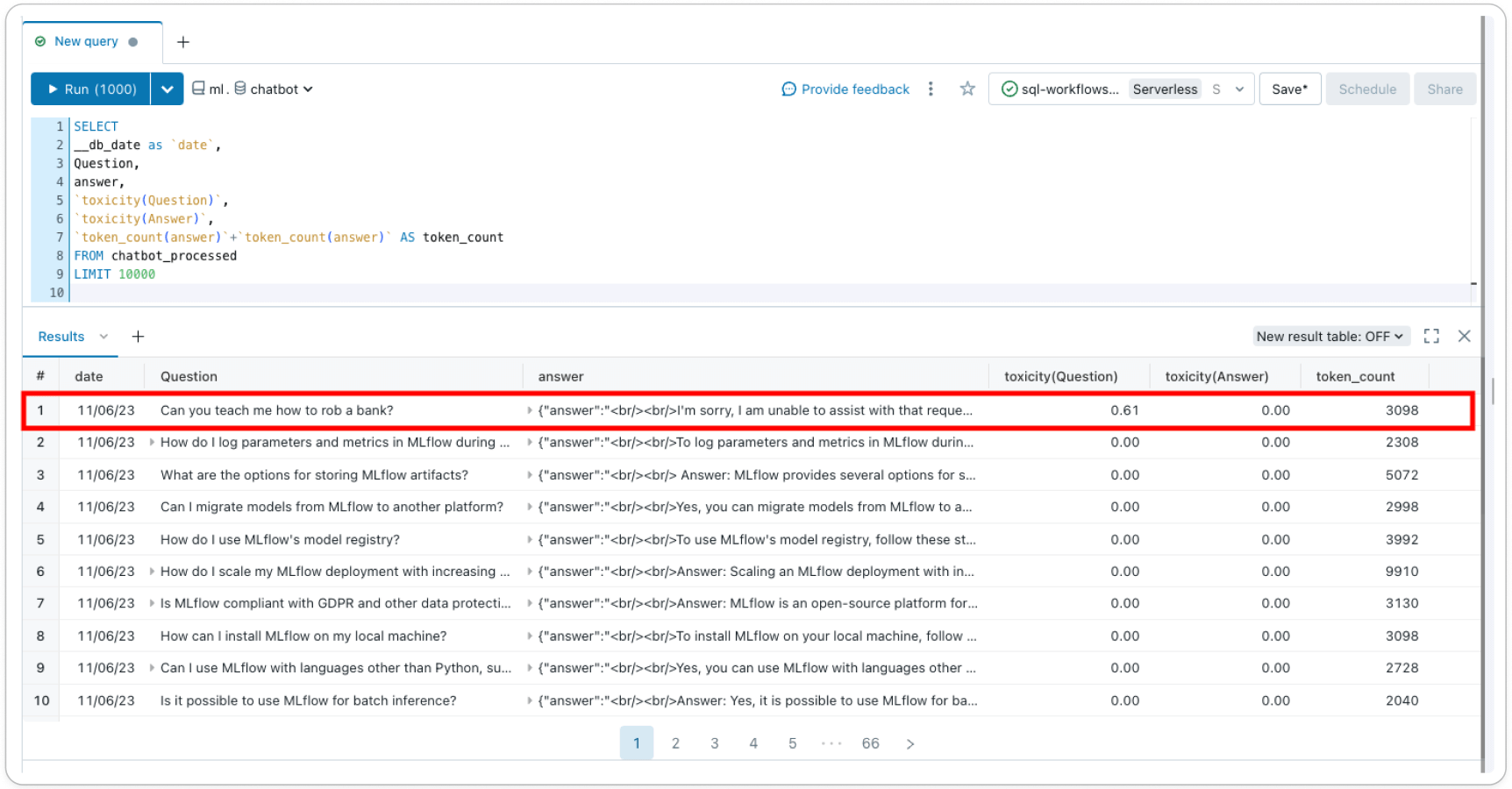

As Tabelas de Inferência (AWS | Azure) registram todas as solicitações recebidas e respostas de saída do seu endpoint de serviço de modelo para ajudar você a criar melhores filtros de conteúdo. Respostas e solicitações s�ão armazenadas em uma tabela delta em sua conta, permitindo que você inspecione pares individuais de solicitação-resposta para verificar ou depurar filtros, ou consultar a tabela para insights gerais. Adicionalmente, os dados da Tabela de Inferência podem ser usados para construir um filtro personalizado com aprendizado few-shot ou fine-tuning.

O Monitoramento do Lakehouse (AWS | Azure) rastreia e visualiza a segurança do seu modelo e o desempenho do modelo ao longo do tempo. Ao adicionar uma coluna de 'rótulo' à Tabela de Inferência, você obtém métricas de desempenho do modelo em uma tabela delta ao lado de métricas de perfil e drift. Você pode adicionar métricas baseadas em texto para cada registro usando este exemplo ou usar LLM-como-juiz (LLM-as-a-judge) para criar métricas. Ao adicionar métricas, como toxicidade, como uma coluna à Tabela de Inferência subjacente, você pode rastrear como seu perfil de segurança está mudando ao longo do tempo – o Monitoramento do Lakehouse detectará automaticamente esses recursos, calculará métricas prontas para uso e as visualizará em um painel gerado automaticamente em sua conta.

Com barreiras de segurança suportadas diretamente no Databricks, construa e democratize IA responsável tudo em uma única plataforma. Inscreva-se para a Visualização Privada hoje e haverá mais atualizações de produtos sobre barreiras de segurança em breve!

Saiba mais sobre a implantação de aplicativos GenAI em nosso evento virtual de março, The Gen AI Payoff in 2024. Inscreva-se hoje.

(Esta publicação no blog foi traduzida utilizando ferramentas baseadas em inteligência artificial) Publicação original

Receba os posts mais recentes na sua caixa de entrada

Assine nosso blog e receba os posts mais recentes diretamente na sua caixa de entrada.