Dentro de uma das primeiras implantações de produção do Lakebase: o mecanismo de governança de fluxo de trabalho agentivo da LangGuard

Fluxos de trabalho agentivos empresariais abrangem dezenas de agentes, centenas de ferramentas e mais de 15 sistemas de registro. Controlá-los e operá-los em tempo real requer infraestrutura que não existia até o Lakebase.

por Venkat Raghavan, Jason Keirstead, Ravi Srinivasan, Nina Williams e Amelia Westberg

- Menos de 10% das empresas implantaram com sucesso agentes de IA autônomos em escala, principalmente porque os agentes contornam os controles de segurança tradicionais gerando sua própria lógica em tempo de execução, criando uma lacuna de governança invisível.

- A Databricks fornece governança unificada para dados, modelos e políticas de acesso por meio do Unity Catalog e do AI Gateway. O LangGuard estende esses controles em nível de plataforma com uma camada de imposição em tempo de execução para fluxos de trabalho agentivos — monitorando e impondo políticas em toda a cadeia ponta a ponta de ações, decisões, ferramentas e credenciais. Ele usa um tecido de dados GRAIL™ com patente pendente que captura cada ação do agente em um grafo de conhecimento ao vivo e avalia cada decisão de política em tempo real, sem impactar o desempenho do agente.

- O Databricks Lakebase, o primeiro banco de dados Postgres totalmente gerenciado e sem servidor do setor, construído sobre o lakehouse, é o que torna isso possível, fornecendo computação elástica de escala zero, execução de consultas de baixa latência para dados operacionais quentes e ramificação instantânea de banco de dados para testes seguros de políticas de governança.

O problema invisível com IA agêntica

A maioria das empresas está experimentando com agentes de IA autônomos. Muito poucas os estão implantando com segurança em escala. De acordo com a pesquisa "The State of AI in 2025" da McKinsey (novembro de 2025), em nenhuma função de negócios mais de dez por cento das empresas escalaram agentes de IA para produção. A falha raramente é a falta de ambição; é a falta de visibilidade.

Ao contrário do software tradicional, os agentes autônomos geram sua própria lógica dinamicamente. Eles contornam monitores de segurança convencionais, invocam ferramentas e acessam dados de maneiras que são difíceis de auditar posteriormente, e operam em fluxos de trabalho complexos de múltiplos agentes onde uma única permissão mal configurada ou lacuna de política pode se transformar em um incidente de segurança significativo. O que as empresas precisam é de uma nova categoria de infraestrutura de controle: uma que opere no momento em que uma decisão está sendo tomada, não depois que o dano foi feito.

Esse é o problema que o LangGuard foi construído para resolver.

Aplicação em tempo de execução encontra governança de plataforma

O LangGuard atua como uma camada de aplicação em tempo de execução para fluxos de trabalho agênticos, monitorando e aplicando políticas em toda a cadeia de ponta a ponta de ações, decisões, ferramentas, credenciais e intenção que abrange todos os sistemas que um agente toca. A Databricks fornece governança unificada através do Unity Catalog e do AI Gateway — o sistema de registro para dados, modelos e políticas de acesso. À medida que as empresas implantam agentes em produção, o próprio fluxo de trabalho também precisa de uma camada de aplicação em tempo de execução que estenda esses controles em nível de plataforma para cada etapa da execução do agente. É aí que o LangGuard se encaixa. O motor de governança do LangGuard, o GRAIL™ (Governance AI Run-time Links) data fabric, captura cada ação do agente como dados de rastreamento multidimensionais e constrói um grafo de conhecimento ao vivo do comportamento e contexto do fluxo de trabalho. Quando um agente tenta invocar uma ferramenta, acessar um conjunto de dados ou chamar um modelo, o LangGuard avalia essa ação em relação à política antes que ela seja executada, em todos os sistemas que o fluxo de trabalho toca, independentemente de onde ele é executado.

A escala de uma implantação agêntica empresarial em produção torna isso genuinamente difícil. Um único fluxo de trabalho pode envolver dezenas de agentes coordenados, centenas de invocações de ferramentas, múltiplos modelos fundamentais e políticas gerenciadas em quinze ou mais Sistemas de Registro empresariais, incluindo sistemas de tickets de TI como ServiceNow, plataformas IAM e IDP, sistemas CRM como Salesforce, plataformas de RH como Workday, plataformas de segurança em nuvem como Wiz e CrowdStrike, plataformas de contact center como TalkDesk, MCP Gateways e API Gateways. Governar isso em tempo real, sem impactar o desempenho do agente, exige infraestrutura construída especificamente para o problema.

Por que escolhemos o Lakebase

A equipe do LangGuard passou anos construindo o IBM QRadar, um líder múltiplo no Gartner Magic Quadrant e uma das plataformas SIEM empresariais mais amplamente implantadas do mundo. O QRadar ingere e correlaciona petabytes de telemetria de segurança por dia sob rigorosos requisitos de latência e confiabilidade. Essa experiência nos ensinou uma lição difícil: a arquitetura do banco de dados é o destino. Quando projetamos o motor de governança de fluxo de trabalho do LangGuard, enfrentamos o mesmo desafio que havíamos resolvido antes: dados operacionais de segurança que chegam em rajadas imprevisíveis e de alta intensidade, onde cada milissegundo de latência de decisão importa e o custo de infraestrutura ociosa é inaceitável. Bancos de dados tradicionais que acoplam computação e armazenamento forçam você a provisionar para a carga máxima e pagar por essa capacidade o tempo todo. O modelo serverless do Lakebase, que desacopla totalmente a computação do armazenamento e escala para zero entre as rajadas, foi a resposta que sempre precisamos, mas não tivemos acesso quando estávamos construindo o QRadar. Correspondeu exatamente ao problema.

O que torna o Lakebase a escolha certa

O Lakebase é uma nova categoria de arquitetura de banco de dados operacional que desagrega a computação do armazenamento, permitindo que a computação escale elasticamente com a demanda da carga de trabalho, enquanto o estado durável reside independentemente em uma camada de armazenamento replicada. Construída sobre a base aberta do PostgreSQL, a arquitetura lakebase preserva tudo o que os desenvolvedores confiam em um banco de dados relacional comprovado, eliminando as restrições de infraestrutura que tornam os RDBMS monolíticos tradicionais a escolha errada para a velocidade e escala que os aplicativos modernos, agentes e IA exigem.

Autoscaling serverless e scale-to-zero

O comportamento do agente é notoriamente intermitente. Um fluxo de trabalho de agente pode ficar completamente inativo por horas e, em seguida, gerar centenas de gravações de rastreamento e leituras de aplicação em questão de segundos. O Lakebase provisiona dinamicamente recursos de computação no exato momento em que esses rastros inundam nosso sistema e desliga completamente quando a atividade para. Como o estado durável reside na camada de armazenamento, não no nó de computação, iniciar uma nova instância de computação não requer movimentação de dados. Ela simplesmente se conecta ao histórico existente do banco de dados e começa a servir consultas imediatamente.

Para uma startup operando em escala empresarial, essa é a diferença entre infraestrutura que corresponde ao uso real e infraestrutura que penaliza você por ter períodos de inatividade. Nossos custos operacionais permanecem perfeitamente alinhados com as cargas de trabalho que estamos realmente servindo.

Latência de leitura de milissegundos para dados operacionais quentes

A preocupação natural com qualquer banco de dados desagregado é a latência de leitura. O Lakebase aborda isso através de uma camada de cache entre a computação e o armazenamento que mantém os dados quentes próximos à computação.

Para as consultas de aplicação do LangGuard, buscas indexadas precisas contra as tabelas de contexto e política do GRAIL™, esperamos que o conjunto de trabalho ativo caiba confortavelmente na memória local da computação. Essa arquitetura nos dá a confiança de que as decisões de governança podem ser aplicadas na velocidade do fluxo de trabalho, sem adicionar latência significativa à execução do agente.

Ramificação instantânea do banco de dados para teste de políticas de governança

A ramificação instantânea do banco de dados do Lakebase é uma de suas capacidades operacionais mais valiosas para um produto de governança. Quando criamos um branch, nenhum dado é fisicamente copiado. O branch diverge do estado atual do banco de dados usando semântica de cópia na gravação, consumindo armazenamento apenas para dados novos ou modificados. Nossos desenvolvedores podem criar uma réplica isolada e exata de nossos dados de rastreamento de produção em segundos, testar novas políticas de governança contra o comportamento real do agente e validar a lógica de aplicação sem arriscar a estabilidade do ambiente ao vivo.

PostgreSQL: uma base comprovada

O Lakebase é construído sobre o PostgreSQL, o banco de dados relacional de código aberto mais avançado do mundo, com décadas de robustez em produção em todos os setores. Para o LangGuard, isso significa compatibilidade total com as ferramentas, bibliotecas e extensões que nossa equipe já conhece, sem linguagem de consulta proprietária ou risco de migração.

Como LangGuard e Databricks Trabalham Juntos

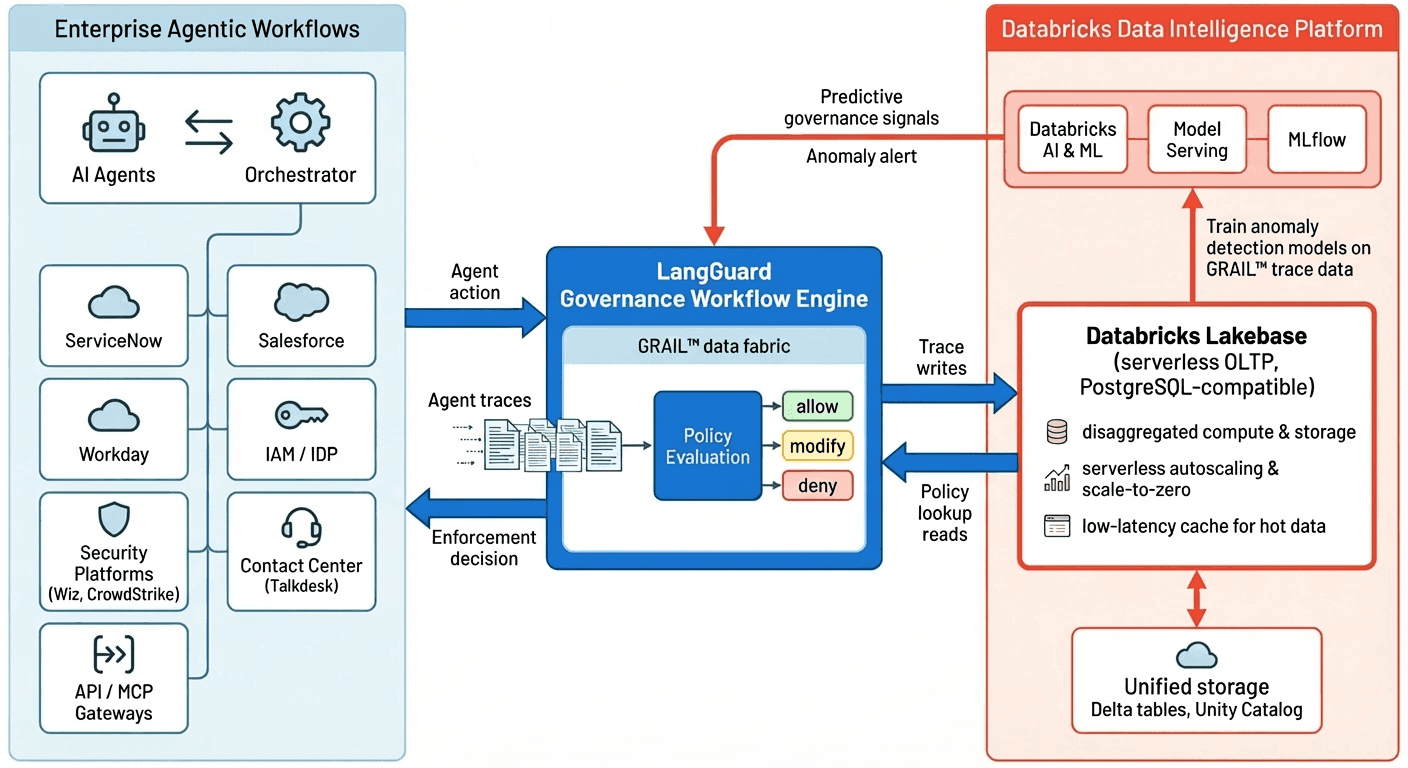

A arquitetura conjunta LangGuard e Databricks é projetada para governar fluxos de trabalho agênticos empresariais de ponta a ponta, mantendo todos os dados operacionais em uma única plataforma de dados e IA confiável. À esquerda da arquitetura estão os próprios fluxos de trabalho agênticos empresariais: agentes de IA e seus orquestradores interagindo com dezenas de sistemas de registro, como gerenciamento de serviços de TI, CRM, RH, identidade, segurança, contact center e gateways de API/MCP. Cada ação do agente, invocação de ferramenta e solicitação de acesso a dados gera eventos de rastreamento ricos que fluem para o LangGuard em tempo real.

No centro do diagrama está o LangGuard Governance Workflow Engine, alimentado pelo GRAIL™ data fabric, com patente pendente. O GRAIL captura cada ação do agente como dados de rastreamento multidimensionais e constrói um grafo de conhecimento ao vivo do comportamento e contexto do fluxo de trabalho. Quando um agente tenta chamar uma ferramenta, acessar um conjunto de dados ou invocar um modelo, o LangGuard realiza uma avaliação de política contra esse contexto ao vivo e as regras de governança relevantes, retornando uma decisão de permitir/negar/modificar antes que a ação seja executada. Isso oferece às empresas um único ponto de controle para aplicar políticas em todos os sistemas que o fluxo de trabalho toca, independentemente de onde os agentes subjacentes estejam em execução.

À direita, o Databricks Lakebase serve como o sistema operacional de registro para os dados de rastreamento e política do LangGuard. A arquitetura serverless e PostgreSQL do Lakebase desagrega a computação do armazenamento, permitindo autoscaling elástico e scale-to-zero entre rajadas de atividade do agente, mantendo os dados operacionais quentes em um cache de baixa latência próximo à computação. O LangGuard grava continuamente eventos de rastreamento no Lakebase e realiza leituras de baixa latência para consultas de políticas de governança e consultas contextuais, garantindo que as decisões de aplicação possam ser tomadas na velocidade do fluxo de trabalho sem provisionar em excesso a capacidade do banco de dados.

Como os dados operacionais do LangGuard residem nativamente no Lakebase, eles estão imediatamente disponíveis para a plataforma mais ampla Databricks Data Intelligence Platform para análise e IA sem ETL adicional. O Databricks AI, Model Serving e MLflow podem treinar e implantar modelos de detecção de anomalias diretamente nos dados de rastreamento do GRAIL para identificar agentes que se desviam de sua linha de base comportamental estabelecida. Esses sinais preditivos retornam ao LangGuard Governance Engine, fechando o ciclo entre a aplicação em tempo real e o monitoramento preditivo, permitindo que as empresas passem de controles reativos para governança de IA proativa baseada em comportamento em uma única plataforma.

O que vem a seguir: governança preditiva para fluxos de trabalho agênticos

O mecanismo do LangGuard hoje aplica políticas estabelecidas em tempo de execução em todo o fluxo de trabalho. A próxima evolução é preditiva: treinar modelos comportamentais em dados históricos de rastreamento do GRAIL para detectar comportamento anômalo do agente antes que ele se manifeste como uma violação de política.

Como nossos dados operacionais de rastreamento já residem no ecossistema Databricks, conforme descrito acima, podemos passar diretamente da aplicação para a predição sem construir pipelines de ETL separados ou configurar uma segunda plataforma analítica.

Se um agente começar a agir de forma errática ou se desviar de sua linha de base estabelecida, esses modelos o sinalizarão como uma anomalia antes que qualquer dano seja feito. Essa convergência de aplicação em tempo real e aprendizado de máquina preditivo é o futuro da governança de IA empresarial, e é a arquitetura que estamos construindo hoje.

| PRINCIPAL CONCLUSÃO |

|---|

| LangGuard é uma das primeiras startups a construir infraestrutura de produção no Databricks Lakebase. A escolha foi impulsionada por um conjunto específico de requisitos inegociáveis: aplicação de baixa latência, tratamento elástico de picos e teste de políticas de governança contra dados reais. Apenas um banco de dados OLTP sem servidor poderia satisfazer a todos eles. Lakebase é o primeiro banco de dados a atender a todos eles. |

| Para empresas que precisam governar fluxos de trabalho de agentes de ponta a ponta, em todos os agentes, ferramentas, credenciais e sistemas de registro na cadeia, essa arquitetura significa aplicação que opera na velocidade do fluxo de trabalho, escala com a complexidade da implantação e evolui para segurança comportamental preditiva sem exigir uma plataforma de dados separada. |

Pronto para governar seus fluxos de trabalho de agentes de ponta a ponta? Visite langguard.ai para saber como o LangGuard protege, controla e opera fluxos de trabalho de agentes empresariais com total conformidade de políticas, ou explore o Databricks Lakebase para ver como a infraestrutura OLTP sem servidor impulsiona a governança de IA em tempo real em escala.

Saiba mais sobre LangGuard Explore o Databricks Lakebase

(Esta publicação no blog foi traduzida utilizando ferramentas baseadas em inteligência artificial) Publicação original

Receba os posts mais recentes na sua caixa de entrada

Assine nosso blog e receba os posts mais recentes diretamente na sua caixa de entrada.