Proteção contra Exfiltração de Dados com a Plataforma Databricks Lakehouse na AWS

Saiba como configurar uma arquitetura segura no Databricks na AWS para se proteger contra a exfiltração de dados

Embora este guia contenha detalhes técnicos valiosos específicos da nuvem, agora recomendamos nossa Abordagem Unificada para Proteção contra Exfiltração de Dados no Databricks, que fornece uma estrutura abrangente para AWS, Azure e GCP com controles priorizados e orientação de implementação.

A Plataforma Databricks Lakehouse oferece um conjunto unificado de ferramentas para construir, implantar, compartilhar e manter soluções de dados de nível empresarial em escala. O Databricks se integra ao armazenamento em nuvem e à segurança em sua conta de nuvem, e gerencia e implanta infraestrutura de nuvem em seu nome.

O objetivo principal deste artigo é mitigar os seguintes riscos:

- Acesso a dados de um navegador na internet ou de uma rede não autorizada usando o aplicativo web Databricks.

- Acesso a dados de um cliente na internet ou de uma rede não autorizada usando a API Databricks.

- Acesso a dados de um cliente na internet ou de uma rede não autorizada usando o Armazenamento em Nuvem (S3).

- Uma carga de trabalho comprometida no cluster Databricks gravando dados em um recurso de armazenamento não autorizado na AWS ou na internet.

Protegendo Dados em Trânsito e em Repouso com Ferramentas Nativas da AWS no Databricks

O Databricks suporta várias ferramentas e serviços nativos da AWS que ajudam a proteger dados em trânsito e em repouso.

Grupos de Segurança

Grupos de Segurança são firewalls virtuais com estado anexados a instâncias EC2. Eles permitem definir qual tráfego de entrada e saída é permitido. O estreitamento das regras de saída (outbound) restringe as instâncias EC2 de enviar dados para endereços IP não autorizados ou para a internet pública, bloqueando efetivamente vazamentos de dados não intencionais.

- Previne: Conexões de saída não autorizadas de recursos de computação Databricks.

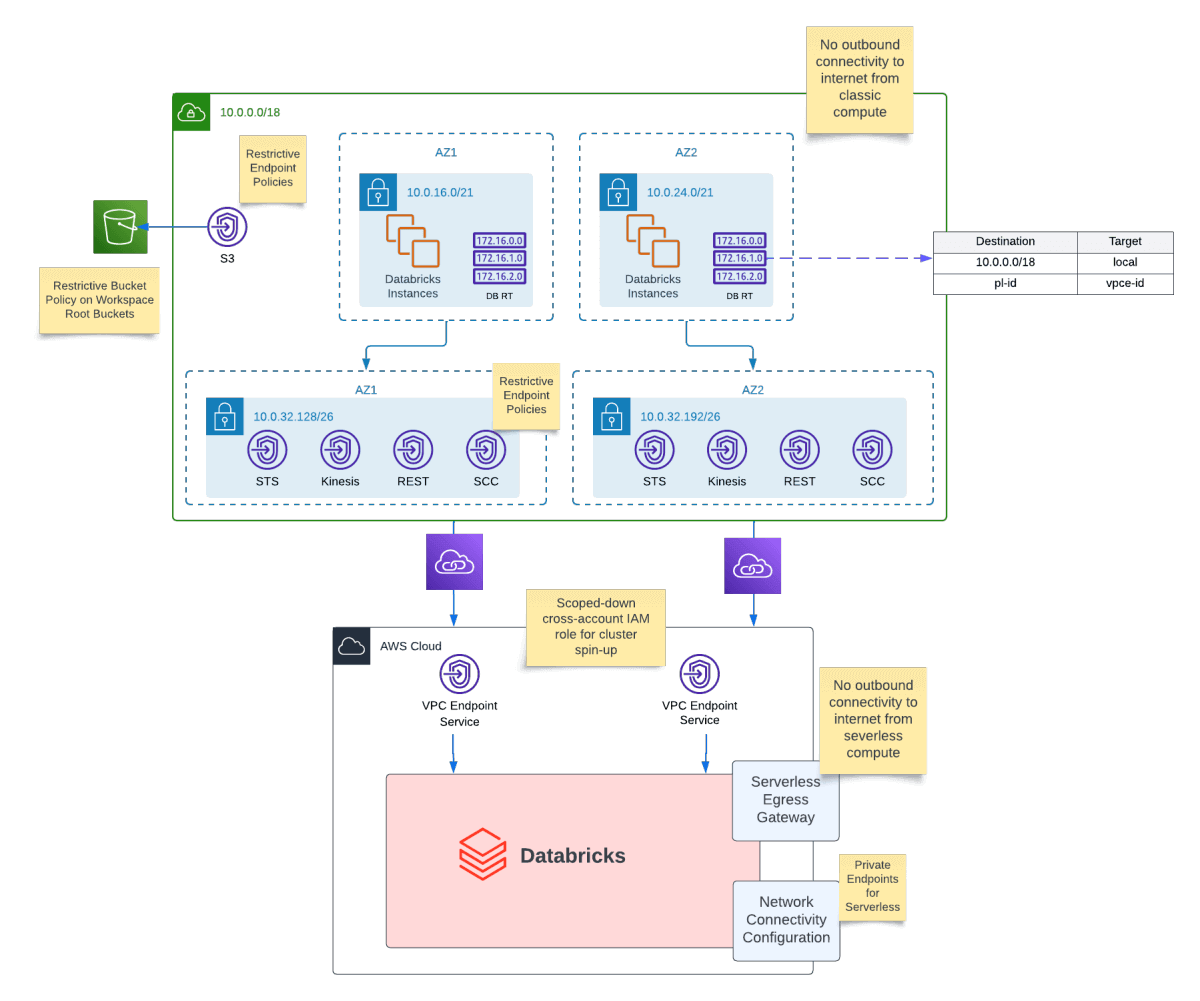

Políticas de Endpoint de VPC

Políticas de endpoint de VPC controlam o acesso a serviços da AWS através de endpoints de VPC. Ao permitir apenas operações necessárias em recursos específicos da AWS (como buckets S3), você pode impedir que workspaces Databricks exfiltrem dados para outras contas ou serviços da AWS.

- Previne: Que o Databricks envie dados para serviços ou recursos não autorizados da AWS.

Endpoints de VPC

Endpoints de VPC estabelecem conexões privadas entre sua VPC e outros serviços da AWS sem atravessar a internet pública. Isso garante que dados confidenciais nunca sejam expostos a redes externas, mitigando riscos de exfiltração de dados por rotas de internet.

- Previne: Exposição de tráfego à internet pública durante a comunicação de serviços.

- Documentação: AWS VPC Endpoints

Funções IAM

Funções IAM permitem controlar a quais recursos da AWS o Databricks pode acessar e quais ações ele pode executar. O uso cuidadoso de políticas de confiança e permissão garante que usuários e clusters Databricks só possam interagir com recursos explicitamente autorizados, bloqueando o uso de buckets S3 não autorizados ou serviços externos.

- Previne: Gravações de dados em recursos não autorizados da AWS usando credenciais comprometidas ou excessivamente permissivas.

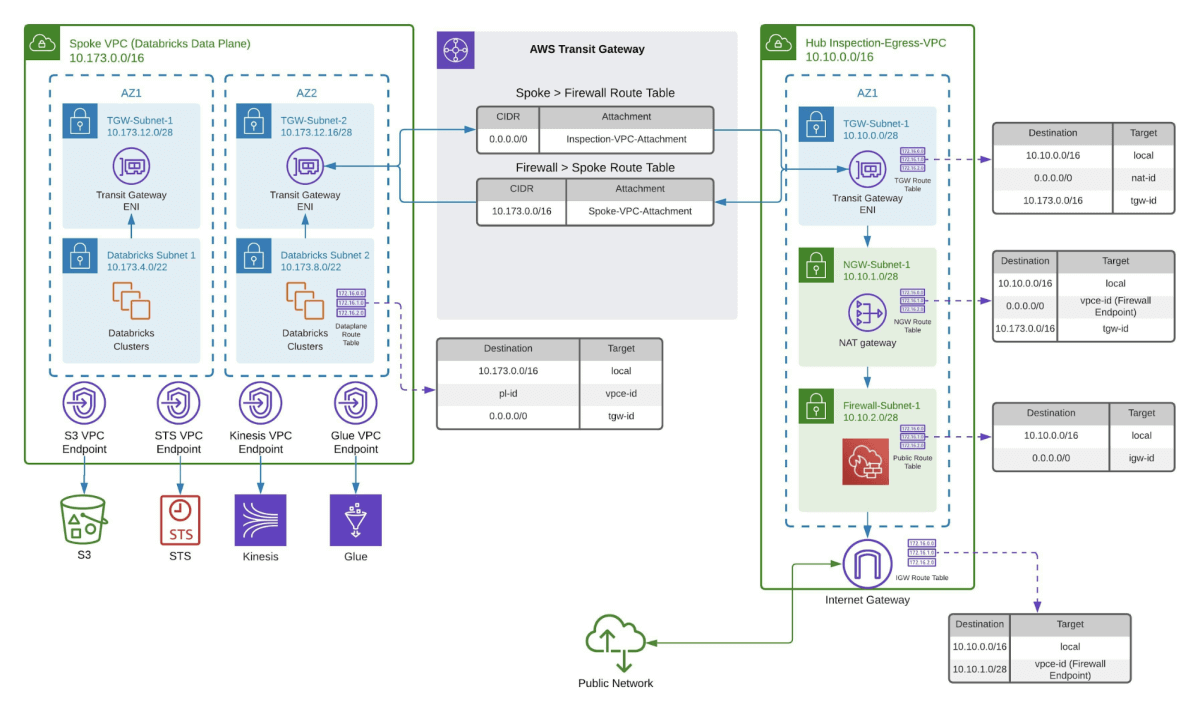

Tabelas de Rota

Tabelas de Rota determinam o fluxo de tráfego de rede dentro de sua VPC. Ao impedir rotas de saída para a internet (ou permitindo apenas destinos necessários), você controla para onde os dados podem viajar, reduzindo o risco de que os dados sejam roteados para locais inseguros.

- Previne: Caminhos de rede para a internet pública ou redes não autorizadas.

AWS PrivateLink

AWS PrivateLink permite conectividade privada entre VPCs e serviços da AWS através de interfaces de rede dedicadas e criptografadas, eliminando a exposição à internet pública. Isso fornece um caminho seguro para os planos de controle e dados do Databricks, tornando mais difícil que os dados vazem para fora da AWS.

- Previne: Interceptação ou exfiltração de dados em redes públicas.

Sub-redes Privadas

Sub-redes privadas não têm rota direta para a internet, o que significa que os recursos dentro delas não podem iniciar conexões de saída para a internet. Essa barreira arquitetônica impede que clusters e nós enviem dados diretamente para fora da AWS.

- Previne: Qualquer comunicação de saída pela internet de recursos de computação.

Chaves KMS

O AWS Key Management Service (KMS) permite criptografar dados em repouso, inclusive em buckets S3. Mesmo que os dados sejam acessados, eles permanecem protegidos, a menos que o invasor também tenha acesso às chaves de criptografia.

- Previne: Exfiltração utilizável de dados sem comprometer o material da chave.

Políticas de Bucket S3

Essas políticas de recursos concedem ou negam acesso a buckets S3 específicos. Ao limitar o acesso apenas a fontes aprovadas (como da VPC Databricks ou funções IAM específicas), elas garantem que, mesmo que alguém tente exfiltrar, não consiga gravar ou copiar dados confidenciais para fora dos buckets controlados.

- Previne: Gravações/leituras de locais S3 indesejados.

Cada um desses controles, individualmente e em conjunto, impõe uma abordagem de defesa em profundidade contra a exfiltração de dados, garantindo múltiplos pontos de verificação antes que os dados possam sair de seu ambiente protegido.

A criptografia é outro componente importante da proteção de dados. O Databricks suporta várias opções de criptografia, incluindo chaves de criptografia gerenciadas pelo cliente, rotação de chaves, criptografia em repouso e em trânsito. As chaves de criptografia gerenciadas pelo Databricks são usadas por padrão e ativadas imediatamente; os clientes também podem trazer suas próprias chaves de criptografia.

Registro de Auditoria

O registro de auditoria é uma capacidade fundamental de segurança e conformidade, permitindo que as organizações rastreiem atividades do usuário, ações administrativas e eventos do sistema em todo o ambiente Databricks. No contexto de exfiltração de dados, os logs de auditoria desempenham um papel crítico ao permitir a detecção, investigação e resposta a ameaças potenciais ou comportamentos inadequados.

Os logs de auditoria ajudam a responder a perguntas fundamentais como:

- Quem acessou quais dados e quando?

- Quais operações (leitura, escrita, modificação, exclusão) foram realizadas?

- Houve tentativas de acessar ou exportar dados confidenciais fora da política?

Ao rastrear esses eventos, os logs de auditoria suportam tanto o monitoramento de segurança quanto o relatório de conformidade.

Capacidades de Registro de Auditoria do Databricks

O Databricks fornece recursos robustos de registro de auditoria nos níveis de workspace e de conta. As principais capacidades incluem:

- Logs de auditoria em nível de workspace: Capturam ações de usuários e sistemas dentro de um workspace Databricks.

- Logs de auditoria em nível de conta: Rastreiam ações em todos os workspaces da conta.

- Logs de auditoria verbosos: Captura de eventos opcional e mais granular para visibilidade mais profunda.

- Integração com tabelas do sistema Unity Catalog: Exibem logs de acesso, computação, consulta, serviço e armazenamento como parte de fluxos de trabalho de governança de dados e investigação.

Os logs de auditoria podem ser entregues a um bucket Amazon S3 designado pelo cliente em tempo quase real. Eles podem ser integrados diretamente com sistemas SIEM ou de análise de segurança para monitoramento contínuo e alertas.

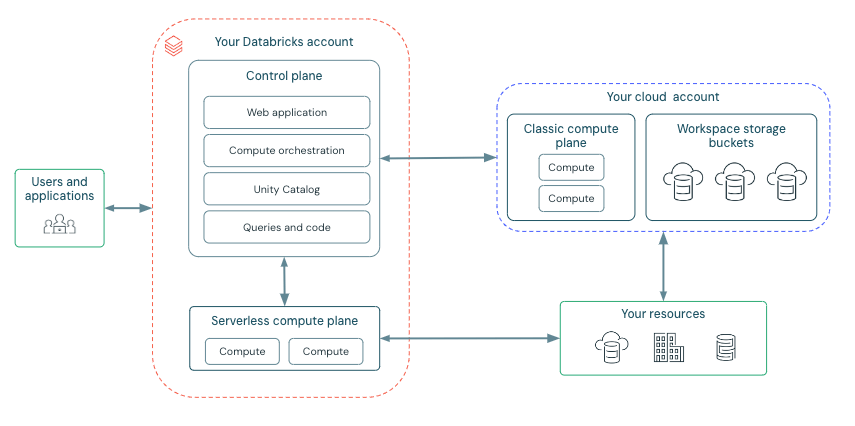

Arquitetura Databricks

Antes de começarmos, vamos dar uma olhada rápida na arquitetura de implantação do Databricks aqui:

O Databricks é estruturado para permitir colaboração segura entre equipes multifuncionais, mantendo uma quantidade significativa de serviços de back-end gerenciados pelo Databricks para que você possa se concentrar em suas tarefas de ciência de dados, análise de dados e engenharia de dados.

O Databricks opera a partir de um plano de controle e um plano de computação.

- O plano de controle inclui os serviços de back-end que o Databricks gerencia em sua própria conta AWS Cloud. Comandos de notebook e muitas outras configurações de workspace são armazenados no plano de controle e criptografados em repouso.

- O plano de computação, onde seus dados são processados, tem tipos diferentes dependendo da computação específica que você está usando. Você pode encontrar mais informações sobre esses tipos de computação.

- Para computação serverless, os recursos de computação serverless são executados em um plano de computação serverless em sua conta Databricks.

- Para computação Databricks clássica, os recursos de computação estão em sua conta AWS Cloud.

Arquitetura de Alto Nível

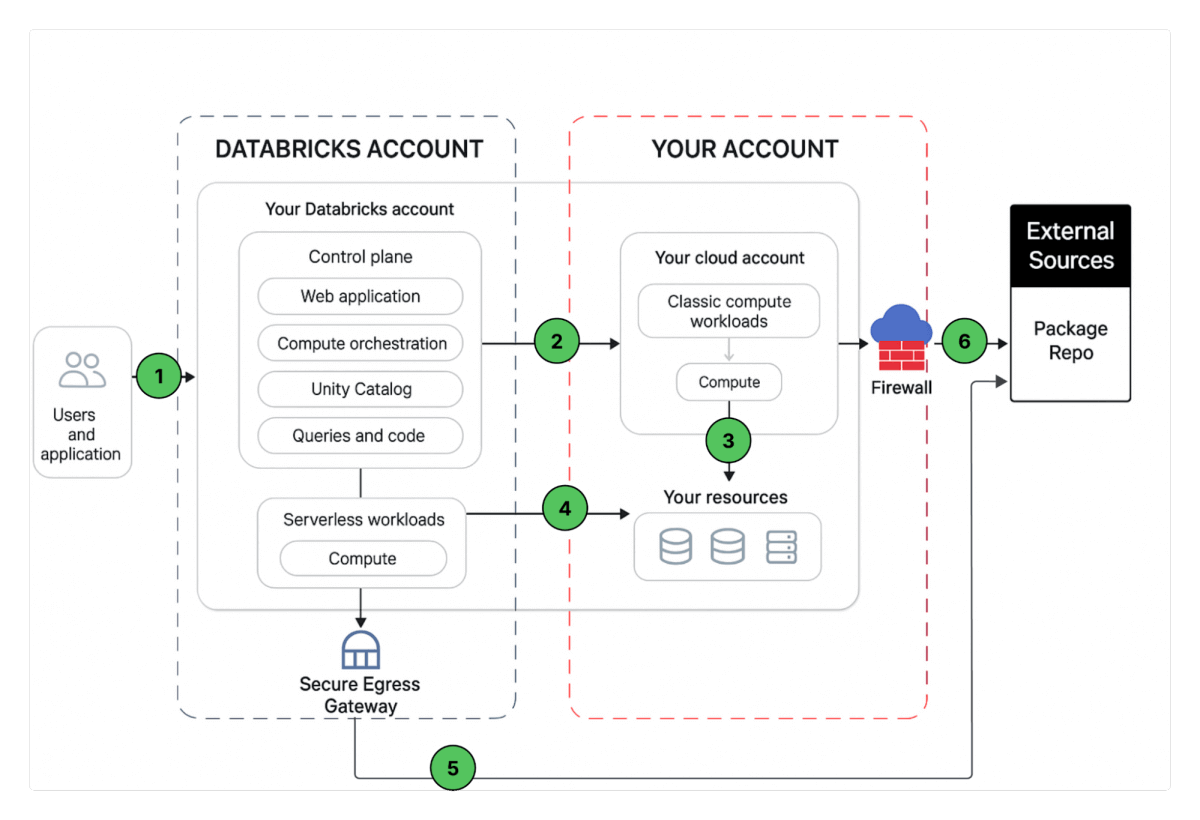

Caminho de Comunicação de Rede

Para entender as medidas de segurança que pretendemos implementar, vamos examinar as várias maneiras pelas quais usuários e aplicativos interagem com o Databricks, conforme ilustrado abaixo.

Uma implantação de workspace Databricks inclui os seguintes caminhos de rede que você pode proteger.

- Usuário ou Aplicações para a aplicação web do Databricks, também conhecida como workspace ou APIs REST do Databricks.

- Rede VPC da camada de computação clássica do Databricks para o serviço da camada de controle do Databricks. Isso inclui o relay de conectividade segura de cluster e a conexão do workspace para os endpoints da API REST.

- Camada de computação clássica para seus serviços de armazenamento (ex: S3, Kinesis, etc).

- Camada de computação serverless para seus serviços de armazenamento (ex: S3, Kinesis, etc).

- Egress seguro da camada de computação serverless via políticas de rede (firewall de egress) para fontes de dados externas, por exemplo, repositórios de pacotes como pypi ou maven.

- Egress seguro da camada de computação clássica via firewall de egress para fontes de dados externas, por exemplo, repositórios de pacotes como pypi ou maven.

Da perspectiva dos usuários finais, 1 requer controles de entrada e 2, 3, 4, 5, 6 controles de saída.

Neste artigo, nossa área de foco é proteger o tráfego de saída dos seus workloads Databricks, fornecer ao leitor orientações prescritivas sobre a arquitetura de implantação proposta e, enquanto estamos nisso, compartilharemos também as melhores práticas para proteger o tráfego de entrada (usuário/cliente para Databricks).

Arquitetura de Implantação Proposta - Arquitetura de Referência de Segurança AWS

Implantar o Databricks de forma segura na AWS pode parecer complexo; você precisa de VPCs, roles IAM, rede privada, Unity Catalog e salvaguardas que se alinhem com a segurança corporativa. A Arquitetura de Referência de Segurança (SRA) Databricks para AWS agrupa essas melhores práticas em templates Terraform prontos para uso, oferecendo às equipes um ponto de partida robusto para implantações em produção.

O que é

- Módulos Terraform opinativos para Databricks seguro na AWS.

- Cobre rede, IAM, Unity Catalog, políticas prontas para uso.

- Atua como um blueprint focado em segurança para acelerar a adoção.

Por que importa

- Velocidade: Automatiza a infraestrutura + configuração do workspace em minutos.

- Segurança: VPCs pré-configuradas, rede privada, logs de auditoria.

- Escalabilidade: Padrões reutilizáveis entre contas/workspaces.

Estrutura geral do repositório

- aws/ → Criação de infraestrutura AWS + workspace.

- /modules/databricks_account/unity_catalog_metastore_creation/ → criação de metastore

- aws/tf/modules/sra/credential.tf → role cross-account usando ID externo

- template.tfvars.example → preencha suas variáveis

O que você obtém

- VPCs AWS, subnets, roles IAM.

- Workspaces Databricks conectados ao Unity Catalog.

- Opções robustas: egress restrito, logging, monitoramento.

Como usar

- Clone o repositório.

- Preencha suas variáveis em template.tfvars.example

- Modifique os parâmetros de VPC, subnet e nome onde necessário

- Estenda para CI/CD para implantações corporativas repetíveis.

Observações

- Snapshot pontual, revise antes de atualizações.

- Não é “gerenciado” → equipes são responsáveis por testes e adaptação.

- Requer conhecimento de Terraform + AWS + provedor Databricks.

Se você precisar de acesso à internet para pypi ou maven, recomendamos a seguinte arquitetura para que você possa inspecionar qualquer tráfego que saia da sua VPC e, assim, analisar qualquer tráfego de saída. Vários serviços AWS podem ser usados para inspecionar o tráfego de saída para sua VPC. Por exemplo, AWS Network Firewall ou Gateway Load Balancer. Recomendamos seguir a documentação da AWS, por exemplo aqui, para começar com sua configuração do AWS Network Firewall.

Controles de Proteção contra Exfiltração de Dados no Databricks

Além de monitorar o tráfego de saída, implemente os seguintes controles para reforçar seu ambiente Databricks contra exfiltração de dados. Por favor, tenha em mente que alguns recursos, como private link, são suportados apenas no tier Enterprise do Databricks:

Provisionamento SCIM

Automatize o gerenciamento do ciclo de vida de usuários e grupos do seu IdP para o Databricks.

Guia de Provisionamento SCIM

Single Sign-On (SSO)

Exija autenticação centralizada através do seu provedor de identidade (SAML ou OIDC).

Configuração de SSO

Autenticação Multifator (MFA)

Exija MFA no nível do IdP para adicionar uma camada extra de segurança de login.

Autenticação Multifator

Listas de Controle de Acesso (ACLs) de IP do Console da Conta

Restrinja o acesso ao console da conta Databricks definindo intervalos de IP permitidos.

Listas de Acesso por IP

Endpoints Privados na Configuração de Conectividade de Rede

Garanta que o tráfego do workspace flua apenas através de endpoints privados (sem internet pública).

Configuração de Conectividade de Rede

Controles de Egress Serverless

Aplique restrições para limitar destinos externos da computação serverless do Databricks.

Segurança de Computação Serverless

Evite Armazenar Dados de Produção no DBFS

Não persista datasets sensíveis no DBFS; use armazenamento seguro (ex: S3, ADLS).

Visão Geral do DBFS

Tempo de Vida do Token do Destinatário do Delta Sharing

Encurte a validade do token para Delta Sharing para reduzir a exposição caso seja vazado.

Segurança do Delta Sharing

Isole Workloads Sensíveis em Redes Diferentes

Use VPCs/subnets separadas para isolar logicamente e fisicamente os workloads.

Isole Workloads Sensíveis em Workspaces Diferentes

Implante múltiplos workspaces (prod, dev, test) para impor a separação de ambientes.

Estratégia Multi-Workspace

Federação de Tokens OIDC para CI/CD

Use federação OIDC para trocar tokens de curta duração de forma segura quando pipelines de CI/CD interagem com o Databricks.

Federação de Tokens OIDC

A aplicação conjunta desses controles fornece defesa em profundidade em camadas, minimizando o risco de vazamento acidental ou malicioso de dados.

Add-ons com Conformidade de Segurança e Monitoramento Aprimorados:

Se sua organização tiver requisitos de segurança elevados, como a necessidade de suportar HIPAA, PCI ou padrões igualmente rigorosos, considere habilitar o Monitoramento de Segurança Aprimorado para seus workloads Databricks.

Este recurso avançado se baseia nas capacidades de segurança principais do Databricks para fornecer visibilidade mais profunda, detecção proativa de ameaças e endurecimento adicional para ambientes de computação clássicos e serverless. O Monitoramento de Segurança Aprimorado oferece benefícios como Canonical Ubuntu com endurecimento Nível 1 do CIS, monitoramento contínuo de malware e integridade de arquivos baseado em comportamento, varredura abrangente de antivírus e malware, e relatórios detalhados de vulnerabilidade para o sistema operacional do host.

Com esta funcionalidade ativada (através do perfil de segurança de conformidade), logs de eventos de segurança, incluindo alertas para escalonamentos de privilégio, shells interativos suspeitos, conexões de saída não autorizadas, alterações inesperadas em arquivos do sistema ou tentativas potenciais de exfiltração, são registrados automaticamente. Esses logs são entregues juntamente com os logs de auditoria padrão do Databricks, fornecendo informações ricas e contextuais para o SIEM da sua organização ou dentro do próprio Databricks. Isso permite que analistas de segurança rastreiem e respondam rapidamente a comportamentos anômalos ou arriscados, apoiando a detecção imediata e a resposta rápida a incidentes sem a necessidade de investigações extensas.

Conclusão e Próximos Passos

Uma defesa forte contra exfiltração de dados para Databricks na AWS não é uma configuração única, requer melhoria contínua. Além de implementar controles arquiteturais, torne o monitoramento contínuo, a auditoria rigorosa e o gerenciamento proativo de mudanças centrais em sua prática de segurança. Revisar regularmente os logs de auditoria, atualizar as políticas de acesso e de rede, e colaborar com as equipes de segurança e conformidade ajuda a garantir que as proteções evoluam para combater ameaças emergentes. Para aprofundar sua estratégia, consulte recursos confiáveis sobre melhores práticas de monitoramento na nuvem e logs de auditoria. Essas referências o ajudarão a manter a vigilância e a resiliência à medida que seu cenário de dados e riscos aumentam.

(Esta publicação no blog foi traduzida utilizando ferramentas baseadas em inteligência artificial) Publicação original

Receba os posts mais recentes na sua caixa de entrada

Assine nosso blog e receba os posts mais recentes diretamente na sua caixa de entrada.