Apresentando o Databricks AI Security Framework (DASF)

Um framework acionável para gerenciar a segurança de IA

por Omar Khawaja, Arun Pamulapati, Kelly Albano e Erika Ehrli

Temos o prazer de anunciar o lançamento do whitepaper Databricks AI Security Framework (DASF) versão 1.0! O framework foi projetado para melhorar o trabalho em equipe entre os grupos de negócios, TI, dados, IA e segurança. Ele simplifica os conceitos de IA e ML, catalogando a base de conhecimento de riscos de segurança de IA com base em observações de ataques do mundo real, oferece uma abordagem de defesa em profundidade para a segurança de IA e fornece conselhos práticos para aplicação imediata.

Machine learning (ML) e IA generativa (GenAI) estão transformando o futuro do trabalho, aprimorando a inovação, a competitividade e a produtividade dos funcionários. No entanto, as organizações estão lidando com o duplo desafio de alavancar tecnologias de inteligência artificial (IA) para oportunidades, ao mesmo tempo em que gerenciam riscos potenciais de segurança e privacidade, como violações de dados e não conformidade regulatória.

Este blog apresentará uma visão geral do DASF, como utilizá-lo para proteger as iniciativas de IA de sua organização, compartilhará uma atualização sobre nosso momentum externo e guiará de forma segura a adoção de IA em sua organização.

Construindo a base do Databricks AI Security Framework

A IA está impactando todas as indústrias e transformando a maneira como trabalhamos. Mais do que nunca, os líderes querem alavancar dados e IA para transformar suas organizações. Segurança e Governança de IA são críticas para estabelecer confiança nos objetivos de IA de sua organização. De acordo com o Gartner, gerenciamento de confiança, risco e segurança de IA é a tendência estratégica nº 1 em 2024 que influenciará as decisões de negócios e tecnologia, e até 2026, modelos de IA de organizações que operacionalizam transparência, confiança e segurança de IA alcançarão um aumento de 50% em adoção, metas de negócios e aceitação do usuário.

No início deste ano, anunciamos a aquisição da MosaicML pela Databricks e compartilhamos mais sobre nosso compromisso com IA Responsável. Nos últimos meses, temos continuado a fortalecer nosso compromisso e momentum como líder da indústria em IA por meio de novas parcerias. Para complementar esses investimentos, a equipe de Segurança da Databricks agora oferece workshops de Segurança de IA para CISOs para educar as organizações sobre como gerenciar com sucesso sua jornada de IA de forma consciente em relação aos riscos. Aprendemos com nossos clientes que as equipes de segurança e governança lutam para encontrar material confiável que desmistifique o que é IA, como funciona e quais riscos de segurança podem surgir à medida que essas tecnologias são implementadas.

Levamos esses aprendizados para desenvolver o framework DASF para ajudar as equipes de negócios, TI, dados, IA e segurança a trabalharem melhor juntas na implantação de IA sob os seguintes princípios:

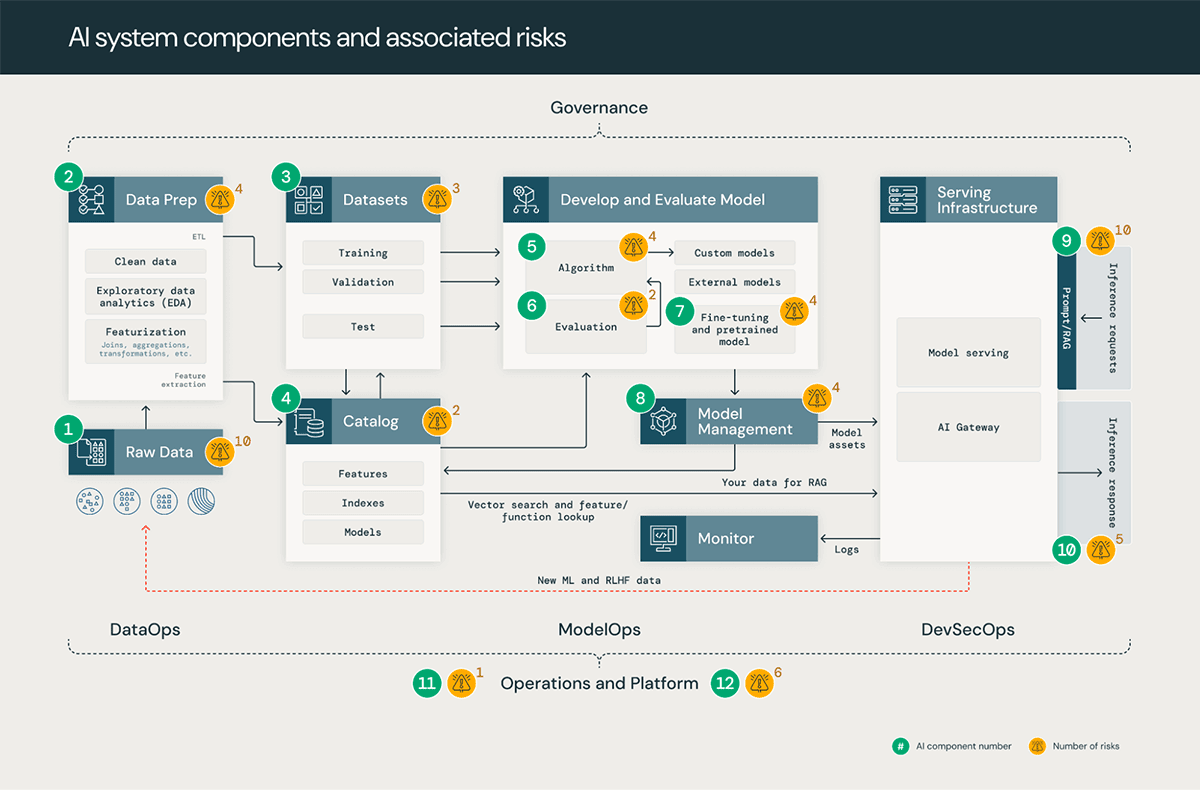

- Desmistificar IA e ML: O DASF detalha os 12 componentes de um sistema de IA, os tipos de modelos de IA existentes e como todos eles funcionam juntos. Isso ajuda na capacidade das equipes de trabalhar juntas, definindo uma nomenclatura comum dos sistemas, processos e personas de IA envolvidos.

- Fornecer uma abordagem de defesa em profundidade para proteger a IA: Em nossas conversas com líderes de segurança, há necessidade de clareza sobre se a segurança de IA é um problema de cibersegurança, um problema de machine learning adversarial ou algo totalmente novo. A realidade é que é tudo isso. O DASF fornece um framework para entender os 55 riscos de segurança nas três fases de qualquer sistema de IA com base em seus casos de uso específicos de IA e modelos de implantação. Também mapeamos os riscos para frameworks comuns de segurança de IA como MITRE ATLAS, OWASP Top 10 para LLMs e NIST AML Taxonomy.

- Entregar recomendações acionáveis: Muitos frameworks existentes fazem um bom trabalho ao delinear os riscos associados à IA, mas não delineiam claramente os controles necessários para mitigá-los. O DASF recomenda 53 controles aplicáveis a qualquer plataforma de dados e IA que você use. Se você é um cliente Databricks, vamos um passo adiante: incluímos links para a documentação da Databricks (por nuvem) para fornecer instruções específicas sobre como implementar cada controle de mitigação!

Começando com o Databricks AI Security Framework

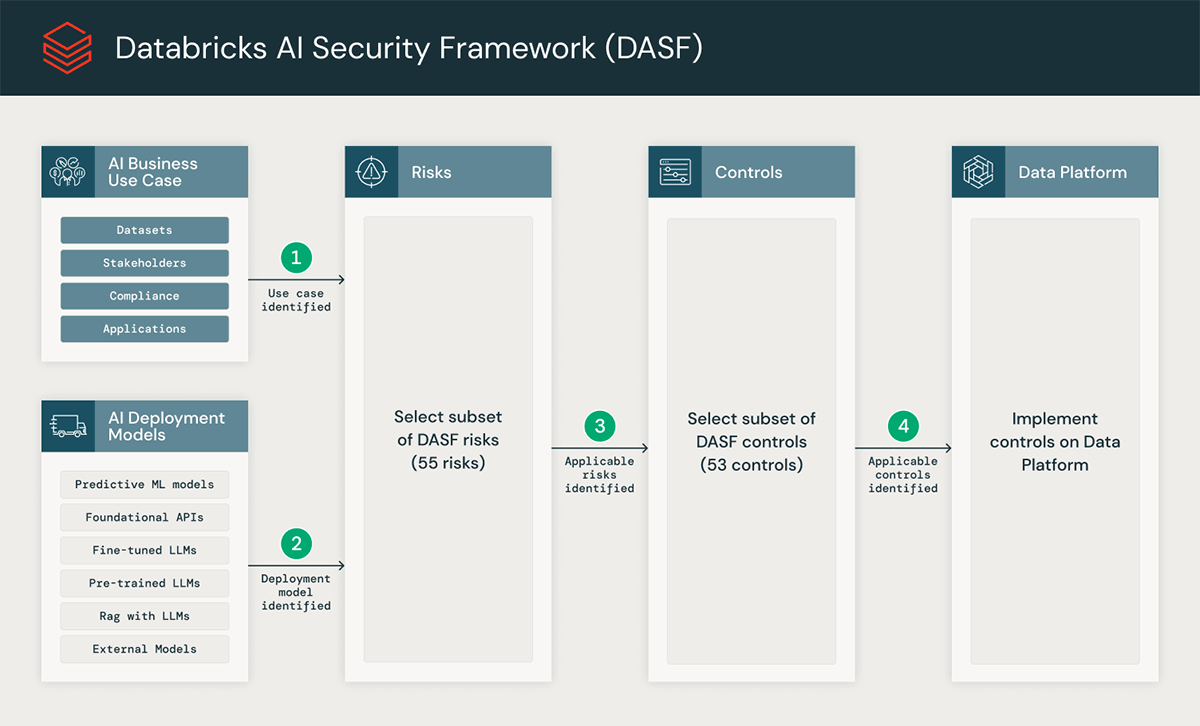

O DASF foi projetado para que, independentemente da plataforma de dados e IA que você use, você possa sair com um perfil de risco ponta a ponta para as necessidades de implantação de IA de sua organização, com um conjunto concreto de controles que você deve considerar implementar. Para começar com o DASF, recomendamos a seguinte abordagem, conforme ilustrado na figura abaixo:

Passo 1 - Identifique o caso de uso de negócios de IA: Trabalhe com seus stakeholders, seja já implementado ou em fases de planejamento, sobre os casos de uso de IA de sua organização. Recomendamos o uso de Databricks Solution Accelerators, que são guias criados especificamente para acelerar resultados nos seus casos de uso de IA e ML mais comuns e de alto impacto. Revise quais datasets serão usados, quais requisitos de conformidade podem se aplicar e quais aplicações esses sistemas de IA impactarão para chegar às capacidades básicas necessárias de sua plataforma de dados e IA.

Passo 2 - Determine o modelo de implantação de IA: Escolha um modelo de implantação apropriado, como modelos de ML preditivos, RAG-LLMs, LLMs ajustados (fine-tuned), LLMs pré-treinados, modelos fundacionais e modelos externos. Cada modelo de implantação tem uma divisão variável de responsabilidade compartilhada entre os 12 componentes do sistema de IA e entre sua organização, sua plataforma de dados e IA, e quaisquer parceiros envolvidos.

Passo 3 - Selecione os riscos mais pertinentes: Da nossa lista documentada de 55 riscos de segurança, identifique os mais relevantes para sua organização com base no caso de uso e modelo de implantação que sua organização está implementando. Para a maioria dos casos de uso, apenas um pequeno subconjunto dos 55 riscos precisará ser abordado.

Passo 4 - Escolha e implemente controles: Selecione controles que se alinhem com o apetite de risco de sua organização. Esses controles são definidos genericamente para compatibilidade com qualquer plataforma de dados e IA. Nosso framework também fornece orientações sobre como adaptar esses controles especificamente para a Databricks Data Intelligence Platform com orientações específicas de implementação da Databricks por nuvem. Você usa esses controles em conjunto com as políticas de sua organização e tem a garantia correta implementada.

Se isso ainda parecer muito, continuaremos a realizar nossos workshops de Segurança de IA para aqueles que desejam uma experiência interativa.

Fomentando a segurança de IA através de aliados, parceiros e clientes da indústria

Na indústria de segurança, cultivar a colaboração entre pares é imperativo para garantir segurança, proteção e sucesso coletivos. Não poderíamos publicar um documento como o DASF hoje sem os padrões, frameworks e ferramentas de terceiros que nos precedem, como as Diretrizes para Desenvolvimento Seguro de Sistemas de IA, o NIST AI Risk Management Framework e o Multilayer Framework for Good Cybersecurity Practices for AI. Muitos outros são referenciados ao longo do DASF e podem ser revisados na seção de recursos.

Embora tenhamos realizado inúmeras revisões internas com nossos especialistas em IA, ML e segurança na Databricks, também nos reunimos com 15 líderes da indústria de segurança de IA, incluindo representantes da HITRUST, Carnegie Mellon University, Capital One, Protect AI e Barracuda (e mais citados abaixo!). Agradecemos a eles por seu tempo, insights e feedback sobre como tornar o DASF mais prático para nossos colegas. Uma lista completa de revisores pode ser encontrada em nossa seção de agradecimentos do DASF.

"Quando penso no que torna um bom acelerador, tudo se resume a tornar as coisas mais suaves, mais eficientes e a promover a inovação. O DASF é uma ferramenta comprovada e eficaz para as equipes de segurança ajudarem seus parceiros a aproveitar ao máximo a IA. Além disso, alinha-se com estruturas de risco estabelecidas como o NIST, portanto, não está apenas acelerando as coisas – está estabelecendo uma base sólida no trabalho de segurança." — Riyaz Poonawala, Vice President of Information Security, Navy Federal Credit Union

"As empresas não precisam sacrificar a segurança pela inovação em IA. O Databricks AI Security Framework é uma ferramenta abrangente para permitir a adoção segura de IA. Ele não apenas mapeia as preocupações de segurança de IA para o pipeline de desenvolvimento de IA, mas as torna acionáveis para os clientes Databricks com controles práticos. Temos o prazer de ter contribuído para o desenvolvimento deste valioso recurso comunitário." — Hyrum Anderson, CTO, Robust Intelligence

"O DASF é um ótimo exemplo da liderança da Databricks em IA e é uma contribuição valiosa para a indústria em um momento crítico. Sabemos que o maior risco associado à Inteligência Artificial no futuro previsível são as pessoas mal-intencionadas e este framework oferece um contrapeso eficaz contra esses cibercriminosos. O DASF é uma maneira pragmática, operacional e eficiente de proteger sua organização." — Chris "Tito" Sestito, CEO e Co-fundador da HiddenLayer

Dê o primeiro passo para expandir uma base sólida de segurança de IA – baixe o Databricks AI Security Framework e interaja com nossa equipe

O whitepaper Databricks AI Security Framework está disponível para download no Databricks Security and Trust Center. Fizemos um esforço concentrado para garantir a precisão, e nossa equipe está ansiosa para receber seu feedback. Caso tenha algum feedback ou dúvida, entre em contato conosco por e-mail em [email protected]. Este alias é também onde você pode solicitar mais informações sobre como participar de um próximo workshop de segurança de IA ou agendar um dedicado para sua organização. Veja nossa nova página de Segurança de IA para recursos detalhados sobre segurança de IA e ML.

(Esta publicação no blog foi traduzida utilizando ferramentas baseadas em inteligência artificial) Publicação original

Receba os posts mais recentes na sua caixa de entrada

Assine nosso blog e receba os posts mais recentes diretamente na sua caixa de entrada.