Central de segurança e confiança

A segurança dos seus dados é a nossa prioridade

Segurança de IA

Melhores práticas para mitigar os riscos associados a modelos de IA

Segurança de AI refere-se às práticas, medidas e estratégias implementadas para proteger sistemas, modelos e dados de inteligência artificial de acesso não autorizado, manipulação ou atividades maliciosas. As organizações devem implementar protocolos de segurança robustos, métodos de criptografia, controles de acesso e mecanismos de monitoramento para proteger os ativos de IA e mitigar os riscos potenciais associados ao seu uso.

A equipe de segurança da Databricks apoia nossos clientes para garantir a implantação de IA e machine learning na Databricks, recomendando recursos adaptados aos seus requisitos de arquitetura. Também trabalhamos com dezenas de especialistas internamente na Databricks e na comunidade maior de ML e GenAI para identificar riscos de segurança para sistemas de IA e definir os controles necessários para mitigar esses riscos.

Compreendendo sistemas de IA

Quais componentes compõem um sistema de IA e como eles funcionam juntos?

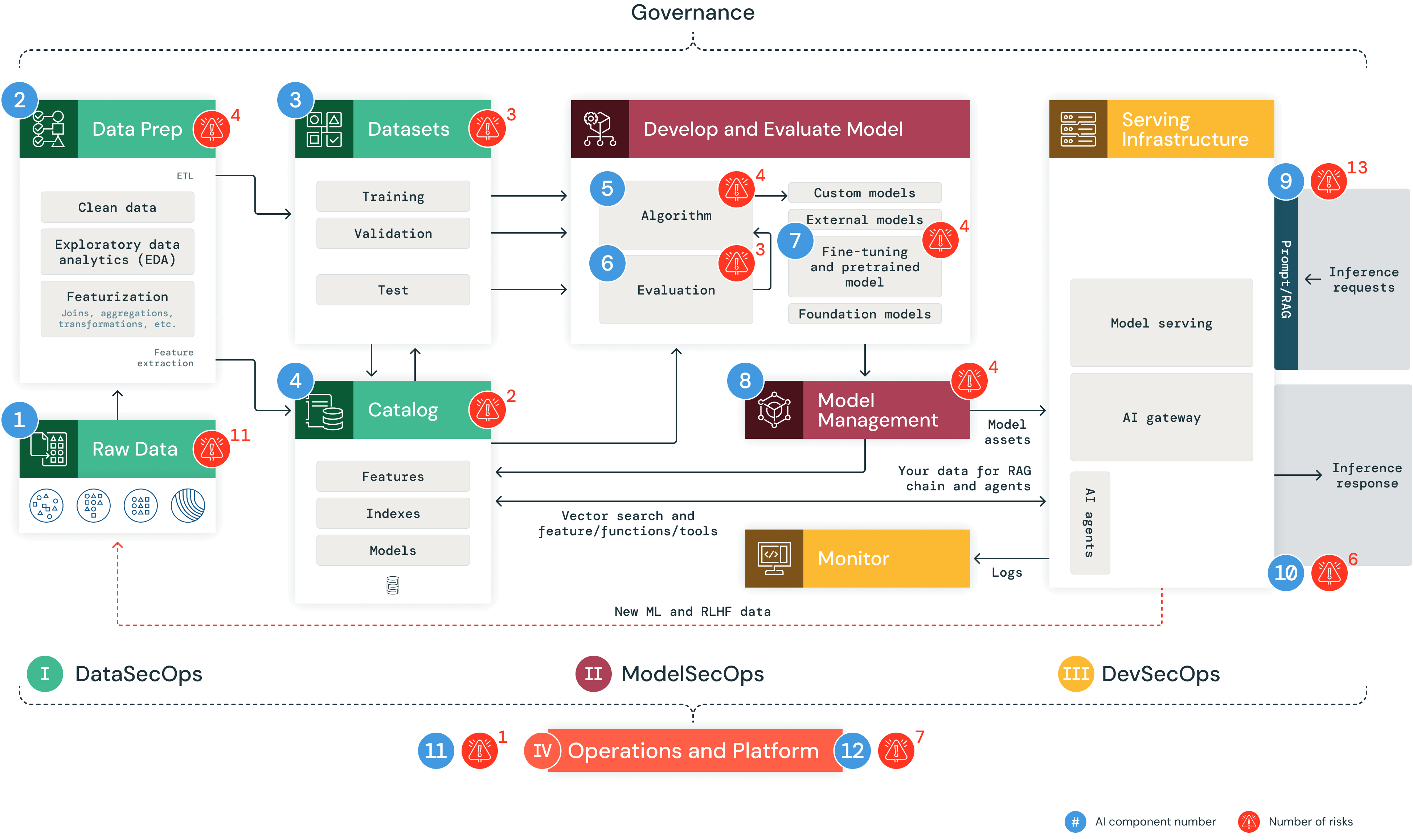

Sistemas de IA são compostos por dados, código e modelos. Um sistema de IA de ponta a ponta típico tem 12 componentes de arquitetura fundamentais, amplamente categorizados em quatro estágios principais:

- Operações de dados incluem a ingestão e a transformação de dados e a garantia da segurança e governança de dados. Bons modelos de ML dependem de pipelines de dados confiáveis e infraestrutura segura.

- As operações de modelo incluem a criação de modelos personalizados, a aquisição de modelos de um marketplace de modelos ou o uso de modelos de linguagem grandes (LLMs) de software como serviço (SaaS), como o OpenAI. O desenvolvimento de um modelo requer uma série de experimentos e uma forma de acompanhar e comparar as condições e os resultados desses experimentos.

- A implantação e o serviço de modelos consistem em criar imagens de modelo com segurança, isolar e servir modelos com segurança, dimensionamento automatizado, limitação de taxa e monitoramento de modelos implantados.

- Operações e plataforma incluem gerenciamento de vulnerabilidades e aplicação de patches da plataforma, isolamento e controles de modelos, e acesso autorizado a modelos com segurança na arquitetura. Também consiste em ferramentas operacionais para CI/CD. Isso garante que o ciclo de vida completo atenda aos padrões exigidos, mantendo os ambientes de execução distintos (desenvolvimento, homologação e produção) seguros para MLOps.

A imagem abaixo destaca os 12 componentes e como eles interagem em um sistema de IA.

Compreendendo os riscos de segurança da IA

Quais são as ameaças de segurança que podem surgir ao adotar a IA?

Em nossa análise de sistemas de IA, identificamos 62 riscos técnicos de segurança nos 12 componentes de arquitetura fundamentais. Na tabela abaixo, descrevemos esses componentes básicos, que se alinham aos passos de qualquer sistema de IA, e destacamos alguns exemplos de riscos de segurança. A lista completa dos 62 riscos técnicos de segurança pode ser encontrada no Databricks AI Security Framework.

Estágio do sistema de IA | Componentes do sistema de AI | Potenciais riscos de segurança |

|---|---|---|

Operações de dados | 1. Dados brutos 2. Preparação de dados 3. Datasets 4. Catálogo e governança | 20 riscos específicos como:

|

Operações de modelo | 5. Algoritmo de ML 6. Avaliação 7. Construção do modelo 8. Gerenciamento de modelos | 15 riscos específicos, como:

|

Implantação e disponibilização de modelos | 9. Model Serving — solicitações de inferência 10. Model Serving — respostas de inferência | 19 riscos específicos, como:

|

Operações e plataforma | 11. Operações de ML 12. Plataforma de ML | 8 riscos específicos, como:

|

Quais controles estão disponíveis para mitigar os riscos de segurança de IA?

Existem 64 controles prescritivos para mitigar os 62 riscos de segurança de IA identificados. Estes controles incluem:

- Melhores práticas de segurança cibernética, como Single Sign On, técnicas de criptografia, controles de biblioteca e de código-fonte e controles de acesso à rede com uma abordagem de defesa em profundidade para gerenciar riscos

- Controles específicos para a governança de dados e IA, como classificação de dados, linhagem de dados, versionamento de dados, rastreamento de modelos, permissões de ativos de dados e de modelos e governança de modelos

- controles específicos de AI, como isolamento de servindo modelo, ferramentas de prompt, auditoria e monitoramento de modelos, MLOps e LLMOps, gerenciamento centralizado de LLM, ajuste fino e pré-treinamento de seus modelos

Se você tiver interesse em obter uma visão geral detalhada dos riscos de segurança associados aos sistemas de IA e quais controles devem ser implementados para cada risco, convidamos você a baixar nosso Databricks AI Security Whitepaper.

Melhores práticas para proteger modelos de IA e ML

As equipes de dados e segurança devem colaborar ativamente para alcançar seu objetivo de melhorar a segurança dos sistemas de IA. Esteja você implementando soluções tradicionais de machine learning ou aplicações baseadas em LLM, a Databricks recomenda seguir os passos, conforme descrito no Whitepaper de Segurança de IA da Databricks.

Perguntas frequentes

Recursos de segurança de IA

Estrutura de segurança de IA da Databricks (DASF)

A equipe de Segurança da Databricks criou o Databricks AI Security Framework (DASF) para lidar com as vulnerabilidades em evolução em sistemas de IA com uma abordagem holística para mitigar riscos além da segurança do modelo.

Workshop sobre Riscos em IA da Databricks

A equipe de segurança da Databricks realiza workshops sobre riscos de IA para ajudar os líderes a entender os sistemas de IA, seus riscos e as estratégias de mitigação.

Treinamento de Fundamentos de Segurança de IA

Este curso explora os fundamentos de segurança em sistemas de AI na Databricks Data Intelligence Platform em cinco módulos abrangentes.

Eventos e webinars de segurança de IA

Os líderes de segurança da Databricks compartilham regularmente seus conhecimentos em eventos com líderes do setor, empresas, agências e fornecedores.