O que é análise de Big Data?

Analisando conjuntos de dados massivos e variados de dispositivos IoT, mídias sociais e comércio eletrônico para descobrir padrões ocultos, correlações e insights acionáveis.

- Analisa dados estruturados, semiestruturados e não estruturados, de terabytes a zettabytes, utilizando técnicas avançadas como aprendizado de máquina, processamento de linguagem natural e aprendizado profundo.

- Aproveita frameworks distribuídos como Hadoop, Spark e Hive para processar dados em redes inteiras, superando as limitações tradicionais de ETL e o processamento em lote lento.

- Proporciona redução de custos por meio da computação em nuvem, permite a tomada de decisões em tempo real com análises em memória e ajuda a identificar novos produtos, tendências de mercado e preferências do cliente.

O que é análise de big data?

A análise de big data é o processo, geralmente complexo, de examinar conjuntos de dados grandes e variados (big data) que foram gerados por várias fontes, como comércio eletrônico, dispositivos móveis, redes sociais e Internet das Coisas (IoT). Ela envolve a integração de diferentes fontes de dados, a transformação de dados não estruturados em dados estruturados e a geração de insights a partir dos dados usando ferramentas e técnicas especializadas que distribuem o processamento de dados por toda a rede.

A quantidade de dados digitais está crescendo rapidamente, dobrando aproximadamente a cada dois anos. A análise big data oferece uma abordagem diferente para gerenciar e analisar todas essas fontes de dados. Embora os princípios da análise de dados tradicional ainda se apliquem no geral, a escala e a complexidade da análise de big data exigiram o desenvolvimento de novas formas de armazenar e processar os petabytes de dados estruturados e não estruturados envolvidos.

Processo e Métodos Principais

A demanda por velocidades mais rápidas e maiores capacidades de armazenamento criou um vácuo tecnológico que logo foi preenchido por abordagens, incluindo:

- Métodos de armazenamento como data warehousese data lakes

- Bancos de dados não relacionais como o NoSQL

- Tecnologias e frameworks de processamento e gestão de dados, como Apache Hadoop de código aberto, Spark e Hive.

A análise de big data usa técnicas analíticas avançadas para analisar conjuntos de dados muito grandes que incluem dados estruturados, semiestruturados e não estruturados, de várias fontes e em tamanhos diferentes, de terabytes a zettabytes.

Análise de Dados Tradicional vs. análise big data

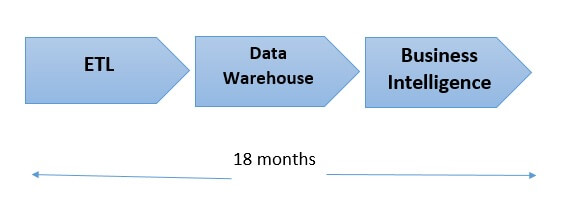

Antes da invenção do Hadoop, as tecnologias que sustentavam sistemas modernos de armazenamento e compute eram relativamente básicas, limitando as empresas basicamente à análise de "dados pequenos". Mesmo essa forma de analítica pode ser difícil, especialmente a integração de novas fontes de dados. Com a análise de dados tradicional, que depende de bancos de dados relacionais de dados estruturados, cada byte de dados brutos precisa ser formatado de uma maneira específica antes de poder ser ingerido no banco de dados para análise. Esse processo, muitas vezes demorado, geralmente conhecido como Extrair, Transformar e Carregar (ETL), é necessário para cada nova fonte de dados. O principal problema com esse processo e abordagem de 3 partes é que é muito demorado e trabalhoso, às vezes exigindo até 18 meses para que data scientists e data engineers implementem ou façam alterações.

No entanto, uma vez que os dados estavam no banco de dados, na maioria dos casos era fácil o suficiente para os analistas de dados fazerem queries e análises. Mas então vieram a internet, o comércio eletrônico, as redes sociais, os dispositivos móveis, a automação de marketing, os dispositivos da Internet das Coisas (IoT) etc., e o tamanho, o volume e a complexidade dos dados brutos se tornaram demais para quase todas as instituições analisarem no dia a dia dos negócios.

O manual de IA agêntica para empresas

Tipos de Dados Mais Comuns em análise big data

- Dados da web. Dados de comportamento da web no nível do cliente, como visitas, visualizações de página, pesquisas, compras etc.

- Dados de texto. Os dados gerados a partir de fontes de texto, incluindo e-mail, notícias, feeds do Facebook, documentos do Word e muito mais, são um dos maiores e mais utilizados tipos de dados não estruturados.

- Tempo e localização, ou dados geoespaciais: GPS e celulares, bem como conexões Wi-Fi, tornam as informações de tempo e localização uma fonte crescente de dados interessantes. Isso também pode incluir dados geográficos relacionados a estradas, edifícios, lagos, endereços, pessoas, locais de trabalho e rotas de transporte, que foram gerados a partir de sistemas de informação geográfica.

- Mídia em tempo real. As fontes de dados em tempo real podem incluir streaming em tempo real ou dados baseados em eventos.

- Dados de grades e sensores inteligentes. Os dados de sensores de carros, oleodutos, turbinas de moinhos de vento e outros sensores geralmente são coletados com frequência extremamente alta.

- Dados de redes sociais: O texto não estruturado (comentários, curtidas, etc.) de sites de redes sociais como Facebook, LinkedIn, Instagram, etc. está crescendo. Ainda é possível fazer análise de links para descobrir a rede de um determinado usu�ário.

- Dados vinculados: esse tipo de dados é coletado usando tecnologias padrão da web, como HTTP, RDF, SPARQL e URLs.

- Dados de rede. Dados relacionados a redes sociais muito grandes, como Facebook e Twitter, ou redes tecnológicas, como a internet, redes telefônicas e de transporte.

A análise de big data ajuda as organizações a aproveitar seus dados e usar técnicas e métodos avançados de data science, como processamento de linguagem natural, deep learning e machine learning, revelando padrões ocultos, correlações desconhecidas, tendências de mercado e preferências do cliente, para identificar novas oportunidades e tomar decisões de negócios mais bem informadas.

As vantagens de fazer análise de big data incluem:

- Redução de custos. Tecnologias de armazenamento e computação em nuvem, como Amazon Web Services (AWS) e Microsoft Azure, bem como Apache Hadoop, Spark e Hive podem ajudar as empresas a reduzir suas despesas referentes ao armazenamento e processamento de grandes conjuntos de dados.

- Melhoria na tomada de decisão.Com a velocidade do Spark e da análise na memória, combinada com a capacidade de analisar rapidamente novas fontes de dados, as empresas podem gerar insights imediatos e acionáveis necessários para tomar decisões em tempo real.

- Novos produtos e serviços. Com a ajuda das ferramentas de análise de big data, as empresas podem analisar com mais precisão as necessidades dos clientes, ficando mais fácil entregar aos clientes o que eles desejam em termos de produtos e serviços.

- Detecção de fraude. A análise de big data também é usada para evitar fraudes, principalmente no setor de serviços financeiros, mas está ganhando importância e uso em todos os setores verticais.

Mais recursos

Receba os posts mais recentes na sua caixa de entrada

Assine nosso blog e receba os posts mais recentes diretamente na sua caixa de entrada.