Como as principais empresas de tecnologia estão eliminando o imposto do construtor com o Lakebase

Aplicativos nativos de IA precisam que dados operacionais e análises convivam — veja como as equipes estão removendo essa barreira.

por Amey Banarse e Madelyn Mullen

- Elimine camadas de movimentação de dados: Organizações líderes estão usando o Databricks Lakebase, eliminando ETL e reverse ETL ao unificar dados operacionais e analíticos em uma única plataforma governada.

- Habilite inteligência em tempo real: Aplicativos e sistemas de IA operam diretamente em dados recentes e de baixa latência, sem atraso de sincronização.

- Produza sistemas de IA: Uma arquitetura unificada reduz a sobrecarga operacional e permite loops de aprendizado contínuo em escala.

O custo oculto que está matando o roteiro dos seus aplicativos de IA

Em organizações de tecnologia líderes que criam aplicativos nativos de IA, a principal restrição mudou da capacidade do modelo para a arquitetura de dados subjacente e, especificamente, para os pipelines de dados. Os requisitos dos sistemas de IA para acessar contexto em tempo real e com estado para agentes e baixo custo marginal para desenvolvimento rápido e experimental expuseram a falha crítica nas arquiteturas de dados tradicionais e separadas.

Cargas de trabalho operacionais normalmente são executadas em bancos de dados transacionais na nuvem (por exemplo, motores Postgres/MySQL gerenciados), enquanto análise, pipelines de ML e engenharia de recursos vivem no lakehouse. A sincronização entre essas camadas depende de uma malha complexa de pipelines de CDC, jobs de ETL/ELT e frameworks de ETL reverso. Isso resulta em ineficiências sistêmicas:

- Dados desatualizados: sistemas de IA operam em instantâneos defasados em vez de estado em tempo real

- Fragmentação arquitetônica: governança, linhagem e controle de acesso são duplicados entre sistemas

- Sobrecarga operacional: o esforço de engenharia muda do desenvolvimento de produtos para a orquestração de pipelines e gerenciamento de falhas

Chamamos isso de imposto do construtor: uma ineficiência estrutural decorrente de pilhas operacionais e analíticas desacopladas. Para as pessoas dentro das empresas de tecnologia que constroem as plataformas, produtos SaaS e ferramentas de desenvolvedor em que todos os outros dependem, esse imposto é especialmente prejudicial. Cada novo recurso de IA gera outro banco de dados, outro pipeline, mais um trimestre de atraso.

Mudança arquitetônica: co-localização de aplicativos e dados

Para quebrar esse padrão, as principais empresas de tecnologia estão redesenhando a arquitetura, indo além da adoção de apenas mais uma ferramenta especializada. Nós as vemos executando aplicativos e IA diretamente na mesma base governada de suas análises.

Essa base é o Lakebase: um motor Postgres serverless totalmente gerenciado e nativamente integrado à Databricks Platform.

- Aplicativos leem e escrevem diretamente nos dados gerenciados pelo lakehouse

- A governança é centralizada por meio do Unity Catalog em todas as cargas de trabalho

- Dados operacionais confiáveis com snapshots automatizados e recuperação de falhas integrada

Isso estabelece uma Base de Aplicativos Interoperável: uma camada única e governada onde aplicativos, IA e análises compartilham o mesmo armazenamento operacional.

Cenário do mundo real

Amey Banarse apresentou “From Transactions to Agents: PostgreSQL in Modern AI Applications” na PostgresConf 2026 [Slides]. Amey cobre uma demonstração ao vivo de um aplicativo de sinistros de healthtech construído inteiramente no Lakebase + o AI DevKit, mostrando como a inteligência do lakehouse, insights operacionais e um loop de aprendizado contínuo são executados em uma única base Databricks.

As organizações geralmente entram nessa arquitetura por meio de três vetores principais:

- Eliminação de pipelines de ETL reverso: conjuntos de dados analíticos (tabelas de camada gold) são sincronizados diretamente no Lakebase por meio de integração nativa. Isso remove a dependência de ferramentas externas e reduz a fragilidade do pipeline.

- Aplicativos nativos de IA e ferramentas internas: Execute Databricks Apps + Lakebase como uma única pilha serverless com model serving, feature store e análise. Nenhuma infraestrutura extra para provisionar.

- Memória e estado do agente: Lakebase com pgvector para busca semântica se torna a camada de memória operacional para agentes construídos com Agent Bricks, juntamente com os dados sobre os quais eles raciocinam.

O que as empresas de tecnologia estão realmente vendo

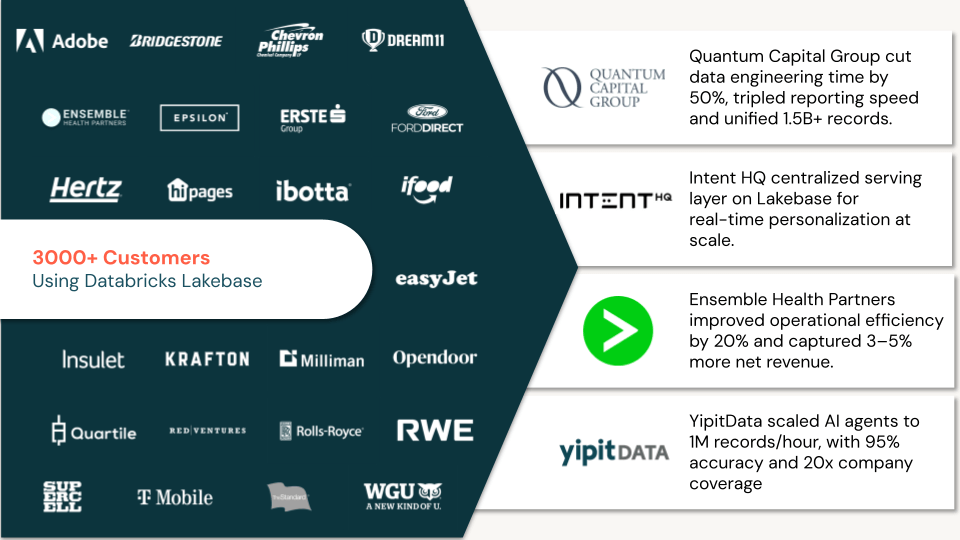

Os resultados abaixo vêm de empresas de tecnologia que migraram para uma arquitetura Lakebase:

YipitData escalou seu pipeline de agentes de IA para processar 1 milhão de registros por hora, alcançando 92–95% de precisão de marcação e 20x de cobertura da empresa. Ao usar o Lakebase como o sistema relacional de registro dentro do Unity Catalog, seus agentes operam com um estado durável e governado — sem armazenamentos externos frágeis, sem atraso de sincronização.

Quantum Capital Group estava gerenciando mais de 1,5 bilhão de registros em seis fontes de dados fragmentadas. Após a consolidação no Lakebase, eles eliminaram mais de 100 tabelas redundantes, reduziram o tempo de engenharia de dados em 50% e triplicaram a velocidade de relatórios — as equipes agora trabalham a partir de um único conjunto de dados confiável em vez de lutar contra a proliferação de versões.

Ensemble Health Partners unificou mais de 15 sistemas fragmentados do SQL Server. Com o Lakebase como a camada transacional, eles implementaram fluxos de trabalho de ciclo de receita impulsionados por IA que melhoraram a eficiência operacional em 20% e ajudaram os clientes a capturar de 3 a 5% mais receita líquida ano a ano.

Replit, cuja plataforma atende milhões de desenvolvedores na criação e implantação de software, usa o Lakebase + o Databricks AI DevKit para ajudar os clientes a lançar IA de geração de código em produção em 3 semanas com 10x de velocidade de desenvolvimento, eliminando a lacuna entre os sistemas operacionais e analíticos desde o primeiro dia.

IntentHQ, uma plataforma de inteligência do consumidor, centralizou sua camada de serviço no Lakebase para potencializar a personalização em tempo real em escala — fornecendo aos modelos de IA um armazenamento operacional de baixa latência que permanece sincronizado com seus dados do lakehouse sem pipelines personalizados.

O padrão de arquitetura por trás dos resultados

Apesar dos diferentes casos de uso — de agentes de IA e motores de personalização a fluxos de trabalho de saúde e plataformas de desenvolvedor — essas organizações não estão tendo sucesso por meio de otimizações isoladas. Elas estão convergindo para um modelo arquitetônico fundamentalmente diferente.

Em sua essência, esse modelo arquitetônico elimina a separação tradicional entre sistemas transacionais, plataformas analíticas e pipelines de IA, substituindo-a por uma base de dados compartilhada e interoperável.

Esse padrão inclui consistentemente três camadas rigidamente integradas:

Camada de inteligência do Lakehouse

Uma base governada e escalável onde operam dados em lote e de streaming, engenharia de recursos e cargas de trabalho de IA/ML. Essa camada fornece o sistema de insights, permitindo processamento em larga escala, treinamento de modelos e análise de dados unificados.

Camada de dados operacionais

Uma interface transacional de baixa latência (Lakebase) que serve como o sistema de execução para aplicativos e agentes. Essa camada permite leituras/escritas em tempo real, gerenciamento de estado e lógica de aplicativo diretamente em dados governados — sem sobrecarga de replicação ou sincronização.

Loop de aprendizado contínuo

Um sistema de feedback fechado onde interações de aplicativos, saídas de agentes e sinais do usuário são capturados e reintegrados aos pipelines de modelos. Isso estabelece um sistema de melhoria contínua, permitindo que as capacidades de IA evoluam com base no uso no mundo real.

Quando essas três camadas compartilham uma base, os sistemas de IA transitam de cargas de trabalho isoladas para sistemas de produção em constante aprimoramento.

Eliminando o imposto do construtor

O imposto do construtor não é inevitável. É uma consequência de construir IA sobre uma infraestrutura projetada para uma era diferente — quando os bancos de dados eram monolíticos, os aplicativos não tinham estado e a inteligência era um projeto separado.

Lakebase muda a matemática! Os aplicativos rodam onde os dados residem. Os agentes têm o contexto de que precisam. E o tempo de engenharia que sua equipe gastou em pipelines volta para o desenvolvimento.

Assista à sessão de Amey Banarse no PostgresConf 2026, “De Transações a Agentes: PostgreSQL em Aplicações Modernas de IA” [Slides] para ver um aplicativo completo nativo de IA construído sobre Lakebase em ação.

Databricks Lakebase é Postgres serverless construído para agentes e aplicativos. Saiba mais em databricks.com/product/lakebase.

(Esta publicação no blog foi traduzida utilizando ferramentas baseadas em inteligência artificial) Publicação original

Receba os posts mais recentes na sua caixa de entrada

Assine nosso blog e receba os posts mais recentes diretamente na sua caixa de entrada.