Aprendizaje de Agentes a partir de Retroalimentación Humana (ALHF): Un Caso de Estudio del Asistente de Conocimiento de Databricks

En este blog, profundizamos en Agent Learning from Human Feedback (ALHF) — un nuevo paradigma de aprendizaje automático donde los agentes aprenden directamente de retroalimentación mínima en lenguaje natural, no solo de recompensas numéricas o etiquetas estáticas. Esto permite una adaptación de agentes más rápida e intuitiva para aplicaciones empresariales, donde las expectativas a menudo son especializadas y difíciles de formalizar.

ALHF potencia el producto Databricks Agent Bricks. En nuestro caso de estudio, analizamos Agent Bricks Knowledge Assistant (KA) - que mejora continuamente sus respuestas a través de la retroalimentación de expertos. Como se muestra en la Figura 1, ALHF aumenta drásticamente la calidad general de las respuestas en Databricks DocsQA con tan solo 4 registros de retroalimentación. Con solo 32 registros de retroalimentación, cuadruplicamos la calidad de las respuestas sobre las bases de referencia estáticas. Nuestro caso de estudio demuestra la eficacia de ALHF y abre una nueva y atractiva dirección para la investigación de agentes.

La Promesa de los Agentes de IA Enseables

Al trabajar con clientes empresariales de Databricks, un desafío clave que hemos observado es que muchos casos de uso de IA empresariales dependen de lógica de negocio interna altamente especializada, datos propietarios y expectativas intrínsecas, que no se conocen externamente (vea nuestro Domain Intelligence Benchmark para saber más). Por lo tanto, incluso los sistemas más avanzados aún necesitan ajustes sustanciales para cumplir el umbral de calidad de los casos de uso empresariales.

Para ajustar estos sistemas, los enfoques existentes se basan en resultados explícitos de verdad fundamental, que son costosos de recopilar, o en modelos de recompensa, que solo proporcionan señales binarias/escalares. Para resolver estos desafíos, describimos Agent Learning from Human Feedback (ALHF), un paradigma de aprendizaje donde un agente adapta su comportamiento incorporando una pequeña cantidad de retroalimentación en lenguaje natural de expertos. Este paradigma ofrece un canal natural y rentable para la interacción humana y permite al sistema aprender de señales de expectativas ricas.

Ejemplo

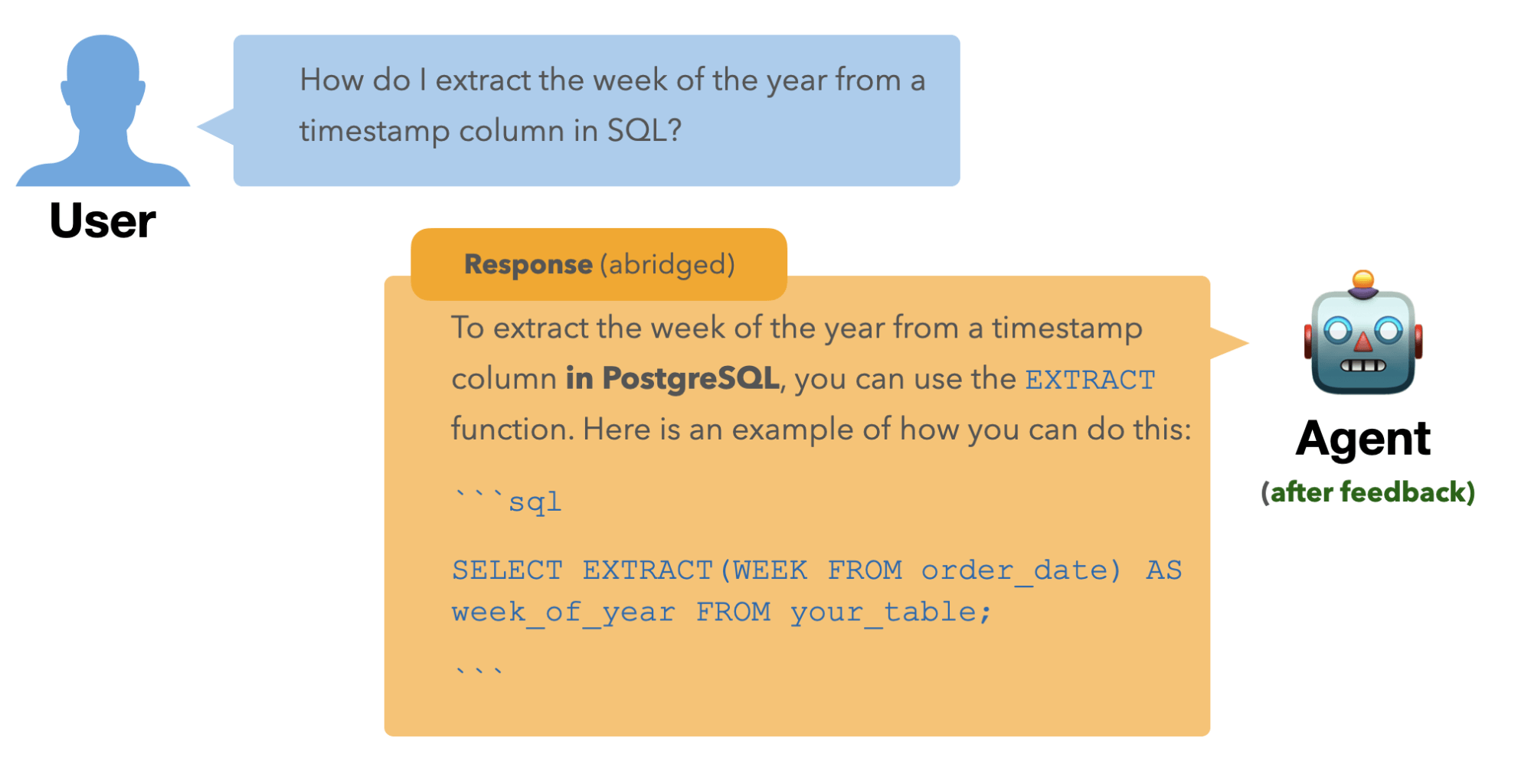

Digamos que creamos un agente de Preguntas y Respuestas (QA) para responder preguntas para una empresa de bases de datos alojadas. Aquí hay una pregunta de ejemplo:

El agente sugirió usar la función weekofyear(), compatible con múltiples sabores de SQL (MySQL, MariaDB, etc.). Esta respuesta es correcta en el sentido de que, cuando se usa apropiadamente, weekofyear() logra la funcionalidad deseada. Sin embargo, no es compatible con PostgreSQL, el sabor de SQL preferido por nuestro grupo de usuarios. Nuestro Experto en la Materia (SME) puede proporcionar retroalimentación en lenguaje natural sobre la respuesta para comunicar esta expectativa como se mencionó anteriormente, y el agente se adaptará en consecuencia:

ALHF adapta las respuestas del sistema no solo para esta única pregunta, sino también para preguntas en conversaciones futuras donde la retroalimentación sea relevante, por ejemplo:

Como muestra este ejemplo, ALHF brinda a los desarrolladores y SMEs una forma fluida e intuitiva de dirigir el comportamiento de un agente utilizando lenguaje natural, alineándolo con sus expectativas.

ALHF en Agent Bricks

Utilizaremos un caso de uso específico del producto Agent Bricks - Knowledge Assistant - como caso de estudio para demostrar el poder de ALHF.

Knowledge Assistant (KA) proporciona un enfoque declarativo para crear un chatbot sobre sus documentos, ofreciendo respuestas confiables y de alta calidad con citas. KA aprovecha ALHF para aprender continuamente las expectativas de los expertos a partir de retroalimentación en lenguaje natural y mejorar la calidad de sus respuestas.

KA primero solicita instrucciones de tareas de alto nivel. Una vez conectado a las fuentes de conocimiento relevantes, comienza a responder preguntas. Luego, los expertos pueden aprovechar un modo de Mejorar Calidad para revisar respuestas y dejar retroalimentación, que KA incorpora a través de ALHF para refinar respuestas futuras.

Evaluación

Para demostrar el valor de ALHF en KA, evaluamos KA utilizando DocsQA – un conjunto de datos de preguntas y respuestas de referencia sobre la documentación de Databricks, parte de nuestro Domain Intelligence Benchmark. Para este conjunto de datos, también tenemos un conjunto de expectativas de expertos definidas. Para un pequeño conjunto de respuestas candidatas generadas por KA, creamos una retroalimentación concisa en lenguaje natural (como en el ejemplo anterior) basada en estas expectativas y proporcionamos la retroalimentación a KA para refinar sus respuestas. Luego medimos la calidad de la respuesta en múltiples rondas de retroalimentación para evaluar si KA se adapta exitosamente para cumplir con las expectativas de los expertos.

Tenga en cuenta que, si bien las respuestas de referencia reflejan la corrección fáctica — si una respuesta contiene información relevante y precisa para abordar la pregunta — no son necesariamente ideales en términos de alineación con las expectativas de los expertos. Como se ilustra en nuestro ejemplo anterior, la respuesta inicial puede ser factualmente correcta para muchos sabores de SQL, pero aún puede fallar si el experto espera una respuesta específica de PostgreSQL.

Considerando estas dos dimensiones de corrección, evaluamos la calidad de una respuesta utilizando dos jueces de LLM:

- Completitud de Respuesta: Qué tan bien se alinea la respuesta con la respuesta de referencia del conjunto de datos. Esto sirve como una medida base de corrección fáctica.

- Adherencia a la Retroalimentación: Qué tan bien la respuesta satisface las expectativas específicas del experto. Esto mide la capacidad del agente para adaptar su salida basándose en criterios personalizados.

Resultados

La Figura 2 muestra cómo KA mejora en calidad con rondas crecientes de retroalimentación de expertos en DocsQA. Informamos los resultados para un conjunto de prueba reservado.

- Completitud de Respuesta: Sin retroalimentación, KA ya produce respuestas de alta calidad comparables con los sistemas líderes de la competencia. Con hasta 32 piezas de retroalimentación, la Completitud de Respuesta de KA mejora en 12 puntos porcentuales, superando claramente a los competidores.

- Adherencia a la retroalimentación: La distinción entre Adherencia a la retroalimentación y Completitud de la respuesta es evidente: todos los sistemas comienzan con puntuaciones bajas de adherencia sin retroalimentación. Pero aquí es donde ALHF brilla: con retroalimentación, la puntuación de adherencia de KA salta del 11.7% a casi el 80%, mostrando el impacto dramático de ALHF.

En general, ALHF es un mecanismo eficaz para refinar y adaptar el comportamiento de un sistema para cumplir con las expectativas específicas de los expertos. En particular, es muy eficiente en cuanto a muestras: no necesita cientos o miles de ejemplos, sino que puede ver ganancias claras con una pequeña cantidad de retroalimentación.

ALHF: el desafío técnico

Estos impresionantes resultados son posibles porque KA aborda con éxito dos desafíos técnicos centrales de ALHF.

Aprender cuándo aplicar la retroalimentación

Cuando un experto proporciona retroalimentación sobre una pregunta, ¿cómo sabe el agente qué preguntas futuras se beneficiarán de esa misma información? Este es el desafío del alcance — determinar el alcance correcto de aplicabilidad para cada pieza de retroalimentación. O dicho de otra manera, determinar la relevancia de una pieza de retroalimentación para una pregunta.

Considere nuestro ejemplo de PostgreSQL. Cuando el experto dice "la respuesta debe ser compatible con PostgreSQL", esta retroalimentación no solo debería corregir esa respuesta. Debería informar a todas las preguntas futuras relacionadas con SQL. Pero no debería afectar a consultas no relacionadas, como "¿Debería usar matplotlib o seaborn para este gráfico?"

Adoptamos un enfoque de memoria de agente que registra toda la retroalimentación previa y permite al agente recuperar eficientemente la retroalimentación relevante para una nueva pregunta. Esto permite al agente determinar de forma dinámica y holística qué información es más relevante para la pregunta actual.

Adaptar los componentes correctos del sistema

El segundo desafío es la asignación — determinar qué partes del sistema necesitan cambiar en respuesta a la retroalimentación. KA no es un modelo único; es un pipeline de múltiples componentes que genera consultas de búsqueda, recupera documentos y produce respuestas. Una ALHF eficaz requiere actualizar los componentes correctos de las maneras correctas.

KA está diseñado con un conjunto de componentes impulsados por LLM que están parametrizados por retroalimentación. Cada componente es un módulo que acepta retroalimentación relevante y adapta su comportamiento en consecuencia. Tomando el ejemplo anterior, donde el SME proporciona la siguiente retroalimentación sobre el ejemplo de extracción de fechas:

Más tarde, el usuario hace una pregunta relacionada: "¿Cómo obtengo la diferencia entre dos fechas en SQL?". Sin recibir ninguna retroalimentación nueva, KA aplica automáticamente lo que aprendió de la interacción anterior. Comienza modificando la consulta de búsqueda en la etapa de recuperación, adaptándola al contexto:

Luego, produce una respuesta específica de PostgreSQL:

Al dirigir con precisión la retroalimentación a los componentes apropiados de recuperación y generación de respuestas, ALHF garantiza que el agente aprenda y generalice de manera efectiva a partir de la retroalimentación del experto.

Lo que ALHF significa para usted: Dentro de Agent Bricks

Aprendizaje del Agente a partir de Retroalimentación Humana (ALHF) representa un gran avance para que los agentes de IA comprendan y se adapten verdaderamente a las expectativas de los expertos. Al permitir que la retroalimentación en lenguaje natural moldee incrementalmente el comportamiento de un agente, ALHF proporciona un mecanismo flexible, intuitivo y potente para dirigir los sistemas de IA hacia necesidades empresariales específicas. Nuestro estudio de caso con Knowledge Assistant demuestra cómo ALHF puede mejorar drásticamente la calidad de la respuesta y la adherencia a las expectativas de los expertos, incluso con una retroalimentación mínima. Como dijo Patrick Vinton, Director de Tecnología de Analytics8, un cliente de KA:

“Al aprovechar Agent Bricks, Analytics8 logró un aumento del 40% en la precisión de las respuestas con tiempos de implementación un 800% más rápidos para nuestros casos de uso, que van desde simples asistentes de RR. HH. hasta complejos asistentes de investigación que se basan en documentos técnicos y de múltiples modalidades. Después del lanzamiento, también hemos observado que la calidad de las respuestas sigue aumentando.”

ALHF es ahora una capacidad integrada dentro del producto Agent Bricks, que permite a los clientes de Databricks implementar soluciones de IA empresariales altamente personalizadas. Animamos a todos los clientes interesados en aprovechar el poder de la IA enseñable a ponerse en contacto con sus Equipos de Cuenta de Databricks y probar KA y otros casos de uso de Agent Bricks para explorar cómo ALHF puede transformar sus flujos de trabajo de IA generativa.

Veronica Lyu y Kartik Sreenivasan contribuyeron por igual

Autores: Veronica Lyu, Kartik Sreenivasan, Moonsoo Lee, Michael Bendersky, Alkis Polyzotis, Xiangrui Meng, Omar Khattab, Sam Havens, Michael Carbin y Matei Zaharia

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.