Dentro de una de las primeras implementaciones de producción de Lakebase: el motor de gobernanza de flujos de trabajo agentivos de LangGuard

Los flujos de trabajo agénticos empresariales abarcan docenas de agentes, cientos de herramientas y más de 15 sistemas de registro. Controlarlos y operarlos en tiempo real requiere una infraestructura que no existía hasta Lakebase.

por Venkat Raghavan, Jason Keirstead, Ravi Srinivasan, Nina Williams y Amelia Westberg

- Menos del 10% de las empresas han implementado con éxito agentes de IA autónomos a escala, principalmente porque los agentes eluden los controles de seguridad tradicionales al generar su propia lógica en tiempo de ejecución, creando una brecha de gobernanza invisible.

- Databricks proporciona gobernanza unificada para datos, modelos y políticas de acceso a través de Unity Catalog y AI Gateway. LangGuard extiende estos controles a nivel de plataforma con una capa de aplicación de políticas en tiempo de ejecución para flujos de trabajo agénticos, monitoreando y aplicando políticas en toda la cadena de acciones, decisiones, herramientas y credenciales de extremo a extremo. Utiliza un tejido de datos GRAIL™ pendiente de patente que captura cada acción del agente en un grafo de conocimiento en vivo y evalúa cada decisión de política en tiempo real, sin afectar el rendimiento del agente.

- Databricks Lakebase, la primera base de datos Postgres totalmente administrada y sin servidor de la industria construida sobre el lakehouse, es lo que hace esto posible, proporcionando cómputo elástico de escala a cero, ejecución de consultas de baja latencia para datos operacionales en caliente y ramificación instantánea de bases de datos para pruebas seguras de políticas de gobernanza.

El problema invisible de la IA agentiva

La mayoría de las empresas están experimentando con agentes de IA autónomos. Muy pocas los están implementando de forma segura a escala. Según la encuesta "The State of AI in 2025" de McKinsey (noviembre de 2025), en ninguna función empresarial más del diez por ciento de las empresas han escalado agentes de IA a producción. El fracaso rara vez es una falta de ambición; es una falta de visibilidad.

A diferencia del software tradicional, los agentes autónomos generan su propia lógica sobre la marcha. Evaden los monitores de seguridad convencionales, invocan herramientas y acceden a datos de formas que son difíciles de auditar después de los hechos, y operan en flujos de trabajo complejos de múltiples agentes donde un solo permiso mal configurado o una brecha de política puede convertirse en un incidente de seguridad significativo. Lo que las empresas necesitan es una nueva categoría de infraestructura de control: una que opere en el momento en que se está tomando una decisión, no después de que el daño esté hecho.

Ese es el problema que LangGuard fue construido para resolver.

La aplicación en tiempo de ejecución se une a la gobernanza de la plataforma

LangGuard actúa como una capa de aplicación en tiempo de ejecución para flujos de trabajo agentivos, monitoreando y aplicando políticas en toda la cadena de acciones, decisiones, herramientas, credenciales e intenciones de extremo a extremo que abarca cada sistema que un agente toca. Databricks proporciona gobernanza unificada a través de Unity Catalog y AI Gateway, el sistema de registro para datos, modelos y políticas de acceso. A medida que las empresas implementan agentes en producción, el propio flujo de trabajo también necesita una capa de aplicación en tiempo de ejecución que extienda esos controles a nivel de plataforma a cada paso de la ejecución del agente. Ahí es donde encaja LangGuard. El motor de gobernanza de LangGuard, el tejido de datos GRAIL™ (Governance AI Run-time Links), captura cada acción del agente como datos de rastreo multidimensionales y construye un grafo de conocimiento en vivo del comportamiento y el contexto del flujo de trabajo. Cuando un agente intenta invocar una herramienta, acceder a un conjunto de datos o llamar a un modelo, LangGuard evalúa esa acción frente a la política antes de que se ejecute, en todos los sistemas que toca el flujo de trabajo, independientemente de dónde se ejecute.

La escala de una implementación de agentes empresariales en producción hace que esto sea realmente difícil. Un solo flujo de trabajo puede involucrar a decenas de agentes coordinados, cientos de invocaciones de herramientas, múltiples modelos fundacionales y políticas administradas en quince o más Sistemas de Registro empresariales, incluyendo sistemas de tickets de TI como ServiceNow, plataformas IAM e IDP, sistemas CRM como Salesforce, plataformas de RR. HH. como Workday, plataformas de seguridad en la nube como Wiz y CrowdStrike, plataformas de centros de contacto como TalkDesk, MCP Gateways y API Gateways. Gobernar esto en tiempo real, sin afectar el rendimiento del agente, exige una infraestructura especialmente diseñada para el problema.

Por qué elegimos Lakebase

El equipo de LangGuard pasó años construyendo IBM QRadar, un líder múltiple en el Cuadrante Mágico de Gartner y una de las plataformas SIEM empresariales más desplegadas del mundo. QRadar ingiere y correlaciona petabytes de telemetría de seguridad por día bajo estrictos requisitos de latencia y confiabilidad. Esa experiencia nos enseñó una dura lección: la arquitectura de la base de datos es el destino. Cuando diseñamos el motor de gobernanza de flujos de trabajo de LangGuard, nos enfrentamos al mismo desafío que habíamos resuelto antes: datos de seguridad operativos que llegan en ráfagas impredecibles y de alta intensidad, donde cada milisegundo de latencia de decisión importa y el gasto en infraestructura inactiva es inaceptable. Las bases de datos tradicionales que acoplan el cómputo y el almacenamiento te obligan a aprovisionar para la carga máxima y a pagar por esa capacidad las 24 horas del día. El modelo sin servidor de Lakebase, que desacopla completamente el cómputo del almacenamiento y escala a cero entre ráfagas, fue la respuesta que siempre habíamos necesitado pero a la que no teníamos acceso cuando estábamos construyendo QRadar. Coincidía exactamente con el problema.

Lo que hace que Lakebase sea la opción correcta

Lakebase es una nueva categoría de arquitectura de bases de datos operativas que desagrega el cómputo del almacenamiento, permitiendo que el cómputo escale elásticamente con la demanda de la carga de trabajo, mientras que el estado duradero vive de forma independiente en una capa de almacenamiento replicada. Construida sobre la base abierta de PostgreSQL, la arquitectura lakebase preserva todo lo que los desarrolladores confían en una base de datos relacional probada, al tiempo que elimina las restricciones de infraestructura que hacen que los RDBMS monolíticos tradicionales sean la opción incorrecta para la velocidad y la escala que exigen las aplicaciones, agentes e IA modernos.

Autoscaling sin servidor y escalado a cero

El comportamiento del agente es notoriamente errático. Un flujo de trabajo de agente puede estar completamente inactivo durante horas y luego generar repentinamente cientos de escrituras de rastreo y lecturas de aplicación en cuestión de segundos. Lakebase aprovisiona dinámicamente recursos de cómputo en el momento exacto en que esos rastreos inundan nuestro sistema y se apaga por completo cuando la actividad se detiene. Dado que el estado duradero reside en la capa de almacenamiento, no en el nodo de cómputo, iniciar una nueva instancia de cómputo no requiere movimiento de datos. Simplemente se conecta al historial de la base de datos existente y comienza a servir consultas de inmediato.

Para una startup que opera a escala empresarial, esta es la diferencia entre una infraestructura que coincide con el uso real y una infraestructura que te penaliza por tener períodos de inactividad. Nuestros costos operativos se mantienen perfectamente alineados con las cargas de trabajo que realmente estamos sirviendo.

Latencia de lectura de milisegundos para datos operativos activos

La preocupación natural con cualquier base de datos desagregada es la latencia de lectura. Lakebase aborda esto a través de una capa de caché entre el cómputo y el almacenamiento que mantiene los datos activos cerca del cómputo.

Para las consultas de aplicación de LangGuard, búsquedas indexadas ajustadas contra las tablas de contexto y políticas de GRAIL™, esperamos que el conjunto de trabajo activo quepa cómodamente en la memoria local del cómputo. Esta arquitectura nos da la confianza de que las decisiones de gobernanza se pueden aplicar a la velocidad del flujo de trabajo, sin agregar latencia significativa a la ejecución del agente.

Ramificación instantánea de la base de datos para pruebas de políticas de gobernanza

La ramificación instantánea de la base de datos de Lakebase es una de sus capacidades operativamente más valiosas para un producto de gobernanza. Cuando creamos una rama, no se copia físicamente ningún dato. La rama diverge del estado actual de la base de datos utilizando semántica de copia en escritura, consumiendo almacenamiento solo para datos nuevos o modificados. Nuestros desarrolladores pueden crear una réplica aislada y exacta de nuestros datos de rastreo de producción en segundos, probar nuevas políticas de gobernanza contra el comportamiento real del agente y validar la lógica de aplicación sin arriesgar la estabilidad del entorno en vivo.

PostgreSQL: una base probada

Lakebase está construido sobre PostgreSQL, la base de datos relacional de código abierto más avanzada del mundo, con décadas de endurecimiento en producción en todas las industrias. Para LangGuard, esto significa compatibilidad total con las herramientas, bibliotecas y extensiones que nuestro equipo ya conoce, sin un lenguaje de consulta propietario ni riesgo de migración.

Cómo colaboran LangGuard y Databricks

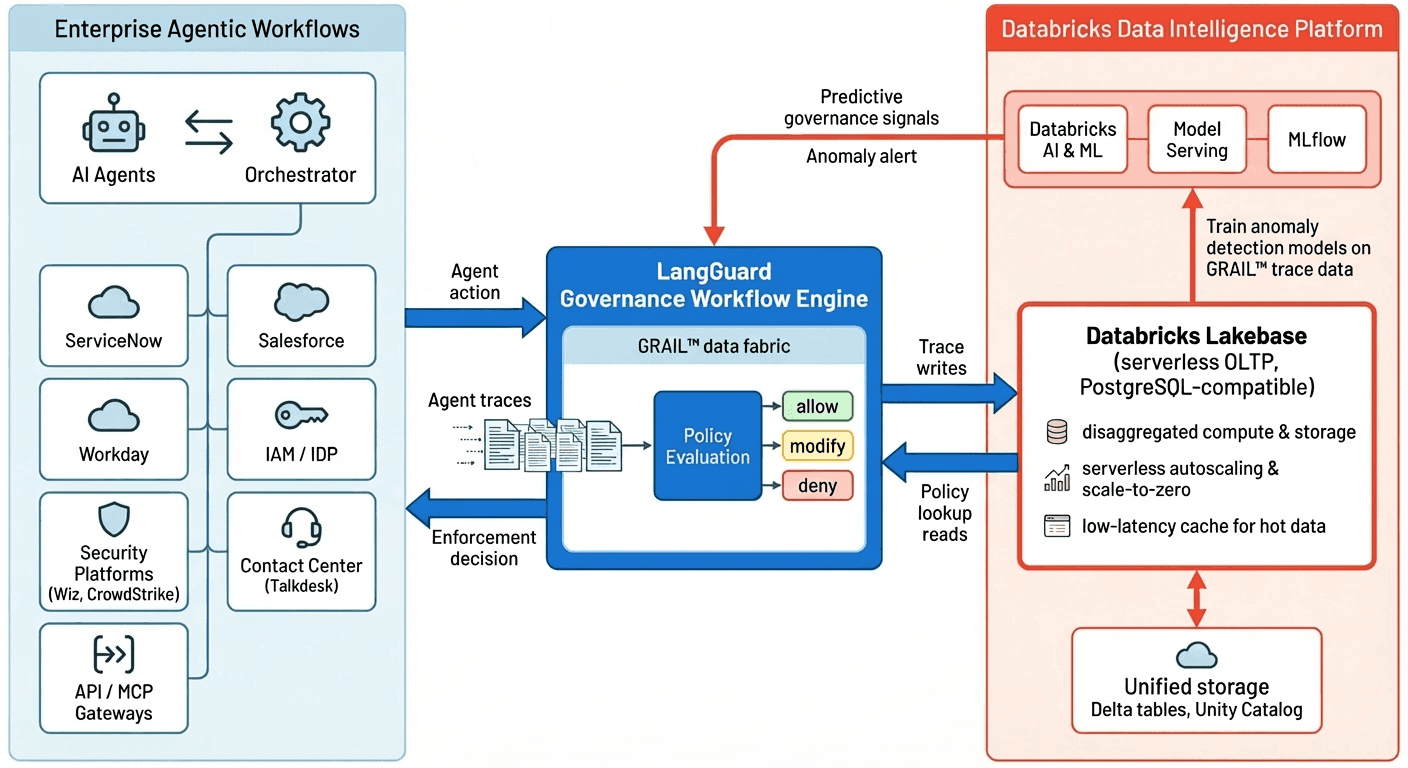

La arquitectura conjunta de LangGuard y Databricks está diseñada para gobernar flujos de trabajo agentivos empresariales de extremo a extremo, manteniendo todos los datos operativos en una única plataforma de datos e IA confiable. A la izquierda de la arquitectura se encuentran los flujos de trabajo agentivos empresariales en sí mismos: agentes de IA y sus orquestadores interactuando con docenas de sistemas de registro como gestión de servicios de TI, CRM, RR. HH., identidad, seguridad, centro de contacto y gateways de API/MCP. Cada acción del agente, invocación de herramienta y solicitud de acceso a datos genera eventos de rastreo enriquecidos que fluyen a LangGuard en tiempo real.

En el centro del diagrama se encuentra el Motor de Flujo de Trabajo de Gobernanza de LangGuard, impulsado por el tejido de datos GRAIL™ pendiente de patente. GRAIL captura cada acción del agente como datos de rastreo multidimensionales y construye un grafo de conocimiento en vivo del comportamiento y el contexto del flujo de trabajo. Cuando un agente intenta llamar a una herramienta, acceder a un conjunto de datos o invocar un modelo, LangGuard realiza una evaluación de políticas contra este contexto en vivo y las reglas de gobernanza relevantes, devolviendo una decisión de permitir/denegar/modificar antes de que la acción se ejecute. Esto brinda a las empresas un único punto de control para aplicar políticas en todos los sistemas que toca el flujo de trabajo, independientemente de dónde se ejecuten los agentes subyacentes.

A la derecha, Databricks Lakebase sirve como el sistema operativo de registro para los datos de rastreo y políticas de LangGuard. La arquitectura sin servidor de PostgreSQL de Lakebase desagrega el cómputo del almacenamiento, lo que permite el autoscaling elástico y el escalado a cero entre ráfagas de actividad de agentes, al tiempo que mantiene los datos operativos activos en una caché de baja latencia cerca del cómputo. LangGuard escribe continuamente eventos de rastreo en Lakebase y realiza lecturas de baja latencia para búsquedas de políticas de gobernanza y consultas contextuales, asegurando que las decisiones de aplicación se puedan tomar a la velocidad del flujo de trabajo sin un aprovisionamiento excesivo de capacidad de base de datos.

Dado que los datos operativos de LangGuard residen de forma nativa en Lakebase, están inmediatamente disponibles para la Plataforma de Inteligencia de Datos de Databricks en general para análisis e IA sin ETL adicional. Databricks AI, Model Serving y MLflow pueden entrenar e implementar modelos de detección de anomalías directamente sobre los datos de rastreo de GRAIL para identificar agentes que se desvían de su línea base de comportamiento establecida. Estas señales predictivas retroalimentan el Motor de Gobernanza de LangGuard, cerrando el ciclo entre la aplicación en tiempo real y el monitoreo predictivo, y permitiendo a las empresas pasar de controles reactivos a una gobernanza de IA proactiva basada en el comportamiento en una única plataforma.

Lo que viene a continuación: gobernanza predictiva para flujos de trabajo agentivos

El motor de LangGuard hoy aplica políticas establecidas en tiempo de ejecución en todo el flujo de trabajo. La próxima evolución es predictiva: entrenar modelos de comportamiento con datos históricos de rastreo de GRAIL para detectar comportamientos anómalos del agente antes de que se manifiesten como una violación de la política.

Dado que nuestros datos operativos de rastreo ya residen dentro del ecosistema de Databricks, como se describió anteriormente, podemos pasar directamente de la aplicación a la predicción sin construir canalizaciones ETL separadas ni configurar una segunda plataforma analítica.

Si un agente comienza a actuar de manera errática o se desvía de su línea de base establecida, esos modelos lo marcarán como una anomalía antes de que se produzca algún daño. Esta convergencia de la aplicación en tiempo real y el aprendizaje automático predictivo es el futuro de la gobernanza de IA empresarial, y es la arquitectura que estamos construyendo hoy.

| CONCLUSIÓN CLAVE |

|---|

| LangGuard es una de las primeras startups en construir infraestructura de producción sobre Databricks Lakebase. La elección se basó en un conjunto específico de requisitos no negociables: aplicación de baja latencia, manejo elástico de ráfagas y pruebas de políticas de gobernanza contra datos reales. Solo una base de datos OLTP sin servidor podría satisfacerlos todos. Lakebase es la primera base de datos que cumple con todos ellos. |

| Para las empresas que necesitan gobernar flujos de trabajo de agentes de extremo a extremo, a través de cada agente, herramienta, credencial y sistema de registro en la cadena, esta arquitectura significa una aplicación que opera a la velocidad del flujo de trabajo, se escala con la complejidad del despliegue y evoluciona hacia la seguridad predictiva del comportamiento sin requerir una plataforma de datos separada. |

¿Listo para gobernar sus flujos de trabajo de agentes de extremo a extremo? Visite langguard.ai para obtener más información sobre cómo LangGuard asegura, controla y opera flujos de trabajo de agentes empresariales con cumplimiento total de políticas, o explore Databricks Lakebase para ver cómo la infraestructura OLTP sin servidor potencia la gobernanza de IA en tiempo real a escala.

Más información sobre LangGuard Explore Databricks Lakebase

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.