¿Qué es una red neuronal bayesiana?

Redes neuronales que utilizan distribuciones de probabilidad como ponderaciones en lugar de estimaciones puntuales, lo que permite la cuantificación de la incertidumbre y la confianza en las predicciones.

- Modela ponderaciones y sesgos como distribuciones de probabilidad (p. ej., gaussianas) con parámetros aprendibles para medias y varianzas, en lugar de estimaciones puntuales fijas de redes neuronales estándar.

- Se entrena mediante inferencia variacional que aproxima distribuciones posteriores o métodos de muestreo MCMC, que son computacionalmente más costosos, pero proporcionan estimaciones de incertidumbre basadas en principios.

- Es fundamental para aplicaciones de seguridad, aprendizaje activo donde la incertidumbre guía la recopilación de datos, detección de entradas fuera de la distribución y escenarios que requieren intervalos de confianza en las predicciones.

¿Qué son las redes neuronales bayesianas?

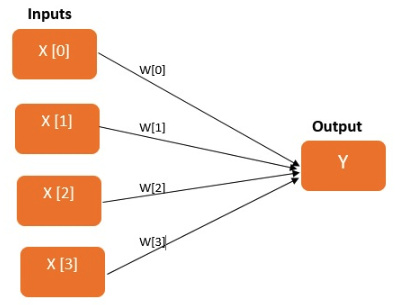

Las redes neuronales bayesianas (BNNs) se refieren a la extensión de redes estándar con inferencia posterior para controlar el sobreajuste. Desde una perspectiva más amplia, el enfoque bayesiano usa la metodología estadística para que todo tenga una distribución de probabilidad adjunta, incluidos los parámetros del modelo (pesos y sesgos en las redes neuronales). En los lenguajes de programación, las variables que pueden tomar un valor específico obtendrán el mismo resultado cada vez que acceda a esa variable específica. Comencemos con la revisión de un modelo lineal simple, que predecirá la salida por la suma ponderada de una serie de características de entrada.

En comparación, en el mundo bayesiano, puede haber entidades similares, también conocidas como variables aleatorias, que te darán un valor diferente cada vez que accedas a ellas. En términos bayesianos, los datos históricos representan nuestro conocimiento previo del comportamiento general, y cada variable tiene sus propias propiedades estadísticas que varían con el tiempo. Supongamos que X es una variable aleatoria que representa la distribución normal. Cada vez que se accede a X, el resultado que se obtiene tendrá diferentes valores. Este proceso de obtener un nuevo valor a partir de una variable aleatoria se llama muestreo. El valor que se obtiene depende de la distribución de probabilidad asociada a la variable aleatoria. Eso significa que, en el espacio de parámetros, se puede deducir la naturaleza y la forma de los parámetros aprendidos por la red neuronal. Recientemente hubo mucha actividad en esta área, con el advenimiento de varias bibliotecas de programación probabilística como PyMC3, Edward, Stan, etc. Los métodos bayesianos se usan en muchos campos: desde el desarrollo de juegos hasta el descubrimiento de fármacos.

¿Cuáles son algunas de las principales ventajas de las BNN?

- Las redes neuronales bayesianas son útiles para resolver problemas en dominios donde los datos son escasos, como una forma de prevenir el sobreajuste. Los ejemplos de aplicaciones son la biología molecular y el diagnóstico médico, que son áreas donde los datos a menudo provienen de trabajos experimentales costosos y difíciles.

- Las redes bayesianas son universalmente útiles.

- Pueden obtener mejores resultados para una gran cantidad de tareas, sin embargo, son extremadamente difíciles de escalar a problemas de gran magnitud.

- Las BNN te permiten calcular automáticamente un error asociado con tus predicciones al trabajar con datos de objetivos desconocidos.

- Permiten estimar la incertidumbre en las predicciones, lo cual es una excelente característica para campos como la medicina.

La guía de IA agéntica para la empresa

¿Por qué debería usar las redes neuronales bayesianas?

En lugar de considerar una sola respuesta a una pregunta, los métodos bayesianos permiten considerar toda una distribución de respuestas. Con este enfoque, puedes abordar de manera natural problemas como:

- Regularización (sobreajuste o no).

- selección/comparación de modelos, sin necesidad de un conjunto de datos de validación cruzada separado

Recursos adicionales

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.