Novidades: Lakeflow Jobs oferece orquestração de dados mais eficiente

O Lakeflow Jobs agora vem com um novo conjunto de funcionalidades e atualizações de design criadas para aprimorar a orquestração de fluxos de trabalho e melhorar a eficiência do pipeline.

- Descubra as mais recentes melhorias de UI/UX para o Lakeflow Jobs que oferecem aos usuários uma aparência mais limpa e intuitiva, aprimorando sua experiência geral.

- Saiba mais sobre as últimas funcionalidades adicionadas que proporcionam flexibilidade e controle adicionais sobre os fluxos de trabalho.

- Descubra mais sobre o Lakeflow Connect no Jobs, uma maneira nova e mais centralizada de ingerir dados em seu pipeline.

Nos últimos meses, introduzimos atualizações empolgantes para o Lakeflow Jobs (anteriormente conhecido como Databricks Workflows) para aprimorar a orquestração de dados e otimizar o desempenho dos fluxos de trabalho.

Para quem é novo, Lakeflow Jobs é o orquestrador integrado para Lakeflow, uma solução unificada e inteligente para engenharia de dados com desenvolvimento e operações de ETL simplificados, construída sobre a Data Intelligence Platform. Lakeflow Jobs é o orquestrador mais confiável para o Lakehouse e cargas de trabalho de nível de produção, com mais de 14.600 clientes, 187.000 usuários semanais e 100 milhões de jobs executados toda semana.

Desde melhorias na interface do usuário até um controle de fluxo de trabalho mais avançado, confira as novidades na solução nativa de orquestração de dados da Databricks e descubra como os engenheiros de dados podem otimizar sua experiência de pipeline de dados de ponta a ponta.

Interface de usuário renovada para uma experiência mais focada

Redesenhamos nossa interface para dar ao Lakeflow Jobs um visual novo e moderno. O novo layout compacto permite uma jornada de orquestração mais intuitiva. Os usuários desfrutarão de uma paleta de tarefas que agora oferece atalhos e um botão de pesquisa para ajudá-los a encontrar e acessar suas tarefas com mais facilidade, seja um Lakeflow Pipeline, um dashboard de IA/BI, um notebook, SQL ou mais.

Para monitoramento, os clientes agora podem encontrar facilmente informações sobre os tempos de execução de seus jobs no painel direito, em Detalhes de execução de Job e Tarefa, permitindo que monitorem facilmente os tempos de processamento e identifiquem rapidamente quaisquer problemas no pipeline de dados.

Também aprimoramos a barra lateral, permitindo que os usuários escolham quais seções (Detalhes do Job, Agendamentos e Gatilhos, Parâmetros do Job, etc.) ocultar ou manter abertas, tornando sua interface de orquestração mais limpa e relevante.

No geral, os usuários do Lakeflow Jobs podem esperar um fluxo de trabalho de orquestração mais otimizado, focado e simplificado. O novo layout está atualmente disponível para usuários que optaram pela prévia e ativaram a opção na página de Jobs.

Fluxos de dados mais controlados e eficientes

Nosso orquestrador está constantemente sendo aprimorado com novos recursos. A atualização mais recente introduz controles avançados para a orquestração de pipelines de dados, dando aos usuários maior comando sobre seus fluxos de trabalho para mais eficiência e desempenho otimizado.

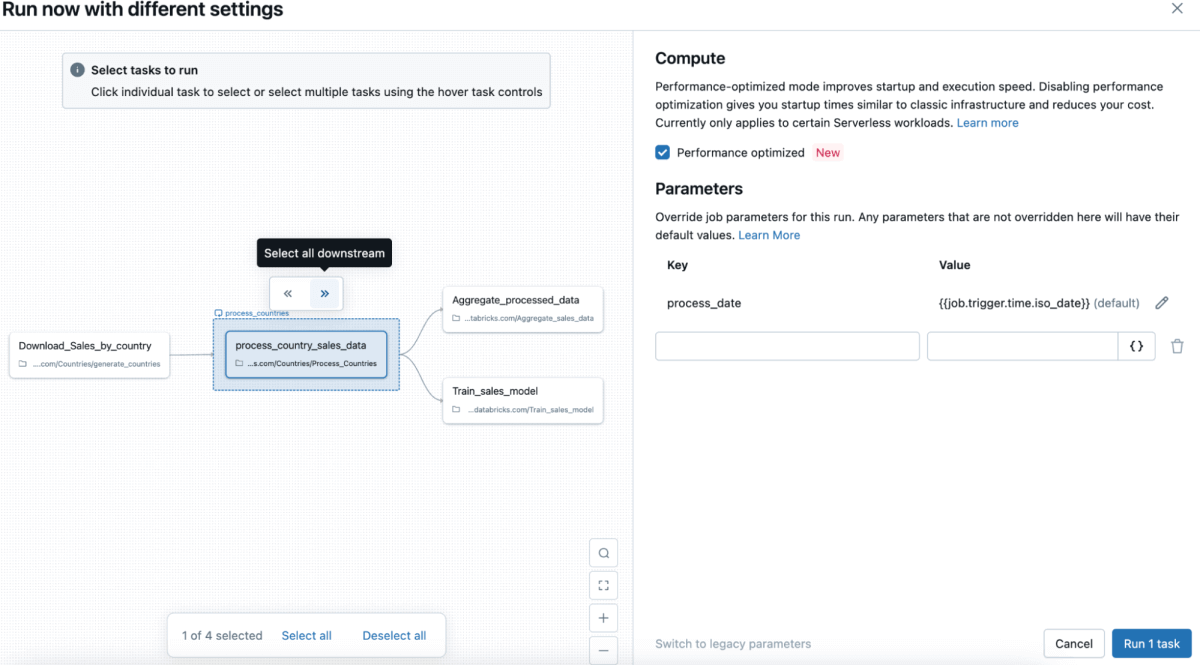

Execuções parciais permitem que os usuários selecionem quais tarefas executar sem afetar outras. Anteriormente, testar tarefas individuais exigia a execução do job inteiro, o que poderia ser computacionalmente intensivo, lento e caro. Agora, na página Jobs & Pipelines, os usuários podem selecionar "Executar agora com configurações diferentes" e escolher tarefas específicas para executar sem impactar outras, evitando desperdício computacional e altos custos. Da mesma forma, reparos parciais permitem depuração mais rápida, permitindo que os usuários corrijam tarefas individuais com falha sem reexecutar o job inteiro.

Com mais controle sobre seus fluxos de execução e reparo, os clientes podem acelerar os ciclos de desenvolvimento, melhorar o tempo de atividade dos jobs e reduzir os custos de computação. Tanto as execuções parciais quanto os reparos parciais estão geralmente disponíveis na interface do usuário e na API de Jobs.

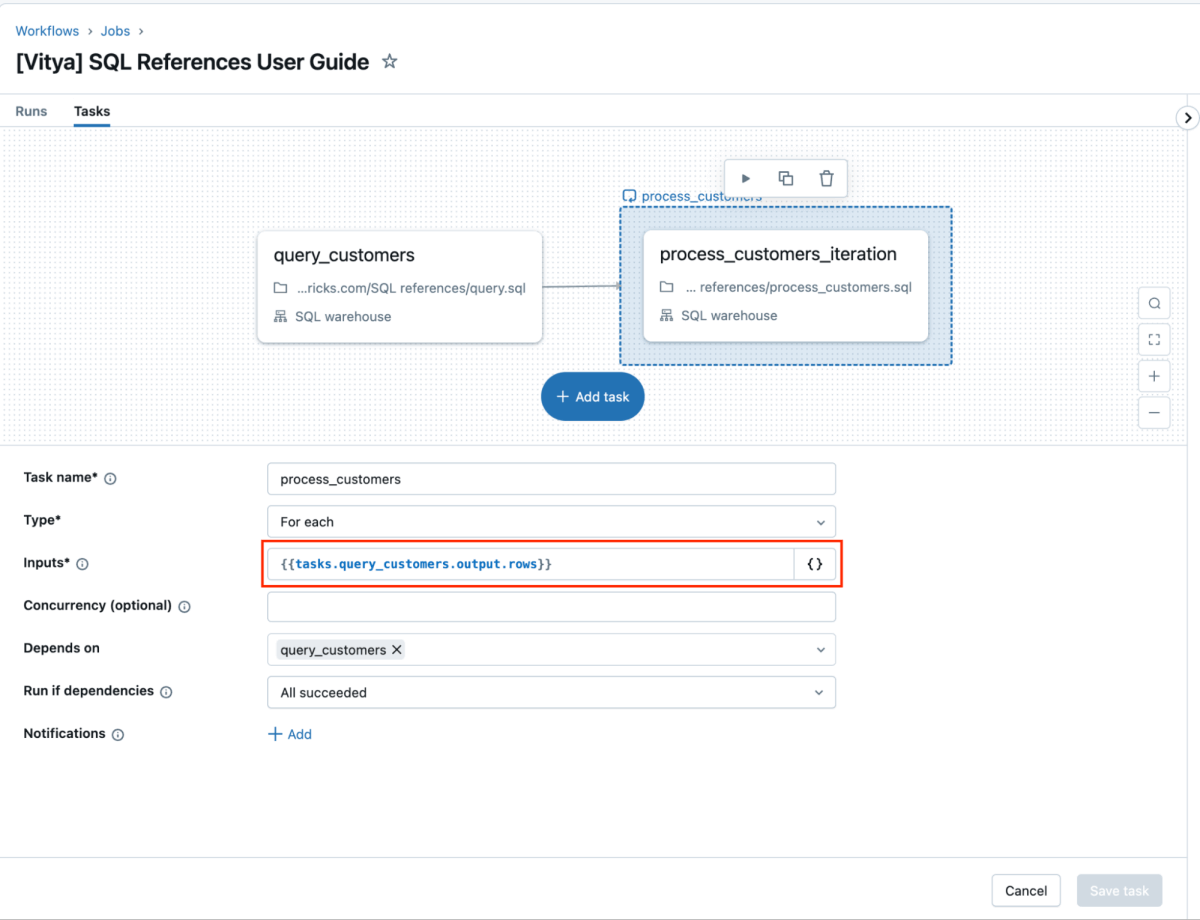

Para todos os fãs de SQL, temos ótimas notícias! Nesta última rodada de atualizações, os clientes poderão usar os resultados de consultas SQL como parâmetros no Lakeflow Jobs para orquestrar seus dados. Isso facilita para os desenvolvedores SQL passarem parâmetros entre tarefas e compartilharem contexto dentro de um job, resultando em uma orquestração de pipeline de dados mais coesa e unificada. Este recurso também está agora geralmente disponível.

Início rápido com Lakeflow Connect em Jobs

Além desses aprimoramentos, também estamos tornando rápido e fácil ingerir dados no Lakeflow Jobs, integrando mais estreitamente Jobs com Lakeflow Connect, a solução de ingestão de dados gerenciada e confiável do Databricks Lakeflow, com conectores integrados.

Os clientes já podem orquestrar pipelines de ingestão do Lakeflow Connect que se originam do Lakeflow Connect, usando qualquer um dos conectores totalmente gerenciados (por exemplo, Salesforce, Workday, etc.) ou diretamente de notebooks. Agora, com o Lakeflow Connect em Jobs, os clientes podem criar facilmente um pipeline de ingestão diretamente de dois pontos de entrada em sua interface de Jobs, tudo dentro de um ambiente de clique e apontar. Como a ingestão é frequentemente o primeiro passo no ETL, essa nova integração perfeita com o Lakeflow Connect permite que os clientes consolidem e otimizem sua experiência de engenharia de dados, de ponta a ponta.

O Lakeflow Connect em Jobs está agora geralmente disponível para os clientes. Saiba mais sobre este e outros lançamentos recentes do Lakeflow Connect.

Uma única orquestração para todas as suas cargas de trabalho

Estamos inovando constantemente no Lakeflow Jobs para oferecer aos nossos clientes uma experiência de orquestração moderna e centralizada para todas as suas necessidades de dados em toda a organização. Mais recursos estão chegando ao Jobs - em breve revelaremos uma maneira para os usuários acionarem jobs com base em atualizações de tabelas, forneceremos suporte para tabelas do sistema e expandiremos nossas capacidades de observabilidade, então fique atento!

Para aqueles que desejam continuar aprendendo sobre o Lakeflow Jobs, confira nossas sessões sob demanda do nosso Data+AI Summit e explore o Lakeflow em uma variedade de casos de uso, demonstrações e muito mais!

- Saiba mais sobre o Lakeflow Jobs

- Crie seu primeiro job com nosso Guia de Início Rápido

- Ative a nova interface do usuário usando a opção na página Jobs & Pipelines (apenas para clientes em prévia)

- Não conseguiu ir ao Data+AI Summit? Assista às sessões do Lakeflow Jobs sob demanda

(Esta publicação no blog foi traduzida utilizando ferramentas baseadas em inteligência artificial) Publicação original

Receba os posts mais recentes na sua caixa de entrada

Assine nosso blog e receba os posts mais recentes diretamente na sua caixa de entrada.