Protección contra exfiltración de datos con la plataforma Databricks Lakehouse en AWS

Aprende cómo configurar una arquitectura segura de Databricks en AWS para protegerte contra la exfiltración de datos

Si bien esta guía contiene valiosos detalles técnicos específicos de la nube, ahora recomendamos nuestro Enfoque Unificado para la Protección contra la Exfiltración de Datos en Databricks, que proporciona un marco integral en AWS, Azure y GCP con controles priorizados y orientación de implementación.

La Plataforma Databricks Lakehouse proporciona un conjunto unificado de herramientas para crear, implementar, compartir y mantener soluciones de datos de nivel empresarial a escala. Databricks se integra con el almacenamiento en la nube y la seguridad en su cuenta de la nube, y administra e implementa la infraestructura de la nube en su nombre.

El objetivo general de este artículo es mitigar los siguientes riesgos:

- Acceso a datos desde un navegador en Internet o una red no autorizada utilizando la aplicación web Databricks.

- Acceso a datos desde un cliente en Internet o una red no autorizada utilizando la API de Databricks.

- Acceso a datos desde un cliente en Internet o una red no autorizada utilizando el Almacenamiento en la Nube (S3).

- Una carga de trabajo comprometida en el clúster de Databricks que escribe datos en un recurso de almacenamiento no autorizado en AWS o en Internet.

Protección de Datos en Tránsito y en Reposo con Herramientas Nativas de AWS en Databricks

Databricks admite varias herramientas y servicios nativos de AWS que ayudan a proteger los datos en tránsito y en reposo.

Grupos de Seguridad

Los Grupos de Seguridad son firewalls virtuales con estado adjuntos a las instancias EC2. Le permiten definir qué tráfico entrante y saliente está permitido. El estrechamiento de las reglas de salida (saliente) restringe que las instancias EC2 envíen datos a direcciones IP no autorizadas o a Internet, bloqueando efectivamente las fugas de datos no deseadas.

- Previene: Conexiones salientes no autorizadas desde recursos de cómputo de Databricks.

Políticas de Puntos de Conexión de VPC

Las políticas de puntos de conexión de VPC controlan el acceso a los servicios de AWS a través de puntos de conexión de VPC. Al permitir solo las operaciones requeridas en recursos específicos de AWS (como los buckets de S3), puede evitar que los espacios de trabajo de Databricks exfiltren datos a otras cuentas o servicios de AWS.

- Previene: Que Databricks envíe datos a servicios o recursos no autorizados de AWS.

Puntos de Conexión de VPC

Los Puntos de Conexión de VPC establecen conexiones privadas entre su VPC y otros servicios de AWS sin atravesar Internet. Esto garantiza que los datos confidenciales nunca se expongan a redes externas, mitigando los riesgos de exfiltración de datos a través de rutas de Internet.

- Previene: La exposición del tráfico a Internet durante la comunicación del servicio.

- Documentación: Puntos de Conexión de VPC de AWS

Roles de IAM

Los Roles de IAM le permiten controlar a qué recursos de AWS puede acceder Databricks y qué acciones puede realizar. El uso cuidadoso de las políticas de confianza y permisos garantiza que los usuarios y clústeres de Databricks solo puedan interactuar con recursos explícitamente autorizados, bloqueando el uso de buckets de S3 o servicios externos no autorizados.

- Previene: Escrituras de datos en recursos no autorizados de AWS utilizando credenciales comprometidas o excesivamente permisivas.

Tablas de Enrutamiento

Las Tablas de Enrutamiento determinan el flujo del tráfico de red dentro de su VPC. Al evitar las rutas salientes a Internet (o solo permitir destinos necesarios), usted controla a dónde pueden viajar los datos, reduciendo el riesgo de que los datos se enruten a ubicaciones inseguras.

- Previene: Rutas de red a Internet o a redes no autorizadas.

AWS PrivateLink

AWS PrivateLink permite la conectividad privada entre VPC y servicios de AWS a través de interfaces de red dedicadas y cifradas, eliminando la exposición a Internet. Esto proporciona una ruta segura para los planos de control y datos de Databricks, lo que dificulta la fuga de datos fuera de AWS.

- Previene: Interceptación o exfiltración de datos a través de redes públicas.

Subredes Privadas

Las subredes privadas no tienen una ruta directa a Internet, lo que significa que los recursos dentro de ellas no pueden iniciar conexiones salientes a Internet. Esta barrera arquitectónica impide que los clústeres y nodos envíen datos directamente fuera de AWS.

- Previene: Cualquier comunicación saliente a Internet desde recursos de cómputo.

Claves KMS

AWS Key Management Service (KMS) le permite cifrar datos en reposo, incluso en buckets de S3. Incluso si se accede a los datos, permanecen protegidos a menos que el atacante también tenga acceso a las claves de cifrado.

- Previene: Exfiltración utilizable de datos sin comprometer el material de la clave.

Políticas de Bucket S3

Estas políticas de recursos otorgan o deniegan el acceso a buckets de S3 específicos. Al limitar el acceso solo desde fuentes aprobadas (como desde la VPC de Databricks o roles de IAM específicos), garantizan que incluso si alguien intenta exfiltrar datos, no podrá escribir ni copiar datos confidenciales fuera de los buckets controlados.

- Previene: Escrituras/lecturas desde ubicaciones de S3 no deseadas.

Cada uno de estos controles, individual y conjuntamente, impone un enfoque de defensa en profundidad contra la exfiltración de datos, asegurando múltiples puntos de control antes de que los datos puedan salir de su entorno protegido.

El cifrado es otro componente importante de la protección de datos. Databricks admite varias opciones de cifrado, incluidas claves de cifrado administradas por el cliente, rotación de claves, cifrado en reposo y en tránsito. Las claves de cifrado administradas por Databricks se utilizan de forma predeterminada y están habilitadas desde el principio; los clientes también pueden traer sus propias claves de cifrado.

Registro de Auditoría

El registro de auditoría es una capacidad fundamental de seguridad y cumplimiento, que permite a las organizaciones rastrear la actividad del usuario, las acciones administrativas y los eventos del sistema en todo el entorno de Databricks. En el contexto de la exfiltración de datos, los registros de auditoría desempeñan un papel fundamental para permitir la detección, investigación y respuesta a posibles amenazas o comportamientos inapropiados.

Los registros de auditoría ayudan a responder preguntas fundamentales como:

- ¿Quién accedió a qué datos y cuándo?

- ¿Qué operaciones (lectura, escritura, modificación, eliminación) se realizaron?

- ¿Hubo intentos de acceder o exportar datos confidenciales fuera de la política?

Al rastrear estos eventos, los registros de auditoría respaldan tanto la supervisión de seguridad como la generación de informes de cumplimiento.

Capacidades de Registro de Auditoría de Databricks

Databricks proporciona sólidas funciones de registro de auditoría tanto a nivel de espacio de trabajo como de cuenta. Las capacidades clave incluyen:

- Registros de auditoría a nivel de espacio de trabajo: Capturan acciones de usuarios y sistemas dentro de un espacio de trabajo de Databricks.

- Registros de auditoría a nivel de cuenta: Rastrea acciones en todos los espacios de trabajo de la cuenta.

- Registros de auditoría detallados: Captura de eventos opcional y más granular para una mayor visibilidad.

- Integración con tablas del sistema de Unity Catalog: Muestra registros de acceso, cómputo, consulta, servicio y almacenamiento como parte de los flujos de trabajo de gobernanza de datos e investigación.

Los registros de auditoría se pueden entregar a un bucket de Amazon S3 designado por el cliente en tiempo casi real. Pueden integrarse directamente con sistemas SIEM o de análisis de seguridad para la monitorización continua y las alertas.

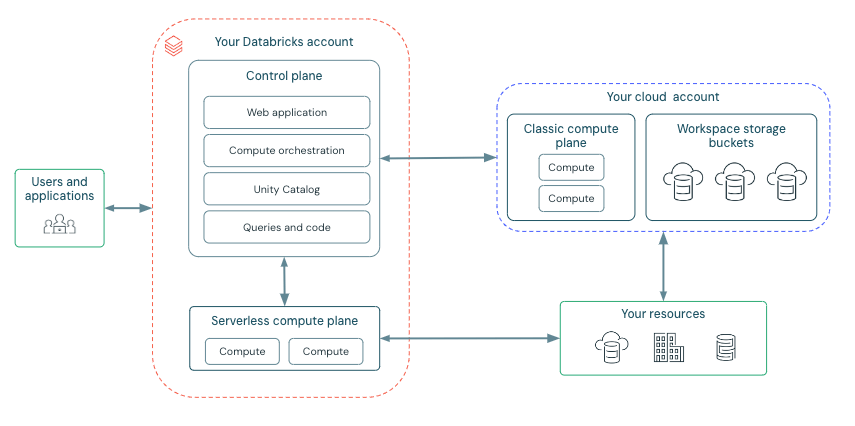

Arquitectura de Databricks

Antes de comenzar, echemos un vistazo rápido a la arquitectura de implementación de Databricks aquí:

Databricks está estructurado para permitir la colaboración segura entre equipos multifuncionales, manteniendo al mismo tiempo una cantidad significativa de servicios backend administrados por Databricks para que usted pueda concentrarse en sus tareas de ciencia de datos, análisis de datos e ingeniería de datos.

Databricks opera a partir de un plano de control y un plano de cómputo.

- El plano de control incluye los servicios backend que Databricks administra en su propia cuenta de AWS Cloud. Los comandos de los cuadernos y muchas otras configuraciones del espacio de trabajo se almacenan en el plano de control y se cifran en reposo.

- El plano de cómputo, donde se procesan sus datos, tiene diferentes tipos según el cómputo específico que esté utilizando. Puede encontrar más información sobre estos tipos de cómputo.

- Para el cómputo sin servidor, los recursos de cómputo sin servidor se ejecutan en un plano de cómputo sin servidor en su cuenta de Databricks.

- Para el cómputo clásico de Databricks, los recursos de cómputo se encuentran en su cuenta de AWS Cloud.

Arquitectura de Alto Nivel

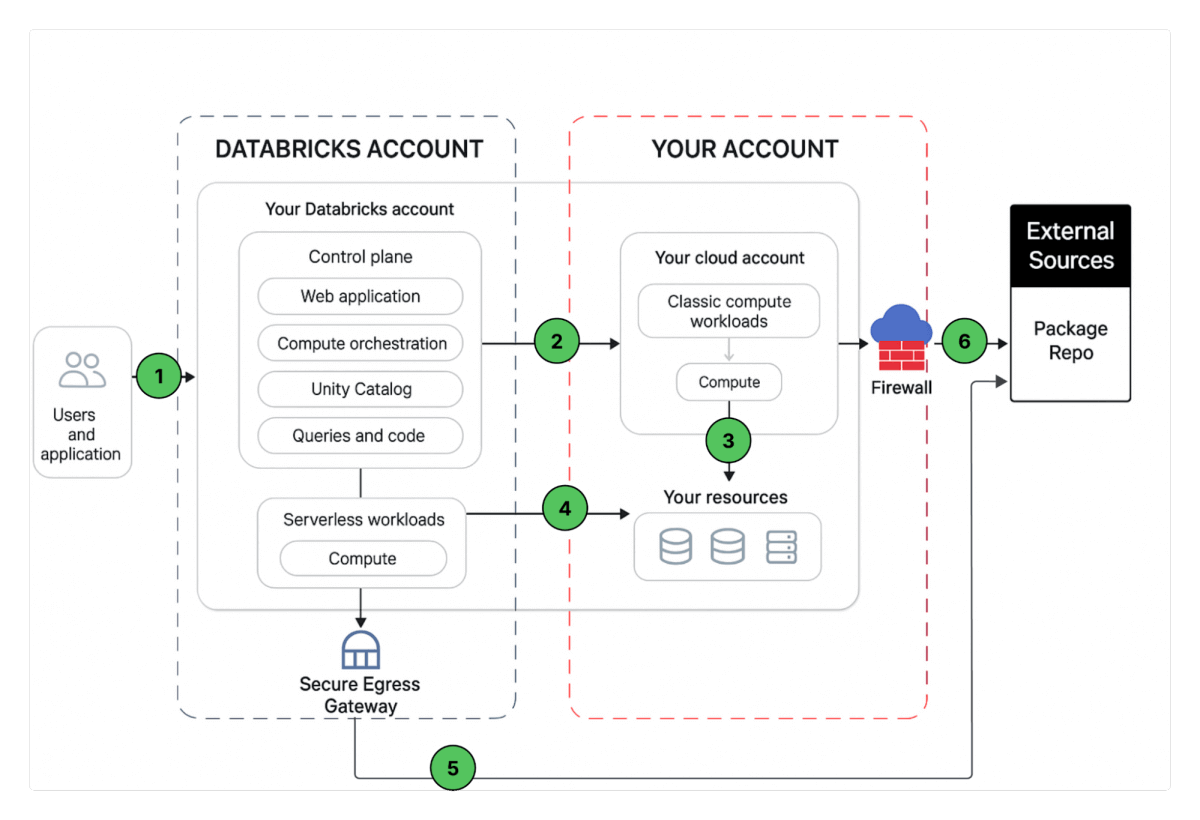

Ruta de Comunicación de Red

Para comprender las medidas de seguridad que pretendemos implementar, examinemos las diversas formas en que los usuarios y las aplicaciones interactúan con Databricks, como se ilustra a continuación.

Una implementación de Databricks workspace incluye las siguientes rutas de red que puedes proteger.

- Usuario o Aplicaciones a la aplicación web de Databricks, también conocida como workspace, o a las APIs REST de Databricks.

- Red VPC del plano de cómputo clásico de Databricks al servicio del plano de control de Databricks. Esto incluye el relé de conectividad segura de clúster y la conexión del workspace para los puntos de conexión de la API REST.

- Plano de cómputo clásico a tus servicios de almacenamiento (ej: S3, Kinesis, etc.).

- Plano de cómputo sin servidor a tus servicios de almacenamiento (ej: S3, Kinesis, etc.).

- Salida segura desde el plano de cómputo sin servidor a través de políticas de red (firewall de salida) a fuentes de datos externas, por ejemplo, repositorios de paquetes como pypi o maven.

- Salida segura desde el plano de cómputo clásico a través de firewall de salida a fuentes de datos externas, por ejemplo, repositorios de paquetes como pypi o maven.

Desde la perspectiva del usuario final, el punto 1 requiere controles de entrada y los puntos 2, 3, 4, 5 y 6 requieren controles de salida.

En este artículo, nuestro enfoque es proteger el tráfico de salida de tus cargas de trabajo de Databricks, proporcionar al lector una guía prescriptiva sobre la arquitectura de implementación propuesta y, de paso, compartir mejores prácticas para proteger también el tráfico de entrada (usuario/cliente hacia Databricks).

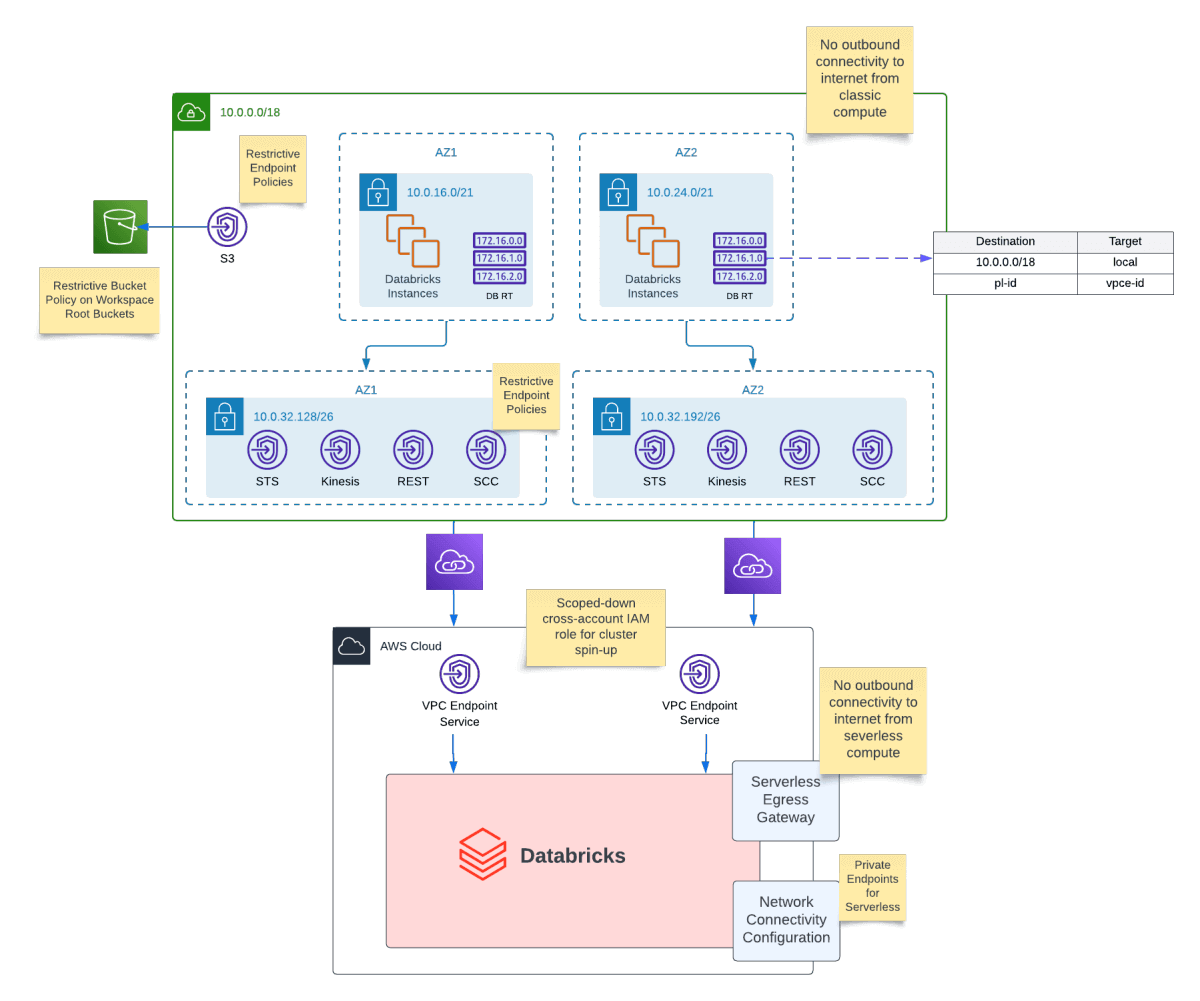

Arquitectura de Implementación Propuesta - Arquitectura de Referencia de Seguridad de AWS

Implementar Databricks de forma segura en AWS puede parecer complejo; necesitas VPCs, roles de IAM, redes privadas, Unity Catalog y salvaguardas que se alineen con la seguridad empresarial. La Arquitectura de Referencia de Seguridad (SRA) de Databricks para AWS empaqueta estas mejores prácticas en plantillas de Terraform listas para usar, brindando a los equipos un punto de partida reforzado para implementaciones en producción.

Qué es

- Módulos de Terraform opinados para Databricks seguro en AWS.

- Cubre redes, IAM, Unity Catalog, políticas listas para usar.

- Actúa como un blueprint centrado en la seguridad para acelerar la adopción.

Por qué importa

- Velocidad: Automatiza la configuración de infraestructura y workspace en minutos.

- Seguridad: VPCs preconfiguradas, redes privadas, registro de auditoría.

- Escalabilidad: Patrones reutilizables en cuentas/workspaces.

Estructura general del repositorio

- aws/ → Creación de infraestructura y workspace de AWS.

- /modules/databricks_account/unity_catalog_metastore_creation/ → Creación de metastore

- aws/tf/modules/sra/credential.tf → Rol entre cuentas usando ID externo

- template.tfvars.example → Rellena tus variables

Lo que obtienes

- VPCs, subredes y roles de IAM de AWS.

- Workspaces de Databricks conectados a Unity Catalog.

- Opciones reforzadas: salida restringida, registro, monitoreo.

Cómo usar

- Clona el repositorio.

- Rellena tus variables en template.tfvars.example

- Modifica los parámetros de VPC, subred y nombre donde sea necesario

- Extiende a CI/CD para implementaciones empresariales repetibles.

Advertencias

- Instantánea puntual, revisa antes de las actualizaciones.

- No es “gestionado” → los equipos son dueños de las pruebas y adaptación.

- Requiere conocimiento de los proveedores Terraform, AWS y Databricks.

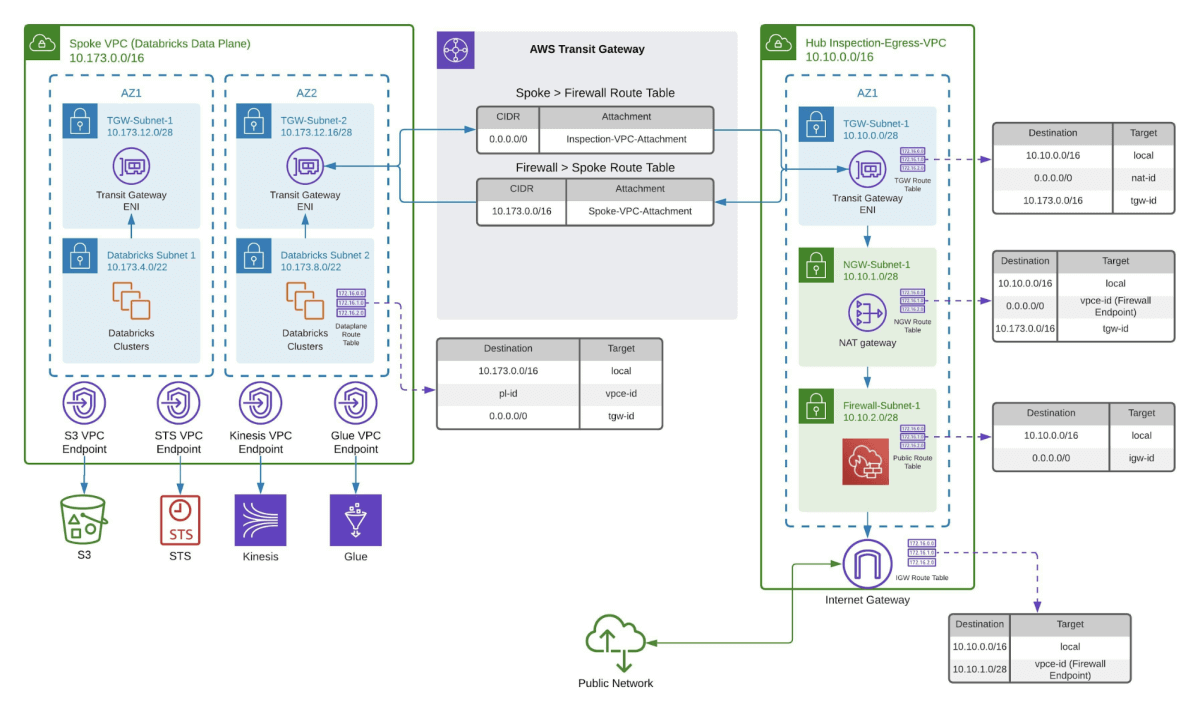

Si necesitas acceso a internet para pypi o maven, recomendamos la siguiente arquitectura para que escanees cualquier tráfico que salga de tu VPC y así poder monitorear cualquier tráfico saliente. Varios servicios de AWS pueden usarse para escanear el tráfico saliente hacia tu VPC. Por ejemplo, AWS Network Firewall o Gateway Load Balancer. Recomendamos seguir la documentación de AWS, por ejemplo aquí, para comenzar con tu configuración de AWS Network Firewall.

Controles de Protección contra Exfiltración de Datos en Databricks

Además de monitorear el tráfico saliente, implementa los siguientes controles para reforzar tu entorno Databricks contra la exfiltración de datos. Ten en cuenta que algunas características, como el enlace privado, solo son compatibles con el nivel Enterprise de Databricks:

Aprovisionamiento SCIM

Automatiza la gestión del ciclo de vida de usuarios y grupos desde tu IdP a Databricks.

Guía de Aprovisionamiento SCIM

Inicio de Sesión Único (SSO)

Requiere autenticación centralizada a través de tu proveedor de identidad (SAML u OIDC).

Configuración de SSO

Autenticación Multifactor (MFA)

Impón MFA a nivel de IdP para añadir una capa adicional de seguridad de inicio de sesión.

Autenticación Multifactor

Listas de Control de Acceso (ACL) de IP de la Consola de Cuenta

Restringe el acceso a la consola de cuenta de Databricks definiendo rangos de IP permitidos.

Listas de Control de Acceso de IP

Puntos de Conexión Privados en la Configuración de Conectividad de Red

Asegura que el tráfico del workspace fluya solo a través de puntos de conexión privados (sin internet público).

Configuración de Conectividad de Red

Controles de Salida de Datos sin Servidor

Aplica restricciones para limitar los destinos externos desde el cómputo sin servidor de Databricks.

Seguridad de Cómputo sin Servidor

Evitar Almacenar Datos de Producción en DBFS

No persistas conjuntos de datos sensibles en DBFS; utiliza almacenamiento seguro (ej: S3, ADLS).

Descripción general de DBFS

Vida Útil del Token del Receptor de Delta Sharing

Acorta la validez del token para Delta Sharing para reducir la exposición si se filtra.

Seguridad de Delta Sharing

Aislar Cargas de Trabajo Sensibles en Diferentes Redes

Usa VPCs/subredes separadas para aislar lógicas y físicamente las cargas de trabajo.

Aislar Cargas de Trabajo Sensibles en Diferentes Workspaces

Implementa múltiples workspaces (prod, dev, test) para forzar la separación de entornos.

Estrategia Multi-Workspace

Federación de Tokens OIDC para CI/CD

Usa federación OIDC para intercambiar de forma segura tokens de corta duración cuando las canalizaciones de CI/CD interactúan con Databricks.

Federación de Tokens OIDC

La aplicación conjunta de estos controles proporciona una defensa en profundidad en capas, minimizando el riesgo de fuga de datos accidental o maliciosa.

Complementos con Cumplimiento de Seguridad y Monitoreo Mejorados:

Si tu organización tiene requisitos de seguridad elevados, como la necesidad de soportar HIPAA, PCI o estándares igualmente estrictos, considera habilitar Monitoreo de Seguridad Mejorado para tus cargas de trabajo de Databricks.

Esta funcionalidad avanzada se basa en las capacidades de seguridad principales de Databricks para proporcionar una mayor visibilidad, detección proactiva de amenazas y endurecimiento adicional tanto para entornos de cómputo clásicos como sin servidor. Enhanced Security Monitoring ofrece beneficios como Canonical Ubuntu con endurecimiento CIS Nivel 1, monitoreo continuo basado en el comportamiento de malware e integridad de archivos, escaneo integral de malware y antivirus, e informes detallados de vulnerabilidades para el sistema operativo host.

Con esta funcionalidad habilitada (a través del perfil de seguridad de cumplimiento), los registros de eventos de seguridad, incluidas las alertas de escaladas de privilegios, shells interactivas sospechosas, conexiones salientes no autorizadas, cambios inesperados en archivos del sistema o intentos de exfiltración, se registran automáticamente. Estos registros se entregan junto con los registros de auditoría estándar de Databricks, proporcionando información rica y contextual a la SIEM de su organización o dentro de Databricks. Esto permite a los analistas de seguridad rastrear y responder rápidamente a comportamientos anómalos o riesgosos, lo que facilita la detección inmediata y la respuesta rápida a incidentes sin necesidad de investigaciones exhaustivas.

Conclusión y Próximos Pasos

Una defensa sólida contra la exfiltración de datos para Databricks en AWS no es una configuración única, requiere una mejora continua. Más allá de implementar controles arquitectónicos, haga del monitoreo continuo, la auditoría rigurosa y la gestión proactiva de cambios un elemento central de su práctica de seguridad. Revisar regularmente los registros de auditoría, actualizar las políticas de acceso y red, y colaborar con los equipos de seguridad y cumplimiento ayuda a garantizar que las protecciones evolucionen para contrarrestar las amenazas emergentes. Para profundizar su estrategia, revise recursos de renombre sobre mejores prácticas de monitoreo en la nube y registro de auditoría. Estas referencias le ayudarán a mantener la vigilancia y la resiliencia a medida que su panorama de datos y sus riesgos crecen.

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.