Un enfoque centrado en la IA para la ingeniería de datos con Lakeflow y Agent Bricks

Cómo Lakeflow y Agent Bricks llevan la automatización impulsada por IA a cada etapa de tu proceso de ETL

por Joanna Zouhour

- Lakeflow ofrece una plataforma de ingeniería de datos centrada en la IA que les permite aprovechar y poner en producción modelos de IA en su ETL con las funciones de IA de Agent Bricks

- Los ingenieros de datos pueden orquestar fácilmente sus modelos de IA a escala con Lakeflow Jobs, automatizando su canalización de ETL dentro de su contexto empresarial

- Desde las coincidencias aproximadas hasta la extracción y el resumen de datos, los usuarios de Lakeflow Jobs pueden habilitar casos de uso de canalizaciones y extraer nueva información clave que puede impulsar sus casos de uso posteriores de análisis, BI y ML.

Los ingenieros de datos se centran cada vez más en un problema central: usar la IA para mejorar el ETL y crear procesos confiables y de nivel de producción sin introducir una nueva complejidad. Necesitan una IA que realmente ofrezca resultados, que agilice los flujos de trabajo sin añadir herramientas desconectadas ni eliminar el contexto.

Databricks Lakeflow ofrece una plataforma unificada de ingeniería de datos con IA integrada y segura que automatiza todo su procesamiento de datos, descubre más información y admite una gama más amplia de problemas empresariales. Ya sea con código de canalización generado por IA o con la orquestación de cargas de trabajo de IA, los ingenieros de datos que aprovechan Lakeflow pueden evitar pasar horas en trabajo manual de integración y, en su lugar, centrarse en patrones estratégicos y de mayor valor que generan un impacto real en su negocio.

En este blog, exploraremos cómo puede poner en producción y escalar sus modelos de IA implementándolos en su canalización de datos para descubrir automáticamente información empresarial.

Extraiga más información de sus datos a escala y sin esfuerzo

Los equipos de datos están saturados de entradas no estructuradas, ya sean contratos, facturas, transcripciones o reseñas. Procesarlos suele significar hacer malabares con modelos de NLP frágiles, reglas rígidas o limpieza manual. El resultado: resultados poco fiables, tiempos de respuesta lentos e información valiosa atrapada dentro de los documentos, mientras los ingenieros pierden tiempo en el análisis repetitivo en lugar de generar impacto.

Con Databricks Lakeflow, puede resolver esto incorporando sin problemas transformaciones impulsadas por IA en sus flujos de trabajo existentes a través de las AI Functions de Databricks Agent Bricks. Estas funciones le permiten integrar IA de alta calidad directamente en su proceso de ETL, automatizando la extracción, transformación y clasificación de datos tanto estructurados como no estructurados a escala.

Hay varios tipos de funciones de IA en Agent Bricks entre los que puede elegir. Algunas de ellas no requieren prompts y son específicas para cada tarea, como por ejemplo:

ai_extract: extrae entidades específicas del texto de entrada según las etiquetas que proporcione. Por ejemplo, persona, ubicación, organizaciónai_classify: Clasifica el texto de entrada según las etiquetas que proporciones. Por ejemplo, “urgente” frente a “no urgente” o categorías de temas.ai_translate: Traduce texto a un idioma de destino específico.

Estamos especialmente entusiasmados con nuestra función de IA lanzada recientemente ai_parse_document, que se puede utilizar para transformar cualquier dato no estructurado en los formatos estructurados necesarios. Mediante el uso de modelos de base multimodales, ai_parse_doc te permite analizar texto, extraer tablas, razonar sobre cifras y convertir imágenes en descripciones generadas por IA. Esta función abre nuevas posibilidades para procesar datos que antes eran casi imposibles de analizar. Más información aquí

También ofrecemos una función más general llamada ai_query(), impulsada por nuestra plataforma de inferencia por lotes sin servidor. Esta función le permite ejecutar transformaciones impulsadas por IA en grandes conjuntos de datos utilizando cualquier LLM de su elección de una sola vez.

Para maximizar el rendimiento en millones de filas, nuestro motor de inferencia por lotes sin servidor aprovisiona y escala automáticamente los recursos de computación y ejecuta las cargas de trabajo en paralelo. Esto elimina la sobrecarga por solicitud y ofrece un procesamiento significativamente más rápido, lo que reduce los tiempos de ejecución de horas a minutos y mejora la rentabilidad para las cargas de trabajo de IA de gran volumen.

Con Lakeflow, puede poner en producción fácilmente sus modelos de IA y orquestarlos de forma nativa en su solución de ingeniería de datos usando Lakeflow Jobs. Con las funciones de IA, puede aportar más eficiencia a su orquestación y habilitar más casos de uso, como los siguientes:

- Generar nuevos datos. Utilice la IA para escribir resúmenes sobre la información de los clientes a fin de acelerar la generación de informes o para proyectar los ingresos futuros.

- Estructurar y organizar datos en categorías específicas con significado para el negocio. Realice análisis de sentimiento en millones de reseñas multilingües o automatice la segmentación de clientes utilizando prompts de lenguaje natural a escala.

- Mejorar la calidad de los datos. Utilice las coincidencias aproximadas y la resolución de entidades para corregir duplicados e incoherencias a escala.

La combinación de Lakeflow y Agent Bricks le permite ejecutar sus modelos de IA en una única plataforma de datos unificada y gobernada, de modo que su IA (y la información que extrae) tenga el contexto empresarial y corporativo adecuado.

Casos de uso prácticos de las funciones de IA y Lakeflow

Ejemplo 1: Cómo convertir transcripciones de llamadas sin procesar en información empresarial

Imagine que su equipo de ventas necesita una forma fiable de convertir largas transcripciones de llamadas no estructuradas en resúmenes claros y procesables. Con cientos de llamadas al día (muchas de las cuales duran entre 45 y 60 minutos), la revisión manual se vuelve imposible rápidamente.

Con Databricks, puede aprovechar las funciones de IA integradas para analizar fácil y rápidamente todas esas transcripciones, extraer información clave y generar recomendaciones de seguimiento.

En lugar de crear un servicio de IA independiente o gestionar agentes personalizados, puede simplemente escribir una consulta y ejecutarla como parte de su orquestador con Lakeflow Jobs. Su modelo de IA se implementa directamente en una plataforma de ingeniería de datos gobernada y unificada, donde obtiene un procesamiento por lotes escalable que se mantiene totalmente integrado con los flujos de trabajo de su canalización de ventas existentes, a la vez que permanece en el contexto empresarial y corporativo adecuado.

Veamos cómo funciona esto en la práctica. Después de ingerir las transcripciones de las llamadas en su canalización, puede aplicar funciones de IA para convertir el texto no estructurado en señales utilizables:

ai_analyze_sentimentpara revelar el sentimiento general de la llamada (positivo, negativo, neutro)ai_extractpara extraer información clave de las llamadas, como el nombre del cliente, el nombre de la empresa, el cargo, el número de teléfono, etc.ai_classifypara clasificar el tipo de llamada (urgencia, tema, etc.).

Esto te brinda una base estructurada para la analítica y automatización posteriores.

A continuación, utiliza ai_query para resumir cada llamada con el modelo de IA que prefieras (en nuestro ejemplo, usamos un LLM “databricks-meta-llama-3-3-70b-instruct”):

Esta consulta produce resúmenes coherentes y de alta calidad que los equipos de ventas y de cuentas pueden revisar de un vistazo.

Luego, puedes generar seguimientos personalizados en el mismo flujo de trabajo:

Estas notas se pueden enviar directamente a su CRM o a sus herramientas de ventas a gran escala, para que sus equipos sepan exactamente la acción correcta que deben tomar poco después de que termine la llamada. También podría compartir esas notas con su equipo de BI para descubrir brechas y ayudar a mejorar la experiencia general de servicio al cliente.

Ejemplo 2: Agilizar el procesamiento de reclamos de seguros

Imagine que está creando una canalización de procesamiento de reclamaciones para un proveedor de seguros que necesita aprobaciones más rápidas y coherentes. Hoy en día, las reclamaciones suelen llegar por correo electrónico con archivos adjuntos no estructurados, como documentos escaneados, fotos y PDF, lo que dificulta su ingesta y procesamiento a escala.

Con Agent Bricks y Lakeflow, los ingenieros de datos pueden usar ai_parse_document y ai_query para extraer, normalizar y consolidar datos de los correos electrónicos entrantes de forma automática como parte de sus canalizaciones de ETL. Esto permite una automatización fiable de extremo a extremo que reduce la revisión manual, acelera las decisiones y se integra sin problemas en los flujos de trabajo de datos existentes.

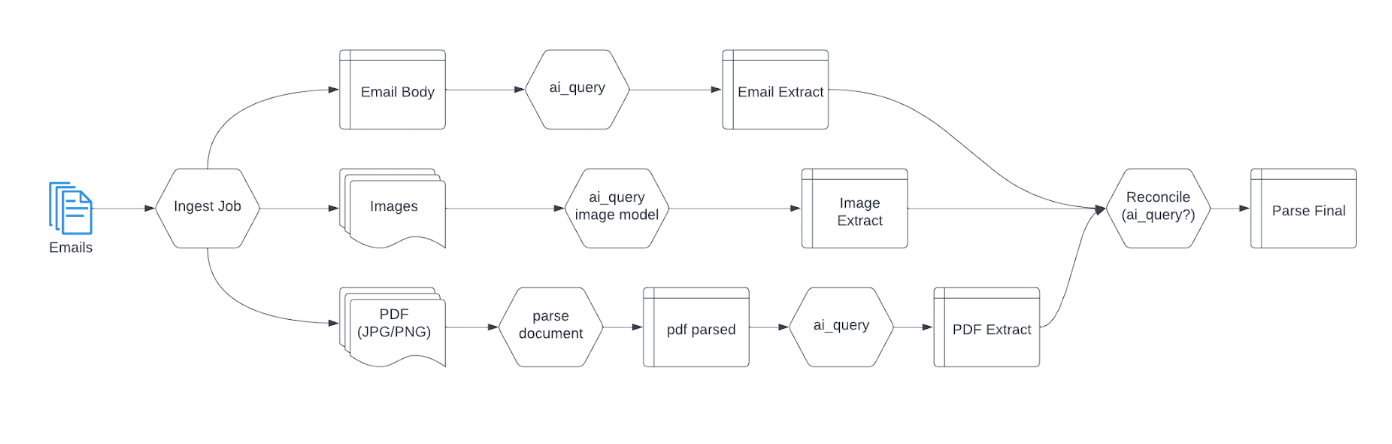

Así es como funcionaría:

Usando Lakeflow y Agent Bricks, puede ingerir sus archivos de correo electrónico en su lakehouse y luego extraer los datos que necesita con lo siguiente:

ai_querypara leer el cuerpo del correo electrónico y extraer información clave (por ejemplo: nombre, fecha de nacimiento, dirección, número de seguro social)ai_querycon un modelo que puede leer específicamente el tipo de imagen que se recibe. Esta función de IA generará texto que describe la imagen adjunta y extraerá sus metadatos. A continuación, se muestra un ejemplo de consulta SQL de esa función:

- y

ai_parse_documentpara leer cualquier PDF (jpg o png) adjunto al correo electrónico

Una vez extraídos los datos, puedes volver a usar ai_query para consolidar toda la información en un archivo que se puede reutilizar en otro flujo de trabajo o compartir directamente con un equipo descendente (analista de BI, equipo de IA/ML, etc.), dependiendo de tu caso de uso.

A continuación, se muestra un ejemplo de DAG de cómo se vería ese flujo de trabajo en Lakeflow Jobs:

Hay mucho más que puede hacer combinando Lakeflow y Agent Bricks: vea este video para aprender a convertir datos de ventas desordenados en campañas de marketing impulsadas por IA.

Aplicaciones del mundo real de la IA en Databricks

Muchos clientes e ingenieros de datos de Databricks han abordado con éxito diversos problemas empresariales (precios, éxito del cliente y marketing) utilizando la IA y Lakeflow para descubrir información y aumentar la productividad.

Kard, una empresa de tecnología financiera con sede en Nueva York, utiliza las funciones de IA de Agent Bricks para impulsar un sistema de categorización de transacciones escalable y preciso que sustituye los métodos heredados manuales e incoherentes. Este enfoque moderno permite a Kard procesar eficientemente miles de millones de transacciones, ofrecer recompensas personalizadas y proporcionar información más valiosa que impulsa la lealtad y el valor empresarial.

El equipo de ingeniería de datos de Banco Bradesco, uno de los bancos más grandes de América Latina, enfrentaba cuellos de botella en la productividad debido a los largos procesos de codificación, depuración y documentación. Al adoptar Databricks Assistant, redujeron el tiempo de codificación en un 50 % y permitieron a los usuarios, tanto técnicos como no técnicos, generar y solucionar problemas de código usando lenguaje natural, lo que democratizó el acceso a los datos, redujo los costos y aceleró las decisiones basadas en datos.

Locala, una plataforma global de publicidad omnicanal, utilizó Lakeflow Jobs para orquestar complejas canalizaciones de entrenamiento de LLM, que su anterior programador, Airflow, no podía gestionar. Al optimizar el ETL, el entrenamiento y la experimentación de modelos, y la selección de computación, Lakeflow Jobs eliminó la carga operativa de gestionar flujos de trabajo complejos, lo que permitió que un único científico de datos creara un asistente de GenAI que se convirtió en una característica de ventas clave para la empresa de tecnología publicitaria.

Con Lakeflow, puede integrar fácilmente capacidades de IA en su plataforma de ingeniería de datos y orquestar flujos de trabajo de IA, lo que hace que sus procesos de datos sean más eficientes, se basen en la información y sean más accesibles. ¡Y tenemos más novedades! Pronto podrá utilizar Databricks Genie para potenciar su plataforma de ingeniería de datos para la creación y depuración de canalizaciones mediante el procesamiento del lenguaje natural.

- Empiece a usar Databricks Free Edition

- Consulte la documentación de nuestro producto Databricks AI functions

- Más información sobre Databricks Genie

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.