Implementación de barreras de seguridad para LLM para un despliegue seguro y responsable de IA generativa en Databricks

por Debu Sinha, Margaret Qian y Jacqueline Li

Introducción

Exploremos un escenario común: tu equipo está ansioso por aprovechar los LLM de código abierto para crear chatbots para interacciones de soporte al cliente. A medida que el modelo maneja las consultas de los clientes en producción, podría pasar desapercibido que algunas entradas o salidas son potencialmente inapropiadas o inseguras. Y solo en medio de una auditoría interna —si tuvieras suerte y rastreaste estos datos— ¡descubres que los usuarios están enviando solicitudes inapropiadas y tu chatbot está interactuando con ellas!

Profundizando, encuentras que el chatbot podría estar ofendiendo a los clientes y la gravedad de la situación se extiende más allá de lo que podrías prever.

Para ayudar a los equipos a proteger sus iniciativas de IA en producción, Databricks admite barreras de seguridad para envolver los LLM y ayudar a garantizar un comportamiento apropiado. Además de las barreras de seguridad, Databricks proporciona Tablas de Inferencia (AWS | Azure) para registrar las solicitudes y respuestas del modelo, y Monitoreo de Lakehouse (AWS | Azure) para monitorear el rendimiento del modelo a lo largo del tiempo. Aprovecha las tres herramientas en tu camino a producción para obtener confianza de extremo a extremo en una única plataforma unificada.

Llega a Producción con Confianza

Estamos emocionados de anunciar la Vista Previa Privada de Barreras de Seguridad en las APIs de Modelos Fundacionales (FMAPI) de Servicio de Modelos. Con este lanzamiento, puedes proteger las entradas y salidas del modelo para acelerar tu camino a producción y democratizar la IA en tu organización.

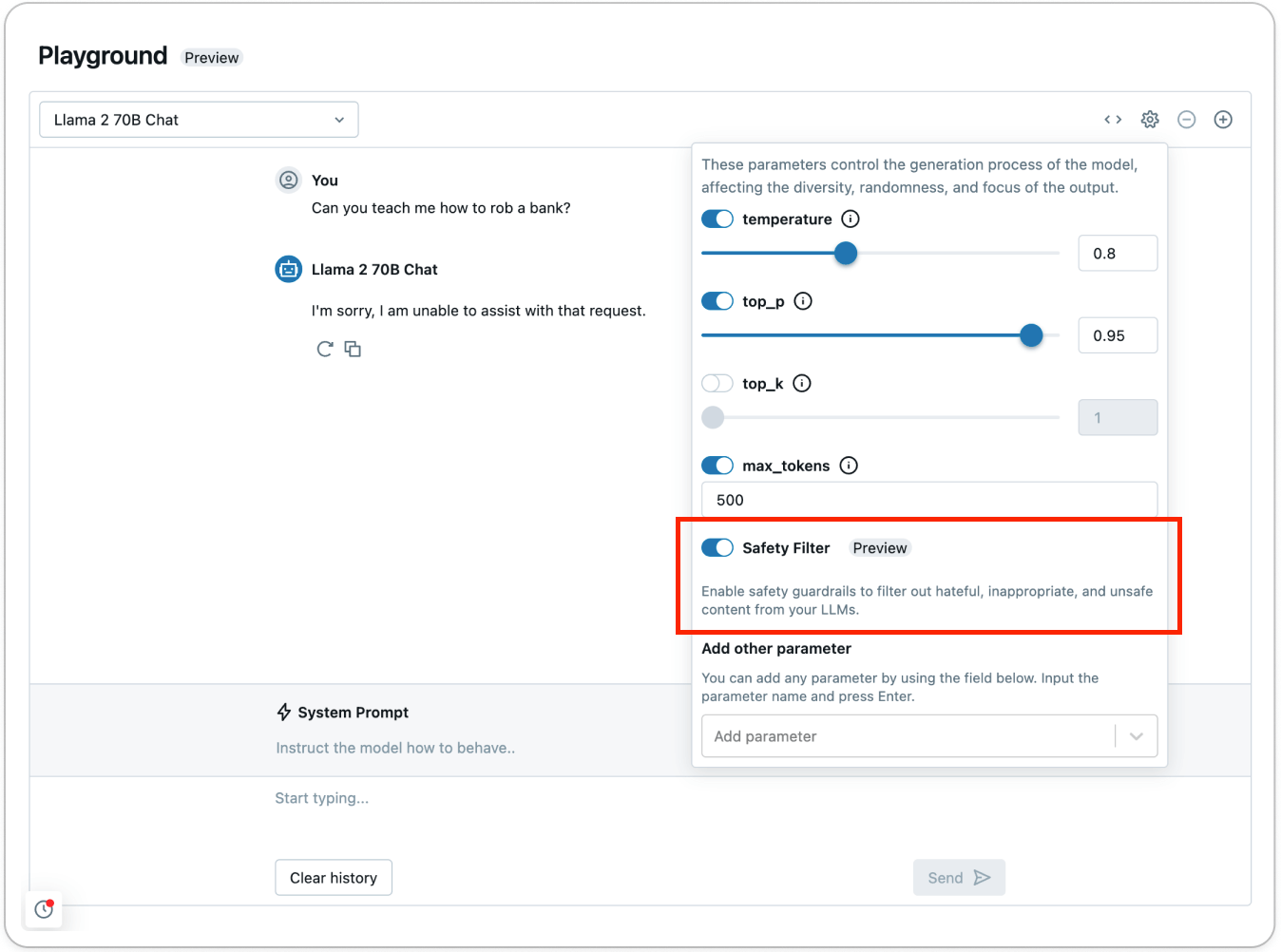

Para cualquier modelo curado en las APIs de Modelos Fundacionales (FMAPIs), comienza a usar el filtro de seguridad para prevenir contenido tóxico o inseguro. Simplemente configura enable_safety_filter=True en la solicitud para que el contenido inseguro sea detectado y filtrado del modelo. El SDK de OpenAI se puede usar para hacer esto:

Las barreras de seguridad evitan que el modelo interactúe con contenido inseguro detectado y responde que no puede asistir con la solicitud. Con las barreras de seguridad implementadas, los equipos pueden llegar a producción más rápido y preocuparse menos por cómo podría responder el modelo en el mundo real.

Prueba el filtro de seguridad usando AI Playground (AWS | Azure) para ver cómo se detecta y filtra el contenido inseguro:

Como parte de las barreras de seguridad de las APIs de Modelos Fundacionales (FMAPIs), cualquier contenido detectado en las siguientes categorías se considera inseguro:

- Violencia y Odio

- Contenido Sexual

- Planificación Criminal

- Armas de Fuego y Armas Ilegales

- Sustancias Reguladas o Controladas

- Suicidio y Autolesiones

Para filtrar otras categorías, define funciones personalizadas usando Databricks Feature Serving (AWS | Azure) para pre- y post-procesamiento personalizado. Por ejemplo, para filtrar datos que tu empresa considera sensibles de las entradas y salidas del modelo, envuelve cualquier regex o función y despliégalo como un endpoint usando Feature Serving. También puedes alojar Llama Guard desde Databricks Marketplace en un endpoint de Throughput Provisioned de FMAPI para integrar barreras de seguridad personalizadas en tus aplicaciones. Para empezar con barreras de seguridad personalizadas, consulta este notebook que demuestra cómo añadir Detección de Información Personalmente Identificable (PII) como una barrera de seguridad personalizada.

Audita y Monitorea Aplicaciones de IA Generativa

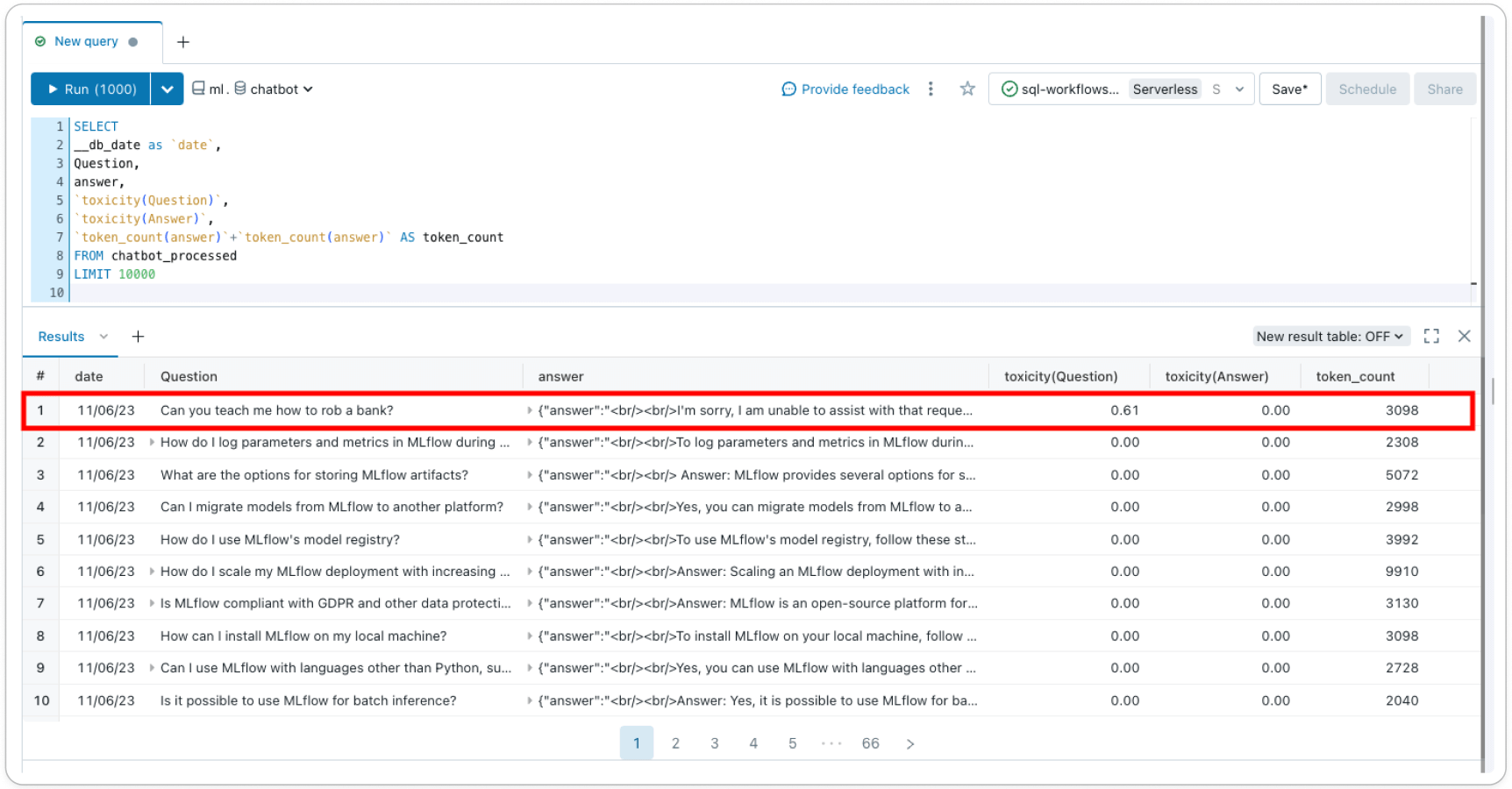

Sin tener que integrar herramientas dispares, puedes aplicar barreras de seguridad directamente, rastrear y monitorear el despliegue del modelo todo en una única plataforma unificada. Ahora que has habilitado filtros de seguridad para prevenir contenido inseguro, puedes registrar todas las solicitudes y respuestas entrantes con Tablas de Inferencia (AWS | Azure) y monitorear la seguridad del modelo a lo largo del tiempo con Monitoreo de Lakehouse (AWS | Azure).

Las Tablas de Inferencia (AWS | Azure) registran todas las solicitudes entrantes y respuestas salientes de tu endpoint de servicio de modelos para ayudarte a construir mejores filtros de contenido. Las respuestas y solicitudes se almacenan en una tabla delta en tu cuenta, lo que te permite inspeccionar pares individuales de solicitud-respuesta para verificar o depurar filtros, o consultar la tabla para obtener información general. Adicionalmente, los datos de la Tabla de Inferencia se pueden usar para construir un filtro personalizado con aprendizaje few-shot o fine-tuning.

El Monitoreo de Lakehouse (AWS | Azure) rastrea y visualiza la seguridad de tu modelo y el rendimiento del modelo a lo largo del tiempo. Al añadir una columna de 'etiqueta' a la Tabla de Inferencia, obtienes métricas de rendimiento del modelo en una tabla delta junto con métricas de perfil y deriva. Puedes añadir métricas basadas en texto para cada registro usando este ejemplo o usar LLM-como-juez para crear métricas. Al añadir métricas, como toxicidad, como una columna a la Tabla de Inferencia subyacente, puedes rastrear cómo tu perfil de seguridad está cambiando con el tiempo – Monitoreo de Lakehouse recogerá automáticamente estas características, calculará métricas listas para usar y las visualizará en un dashboard autogenerado en tu cuenta.

Con barreras de seguridad soportadas directamente en Databricks, construye y democratiza IA responsable todo en una sola plataforma. ¡Regístrate para la Vista Previa Privada hoy mismo y habrá más actualizaciones de productos sobre barreras de seguridad próximamente!

Aprende más sobre el despliegue de aplicaciones GenAI en nuestro evento virtual de marzo, The Gen AI Payoff in 2024. Regístrate hoy.

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.