Presentamos el Marco de Seguridad de IA de Databricks (DASF)

Un marco práctico para gestionar la seguridad de la IA

por Omar Khawaja, Arun Pamulapati, Kelly Albano y Erika Ehrli

¡Nos complace anunciar el lanzamiento del whitepaper Databricks AI Security Framework (DASF) versión 1.0! El marco está diseñado para mejorar el trabajo en equipo entre los grupos de negocio, TI, datos, IA y seguridad. Simplifica los conceptos de IA y ML catalogando la base de conocimientos de los riesgos de seguridad de IA basados en observaciones de ataques del mundo real y ofrece un enfoque de defensa en profundidad para la seguridad de IA, además de brindar consejos prácticos para su aplicación inmediata.

El machine learning (ML) y la IA generativa (GenAI) están transformando el futuro del trabajo al mejorar la innovación, la competitividad y la productividad de los empleados. Sin embargo, las organizaciones se enfrentan al doble desafío de aprovechar las tecnologías de inteligencia artificial (IA) para obtener oportunidades, al mismo tiempo que gestionan los posibles riesgos de seguridad y privacidad, como las violaciones de datos y el incumplimiento normativo.

Este blog ofrecerá una descripción general del DASF, cómo utilizarlo para proteger las iniciativas de IA de su organización, compartirá una actualización sobre nuestro impulso externo y guiará de forma segura la adopción de IA en su organización.

Construyendo los cimientos del Databricks AI Security Framework

La IA está impactando en todas las industrias y transformando la forma en que trabajamos. Ahora más que nunca, los líderes desean aprovechar los datos y la IA para transformar sus organizaciones. La seguridad y la gobernanza de la IA son fundamentales para establecer la confianza en los objetivos de IA de su organización. Según Gartner, la gestión de la confianza, el riesgo y la seguridad de la IA es la tendencia estratégica número 1 de 2024 que influirá en las decisiones de negocio y tecnología, y para 2026, los modelos de IA de las organizaciones que operacionalicen la transparencia, la confianza y la seguridad de la IA lograrán un aumento del 50% en términos de adopción, objetivos de negocio y aceptación por parte de los usuarios.

A principios de este año, anunciamos la adquisición de MosaicML por parte de Databricks y compartimos más sobre nuestro compromiso con la IA Responsable. Durante los últimos meses, hemos continuado fortaleciendo nuestro compromiso e impulso como líder de la industria en IA a través de nuevas asociaciones. Para complementar estas inversiones, el equipo de Seguridad de Databricks ahora organiza talleres de seguridad de IA para CISOs para educar a las organizaciones sobre cómo guiar con éxito su viaje de IA de manera consciente del riesgo. Aprendimos de nuestros clientes que los equipos de seguridad y gobernanza luchan por encontrar material confiable que desmitifique qué es la IA, cómo funciona y qué riesgos de seguridad pueden surgir a medida que se implementan estas tecnologías.

Tomamos estos aprendizajes para desarrollar el marco DASF y ayudar a los equipos de negocio, TI, datos, IA y seguridad a trabajar mejor juntos en la implementación de IA bajo los siguientes principios:

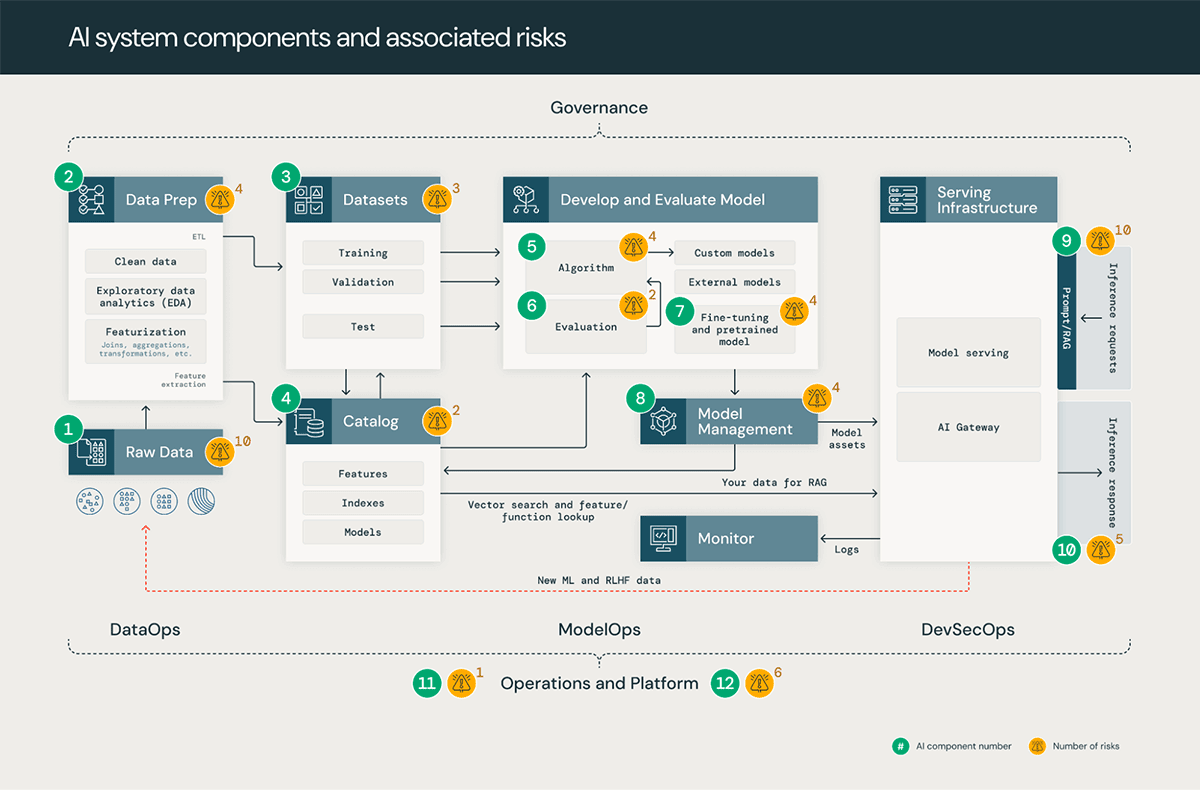

- Desmitificar la IA y el ML: El DASF desglosa los 12 componentes de un sistema de IA, los tipos de modelos de IA que existen y cómo funcionan juntos. Esto ayuda a la capacidad del equipo para trabajar juntos al definir una nomenclatura común de los sistemas, procesos y perfiles de IA involucrados.

- Proporcionar un enfoque de defensa en profundidad para asegurar la IA: En nuestras conversaciones con líderes de seguridad, es necesario aclarar si la seguridad de la IA es un problema de ciberseguridad, un problema de machine learning adversarial o algo completamente nuevo. La realidad es que es todo lo anterior. El DASF proporciona un marco para comprender los 55 riesgos de seguridad en las tres etapas de cualquier sistema de IA según sus casos de uso y modelos de implementación de IA específicos. También mapeamos los riesgos a marcos comunes de seguridad de IA como MITRE ATLAS, OWASP Top 10 para LLMs y la Taxonomía AML de NIST.

- Entregar recomendaciones accionables: Muchos marcos existentes hacen un buen trabajo al describir los riesgos asociados con la IA, pero no describen claramente los controles necesarios para mitigarlos. El DASF recomienda 53 controles aplicables a cualquier plataforma de datos e IA que utilice. Si usted es un cliente de Databricks, vamos un paso más allá: hemos incluido enlaces a la documentación de Databricks (por nube) para proporcionar instrucciones específicas sobre cómo implementar cada control de mitigación.

Comenzando con el Databricks AI Security Framework

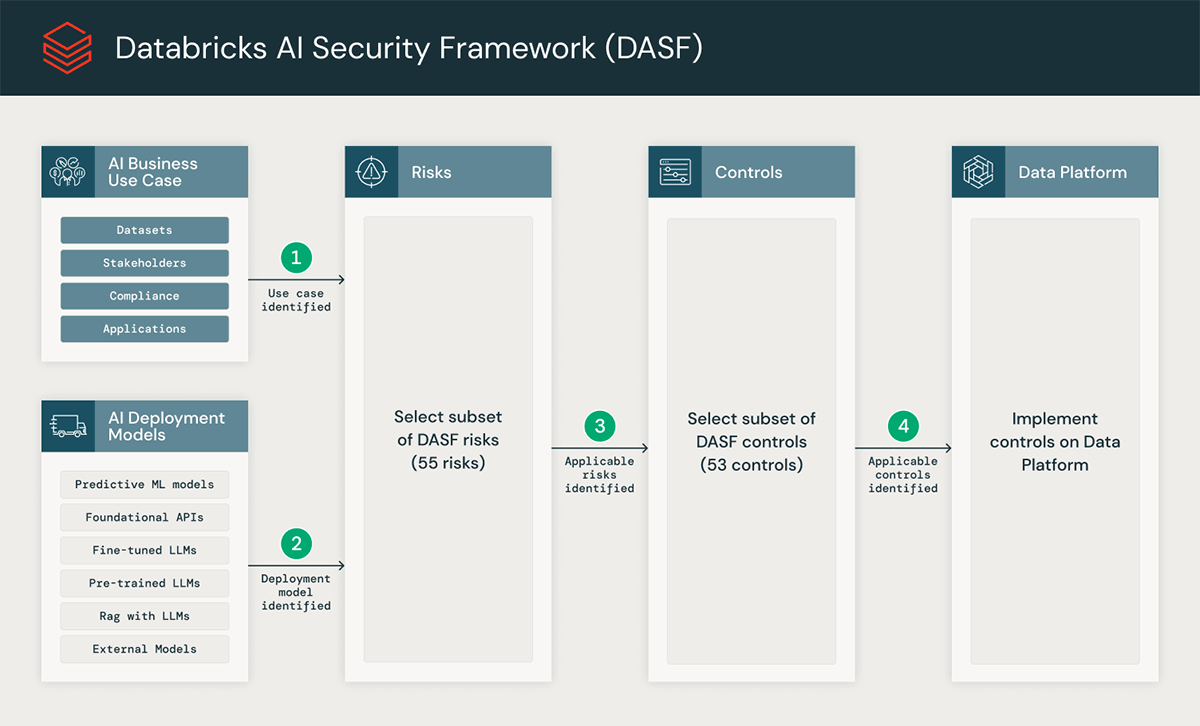

El DASF fue diseñado para que, sin importar la plataforma de datos e IA que utilice, pueda obtener un perfil de riesgo de extremo a extremo para las necesidades de implementación de IA de su organización con un conjunto concreto de controles que debería considerar implementar. Para comenzar con el DASF, recomendamos el siguiente enfoque, como se ilustra en la figura a continuación:

Paso 1 - Identificar el caso de uso de negocio de IA: Trabaje con sus partes interesadas, ya sea que ya estén implementados o en fases de planificación, en los casos de uso de IA de su organización. Recomendamos aprovechar los Aceleradores de Soluciones de Databricks, que son guías diseñadas específicamente para acelerar los resultados en sus casos de uso de IA y ML más comunes y de alto impacto. Revise qué conjuntos de datos se utilizarán, qué requisitos de cumplimiento pueden aplicarse y qué aplicaciones se verán afectadas por estos sistemas de IA para determinar las capacidades básicas requeridas de su plataforma de datos e IA.

Paso 2 - Determinar el modelo de implementación de IA: Elija un modelo de implementación apropiado, como modelos de ML predictivos, RAG-LLMs, LLMs ajustados (fine-tuned), LLMs preentrenados, modelos fundacionales y modelos externos. Cada modelo de implementación tiene una división variable de responsabilidad compartida entre los 12 componentes del sistema de IA y entre su organización, su plataforma de datos e IA y cualquier socio involucrado.

Paso 3 - Seleccionar los riesgos más pertinentes: De nuestra lista documentada de 55 riesgos de seguridad, identifique los más relevantes para su organización según el caso de uso y el modelo de implementación que su organización esté implementando. Para la mayoría de los casos de uso, solo será necesario abordar un pequeño subconjunto de los 55 riesgos.

Paso 4 - Elegir e implementar controles: Seleccione los controles que se alineen con el apetito de riesgo de su organización. Estos controles se definen genéricamente para ser compatibles con cualquier plataforma de datos e IA. Nuestro marco también proporciona directrices sobre cómo adaptar estos controles específicamente para la Plataforma de Inteligencia de Datos de Databricks con orientación específica de implementación de Databricks por nube. Utiliza estos controles junto con las políticas de su organización y tenga la garantía adecuada implementada.

Si esto aún parece mucho, continuaremos organizando nuestros talleres de seguridad de IA para aquellos que deseen una experiencia interactiva.

Fomentando la seguridad de la IA a través de aliados, socios y clientes de la industria

En la industria de la seguridad, cultivar la colaboración entre pares es imperativo para garantizar la seguridad, la protección y el éxito colectivos. No podríamos publicar un documento como el DASF hoy sin los estándares, marcos y herramientas de terceros que nos preceden, como las Directrices para el Desarrollo Seguro de Sistemas de IA, el Marco de Gestión de Riesgos de IA del NIST y el Marco Multicapa para Buenas Prácticas de Ciberseguridad para IA. Muchos más se referencian en el DASF y se pueden revisar en la sección de recursos.

Si bien realizamos innumerables revisiones internas con nuestros expertos en IA, ML y seguridad en Databricks, también nos reunimos con 15 líderes de la industria de seguridad de IA, incluidos los de HITRUST, Carnegie Mellon University, Capital One, Protect AI y Barracuda (¡y más citados a continuación!). Les agradecemos su tiempo, ideas y comentarios sobre cómo hacer que el DASF sea lo más práctico posible para nuestros colegas. Una lista completa de revisores se puede encontrar en la sección de agradecimientos del DASF.

"Cuando pienso en lo que hace que un acelerador sea bueno, se trata de hacer las cosas más fluidas, más eficientes y fomentar la innovación. El DASF es una herramienta probada y eficaz para que los equipos de seguridad ayuden a sus socios a sacar el máximo provecho de la IA. Además, se alinea con marcos de riesgo establecidos como NIST, por lo que no solo está acelerando las cosas, sino que está sentando una base sólida en el trabajo de seguridad." — Riyaz Poonawala, Vicepresidente de Seguridad de la Información, Navy Federal Credit Union

"Las empresas no necesitan sacrificar la seguridad por la innovación en IA. El Databricks AI Security Framework es una herramienta integral para permitir la adopción segura de la IA. No solo mapea las preocupaciones de seguridad de la IA con el pipeline de desarrollo de IA, sino que las hace accionables para los clientes de Databricks con controles prácticos. Estamos encantados de haber contribuido al desarrollo de este valioso recurso comunitario." — Hyrum Anderson, CTO, Robust Intelligence

"El DASF es un gran ejemplo del liderazgo de Databricks en IA y es una valiosa contribución a la industria en un momento crítico. Sabemos que el mayor riesgo asociado con la Inteligencia Artificial en el futuro previsible son las personas malintencionadas y este marco ofrece un contrapeso eficaz a esos ciberdelincuentes. El DASF es una forma pragmática, operativa y eficiente de asegurar su organización." — Chris "Tito" Sestito, CEO y Co-fundador de HiddenLayer

Dé el primer paso para expandir una sólida base de seguridad de IA: descargue el Databricks AI Security Framework y póngase en contacto con nuestro equipo

El whitepaper Databricks AI Security Framework está disponible para descargar en el Databricks Security and Trust Center. Hemos hecho un esfuerzo concertado para garantizar la precisión y nuestro equipo está deseoso de recibir sus comentarios. Si tiene algún comentario o pregunta, póngase en contacto con nosotros por correo electrónico a [email protected]. Esta alias es también donde puede solicitar más información sobre cómo unirse a un próximo taller de seguridad de IA o programar uno dedicado para su organización. Consulte nuestra nueva página de seguridad de IA para obtener recursos detallados sobre seguridad de IA y ML.

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.