Seguridad y confianza

La seguridad de sus datos es nuestra máxima prioridad.

Seguridad de IA

Prácticas recomendadas para mitigar los riesgos asociados con los modelos de IA

La seguridad de la IA se refiere a las prácticas, las medidas y las estrategias implementadas para proteger los sistemas de inteligencia artificial, los modelos y los datos contra el acceso no autorizado, la manipulación o las actividades maliciosas. Las organizaciones deben implementar protocolos de seguridad sólidos, métodos de cifrado, controles de acceso y mecanismos de monitoreo para proteger los activos de IA y mitigar los riesgos potenciales asociados con su uso.

Nuestro equipo de seguridad de Databricks trabaja con nuestra base de clientes para implementar IA y aprendizaje automático en Databricks de forma segura con las características adecuadas que cumplan con los requisitos de arquitectura de los clientes. También trabajamos con docenas de expertos internos en Databricks y en la comunidad más amplia de ML y GenAI para identificar los riesgos de seguridad de los sistemas de IA y definir los controles necesarios para mitigarlos.

Comprensión de los sistemas de IA

¿Qué componentes conforman un sistema de IA y cómo funcionan en conjunto?

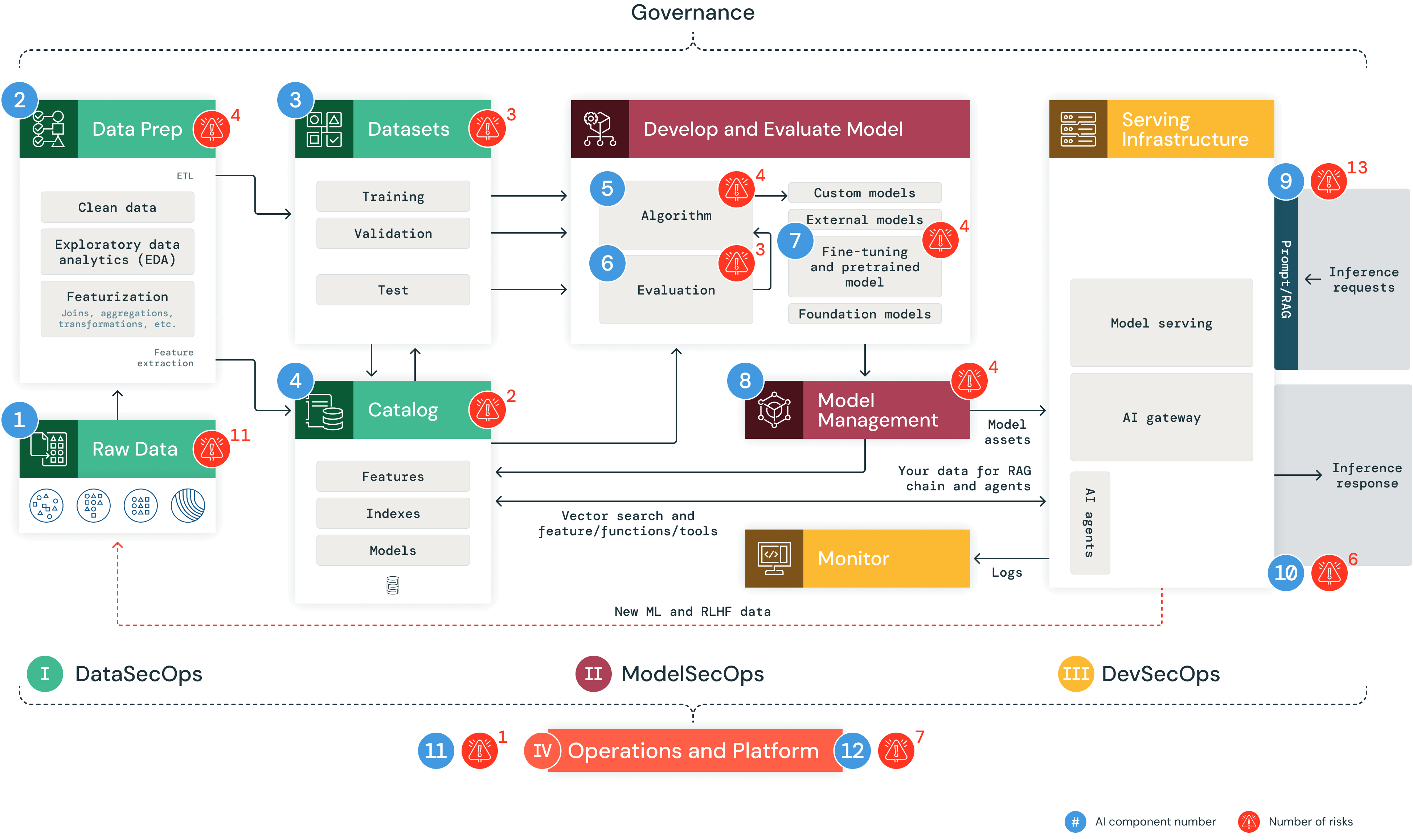

Los sistemas de IA se componen de datos, código y modelos. Un sistema de IA típico de extremo a extremo tiene 12 componentes de arquitectura fundamentales, categorizados en términos generales en cuatro etapas principales:

- Las operaciones de datos incluyen la ingesta y la transformación de datos y garantizan su seguridad y gobernanza. Los buenos modelos de AA dependen de canalizaciones de datos confiables y de una infraestructura segura.

- Las operaciones de modelos incluyen la creación de modelos personalizados, la adquisición de modelos de un mercado de modelos o el uso de modelos de lenguaje grandes (LLM) de software como servicio (SaaS), como OpenAI. El desarrollo de un modelo requiere una serie de experimentos y una forma de hacer un seguimiento y comparar las condiciones y los resultados de dichos experimentos.

- El despliegue y la entrega de modelos consiste en crear imágenes de modelos de forma segura, aislar y entregar modelos de forma segura, el escalamiento automatizado, la limitación de frecuencia y el monitoreo de los modelos desplegados.

- Operaciones y plataforma incluyen la gestión de vulnerabilidades de la plataforma y la aplicación de parches, el aislamiento de los modelos y los controles del sistema y el acceso autorizado a los modelos con seguridad en la arquitectura. También consta de herramientas operativas para CI/CD. Garantiza que el ciclo de vida completo cumpla con los estándares requeridos al mantener seguros los distintos entornos de ejecución (desarrollo, preproducción y producción) para MLOps.

La siguiente imagen resalta los 12 componentes y cómo interactúan en un sistema de IA.

Comprensión de los riesgos de seguridad de la IA

¿Cuáles son las amenazas de seguridad que pueden surgir al adoptar la IA?

En nuestro análisis de los sistemas de IA, identificamos 62 riesgos de seguridad técnicos en los 12 componentes fundamentales de la arquitectura. En la siguiente tabla, describimos estos componentes básicos, que se alinean con los pasos de cualquier sistema de IA, y destacamos algunos ejemplos de riesgos de seguridad. La lista completa de los 62 riesgos de seguridad técnicos se puede encontrar en el Databricks AI Security Framework.

Etapa del sistema de IA | Componentes del sistema de IA | Posibles riesgos de seguridad |

|---|---|---|

Operaciones de datos | 1. Datos crudos 2. Preparación de datos 3. Conjuntos de datos 4. Catálogo y gobernanza | 20 riesgos específicos, como:

|

Operaciones de modelos | 5. Algoritmo de ML 6. Evaluación 7. Creación del modelo 8. Gestión de modelos | 15 riesgos específicos, como:

|

Implementación y servicio de modelos | 9. Servicio de modelos: solicitudes de inferencia 10. Servicio de modelos: respuestas de inferencia | 19 riesgos específicos, como:

|

Operaciones y plataforma | 11. Operaciones de ML 12. Plataforma de ML | 8 riesgos específicos, como:

|

¿Qué controles hay disponibles para mitigar los riesgos de seguridad de la IA?

Existen 64 controles prescriptivos para mitigar los 62 riesgos de seguridad de la IA identificados. Estos controles incluyen:

- Mejores prácticas de ciberseguridad, como el inicio de sesión único, las técnicas de cifrado, los controles de bibliotecas y código fuente y los controles de acceso a la red con un enfoque de defensa en profundidad para gestionar los riesgos

- Controles específicos de la gobernanza de datos y de la IA, como la clasificación de datos, el linaje de datos, el control de versiones de datos, el seguimiento de modelos, los permisos de activos de datos y modelos, y la gobernanza de modelos

- Controles específicos para la IA, como el aislamiento del servicio de modelos, herramientas de prompts, auditoría y supervisión de modelos, MLOps y LLMOps, gestión centralizada de LLM, ajuste fino y preentrenamiento de sus modelos

Si le interesa obtener una descripción detallada de los riesgos de seguridad asociados a los sistemas de IA y qué controles se deben implementar para cada riesgo, lo invitamos a descargar nuestro Databricks AI Security Whitepaper.

Mejores prácticas para proteger los modelos de IA y ML

Los equipos de datos y seguridad deben colaborar activamente para alcanzar su objetivo de mejorar la seguridad de los sistemas de IA. Ya sea que esté implementando soluciones tradicionales de machine learning o aplicaciones basadas en LLM, Databricks recomienda seguir los pasos que se indican a continuación, tal como se describe en el Databricks AI Security Whitepaper.

PREGUNTAS FRECUENTES

Recursos de seguridad de la IA

Databricks AI Security Framework (DASF) 2.0

El equipo de Seguridad de Databricks creó el Databricks AI Security Framework (DASF) para abordar las vulnerabilidades en evolución en los sistemas de IA con un enfoque holístico para mitigar los riesgos más allá de la seguridad del modelo.

Taller sobre riesgos de la IA de Databricks

El equipo de Seguridad de Databricks organiza talleres sobre riesgos de la IA para ayudar a los líderes a comprender los sistemas de IA, sus riesgos y las estrategias de mitigación.

Capacitación en fundamentos de seguridad de la IA

Este curso explora los fundamentos de la seguridad en los sistemas de IA dentro de la Databricks Data Intelligence Platform en cinco módulos completos.

Eventos y webinars sobre la seguridad de la IA

Los líderes de seguridad de Databricks comparten regularmente sus conocimientos en eventos con líderes del sector, empresas, agencias y proveedores.