Databricks Lakehouse y Data Mesh, Parte 1

por Sharon Richardson, Bernhard Walter, Pawarit Laosunthara, Guillermo Schiava D'Albano, Fran Medina Castro y Amr Ali

Este es el primer blog de una serie de dos partes. En esta publicación, presentaremos el concepto de data mesh y las capacidades de Databricks disponibles para implementar un data mesh. El segundo blog examinará diferentes opciones de data mesh y proporcionará detalles sobre la implementación de un data mesh basado en el Databricks Lakehouse.

Data mesh es un paradigma que describe un conjunto de principios y arquitectura lógica para escalar plataformas de análisis de datos. El propósito es obtener más valor de los datos como activo a escala. La frase 'data mesh' fue introducida por Zhamak Dehghani en 2019 y ampliada en su artículo de 2020 Data Mesh Principles and Logical Architecture.

En el núcleo de la arquitectura lógica de data mesh se encuentran cuatro principios:

- Propiedad del dominio: adoptar una arquitectura distribuida donde los equipos de dominio, los productores de datos, conservan la responsabilidad total de sus datos a lo largo de su ciclo de vida, desde la captura hasta la curación, el análisis y la reutilización.

- Datos como producto: aplicar principios de gestión de productos al ciclo de vida del análisis de datos, asegurando que se proporcionen datos de calidad a los consumidores de datos que pueden estar dentro y fuera del dominio del productor.

- Plataforma de infraestructura de autoservicio: adoptar un enfoque independiente del dominio para el ciclo de vida del análisis de datos, utilizando herramientas y métodos comunes para construir, ejecutar y mantener productos de datos interoperables.

- Gobernanza federada: garantizar un ecosistema de datos que cumpla con las reglas organizacionales y las regulaciones de la industria a través de la estandarización.

Los productos de datos son un concepto importante para el data mesh. No están destinados a ser solo conjuntos de datos, sino datos tratados como un producto: deben ser detectables, confiables, autodescriptivos, direccionables e interoperables. Además de datos y metadatos, pueden contener código, paneles, características, modelos y otros recursos necesarios para crear y mantener el producto de datos.

Muchos clientes preguntan: '¿Podemos crear un data mesh con Databricks Lakehouse?' ¡La respuesta es sí! Varios de los clientes más grandes de Databricks en todo el mundo han adoptado data mesh utilizando Lakehouse como base tecnológica.

Databricks Lakehouse es una plataforma nativa en la nube de datos, análisis e IA que combina el rendimiento y las características de un data warehouse con el bajo costo, la flexibilidad y la escalabilidad de un data lake moderno. Para una introducción, por favor lea ¿Qué es un Lakehouse?

El lakehouse aborda una preocupación fundamental con los data lakes que condujo a los principios de un data mesh: que un data lake monolítico puede convertirse en un pantano de datos inmanejable. Databricks Lakehouse es una arquitectura abierta que ofrece flexibilidad en cómo se organizan y estructuran los datos, al tiempo que proporciona una infraestructura de gestión unificada para todas las cargas de trabajo de datos y análisis.

La unidad principal de organización dentro de la plataforma Databricks Lakehouse que se mapea al concepto de dominios en un data mesh es el 'workspace'. Un Databricks Lakehouse puede tener uno o más workspaces, y cada workspace permite la propiedad de datos local y el control de acceso.

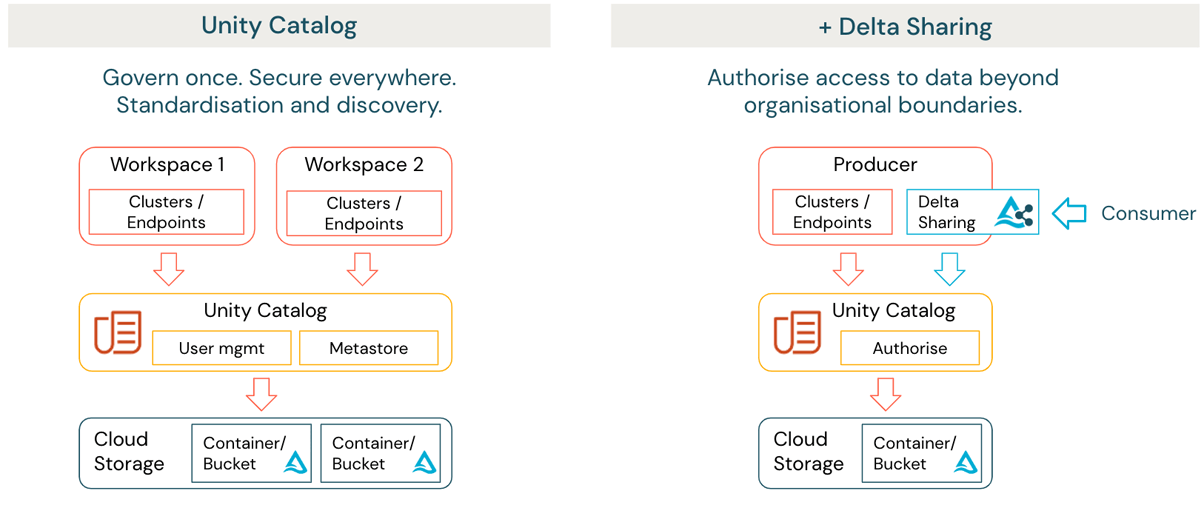

Cada workspace encapsula uno o más dominios, sirve como hogar para la colaboración y permite que el/los dominio/s administren sus productos de datos utilizando una infraestructura común de autoservicio independiente del dominio. Esto puede incluir automatización en el aprovisionamiento del entorno y orquestación de pipelines de datos utilizando servicios integrados como Databricks Workflows, y automatización de despliegue utilizando el proveedor de Terraform de Databricks. Unity Catalog proporciona gobernanza federada, descubrimiento y linaje como un servicio centralizado a nivel de cuenta de la organización que ejecuta Databricks. (figura 1 lado izquierdo).

Para muchas organizaciones, existe la necesidad de considerar cómo se pueden compartir los datos de forma segura con partes externas más allá de un límite de gobernanza. Esto también puede aplicarse a dominios internos alojados en diferentes proveedores de nube y regiones. Databricks Lakehouse proporciona una solución en forma de Delta Sharing (figura 1 lado derecho). Delta Sharing permite a las organizaciones compartir datos de forma segura con partes externas independientemente de la plataforma informática. Los datos no necesitan duplicarse y el acceso se audita y registra automáticamente.

Delta Sharing también proporciona la base para una gama más amplia de actividades de intercambio de datos externos. Esto incluye la publicación o adquisición de datos a través de un mercado de datos como el Databricks Marketplace, y la colaboración segura en datos a través de límites organizacionales y técnicos, habilitada dentro de la plataforma Databricks como Databricks Cleanrooms.

La combinación de Unity Catalog y Delta Sharing significa que la plataforma Databricks Lakehouse ofrece flexibilidad en cómo una organización elige organizar y administrar datos y análisis a escala, incluyendo despliegues que abarcan múltiples proveedores de nube, diferentes regiones geográficas y despliegues que requieren la capacidad de compartir activos de datos con entidades externas. Con Databricks Lakehouse, los datos se pueden organizar en un data mesh, pero también se pueden organizar utilizando cualquier arquitectura apropiada, desde completamente centralizada hasta completamente distribuida.

La segunda parte de esta publicación de blog examinará diferentes opciones de data mesh y proporcionará detalles sobre cómo implementar un data mesh basado en Databricks Lakehouse.

Para obtener más información sobre las capacidades de Databricks Lakehouse mencionadas en esta publicación:

- ¿Qué es un Lakehouse?

- ¿Qué es Databricks Lakehouse?

- Presentamos Databricks Unity Catalog

- Presentamos Databricks Delta Sharing

- Presentamos Databricks Cleanrooms

- Presentamos Databricks Marketplace

- Proveedor de Terraform de Databricks

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.