Cómo las principales empresas de tecnología están eliminando el impuesto del constructor con Lakebase

Las aplicaciones nativas de IA necesitan que los datos operativos y los análisis convivan; aquí le mostramos cómo los equipos están eliminando la barrera.

por Amey Banarse y Madelyn Mullen

- Reducir las capas de movimiento de datos: Las organizaciones líderes utilizan Databricks Lakebase, eliminando ETL y reverse ETL al unificar datos operativos y analíticos en una única plataforma gobernada.

- Habilitar inteligencia en tiempo real: Las aplicaciones y los sistemas de IA operan directamente sobre datos frescos y de baja latencia sin retrasos de sincronización.

- Poner en producción sistemas de IA: Una arquitectura unificada reduce la sobrecarga operativa y permite bucles de aprendizaje continuo a escala.

El costo oculto que frena la hoja de ruta de tus aplicaciones de IA

En las principales organizaciones tecnológicas que desarrollan aplicaciones nativas de IA, la principal limitación ha pasado de la capacidad del modelo a la arquitectura de datos subyacente, y específicamente, a las canalizaciones de datos. Los requisitos de los sistemas de IA para acceder a contexto en tiempo real y con estado para agentes, y el bajo costo marginal para un desarrollo rápido y experimental, han expuesto el defecto crítico en las arquitecturas de datos tradicionales y separadas.

Las cargas de trabajo operativas suelen ejecutarse en bases de datos transaccionales en la nube (por ejemplo, motores Postgres/MySQL administrados), mientras que la analítica, las canalizaciones de ML y la ingeniería de características residen en el lakehouse. La sincronización entre estas capas depende de una compleja red de canalizaciones de CDC, tareas ETL/ELT y frameworks de ETL inverso. Esto da como resultado ineficiencias sistémicas:

- Datos desactualizados: Los sistemas de IA operan con instantáneas rezagadas en lugar del estado en tiempo real

- Fragmentación arquitectónica: La gobernanza, el linaje y el control de acceso se duplican en varios sistemas

- Sobrecarga operativa: El esfuerzo de ingeniería se traslada del desarrollo de productos a la orquestación de canalizaciones y la gestión de fallos

Llamamos a esto el impuesto del desarrollador: una ineficiencia estructural que surge de pilas de datos operativas y analíticas desacopladas. Para las personas dentro de las empresas tecnológicas que crean las plataformas, los productos SaaS y las herramientas para desarrolladores en las que todos los demás se basan, este impuesto es especialmente perjudicial. Cada nueva función de IA genera otra base de datos, otra canalización, otro trimestre de retraso.

Cambio arquitectónico: co-localización de aplicaciones y datos

Para romper este patrón, las principales empresas tecnológicas están rediseñando la arquitectura, yendo más allá de la adopción de una simple herramienta especializada más. Las vemos ejecutando aplicaciones e IA directamente sobre la misma base gobernada que su analítica.

Esa base es Lakebase: un motor Postgres sin servidor totalmente administrado e integrado de forma nativa en la Plataforma Databricks.

- Las aplicaciones leen y escriben directamente en los datos administrados por el lakehouse

- La gobernanza se centraliza a través de Unity Catalog en todas las cargas de trabajo

- Datos operativos fiables con instantáneas automatizadas y recuperación de fallos integrada

Esto establece una Base de Aplicaciones Interoperable: una capa única y gobernada donde las aplicaciones, la IA y la analítica comparten el mismo almacén operativo.

Escenario del mundo real

Amey Banarse presentó “De Transacciones a Agentes: PostgreSQL en Aplicaciones de IA Modernas” en PostgresConf 2026 [Diapositivas]. Amey cubre un recorrido en vivo de una aplicación de reclamaciones de tecnología de la salud construida completamente sobre Lakebase + el AI DevKit, mostrando cómo la inteligencia del lakehouse, las perspectivas operativas y un bucle de aprendizaje continuo se ejecutan en una única base Databricks.

Las organizaciones suelen entrar en esta arquitectura a través de tres vectores principales:

- Eliminación de canalizaciones de ETL inverso: Los conjuntos de datos analíticos (tablas de capa gold) se sincronizan directamente en Lakebase a través de la integración nativa. Esto elimina la dependencia de herramientas externas y reduce la fragilidad de las canalizaciones.

- Aplicaciones nativas de IA y herramientas internas: Ejecuta Databricks Apps + Lakebase como una única pila sin servidor con servicio de modelos, almacén de características y analítica. Sin infraestructura adicional que aprovisionar.

- Memoria y estado de agentes: Lakebase con pgvector para búsqueda semántica se convierte en la capa de memoria operativa para agentes construidos con Agent Bricks, junto con los datos sobre los que razonan.

Lo que las empresas tecnológicas están viendo en realidad

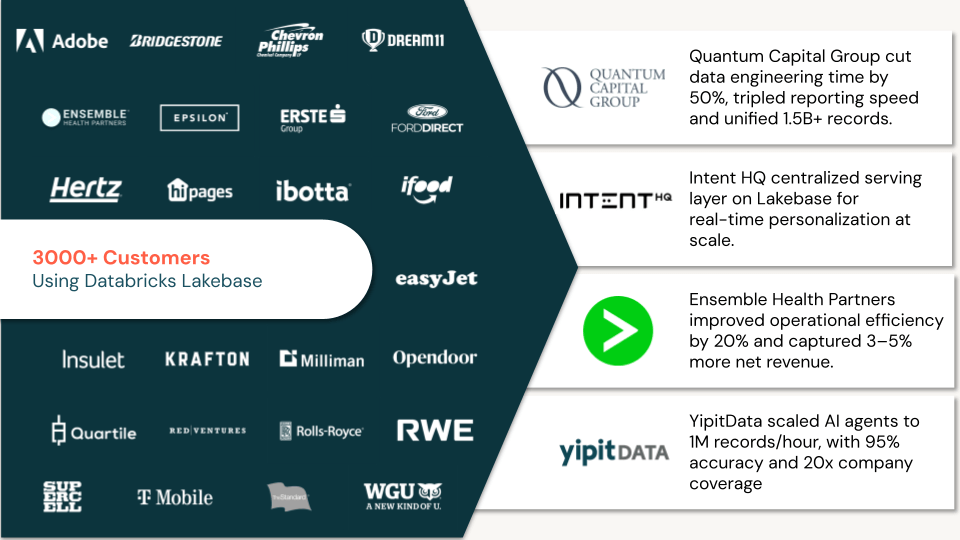

Los resultados a continuación provienen de empresas tecnológicas que han migrado a una arquitectura Lakebase:

YipitData escaló su canalización de agentes de IA para procesar 1 millón de registros por hora, logrando una precisión de etiquetado del 92-95% y una cobertura de empresa del 20x. Al usar Lakebase como el sistema relacional de registro dentro de Unity Catalog, sus agentes operan con un estado duradero y gobernado — sin almacenes externos frágiles, sin retrasos de sincronización.

Quantum Capital Group gestionaba más de 1.5 mil millones de registros en seis fuentes de datos fragmentadas. Después de consolidarse en Lakebase, eliminaron más de 100 tablas redundantes, redujeron el tiempo de ingeniería de datos en un 50% y triplicaron la velocidad de generación de informes — los equipos ahora trabajan desde un único conjunto de datos confiable en lugar de luchar contra la proliferación de versiones.

Ensemble Health Partners unificó más de 15 sistemas fragmentados de SQL Server. Con Lakebase como la capa transaccional, implementaron flujos de trabajo de ciclo de ingresos impulsados por IA que mejoraron la eficiencia operativa en un 20% y ayudaron a los clientes a capturar entre un 3% y un 5% más de ingresos netos año tras año.

Replit, cuya plataforma potencia a millones de desarrolladores que crean y despliegan software, utiliza Lakebase + el Databricks AI DevKit para ayudar a los clientes a lanzar IA de generación de código en producción en 3 semanas con una velocidad de desarrollo 10 veces mayor, eliminando la brecha entre los sistemas operativos y analíticos desde el primer día.

IntentHQ, una plataforma de inteligencia de consumo, centralizó su capa de servicio en Lakebase para potenciar la personalización en tiempo real a escala — brindando a los modelos de IA un almacén operativo de baja latencia que se mantiene sincronizado con sus datos del lakehouse sin canalizaciones personalizadas.

El patrón arquitectónico detrás de los resultados

A pesar de los diferentes casos de uso — desde agentes de IA y motores de personalización hasta flujos de trabajo de atención médica y plataformas de desarrolladores — estas organizaciones no están teniendo éxito a través de optimizaciones aisladas. Están convergiendo en un modelo arquitectónico fundamentalmente diferente.

En su núcleo, este modelo arquitectónico elimina la separación tradicional entre sistemas transaccionales, plataformas analíticas y canalizaciones de IA, reemplazándola con una base de datos compartida e interoperable.

Este patrón incluye consistentemente tres capas estrechamente integradas:

Capa de inteligencia del lakehouse

Una base gobernada y escalable donde operan datos por lotes y en streaming, ingeniería de características y cargas de trabajo de IA/ML. Esta capa proporciona el sistema de información, permitiendo el procesamiento a gran escala, el entrenamiento de modelos y la analítica sobre datos unificados.

Capa de datos operativos

Una interfaz transaccional de baja latencia (Lakebase) que sirve como el sistema de ejecución para aplicaciones y agentes. Esta capa permite lecturas/escrituras en tiempo real, gestión de estado y lógica de aplicaciones directamente sobre datos gobernados — sin sobrecarga de replicación o sincronización.

Bucle de aprendizaje continuo

Un sistema de retroalimentación cerrado donde las interacciones de la aplicación, las salidas de los agentes y las señales del usuario se capturan y reintegran en las canalizaciones del modelo. Esto establece un sistema de mejora continua, permitiendo que las capacidades de IA evolucionen basándose en el uso en el mundo real.

Cuando estas tres capas comparten una base, los sistemas de IA pasan de ser cargas de trabajo aisladas a sistemas de producción en continua mejora.

Eliminando el impuesto del desarrollador

El impuesto del desarrollador no es inevitable. Es una consecuencia de construir IA sobre una infraestructura diseñada para una era diferente — cuando las bases de datos eran monolíticas, las aplicaciones sin estado y la inteligencia era un proyecto separado.

¡Lakebase cambia las reglas del juego! Las aplicaciones se ejecutan donde residen los datos. Los agentes tienen el contexto que necesitan. Y el tiempo de ingeniería que tu equipo dedicaba a las canalizaciones vuelve a la fase de desarrollo.

Mira la sesión de Amey Banarse en PostgresConf 2026, “De Transacciones a Agentes: PostgreSQL en Aplicaciones Modernas de IA” [Diapositivas] para ver una aplicación completa nativa de IA construida sobre Lakebase en acción.

Databricks Lakebase es un Postgres sin servidor diseñado para agentes y aplicaciones. Obtén más información en databricks.com/product/lakebase.

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.