Optimización predictiva a escala: un año de innovación y lo que sigue

Consultas más rápidas, menores costos de almacenamiento y automatización completa en las tablas administradas de Unity Catalog

por Jeffrey Gong y Kelly Albano

- La optimización predictiva ahora se ejecuta por defecto para las nuevas tablas administradas de Unity Catalog y funciona a gran escala

- Las nuevas capacidades en 2025 ofrecieron consultas más rápidas, un mantenimiento del almacenamiento más económico y capacidades mejoradas

- En 2026, la optimización predictiva se expande a la automatización del ciclo de vida de los datos y a una observabilidad más profunda

Introducción

El lakehouse más rentable y de mayor rendimiento es aquel que se optimiza a sí mismo a medida que los volúmenes de datos, los patrones de consulta y el uso de la organización continúan evolucionando. La Optimización Predictiva (PO) en Unity Catalog habilita este comportamiento al analizar continuamente cómo se escriben y consultan los datos, para luego aplicar las acciones de mantenimiento adecuadas automáticamente sin requerir trabajo manual de los usuarios o equipos de la plataforma. En 2025, la Optimización Predictiva pasó de ser una función de automatización opcional al comportamiento predeterminado de la plataforma, gestionando el rendimiento y la eficiencia del almacenamiento en millones de tablas de producción y eliminando la carga operativa tradicionalmente asociada con el ajuste de tablas. A continuación, se presentan los hitos que nos trajeron hasta aquí y lo que viene para 2026.

Adopción a escala en todo el lakehouse

A lo largo de 2025, la Optimización Predictiva tuvo una rápida adopción en toda la plataforma Databricks, ya que los clientes confiaron cada vez más en el mantenimiento autónomo para gestionar un patrimonio de datos en crecimiento. La Optimización Predictiva ha crecido rápidamente este último año:

- Se limpiaron exabytes de datos sin referencia, lo que resultó en un ahorro de decenas de millones de dólares en costos de almacenamiento

- Se compactaron y agruparon cientos de petabytes de datos para mejorar el rendimiento de las consultas y la eficiencia de la poda de archivos

- Millones de tablas adoptaron el Agrupamiento Líquido Automático para la gestión autónoma del diseño de datos

A partir de las mejoras de rendimiento constantes observadas a esta escala, la Optimización predictiva ahora está habilitada de forma predeterminada para todas las nuevas tablas administradas, áreas de trabajo y cuentas de Unity Catalog.

Cómo funciona la optimización predictiva

La optimización predictiva (PO) funciona como la capa de inteligencia de la plataforma para el lakehouse, ya que optimiza continuamente el diseño de sus datos, reduce el espacio de almacenamiento y mantiene las estadísticas de archivos precisas necesarias para una planificación de consultas eficiente en tablas gestionadas por UC.

Basándose en los patrones de uso observados, la PO determina automáticamente cuándo y cómo ejecutar comandos como los siguientes:

- OPTIMIZE, que compacta archivos pequeños y mejora la localidad de los datos para un acceso eficiente

- VACUUM, que elimina los archivos sin referencia para controlar los costos de almacenamiento

- CLUSTER BY, que selecciona las columnas de agrupamiento óptimas para las tablas con agrupamiento líquido automático

- ANALYZE, que mantiene estadísticas precisas para la planificación de consultas y la omisión de datos

Todas las decisiones de optimización son adaptativas y se basan en la carga de trabajo, lo que elimina la necesidad de administrar programaciones, ajustar parámetros o revisar las estrategias de optimización a medida que cambian los patrones de consulta.

Avances clave en la optimización predictiva en 2025

Estadísticas automáticas para consultas un 22 % más rápidas

Las estadísticas precisas son fundamentales para crear planes de consulta eficientes; sin embargo, administrar las estadísticas manualmente se vuelve cada vez más impracticable a medida que el volumen de datos y la diversidad de consultas aumentan.

Con Estadísticas automáticas (ahora disponibles de forma general), la Optimización predictiva determina qué columnas son importantes basándose en el comportamiento de consulta observado y garantiza que las estadísticas se mantengan actualizadas sin comandos ANALYZE manuales.

Las estadísticas se mantienen mediante dos mecanismos complementarios:

- Estadísticas en escritura captura estadísticas a medida que se escriben los datos con una sobrecarga mínima, un método que es de 7 a 10 veces más eficiente que ejecutar ANALYZE TABLE

- La actualización en segundo plano actualiza las estadísticas cuando se vuelven obsoletas debido a cambios en los datos o a patrones de consulta en evolución.

En las cargas de trabajo de producción de clientes reales, este enfoque proporcionó consultas hasta un 22 % más rápidas y eliminó el costo operativo de la administración manual de estadísticas.

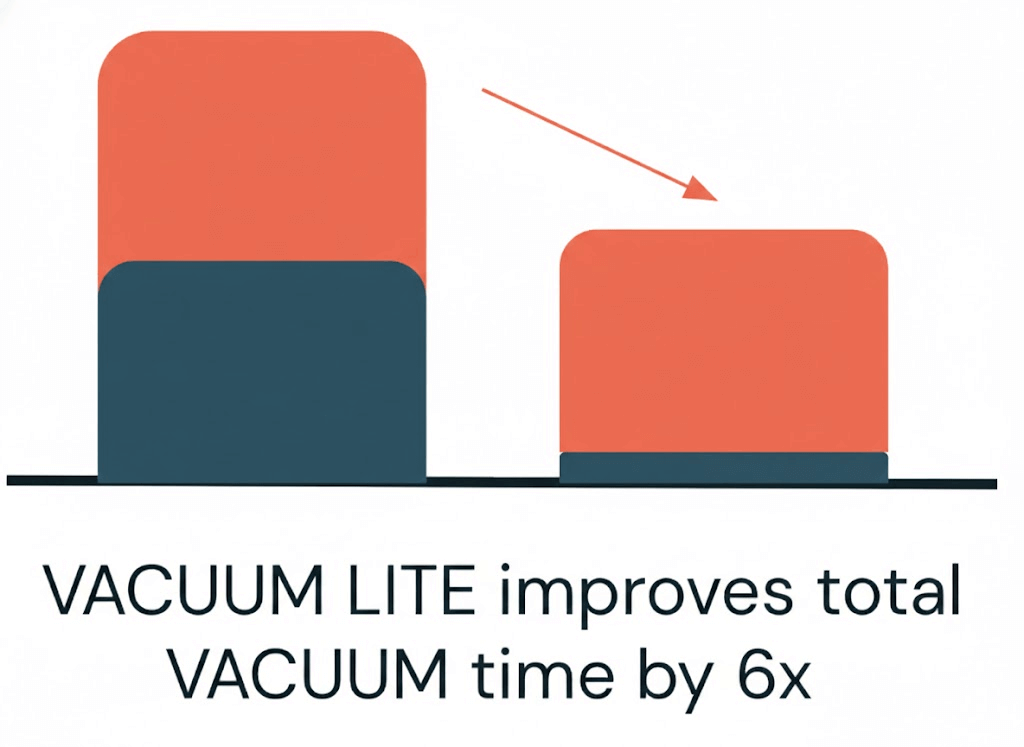

VACUUMs 6 veces más rápidos y 4 veces más económicos

VACUUM desempeña un papel fundamental en la administración de los costos de almacenamiento y el cumplimiento mediante la eliminación de archivos de datos sin referencia. El proceso VACUUM estándar requiere que se listen todos los archivos en el directorio de una tabla para identificar los candidatos para su eliminación, una operación que puede tardar más de 40 minutos para tablas con 10 millones de archivos.

La optimización predictiva ahora aplica una ruta de ejecución de VACUUM optimizada que aprovecha el registro de transacciones de Delta para identificar los archivos que se pueden eliminar directamente, lo que evita los costosos listados de directorios siempre que sea posible.

A escala, esto dio como resultado lo siguiente:

- Ejecución de VACUUM hasta 6 veces más rápida

- Costo de computación hasta 4 veces menor en comparación con los enfoques estándar

El motor determina dinámicamente cuándo usar este enfoque basado en registros y cuándo realizar un examen completo del directorio para limpiar fragmentos de transacciones anuladas.

Agrupamiento líquido automático

El agrupamiento líquido automático alcanzó la disponibilidad general en 2025 y ya está optimizando millones de tablas en producción.

El proceso está totalmente impulsado por la carga de trabajo:

- Primero, la PO analiza la telemetría de todas las consultas en su tabla, observando métricas clave como columnas de predicado, expresiones de filtro y el número y tamaño de los archivos leídos y descartados.

- A continuación, realiza el modelado de la carga de trabajo, identificando y probando varias combinaciones de claves de agrupamiento candidatas (p. ej., agrupadas por fecha, o customer_id, o ambos).

- Finalmente, la PO ejecuta un análisis de costo-beneficio para seleccionar la mejor estrategia de clustering que maximizará la poda de consultas y reducirá los datos escaneados, e incluso determinará si el orden de inserción existente de la tabla ya es suficiente.

Obtienes consultas más rápidas sin necesidad de ajustes manuales. Al analizar automáticamente las cargas de trabajo y aplicar el diseño de datos óptimo, la PO elimina la compleja tarea de seleccionar la clave de agrupamiento y garantiza que sus tablas sigan siendo de alto rendimiento a medida que evolucionan sus patrones de consulta.

Cobertura en toda la plataforma

Predictive Optimization se ha expandido más allá de las tablas tradicionales para admitir un conjunto más amplio de la plataforma de Databricks.

- Ahora, PO se integra de forma nativa con Lakeflow Spark Declarative Pipelines (SDP), lo que aporta un mantenimiento autónomo en segundo plano tanto a las Materialized Views como a las Streaming Tables.

- PO funciona tanto en tablas administradas de Delta como de Iceberg

- La PO está habilitada de forma predeterminada para todas las nuevas tablas, áreas de trabajo y cuentas gestionadas por Unity Catalog.

Esto garantiza un mantenimiento autónomo en todo su patrimonio de datos, en lugar de la optimización aislada de tablas individuales.

¿Qué sigue en 2026?

Nos comprometemos a ofrecer funciones que sustituyan el ajuste manual de las tablas por un mantenimiento automatizado. Paralelamente, planeamos ir más allá de la salud de la tabla física para abordar la inteligencia total del ciclo de vida de los datos: ahorro automatizado de costos de almacenamiento, gestión del ciclo de vida de los datos y eliminación de filas. También estamos priorizando la observabilidad mejorada, integrando los insights de la optimización predictiva en las operaciones comunes de las tablas y en el Governance Hub para proporcionar una visibilidad más clara de las operaciones de PO y su ROI.

Auto-TTL (eliminación automática de filas)

Administrar la retención de datos o controlar los costos de almacenamiento es una tarea fundamental, pero que a menudo es manual. Nos complace presentar Auto-TTL, una nueva capacidad de Predictive Optimization que automatiza por completo la eliminación de filas. Con esta característica, podrá establecer una política sencilla de tiempo de vida (time-to-live) directamente en cualquier tabla administrada de UC mediante un comando como:

Una vez que se establece la política, la Optimización Predictiva se encarga del resto. Automatiza todo el proceso de dos pasos: primero, ejecuta una operación DELETE para hacer una eliminación temporal de las filas vencidas y, luego, realiza una operación VACUUM para eliminarlas permanentemente del almacenamiento físico.

¡Comuníquese hoy con su equipo de cuenta para probar esto en la Vista Previa Privada!

Observabilidad mejorada

Observabilidad de Predictive Optimization mejorada

Podrá hacer un seguimiento del impacto directo y del ROI de la optimización predictiva en el nuevo Centro de Gobernanza de Datos. Este panel de observabilidad incluirá de forma nativa una vista centralizada de las operaciones de PO y mostrará métricas clave que cuantifican su valor.

Utilice esto para ver exactamente lo que PO está haciendo internamente, con visualizaciones claras de los bytes compactados, los bytes agrupados en clústeres por Liquid, los bytes aspirados y los bytes analizados. Lo que es más importante, el hub traduce estas acciones en valor empresarial directo al mostrar sus ahorros estimados en costos de almacenamiento. Esto hará que sea más fácil que nunca comprender y comunicar el impacto positivo que PO está teniendo tanto en sus costos de almacenamiento como en el rendimiento de las consultas.

En DESCRIBED EXTENDED, también podrás ver las razones por las que Predictive Optimization omitió la optimización (p. ej., tabla ya bien agrupada, tabla demasiado pequeña para beneficiarse de la compactación, etc.).

Además, hemos agregado la capacidad de ver las selecciones de columnas para el salto de datos y Auto Liquid en la tabla de sistema de la PO.

¡Comuníquese hoy con su equipo de cuenta para probar el Centro de Gobernanza de Datos en la Vista Previa Privada!

Observabilidad de almacenamiento mejorada a nivel de tabla

Para proporcionar mayor claridad sobre tu huella de almacenamiento, introduciremos funciones de observabilidad mejoradas para Predictive Optimization. Podrá supervisar el estado y la evolución de sus tablas a través de métricas de alto nivel, como el recuento de archivos y el crecimiento del almacenamiento. Al presentar esta información directamente, facilitamos la visualización del impacto del mantenimiento automatizado y la identificación de nuevas oportunidades para reducir costos y optimizar tu patrimonio de datos.

Comience a usar Predictive Optimization

Predictive Optimization está disponible hoy para las tablas administradas de Unity Catalog y está habilitado de forma predeterminada para las nuevas cargas de trabajo.

Cuando está habilitado, los clientes se benefician automáticamente de una ejecución de VACUUM más rápida, estadísticas automáticas que reconocen la carga de trabajo y un diseño de datos autónomo a través de la agrupación automática en clústeres de Liquid.

También puede explorar la observabilidad de Auto TTL y la optimización predictiva (Centro de Gobernanza de Datos) a través de la versión preliminar privada contactando al equipo de su cuenta.

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.