¿Qué es el Protocolo de Contexto Modelo (MCP)?

Permitir que los modelos de IA accedan de forma segura a fuentes de datos y herramientas externas a través de un marco de integración estandarizado

- Comprenda qué es el Protocolo de Contexto de Modelo (MCP) y cómo proporciona una interfaz unificada para conectar modelos de IA con recursos externos.

- Aprenda cómo MCP permite a los agentes interactuar de forma segura con bases de datos, API, sistemas de archivos y herramientas empresariales.

- Descubra cómo los protocolos estandarizados mejoran la confiabilidad, la seguridad y la interoperabilidad de los agentes en diferentes sistemas y plataformas.

Introducción: Comprensión del Protocolo de Contexto de Modelo

El Protocolo de Contexto de Modelo (MCP) es un estándar abierto que permite a las aplicaciones de IA conectarse sin inconvenientes con fuentes de datos, herramientas y sistemas externos. Piensa en el Protocolo de Contexto de Modelo como un puerto USB-C para los sistemas de IA: así como un puerto USB-C estandariza la forma en que los dispositivos se conectan a las computadoras, el MCP estandariza la forma en que los agentes de IA acceden a recursos externos como bases de datos, API, sistemas de archivos y bases de conocimiento.

El protocolo de contexto aborda un desafío crítico en la creación de agentes de IA: el "problema de integración N×M". Sin un protocolo estandarizado, cada aplicación de IA debe integrarse directamente con cada servicio externo, lo que crea N×M integraciones separadas, donde N representa el número de herramientas y M, el número de clientes. Este enfoque se vuelve rápidamente imposible de escalar. El protocolo de contexto de modelo (MCP) resuelve esto al requerir que cada cliente y cada servidor MCP implementen el protocolo una sola vez, lo que reduce las integraciones totales de N×M a N+M.

Al permitir que los sistemas de IA accedan a datos en tiempo real más allá de los datos de entrenamiento de su LLM, el MCP ayuda a los modelos de IA a proporcionar respuestas precisas y actualizadas en lugar de depender únicamente de los datos de entrenamiento estáticos de su fase de aprendizaje inicial.

¿Qué es un protocolo de contexto de un modelo?

El Model Context Protocol es un estándar unificado de código abierto para la interoperabilidad que permite a los desarrolladores crear aplicaciones de IA contextuales. El MCP complementa LLMOps al exponer la integración en tiempo de ejecución, la observabilidad y los controles de gobernanza que simplifican la implementación, el monitoreo y la gestión del ciclo de vida de las aplicaciones de LLM.

Las aplicaciones de IA necesitan acceso a activos como recursos locales, bases de datos, canalizaciones de datos (streaming/batch), motores de búsqueda, calculadoras y flujos de trabajo para el condicionamiento de prompts y la fundamentación de la generación. El protocolo de contexto estandariza cómo las aplicaciones se conectan a esos activos a través de una forma estructurada que reduce el código de integración repetitivo.

El problema de la escalabilidad significa que los modelos de IA (en particular, los modelos de lenguaje grandes) normalmente deben depender de datos preexistentes y estáticos para el entrenamiento. Esto puede generar respuestas imprecisas o desactualizadas porque los modelos entrenados con conjuntos de datos estáticos necesitan actualizaciones adicionales para incorporar información nueva. Al abordar la escalabilidad, MCP permite que las aplicaciones de IA sean conscientes del contexto y proporcionen resultados actualizados que no estén restringidos por las limitaciones de los datos de entrenamiento estáticos.

¿Qué es el MCP y por qué se utiliza?

El protocolo de contexto del modelo (MCP) sirve como una forma estandarizada para que las aplicaciones de IA descubran e interactúen con herramientas y fuentes de datos externas en tiempo de ejecución. En lugar de codificar de forma rígida las conexiones a cada servicio externo, los agentes de IA que usan MCP pueden descubrir dinámicamente las herramientas disponibles, comprender sus capacidades a través de llamadas estructuradas e invocarlas con los permisos de herramienta adecuados.

El MCP se utiliza porque transforma la manera en que las herramientas impulsadas por IA acceden a la información. Los sistemas de IA tradicionales están limitados por sus datos de entrenamiento, que se desactualizan rápidamente. El protocolo de contexto permite a los desarrolladores crear agentes de IA que pueden realizar tareas utilizando datos en vivo de sistemas empresariales populares, entornos de desarrollo y otras fuentes externas, todo a través de un único protocolo estandarizado.

El protocolo abierto también reduce el código de integración repetitivo. En lugar de escribir conectores personalizados para cada nueva integración, los desarrolladores implementan el MCP una sola vez tanto en el lado del cliente como en el del servidor. Este enfoque es particularmente valioso para los sistemas de IA agénticos que necesitan descubrir y usar de forma autónoma múltiples herramientas en diferentes contextos.

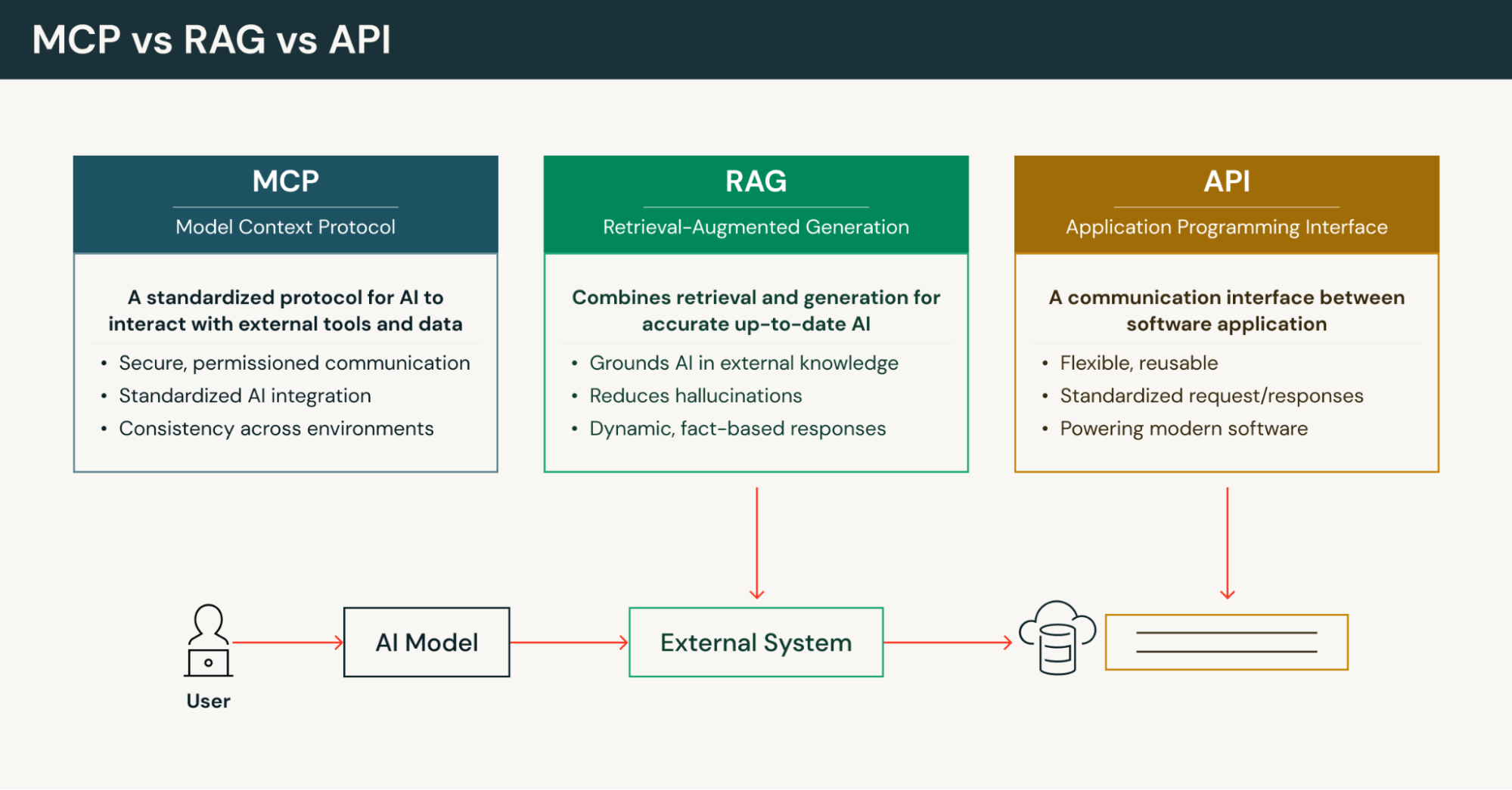

¿Qué es MCP vs. API?

Limitaciones de las API tradicionales

Las API tradicionales exponen endpoints con parámetros tipados que los clientes deben codificar de forma rígida y actualizar cada vez que una API cambia. El ensamblaje de contexto se convierte en la responsabilidad del cliente porque las API proporcionan una guía semántica mínima sobre cómo se deben usar los datos devueltos. Una solicitud de API generalmente sigue un patrón simple de solicitud-respuesta sin mantener el estado o el contexto entre llamadas.

En qué se diferencia el Protocolo de Contexto de Modelo

MCP define un enfoque diferente de las API tradicionales. En lugar de endpoints codificados, los servidores MCP exponen una superficie de capacidad legible por máquina que se puede detectar en tiempo de ejecución. Los sistemas de IA pueden consultar las herramientas, los recursos y los prompts disponibles en lugar de depender de conexiones predefinidas. El Protocolo de Contexto de Modelo estandariza las formas de los recursos —documentos, filas de bases de datos, archivos—, lo que reduce la complejidad de la serialización para que los modelos de IA reciban un contexto relevante optimizado para el razonamiento.

Las implementaciones del MCP soportan la comunicación bidireccional y con estado con semántica de streaming. Esto permite que los servidores del MCP envíen actualizaciones y notificaciones de progreso directamente al bucle de contexto de un agente de IA, lo que permite flujos de trabajo de varios pasos y resultados parciales que las API tradicionales no pueden proporcionar de forma nativa. Esta arquitectura cliente-servidor permite patrones de uso de herramientas más sofisticados en sistemas agénticos.

MCP frente a RAG: Enfoques complementarios

La generación aumentada por recuperación (RAG) mejora la precisión de la IA al convertir documentos en embeddings, almacenarlos en bases de datos vectoriales y recuperar información relevante durante la generación. Sin embargo, RAG generalmente se basa en fuentes estáticas e indexadas de repositorios de contenido. El Model Context Protocol proporciona acceso bajo demanda a API en vivo, bases de datos y flujos de datos, devolviendo un contexto autorizado y actualizado cuando la actualidad de los datos es importante.

A diferencia de RAG, que principalmente devuelve contexto de solo lectura, el protocolo de contexto separa los recursos de las herramientas para que los agentes de IA puedan tanto obtener datos como realizar tareas en sistemas externos con esquemas controlados. MCP aborda necesidades de integración más amplias, como la habilitación de flujos de trabajo agénticos, la orquestación de múltiples turnos, el descubrimiento de capacidades en tiempo de ejecución y la gobernanza multiinquilino, que RAG no proporciona de forma nativa.

El MCP puede complementar las implementaciones de RAG. Las organizaciones pueden usar RAG para indexar contenido perenne para una recuperación rápida, mientras utilizan el Protocolo de contexto del modelo para búsquedas transaccionales, ejecución de consultas SQL y acciones que requieren el contexto adecuado de los sistemas en vivo. Este enfoque híbrido proporciona tanto velocidad como precisión.

El valor de la estandarización en el ecosistema MCP

Como un protocolo bidireccional y detectable en tiempo de ejecución, el Protocolo de Contexto de Modelo convierte las herramientas y los datos externos dispares en recursos direccionables y acciones invocables. Un único cliente MCP puede descubrir de manera uniforme archivos, filas de bases de datos, fragmentos de vectores, transmisiones en vivo y endpoints de API. Al coexistir con cachés de RAG indexados, el MCP ofrece búsquedas autorizadas y justo a tiempo, y semántica de acciones.

El resultado práctico es menos conectores a medida, menos código personalizado, integraciones más rápidas y sistemas agénticos más confiables con un manejo de errores adecuado y registros de auditoría. Esta forma estandarizada de conectar los asistentes de IA a los recursos remotos acelera los ciclos de desarrollo mientras se mantienen los controles de seguridad empresariales. El ecosistema de MCP se beneficia de esta estandarización a medida que más implementaciones de servidores de MCP están disponibles para los sistemas empresariales populares.

Arquitectura central de MCP: Comprensión del modelo cliente-servidor

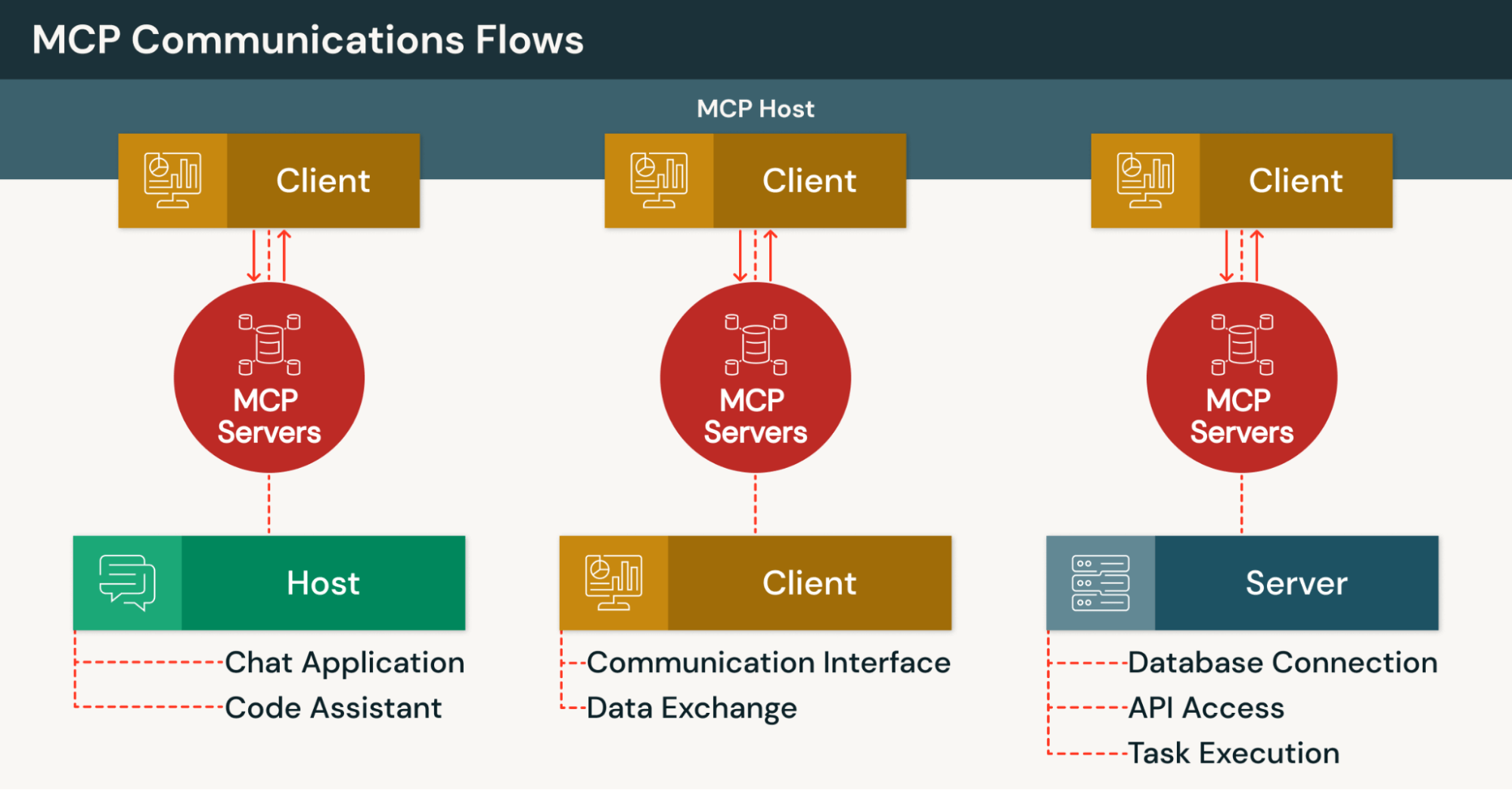

La arquitectura de MCP organiza las integraciones en torno a tres roles clave —servidores MCP, clientes MCP y hosts MCP— conectados a través de canales de comunicación persistentes. Esta arquitectura cliente-servidor permite que las herramientas de IA ejecuten flujos de trabajo de varios pasos y con estado, en lugar de interacciones aisladas de solicitud-respuesta.

¿Qué hacen los servidores MCP?

Los servidores de MCP exponen datos y herramientas a través de interfaces estandarizadas y pueden ejecutarse en entornos de nube, locales o híbridos. Cada servidor publica una superficie de capacidades de recursos con nombre, herramientas invocables, prompts y hooks de notificación. Los recursos pueden incluir documentos, filas de bases de datos, archivos y salidas de canalización.

Las implementaciones de servidor de MCP utilizan métodos y notificaciones JSON-RPC 2.0, admiten la transmisión para operaciones de larga duración y proporcionan un descubrimiento legible por máquina a través de la capa de transporte. Esto permite que los hosts de MCP y los modelos de IA consulten las capacidades en tiempo de ejecución sin requerir un conocimiento predefinido de las herramientas disponibles.

Las implementaciones populares de servidores MCP conectan los sistemas de IA con servicios externos como Google Drive, Slack, GitHub y bases de datos PostgreSQL. Estos servidores de MCP gestionan la autenticación, la recuperación de datos y la ejecución de herramientas, a la vez que presentan una interfaz consistente a través del protocolo estandarizado. Cada servidor del ecosistema MCP puede dar servicio a múltiples clientes simultáneamente.

Cómo funcionan los clientes MCP

Los clientes de MCP son componentes dentro de las aplicaciones host que traducen las intenciones del usuario o del modelo en mensajes de protocolo. Cada cliente suele mantener una conexión uno a uno con un servidor de MCP y gestiona el ciclo de vida, la autenticación y los detalles de transporte de forma estructurada.

Los clientes del MCP serializan las solicitudes como llamadas estructuradas usando JSON-RPC, manejan notificaciones asíncronas y flujos de datos parciales, y presentan una API local unificada para reducir la complejidad de la integración. Varios clientes pueden operar desde el mismo host del MCP, y cada uno puede conectarse a diferentes servidores del MCP simultáneamente.

Estos clientes permiten que los agentes de IA interactúen con fuentes de datos externas sin comprender los detalles de implementación de cada servicio externo. El cliente gestiona todos los protocolos de comunicación, el manejo de errores y la lógica de reintento de forma automática.

El rol de los hosts de MCP

Los hosts MCP proporcionan la capa de aplicación de IA que coordina las capacidades de los clientes y servidores MCP. Algunos ejemplos son Claude Desktop, Claude Code, los IDE con tecnología de IA y otras plataformas donde operan los agentes de IA. El host MCP agrega los prompts, el estado de la conversación y las respuestas del cliente para organizar flujos de trabajo de múltiples herramientas.

El host de MCP decide cuándo llamar a las herramientas, solicitar entradas adicionales o mostrar notificaciones. Esta orquestación centralizada permite que los modelos de IA funcionen en servidores de MCP heterogéneos sin código a medida para cada servicio, lo que respalda el objetivo del ecosistema de MCP de interoperabilidad universal para conectar los asistentes de IA a sistemas diversos.

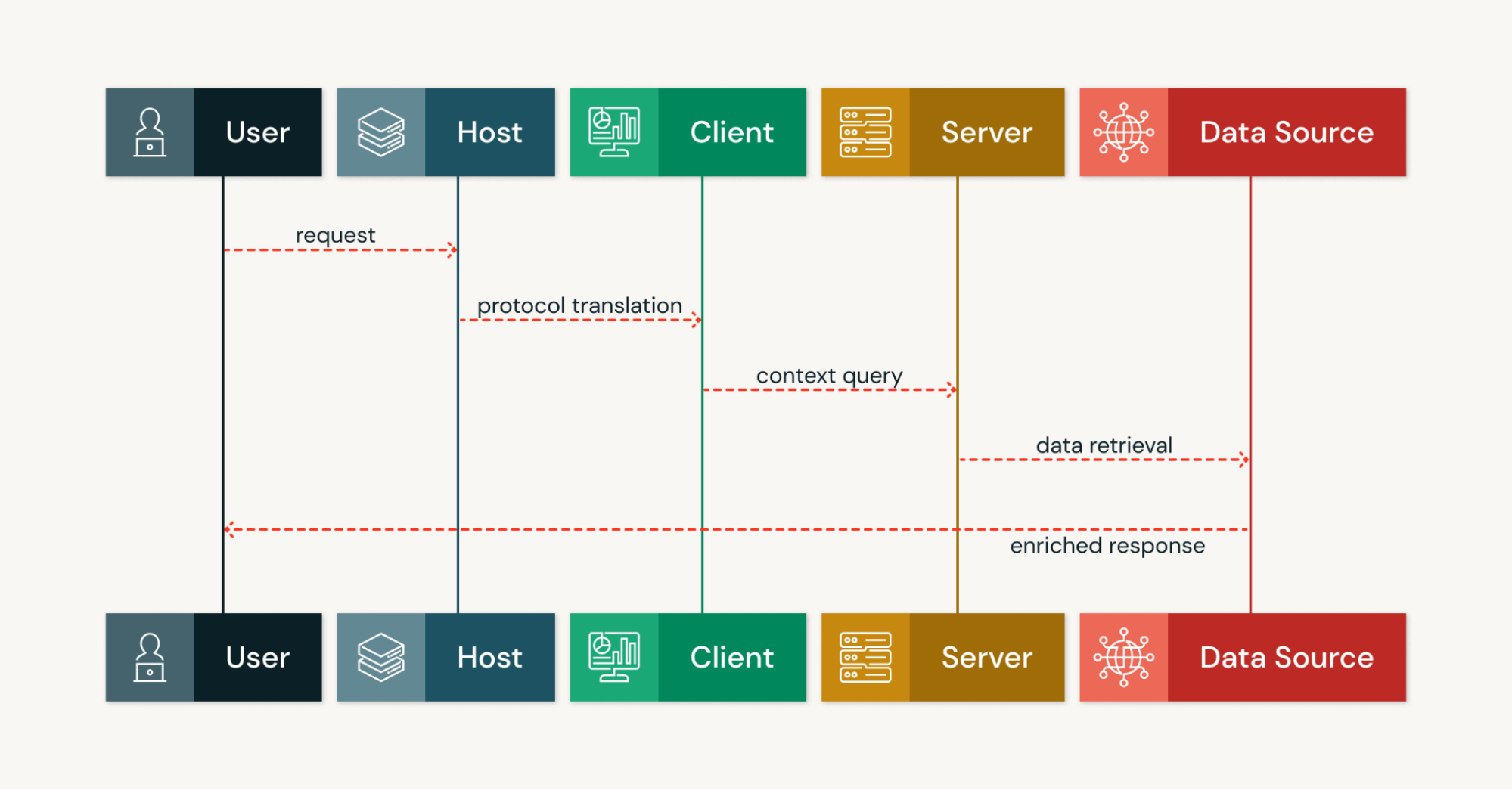

Flujo de contexto y comunicación bidireccional

La comunicación cliente-servidor en el Protocolo de Contexto de Modelo es bidireccional y está basada en mensajes mediante JSON-RPC 2.0 sobre la capa de transporte. Los clientes de MCP llaman a métodos para obtener recursos o invocar herramientas, mientras que los servidores de MCP devuelven resultados, transmiten resultados parciales y envían notificaciones con información relevante.

Los servidores de MCP también pueden iniciar solicitudes, pidiendo a los hosts de MCP que muestreen opciones o soliciten la entrada del usuario a través de mecanismos de llamada de función. Esta capacidad bidireccional diferencia al protocolo de contexto de los patrones de API unidireccionales tradicionales. Las búsquedas autoritativas en tiempo real del MCP complementan el RAG al proporcionar registros justo a tiempo con metadatos de procedencia para la trazabilidad.

Los transportes persistentes conservan el orden de los mensajes y habilitan actualizaciones en tiempo real, lo que permite que los sistemas de IA iteren sobre resultados intermedios y ejecuten bucles agenciales que hacen posibles a los agentes de IA autónomos.

¿Cuáles son los requisitos para el Protocolo de Contexto de Modelo?

Requisitos de seguridad y protección contra amenazas

Las implementaciones de MCP deben aplicar la seguridad de la capa de transporte (TLS) para los transportes remotos, permisos de herramientas estrictos y credenciales de alcance limitado para protegerse contra amenazas de seguridad. El protocolo requiere limitación de velocidad y una validación de entrada robusta mediante la aplicación de JSON Schema tanto en los clientes como en los servidores de MCP para evitar ataques de inyección y solicitudes malformadas.

El registro de auditoría, la rotación de tokens y las concesiones de privilegios mínimos son requisitos esenciales para gobernar los canales de larga duración. Estas medidas de seguridad protegen contra el acceso no autorizado y, a la vez, preservan las capacidades de integración detectables que habilita el protocolo de contexto del modelo. Las organizaciones deben implementar el cifrado en tránsito y en reposo, el enmascaramiento y los permisos de alcance limitado para los canales de MCP de larga duración para garantizar la seguridad de los datos.

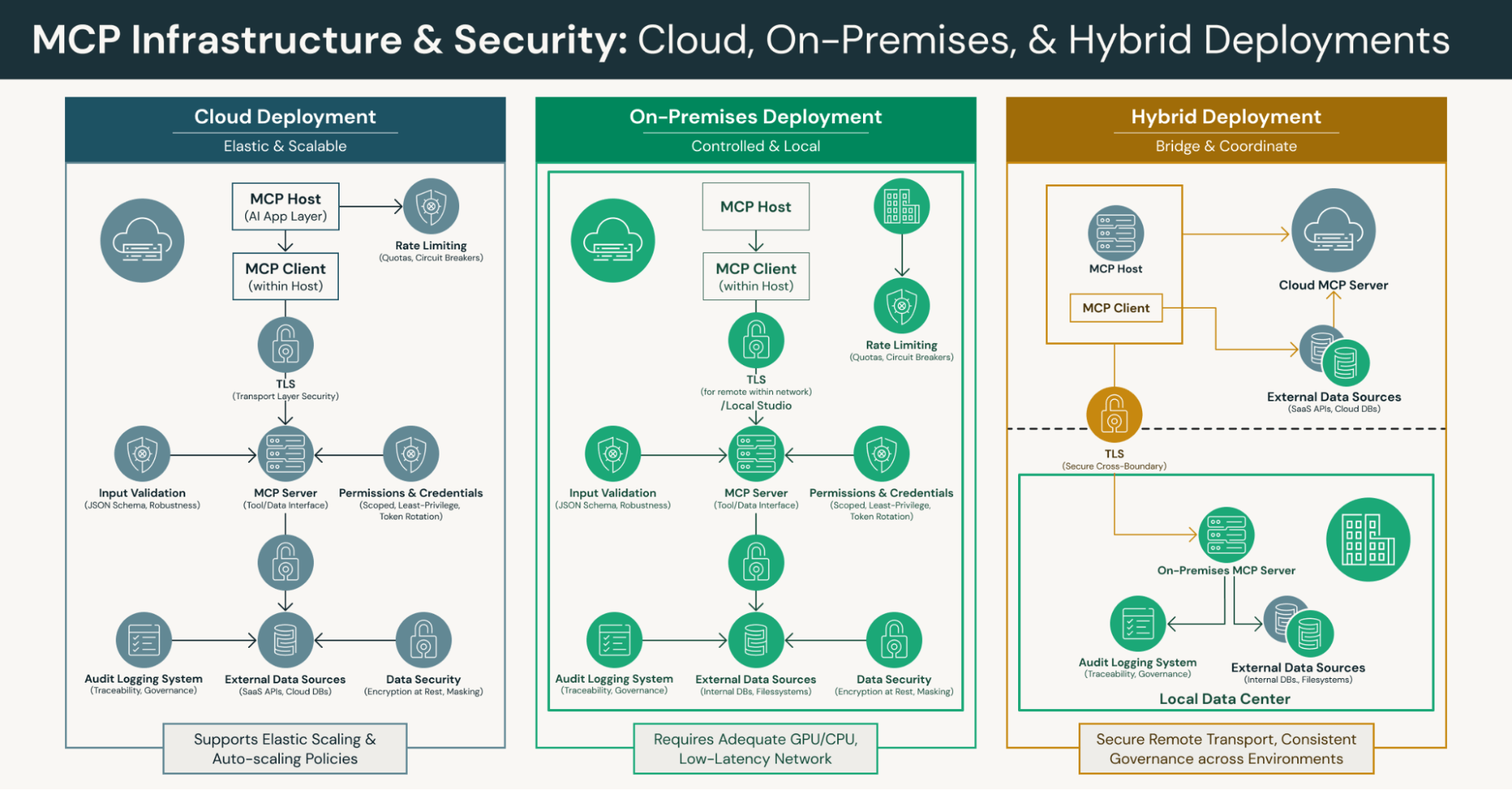

Requisitos de infraestructura y sistema

Las organizaciones que implementan MCP necesitan una infraestructura de computación y de redes que pueda alojar modelos de lenguaje grandes, servidores MCP y fuentes de datos conectadas. Esto incluye capacidad adecuada de GPU/CPU, memoria, E/S de disco y rutas de red de baja latencia entre los componentes de la arquitectura cliente-servidor.

Las plataformas en la nube deben admitir el escalamiento elástico de las instancias de modelos y los servidores MCP. Los equipos deben definir políticas de escalamiento automático para flujos simultáneos y operaciones de larga duración. La capa de transporte debería admitir tanto STDIO local para componentes integrados como canales de streaming remotos como HTTP/SSE o WebSocket para implementaciones distribuidas.

Requisitos de implementación para el trabajo con MCP

El trabajo con MCP requiere la implementación de mensajería JSON-RPC 2.0, endpoints de detección y esquemas de recursos/herramientas. Los servidores MCP deben publicar sus capacidades en un formato legible por máquina a través del protocolo estándar. Esto permite a los desarrolladores crear integraciones basadas en la detección que admiten la detección de herramientas sin conexiones codificadas.

El manejo de errores, las estrategias de reconexión y la gestión de la contrapresión son requisitos de implementación críticos para la confiabilidad en producción. Las organizaciones deben implementar la observabilidad para flujos persistentes, latencias de métodos y uso de recursos mediante métricas, seguimientos y registros. Los limitadores de velocidad, los interruptores de circuito y las cuotas protegen los sistemas posteriores de la sobrecarga.

Beneficios prácticos: acceso a datos en tiempo real y reducción de alucinaciones

Con el Protocolo de Contexto de Modelo, los modelos de IA recuperan registros en vivo, resultados de canalizaciones, respuestas de API y archivos on demand, en lugar de depender únicamente de las incorporaciones en caché o los datos de entrenamiento estáticos de los LLM. Esto fundamenta las respuestas en fuentes de datos actuales y autorizadas, y reduce las alucinaciones en las que los sistemas de IA generan información incorrecta.

Los recursos devueltos en el momento de la consulta incluyen metadatos de procedencia, como ID de origen y marcas de tiempo, lo que permite a los hosts de MCP registrar los orígenes y hacer que los resultados sean rastreables. Esta transparencia es crucial cuando los agentes de IA realizan tareas que requieren auditabilidad en industrias reguladas. El protocolo de contexto garantiza que el contexto relevante esté siempre disponible desde sistemas externos autorizados.

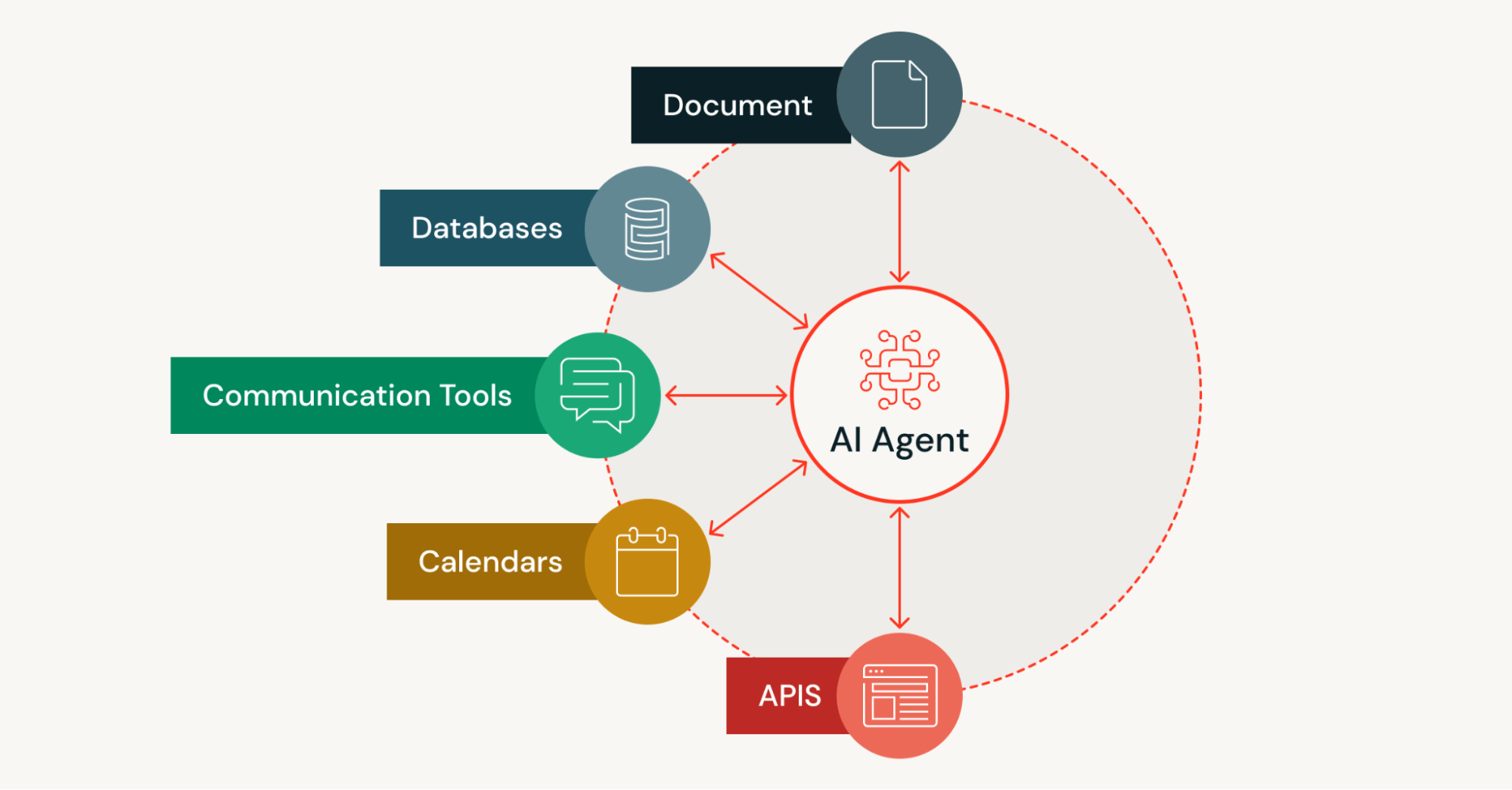

Soporte para flujos de trabajo de IA agenciales

Debido a que los servidores MCP publican recursos, herramientas y prompts de forma estandarizada, los modelos de IA pueden descubrir y llamar a servicios sin endpoints codificados de forma rígida. El estándar abierto admite la obtención de información iniciada por el servidor y las respuestas de streaming desde los servidores MCP, lo que permite el razonamiento en varios pasos, la aclaración de entradas y la iteración sobre resultados parciales.

Las herramientas exponen entradas y salidas definidas por JSON Schema con permisos de herramienta de alcance limitado, lo que permite a los agentes de IA realizar acciones controladas como crear tickets, ejecutar consultas SQL o ejecutar flujos de trabajo. Este descubrimiento autónomo de herramientas, la interacción bidireccional y las barreras de protección incorporadas proporcionan la base para una IA agéntica confiable en sistemas externos.

El protocolo de contexto de modelo (MCP) habilita explícitamente flujos de trabajo agénticos que se basan en el descubrimiento dinámico de herramientas y las primitivas de acción para percibir, decidir y actuar en todos los sistemas. Esto hace posible crear agentes de IA que operan de forma autónoma mientras se mantienen los controles de gobernanza adecuados.

La guía de IA agéntica para la empresa

Desarrollo simplificado con integraciones estandarizadas

El protocolo de contexto permite a los desarrolladores implementar una única superficie de servidor que los hosts de MCP y los modelos de IA pueden reutilizar con una semántica de descubrimiento y de llamada coherente. Esto elimina los conectores separados para los servicios comunes, lo que reduce el esfuerzo de ingeniería necesario para conectar los asistentes de IA a nuevas fuentes de datos.

Los recursos tipados y el JSON Schema reducen el código personalizado de serialización, validación y manejo de errores que, de otro modo, sería necesario. Los transportes de STDIO local o de transmisión remota permiten a los equipos elegir implementaciones locales, en la nube o híbridas sin cambiar la lógica del host MCP. Esta flexibilidad acelera la forma en que los equipos crean agentes de IA en diferentes entornos de desarrollo.

El MCP ofrece una forma práctica de estandarizar las integraciones una sola vez, en lugar de crear adaptadores personalizados para cada nueva integración. Este enfoque de protocolo estandarizado beneficia a todo el ecosistema del MCP a medida que más organizaciones adoptan el estándar.

Mayor potencial de automatización para flujos de trabajo complejos

Los canales persistentes y con estado del MCP permiten que los sistemas de IA combinen búsquedas, transformaciones y efectos secundarios en múltiples servicios externos en un solo bucle continuo. Para operaciones de larga duración, los servidores de MCP pueden transmitir resultados parciales para que los agentes de IA tomen decisiones intermedias, bifurquen flujos de trabajo o soliciten la intervención humana cuando sea necesario.

La combinación de la recuperación indexada para repositorios de contenido perenne con las búsquedas autorizadas bajo demanda del Model Context Protocol permite obtener respuestas rápidas y precisas. Este enfoque híbrido mantiene los controles de gobernanza y, a la vez, permite que las herramientas impulsadas por IA accedan tanto a bases de conocimiento estáticas como a fuentes de datos externas dinámicas.

El soporte del protocolo de contexto para la orquestación de múltiples turnos permite que los sistemas agénticos gestionen flujos de trabajo complejos que requieren coordinación entre múltiples herramientas y fuentes de datos. Este potencial de automatización transforma la manera en que las organizaciones implementan aplicaciones de IA en entornos de producción.

Mejores prácticas de implementación: preparación del sistema

Valida que tu infraestructura pueda admitir el hosting de LLM, los servidores MCP y las fuentes de datos conectadas. Asegúrate de tener recursos de GPU/CPU adecuados, asignación de memoria y ancho de banda de red para la arquitectura cliente-servidor. Elige plataformas en la nube que admitan el escalamiento elástico para usuarios simultáneos y define políticas de autoescalamiento.

Estandarizar los transportes seguros usando TLS para todas las conexiones remotas entre los clientes y servidores de MCP. Documentar la gestión del ciclo de vida de la conexión, incluidas las estrategias de reconexión y las métricas observables del estado del flujo. Implementar límites de velocidad, disyuntores y cuotas para proteger los sistemas externos descendentes de la sobrecarga.

Las organizaciones deben estandarizar los canales de transmisión (HTTP/SSE, WebSocket) más el STDIO local para los componentes integrados. Validar las cargas útiles y el esquema JSON tanto en el servidor como en el cliente para evitar ataques de inyección y garantizar un manejo de errores adecuado en todo el sistema.

Aprovechamiento de los recursos de código abierto en los lenguajes de programación

El ecosistema MCP incluye SDK de la comunidad en múltiples lenguajes de programación que aceleran el desarrollo de clientes y servidores. Estos SDK proporcionan patrones establecidos para la mensajería JSON-RPC, el streaming y la validación de esquemas, lo que elimina la necesidad de volver a implementar la infraestructura básica del protocolo.

Los desarrolladores pueden reutilizar las implementaciones de servidores MCP existentes para los sistemas empresariales más populares y ampliarlas a casos de uso específicos del dominio a través del estándar abierto. Crear simuladores que imiten notificaciones, flujos de larga duración y condiciones de error ayuda a los equipos a probar los sistemas agénticos antes de la implementación en producción.

Adopte los recursos de la comunidad para acelerar el trabajo con el MCP y evitar reconstruir la funcionalidad común. Estas herramientas de código abierto permiten que los desarrolladores se centren en la lógica de negocio en lugar de los detalles de implementación del protocolo.

Estrategia de integración para la implementación en producción

Comienza con casos de uso de alto impacto que demuestren un ROI medible, como asistentes de IA contextuales o flujos de trabajo automatizados con agentes de IA. Limitar los alcances iniciales de las herramientas y los permisos de las herramientas, recopilar telemetría y comentarios de los usuarios, y luego ampliar las capacidades después de estabilizar la funcionalidad principal.

Equilibra la latencia y la actualidad de los datos combinando las búsquedas en vivo de MCP con RAG para grandes corpus estáticos de repositorios de contenido. Define los SLA, los registros de auditoría y los procedimientos de escalamiento antes de un despliegue general en producción. Este enfoque por fases reduce el riesgo a la vez que genera confianza en la organización con respecto a las implementaciones agénticas de IA.

El MCP aborda la necesidad de planes de integración estructurados que escalen a medida que se agregan más servidores y clientes del MCP al ecosistema. Las organizaciones deben documentar su arquitectura de integración y sus políticas de gobernanza en una etapa temprana del proceso de implementación.

Conceptos erróneos comunes: MCP no es solo otro framework de API

Realidad: El protocolo de contexto del modelo estandariza la integración a nivel de protocolo con una gestión de contexto persistente y un descubrimiento de capacidades dinámico. A diferencia de las llamadas REST o RPC, el MCP define cómo los agentes de IA descubren capacidades, se suscriben a flujos y mantienen el estado contextual a través de las interacciones mediante el protocolo estándar.

Este protocolo estandarizado significa que puedes crear herramientas una vez y exponerlas de manera uniforme a múltiples agentes de IA y proveedores de modelos a través del ecosistema de MCP. En lugar de tratar el contexto del modelo como una carga útil efímera, el protocolo de contexto aborda el contexto como un recurso de primera clase y versionado con una gestión adecuada de su ciclo de vida.

Las herramientas y los agentes son componentes diferentes

Realidad: Las herramientas son capacidades discretas expuestas a través de servidores MCP, como acceso a bases de datos, operaciones de archivos o integraciones de API. Los agentes de IA son programas informáticos de toma de decisiones que descubren, orquestan e invocan las herramientas disponibles para realizar tareas de forma autónoma.

El protocolo de contexto permite a los agentes de IA descubrir metadatos de herramientas de forma dinámica, invocar interfaces de herramientas de forma segura con semántica de llamada a funciones e integrar los resultados en las conversaciones a través de los clientes MCP. Esta separación permite que diferentes sistemas agénticos utilicen el mismo catálogo de herramientas, mientras que los propietarios de las herramientas actualizan las interfaces independientemente de la lógica del agente.

MCP gestiona la conectividad integral de datos

Realidad: El protocolo de contexto de modelo gestiona una conectividad integral con fuentes de datos externas que va más allá del simple uso de herramientas. Admite notificaciones de streaming, acceso autenticado a repositorios de contenido y almacenes de vectores, y una semántica coherente para las operaciones de larga duración y el manejo de errores.

El MCP ofrece una forma práctica de unificar el acceso a recursos locales, recursos remotos, consultas de datos en vivo y acciones operativas de una manera estructurada. Este enfoque unificado ayuda a que la gobernanza, la observabilidad y el control de acceso escalen junto con las capacidades de IA en entornos empresariales. El protocolo de contexto maneja otras herramientas y servicios externos a través de una interfaz consistente.

Futuras líneas de investigación y evolución

A medida que el estándar abierto madure, las futuras líneas de investigación incluirán marcos de seguridad mejorados para implementaciones multiinquilino, una semántica de transmisión mejorada para flujos de trabajo agénticos complejos y patrones estandarizados para la integración con otros lenguajes de programación y entornos de desarrollo.

El creciente ecosistema de MCP sigue expandiéndose con nuevas implementaciones de servidor MCP para herramientas y plataformas externas emergentes. Las contribuciones de la comunidad a los SDK, los adaptadores y las arquitecturas de referencia aceleran la adopción, a la vez que mantienen el objetivo principal del protocolo: permitir que cualquier aplicación de IA se conecte con cualquier servicio externo de una manera estandarizada.

Las organizaciones que exploran el Protocolo de Contexto de Modelo (Model Context Protocol) deben supervisar los desarrollos del ecosistema, contribuir a las implementaciones de MCP y participar en grupos de trabajo que dan forma a cómo evoluciona la conexión de asistentes de IA con sistemas externos. Este enfoque colaborativo garantiza que las implementaciones de MCP sigan siendo interoperables a medida que los sistemas de IA y los servicios externos continúen avanzando. Las futuras líneas de investigación probablemente se centrarán en ampliar las capacidades del protocolo, manteniendo al mismo tiempo su simplicidad fundamental.

Conclusión: El Protocolo de Contexto del Modelo como fundamento para la IA moderna

El Protocolo de Contexto de Modelo representa un cambio fundamental en cómo las aplicaciones de IA acceden a fuentes de datos y herramientas externas. Al proporcionar un protocolo abierto para la integración basada en la detección, el protocolo de contexto permite a los desarrolladores crear agentes de IA conscientes del contexto que pueden realizar tareas utilizando datos en vivo de sistemas empresariales populares sin un extenso código de integración repetitivo.

El protocolo estandarizado reduce la complejidad a través de la arquitectura cliente-servidor, acelera los ciclos de desarrollo y permite que los sistemas de IA superen las limitaciones de los datos de entrenamiento estáticos de los LLM. A través de su comunicación bidireccional entre los clientes y los servidores de MCP, y el soporte para flujos de trabajo de IA agénticos, el Model Context Protocol (MCP) establece las bases para herramientas de IA más capaces y autónomas en diversos entornos.

A medida que el ecosistema de MCP crece con nuevas implementaciones e integraciones de servidores MCP, las organizaciones pueden crear agentes de IA sofisticados que descubren y orquestan múltiples servicios externos, mientras mantienen los permisos de herramientas, los controles de seguridad y los registros de auditoría adecuados. Este enfoque estandarizado para conectar los sistemas de IA con herramientas y fuentes de datos externas seguirá dando forma a cómo las empresas implementan las aplicaciones de IA en producción. El protocolo de contexto proporciona la infraestructura esencial que permite a los desarrolladores crear aplicaciones de IA de próxima generación con confianza.

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.