Anuncio del Marco de Seguridad de IA 2.0 de Databricks

Guía probada para mitigar el riesgo de modelos de IA a escala

- La segunda edición del Marco de Seguridad de IA de Databricks está diseñada para permitir implementaciones de IA seguras e impactantes.

- En DASF 2.0, hemos identificado 62 riesgos técnicos de seguridad y los hemos mapeado a controles recomendados.

- En respuesta a los comentarios de los usuarios, hemos publicado el documento compendio DASF, diseñado para ayudar a los usuarios a operacionalizar el DASF.

Nos complace anunciar la segunda edición del Marco de Seguridad de IA de Databricks (DASF 2.0—descárguelo ahora)! Las organizaciones que compiten por aprovechar el potencial de la IA necesitan tanto el 'acelerador' de la innovación como los 'frenos' de la gobernanza y la gestión de riesgos. El DASF cierra esta brecha, permitiendo implementaciones de IA seguras e impactantes para su organización al servir como una guía integral sobre la gestión de riesgos de IA.

Este blog proporcionará una descripción general del DASF, explorará las ideas clave obtenidas desde que se lanzó la versión original, presentará nuevos recursos para profundizar su comprensión de la seguridad de la IA y proporcionará actualizaciones sobre nuestros colaboradores de la industria.

¿Qué es el Marco de Seguridad de IA de Databricks y qué hay de nuevo en la versión 2.0?

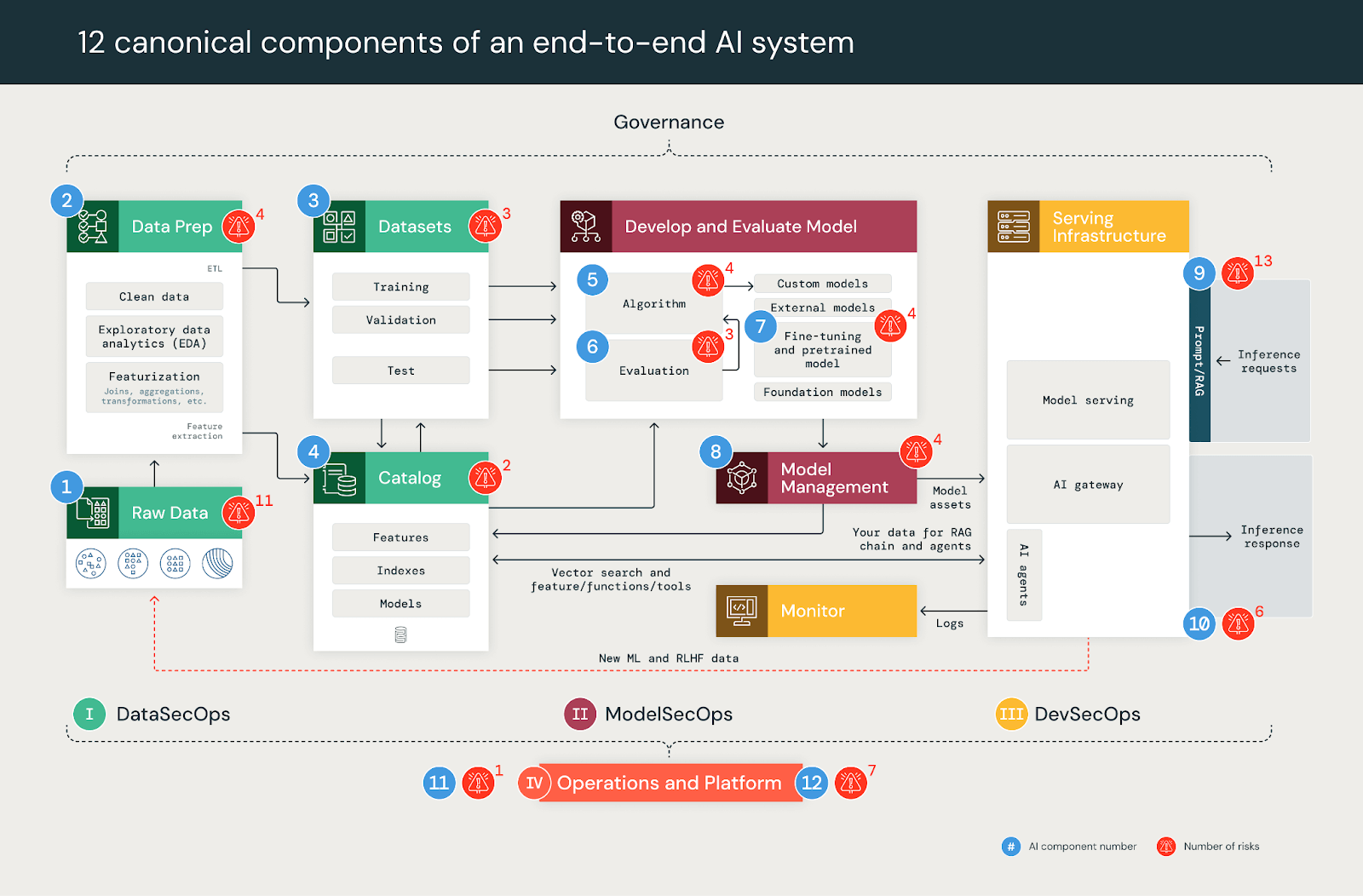

El DASF es un marco y un documento técnico para gestionar los riesgos de seguridad y gobernanza de la IA. Enumera los 12 componentes canónicos del sistema de IA, sus riesgos respectivos y controles accionables para mitigar cada riesgo. Creado por los equipos de Seguridad y ML de Databricks en colaboración con expertos de la industria, cierra la brecha entre los equipos de negocio, datos, gobernanza y seguridad con herramientas prácticas y estrategias accionables para desmitificar la IA, fomentar la colaboración y garantizar una implementación efectiva.

A diferencia de otros marcos, el DASF 2.0 se basa en estándares existentes para proporcionar un perfil de riesgo de extremo a extremo para las implementaciones de IA. Ofrece controles de defensa en profundidad para simplificar la gestión de riesgos de IA para que su organización la ponga en práctica y se puede aplicar a la plataforma de datos e IA que elija.

En el DASF 2.0, hemos identificado 62 riesgos técnicos de seguridad y los hemos mapeado a 64 controles recomendados para gestionar el riesgo de los modelos de IA. También hemos ampliado los mapeos a marcos y estándares líderes de la industria de riesgos de IA, incluyendo MITRE ATLAS, OWASP LLM y ML Top 10, NIST 800-53, NIST CSF, HITRUST, ENISA’s Securing ML Algorithms, ISO 42001, ISO 27001:2022, y la Ley de IA de la UE.

Poniendo en práctica el DASF: ¡echa un vistazo al nuevo compendio y al video instructivo complementario!

Hemos recibido comentarios valiosos al compartir el DASF en eventos de la industria, talleres y reuniones con clientes. Muchos de ustedes han solicitado más recursos para facilitar la navegación del DASF, su implementación y el mapeo efectivo de sus controles.

En respuesta, nos complace anunciar el lanzamiento del documento compendio del DASF (Hoja de Google, Excel). Este recurso está diseñado para ayudar a poner en práctica el DASF organizando y aplicando sus riesgos, amenazas, controles y mapeos a estándares reconocidos por la industria de organizaciones como MITRE, OWASP, NIST, ISO, HITRUST y más. También hemos creado un video instructivo complementario que proporciona un recorrido guiado por el DASF y su compendio.

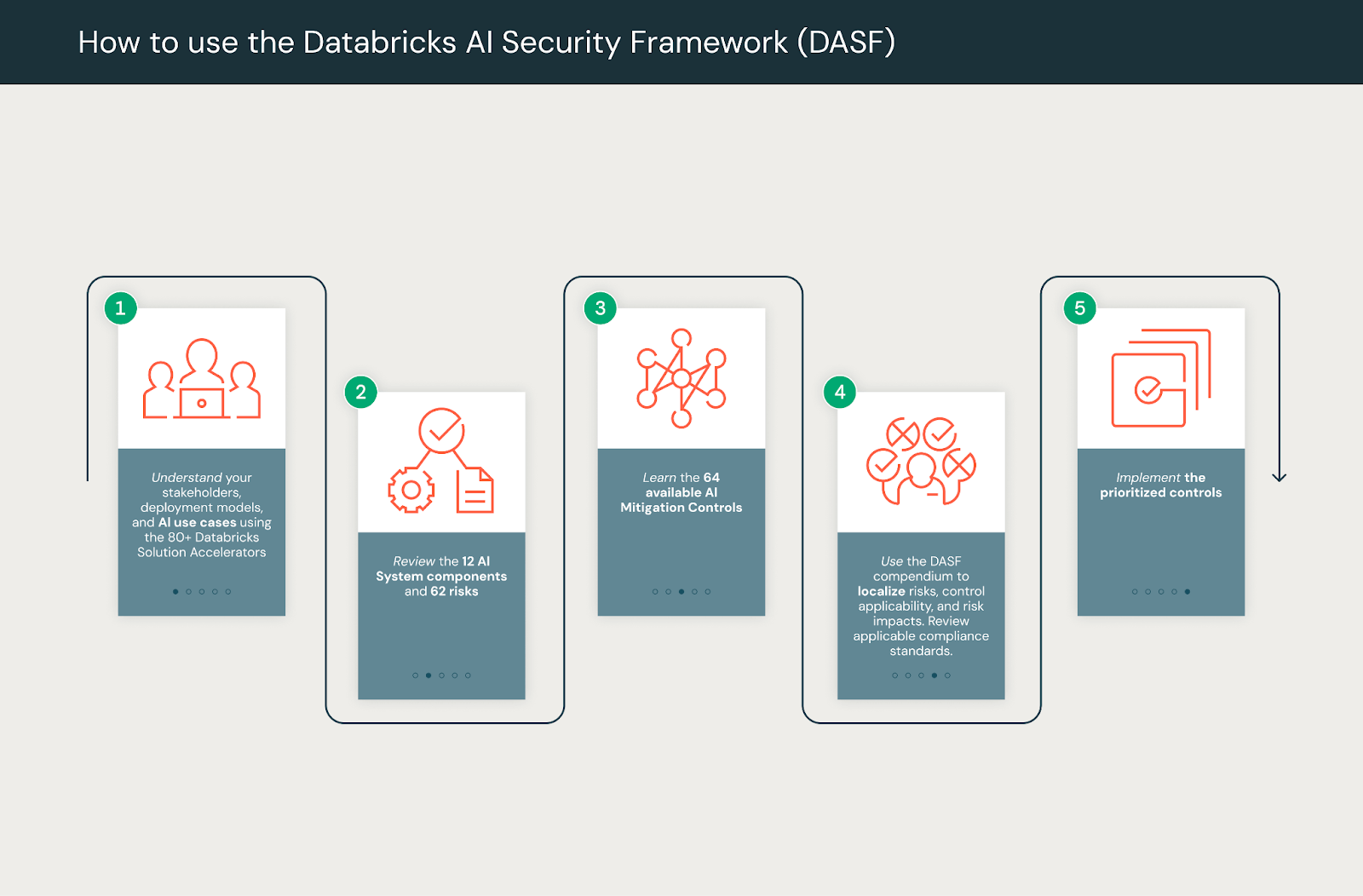

Nuestro objetivo con estas actualizaciones es facilitar la adopción del DASF, capacitando a las organizaciones para implementar sistemas de IA de manera segura y con confianza. Si está ansioso por comenzar, nuestro equipo recomienda el siguiente enfoque:

- Comprende a tus stakeholders, modelos de implementación y casos de uso de IA: Comienza con un caso de uso de negocio, aprovechando el whitepaper de DASF para identificar el modelo de implementación de IA que mejor se adapte. Elige entre más de 80 Databricks Solution Accelerators para guiar tu camino. Los modelos de implementación incluyen Modelos Predictivos de ML, APIs de Modelos Fundacionales, LLMs ajustados y pre-entrenados, RAG, Agentes de IA con LLMs y Modelos Externos. Asegura la claridad en el desarrollo de IA dentro de tu organización, incluyendo casos de uso, conjuntos de datos, necesidades de cumplimiento, procesos, aplicaciones y stakeholders responsables.

- Revisa los 12 componentes del sistema de IA y los 62 riesgos: Comprende los 12 componentes del sistema de IA, los riesgos de ciberseguridad tradicionales y los nuevos riesgos de seguridad de IA asociados a cada componente, y los stakeholders responsables (ej. ingenieros de datos, científicos, oficiales de gobernanza y equipos de seguridad). Usa el DASF para fomentar la colaboración entre estos grupos a lo largo del ciclo de vida de la IA.

- Revisa los 64 controles de mitigación disponibles: Cada riesgo se mapea a controles de mitigación priorizados, comenzando con la seguridad del perímetro y de los datos. Estos riesgos y controles se alinean además con 10 estándares de la industria, proporcionando detalle y claridad adicionales.

- Utiliza el compendio DASF para localizar riesgos, aplicabilidad de controles e impactos de riesgos: Comienza usando la pestaña “DASF Risk Applicability” para identificar riesgos relevantes para tu caso de uso seleccionando uno o más modelos de implementación de IA. Luego, revisa los impactos de riesgo asociados, los requisitos de cumplimiento y los controles de mitigación. Finalmente, documenta los detalles clave para tu caso de uso, incluyendo la descripción del caso de uso de IA, conjuntos de datos, stakeholders, consideraciones de cumplimiento y aplicaciones.

- Implementa los controles priorizados: Usa la pestaña “DASF Control Applicability” del compendio para revisar los controles DASF aplicables e implementar los controles de mitigación en tu plataforma de datos a través de los 12 componentes de IA. Si estás usando Databricks, incluimos enlaces con instrucciones detalladas sobre cómo implementar cada control en nuestra plataforma.

Implementa el DASF en tu organización con nuevos recursos de capacitación en IA de Databricks

Según un reciente estudio de Economist Impact, los líderes de datos e IA encuestados han identificado la capacitación y el fomento de una mentalidad de crecimiento como prioridades clave para impulsar la adopción de IA en 2025. Como parte del lanzamiento de DASF 2.0, tenemos recursos para ayudarte a comprender los conceptos de IA y ML y aplicar las mejores prácticas de seguridad de IA en tu organización.

- Capacitación en Databricks Academy: Recomendamos tomar el nuevo curso AI Security Fundamentals, que ya está disponible en Databricks Academy. Antes de sumergirte en el whitepaper, este curso de 1 hora es una excelente introducción a los temas de seguridad de IA destacados en el DASF. También recibirás una acreditación para tu perfil de LinkedIn al completarlo. Si eres nuevo en los conceptos de IA y ML, comienza con nuestro curso Generative AI Fundamentals.

- Videos de cómo hacerlo: Hemos grabado videos de descripción general y de cómo hacerlo del DASF para un consumo rápido. Puedes encontrar estos videos en nuestro canal de YouTube Security Best Practices.

- Taller presencial o virtual: Nuestro equipo ofrece un Taller de Riesgos de IA como una revisión en vivo de los conceptos descritos en el DASF, centrándose en superar los obstáculos para operacionalizar la gestión de riesgos de IA. Este evento de medio día está dirigido a líderes de nivel Director+ en funciones de gobernanza, datos, privacidad, legal, TI y seguridad.

- Soporte de implementación: La Herramienta de Análisis de Seguridad (SAT) monitorea el cumplimiento de las mejores prácticas de seguridad en los espacios de trabajo de Databricks de forma continua. Recientemente actualizamos la SAT para agilizar la configuración y mejorar las verificaciones, alineándolas con el DASF para una mejor cobertura de los riesgos de seguridad de IA.

- Asistente de IA DASF: Los clientes de Databricks pueden configurar el asistente de IA del Databricks AI Security Framework (DASF) directamente en su propio espacio de trabajo sin necesidad de habilidades previas en Databricks, interactuar con el contenido del DASF en lenguaje humano simple y obtener respuestas.

Construyendo una comunidad con grupos de la industria de IA, clientes y socios

Asegurar que el DASF evolucione al ritmo del entorno regulatorio actual de IA y del panorama de amenazas emergentes es una prioridad principal. Desde el lanzamiento de la versión 1.0, hemos formado un grupo de trabajo de IA con colegas de la industria, clientes y socios para mantenernos estrechamente alineados con estos desarrollos. Queremos agradecer a nuestros colegas del grupo de trabajo y a nuestros pre-revisores como Complyleft, The FAIR Institute, Ethriva Inc, Arhasi AI, Carnegie Mellon University y Rakesh Patil de JPMC. Puedes encontrar la lista completa de contribuyentes en la sección de agradecimientos del DASF. Si deseas participar en el Grupo de Trabajo de IA del DASF, por favor contacta a nuestro equipo en [email protected].

Esto es lo que dicen algunos de nuestros principales defensores:

"La IA está revolucionando la prestación de atención médica a través de innovaciones como el pipeline CLEVER GenAI, que procesa más de 1.5 millones de notas clínicas al día para clasificar determinantes sociales clave e impactar la atención a veteranos. Este pipeline está construido con una sólida base de seguridad, incorporando controles NIST 800-53 y aprovechando el Databricks AI Security Framework para garantizar el cumplimiento y mitigar riesgos. Mirando hacia el futuro, estamos explorando formas de expandir estas capacidades a través de la Infraestructura como Código y estrategias de contenerización seguras, permitiendo que los agentes se implementen y escalen dinámicamente desde repositorios mientras se mantienen rigurosos estándares de seguridad." - Joseph Raetano, Artificial Intelligence Lead, Summit Data Analytics & AI Platform, U.S. Department of Veteran Affairs

“DASF es la herramienta esencial para transformar la cuantificación de riesgos de IA en una realidad operativa. Con el enfoque FAIR-AI Risk ahora en su segundo año, DASF 2.0 permite a los CISO cerrar la brecha entre la ciberseguridad y la estrategia empresarial, hablando un lenguaje común basado en el impacto financiero medible.” - Jacqueline Lebo, Fundadora AI Workgroup, The FAIR Institute y Risk Advisory Manager, Safe Security

“A medida que la IA continúa transformando industrias, asegurar estos sistemas contra ataques de ciberseguridad sofisticados y únicos es más crítico que nunca. El Databricks AI Security Framework es un gran activo para que las empresas lideren tanto en innovación como en seguridad. Con el DASF, las empresas están equipadas para comprender mejor los riesgos de IA y encontrar las herramientas y recursos para mitigar esos riesgos a medida que continúan innovando.” - Ian Swanson, CEO, Protect AI

“Con el Databricks AI Security Framework, podemos mitigar los riesgos de IA de manera reflexiva y transparente, lo cual es invaluable para generar confianza en la junta directiva y entre los empleados. Es un cambio de juego que nos permite incorporar la IA en el negocio y estar entre el 15% de las organizaciones que llevan cargas de trabajo de IA a producción de manera segura y con confianza.” — Coastal Community Bank

"En el contexto de datos e IA, las conversaciones sobre seguridad son escasas. El Databricks AI Security Framework aborda el lado a menudo descuidado del trabajo de IA y ML, sirviendo como una guía de primer nivel no solo para comprender los riesgos de seguridad de la IA, sino también cómo mitigarlos." - Josue A. Bogran, Arquitecto en Kythera Labs y Asesor de SunnyData.ai

“Hemos utilizado el Databricks AI Security Framework para ayudar a mejorar la postura de seguridad de nuestra organización para gestionar los riesgos de seguridad de ML e IA. Con el Databricks AI Security Framework, ahora tenemos más confianza para explorar posibilidades con IA y análisis de datos, asegurando al mismo tiempo que contamos con la gobernanza de datos y las medidas de seguridad adecuadas.” - Muhammad Shami, Vicepresidente, Jackson National Life Insurance Company

¡Descargue hoy mismo el Databricks AI Security Framework 2.0!

El Databricks AI Security Framework 2.0 y su compendio (hoja de Google, Excel) ya están disponibles para descargar. Para obtener información sobre próximos talleres sobre riesgos de IA o para solicitar un taller presencial o virtual dedicado para su organización, contáctenos en [email protected] o a su equipo de cuentas. También tendremos contenido adicional de liderazgo de opinión próximamente para proporcionar más información sobre la gestión de la gobernanza de IA. Para obtener más información sobre cómo gestionar los riesgos de seguridad de la IA, visite el Centro de Seguridad y Confianza de IA de Databricks.

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.