Anuncio de la disponibilidad general de Databricks Lakeflow

El enfoque unificado de la ingeniería de datos en ingesta, transformación y orquestación

por Bilal Aslam y Michael Armbrust

- Databricks Lakeflow resuelve los desafíos de ingeniería de datos que plantea el uso de pilas fragmentadas, ofreciendo una solución unificada para la ingesta, transformación y orquestación en la plataforma de inteligencia de datos.

- Lakeflow Connect añade más conectores a bases de datos, fuentes de archivos, aplicaciones empresariales y almacenes de datos. Zerobus introduce escrituras directas de alto rendimiento con baja latencia.

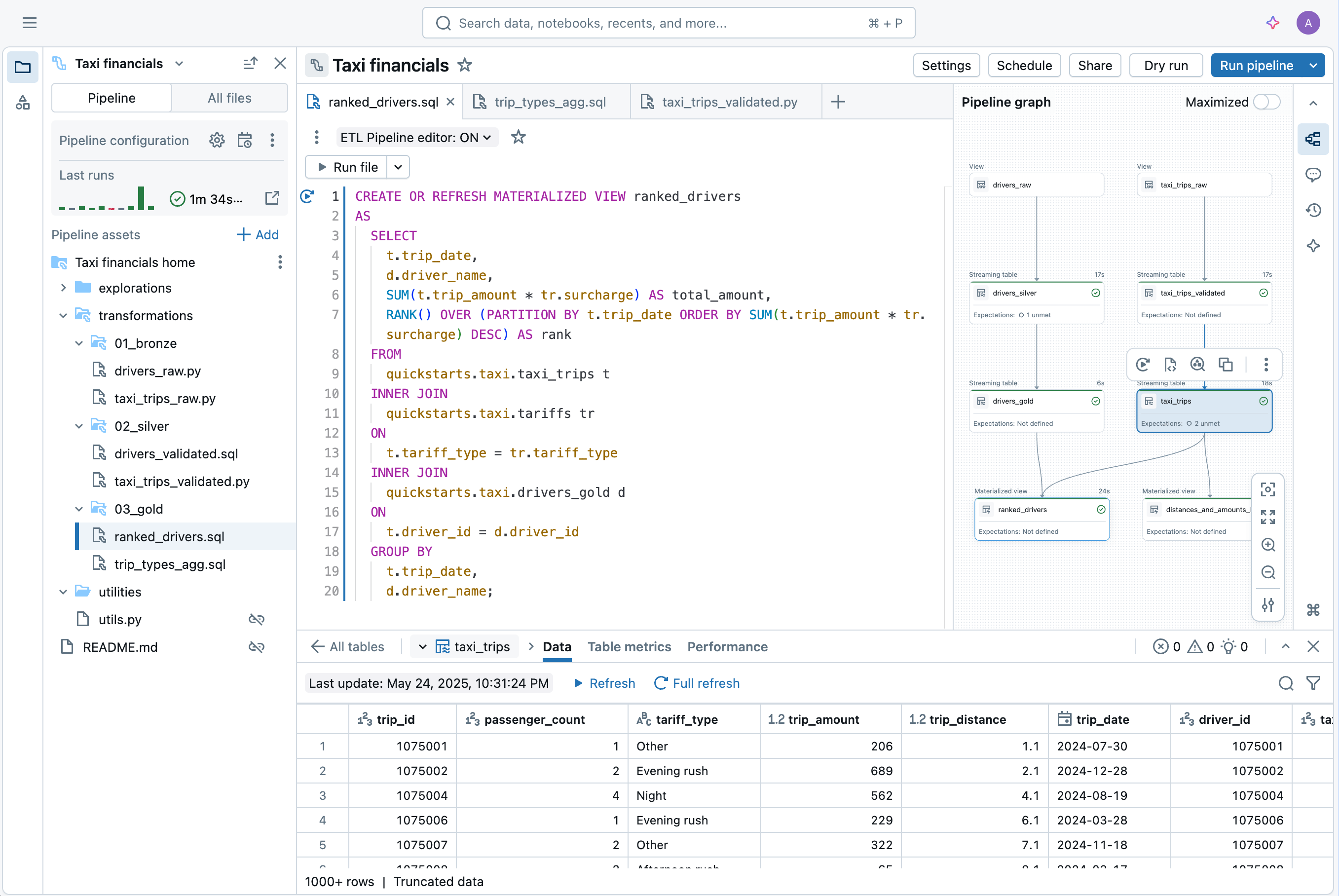

- Lakeflow Declarative Pipelines, construido sobre el nuevo estándar abierto Spark Declarative Pipelines, presenta un nuevo IDE para ingenieros de datos para un mejor desarrollo de pipelines ETL.

Nos complace anunciar que Lakeflow, la solución unificada de ingeniería de datos de Databricks, ya está disponible de forma general. Incluye conectores de ingesta ampliados para orígenes de datos populares, un nuevo "IDE para ingeniería de datos" que facilita la creación y depuración de canalizaciones de datos, y capacidades ampliadas para la operacionalización y monitorización de ETL.

En la Data + AI Summit del año pasado, presentamos Lakeflow, nuestra visión para el futuro de la ingeniería de datos, una solución integral que incluye tres componentes principales:

- Lakeflow Connect: Ingesta fiable y gestionada desde aplicaciones empresariales, bases de datos, sistemas de archivos y flujos en tiempo real, sin la sobrecarga de conectores personalizados o servicios externos.

- Lakeflow Declarative Pipelines: Canalizaciones ETL escalables construidas sobre el estándar abierto de Spark Declarative Pipelines, integradas con gobernanza y observabilidad, y que proporcionan una experiencia de desarrollo optimizada a través de un moderno "IDE para ingeniería de datos".

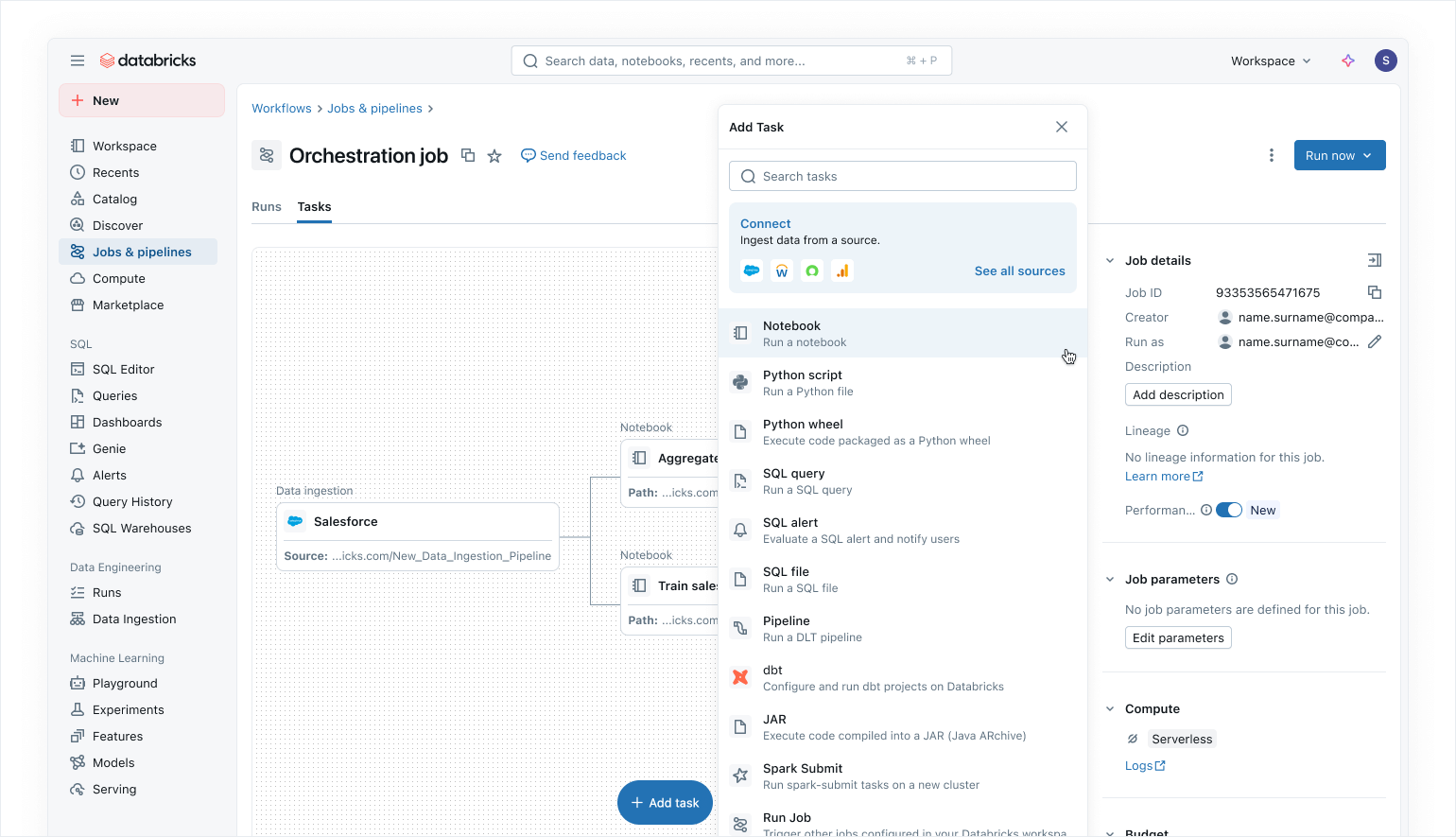

- Lakeflow Jobs: Orquestación nativa para la Plataforma de Inteligencia de Datos, compatible con control de flujo avanzado, disparadores de datos en tiempo real y monitorización completa.

Al unificar la ingeniería de datos, Lakeflow elimina la complejidad y el coste de unir diferentes herramientas, permitiendo a los equipos de datos centrarse en la creación de valor para el negocio. Lakeflow Designer, el nuevo constructor visual de canalizaciones impulsado por IA, permite a cualquier usuario crear canalizaciones de datos de calidad de producción sin escribir código.

Ha sido un año ajetreado y estamos muy contentos de compartir las novedades ahora que Lakeflow alcanza la Disponibilidad General.

Los equipos de ingeniería de datos luchan por mantenerse al día con las necesidades de datos de su organización

En todas las industrias, la capacidad de una empresa para extraer valor de sus datos a través de análisis e IA es su ventaja competitiva. Los datos se utilizan en todas las facetas de la organización: para crear vistas 360° del cliente y nuevas experiencias de cliente, para habilitar nuevas fuentes de ingresos, para optimizar operaciones y para empoderar a los empleados. A medida que las organizaciones buscan utilizar sus propios datos, terminan con un mosaico de herramientas. Los ingenieros de datos encuentran difícil abordar la complejidad de las tareas de ingeniería de datos mientras navegan por pilas de herramientas fragmentadas que son dolorosas de integrar y costosas de mantener.

Un desafío clave es la gobernanza de datos: las herramientas fragmentadas dificultan la aplicación de estándares, lo que genera lagunas en el descubrimiento, el linaje y la observabilidad. Un estudio reciente de The Economist encontró que "la mitad de los ingenieros de datos dicen que la gobernanza consume más tiempo que cualquier otra cosa". Esa misma encuesta preguntó a los ingenieros de datos qué les proporcionaría los mayores beneficios para su productividad, e identificaron "simplificar las conexiones de orígenes de datos para ingerir datos", "usar una única solución unificada en lugar de múltiples herramientas" y "una mejor visibilidad de las canalizaciones de datos para encontrar y solucionar problemas" entre las principales intervenciones".

Una solución unificada de ingeniería de datos integrada en la Plataforma de Inteligencia de Datos

Lakeflow ayuda a los equipos de datos a abordar estos desafíos proporcionando una solución integral de ingeniería de datos en la Plataforma de Inteligencia de Datos. Los clientes de Databricks pueden usar Lakeflow para todos los aspectos de la ingeniería de datos: ingesta, transformación y orquestación. Dado que todas estas capacidades están disponibles como parte de una única solución, no se pierde tiempo en complejas integraciones de herramientas ni se incurre en costes adicionales por licenciar herramientas externas.

Además, Lakeflow está integrado en la Plataforma de Inteligencia de Datos y, con ello, vienen formas consistentes de desplegar, gobernar y observar todos los casos de uso de datos e IA. Por ejemplo, para la gobernanza, Lakeflow se integra con Unity Catalog, la solución de gobernanza unificada para la Plataforma de Inteligencia de Datos. A través de Unity Catalog, los ingenieros de datos obtienen visibilidad y control completos sobre cada parte de la canalización de datos, lo que les permite comprender fácilmente dónde se están utilizando los datos y diagnosticar problemas a medida que surgen.

Ya sea versionando código, desplegando canalizaciones CI/CD, asegurando datos u observando métricas operativas en tiempo real, Lakeflow aprovecha la Plataforma de Inteligencia de Datos para proporcionar un lugar único y coherente para gestionar las necesidades de ingeniería de datos de extremo a extremo.

Lakeflow Connect: Más conectores y escrituras directas rápidas a Unity Catalog

Este último año, hemos visto una fuerte adopción de Lakeflow Connect con más de 2.000 clientes utilizando nuestros conectores de ingesta para desbloquear el valor de sus datos. Un ejemplo es Porsche Holding Salzburg, que ya está viendo los beneficios de usar Lakeflow Connect para unificar sus datos de CRM con análisis para mejorar la experiencia del cliente.

"Usar el conector de Salesforce de Lakeflow Connect nos ayuda a cerrar una brecha crítica para Porsche desde el lado del negocio en cuanto a facilidad de uso y precio. Por el lado del cliente, podemos crear una experiencia de cliente completamente nueva que fortalece el vínculo entre Porsche y el cliente con un viaje del cliente unificado y no fragmentado." — Lucas Salzburger, Project Manager, Porsche Holding Salzburg

Hoy, ampliamos la gama de orígenes de datos compatibles con más conectores integrados para una ingesta sencilla y fiable. Los conectores de Lakeflow están optimizados para una extracción de datos eficiente, incluido el uso de métodos de captura de datos de cambio (CDC) personalizados para cada origen de datos respectivo.

Estos conectores gestionados ahora abarcan aplicaciones empresariales, orígenes de archivos, bases de datos y almacenes de datos, desplegándose en varios estados de lanzamiento:

- Aplicaciones empresariales: Salesforce, Workday, ServiceNow, Google Analytics, Microsoft Dynamics 365, Oracle NetSuite

- Orígenes de archivos: SFTP, SharePoint

- Bases de datos: Microsoft SQL Server, Oracle Database, MySQL, PostgreSQL

- Almacenes de datos: Snowflake, Amazon Redshift, Google BigQuery

Además, un caso de uso común que vemos en los clientes es la ingesta de datos de eventos en tiempo real, normalmente con infraestructura de bus de mensajes alojada fuera de su plataforma de datos. Para simplificar este caso de uso en Databricks, anunciamos Zerobus, una API de Lakeflow Connect que permite a los desarrolladores escribir datos de eventos directamente en su lakehouse con un rendimiento muy alto (100 MB/s) y una latencia casi en tiempo real (<5 segundos). Esta infraestructura de ingesta optimizada proporciona rendimiento a escala y está unificada con la Plataforma Databricks para que pueda aprovechar herramientas de análisis e IA más amplias de inmediato.

"Joby puede utilizar nuestros agentes de fabricación con Zerobus para enviar gigabytes de datos de telemetría por minuto directamente a nuestro lakehouse, acelerando el tiempo hasta obtener información, todo ello con Databricks Lakeflow y la Plataforma de Inteligencia de Datos." — Dominik Müller, Factory Systems Lead, Joby Aviation Inc.

Lakeflow Declarative Pipelines: Desarrollo ETL acelerado basado en estándares abiertos

Después de años operando y evolucionando DLT con miles de clientes a través de petabytes de datos, hemos tomado todo lo aprendido y creado un nuevo estándar abierto: Spark Declarative Pipelines. Esta es la próxima evolución en el desarrollo de canalizaciones: declarativa, escalable y abierta.

Y hoy, nos complace anunciar la Disponibilidad General de Lakeflow Declarative Pipelines, que aporta el poder de Spark Declarative Pipelines a la Plataforma de Inteligencia de Datos de Databricks. Es 100% compatible con el estándar abierto, por lo que puede desarrollar canalizaciones una vez y ejecutarlas en cualquier lugar. También es 100% retrocompatible con las canalizaciones DLT, por lo que los usuarios existentes pueden adoptar las nuevas capacidades sin reescribir nada. Lakeflow Declarative Pipelines es una experiencia totalmente gestionada en Databricks: cómputo sin servidor sin intervención manual, integración profunda con Unity Catalog para una gobernanza unificada y un IDE para Ingeniería de Datos diseñado específicamente.

El nuevo IDE para Ingeniería de Datos es un entorno moderno e integrado diseñado para optimizar la experiencia de desarrollo de canalizaciones. Incluye:

- Código y DAG uno al lado del otro, con visualización de dependencias y previsualizaciones de datos instantáneas

- Depuración contextual que muestra los problemas en línea

- Integración Git incorporada para un desarrollo rápido

- Autoría y configuración asistidas por IA

“El nuevo editor reúne todo en un solo lugar: código, gráfico de canalización, resultados, configuración y solución de problemas. Ya no hay que malabarizar con pestañas del navegador o perder el contexto. El desarrollo se siente más enfocado y eficiente. Puedo ver directamente el impacto de cada cambio de código. Un clic me lleva a la línea de error exacta, lo que acelera la depuración. Todo se conecta: código con datos; código con tablas; tablas con el código. Cambiar entre canalizaciones es fácil, y funciones como las carpetas de utilidad autoconfiguradas eliminan la complejidad. Esto se siente como debería funcionar el desarrollo de canalizaciones.” — Chris Sharratt, Ingeniero de Datos, Rolls-Royce

Las Canalizaciones Declarativas de Lakeflow son ahora la forma unificada de construir canalizaciones escalables, gobernadas y optimizadas continuamente en Databricks, ya sea que trabaje con código o visualmente a través del Lakeflow Designer, una nueva experiencia sin código que permite a los profesionales de datos de cualquier nivel técnico construir canalizaciones de datos confiables.

Lakeflow Jobs: Orquestación confiable para todas las cargas de trabajo con observabilidad unificada

Databricks Workflows ha sido confiable durante mucho tiempo para orquestar flujos de trabajo de misión crítica, con miles de clientes que confían en nuestra plataforma para que las canalizaciones ejecuten más de 110 millones de trabajos cada semana. Con la GA de Lakeflow, estamos evolucionando Workflows a Lakeflow Jobs, unificando este orquestador maduro y nativo con el resto de la pila de ingeniería de datos.

Lakeflow Jobs te permite orquestar cualquier proceso en la Plataforma de Datos Inteligente con un conjunto creciente de capacidades, que incluyen:

- Soporte para una colección completa de tipos de tareas para orquestar flujos que incluyen Canalizaciones Declarativas, notebooks, consultas SQL, transformaciones dbt e incluso la publicación de dashboards de IA/BI o en Power BI.

- Funciones de control de flujo como ejecución condicional, bucles y configuración de parámetros a nivel de tarea o trabajo.

- Disparadores para ejecuciones de trabajos más allá de la programación simple con disparadores de llegada de archivos y los nuevos disparadores de actualización de tablas, que aseguran que los trabajos solo se ejecuten cuando hay nuevos datos disponibles.

- Trabajos sin servidor que proporcionan optimizaciones automáticas para un mejor rendimiento y un menor costo.

“Con los trabajos sin servidor de Lakeflow, hemos logrado una mejora de 3 a 5 veces en la latencia. Lo que antes tomaba 10 minutos ahora toma solo 2 o 3 minutos, lo que reduce significativamente los tiempos de procesamiento. Esto nos ha permitido ofrecer ciclos de retroalimentación más rápidos para jugadores y entrenadores, asegurando que obtengan los insights que necesitan en tiempo casi real para tomar decisiones procesables.” — Bryce Dugar, Gerente de Ingeniería de Datos, Cincinnati Reds

Como parte de la unificación de Lakeflow, Lakeflow Jobs aporta observabilidad de extremo a extremo a cada capa del ciclo de vida de los datos, desde la ingesta de datos hasta la transformación y la orquestación compleja. Un conjunto diverso de herramientas se adapta a cada necesidad de monitoreo: las herramientas de monitoreo visual proporcionan búsqueda, estado y seguimiento de un vistazo, las herramientas de depuración como los perfiles de consulta ayudan a optimizar el rendimiento, las alertas y las tablas del sistema ayudan a detectar problemas y ofrecen insights históricos, y las expectativas de calidad de datos aplican reglas y garantizan altos estándares para sus necesidades de canalización de datos.

Comienza con Lakeflow

Lakeflow Connect, Lakeflow Declarative Pipelines y Lakeflow Jobs están todos Generalmente Disponibles para todos los clientes de Databricks hoy. Obtén más información sobre Lakeflow aquí y visita la documentación oficial para comenzar con Lakeflow para tu próximo proyecto de ingeniería de datos.

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.