Novedades: Lakeflow Jobs ofrece una orquestación de datos más eficiente

Lakeflow Jobs ahora viene con un nuevo conjunto de capacidades y actualizaciones de diseño creadas para mejorar la orquestación de flujos de trabajo y la eficiencia de los pipelines.

- Descubre las nuevas mejoras de UI/UX para Lakeflow Jobs que ofrecen a los usuarios un aspecto más limpio e intuitivo, mejorando su experiencia general.

- Conoce las últimas capacidades añadidas que proporcionan flexibilidad y control adicionales sobre los flujos de trabajo.

- Obtén más información sobre Lakeflow Connect en Jobs, una forma nueva y más centralizada de ingerir datos en tu pipeline.

En los últimos meses, hemos introducido interesantes actualizaciones en Lakeflow Jobs (anteriormente conocido como Databricks Workflows) para mejorar la orquestación de datos y optimizar el rendimiento de los flujos de trabajo.

Para los recién llegados, Lakeflow Jobs es el orquestador integrado para Lakeflow, una solución unificada e inteligente para la ingeniería de datos con desarrollo y operaciones de ETL optimizados, construida sobre la Data Intelligence Platform. Lakeflow Jobs es el orquestador más confiable para el Lakehouse y cargas de trabajo de nivel de producción, con más de 14.600 clientes, 187.000 usuarios semanales y 100 millones de trabajos ejecutados cada semana.

Desde mejoras en la interfaz de usuario hasta un control de flujo de trabajo más avanzado, echa un vistazo a las últimas novedades de la solución nativa de orquestación de datos de Databricks y descubre cómo los ingenieros de datos pueden optimizar su experiencia de pipeline de datos de extremo a extremo.

Interfaz de usuario renovada para una experiencia de usuario más enfocada

Hemos rediseñado nuestra interfaz para dar a Lakeflow Jobs un aspecto fresco y moderno. El nuevo diseño compacto permite un viaje de orquestación más intuitivo. Los usuarios disfrutarán de una paleta de tareas que ahora ofrece accesos directos y un botón de búsqueda para ayudarles a encontrar y acceder a sus tareas más fácilmente, ya sea un Lakeflow Pipeline, un dashboard de IA/BI, un notebook, SQL o más.

Para la monitorización, los clientes ahora pueden encontrar fácilmente información sobre los tiempos de ejecución de sus trabajos en el panel derecho, en los detalles de ejecución del trabajo y la tarea, lo que les permite monitorizar fácilmente los tiempos de procesamiento e identificar rápidamente cualquier problema en el pipeline de datos.

También hemos mejorado la barra lateral permitiendo a los usuarios elegir qué secciones (detalles del trabajo, programaciones y activadores, parámetros del trabajo, etc.) ocultar o mantener abiertas, haciendo que su interfaz de orquestación sea más limpia y relevante.

En general, los usuarios de Lakeflow Jobs pueden esperar un flujo de trabajo de orquestación más optimizado, enfocado y simplificado. El nuevo diseño está actualmente disponible para los usuarios que han optado por la vista previa y han activado el interruptor en la página de Jobs.

Flujos de datos más controlados y eficientes

Nuestro orquestador se mejora constantemente con nuevas funciones. La última actualización introduce controles avanzados para la orquestación de pipelines de datos, dando a los usuarios un mayor control sobre sus flujos de trabajo para una mayor eficiencia y un rendimiento optimizado.

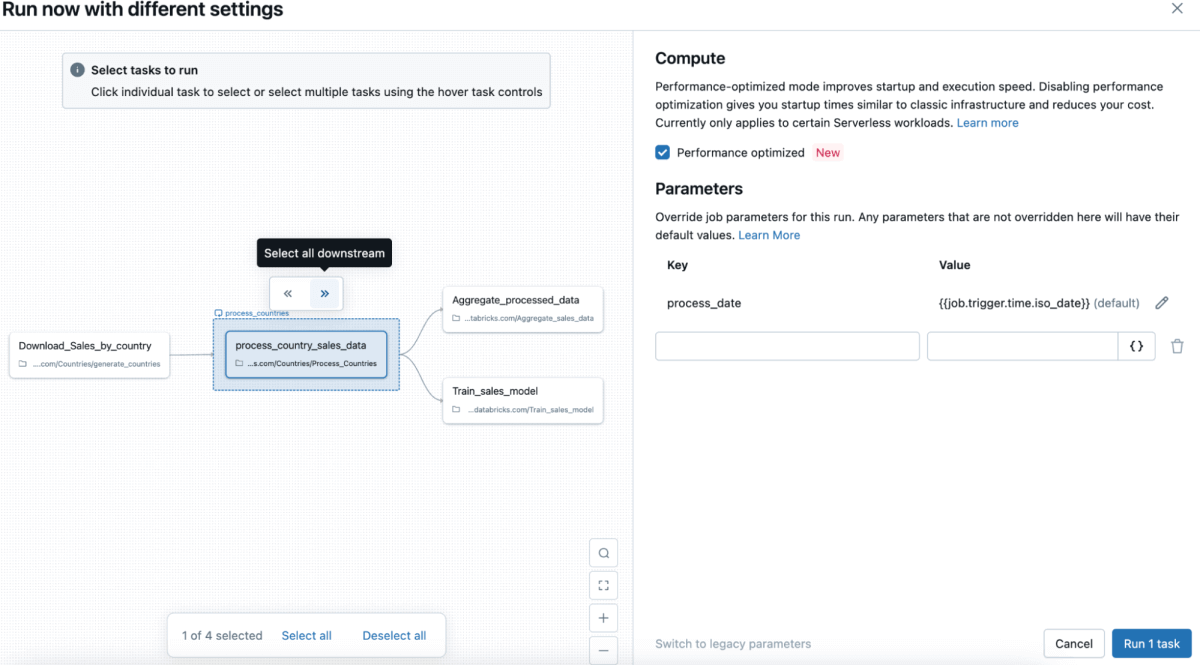

Ejecuciones parciales permiten a los usuarios seleccionar qué tareas ejecutar sin afectar a otras. Anteriormente, probar tareas individuales requería ejecutar todo el trabajo, lo que podía ser computacionalmente intensivo, lento y costoso. Ahora, en la página Jobs & Pipelines, los usuarios pueden seleccionar "Ejecutar ahora con configuraciones diferentes" y elegir tareas específicas para ejecutar sin afectar a otras, evitando el desperdicio computacional y los altos costos. De manera similar, las reparaciones parciales permiten una depuración más rápida al permitir a los usuarios corregir tareas fallidas individuales sin volver a ejecutar todo el trabajo.

Con un mayor control sobre sus flujos de ejecución y reparación, los clientes pueden acelerar los ciclos de desarrollo, mejorar el tiempo de actividad de los trabajos y reducir los costos de cómputo. Tanto las ejecuciones parciales como las reparaciones están generalmente disponibles en la interfaz de usuario y en la API de Jobs.

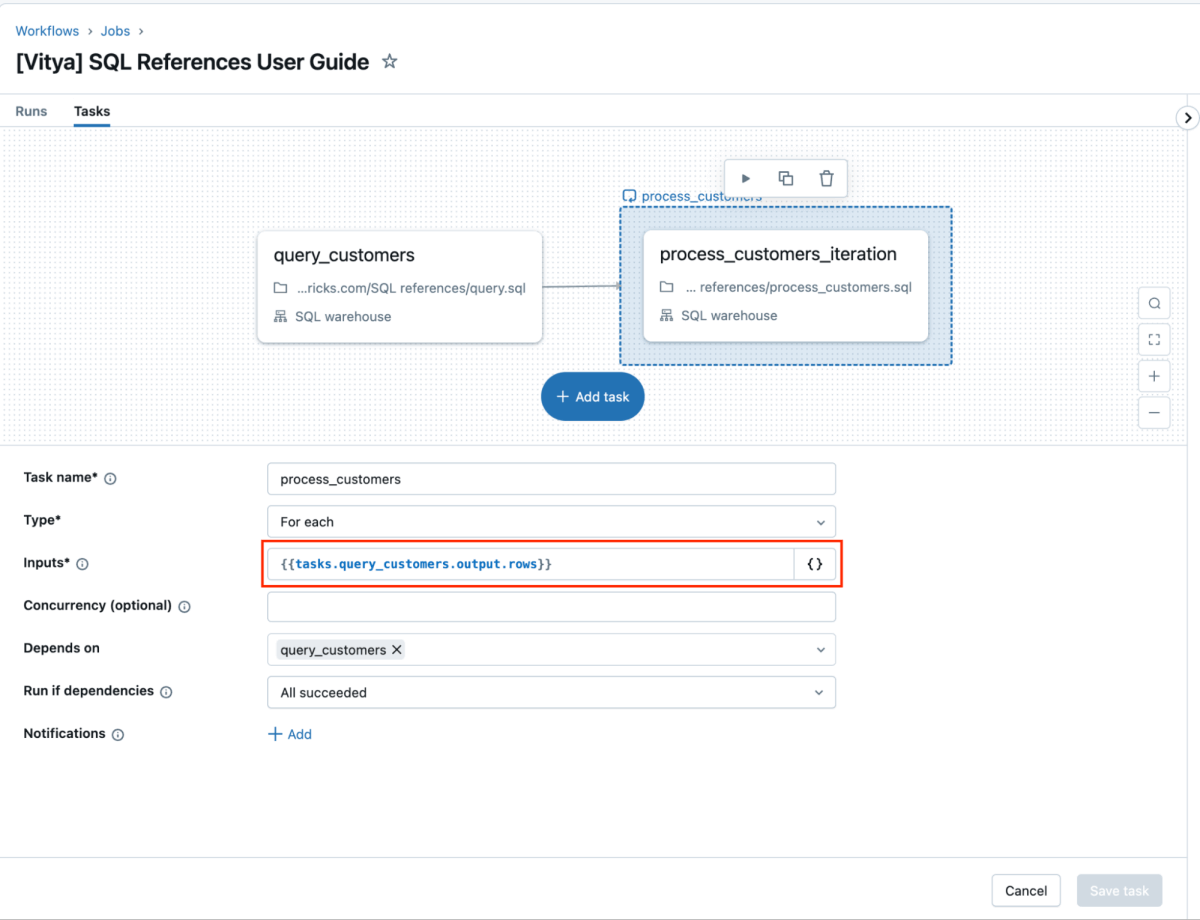

¡Para todos los fans de SQL, tenemos excelentes noticias! En esta última ronda de actualizaciones, los clientes podrán utilizar los resultados de las consultas SQL como parámetros en Lakeflow Jobs para orquestar sus datos. Esto facilita a los desarrolladores de SQL pasar parámetros entre tareas y compartir contexto dentro de un trabajo, lo que resulta en una orquestación de pipeline de datos más cohesiva y unificada. Esta función también está ahora generalmente disponible.

Inicio rápido con Lakeflow Connect en Jobs

Además de estas mejoras, también estamos haciendo que la ingesta de datos en Lakeflow Jobs sea rápida y fácil al integrar más estrechamente Jobs con Lakeflow Connect, la solución de ingesta de datos administrada y confiable de Databricks Lakeflow, con conectores integrados.

Los clientes ya pueden orquestar pipelines de ingesta de Lakeflow Connect que se originan en Lakeflow Connect, utilizando cualquiera de los conectores totalmente administrados (por ejemplo, Salesforce, Workday, etc.) o directamente desde notebooks. Ahora, con Lakeflow Connect en Jobs, los clientes pueden crear fácilmente un pipeline de ingesta directamente desde dos puntos de entrada en su interfaz de Jobs, todo dentro de un entorno de apuntar y hacer clic. Dado que la ingesta suele ser el primer paso en ETL, esta nueva integración perfecta con Lakeflow Connect permite a los clientes consolidar y optimizar su experiencia de ingeniería de datos, de extremo a extremo.

Lakeflow Connect en Jobs está ahora generalmente disponible para los clientes. Obtén más información sobre esta y otras versiones recientes de Lakeflow Connect.

Una única orquestación para todas tus cargas de trabajo

Estamos innovando constantemente en Lakeflow Jobs para ofrecer a nuestros clientes una experiencia de orquestación moderna y centralizada para todas sus necesidades de datos en toda la organización. Próximamente habrá más funciones en Jobs: pronto presentaremos una forma para que los usuarios activen trabajos basados en actualizaciones de tablas, proporcionaremos soporte para tablas del sistema y ampliaremos nuestras capacidades de observabilidad, ¡así que estad atentos!

Para aquellos que quieran seguir aprendiendo sobre Lakeflow Jobs, consulten nuestras sesiones bajo demanda de nuestro Data+AI Summit y exploren Lakeflow en una variedad de casos de uso, demos y más.

- Obtén más información sobre Lakeflow Jobs

- Crea tu primer trabajo con nuestra Guía de inicio rápido

- Activa la nueva interfaz de usuario utilizando el interruptor en la página Jobs & Pipelines (solo clientes en vista previa)

- ¿No pudiste asistir al Data+AI Summit? Mira las sesiones de Lakeflow Jobs bajo demanda

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.