Novedades: Zerobus y otros anuncios mejoran la ingesta de datos para Lakeflow Connect

Lakeflow Connect amplía su cobertura de fuentes de datos y Zerobus introduce una API de escritura directa de alto rendimiento con baja latencia

por Elise Georis, Peter Pogorski, Victoria Bukta y Giselle Goicochea

- Lakeflow Connect amplía la variedad de fuentes de ingesta de datos, incluyendo nuevos conectores basados en consultas para bases de datos.

- Zerobus es una API de escritura directa que simplifica la ingesta para IoT, clickstream, telemetría y otros casos de uso similares.

- Lakeflow Connect en Jobs proporciona una integración fluida e intuitiva entre ambas herramientas, ayudando a los usuarios a ahorrar tiempo con una experiencia unificada de extremo a extremo.

Todo comienza con buenos datos, por lo que la ingesta suele ser tu primer paso para descubrir información valiosa. Sin embargo, la ingesta presenta desafíos, como familiarizarse con las complejidades de cada fuente de datos, estar al tanto de esas fuentes a medida que cambian y gobernar todo esto a lo largo del proceso.

Lakeflow Connect facilita la ingesta eficiente de datos, con una interfaz de usuario de apuntar y hacer clic, una API sencilla e integraciones profundas con la Plataforma de Inteligencia de Datos. El año pasado, más de 2.000 clientes utilizaron Lakeflow Connect para extraer valor de sus datos.

En esta entrada de blog, repasaremos los aspectos básicos de Lakeflow Connect y resumiremos los últimos anuncios de la Data + AI Summit 2025.

Ingiere todos tus datos en un solo lugar con Lakeflow Connect

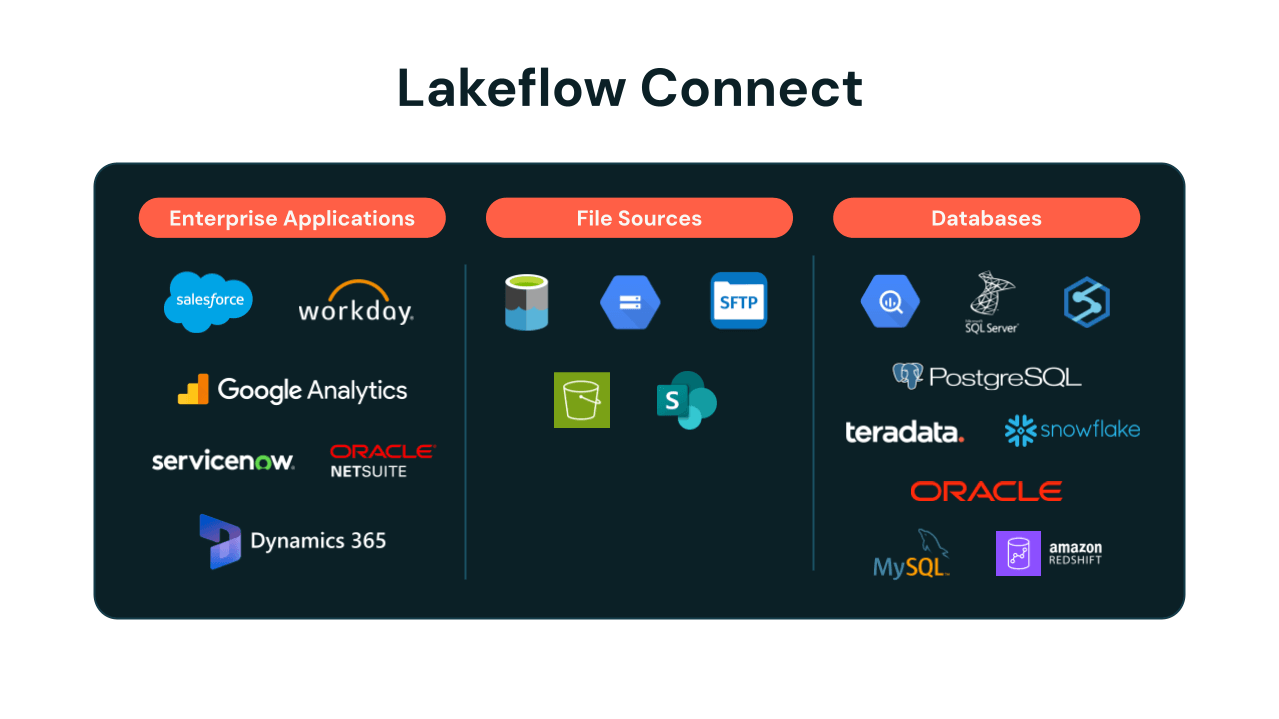

Lakeflow Connect ofrece conectores de ingesta sencillos para aplicaciones, bases de datos, almacenamiento en la nube, buses de mensajes y más. Bajo el capó, la ingesta es eficiente, con actualizaciones incrementales y uso optimizado de la API. A medida que se ejecutan tus canalizaciones administradas, nos encargamos de la evolución del esquema, las actualizaciones sin problemas de la API de terceros y la observabilidad integral con alertas integradas.

Anuncios de la Data + AI Summit 2025

En la Data + AI Summit de este año, Databricks anunció la Disponibilidad General de Lakeflow, el enfoque unificado para la ingeniería de datos en ingesta, transformación y orquestación. Como parte de esto, Lakeflow Connect anunció Zerobus, una API de escritura directa que simplifica la ingesta para IoT, clickstream, telemetría y otros casos de uso similares. También ampliamos la gama de fuentes de datos compatibles con más conectores integrados para aplicaciones empresariales, fuentes de archivos, bases de datos y almacenes de datos, así como datos de almacenamiento de objetos en la nube.

Zerobus: una nueva forma de enviar datos de eventos directamente a tu lakehouse

Hicimos un anuncio emocionante presentando Zerobus, un nuevo enfoque innovador para enviar datos de eventos directamente a tu lakehouse, acercándote a la fuente de datos. La eliminación de saltos de datos y la reducción de la carga operativa permiten a Zerobus ofrecer escrituras directas de alto rendimiento con baja latencia, proporcionando un rendimiento casi en tiempo real a escala.

Anteriormente, algunas organizaciones utilizaban buses de mensajes como Kafka como capas de transporte al Lakehouse. Kafka ofrece una forma duradera y de baja latencia para que los productores de datos envíen datos, y es una opción popular al escribir en múltiples destinos. Sin embargo, también añade complejidad y costos adicionales, así como la carga de administrar otra copia de datos, por lo que es ineficiente cuando tu único destino es el Lakehouse. Zerobus proporciona una solución sencilla para estos casos.

Joby Aviation ya está utilizando Zerobus para enviar datos de telemetría directamente a Databricks.

Joby puede utilizar nuestros agentes de fabricación con Zerobus para enviar gigabytes de datos de telemetría por minuto directamente a nuestro lakehouse, acelerando el tiempo para obtener información valiosa, todo ello con Databricks Lakeflow y la Plataforma de Inteligencia de Datos.” — Dominik Müller, Factory Systems Lead, Joby Aviation, Inc.

Como parte de Lakeflow Connect, Zerobus también está unificado con la Plataforma Databricks, por lo que puedes aprovechar capacidades analíticas y de IA más amplias de inmediato. Zerobus se encuentra actualmente en Vista Previa Privada; ponte en contacto con tu equipo de cuentas para acceder anticipadamente.

🎥 Mira y aprende más sobre Zerobus: Sesión magistral en la Data + AI Summit, con Joby Aviation, "Lakeflow Connect: eliminando saltos en tu arquitectura de streaming”

Lakeflow Connect amplía las capacidades de ingesta y las fuentes de datos

Se siguen lanzando nuevos conectores totalmente administrados en varios estados de lanzamiento (ver lista completa a continuación), incluidos Google Analytics y ServiceNow, así como SQL Server, el primer conector de base de datos, todos actualmente en Vista Previa Pública con Disponibilidad General próximamente.

También hemos seguido innovando para los clientes que desean más opciones de personalización y utilizan nuestra solución de ingesta existente, Auto Loader. Procesa de forma incremental y eficiente los nuevos archivos de datos a medida que llegan al almacenamiento en la nube. Hemos lanzado importantes mejoras de costo y rendimiento para Auto Loader, que incluyen listados de directorios 3 veces más rápidos y limpieza automática con “CleanSource”, ambos ahora disponibles de forma general, junto con una detección de archivos más inteligente y rentable utilizando eventos de archivos. También anunciamos soporte nativo para la ingesta de archivos Excel y la ingesta de datos de servidores SFTP, ambos en Vista Previa Privada, disponibles bajo solicitud para acceso anticipado.

Fuentes de datos admitidas:

- Aplicaciones: Salesforce, Workday, ServiceNow, Google Analytics, Microsoft Dynamics 365, Oracle NetSuite

- Fuentes de archivos: S3, ADLS, GCS, SFTP, SharePoint

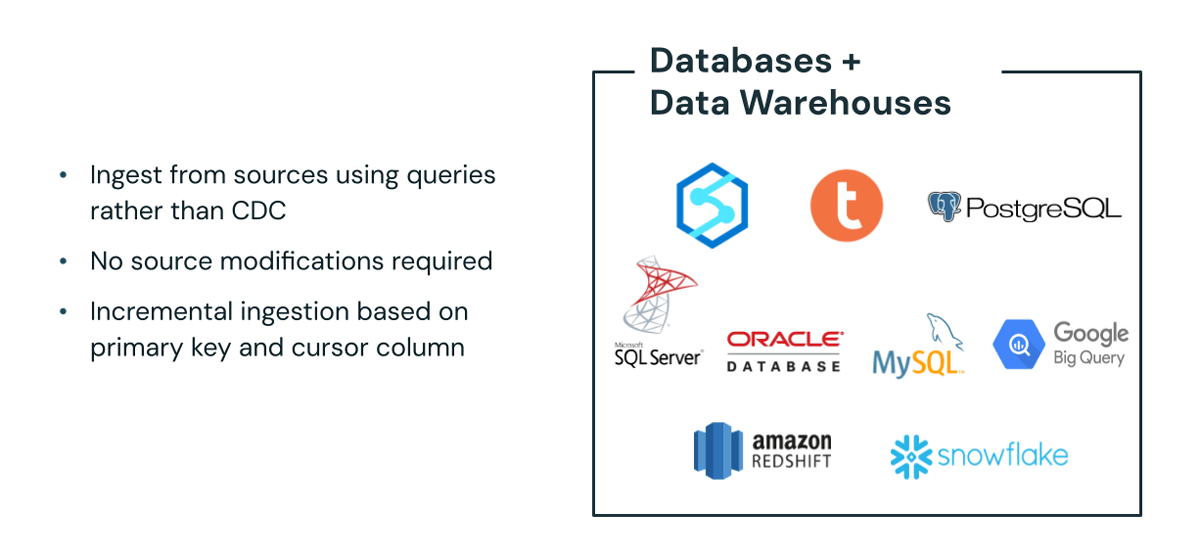

- Bases de datos: SQL Server, Oracle Database, MySQL, PostgreSQL

- Almacenes de datos: Snowflake, Amazon Redshift, Google BigQuery

Dentro de la oferta ampliada de conectores, presentamos conectores basados en consultas que simplifican la ingesta de datos. Estos nuevos conectores te permiten extraer datos directamente de tus sistemas de origen sin modificaciones en la base de datos y funcionan con réplicas de lectura donde los registros de captura de cambios de datos (CDC) no están disponibles. Esto se encuentra actualmente en Vista Previa Privada; ponte en contacto con tu equipo de cuentas para acceder anticipadamente.

🎥 Mira y aprende más sobre Lakeflow Connect: Sesión magistral en la Data + AI Summit, “Introducción a Lakeflow Connect”

🎥 Mira y aprende más sobre la ingesta desde aplicaciones empresariales SaaS: Sesión magistral en la Data + AI Summit con el cliente de Databricks Porsche Holding, "Lakeflow Connect: Ingesta de datos sin problemas desde aplicaciones empresariales"

🎥 Mira y aprende más sobre conectores de bases de datos: Sesión magistral en la Data + AI Summit, "Lakeflow Connect: Ingesta fácil y eficiente desde bases de datos"

Lakeflow Connect en Jobs, ahora disponible de forma general

Continuamos desarrollando capacidades para facilitar el uso de nuestros conectores de ingesta al crear canalizaciones de datos, como parte de la experiencia unificada de ingeniería de datos de Lakeflow. Databricks anunció recientemente Lakeflow Connect en Jobs, que te permite crear canalizaciones de ingesta dentro de Lakeflow Jobs. Por lo tanto, si tienes trabajos como centro de tu proceso ETL, esta integración perfecta proporciona una experiencia más intuitiva y unificada para administrar la ingesta.

Los clientes pueden definir y administrar sus cargas de trabajo de extremo a extremo, desde la ingesta hasta la transformación, todo en un solo lugar. Lakeflow Connect en Jobs ya está disponible de forma general.

🎥 Mira y aprende más sobre Lakeflow Jobs: Sesión de clausura en el Data + AI Summit "Orquestación con Lakeflow Jobs" "Orquestación con Lakeflow Jobs"

Lakeflow Connect: más por venir en 2025 y más allá

Databricks comprende las necesidades de los ingenieros de datos y las organizaciones que impulsan la innovación con sus datos utilizando herramientas de análisis e IA. Para ello, Lakeflow Connect ha seguido desarrollando capacidades de ingesta robustas y eficientes con conectores totalmente administrados para características y API más personalizables.

Recién estamos comenzando con Lakeflow Connect. Mantente atento a más anuncios más adelante este año, o contacta a tu equipo de cuentas de Databricks para unirte a una vista previa y obtener acceso anticipado.

Para probar Lakeflow Connect, puedes revisar la documentación, o consultar el Demo Center.

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.