Un marco práctico de gobernanza de la IA para empresas

Una guía completa para implementar herramientas y programas de gobernanza de la IA de manera responsable y eficaz

- Para las organizaciones que buscan desarrollar y documentar una gobernanza de la IA rigurosa, hemos desarrollado un marco de gobernanza de la IA que describe un enfoque estructurado para el desarrollo responsable de la IA.

- Las mejores prácticas de gobernanza de la IA, incluida la gestión de riesgos, el cumplimiento legal, la supervisión ética y el monitoreo operativo, son clave para respaldar sistemas de IA transparentes y responsables.

- El marco de gobernanza de IA tiene como objetivo ayudar a las empresas a escalar los programas de IA mientras se gestionan las expectativas normativas, se reduce el riesgo y se mantiene la confianza de las partes interesadas.

A medida que las organizaciones adoptan la IA a gran escala, crece la necesidad de una gobernanza formal. Las empresas deben alinear el desarrollo de la IA con los objetivos de negocio, cumplir con las obligaciones legales y tener en cuenta los riesgos éticos.

Presentamos el Marco de Gobernanza de IA de Databricks para proporcionar un enfoque estructurado y práctico para gobernar la adopción de la IA en toda la empresa. Este marco está diseñado para respaldar el desarrollo, la implementación y la mejora continua de los programas de gobernanza de IA.

Introducción a la gobernanza de la IA

El término "gobernanza de IA" se refiere al tipo de estructuras, procesos y supervisión que los sistemas de IA requieren para ser desarrollados e implementados de manera responsable en toda una empresa. A medida que las organizaciones escalan la IA generativa, la gobernanza se convierte en un principio fundamental para cuestiones como alinear las iniciativas de IA con los objetivos de negocio, gestionar las obligaciones éticas y regulatorias y confirmar que los modelos se comporten de manera consistente y predecible mientras están en producción.

Además, la gobernanza de la IA tiene un impacto significativo en el ROI de la IA. Sin una responsabilidad, políticas y controles de riesgo claros, los programas de IA pueden estancarse con frecuencia, sufrir incidentes de seguridad evitables o directamente no lograr ganarse la confianza de las partes interesadas. Investigaciones del sector muestran que los desafíos de la gobernanza son una barrera principal para escalar la IA, mientras que más de la mitad de los líderes señalan la falta de una responsabilidad clara, controles de riesgo inadecuados o la falta de cumplimiento como las causas principales de los proyectos de IA fallidos. Además, problemas como el sesgo de los modelos, la filtración de datos y el comportamiento no autorizado de los modelos han ido en aumento, lo que impulsa la necesidad de prácticas de gobernanza más sólidas. Estas cifras destacan cómo la gobernanza es un prerrequisito crucial para el valor de la IA, y no solo una ocurrencia tardía.

También es importante distinguir la gobernanza de la seguridad. Mientras que la seguridad se enfoca en proteger los datos, los modelos y la infraestructura de las amenazas, la gobernanza, en cambio, define cómo se toman las decisiones sobre el desarrollo y el uso de la IA.

Esto incluye cuestiones como establecer la rendición de cuentas, fijar políticas, evaluar riesgos y garantizar operaciones éticas y transparentes. Juntas, la gobernanza y la seguridad forman la base para una IA segura y escalable. Con el Marco de Gobernanza de IA de Databricks, las empresas obtienen un enfoque estructurado para desarrollar estas capacidades antes de escalar la IA en productos y flujos de trabajo.

Por qué la gobernanza de la IA no puede esperar

Según una encuesta global de 2024 a 1100 ejecutivos de tecnología e ingenieros realizada por Economist Impact, el 40 % de los encuestados creía que el programa de Gobernanza de IA de su organización era insuficiente para garantizar la seguridad y el cumplimiento de sus activos y casos de uso de IA. Además, la privacidad de los datos y las brechas de seguridad eran la principal preocupación para el 53 % de los arquitectos empresariales, mientras que la seguridad y la gobernanza son los aspectos más desafiantes de la ingeniería de datos para los ingenieros.

Además, según Gartner, la gestión de la confianza, el riesgo y la seguridad de la IA es la principal tendencia estratégica n.º 1 en 2024 que influirá en las decisiones empresariales y tecnológicas, y para 2026, los modelos de IA de las organizaciones que operacionalizan la transparencia, la confianza y la seguridad de la IA lograrán un aumento del 50 % en términos de adopción, objetivos empresariales y aceptación de los usuarios.

Es evidente que la falta de programas de gobernanza de la IA a nivel empresarial se está convirtiendo rápidamente en un obstáculo clave para obtener un retorno del valor de las inversiones en IA y la adopción de la IA en general.

Por eso, desarrollamos un marco de orientación integral que las empresas pueden aprovechar para crear programas eficaces de gobernanza de la IA.

Un enfoque estructurado para la gobernanza de la IA

Las mejores prácticas para implementar la gobernanza de la IA requieren una metodología estructurada y repetible que alinee a las personas, los procesos y la tecnología en toda la organización. El Marco de Gobernanza de la IA de Databricks desarrolla un enfoque holístico que comienza con el establecimiento de objetivos empresariales claros, la definición de la propiedad y la creación de modelos de gobernanza que se integran a la perfección con las estructuras empresariales existentes. Los programas de gobernanza tienen éxito cuando se los trata como extensiones de las estrategias organizacionales existentes, las prácticas de riesgo y los procesos de gestión de datos.

Un aspecto clave de este enfoque es integrar las responsabilidades de gobernanza en todos los equipos, en lugar de centralizarlas en un solo grupo. Los líderes empresariales establecen la dirección estratégica al articular los objetivos de la IA, definir niveles de riesgo aceptables y garantizar la alineación con las prioridades de la empresa.

Equipos como los de ingeniería de datos, ciencia de datos e ingeniería de ML operacionalizan estas directivas implementando estándares para la calidad de los datos, la documentación de modelos, el linaje, la reproducibilidad y los controles de acceso. Los equipos legales, de cumplimiento y de seguridad desempeñan un rol adicional y paralelo para garantizar la preparación regulatoria, el cumplimiento de las políticas y la protección de los datos y los activos de modelos a lo largo de todo el ciclo de vida.

La integración de la gobernanza con los sistemas operativos proporciona tanto consistencia como escalabilidad. Por ejemplo, las soluciones unificadas de gobernanza de datos como Unity Catalog pueden estandarizar las políticas de acceso, aplicar el linaje y centralizar los metadatos para la evaluación de riesgos y la auditabilidad. Mientras tanto, las prácticas sólidas de ingeniería de datos garantizan que los programas de IA se construyan sobre bases de datos confiables y bien gobernadas, con pipelines reproducibles y transformaciones transparentes que puedan monitorearse a lo largo del tiempo.

La gobernanza eficaz de la IA no es un ejercicio de una sola vez. Se requieren procesos continuos de monitoreo y evaluación para hacer un seguimiento del rendimiento del modelo, evaluar el desvío de datos, detectar sesgos, confirmar el cumplimiento de las políticas e identificar los riesgos emergentes. Este ciclo de retroalimentación continuo garantiza que los modelos se mantengan alineados con las expectativas del negocio y los requisitos normativos a medida que las condiciones evolucionan. Las revisiones periódicas por parte de equipos multifuncionales también ayudan a las organizaciones a ajustar proactivamente las políticas, reentrenar los modelos y perfeccionar los procesos de gobernanza.

Al adoptar un enfoque estructurado, colaborativo y orientado al ciclo de vida, las organizaciones pueden crear programas de gobernanza que escalen de manera confiable, reduzcan el riesgo y aceleren la adopción segura de la IA en toda la empresa.

Los cinco pilares fundamentales para la gobernanza de la IA

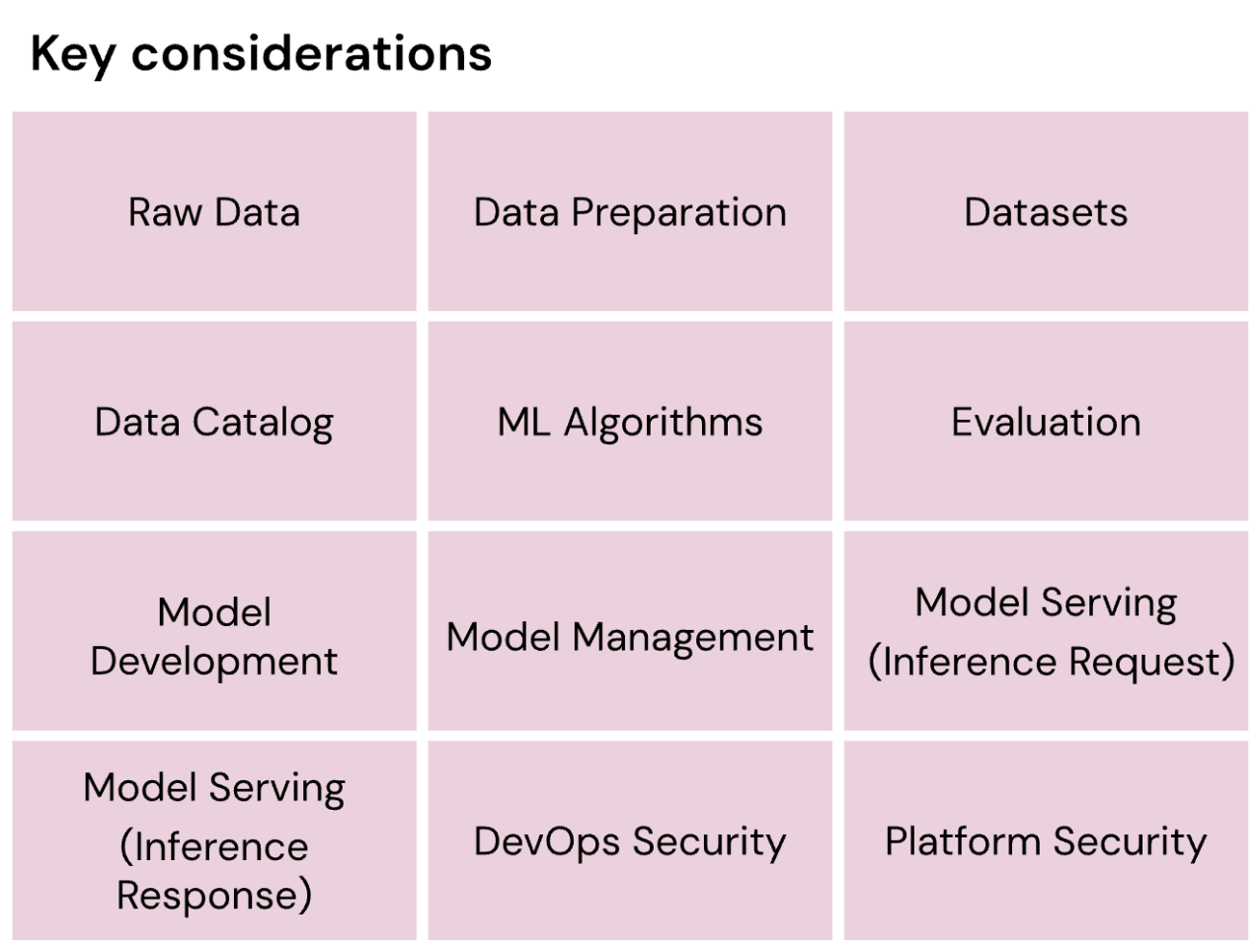

En este marco, presentamos 43 consideraciones clave que son esenciales para que toda empresa comprenda (e implemente según corresponda) a fin de gobernar eficazmente sus recorridos con la IA.

Las consideraciones clave para la gobernanza de la IA se agrupan lógicamente en cinco pilares fundamentales, diseñados y secuenciados para reflejar las estructuras organizacionales y los perfiles típicos de las empresas.

- Organización de la IA

- Cumplimiento legal y regulatorio

- Ética, transparencia e interpretabilidad

- Datos, operaciones de IA e infraestructura

- Seguridad de IA

Un marco para la gobernanza de la IA

Organización de la IA

La organización de IA integra la gobernanza de la IA dentro de la estrategia de gobernanza más amplia de la organización. Subraya la base para un programa de IA eficaz a través de las mejores prácticas, como objetivos empresariales claramente definidos y la integración de las prácticas de gobernanza adecuadas que supervisan a las personas, los procesos, la tecnología y los datos de la organización. Explica cómo las organizaciones pueden establecer la supervisión necesaria para alcanzar sus objetivos estratégicos mientras reducen el riesgo.

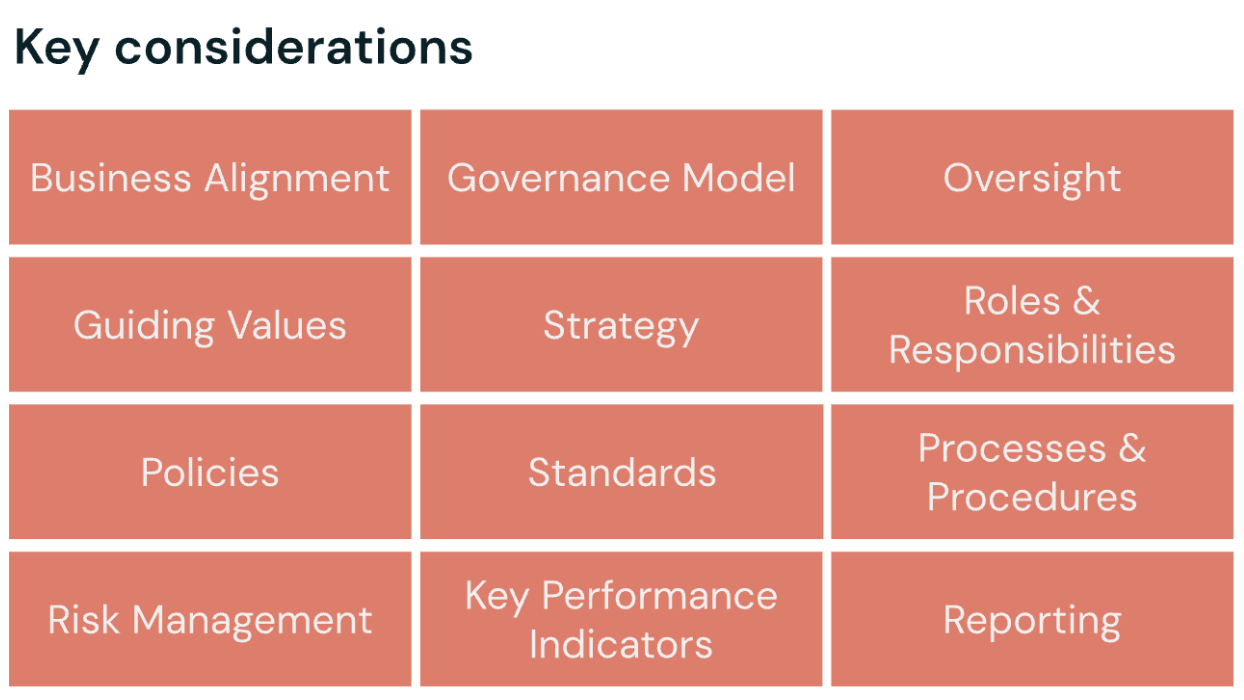

Consideraciones clave para una organización de gobernanza de la IA eficaz

- Alineación de negocio

- Modelo de gobernanza

- Supervisión

- Valores rectores

- Estrategia

- Funciones y& responsabilidades

- Políticas

- Estándares

- Procesos y procedimientos

- Gestión de riesgos

- Indicadores clave de rendimiento

- Informes

Descarga el Marco de gobernanza de la IA para conocer los pasos para comenzar.

Cumplimiento legal y normativo de las iniciativas de IA

El pilar de Cumplimiento Legal y Regulatorio ayuda a las organizaciones a alinear las iniciativas de IA con las leyes y regulaciones aplicables. Guía la gestión de riesgos legales, la interpretación de los requisitos específicos del sector y la adaptación de las estrategias de cumplimiento en respuesta a los cambiantes panoramas regulatorios. El resultado es que los programas de IA se desarrollan e implementan dentro de un marco legal y regulatorio sólido.

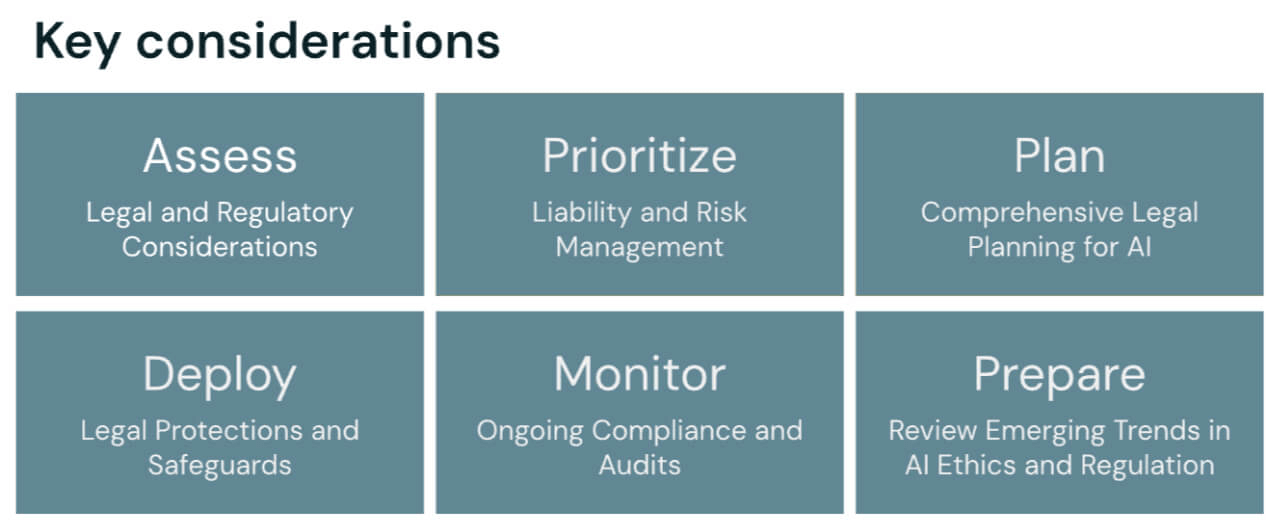

Pasos para alinear las iniciativas de IA con las leyes y regulaciones

- Evaluar las consideraciones legales y regulatorias

- Priorizar la gestión de la responsabilidad y el riesgo

- Planificar una revisión legal integral

- Implementar protecciones y salvaguardas legales

- Supervisar el cumplimiento continuo y realizar auditorías periódicas

- Revisar las tendencias emergentes en la ética y la regulación de la IA

Ética, transparencia e interpretabilidad de los programas de IA

En las organizaciones que desarrollan sistemas de IA confiables y responsables, es importante adherirse a principios éticos como la equidad, la responsabilidad y la supervisión humana, a la vez que se promueve la explicabilidad y la participación de las partes interesadas. Este pilar del marco de gobernanza de la IA proporciona métodos para establecer la responsabilidad y la estructura dentro de los equipos de la organización, lo que ayuda a garantizar que las decisiones de la IA sean interpretables, estén alineadas con los estándares éticos en evolución y fomenten la confianza a largo plazo y la aceptación social.

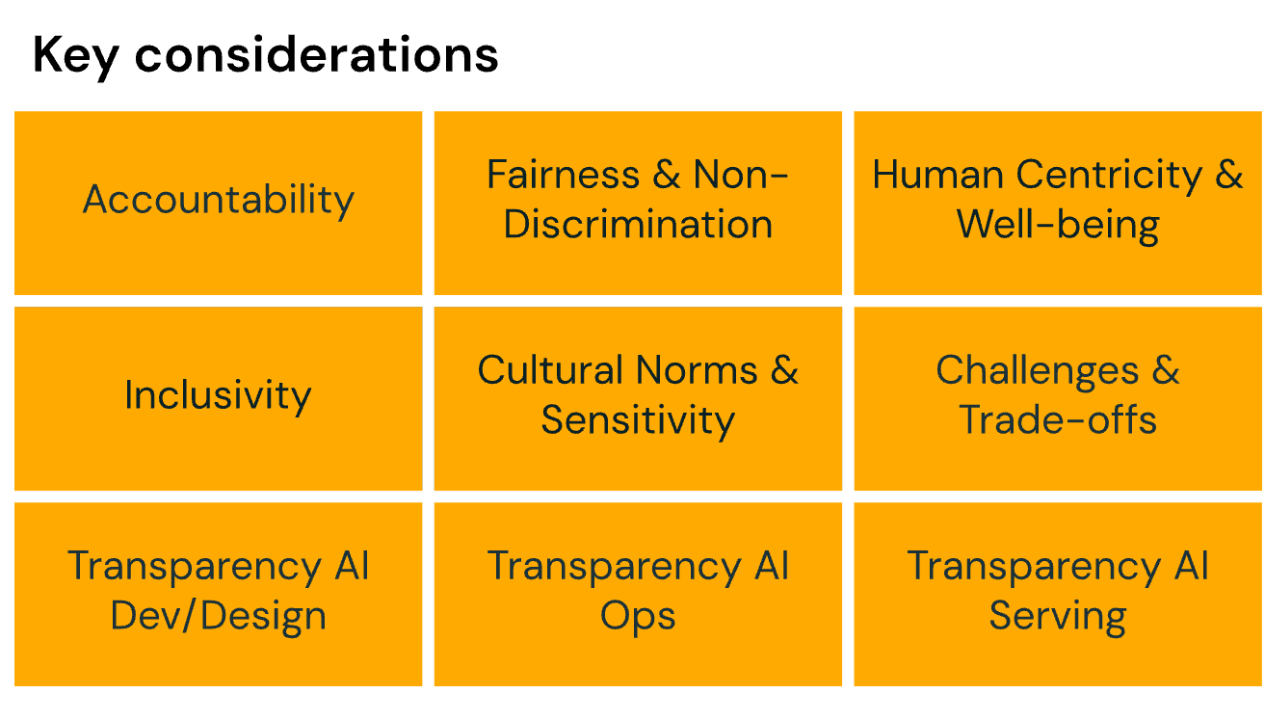

Al diseñar programas de IA e implementar herramientas de gobernanza de la IA, considere cómo abordará lo siguiente:

- Responsabilidad

- Equidad y no discriminación

- Centralidad humana y bienestar

- Inclusividad

- Normas culturales y sensibilidad

- Desafíos y contrapartidas de todo lo anterior

- Transparencia en el desarrollo y diseño de la IA

- Transparencia en las operaciones de IA

- Transparencia en el servicio de la IA

Datos, AI Ops e infraestructura para la gobernanza de la IA

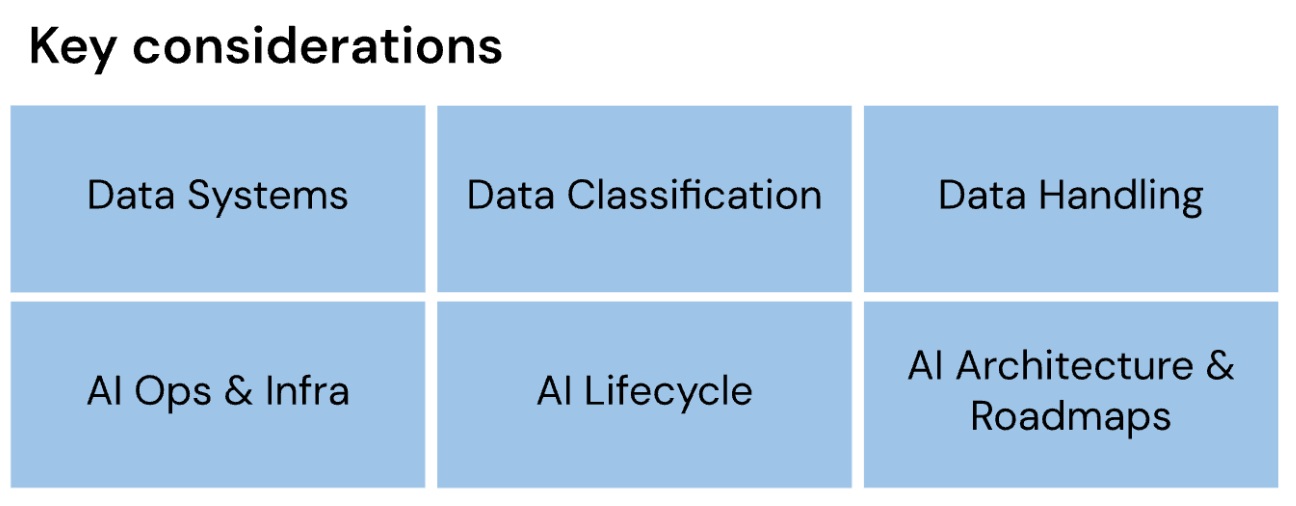

El pilar de Datos, Operaciones de IA (AIOps) e Infraestructura define la base que ayuda a las organizaciones a implementar y mantener la IA por completo. Necesitará pautas para crear una infraestructura de IA escalable y confiable, gestionar el ciclo de vida del machine learning y garantizar la calidad, la seguridad y el cumplimiento de los datos. Este pilar también destaca las mejores prácticas para las operaciones de IA, lo que incluye el entrenamiento, la evaluación, la implementación y el monitoreo de modelos, para que los sistemas de IA sean confiables, eficientes y estén alineados con los objetivos de negocio.

Pilar V: Seguridad de la IA

El pilar de Seguridad de IA presenta el Marco de Seguridad de IA de Databricks (DASF), un marco integral para comprender y mitigar los riesgos de seguridad en todo el ciclo de vida de la IA. Cubre áreas críticas como la protección de datos, la gestión de modelos, el servicio seguro de modelos y la implementación de medidas sólidas de ciberseguridad para proteger los activos de IA.

Relacionado: Vea un ejemplo práctico de cómo una organización puede aprovechar el marco de gobernanza de la IA para crear una titularidad y una alineación claras en todo el ciclo de vida del programa de IA. Vea esta presentación realizada durante el Data + AI Summit de 2025.

Marco de Gobernanza de la IA

El informe técnico del Marco de Gobernanza de IA está disponible para las organizaciones que buscan desarrollar su propia gobernanza de IA.

Comuníquese con nosotros por correo electrónico a [email protected] si tiene alguna pregunta o comentario. Si te interesa contribuir a futuras actualizaciones de este marco de trabajo (y otros artefactos futuros) uniéndote a nuestra comunidad de revisores, ¡nos encantaría saber de ti también!

Principios clave para una gobernanza de la IA eficaz

La gobernanza de la IA depende de un conjunto consistente de principios fundamentales que operan en cada etapa del ciclo de vida de la IA. Estos principios aseguran que los sistemas de IA se desarrollen y se implementen de manera responsable, al tiempo que proporcionan una estructura necesaria para que las organizaciones cumplan con las expectativas normativas, mantengan la confianza de las partes interesadas y mitiguen los riesgos a medida que se escala la adopción. Principios como la transparencia, la rendición de cuentas, la equidad y la supervisión humana se encuentran en el núcleo de cualquier estrategia eficaz.

La transparencia comienza con una documentación clara y accesible de las fuentes de datos, los supuestos del modelo, las metodologías de entrenamiento y los procesos de evaluación. Una práctica de transparencia requiere un seguimiento sistemático del linaje, el control de versiones y los comportamientos del modelo para que los equipos puedan rastrear cómo se toman las decisiones e identificar los factores que contribuyen cuando surgen problemas. Herramientas de gobernanza que centralizan los metadatos, los registros de auditoría y las políticas de acceso respaldan este trabajo al hacer que los detalles operativos sean visibles y verificables entre los equipos.

La gobernanza de IA también debe priorizar las medidas de rendición de cuentas para que en cualquier sistema de IA se definan claramente los propietarios responsables de los resultados, la gestión de riesgos y el cumplimiento de las normas de gobernanza. Un marco de responsabilidad eficaz establece roles en los grupos empresariales, técnicos, legales y de cumplimiento; distribuye los derechos de toma de decisiones y crea mecanismos de escalamiento cuando surgen comportamientos inesperados del modelo o inquietudes éticas. Además, la creación de KPI y umbrales de rendimiento puede proporcionar a los líderes puntos de referencia medibles para evaluar los sistemas de IA a lo largo del tiempo.

Un principio de equidad requiere identificar y mitigar proactivamente los sesgos durante la recopilación de datos, el entrenamiento del modelo y el monitoreo de la producción. Técnicas como el análisis de impacto dispar, las métricas de detección de sesgos y las estrategias de muestreo representativo pueden ayudar a los equipos a comprender cómo varían los resultados del modelo entre los grupos de usuarios. Las evaluaciones continuas de equidad permiten a las organizaciones identificar el desfase o las inequidades a medida que evoluciona el uso en el mundo real.

Finalmente, la supervisión humana ayuda a que los sistemas de IA se alineen con los valores de la organización y los requisitos normativos. Este paso implica definir dónde se requiere una revisión humana, diseñar procedimientos de respaldo claros y garantizar que los expertos en la materia puedan intervenir cuando los resultados del modelo son ambiguos, de alto riesgo o sensibles. Los mecanismos de supervisión deben integrarse tanto en los flujos de trabajo de desarrollo como en las operaciones de producción para que las salvaguardas permanezcan activas durante todo el ciclo de vida de la IA.

Implementación de prácticas de IA responsable

Las prácticas de IA responsable son las barreras de protección que garantizan que los sistemas de IA sirvan a las personas, las empresas y la sociedad de formas seguras, justas y alineadas con los valores de la organización. La implementación de estas prácticas requiere un enfoque holístico en todo el ciclo de vida de la IA. Desde la obtención de datos y el desarrollo de modelos hasta la implementación, el monitoreo y el retiro final, cada etapa es una oportunidad para incorporar salvaguardas. En resumen, el objetivo de cualquier práctica de IA responsable es reducir el daño, fortalecer la confianza y mejorar el rendimiento del sistema con el tiempo.

Un componente fundamental de la IA responsable es alinear el comportamiento del sistema con los valores humanos y los principios de la organización. Esto comienza con la definición del uso previsto de un modelo (incluidos los escenarios sensibles o de alto impacto) y el establecimiento de requisitos relacionados con la privacidad, la equidad, la seguridad y la explicabilidad. Es fundamental incorporar estos criterios en una fase temprana del proceso de diseño para que los equipos aborden explícitamente las consideraciones éticas, en lugar de limitarse a responder de forma reactiva. Ciertas técnicas ayudan a que los sistemas de IA funcionen de forma coherente con las expectativas de los usuarios y las normas sociales, como las herramientas de interpretabilidad de modelos, los conjuntos de datos de entrenamiento representativos y los procesos de revisión con intervención humana (human-in-the-loop).

Además, la identificación y mitigación de riesgos deberían integrarse directamente en los flujos de trabajo de desarrollo. Las organizaciones deben evaluar los riesgos como el sesgo, la deriva del modelo, las alucinaciones, la fuga de datos y los resultados no seguros, y desarrollar estrategias de mitigación vinculadas a cada uno. Estas estrategias también pueden incluir privacidad diferencial, filtrado de entradas y salidas, pruebas adversariales y ejercicios de “red-teaming” adaptados a los riesgos específicos del dominio. A medida que avanzan estas pruebas, los equipos deben documentar las evaluaciones de riesgos y los controles para proporcionar transparencia y respaldar los requisitos de auditoría interna y regulatoria.

La implementación de prácticas de IA responsable es un trabajo continuo. Incluso los modelos bien gobernados pueden degradarse a medida que cambian las distribuciones de datos o surgen nuevos requisitos. Los equipos deben establecer pipelines de monitoreo automatizados para ayudarlos a hacer un seguimiento de las métricas de rendimiento, los indicadores de equidad y el cumplimiento de las políticas en producción. Cuando surgen problemas, los procedimientos de reentrenamiento, las revisiones estructuradas de incidentes y la documentación actualizada garantizan que los sistemas de IA evolucionen de manera responsable.

Es importante que todo equipo equilibre la innovación con la cautela. Los equipos deben crear vías que permitan la experimentación, como los entornos de sandbox o los despliegues piloto controlados, a la vez que mantienen barreras de protección que evitan daños no intencionados. Este equilibrio permite a las organizaciones explorar nuevas capacidades de IA generativa y, al mismo tiempo, cumplir las expectativas de gobernanza y las normas éticas.

Primeros pasos con la implementación del DAGF

La implementación del Marco de trabajo de gobernanza de la IA de Databricks (DAGF) comienza con una hoja de ruta clara y práctica que guía a las organizaciones desde la planificación inicial hasta las operaciones a escala empresarial. El primer paso es establecer estructuras de gobernanza fundamentales: definir roles y responsabilidades, documentar los casos de uso de la IA y evaluar la preparación organizacional en cuanto a la calidad de los datos, las prácticas de desarrollo de modelos y los requisitos de cumplimiento. Esta alineación inicial garantiza que los esfuerzos de gobernanza respalden directamente las prioridades del negocio y la tolerancia al riesgo.

Un modelo de madurez puede ayudar a las organizaciones a evaluar su situación actual e identificar los siguientes pasos en su proceso de gobernanza. Por ejemplo, los programas en fase inicial se centran en documentar los activos de IA, centralizar los controles de acceso y establecer políticas de base para el uso de datos, el desarrollo de modelos y la revisión. A medida que esto madura, las organizaciones pueden empezar a introducir flujos de trabajo estandarizados, linaje y monitoreo automatizados y comités multifuncionales que supervisen el riesgo y el cumplimiento de la IA. Por último, los programas totalmente maduros operacionalizan la gobernanza en todo el ciclo de vida, lo que incluye canalizaciones reproducibles, la evaluación continua de modelos y procesos bien definidos para el reentrenamiento, la auditoría y la respuesta a incidentes.

Sin importar cuán cuidadosamente se implemente un marco de gobernanza, existen algunas dificultades comunes que enfrentan las organizaciones. Por ejemplo, muchas tienen dificultades cuando la gobernanza se trata como una idea de último momento o se asigna a un solo equipo sin una responsabilidad clara. Otras pueden subestimar el rol de los datos de alta calidad y no implementar algunas prácticas fundamentales, como la aplicación de esquemas, el seguimiento del linaje y el acceso controlado. A simple vista, estas brechas pueden parecer menores, pero pueden generar desafíos posteriores en cuanto a transparencia, reproducibilidad y auditabilidad. Establecer una responsabilidad compartida entre los equipos de negocio, técnicos y de cumplimiento, así como basar la gobernanza en prácticas sólidas de ingeniería de datos, puede ayudar a prevenir este problema en toda una organización.

Para medir el éxito, las organizaciones deben hacer un seguimiento del progreso y medir el impacto de las inversiones en gobernanza. Las métricas pueden incluir reducciones en los incidentes de los modelos y en los hallazgos de sesgo, una mejor reproducibilidad de los modelos, una mayor exhaustividad de la documentación, ciclos de revisión más cortos, aprobaciones más rápidas para nuevos casos de uso de la IA y una mayor adopción de canalizaciones y herramientas estandarizadas. Con el tiempo, estos indicadores demuestran cómo la gobernanza es una función esencial para la fiabilidad, el cumplimiento y la eficiencia operativa.

La implementación de la gobernanza debería ser un enfoque por fases que ayude a las organizaciones a alinearse cuidadosamente con sus recursos y objetivos. Muchos comienzan con casos de uso de alto impacto, aplicando controles de gobernanza a los modelos más sensibles o críticos para el negocio antes de expandirse a programas más amplios. Sin embargo, iterar y escalar de forma incremental puede ayudar a las organizaciones a construir una base de gobernanza duradera que respalde una adopción de IA segura, transparente y confiable en toda la organización.

Por qué Databricks lidera este esfuerzo

Como líder de la industria en el espacio de datos e IA, con más de 15 000 clientes en diversas geografías y segmentos de mercado, Databricks ha seguido cumpliendo su compromiso con los principios de desarrollo responsable e innovación de código abierto. Hemos mantenido estos compromisos a través de:

- Participación en los esfuerzos de la industria y el gobierno para promover la innovación y abogar por el uso de una IA segura y confiable

- Talleres interactivos para educar a las organizaciones sobre cómo guiar exitosamente su trayectoria de IA de manera consciente del riesgo.

- El código abierto de innovaciones clave en gobernanza, como MLFlow y Unity Catalog, la única solución unificada de la industria para la gobernanza de datos e IA en nubes, formatos de datos y plataformas de datos.

Estos programas nos han ofrecido una visibilidad única de los problemas prácticos a los que se enfrentan hoy las empresas y los reguladores en la gobernanza de la IA. Para promover nuestro compromiso de ayudar a todas las empresas a tener �éxito y acelerar su trayectoria de datos e IA, decidimos aprovechar esta visibilidad para crear (y poner a disposición de forma gratuita) un Marco de Gobernanza de IA completo, estructurado y accionable.

(Esta entrada del blog ha sido traducida utilizando herramientas basadas en inteligencia artificial) Publicación original

Recibe las últimas publicaciones en tu bandeja de entrada

Suscríbete a nuestro blog y recibe las últimas publicaciones directamente en tu bandeja de entrada.