Apprentissage d'agent à partir des retours humains (ALHF) : une étude de cas sur l'assistant de connaissance Databricks

Dans ce blog, nous explorons l'Apprentissage d'Agent à partir des Retours Humains (ALHF) — un nouveau paradigme d'apprentissage automatique où les agents apprennent directement à partir de retours en langage naturel minimal, et non seulement de récompenses numériques ou d'étiquettes statiques. Cela permet une adaptation plus rapide et plus intuitive des agents pour les applications d'entreprise, où les attentes sont souvent spécialisées et difficiles à formaliser.

L'ALHF alimente le produit Databricks Agent Bricks. Dans notre étude de cas, nous examinons Agent Bricks Assistant de Connaissances (KA) - qui améliore continuellement ses réponses grâce aux retours d'experts. Comme le montre la Figure 1, l'ALHF augmente considérablement la qualité globale des réponses sur Databricks DocsQA avec aussi peu que 4 enregistrements de retours. Avec seulement 32 enregistrements de retours, nous multiplions par plus de quatre la qualité des réponses par rapport aux bases statiques. Notre étude de cas démontre l'efficacité de l'ALHF et ouvre une nouvelle direction prometteuse pour la recherche sur les agents.

La Promesse des Agents IA Enseignables

En travaillant avec des clients d'entreprise de Databricks, un défi majeur que nous avons constaté est que de nombreux cas d'utilisation d'IA en entreprise dépendent de la logique métier interne hautement spécialisée, de données propriétaires et d'attentes intrinsèques, qui ne sont pas connues extérieurement (voir notre Benchmark d'Intelligence de Domaine pour en savoir plus). Par conséquent, même les systèmes les plus avancés nécessitent encore un réglage substantiel pour atteindre le seuil de qualité des cas d'utilisation d'entreprise.

Pour régler ces systèmes, les approches existantes s'appuient soit sur des sorties de vérité terrain explicites, coûteuses à collecter, soit sur des modèles de récompense, qui ne fournissent que des signaux binaires/scalaires. Afin de résoudre ces défis, nous décrivons l'Apprentissage d'Agent à partir des Retours Humains (ALHF), un paradigme d'apprentissage où un agent adapte son comportement en intégrant une petite quantité de retours en langage naturel d'experts. Ce paradigme offre un canal naturel et rentable pour l'interaction humaine et permet au système d'apprendre à partir de signaux d'attente riches.

Exemple

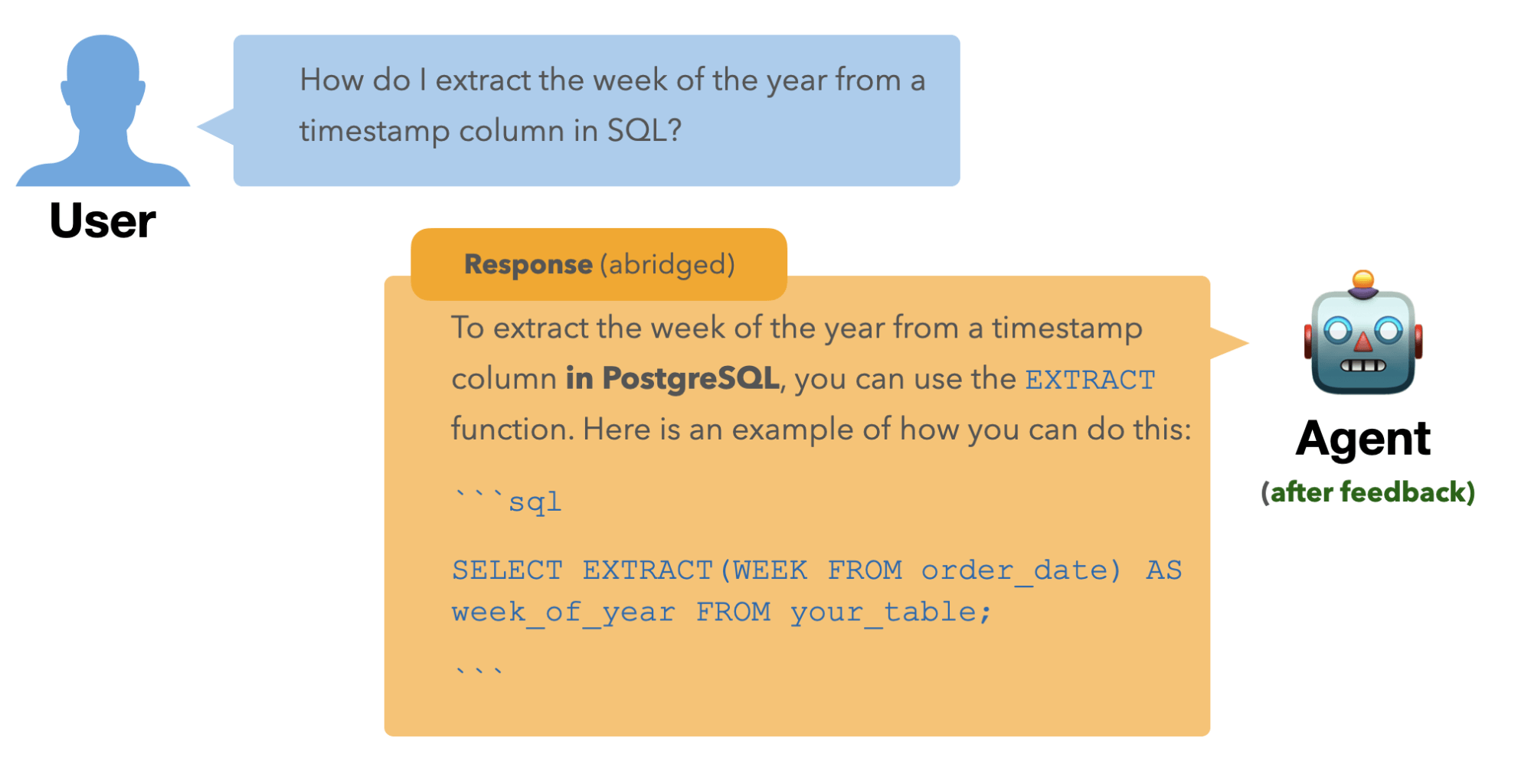

Disons que nous créons un agent de Questions-Réponses (QA) pour répondre aux questions d'une société d'hébergement de bases de données. Voici un exemple de question :

L'agent a suggéré d'utiliser la fonction weekofyear(), prise en charge dans plusieurs saveurs de SQL (MySQL, MariaDB, etc.). Cette réponse est correcte en ce sens que lorsqu'elle est utilisée de manière appropriée, weekofyear() atteint la fonctionnalité souhaitée. Cependant, elle n'est pas prise en charge dans PostgreSQL, la saveur SQL préférée par notre groupe d'utilisateurs. Notre expert métier (SME) peut fournir des retours en langage naturel sur la réponse pour communiquer cette attente comme ci-dessus, et l'agent s'adaptera en conséquence :

L'ALHF adapte les réponses du système non seulement pour cette question unique, mais aussi pour les questions des conversations futures où les retours sont pertinents, par exemple :

Comme le montre cet exemple, l'ALHF offre aux développeurs et aux SME un moyen simple et intuitif de diriger le comportement d'un agent en utilisant le langage naturel — en l'alignant sur leurs attentes.

ALHF dans Agent Bricks

Nous utiliserons un cas d'utilisation spécifique du produit Agent Bricks - l'Assistant de Connaissances - comme étude de cas pour démontrer la puissance de l'ALHF.

Assistant de Connaissances (KA) offre une approche déclarative pour créer un chatbot sur vos documents, fournissant des réponses fiables et de haute qualité avec des citations. KA exploite l'ALHF pour apprendre continuellement les attentes des experts à partir des retours en langage naturel et améliorer la qualité de ses réponses.

KA demande d'abord des instructions de tâche de haut niveau. Une fois connecté aux sources de connaissances pertinentes, il commence à répondre aux questions. Les experts peuvent ensuite utiliser un mode d'Amélioration de la Qualité pour examiner les réponses et laisser des retours, que KA incorpore via l'ALHF pour affiner les réponses futures.

Évaluation

Pour démontrer la valeur de l'ALHF dans KA, nous évaluons KA en utilisant DocsQA – un ensemble de données de questions et de réponses de référence sur la documentation Databricks, faisant partie de notre Benchmark d'Intelligence de Domaine. Pour cet ensemble de données, nous avons également un ensemble d'attentes d'experts définies. Pour un petit ensemble de réponses candidates générées par KA, nous créons un retour concis en langage naturel (comme dans l'exemple ci-dessus) basé sur ces attentes et fournissons le retour à KA pour affiner ses réponses. Nous mesurons ensuite la qualité des réponses sur plusieurs cycles de retours pour évaluer si KA s'adapte avec succès pour répondre aux attentes des experts.

Notez que si les réponses de référence reflètent l'exactitude factuelle — si une réponse contient des informations pertinentes et précises pour répondre à la question — elles ne sont pas nécessairement idéales en termes d'alignement avec les attentes des experts. Comme illustré dans notre exemple précédent, la réponse initiale peut être factuellement correcte pour de nombreuses saveurs de SQL, mais peut encore être insuffisante si l'expert s'attend à une réponse spécifique à PostgreSQL.

En considérant ces deux dimensions de correction, nous évaluons la qualité d'une réponse à l'aide de deux juges LLM :

- Complétude de la Réponse : Dans quelle mesure la réponse correspond à la réponse de référence de l'ensemble de données. Cela sert de mesure de base de l'exactitude factuelle.

- Adhésion aux Retours : Dans quelle mesure la réponse satisfait les attentes spécifiques de l'expert. Cela mesure la capacité de l'agent à adapter sa sortie en fonction de critères personnalisés.

Résultats

La Figure 2 montre comment KA améliore sa qualité avec des cycles croissants de retours d'experts sur DocsQA. Nous rapportons les résultats pour un ensemble de test réservé.

- Complétude de la Réponse : Sans retours, KA produit déjà des réponses de haute qualité comparables aux systèmes concurrents leaders. Avec jusqu'à 32 retours, la Complétude de la Réponse de KA s'améliore de 12 points de pourcentage, surpassant clairement les concurrents.

- Adhésion au feedback : La distinction entre Adhésion au feedback et Complétude de la réponse est évidente – tous les systèmes commencent avec de faibles scores d'adhésion sans feedback. Mais c'est là que ALHF excelle : avec le feedback, le score d'adhésion de KA passe de 11,7 % à près de 80 %, démontrant l'impact spectaculaire de ALHF.

Dans l'ensemble, ALHF est un mécanisme efficace pour affiner et adapter le comportement d'un système afin de répondre aux attentes spécifiques des experts. En particulier, il est très efficace en termes d'échantillons : vous n'avez pas besoin de centaines ou de milliers d'exemples, mais vous pouvez constater des gains clairs avec une petite quantité de feedback.

ALHF : le défi technique

Ces résultats impressionnants sont possibles car KA aborde avec succès deux défis techniques principaux de ALHF.

Apprendre quand appliquer le feedback

Lorsqu'un expert donne son avis sur une question, comment l'agent sait-il quelles questions futures bénéficieront de cette même compréhension ? C'est le défi de la portée — déterminer la bonne portée d'applicabilité pour chaque retour d'information. Ou, dit autrement, déterminer la pertinence d'un retour d'information pour une question.

Prenons notre exemple PostgreSQL. Lorsque l'expert dit « la réponse doit être compatible avec PostgreSQL », ce feedback ne devrait pas seulement corriger cette réponse unique. Il devrait éclairer toutes les futures questions liées à SQL. Mais il ne devrait pas affecter les requêtes sans rapport, comme « Dois-je utiliser matplotlib ou seaborn pour ce graphique ? »

Nous adoptons une approche de mémoire d'agent qui enregistre tous les feedbacks antérieurs et permet à l'agent de récupérer efficacement les feedbacks pertinents pour une nouvelle question. Cela permet à l'agent de déterminer dynamiquement et globalement quels insights sont les plus pertinents pour la question actuelle.

Adapter les bons composants du système

Le deuxième défi est l'affectation — déterminer quelles parties du système doivent changer en réponse au feedback. KA n'est pas un modèle unique ; c'est un pipeline multi-composants qui génère des requêtes de recherche, récupère des documents et produit des réponses. Un ALHF efficace nécessite la mise à jour des bons composants de la bonne manière.

KA est conçu avec un ensemble de composants alimentés par LLM qui sont paramétrés par le feedback. Chaque composant est un module qui accepte le feedback pertinent et adapte son comportement en conséquence. En prenant l'exemple précédent, où le SME fournit le feedback suivant sur l'exemple d'extraction de date :

Plus tard, l'utilisateur pose une question connexe — « Comment obtenir la différence entre deux dates en SQL ? ». Sans recevoir de nouveau feedback, KA applique automatiquement ce qu'il a appris de l'interaction précédente. Il commence par modifier la requête de recherche à l'étape de récupération, en l'adaptant au contexte :

Ensuite, il produit une réponse spécifique à PostgreSQL :

En acheminant précisément le feedback vers les composants de récupération et de génération de réponses appropriés, ALHF garantit que l'agent apprend et généralise efficacement à partir du feedback de l'expert.

Ce que ALHF signifie pour vous : À l'intérieur d'Agent Bricks

Agent Learning from Human Feedback (ALHF) représente une avancée majeure pour permettre aux agents IA de comprendre et de s'adapter véritablement aux attentes des experts. En permettant au feedback en langage naturel de façonner progressivement le comportement d'un agent, ALHF fournit un mécanisme flexible, intuitif et puissant pour orienter les systèmes d'IA vers des besoins spécifiques de l'entreprise. Notre étude de cas avec Knowledge Assistant démontre comment ALHF peut améliorer considérablement la qualité des réponses et l'adhésion aux attentes des experts, même avec un minimum de feedback. Comme l'a dit Patrick Vinton, directeur de la technologie chez Analytics8, un client de KA :

« En utilisant Agent Bricks, Analytics8 a obtenu une augmentation de 40 % de la précision des réponses avec des temps d'implémentation 800 % plus rapides pour nos cas d'utilisation, allant de simples assistants RH à des assistants de recherche complexes basés sur des articles techniques et de la documentation multimodaux extrêmement techniques. Après le lancement, nous avons également constaté que la qualité des réponses continue d'augmenter. »

ALHF est désormais une capacité intégrée dans le produit Agent Bricks, permettant aux clients Databricks de déployer des solutions d'IA d'entreprise hautement personnalisées. Nous encourageons tous les clients intéressés par l'exploitation de la puissance de l'IA enseignable à contacter leurs équipes de compte Databricks et à essayer KA et d'autres cas d'utilisation d'Agent Bricks pour explorer comment ALHF peut transformer leurs flux de travail d'IA générative.

Veronica Lyu et Kartik Sreenivasan ont contribué à égalité

Auteurs : Veronica Lyu, Kartik Sreenivasan, Moonsoo Lee, Michael Bendersky, Alkis Polyzotis, Xiangrui Meng, Omar Khattab, Sam Havens, Michael Carbin et Matei Zaharia

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.