Au-delà du provisionnement : le guide du développeur pour la mise à l'échelle automatique de Databricks Lakebase

par Bryan Clark et Susan Pierce

- La mise à l'échelle automatique de Databricks Lakebase élimine le compromis traditionnel entre le sur-provisionnement et le sous-provisionnement en ajustant dynamiquement les unités de compute en fonction de la charge du CPU, de l'utilisation de la mémoire et de la taille de l'ensemble de travail.

- Les développeurs définissent des garde-fous de CU minimum et maximum pour équilibrer les performances et les coûts, la mise à l'échelle se faisant automatiquement et sans redémarrage de la base de données.

- La combinaison de la mise à l'échelle automatique et de la mise à l'échelle à zéro réduit considérablement les dépenses de compute inutilisé, tout en continuant d'offrir des performances instantanées pour les charges de travail d'IA, de développement et en rafale.

Vous n'avez que 2 choix lors du provisionnement des bases de données :

- Surprovisionnement: configurez un compute élevé pour le pire des scénarios et surpayez pour les CPU inactifs.

- Sous-provisionnement: économisez de l'argent maintenant en réglant le compute au plus bas, mais un pic de charge de travail paralysera votre système plus tard

C'est le « paradoxe du provisionnement », et si vous avez déjà géré une base de données de production, vous avez été confronté à ce défi.

Pendant des années, nous avons simplement accepté cela comme le coût d'utilisation des bases de données relationnelles. Mais avec l'introduction de Databricks Lakebase, serverless Postgres intégré à Databricks, la donne a changé. Nous nous sommes éloignés des instances de taille fixe, « toujours actives », pour nous tourner vers un modèle plus intelligent et élastique : la mise à l'échelle automatique.

Dans cet article, nous allons examiner en détail le fonctionnement de la mise à l'échelle automatique de Lakebase, pourquoi elle est une véritable bouée de sauvetage pour les workflows des développeurs modernes, et comment configurer vos garde-fous afin que vous puissiez vous concentrer sur la création de fonctionnalités plutôt que sur la gestion de l'infrastructure.

Qu'est-ce que la mise à l'échelle automatique de Lakebase ?

Lakebase Autoscaling est un modèle de compute intelligent qui garantit que la taille de votre base de données correspond aux besoins immédiats de votre application.

Le dimensionnement correct pour votre base de données est celui dont votre application a besoin. La compute de la base de données doit être réactive, et non statique et limitée à une taille prédéfinie. Avec la mise à l'échelle automatique, vous définissez la plage de ressources que vous souhaitez allouer à la base de données. Le système ajuste ensuite dynamiquement le compute disponible pour votre base de données en fonction de la charge actuelle.

Dans Lakebase, cela est géré via une abstraction appelée compute Units (CUs). La mise à l'échelle automatique utilise une approche granulaire où 1 CU alloue 2 Go de mémoire. Cela permet au système de monter en charge par incréments plus petits et plus précis, vous donnant ainsi un contrôle plus étroit sur les performances et les coûts.

Spéc. | Valeur |

Mémoire par unité de compute | 2 Go |

Plage d'autoscaling maximale | 32 CU |

Écart max de CU (min-max) | 8 CU |

Délai d'inactivité pour monter en charge à l'arrêt | Défini par l'utilisateur (par ex., 15 min) |

Économies estimées (Monter en charge à zéro) | 70 %+ pour les charges de travail en rafale/de développement |

Redémarrage de la base de données requis pour Monter en charge | Non |

La mécanique : comment raisonne l'algorithme de mise à l'échelle

On pourrait facilement croire que la mise à l'échelle automatique ne prend en compte que l'utilisation brute du processeur, mais Lakebase est plus intelligent que ça. Pour garantir que les performances de votre application ne se dégradent pas, l'algorithme de mise à l'échelle automatique surveille trois piliers techniques clés :

1. Charge du CPU

La métrique la plus intuitive. Si votre application commence à exécuter des jointures complexes ou si le volume de query simultanées augmente, le système détecte le pic d'utilisation du processeur et ajoute plus de CU pour garantir que la latence des query reste faible.

2. Utilisation de la mémoire

Les bases de données relationnelles sont notoirement gourmandes en mémoire. Cette métrique surveille la quantité de mémoire que vos processus actifs et vos tampons consomment. En monitoring la mémoire, Lakebase peut monter en charge pour éviter les problèmes de mémoire insuffisante (OOM) avant qu'ils ne fassent planter votre session, garantissant ainsi une disponibilité constante même en cas de forte charge.

3. Taille du jeu de travail

Il s'agit peut-être de la métrique la plus importante au niveau professionnel. L'ensemble de travail est la partie de vos données qui est fréquemment consultée et qui devrait idéalement rester « chaude » dans le cache. Si votre ensemble de travail devient plus grand que la RAM qui vous est allouée, la base de données doit "swapper" des données sur le disque, ce qui est de plusieurs ordres de grandeur plus lent. Lakebase estime la taille de votre ensemble de travail et augmente votre compute pour garantir que vos données "chaudes" restent dans une mémoire à haute vitesse.

L'avantage de cette approche est que tout se passe sans redémarrage. Vos connexions à la base de données restent ouvertes et votre application reste réactive tandis que l'infrastructure sous-jacente s'adapte de manière fluide à votre trafic.

Configuration des garde-fous : CU min. et max.

L'autoscaling ne signifie pas des ressources infinies ou des factures infinies. En tant que développeur, vous avez besoin de contrôler votre plancher de performance et votre plafond de coûts. Pour ce faire, vous définissez une plage de mise à l'échelle.

Définition des limites de mise à l'échelle

Lorsque vous configurez une instance de compute Lakebase, vous définissez deux valeurs principales :

- CU minimum : C'est votre référence de base. Elle garantit que même pendant les périodes de faible trafic, votre base de données dispose de suffisamment de réactivité pour répondre aux tâches administratives ou aux Jobs de fond.

- CU maximum : Il s'agit de votre filet de sécurité budgétaire. Il empêche un processus incontrôlé, un bug de query récursive ou un pic de trafic inattendu de faire grimper vos coûts au-delà de ce que vous avez autorisé.

Remarque importante sur les limites : pour que la mise à l'échelle reste prévisible et très réactive, Lakebase exige que la différence entre votre taille de compute maximale et minimale ne dépasse pas 8 CU (par exemple, une plage de 2 à 10 CU). L'Autoscaling Lakebase prend en charge des plages allant jusqu'à 32 CU. Pour les charges de travail qui nécessitent constamment plus de puissance, des computes de plus grande taille et fixes sont également disponibles.

Scénarios réels : quand la mise à l'échelle automatique l'emporte

1. Charges de travail des agents d'IA et des applications interactives

Si vous créez des applications basées sur l'IA ou des agents autonomes sur Databricks, vos modèles de trafic ne sont presque jamais linéaires. Un agent peut rester inactif pendant des heures, puis déclencher soudainement une chaîne de requêtes massive lors du traitement d'une invite complexe ou de l'ingestion d'un nouveau dataset.

La mise à l'échelle automatique garantit que la base de données gère ces pics d'activité soudains sans que vous ayez à "préchauffer" l'infrastructure. Lorsque l'agent termine sa tâche, la base de données se réduit automatiquement, ce qui protège le budget de votre projet.

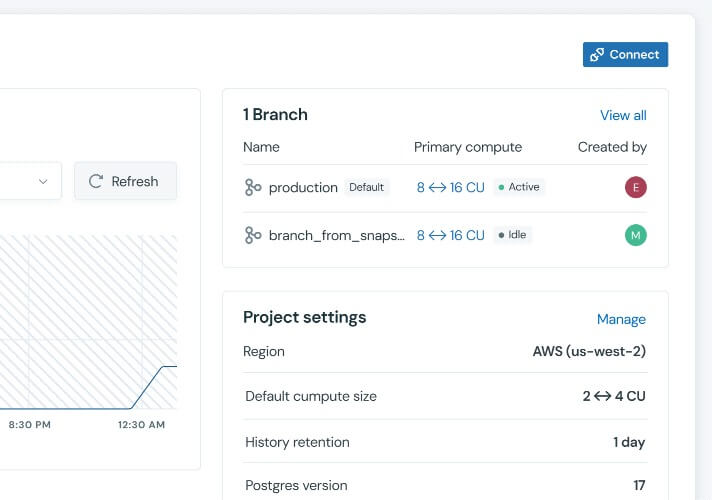

2. Développement, tests et branchement

Les workflows de base de données modernes dans Lakebase impliquent souvent le branchement de bases de données, c'est-à-dire la capacité de créer des environnements isolés en copie sur écriture pour des fonctionnalités ou des PR spécifiques.

La plupart de ces Branch sont inactives 90 % du temps. Avec la mise à l'échelle automatique, ces environnements restent à leur CU minimal lorsqu'ils ne sont pas utilisés. Cependant, dès qu'un pipeline CI/CD start un test d'intégration lourd ou qu'un développeur commence une validation manuelle des données, l'environnement monte en charge instantanément pour fournir des performances de niveau production.

L'avantage de Monter en charge à zéro

L'autoscaling gère les heures d'activité, mais que se passe-t-il lorsque la journée de travail se termine ?

C'est là que Monter en charge à zéro devient l'outil ultime d'optimisation des coûts. Lorsqu'elle est activée en même temps que la mise à l'échelle automatique, Lakebase peut détecter les périodes d'inactivité totale. Après un délai d'attente défini par l'utilisateur, par exemple 15 minutes sans query, l'instance compute est entièrement suspendue.

- Aucun coût de compute : Pendant que l'instance est suspendue, votre facture de compute tombe à zéro.

- Redémarrage instantané : Dès qu'une nouvelle connexion ou query arrive, la base de données reprend instantanément son activité à la taille minimale de mise �à l'échelle automatique que vous avez définie.

Pour les environnements de développement ou les tableaux de bord internes utilisés uniquement pendant les heures de bureau, cette combinaison peut réduire les coûts de compute mensuels de 70 % ou plus.

Pourquoi les développeurs modernes se tournent vers Lakebase

Le passage à l'autoscaling est autant une question de simplicité opérationnelle que d'argent.

- Pas de redimensionnement manuel : Vous n'avez pas à surveiller les tableaux de bord Grafana et à redimensionner manuellement les instances lorsque vous atteignez 80 % d'utilisation du CPU.

- Performances prévisibles : en monitoring le working set et l'utilisation de la mémoire, Lakebase effectue un Monter en charge avant que vos utilisateurs ne remarquent un ralentissement.

- Contrôle granulaire : le modèle à 2 Go par CU permet un réglage beaucoup plus fin que celui des fournisseurs de cloud traditionnels qui vous obligent à doubler la taille de votre instance et votre facture juste pour obtenir un peu plus de RAM.

Conclusion

L'ère du dimensionnement de base de données au jugé est révolue. En tirant parti de la mise à l'échelle automatique de Databricks Lakebase, vous pouvez cesser d'agir en tant qu'administrateur système à temps partiel et commencer à vous concentrer sur ce qui compte : votre code et vos données.

Définissez vos limites, activez Monter en charge à zéro pour vos branches de développement et laissez l'algorithme Lakebase s'occuper du plus gros du travail. Vos utilisateurs et vos parties prenantes vous remercieront.

Prêt à vous lancer ?

Consultez la documentation sur la mise à l'échelle automatique de Lakebase pour apprendre à configurer dès aujourd'hui votre première instance compute à mise à l'échelle automatique.

Foire aux questions (FAQ)

Qu'est-ce que l'autoscaling ? L'autoscaling est un modèle de compute intelligent qui garantit que la taille de votre base de données correspond aux exigences de votre application. Il s'éloigne des instances de taille fixe pour adopter un modèle élastique qui ajuste la puissance de compute disponible pour votre base de données en fonction de la charge actuelle.

Quel est l'objectif principal de la mise à l'échelle automatique ? L'objectif principal est de résoudre le paradoxe du provisionnement où les développeurs devaient traditionnellement choisir entre surpayer pour un CPU inactif ou risquer une défaillance du système lors des pics de charge de travail. Elle permet au compute de la base de données d'être réactif et dimensionné avec précision, plutôt que d'être limité à une taille statique.

Quels sont les avantages de la mise à l'échelle automatique ? Les avantages incluent la simplicité opérationnelle en supprimant le besoin de redimensionnement manuel et des performances prévisibles grâce à un monitoring proactif de la mémoire et des jeux de travail. De plus, le modèle granulaire de 2 Go par CU offre un réglage plus fin des coûts et des performances par rapport aux fournisseurs qui exigent de doubler la taille des instances pour obtenir plus de RAM.

Comment l'autoscaling gère-t-il la capacité de manière dynamique ? La capacité est gérée via une abstraction granulaire appelée Unités de calcul (Compute Units), où une unité alloue 2 Go de mémoire. Le système ajoute ou supprime ces unités sans nécessiter de redémarrage de la base de données, garantissant que les connexions restent ouvertes pendant que l'infrastructure sous-jacente s'adapte.

Comment l'autoscaling améliore-t-il le Monter en charge du cloud ? L'autoscaling améliore la scalabilité en permettant aux bases de données de gérer des pics d'activité soudains sans nécessiter de préchauffage manuel. Cette élasticité garantit que l'infrastructure peut monter en charge pour des performances de niveau production lors de tâches lourdes et redescendre automatiquement en charge pour protéger les budgets une fois ces tâches terminées.

Quelles métriques Lakebase Autoscaling surveille-t-il ? L'algorithme surveille trois piliers techniques clés : la charge du processeur pour maintenir une faible latence des query, l'utilisation de la mémoire pour éviter les problèmes de mémoire insuffisante, et la taille de l'ensemble de travail pour garantir que les données fréquemment consultées restent dans le cache.

Qu'est-ce qu'une Compute Unit (CU) dans Lakebase ? Une Compute Unit est une abstraction granulaire de Ressources utilisée dans Lakebase pour définir la plage de mise à l'échelle. Chaque unité fournit exactement 2 Go de mémoire.

Quelle est la plage de CU maximale prise en charge par l'Autoscaling Lakebase ? L'Autoscaling Lakebase prend en charge des plages allant jusqu'à un maximum de 32 CU. Au sein de cette plage, le système exige que l'écart entre le minimum et le maximum de CU définis par l'utilisateur ne dépasse pas 8 CU.

Comment fonctionne Monter en charge à zéro dans Lakebase ? Monter en charge à zéro détecte les périodes d'inactivité totale et suspend entièrement l'instance compute après un délai d'attente défini par l'utilisateur. Une fois qu'une nouvelle connexion ou query arrive, la base de données redémarre à la taille minimale de Monter en charge automatique définie.

Quelle est la différence entre l'autoscaling et le scale to zero dans Lakebase ? L'autoscaling gère les heures actives en ajustant le compute dans une plage définie pour répondre aux fluctuations de la demande. Le scale to zero gère les périodes d'inactivité en suspendant complètement l'instance pour supprimer les coûts de compute en l'absence de query.

Puis-je utiliser l'Autoscaling de Lakebase avec le branchement de base de données ? Monter en charge est très avantageux pour le branchement de base de données, car il permet à des environnements isolés pour les fonctionnalités de rester à un minimum de CU lorsqu'ils sont inactifs. Ces environnements branchés montent ensuite en charge pour fournir des performances de niveau production chaque fois qu'un développeur commence la validation ou qu'un pipeline CI/CD exécute des tests.

La mise à l'échelle automatique nécessite-t-elle un redémarrage de la base de données ? Non. Les connexions à votre base de données restent actives et ouvertes pendant que Lakebase met à l'échelle les ressources sous-jacentes de manière fluide.

Quel est le ratio RAM/CU dans Lakebase ? Chaque unité compute (CU) fournit exactement 2 Go de mémoire.

Combien puis-je économiser avec Monter en charge à zéro ? Pour les charges de travail qui ne sont actives qu'à certains moments de la journée, comme les Branch de développement ou les tableaux de bord internes, les utilisateurs constatent souvent une réduction des coûts de compute de 70 % ou plus.

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.