Qu'est-ce que le flux de données ?

Déplacement et transformation des données de la source vers la destination via des pipelines de flux continus, des flux de travail par lots, le traitement d'événements en temps réel et l'ETL orchestré

- Les modèles incluent l'extraction, la transformation et le chargement (ETL) pour le traitement par lots, l'extraction, le chargement et la transformation (ELT) exploitant la puissance de calcul du système cible, les architectures de flux pour le traitement continu et les architectures Lambda combinant traitement par lots et en temps réel.

- L'orchestration gère les dépendances entre les tâches, planifie leur exécution, gère les erreurs, permet le traitement parallèle, fournit des tableaux de bord de supervision et maintient l'état des systèmes distribués, coordonnant ainsi des flux de travail complexes à plusieurs étapes.

- Les techniques d'optimisation comprennent le traitement incrémental évitant le recalcul complet, le partitionnement pour le parallélisme, la mise en cache des résultats intermédiaires, la réduction des déplacements de données grâce à la fonction « predicate pushdown » et l'allocation adaptative des ressources en fonction des caractéristiques de la charge de travail.

Qu'est-ce qu'un flux de données ?

Le flux de données décrit la circulation des données d'un processus ou d'un composant à l'autre dans l'architecture d'un système. Il représente la façon dont les données sont acquises, traitées, stockées et livrées dans un système informatique, une application ou un réseau. Le flux de données influence directement l'efficacité, la fiabilité et la sécurité d'un système informatique : il est donc crucial qu'un système soit configuré de façon à optimiser les données en sortie.

Plusieurs composants clés définissent la circulation et le traitement des données au sein d'un système de flux :

- Source des données. Un flux de données a pour point de départ l'importation de données provenant d'une source qui peut contenir des données structurées et non structurées, des sources scriptées ou des informations fournies par des clients. Ces sources sont à l'origine du flux de données et ce sont elles qui mettent le système de circulation en mouvement.

- Transformation des données. Une fois les données importées dans le système, les données peuvent être transformées et converties dans une structure ou un format exploitable à des fins d'analyse ou de data science. La transformation des données suit des règles qui définissent la façon dont les données doivent être manipulées et modifiées dans un système. Elle veille ainsi à ce que le format des données soit adapté aux processus et aux utilisations métier auxquelles elles sont destinées.

- Stockage des données. Une fois les données importées et transformées, elles parviennent à leur destination : le stockage. C'est l'emplacement final du système de données : les données peuvent y être utilisées sans être transférées à un autre point du flux. Cet emplacement peut être une base de données, un lakehouse ou des fichiers de rapport ou de log, et il enregistre les données à des fins d'audit ou d'analyse.

- Parcours de flux de données. Les schémas de flux de données définissent les parcours ou les canaux empruntés par les données entre les sources, les processus et les destinations. Ces parcours peuvent être des connexions réseau physiques ou des parcours logiques (des appels API par exemple). Ils sont associés à des protocoles et des canaux qui assurent la sécurité et l'efficacité de la transmission des données.

Exemples de flux de données

Selon l'approche choisie par votre organisation pour son pipeline de donn�ées, le flux de données peut prendre différents aspects. Le processus ETL (extraire, transformer et charger) organise, prépare et centralise les données issues de plusieurs sources pour les mettre à la disposition des activités d'analyse, de rapport et de prise de décision opérationnelle. En gérant le flux des données depuis le système source jusqu'à la base de données ou le data warehouse de destination, l'ETL assure l'intégration et la cohérence des données, deux facteurs essentiels pour générer des insights fiables et soutenir les stratégies data-driven.

- Analytique en temps réel. Ce flux de données peut traiter une infinité d'enregistrements en provenance de la source d'origine et prendre en charge un afflux continu de données. Les utilisateurs disposent ainsi d'analyses et d'insights instantanés, ce qui peut être utile pour les applications qui exigent des réponses rapides comme la supervision, le suivi, les recommandations et tout type d'action automatisée.

- Pipeline de données opérationnelles. Les pipelines de données opérationnelles sont conçus pour traiter les données transactionnelles et opérationnelles essentielles aux fonctions quotidiennes d'une organisation. Ces pipelines capturent les données de différentes sources – interactions client, transactions financières, mouvements de stock et relevés de capteurs – puis les traitent, les actualisent et les mettent à disposition des systèmes en quasi-temps réel ou avec une latence minime. Les pipelines de données opérationnelles assurent la synchronisation des applications et des bases de données, indispensable au bon fonctionnement des opérations métier. Grâce à cette synchronisation, les données sont dans leur état le plus récent dans tous les systèmes.

- Traitement par batch. Dans un flux de données, le traitement par batch désigne la manipulation de grandes quantités de données intervenant selon des intervalles planifiés ou une fois qu'un volume suffisant a été collecté. Contrairement au traitement en temps réel, le traitement par batch n'a pas besoin de résultats instantanés. Il privilégie l'efficacité, l'évolutivité et la précision en agrégeant les données avant de les traiter. Le traitement par batch est souvent employé pour des tâches de rapport, d'analyse historique et de transformation à grande échelle, dans les situations où il n'est pas crucial d'extraire des insights immédiatement.

Outils et technologies des flux de données

Le workflow ETL est un type courant de flux de données. Dans le cas de l'ETL, les données sont importées depuis les systèmes sources dans un espace intermédiaire, transformées en fonction de différentes exigences (qualité des données, élimination des doublons dans les enregistrements, signalement des données manquantes) puis écrites dans un système de destination, généralement un data warehouse ou un data lake.

Pour votre organisation, des systèmes d'ETL robustes peuvent optimiser l'architecture de données afin d'en améliorer le throughput, la latence, le coût et l'efficacité opérationnelle. Cette approche vous donne accès à des données à jour et de qualité pour orienter la prise de décision.

Face à la quantité massive et à la grande diversité des données stratégiques produites au quotidien, vous devez impérativement comprendre votre flux de données pour un data engineering performant. Si beaucoup d'entreprises doivent choisir entre batch et temps réel pour le traitement de leurs données, Databricks propose une API pour chacune de ces approches. Des outils comme les Delta Live Tables aident les utilisateurs à optimiser les coûts à une extrémité du flux et le throughput ou la latence à l'autre extrémité, en facilitant l'alternance entre les modes de traitement. Les utilisateurs ont ainsi la possibilité de pérenniser leurs solutions en préparant le passage au streaming en cas d'évolution des besoins métier.

Le guide pratique de l'IA agentique pour l'entreprise

Créer des schémas de flux de données

Les organisations peuvent illustrer la circulation des données dans leurs systèmes en créant un schéma de flux de données (data flow diagram, DFD). Cette représentation graphique décrit la façon dont les informations sont collectées, traitées, stockées et utilisées en détaillant leur parcours dans les différentes parties du système. Le DFD que vous devez élaborer dépend de la complexité de votre architecture de données : il peut s'agit d'une simple vue d'ensemble du flux de données, ou d'un schéma multiniveau plus approfondi décrivant les manipulations subies par les données à différentes étapes de leur cycle de vie.

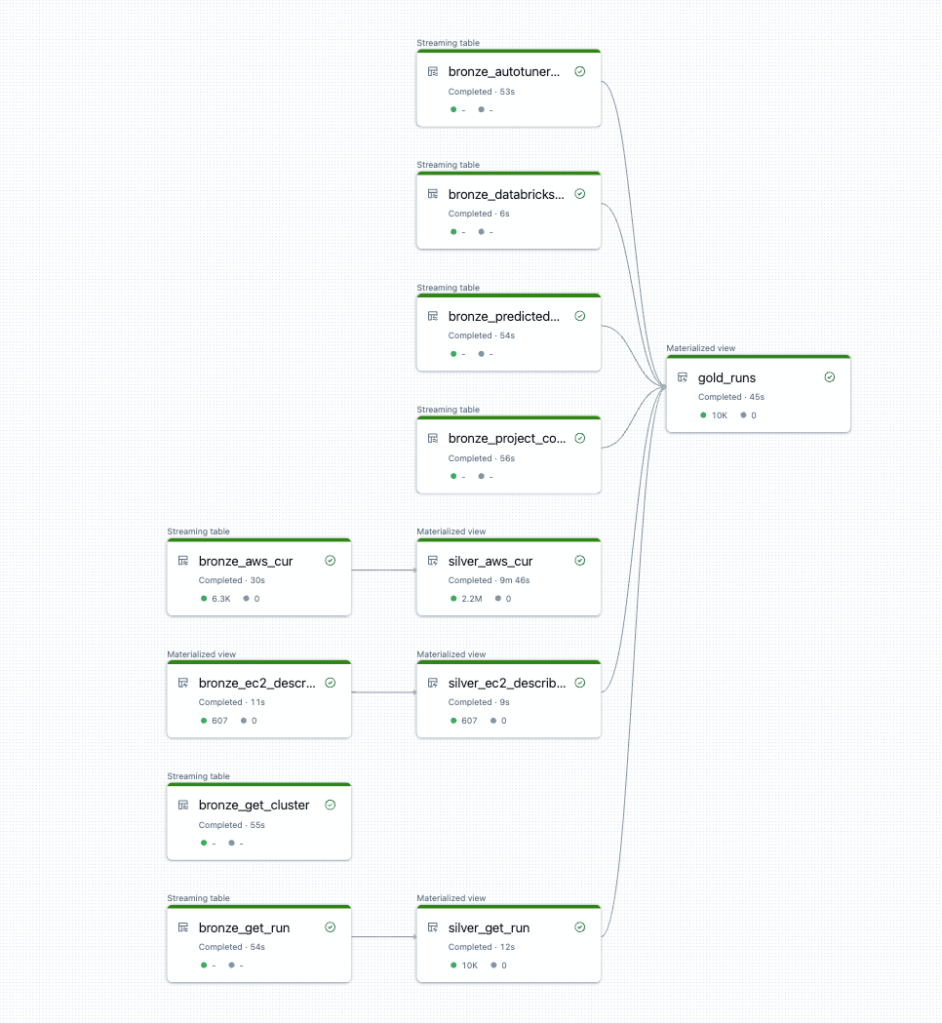

Les DFD ont évolué au fil du temps. Aujourd'hui, les Delta Live Tables utilisent des graphes orientés acycliques (DAG) pour représenter la séquence des transformations et des dépendances entre les différentes tables et vues d'un pipeline. Chaque transformation ou table est un nœud, et les frontières entre les nœuds définissent le flux des données et les dépendances. Les opérations sont ainsi exécutées dans le bon ordre, en suivant une boucle directionnelle fermée.

Les DAG offrent une représentation visuelle claire qui permet de comprendre les relations entre les tâches, mais aussi d'identifier et traiter les erreurs et les échecs au sein du système de flux. Les Delta Live Tables veillent à la gestion efficace du DAG en planifiant et en optimisant des opérations telles que le chargement des données, les transformations et les mises à jour, afin d'assurer leur cohérence et leur performance.

Bonnes pratiques de gestion des flux de données

Un ensemble de bonnes pratiques permet de garantir l'optimisation, l'efficacité et la sécurité de votre flux de données :

- Optimisez le processus de données. Cela consiste à simplifier le flux de données afin d'éliminer les goulets d'étranglement, de réduire les redondances et de faciliter le traitement en temps réel. En examinant et en affinant régulièrement les workflows, on veillera à ce que les données circulent dans le système sans complexité inutile, afin de réduire la consommation de ressources et de faciliter leur exploitation à grande échelle.

- Fluidifiez la circulation des informations. Pour que l'information puisse circuler librement, il faut impérativement minimiser la formation de silos et faire de l'interopérabilité entre les systèmes une priorité. En mettant en place des pipelines ETL rigoureux, les organisations profiteront des avantages offerts par des données cohérentes dans un large éventail d'applications, de services et d'usages. Elles pourront également créer des processus fiables de sauvegarde et de récupération pour se protéger contre les pannes et les coupures.

- Considérations de sécurité. Naturellement, la sécurité des données au sein du flux reste primordiale. Toutes les données, en particulier s'il s'agit d'informations sensibles ou personnellement identifiables, doivent être chiffrées en transit et au repos. On pensera également à limiter l'accès aux données pour réduire le risque d'exposition non autorisée, et à mener régulièrement des audits de sécurité et des évaluations de vulnérabilités pour identifier les points faibles potentiels, afin de sécuriser proactivement le flux de données de bout en bout.

- Supervision des performances. Les outils d'analyse permettent de suivre des métriques telles que la latence, la vitesse de transfert des données et les taux d'erreur, et donc d'identifier les points du flux de données qui accusent des retards ou présentent des problèmes. En configurant des alertes automatisées et des tableaux de bord, les équipes seront immédiatement informées de la moindre anomalie et pourront donc la résoudre dans les meilleurs délais en minimisant les perturbations. Des bilans de performance réguliers offriront également de précieux insights pour garantir la robustesse, la sécurité et l'efficacité du processus de gestion.

L'intérêt d'un flux de données efficace

L'efficacité de votre flux de données peut exercer une influence tangible sur le résultat de votre organisation. En optimisant et en accélérant la circulation des données entre les systèmes et les services de l'organisation, vous allez unifier les workflows, améliorer la productivité et réduire le temps nécessaire au traitement de l'information.

Pour savoir comment Databricks peut vous aider à mettre en place un flux de données optimal, consultez nos architectures lakehouse de référence. Nous vous recommandons également d'explorer notre architecture en médaillon, un modèle de conception qui permet d'organiser les données de façon logique dans un lakehouse.

Si vous souhaitez savoir comment utiliser les Delta Live Tables pour préparer votre organisation à traiter aussi bien des données en batch qu'en streaming, contactez un représentant Databricks.

Un flux de données efficace est un avantage stratégique qui peut aider votre organisation à prendre des décisions éclairées en réponse aux défis opérationnels et aux attentes des clients. Avoir un accès immédiat aux données vous permet d'agir en temps réel sur la base des informations les plus récentes. Et en prenant appui sur des flux de données efficaces, vous pouvez avoir pleinement confiance dans la cohérence et la fiabilité des informations.

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.