하둡과의 관계를 다시 평가해야 할 시점

작성자: Manveer Sahota , 아난드 베누고팔

지난 한 해 동안 기업들이 원격 분산 근무 환경에 적응해야만 하면서 클라우드 도입은 전례 없는 속도로 14% 이상 가속화되었으며, 이는 2020년 팬데믹 이전 예측보다 2%, 즉 130억 달러 높은 수치입니다. 향후 몇 년 안에 6,000억 달러 이상이 온프레미스에서 클라우드로 마이그레이션될 가능성이 있습니다. 이러한 클라우드로의 전환은 혁신을 촉진하고 기업의 디지털 전환 전략을 실현하기 위한 차세대 데이터 및 분석 플랫폼의 중요성을 더욱 부각시키고 있습니다. 그러나 많은 조직이 여전히 기존 Hadoop 환경의 복잡성, 확장 불가능한 인프라, 과도한 유지 관리 오버헤드로 인해 어려움을 겪고 있으며, 결국 데이터의 가치를 희생하고 경쟁 우위를 잃을 위험에 처하게 됩니다. 이러한 과제를 해결하고 데이터에 숨겨진 더 많은 기회를 발굴하기 위해, 조직들은 Databricks Lakehouse Platform과 같은 개방적이고 단순하며 협업적인 클라우드 기반 데이터 및 분석 플랫폼으로 전환하고 있습니다. 이 블로그에서는 조직이 최신 클라우드 기반 솔루션을 탐색하도록 이끄는 과제와 차세대 데이터 기반 혁신을 촉발하는 데 있어 레이크하우스 아키텍처가 수행하는 역할에 대해 알아봅니다.

Hadoop의 지켜지지 않은 약속

Hadoop의 분산 파일 시스템(HDFS)은 출시 당시 획기적인 기술이었으며 데이터 역사의 전당에 상징으로 남을 것입니다. 이 기술의 출현으로 조직은 더 이상 관계형 데이터베이스의 한계에 얽매이지 않게 되었으며, 이는 최신 빅데이터 스토리지와 궁극적으로 클라우드 데이터 레이크의 탄생으로 이어졌습니다. 2015년에 이르기까지 모든 영광과 찬사에도 불구하고, Hadoop은 모든 데이터 유형, 특히 엔터프라이즈 규모에서 진화하는 잠재력을 지원하는 데 어려움을 겪었습니다. 궁극적으로 데이터 환경과 그에 따른 비즈니스 요구 사항이 진화함에 따라 Hadoop은 약속을 계속 이행하는 데 어려움을 겪었습니다. 그 결과 기업들은 클라우드 기반 대안을 모색하기 시작했으며 Hadoop에서 클라우드로의 마이그레이션 비율은 계속 증가하고 있습니다.

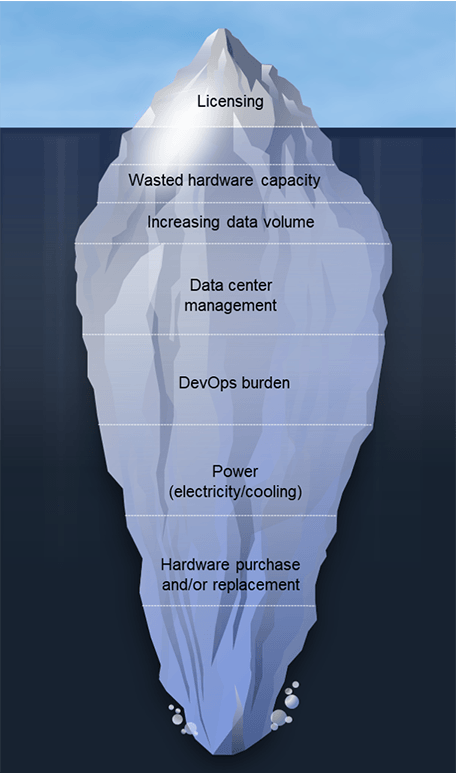

팀들은 다양한 이유로 Hadoop에서 마이그레이션하며, 이는 종종 '푸시'와 '풀' 요인의 조합입니다. 기존 Hadoop 시스템의 한계와 높은 라이선스 및 관리 비용으로 인해 팀은 대안을 모색하고 있습니다. 또한 최신 클라우드 데이터 아키텍처가 제공하는 새로운 가능성에 이끌리기도 합니다. 아키텍처 요구 사항은 조직마다 다르지만, 고객이 작별을 고할 때가 되었다고 깨닫게 하는 몇 가지 공통적인 요인이 있습니다. 다음과 같습니다.

- 낭비되는 하드웨어 용량: 온프레미스 구현에서는 피크 타임 수요에 맞춰 확장할 수 있도록 용량을 초과하여 확보하는 것이 당연시됩니다. 하지만 그 결과 용량의 상당 부분이 유휴 상태로 남아 운영 및 유지보수 비용을 계속 증가시킬 뿐입니다.

- 확장 비용의 빠른 증가: 온프레미스 Hadoop 환경에서는 스토리지와 compute를 분리할 수 없으므로 데이터 세트가 커짐에 따라 비용이 증가합니다. COVID-19 팬데믹으로 인한 급속한 디지털화와 전 세계적인 성장률을 고려해 보세요. 연구에 따르면 전 세계에서 생성, 캡처, 복사, 소비되는 총 데이터 양은 2020년부터 2024년까지 149제타바이트로 152.5% 증가할 것으로 전망됩니다. 초고속 데이터 성장 시대에는 걷잡을 수 없는 비용이 급격히 불어날 수 있습니다.

- DevOps 부담: 당사 고객의 경험에 따르면 노드 100개당 4~8명의 정규직 직원이 필요하다고 가정할 수 있습니다.

- 전력 비용 증가: 소비량 및 냉각을 기준으로 서버당 연간 최대 800달러를 지불해야 할 수 있습니다. 이는 100개 노드 하둡 클러스터의 경우 연간 8만 달러에 해당합니다!

- 신규 및 교체 하드웨어 비용: 이는 TCO의 약 20%를 차지하며 하둡 클러스터 관리 비용과 같습니다.

- 소프트웨어 버전 업그레이드: 이러한 업그레이드는 지원 계약을 유지하기 위해 의무화되는 경우가 많으며, 해당 프로젝트는 한 번에 몇 달이 걸리고 새로운 기능은 거의 제공하지 않으면서 데이터 팀의 소중한 리소스를 차지합니다.

위에 언급된 모든 문제 외에도 Hadoop의 장기적인 존속 가능성에 대한 실질적인 우려가 있습니다. 2019년, 세계는 하둡 분야의 대대적인 붕괴를 목격했습니다. Google에서 2004년에 발표한 중대한 MapReduce 관련 논문은 Apache Hadoop의 제작을 뒷받침하��는 역할을 하였고, 그러면서 MapReduce 사용을 전면 중단하게 되었습니다(Google의 기술 인프라 사업부 선임 부사장(SVP) Urs Hölzle의 트윗 참조). 또한 하둡과 관련해 몇 차례 세간의 이목을 집중시킨 합병과 인수 건도 있었습니다. 또한 지난 2020년에는 하둡의 대표적인 제공업체에서 자사 제품을 하둡 중심에서 벗어나 다른 방향을 지향하기로 했는데, 이는 이제 하둡은 "기술이라기보다 하나의 철학에 가깝기 때문"이라고 밝혔습니다. 마지막으로, 지난 2021년 4월에는 Apache Software Foundation에서 하둡 에코시스템에서 열 개 프로젝트를 사용 중단한다고 발표했습니다. 이렇게 우려되는 상황이 많아진 데다 디지털화가 점점 절실해지면서 수많은 기업이 Hadoop과의 관계를 다시 생각해보게 되었습니다.

레이크하우스 아키텍처로의 전환

lakehouse 아키텍처는 데이터 기반 조직에 이상적인 데이터 아키텍처입니다. 데이터 웨어하우스와 데이터 레이크의 최고 장점을 결합하여 모든 데이터 워크로드를 위한 단일 고성��능 솔루션을 제공합니다. 레이크하우스 아키텍처는 스트리밍 데이터 분석에서 BI, Data Science, AI에 이르기까지 다양한 사용 사례를 지원합니다. 고객들이 Databricks Lakehouse Platform을 선호하는 이유는 무엇일까요?

- 간단하기 때문입니다. 모든 데이터, 분석 및 AI를

하나의 플랫폼에 - 오픈되어 있습니다. 개방형 표준 및 형식으로 데이터 생태계를 통합하세요.

- 협업적입니다. 데이터 팀이 함께 모든 데이터 및 AI 워크플로에서 협업

레이크하우스 아키텍처는 기업의 클라우드 도입을 '견인하는' 레거시 Hadoop 환경에 비해 상당한 이점을 제공할 수 있습니다. 여기에는 클라우드 내에서 Hadoop을 사용해 보았지만 기대하거나 원했던 만큼의 결과를 얻지 못한 고객도 포함됩니다. Scribd의 엔지니어링 디렉터인 R. Tyler Croy는 다음과 같이 설명합니다. “Databricks는 대부분의 기존 Apache Spark™ 워크로드에서 30%–50%의 최적화를 주장했습니다. 호기심에 Databricks의 가격과 잠재적인 Spark 작업 최적화를 고려하여 비용 모델을 리팩토링했습니다. 수치를 조정한 후, 17%의 최적화율만으로도 Databricks가 Amazon Web Services(AWS) 인프라 비용을 크게 절감하여 Databricks 플랫폼 자체 비용을 충당할 수 있다는 사실을 발견했습니다. 초기 평가 후, 저는 이미 Databricks가 제공할 기능과 개발자 속도 향상에 매료되었습니다. 모델에서 수치를 계산해 본 결과, Databricks를 도입하지 않을 수 없다는 것을 깨달았습니다!”

Scribd뿐만이 아닙니다. Hadoop에서 Databricks Lakehouse Platform으로 마이그레이션한 다른 고객은 다음과 같습니다.

- H&M 은 70개 이상의 시장에 있는 5,000개 이상의 매장에서 매일 수백만 명의 고객으로부터 발생하는 대규모 데이터를 처리합니다. Hadoop 기반 아키텍처는 데이터 관련 과제를 야기했습니다. 확장하는 데 리소스가 많이 들고 비용이 많이 들었으며, 데이터 보안 문제를 야기했고, 다양한 사일로화된 데이터 소스로부터의 데이터 사이언스 활동을 지원하기 위한 운영 확장에 어려움을 겪었으며, 상당한 DevOps 지연으로 인해 시장 출시 시간이 늦어졌습니다. 아이디어 구상에서 프로덕션 배포까지 1년이 걸렸습니다. Databricks를 통해 H&M은 운영 비용 70% 절감, 팀 간 협업 개선, 더 빠른 인사이트 확보 시간을 통한 비즈니스 영향력 증대 등 향상된 운영 효율성의 이점을 누리고 있습니다.

- Viacom18은 테라바이트 규모의 일일 시청자 데이터를 처리하여 프로그램 최적화 온프레미스 하둡 데이터 레이크는 SLA 내에서 90일 분의 구간 데이터를 처리할 수 없어 비즈니스 요구 사항을 제공하는 능력이 제한 Databricks를 사용함으로써 데이터 볼륨이 증가했음에도 불구하고 쿼리 시간을 단축하고 DevOps를 줄여 비용을 크게 절감할 수 있었습니다. ETL, 분석, ML을 대규모로 지원하는 완전 관리형 플랫폼으로 팀 생산성을 26% 향상

- Reckitt Benckiser Group(RB) 은 500,000개 매장의 수요 예측 복잡성으로 인해 어려움을 겪었습니다. 250개 파이프라인에서 매일 2TB 이상의 데이터를 처리 레거시 Hadoop 인프라는 복잡하고 번거로우며 확장에 비용이 많이 들고 성능에도 어려움이 있는 것으로 입증되었습니다. Databricks를 통해 RB는 비즈니스 볼륨을 지원하기 위한 10배 더 많은 용량, 80TB에서 2TB로 98% 데이터 압축을 통한 운영 비용 절감, 연중무휴 24시간 작업에 대한 2배 더 빠른 데이터 파이프라인 성능을 실현했습니다.

Hadoop은 클라우드 환경에서 실행되도록 구축되지 않았습니다. 클라우드 기반 Hadoop 서비스가 온프레미스 서비스에 비해 점진적인 개선을 이루었지만, 둘 다 lakehouse 아키텍처에 비하면 여전히 뒤처집니다. 두 Hadoop 인스턴스 모두 성능과 생산성이 낮고 비용이 높으며, 대규모로 더 정교한 데이터 사용 사례를 처리하지 못합니다.

데이터, 분석 및 AI 기반 성장의 미래 경쟁력 확보

클라우드 마이그레이션 결정은 비즈니스 결정입니다. 이는 기업들이 현재 시스템의 제공 현실을 냉정하게 살펴보고 단기 및 장기 목표를 위해 무엇을 달성해야 하는지 평가하도록 합니다. AI 투자가 계속해서 추진력을 얻음에 따라 데이터, 분석 및 기술 리더는 '이것으로 우리가 목표하는 바를 이룰 수 있을까?'라는 질문을 던지며 기존 Hadoop 아키텍처를 뛰어넘는 사고를 하는 데 중요한 역할을 해야 합니다.

목표가 명확해지면 기술 매핑, 클라우드 리소스 활용 및 비용 대비 성능 평가, 오류와 위험을 최소화하는 마이그레이션 프로젝트 구성과 같은 중요한 기술적 세부 사항이 뒤따릅니다. 하지만 가장 중요한 것은 Hadoop과의 관계를 재평가할 때가 되었다는 데이터 기반의 확신을 갖는 것입니다. Hadoop 마이그레이션이 데이터 사용 사례 전반에 걸쳐 비즈니스 성과를 가속화하는 방법을 자세히 알아보세요.

1. 출처: Gartner Market Databook, Goldman Sachs Global Investment Research

(이 글은 AI�의 도움을 받아 번역되었습니다. 원문이 궁금하시다면 여기를 클릭해 주세요)

최신 게시물을 이메일로 받아보세요

블로그를 구독하고 최신 게시물을 이메일로 받아보세요.