Databricks의 공급업체 분석을 위한 SAP 및 Salesforce 데이터 통합

SAP Business Data Cloud Connect와 Lakeflow Connect를 사용하여 공급업체 분석을 위해 CRM 및 ERP 데이터를 통합하세요.

작성자: 크리슈나 사티아바라푸

- Databricks에서 SAP S/4HANA 및 Salesforce 데이터를 직접 연결

- Lakeflow Connect 및 SAP BDC를 사용하여 증분식 제로 카피 액세스

- 분석 및 대화형 인사이트를 위한 거버넌스가 적용된 골드 레이어 구축

Databricks에서 Salesforce SAP 통합을 통해 공급업체 분석을 구축하는 방법

공급업체 데이터는 조달 및 공급망 관리 에서 재무 및 분석에 이르기까지 조직의 거의 모든 부분에 영향을 미칩니다. 하지만 서로 통신하지 않는 여러 시스템에 분산되어 있는 경우가 많습니다. 예를 들어 Salesforce는 공급업체 프로필, 연락처, 계정 세부 정보를 보유하고 SAP S/4HANA는 송장, 결제, 총계정원장 항목을 관리합니다. 이러한 시스템은 독립적으로 운영되기 때문에 팀은 공급업체 관계에 대한 포괄적인 시야를 갖지 못합니다. 그 결과 조정이 느려지고, 레코드가 중복되며, 지출을 최적화할 기회를 놓치게 됩니다.

Databricks는 하나의 거버넌스가 적용되는 데이터 & AI 플랫폼에서 두 시스템을 모두 연결하여 이 문제를 해결합니다. 데이터 수집을 위해 Lakeflow Connect for Salesforce 및 SAP Business Data 클라우드(BDC) Connect를 사용하면 팀에서 중복 없이 CRM 및 ERP 데이터를 통합할 수 있습니다. 그 결과 조달 및 재무 사용 사례는 물론 분석까지 지원하는 공급업체, 결제, 성과 지표에 대한 신뢰할 수 있는 단일 뷰가 생성됩니다.

이 사용법에서는 두 데이터 소스를 연결하고, 혼합 파이프라인을 구축하고, AI/BI 대시보드 및 Genie를 통해 분석 및 대화형 인사이트를 ��지원하는 골드 레이어를 만드는 방법을 알아봅니다.

제로 카피(Zero-Copy) SAP Salesforce 데이터 통합이 효과적인 이유

대부분의 기업은 기존 ETL 또는 타사 도구를 통해 SAP와 Salesforce를 연결하려고 합니다. 이러한 방법은 여러 데이터 사본을 생성하고 지연 시간을 발생시키며 거버넌스를 어렵게 만듭니다. Databricks는 다른 접근 방식을 취합니다.

제로 카피 SAP 액세스: Databricks용 SAP BDC Connector 는 Delta Sharing을 통해 SAP S/4HANA 데이터 제품에 대한 거버넌스가 적용된 실시간 액세스를 제공합니다. 내보내기 또는 중복 없음.

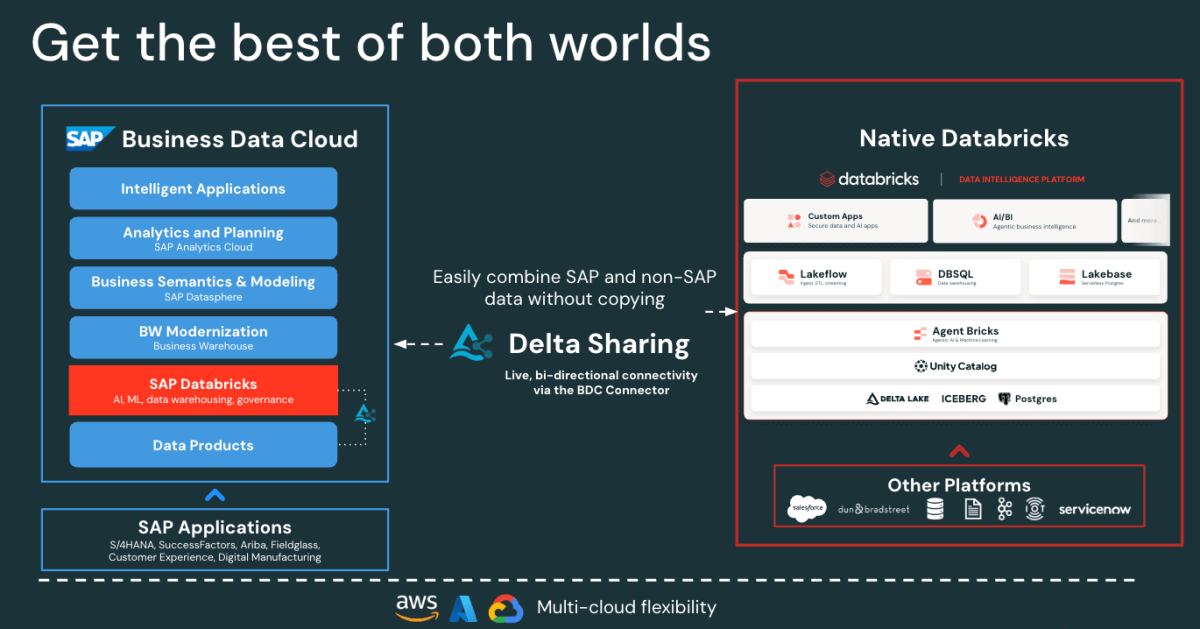

Figure: SAP BDC Connector to Native Databricks(Bi-directional) - 빠른 Salesforce 증분 수집: Lakeflow는 Salesforce 데이터를 지속적으로 연결하고 수집하여 데이터 세트를 최신 상태로 일관성 있게 유지합니다.

- 통합 거버넌스: Unity Catalog 는 SAP와 Salesforce 소스 모두에 걸쳐 권한, 리니지, 감사를 적용합니다.

- 선언적 파이프라인: Lakeflow Spark Declarative Pipelines는 더 나은 성능을 위한 자동 최적화를 통해 ETL 설계 및 오케스트레이션을 단순화합니다.

이러한 기능을 통해 데이터 엔지니어는 엔터프라이즈급 거버넌스를 유지하면서 복잡성을 줄이고 하나의 플랫폼에서 SAP 및 Salesforce 데이터를 통합할 수 있습니다.

Databricks 기반의 SAP Salesforce 데이터 통합 아키텍처

파이프라인을 구축하기 전에 Databricks에서 이러한 구성 요소가 어떻게 함께 작동하는지 이해하는 것이 유용합니다.

개괄적으로, SAP S/4HANA는 큐레이션된 비즈니스용 SAP 관리형 데이터 제품으로 비즈니스 데이터를 SAP Business Data Cloud(BDC)에 게시합니다. SAP BDC Connect for Databricks 는 Delta Sharing을 사용하여 해당 데이터 제품에 대한 안전한 제로 카피 액세스를 지원합니다. 한편, Lakeflow Connect는 증분 파이프라인을 통해 계정, 연락처, 기회 데이터를 캡처하여 Salesforce 수집을 처리합니다.

SAP 또는 Salesforce에서 들어오는 모든 데이터는 거버넌스, 리니지 및 권한을 위해 Unity Catalog에서 관리됩니다. 그런 다음 데이터 엔지니어는 Lakeflow 선언적 파이프라인 을 사용하여 이러한 데이터 세트를 조인하고 변환하여 메달리온 아키텍처(브론즈, 실버, 골드 레이어)로 만듭니다. 마지막으로, 골드 레이어는 AI/BI 대시보드 및 Genie에서 분석과 탐색을 위한 기반 역할을 합니다.

이 아키텍처는 복제나 외부 ETL 도구의 오버헤드 없이 두 시스템의 데이터가 동기화되고, 거버넌스가 적용되며, 분석 및 AI에 바로 사용할 수 있도록 보장합니다.

통�합 공급업체 분석 구축 방법

다음 단계에서는 Databricks에서 SAP 및 Salesforce 데이터를 연결, 혼합, 분석하는 방법을 간략하게 설명합니다.

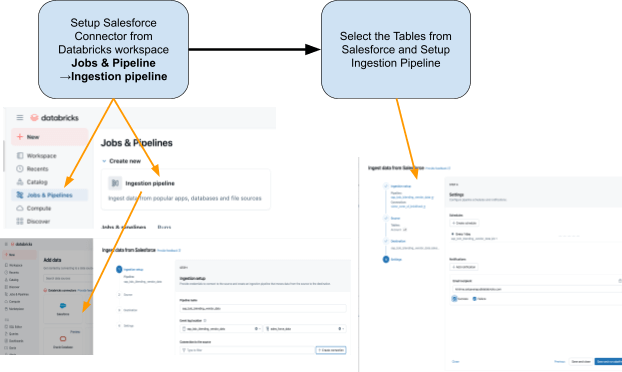

1단계: Lakeflow Connect를 사용한 Salesforce 데이터 수집

Lakeflow Connect 를 사용하여 Salesforce 데이터를 Databricks로 가져오세요. UI 또는 API를 통해 파이프라인을 구성할 수 있습니다. 이러한 파이프라인은 증분 업데이트를 자동으로 관리하여 수동으로 refresh할 필요 없이 데이터를 최신 상태로 유지합니다.

이 커넥터는 Unity Catalog 거버넌스, ETL을 위한 Lakeflow Spark Declarative Pipelines, 오케스트레이션을 위한 Lakeflow Jobs와 완벽하게 통합됩니다.

다음은 Salesforce에서 수집할 예정인 테이블입니다.

- 계정: 공급업체/공급자 세부 정보(포함된 필드: AccountId, Name, 산업, Type, BillingAddress)

- 연락처: 공급업체 연락처(포함된 필드: ContactId, AccountId, FirstName, LastName, Email)

2단계: SAP BDC 커넥터를 사용하여 SAP S/4HANA 데이터에 액세스하기

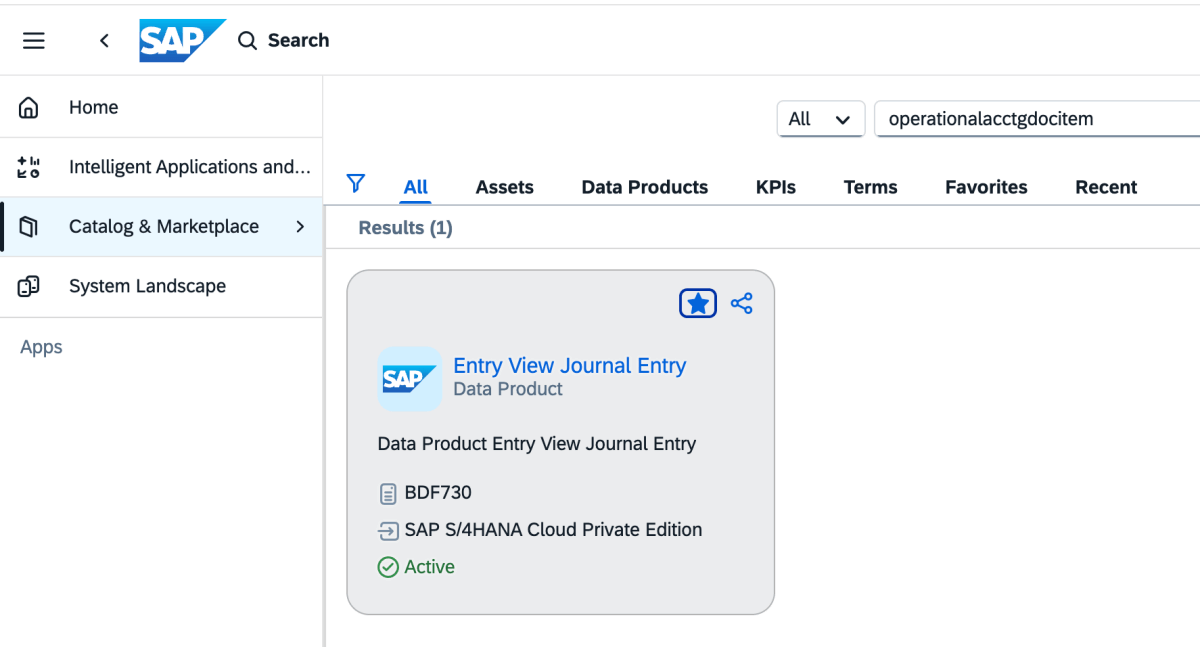

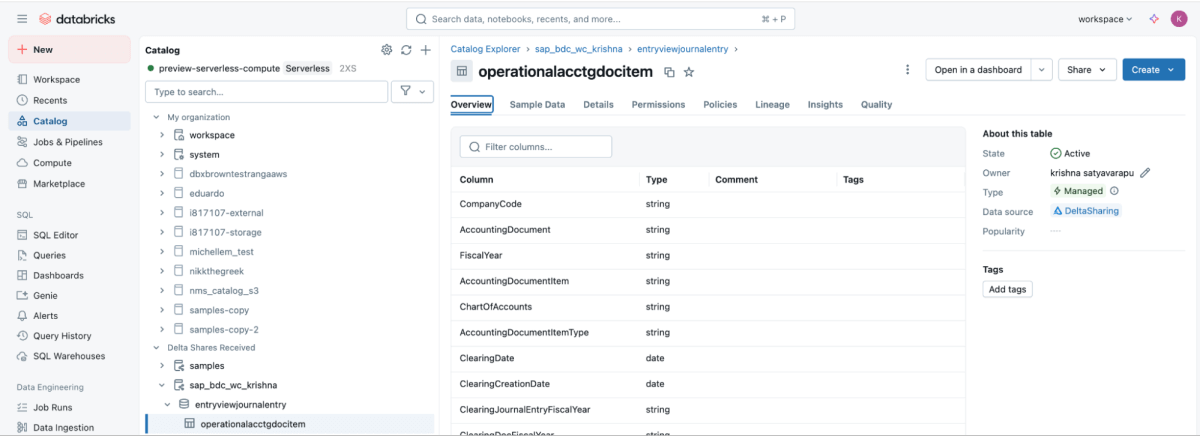

SAP BDC Connect 는 SAP BDC 데이터 제품인 sap_bdc_working_capital.entryviewjournalentry.operationalacctgdocitem( Universal Journal 라인아이템 뷰)를 활용하여 기존의 ETL을 제거하고 Databricks에서 직접 SAP S/4HANA 공급업체 결제 데이터에 대한 실시간 거버넌스 액세스를 제공합니다.

이 BDC 데이터 제품은 ACDOCA 의 SAP S/4HANA CDS 뷰 I_JournalEntryItem(운영 회계 문서 항목)에 직접 매핑됩니다.

ECC 컨텍스트의 경우 가장 가까운 물리적 구조는 BKPF의 헤더가 있는 BSEG(FI 라인 항목), COEP의 CO 전기, 그리고 BSIK/BSAK(공급업체) 및 BSID/BSAD(고객)의 미결/정산 인덱스였습니다. SAP S/4HANA에서 이러한 BS** 객체는 단순화된 데이터 모델의 일부이며, 공급업체 및 G/L 라인 항목을 Universal Journal(ACDOCA)에 중앙 집중화하여 여러 개의 개별 재무 테이블을 조인해야 했던 ECC 접근 방식을 대체합니다.

다음은 SAP BDC 콕핏에서 수행해야 하는 단계입니다.

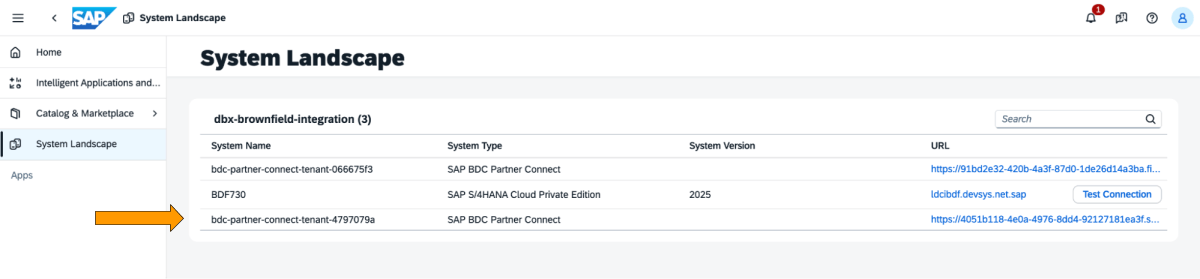

1: SAP BDC cockpit에 로그인하여 System Landscape에서 SAP BDC formation을 확인하세요. SAP BDC delta sharing 커넥터를 통해 Native Databricks에 연결하세요. Native Databricks를 SAP BDC에 연결하여 해당 구성의 일부로 만드는 방법에 대한 자세한 정보는

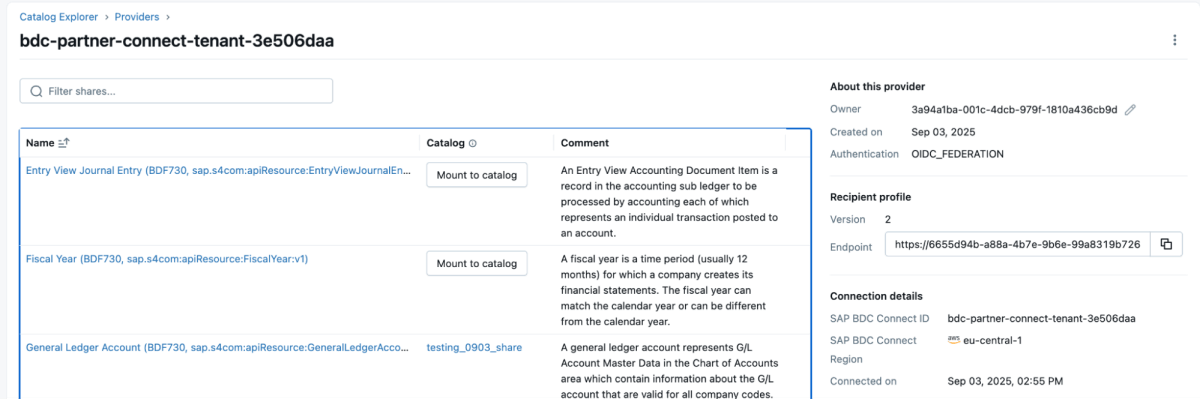

2: 카탈로그로 이동하여 아래 그림과 같이 'Data Product Entry View Journal Entry'를 찾으세요.

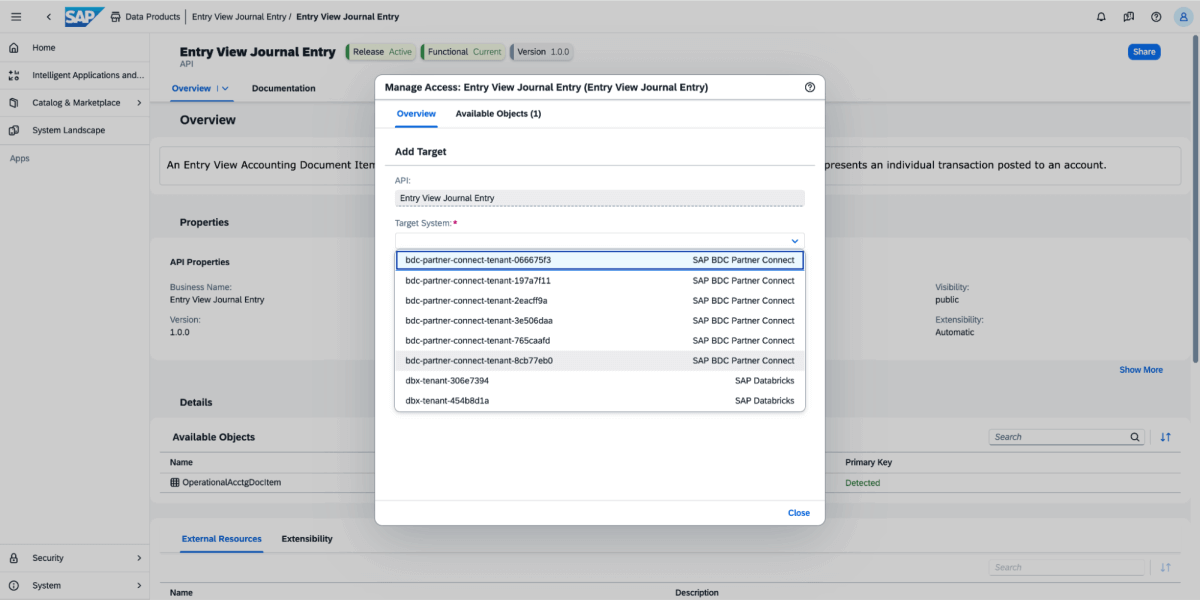

3: 데이터 제품에서 '공유'를 선택한 다음, 아래 이미지와 같이 대상 시스템을 선택합니다.

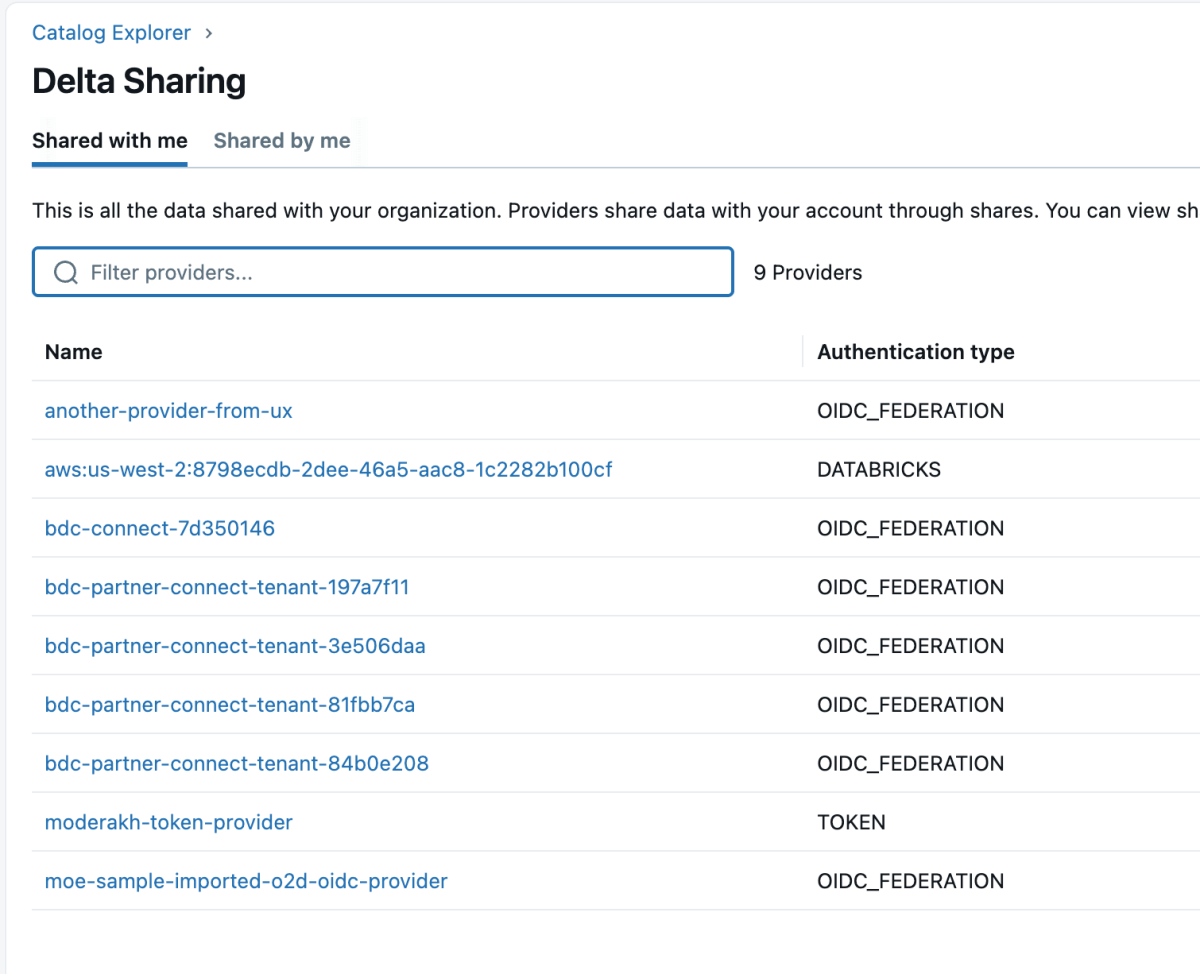

4: 데이터 제품이 공유되면 아래 그림과 같이 Databricks 워크스페이스에 델타 공유로 표시됩니다. 이러한 공급자를 보려면 “공급자 사용” 액세스 권한이 있는지 확인하세요.

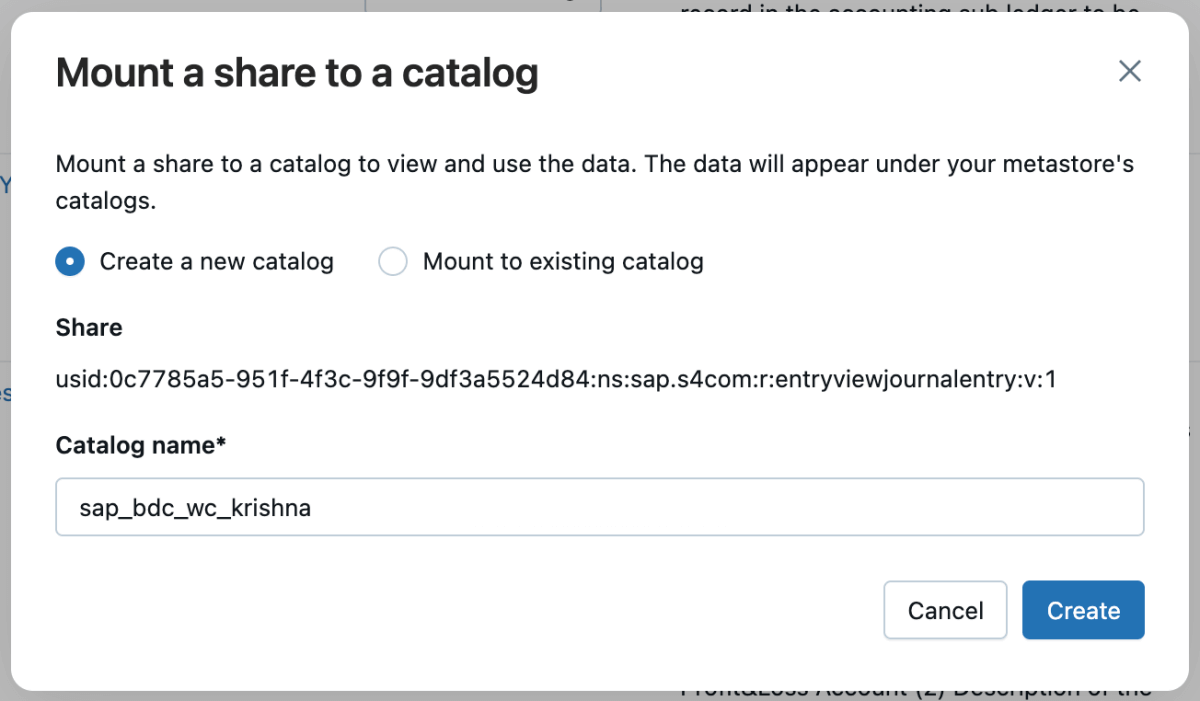

5: 그런 다음 해당 공유를 카탈로그에 마운트하여 새 카탈로그를 만들거나 기존 카탈로그에 마운트할 수 있습니다.

6: 공유가 마운트되면 카탈로그에 반영됩니다.

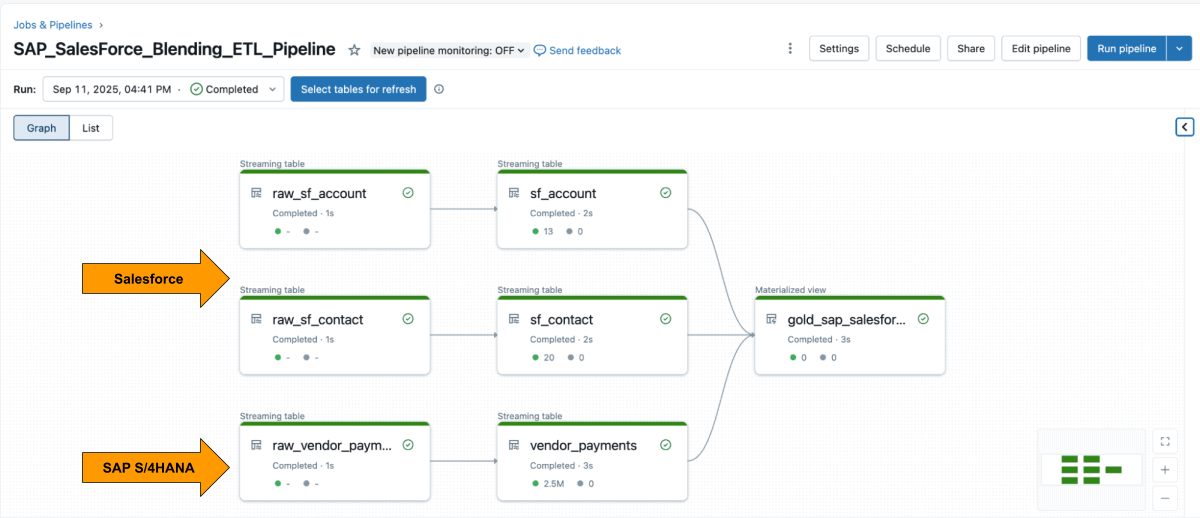

3단계: Lakeflow 선언적 파이프라인을 사용하여 Databricks에서 ETL 파이프라인 블렌딩하기

두 소스를 모두 사용할 수 있으므로 Lakeflow 선언적 파이프라인 을 사용하여 Salesforce 및 SAP 데이터로 ETL 파이프라인을 구축하세요.

Salesforce Account 테이블에는 일반적으로 SAP의 공급업체 ID와 일치하는 SAP_ExternalVendorId__c 필드가 포함됩니다. 이것이 실버 레이어의 기본 조인 키가 됩니다.

Lakeflow Spark Declarative Pipelines를 사용하면 SQL로 변환 로직을 정의할 수 있으며, Databricks는 자동으로 최적화를 처리하고 파이프라인을 오케스트레이션합니다.

예시: 선별된 비즈니스 수준 테이블 구축

이 쿼리는 SAP의 공급업체 결제 기록과 Salesforce의 공급업체 세부 정보를 통합하여 분석 및 보고에 사용할 수 있는 큐레이팅된 비즈니스 수준의 구체화된 뷰 를 생성합니다.

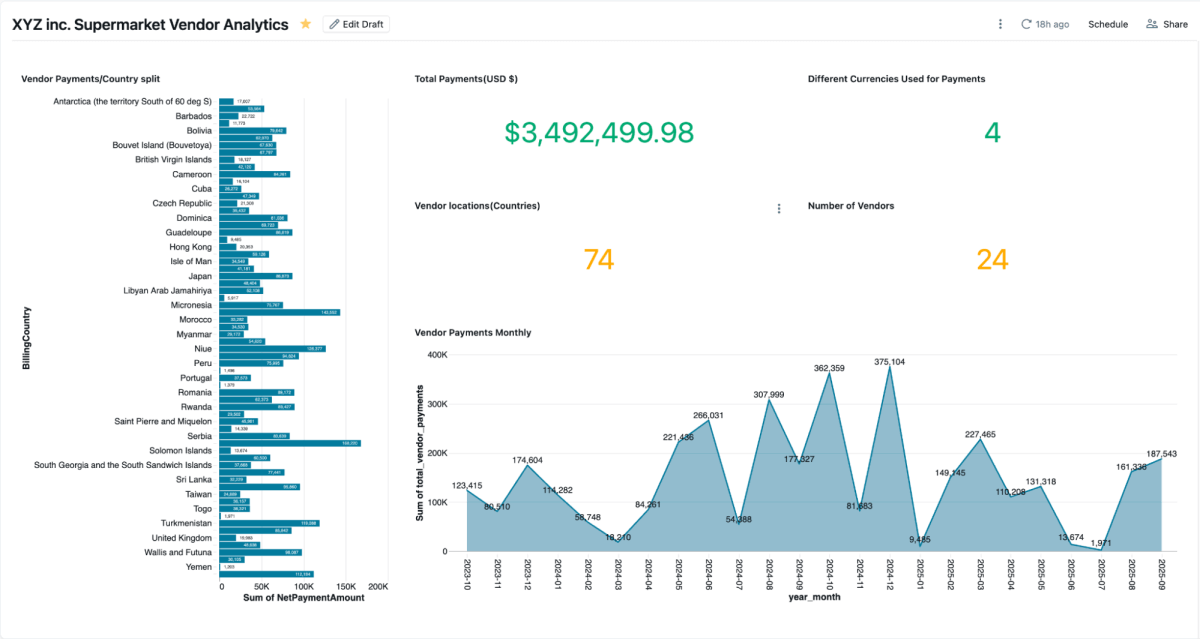

4단계: AI/BI 대시보드 및 Genie로 분석

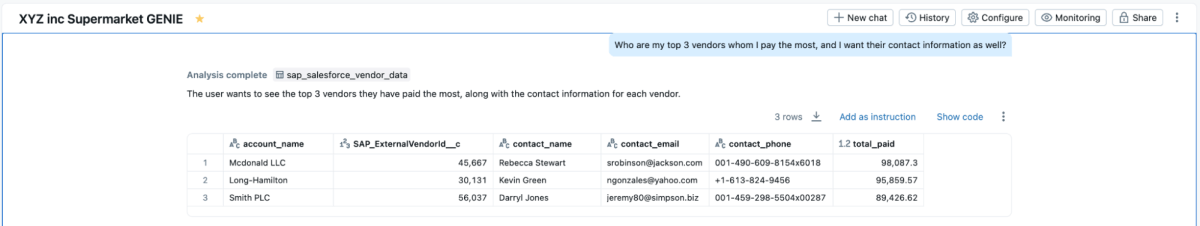

구체화된 뷰가 생성되면 AI/BI 대시보드 에서 직접 탐색하여 팀에서 공급업체 결제, 미지급 잔액, 지역별 지출을 시각화할 수 있습니다. 이는 Unity Catalog의 거버넌스 하에 동적 필터링, 검색, 협업을 지원합니다. Genie 를 사용하면 동일한 데이터를 자연어로 탐색할 수 있습니다.

이 혼합된 데이터에 Genie 스페이스를 생성하고 질문을 할 수 있습니다. 이는 데이터가 Salesforce와 SAP에 사일로화되어 있었다면 불가능했을 일입니다.

- “가장 많이 지불하는 상위 3개 공급업체는 누구이며, 연락처 정보도 알려주세요.”

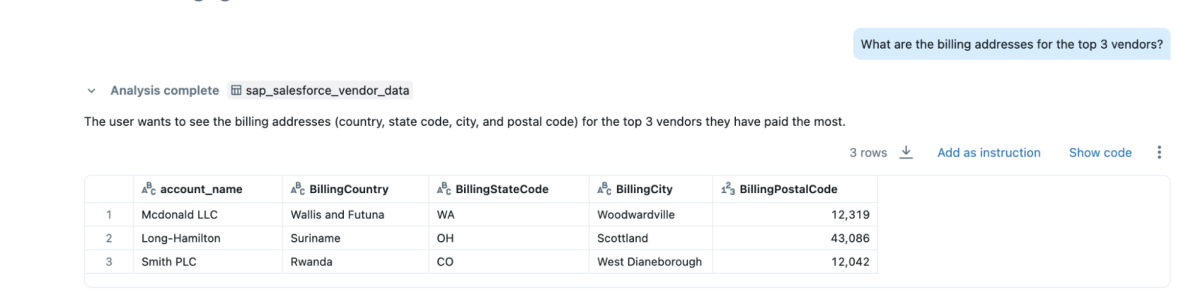

- “상위 3개 공급업체의 청구 주소는 무엇인가요?”

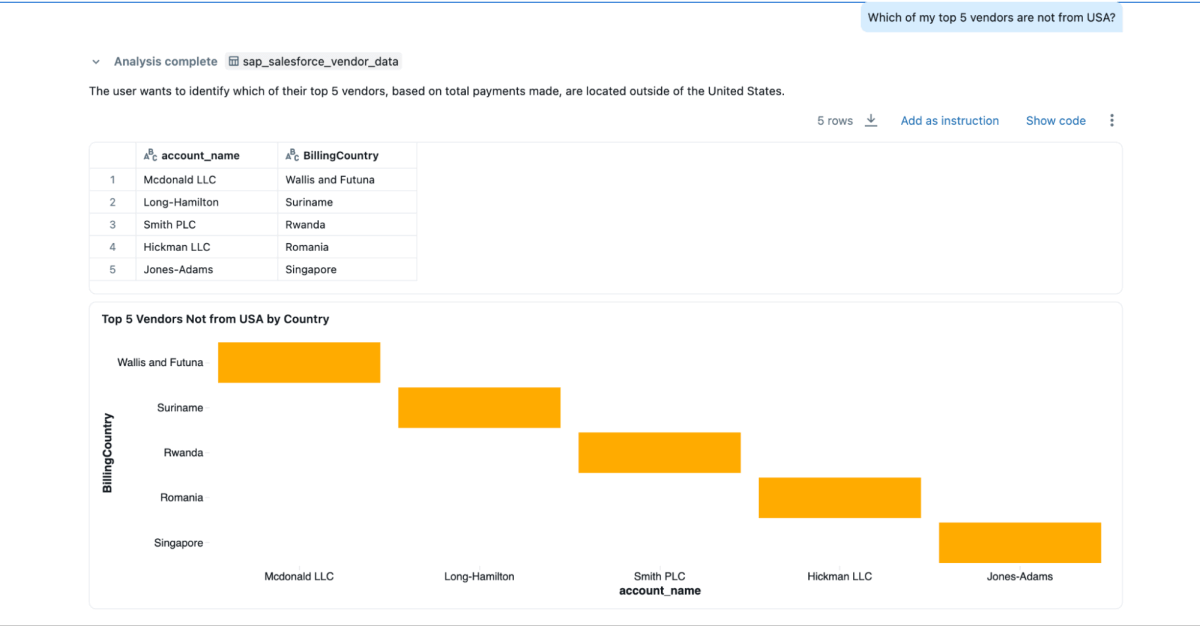

- "상위 5개 공급업체 중 미국에 속하지 않은 업체는 어디인가요?"

비즈니스 성과

Databricks에서 SAP와 Salesforce 데이터를 결합함으로써 조직은 공급업체 성과, 결제 및 관계에 대한 완전하고 신뢰할 수 있는 뷰를 확보할 수 있습니다. 이 통합된 접근 방식은 운영 및 전략적 이점을 모두 제공합니다.

- 더 빠른 분쟁 해결: 팀은 결제 세부 정보와 공급업체 연락처 정보를 나란히 볼 수 있으므로 문제를 조사하고 신속하게 해결하기가 더 쉬워집니다.

- 조기 결제 절감액: 결제 조건, 정산일, 순 금액을 한곳에서 관리하므로 재무팀은 조기 결제 할인 기회를 쉽게 파악할 수 있습니다.

- 더 깨끗한 공급업체 마스터:

SAP_ExternalVendorId__c필드에서 조인하면 중복되거나 일치하지 않는 공급업체 레코드를 식별하고 해결하는 데 도움이 되며, 이를 통해 시스템 전반에 걸쳐 정확하고 일관된 공급업체 데이터를 유지할 수 있습니다. - 감사 지원 거버넌스: Unity Catalog는 일관된 리니지, 권한 및 감사를 통해 모든 데이터가 관리되도록 보장하므로 분석, AI 모델 및 보고서가 동일한 신뢰할 수 있는 소스를 사용하게 됩니다.

이러한 결과를 종합하면 조직이 엔터프라이즈 시스템에 필요한 거버넌스와 보안을 유지하면서 공급업체 관리를 간소화하고 재무 효율성을 개선하는 데 도움이 됩니다.

결론:

SAP와 Salesforce 전반에서 공급업체 데이터를 통합한다고 해서 파이프라인을 재구축하거나 중복 시스템을 관리해야 한다는 의미는 아닙니다.

Databricks를 사용하면 팀은 ERP 및 CRM 데이터를 실시간으로 원활하게 통합하는 단일의 거버넌스가 적용된 기반에서 작업할 수 있습니다. 제로 카피 SAP BDC 액세스, 증분 방식의 Salesforce 수집, 통합 거버넌스, 그리고 선언적 파이프라인 의 조합은 통합 오버헤드를 인사이트로 대체합니다.

결과는 더 빠른 보고 그 이상입니다. 이는 구매 결정�을 개선하고, 공급업체 관계를 강화하며, 측정 가능한 비용 절감을 실현하는 공급업체 성과에 대한 연결된 뷰를 제공합니다. 그리고 이는 Databricks Data Intelligence Platform에 구축되었기 때문에, 결제 및 인보이스에 데이터를 제공하는 동일한 SAP 데이터로 신뢰할 수 있는 단일 소스에서 대시보드, AI 모델, 대화형 분석까지 모두 구동할 수 있습니다.

SAP 데이터는 종종 기업 운영의 중추 역할을 합니다. SAP Business Data Cloud, Delta Sharing, 및 Unity Catalog 를 통합함으로써 조직은 이 아키텍처를 공급업체 분석을 넘어 운전 자본 최적화, 재고 관리, 수요 예측까지 확장할 수 있습니다.

이 접근 방식은 SAP 데이터를 기록 시스템에서 인텔리전스 시스템으로 전환하며, 이 시스템에서는 모든 데이터 세트가 실시간으로 거버넌스가 적용되어 비즈니스 전반에서 즉시 사용할 수 있습니다.

(이 글은 AI의 도움을 받아 번역되었습니다. 원문이 궁금하시다면 여기를 클릭해 주세요)

최신 게시물을 이메일로 받아보세요

블로그를 구독하고 최신 게시물을 이메일로 받아보세요.