Protection contre l'exfiltration de données avec la plateforme Databricks Lakehouse sur AWS

Découvrez comment configurer une architecture Databricks sécurisée sur AWS pour vous protéger contre l'exfiltration de données

Bien que ce guide contienne des détails techniques précieux spécifiques au cloud, nous recommandons désormais notre Approche unifiée pour la protection contre l’exfiltration de données sur Databricks, qui fournit un cadre complet sur AWS, Azure et GCP avec des contrôles prioritaires et des conseils de mise en œuvre.

La Databricks Lakehouse Platform fournit un ensemble unifié d’outils pour construire, déployer, partager et maintenir des solutions de données de niveau entreprise à grande échelle. Databricks s’intègre au stockage cloud et à la sécurité de votre compte cloud, et gère et déploie l’infrastructure cloud en votre nom.

L’objectif principal de cet article est d’atténuer les risques suivants :

- Accès aux données depuis un navigateur sur Internet ou un réseau non autorisé à l’aide de l’application Web Databricks.

- Accès aux données depuis un client sur Internet ou un réseau non autorisé à l’aide de l’API Databricks.

- Accès aux données depuis un client sur Internet ou un réseau non autorisé à l’aide du stockage cloud (S3).

- Une charge de travail compromise sur le cluster Databricks écrivant des données vers une ressource de stockage non autorisée sur AWS ou sur Internet.

Protection des données en transit et au repos avec les outils natifs AWS dans Databricks

Databricks prend en charge plusieurs outils et services natifs AWS qui aident à protéger les données en transit et au repos.

Groupes de sécurité

Les groupes de sécurité sont des pare-feu virtuels avec état attachés aux instances EC2. Ils vous permettent de définir le trafic entrant et sortant autorisé. Le rétrécissement des règles de sortie (sortant) restreint l’envoi de données par les instances EC2 vers des adresses IP non autorisées ou Internet, bloquant ainsi efficacement les fuites de données involontaires.

- Empêche : Les connexions sortantes non autorisées à partir des ressources de calcul Databricks.

Stratégies de point de terminaison VPC

Les stratégies de point de terminaison VPC contrôlent l’accès aux services AWS via les points de terminaison VPC. En autorisant uniquement les opérations requises sur des ressources AWS spécifiques (comme les buckets S3), vous pouvez empêcher les espaces de travail Databricks d’exfiltrer des données vers d’autres comptes ou services AWS.

- Empêche : Databricks d’envoyer des données vers des services ou ressources AWS non autorisés.

Points de terminaison VPC

Les points de terminaison VPC établissent des connexions privées entre votre VPC et d’autres services AWS sans traverser Internet. Cela garantit que les données sensibles ne sont jamais exposées aux réseaux externes, atténuant ainsi les risques d’exfiltration de données via les routes Internet.

- Empêche : L’exposition du trafic à Internet lors de la communication de service.

- Documentation : Points de terminaison VPC AWS

Rôles IAM

Les rôles IAM vous permettent de contrôler quelles ressources AWS Databricks peut accéder et quelles actions il peut effectuer. Une utilisation prudente des stratégies de confiance et d’autorisation garantit que les utilisateurs et les clusters Databricks ne peuvent interagir qu’avec des ressources explicitement autorisées, bloquant l’utilisation de buckets S3 ou de services externes non autorisés.

- Empêche : Les écritures de données vers des ressources AWS non autorisées à l’aide d’identifiants compromis ou trop permissifs.

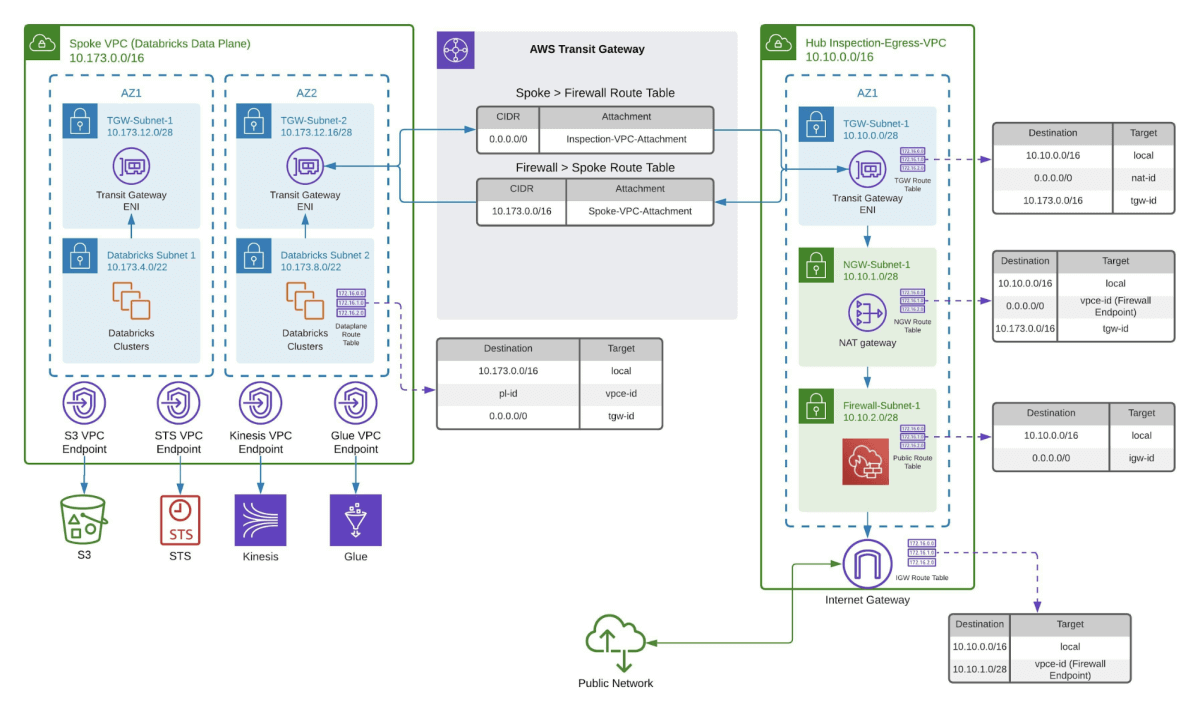

Tables de routage

Les tables de routage déterminent le flux du trafic réseau au sein de votre VPC. En empêchant les routes sortantes vers Internet (ou en n’autorisant que les destinations nécessaires), vous contrôlez où les données peuvent voyager, réduisant ainsi le risque que les données soient acheminées vers des emplacements non sécurisés.

- Empêche : Les chemins réseau vers Internet ou les réseaux non autorisés.

AWS PrivateLink

AWS PrivateLink permet une connectivité privée entre les VPC et les services AWS via des interfaces réseau cryptées et dédiées, éliminant l’exposition à Internet. Cela fournit un chemin sécurisé pour les plans de contrôle et de données de Databricks, rendant plus difficile la fuite de données en dehors d’AWS.

- Empêche : L’interception ou l’exfiltration de données sur les réseaux publics.

Sous-réseaux privés

Les sous-réseaux privés n’ont pas de route directe vers Internet, ce qui signifie que les ressources internes ne peuvent pas initier de connexions sortantes vers Internet. Cette barrière architecturale empêche les clusters et les nœuds d’envoyer directement des données en dehors d’AWS.

- Empêche : Toute communication Internet sortante à partir des ressources de calcul.

Clés KMS

AWS Key Management Service (KMS) vous permet de chiffrer les données au repos, y compris dans les buckets S3. Même si les données sont accessibles, elles restent protégées à moins que l’attaquant n’ait également accès aux clés de chiffrement.

- Empêche : L’exfiltration utilisable de données sans compromettre le matériel de clé.

Stratégies de bucket S3

Ces stratégies de ressources accordent ou refusent l’accès à des buckets S3 spécifiques. En limitant l’accès uniquement à partir de sources approuvées (telles que le VPC Databricks ou des rôles IAM spécifiques), elles garantissent que même si quelqu’un tente une exfiltration, il ne peut pas écrire ou copier de données sensibles en dehors des buckets contrôlés.

- Empêche : Les écritures/lectures à partir d’emplacements S3 indésirables.

Chacun de ces contrôles, individuellement et collectivement, applique une approche de défense en profondeur contre l’exfiltration de données, garantissant plusieurs points de contrôle avant que les données ne puissent quitter votre environnement protégé.

Le chiffrement est une autre composante importante de la protection des données. Databricks prend en charge plusieurs options de chiffrement, notamment les clés de chiffrement gérées par le client, la rotation des clés, le chiffrement au repos et en transit. Les clés de chiffrement gérées par Databricks sont utilisées par défaut et activées dès la sortie de la boîte ; les clients peuvent également apporter leurs propres clés de chiffrement.

Journalisation d’audit

La journalisation d’audit est une capacité fondamentale de sécurité et de conformité, permettant aux organisations de suivre l’activité des utilisateurs, les actions administratives et les événements système dans l’environnement Databricks. Dans le contexte de l’exfiltration de données, les journaux d’audit jouent un rôle essentiel en permettant la détection, l’enquête et la réponse aux menaces potentielles ou aux comportements inappropriés.

Les journaux d’audit aident à répondre à des questions fondamentales telles que :

- Qui a accédé à quelles données et quand ?

- Quelles opérations (lecture, écriture, modification, suppression) ont été effectuées ?

- Y a-t-il eu des tentatives d’accès ou d’exportation de données sensibles en dehors des stratégies ?

En suivant ces événements, les journaux d’audit prennent en charge la surveillance de la sécurité et la génération de rapports de conformité.

Capacités de journalisation d’audit de Databricks

Databricks fournit des fonctionnalités robustes de journalisation d’audit aux niveaux de l’espace de travail et du compte. Les principales capacités comprennent :

- Journaux d’audit au niveau de l’espace de travail : capturent les actions des utilisateurs et du système au sein d’un espace de travail Databricks.

- Journaux d’audit au niveau du compte : suivent les actions sur tous les espaces de travail du compte.

- Journaux d’audit détaillés : capture d’événements optionnelle et plus granulaire pour une visibilité accrue.

- Intégration avec les tables système Unity Catalog : affichent les journaux d’accès, de calcul, de requête, de service et de stockage dans le cadre des flux de gouvernance des données et d’investigation.

Les journaux d’audit peuvent être livrés à un bucket Amazon S3 désigné par le client en temps quasi réel. Ils peuvent être intégrés directement aux systèmes d’analyse de sécurité ou SIEM pour une surveillance et des alertes continues.

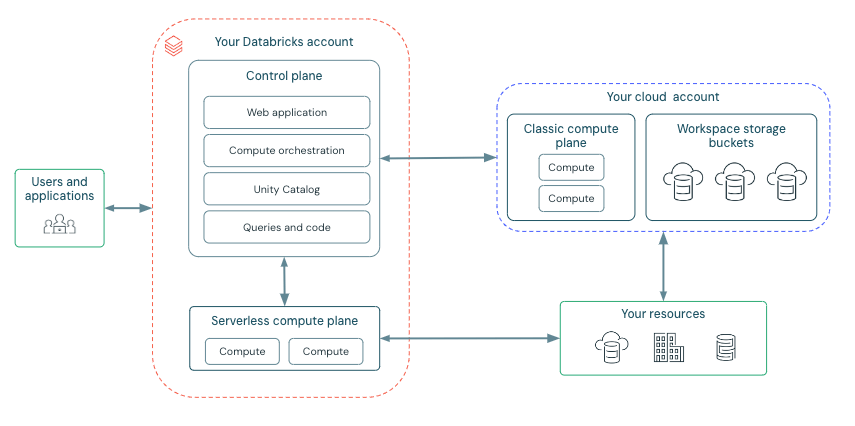

Architecture Databricks

Avant de commencer, jetons un coup d’œil rapide à l’architecture de déploiement Databricks ici :

Databricks est structuré pour permettre une collaboration interfonctionnelle sécurisée tout en gardant une quantité significative de services backend gérés par Databricks afin que vous puissiez vous concentrer sur vos tâches de science des données, d’analyse de données et d’ingénierie des données.

Databricks fonctionne à partir d’un plan de contrôle et d’un plan de calcul.

- Le plan de contrôle comprend les services backend que Databricks gère dans son propre compte AWS Cloud. Les commandes de notebook et de nombreuses autres configurations d’espace de travail sont stockées dans le plan de contrôle et chiffrées au repos.

- Le plan de calcul, où vos données sont traitées, a différents types en fonction du calcul spécifique que vous utilisez. Vous pouvez trouver plus d’informations sur ces types de calcul.

- Pour le calcul serverless, les ressources de calcul serverless s’exécutent dans un plan de calcul serverless dans votre compte Databricks.

- Pour le calcul Databricks classique, les ressources de calcul se trouvent dans votre compte AWS Cloud.

Architecture de haut niveau

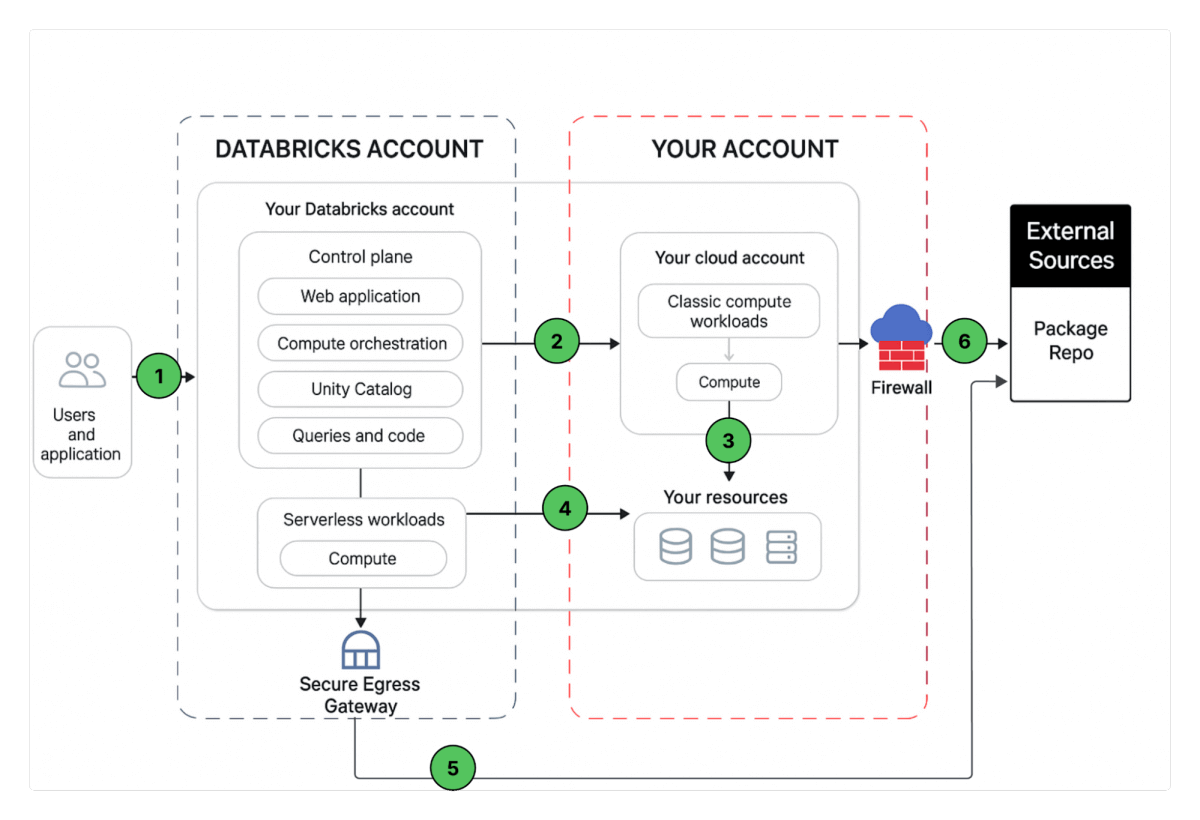

Chemin de communication réseau

Pour comprendre les mesures de sécurité que nous visons à mettre en œuvre, examinons les différentes manières dont les utilisateurs et les applications interagissent avec Databricks, comme illustré ci-dessous.

Un déploiement d'espace de travail Databricks comprend les chemins réseau suivants que vous pouvez sécuriser.

- Utilisateur ou Applications vers l'application web Databricks, alias espace de travail ou les API REST Databricks.

- Réseau VPC du plan de calcul classique Databricks vers le service de plan de contrôle Databricks. Cela inclut le relais de connectivité sécurisée des clusters et la connexion de l'espace de travail pour les points de terminaison de l'API REST.

- Plan de calcul classique vers vos services de stockage (ex : S3, Kinesis, etc.).

- Plan de calcul serverless vers vos services de stockage (ex : S3, Kinesis, etc.).

- Sortie sécurisée depuis le plan de calcul serverless via les politiques réseau (pare-feu sortant) vers des sources de données externes, par exemple des dépôts de paquets comme pypi ou maven.

- Sortie sécurisée depuis le plan de calcul classique via un pare-feu sortant vers des sources de données externes, par exemple des dépôts de paquets comme pypi ou maven.

Du point de vue des utilisateurs finaux, 1 nécessite des contrôles d'entrée et 2, 3, 4, 5, 6 des contrôles de sortie.

Dans cet article, notre objectif est de sécuriser le trafic sortant de vos charges de travail Databricks, de fournir au lecteur des conseils prescriptifs sur l'architecture de déploiement proposée et, pendant que nous y sommes, nous partagerons également les meilleures pratiques pour sécuriser le trafic entrant (utilisateur/client vers Databricks).

Architecture de déploiement proposée - Architecture de référence de sécurité AWS

Déployer Databricks en toute sécurité sur AWS peut sembler complexe ; vous avez besoin de VPC, de rôles IAM, de mise en réseau privée, d'Unity Catalog et de garde-fous qui s'alignent sur la sécurité de l'entreprise. Le Databricks Security Reference Architecture (SRA) pour AWS regroupe ces meilleures pratiques dans des modèles Terraform prêts à l'emploi, offrant aux équipes un point de départ renforcé pour les déploiements en production.

Ce que c'est

- Modules Terraform opinionnés pour Databricks sécurisé sur AWS.

- Couvre le réseau, IAM, Unity Catalog, les politiques prêts à l'emploi.

- Agit comme un plan directeur axé sur la sécurité pour accélérer l'adoption.

Pourquoi c'est important

- Vitesse : Automatisez l'infrastructure + la configuration de l'espace de travail en quelques minutes.

- Sécurité : VPC pré-configurés, mise en réseau privée, journalisation d'audit.

- Scalabilité : Modèles réutilisables entre les comptes/espaces de travail.

Structure générale du dépôt

- aws/ → Création d'infrastructure AWS + espace de travail.

- /modules/databricks_account/unity_catalog_metastore_creation/ → création de metastore

- aws/tf/modules/sra/credential.tf → rôle inter-comptes utilisant l'ID externe

- template.tfvars.example → remplissez vos variables

Ce que vous obtenez

- VPC AWS, sous-réseaux, rôles IAM.

- Espaces de travail Databricks connectés à Unity Catalog.

- Options renforcées : sortie restreinte, journalisation, surveillance.

Comment l'utiliser

- Clonez le dépôt.

- Remplissez vos variables dans template.tfvars.example

- Modifiez les paramètres VPC, sous-réseau et nom si nécessaire

- Étendez vers CI/CD pour des déploiements d'entreprise reproductibles.

Mises en garde

- Instantané ponctuel, à examiner avant les mises à niveau.

- Non « géré » → les équipes sont responsables des tests et de l'adaptation.

- Nécessite des connaissances sur les fournisseurs Terraform + AWS + Databricks.

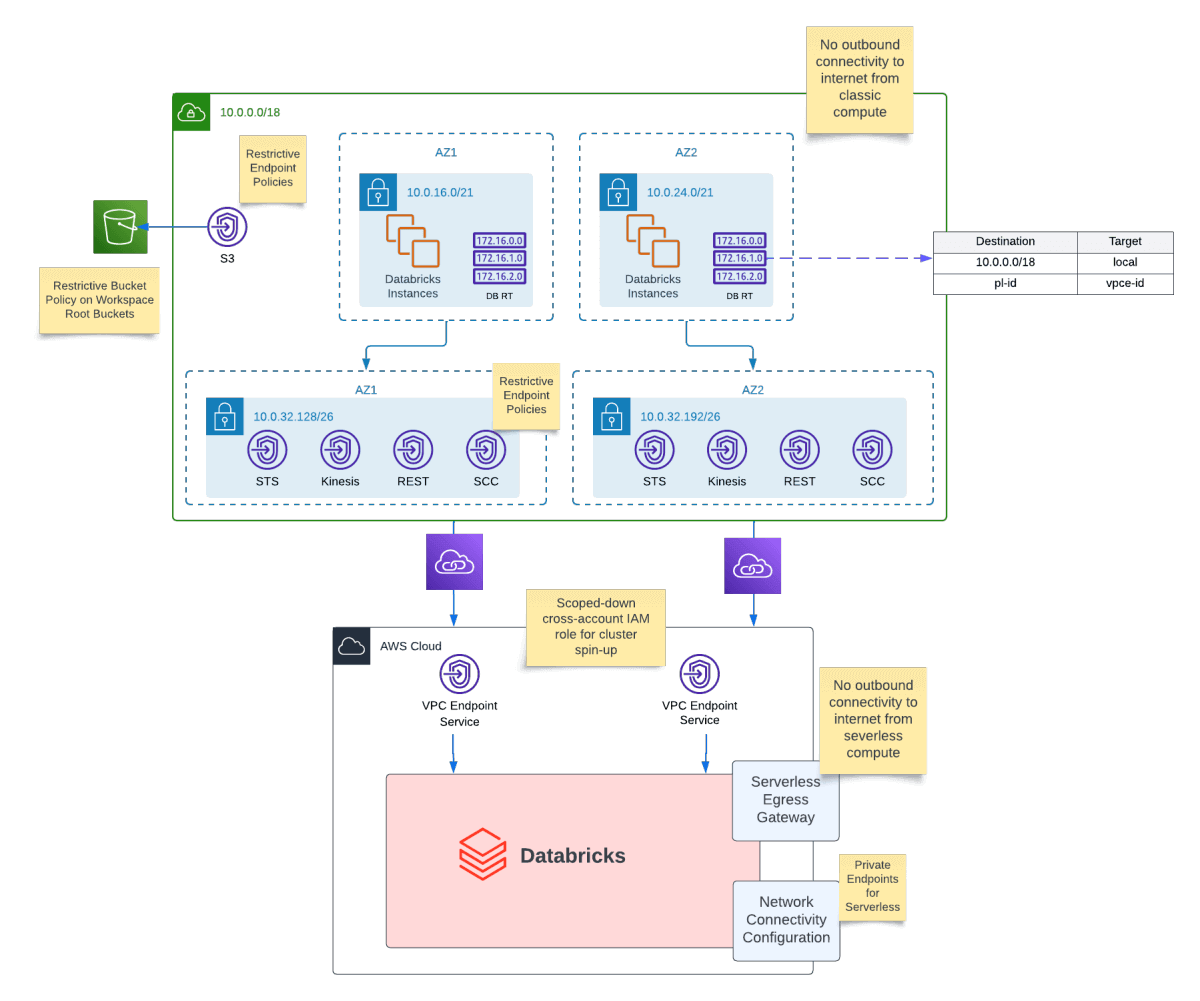

Si vous avez besoin d'un accès à Internet pour pypi ou maven, nous recommandons l'architecture suivante pour scanner tout trafic quittant votre VPC afin de pouvoir analyser tout trafic sortant. Un certain nombre de services AWS peuvent être utilisés pour analyser le trafic sortant vers votre VPC. Par exemple, AWS Network Firewall ou Gateway Load Balancer. Nous vous recommandons de suivre la documentation AWS, par exemple ici, pour commencer avec votre configuration AWS Network Firewall.

Contrôles de protection contre l'exfiltration de données Databricks

En plus de la surveillance du trafic sortant, implémentez les contrôles suivants pour renforcer votre environnement Databricks contre l'exfiltration de données. Veuillez noter que certaines fonctionnalités, telles que le lien privé, ne sont prises en charge que dans le niveau Enterprise de Databricks :

Provisionnement SCIM

Automatisez la gestion du cycle de vie des utilisateurs et des groupes de votre IdP vers Databricks.

Guide de provisionnement SCIM

Authentification unique (SSO)

Exigez une authentification centralisée via votre fournisseur d'identité (SAML ou OIDC).

Configuration SSO

Authentification multifacteur (MFA)

Appliquez la MFA au niveau de l'IdP pour ajouter une couche de sécurité de connexion supplémentaire.

Authentification multifacteur

Listes de contrôle d'accès (ACL) de la console de compte Databricks

Restreignez l'accès à la console de compte Databricks en définissant des plages d'adresses IP autorisées.

Listes d'accès IP

Points de terminaison privés dans la configuration de la connectivité réseau

Assurez-vous que le trafic de l'espace de travail ne transite que par des points de terminaison privés (pas d'Internet public).

Configuration de la connectivité réseau

Contrôles de sortie Serverless

Appliquez des restrictions pour limiter les destinations externes du calcul serverless Databricks.

Sécurité du calcul serverless

Éviter de stocker des données de production dans DBFS

Ne persistez pas les jeux de données sensibles dans DBFS ; utilisez un stockage sécurisé (par exemple, S3, ADLS).

Présentation de DBFS

Durée de vie des jetons du destinataire Delta Sharing

Raccourcissez la validité des jetons pour Delta Sharing afin de réduire l'exposition en cas de fuite.

Sécurité Delta Sharing

Isoler les charges de travail sensibles dans différents réseaux

Utilisez des VPC/sous-réseaux distincts pour isoler logiquement et physiquement les charges de travail.

Isoler les charges de travail sensibles dans différents espaces de travail

Déployez plusieurs espaces de travail (prod, dev, test) pour appliquer la séparation des environnements.

Stratégie multi-espaces de travail

Fédération de jetons OIDC pour CI/CD

Utilisez la fédération OIDC pour échanger en toute sécurité des jetons de courte durée lorsque les pipelines CI/CD interagissent avec Databricks.

Fédération de jetons OIDC

L'application combinée de ces contrôles fournit une défense en profondeur multicouche, minimisant le risque de fuite de données accidentelle ou malveillante.

Modules complémentaires avec conformité de sécurité et surveillance améliorées :

Si votre organisation a des exigences de sécurité accrues, telles que la nécessité de prendre en charge HIPAA, PCI ou des normes similaires, envisagez d'activer la surveillance de sécurité améliorée pour vos charges de travail Databricks.

Cette fonctionnalité avancée s'appuie sur les capacités de sécurité fondamentales de Databricks en offrant une visibilité plus approfondie, une détection proactive des menaces et un renforcement supplémentaire pour les environnements de calcul classiques et serverless. La surveillance de sécurité améliorée offre des avantages tels qu'Ubuntu Canonical avec le renforcement de niveau 1 CIS, une surveillance continue du comportement des logiciels malveillants et de l'intégrité des fichiers, une analyse complète des logiciels malveillants et antivirus, ainsi que des rapports détaillés sur les vulnérabilités du système d'exploitation hôte.

Avec cette fonctionnalité activée (via le profil de sécurité de conformité), les journaux d'événements de sécurité, y compris les alertes d'escalades de privilèges, les shells interactifs suspects, les connexions sortantes non autorisées, les modifications inattendues des fichiers système ou les tentatives potentielles d'exfiltration sont automatiquement enregistrés. Ces journaux sont livrés aux côtés des journaux d'audit Databricks standard, fournissant des informations riches et contextuelles à votre SIEM organisationnel ou au sein de Databricks lui-même. Cela permet aux analystes de sécurité de retracer et de répondre rapidement aux comportements anormaux ou risqués, soutenant la détection immédiate et la réponse rapide aux incidents sans nécessiter d'enquêtes approfondies.

Conclusion et prochaines étapes

Une défense solide contre l'exfiltration de données pour Databricks sur AWS n'est pas une configuration ponctuelle, elle nécessite une amélioration continue. Au-delà du déploiement de contrôles architecturaux, faites de la surveillance continue, de l'audit rigoureux et de la gestion proactive des changements des éléments centraux de votre pratique de sécurité. L'examen régulier des journaux d'audit, la mise à jour des politiques d'accès et de réseau, et la collaboration avec les équipes de sécurité et de conformité aident à garantir que les protections évoluent pour contrer les menaces émergentes. Pour approfondir votre stratégie, consultez des ressources réputées sur les meilleures pratiques de surveillance cloud et l'journalisation d'audit. Ces références vous aideront à maintenir votre vigilance et votre résilience à mesure que votre paysage de données et vos risques augmentent.

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.