Élargir la gouvernance des agents avec la passerelle d'IA de Databricks

Contrôlez et auditez les agents d'IA et les assistants de codage avec une gouvernance, une visibilité et des garde-fous unifiés.

par David Nasi

- Prise en charge de la gouvernance MCP : Contrôlez les agents qui peuvent accéder aux systèmes externes avec des autorisations granulaires, y compris l'accès au nom de la personne (OBO).

- Observabilité de bout en bout pour les agents : Surveillez les appels LLM et MCP, surveillez l'utilisation et attribuez les coûts entre les modèles, les équipes et les flux de travail.

- Accès aux modèles plus flexible et fiable : Utilisez une API unifiée sur tous les modèles avec des solutions de repli intégrées, des limites de débit et des garde-fous.

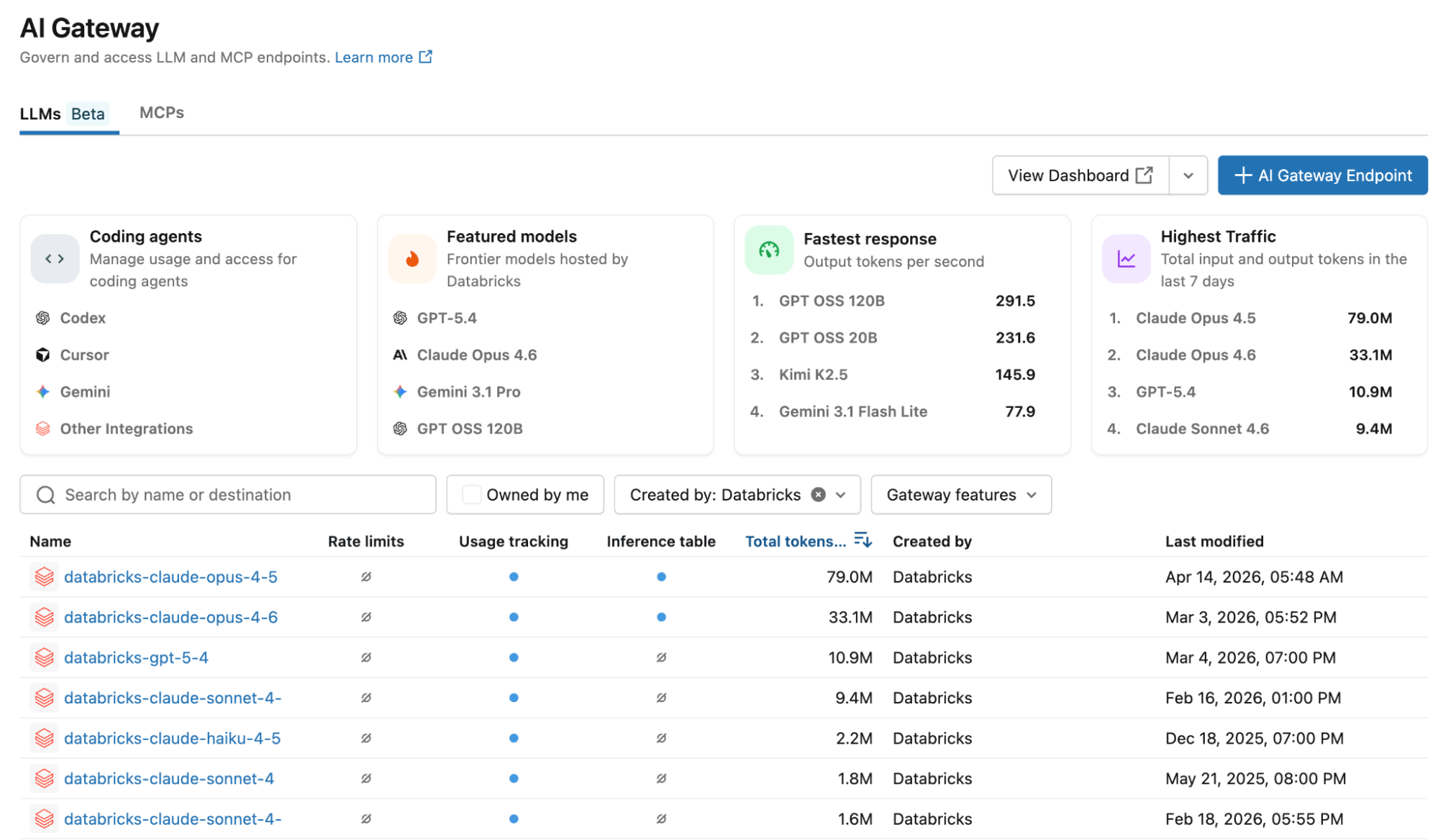

Aujourd'hui, nous annonçons des améliorations majeures pour AI Gateway. Dans le cadre de cette version, AI Gateway fait désormais partie de Unity Catalog sous le nom de Unity AI Gateway. Cela étend le modèle de gouvernance de Unity Catalog à l'IA agentique, vous permettant d'appliquer les mêmes contrôles d'autorisations, d'audit et de politique à la manière dont les agents accèdent aux LLM et interagissent avec des outils tels que les serveurs MCP et les API.

Voici ce qui se passe lorsqu'un agent IA répond à une question client : il appelle un LLM pour interpréter la requête, extrait l'historique des commandes de Salesforce via un serveur MCP, vérifie les données d'expédition en temps réel via une API interne, puis appelle à nouveau le LLM pour rédiger une réponse. Temps total : moins d'une seconde. Visibilité totale sur qui a accédé à quelles données, quels systèmes ont été appelés et si les politiques ont été respectées : presque aucune.

Ce qui a changé, ce ne sont pas seulement les outils, c'est l'architecture. Les agents IA orchestrent désormais des flux de travail multi-étapes à travers des modèles et des systèmes, touchant souvent des données sensibles à chaque étape. Cela peut impliquer d'interroger une base de données, d'appeler une API externe ou d'utiliser des agents de codage comme Cursor, Codex ou Claude Code pour générer ou modifier du code.

Et cela soulève de nouvelles questions : Qui a autorisé chaque action ? Quelles données ont été partagées avec quel modèle ? Les politiques ont-elles été appliquées de manière cohérente ? Si quelque chose casse, pouvez-vous retracer la chaîne complète ?

Les outils de gouvernance traditionnels n'ont pas été conçus pour ce monde. Ils fonctionnent en silos et ne peuvent pas fournir une vue unifiée sur le cycle de vie complet des actions d'un agent.

Avec cette version, nous étendons les capacités de gouvernance de Unity Catalog pour couvrir les agents IA. Unity AI Gateway vous permet de contrôler l'accès aux LLM, de gouverner la manière dont les agents utilisent les serveurs MCP et les API, et d'appliquer des politiques cohérentes sur tous les modèles et outils. Cela inclut un nouveau support pour la gouvernance MCP, vous permettant de contrôler quels agents peuvent accéder à quels systèmes externes et de suivre comment ces données sont utilisées. Pour un aperçu plus approfondi, lisez notre blogue explicatif sur la connexion sécurisée des agents aux MCP externes.

Vous bénéficiez également d'une observabilité détaillée des appels LLM et MCP, ainsi que d'un suivi granulaire des coûts sur les modèles, les équipes et les flux de travail. De plus, Unity AI Gateway fournit un moyen unifié de travailler sur tous les modèles, avec des solutions de repli intégrées, des limites de débit et des garde-fous pour vous aider à exécuter les agents de manière fiable en production.

Certaines des fonctionnalités décrites ci-dessous sont disponibles en version bêta

Vous pouvez désormais configurer un nouvel point de terminaison LLM ou un serveur MCP en quelques secondes : choisissez votre modèle (Claude Opus 4.6, GPT-4, Gemini, Llama ou toute API native du fournisseur) et configurez la gouvernance une seule fois. Le même cadre s'applique aux modèles Anthropic, OpenAI, Google et open-source.

Donnez à votre équipe de support un point de terminaison Claude pour l'IA conversationnelle. Utilisez GPT-4 pour l'extraction de données structurées. Équipez vos ingénieurs de Codex ou Claude pour les agents de codage. Intégrez Gemini pour les flux de travail multimodaux. Vous pouvez choisir le bon modèle pour chaque tâche sans retravailler la gouvernance à chaque fois. Les politiques restent cohérentes entre les fournisseurs, sans configuration dupliquée ni configurations séparées à gérer.

Permissions et garde-fous granulaires

Les permissions granulaires et les garde-fous empêchent ce qui ne devrait pas arriver en premier lieu.

Contrôle d'accès granulaire aux outils

Lorsque les agents appellent les serveurs MCP pour accéder aux systèmes internes, Unity AI Gateway prend en charge l'exécution au nom de l'utilisateur. Le MCP s'exécute avec les autorisations exactes de l'utilisateur demandeur, et non avec un compte de service partagé. Si un utilisateur ne peut pas accéder à un enregistrement Salesforce, l'agent ne le peut pas non plus, même avec des privilèges élevés.

Garde-fous flexibles alimentés par des juges LLM (Bêta)

Les garde-fous de Unity AI Gateway utilisent une approche prompt + modèle : configurez-les pour qu'ils s'exécutent sur les requêtes, les réponses ou les deux :

- Détection et masquage des informations personnelles identifiables (PII) : Détecte et masque les e-mails, les numéros de sécurité sociale, les numéros de téléphone avant qu'ils n'atteignent les modèles externes

- Sécurité du contenu : Bloque le contenu toxique, nuisible ou inapproprié avec des filtres personnalisables

- Détection d'injection de prompt : Intercepte les tentatives de jailbreak visant à outrepasser les instructions système

- Prévention de l'exfiltration de données : Empêche l'exposition des données d'entraînement ou du contenu propriétaire

- Garde-fous contre les hallucinations : Valide les réponses par rapport aux sources de référence

- Garde-fous personnalisés : Définissez les vôtres avec un prompt et un modèle personnalisés

Chaque garde-fous est soutenu par un prompt modifiable et un modèle configurable, et non par une logique rigide pré-construite. En cas de violation, Unity AI Gateway peut rejeter la requête ou masquer les données sensibles. Toutes les actions sont enregistrées pour l'audit. Cette fonctionnalité est en cours de déploiement et sera disponible dans toutes les régions prises en charge dans la semaine à venir.

Observabilité de bout en bout

Trois équipes ont besoin de réponses lorsque les agents IA arrivent en production : FinOps veut savoir ce qui coûte cher, l'ingénierie a besoin de déboguer les échecs, la sécurité a besoin de pistes d'audit. Unity AI Gateway fournit à chaque équipe ce dont elle a besoin à partir de la même infrastructure de journalisation unifiée.

Pour FinOps : Suivez les coûts selon ce qui compte pour vous

Chaque requête est enregistrée dans les tables système de Unity Catalog avec les coûts réels en dollars, et pas seulement les comptes de jetons. Le temps de disponibilité du débit provisionné, l'utilisation au paiement par jeton et la tarification des modèles externes sont tous calculés automatiquement. Segmentez les coûts selon la manière dont votre organisation budgétise :

- Balises de point de terminaison : Regroupez par équipe, environnement ou centre de coûts

- Balises de requête : Attribution dynamique pour les plateformes SaaS qui agissent en proxy pour les clients finaux

- Identité : Agrégation par utilisateur ou principal de service - associez les dépenses aux propriétaires de budget

- Modèle et fournisseur : Suivez quels modèles (Opus vs Sonnet) et quels fournisseurs (Anthropic vs OpenAI) génèrent les coûts

Pour l'ingénierie : Charges utiles complètes pour le débogage

Activez les tables d'inférence qui capturent les charges utiles complètes des requêtes/réponses, la latence, les codes d'état et les erreurs dans des tables Delta. Lorsqu'un agent échoue, retracez exactement quel prompt a été envoyé, ce que le modèle a renvoyé et où il a échoué, et utilisez des outils comme Genie Code et MLflow pour déboguer et résoudre rapidement les problèmes.

Pour la sécurité : Pistes d'audit complètes

Chaque requête enregistre l'identité du demandeur, l'horodatage et, pour les appels MCP, le nom de la connexion, la méthode HTTP et si l'appel a été effectué au nom de l'utilisateur. Les autorisations de Unity Catalog contrôlent qui voit quoi.

Une seule infrastructure de journalisation alimente trois cas d'utilisation critiques, construite sur des tables Delta que vous possédez et contrôlez.

Fiabilité et flexibilité pour la production

Unity AI Gateway vous offre une flexibilité dans la manière d'appeler les modèles, en fonction des besoins de votre application.

API unifiées pour un changement de fournisseur transparent (Bêta)

Si la portabilité est importante - et elle devrait l'être - utilisez l'API compatible OpenAI de Unity AI Gateway . Votre code reste le même pour chaque fournisseur. Écrivez votre application une fois, puis basculez entre n'importe quel modèle en mettant à jour la configuration du point de terminaison. Aucune modification de code, aucun redéploiement.

Le basculement automatique maintient les systèmes en fonctionnement (Bêta)

Configurez des modèles de repli, et Unity AI Gateway gère automatiquement les échecs. Si votre modèle principal atteint les limites de débit ou renvoie des erreurs, les requêtes sont acheminées vers votre modèle de sauvegarde en séquence jusqu'à ce que l'un d'eux réussisse. Quota Opus épuisé ? Le trafic bascule vers Sonnet. Le fournisseur connaît une panne ? Votre application est acheminée vers une alternative. Aucune intervention manuelle, aucun temps d'arrêt.

Enfin, Unity AI Gateway vous permet de définir des limites de débit au niveau du point de terminaison, de l'utilisateur ou du groupe pour éviter les coûts excessifs et protéger votre SLA avant que les problèmes ne commencent.

Commencez avec Unity AI Gateway

Les nouvelles fonctionnalités décrites ci-dessus sont disponibles dans les régions Databricks prises en charge. Ouvrez votre espace de travail, accédez à Unity AI Gateway dans la barre latérale et commencez à gouverner votre pile GenAI — LLM et MCP — à partir d'un seul endroit. Apprenez-en davantage dans la documentation et le blogue « Comment connecter les agents aux MCP externes en toute sécurité » sur la connexion sécurisée des agents aux MCP externes.

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.