Annonce de la préversion publique de Lakeflow Designer

Une expérience sans code, native en IA et entièrement gouvernée pour la préparation des données sur Databricks

par Jason Messer, Emanuel Zgraggen, V Maharajh, Matt Jones et Tracy Yang

- Lakeflow Designer est maintenant en aperçu public, offrant aux utilisateurs de Databricks une manière visuelle, sans code et native en IA pour préparer et analyser des données.

- Construit directement sur Databricks et régi par Unity Catalog, Lakeflow Designer conserve les données en place tout en fournissant la lignée, les autorisations et le code prêt pour la production dès le premier jour.

- Lakeflow Designer aide à rendre les transformations générées par l'IA plus faciles à examiner et à faire confiance en décomposant le travail en opérateurs visuels avec des aperçus étape par étape de la façon dont les données changent.

Nous avons d'abord présenté Lakeflow Designer lors du Data and AI Summit l'année dernière. Depuis, nous avons travaillé en étroite collaboration avec les premiers clients pour affiner le produit et mieux comprendre où il est le plus utile. Aujourd'hui, nous sommes ravis d'annoncer la Public Preview de Lakeflow Designer. Lakeflow Designer supprime l'un des plus grands obstacles aux données aujourd'hui : la barrière technique à l'entrée.

Qu'est-ce que Lakeflow Designer ?

Lakeflow Designer est une expérience visuelle, sans code et native en IA pour la préparation et l'analyse des données. Intégré directement dans Databricks, il permet aux analystes, aux experts du domaine et à d'autres utilisateurs moins techniques de préparer et d'explorer les données via un canevas de glisser-déposer et le langage naturel.

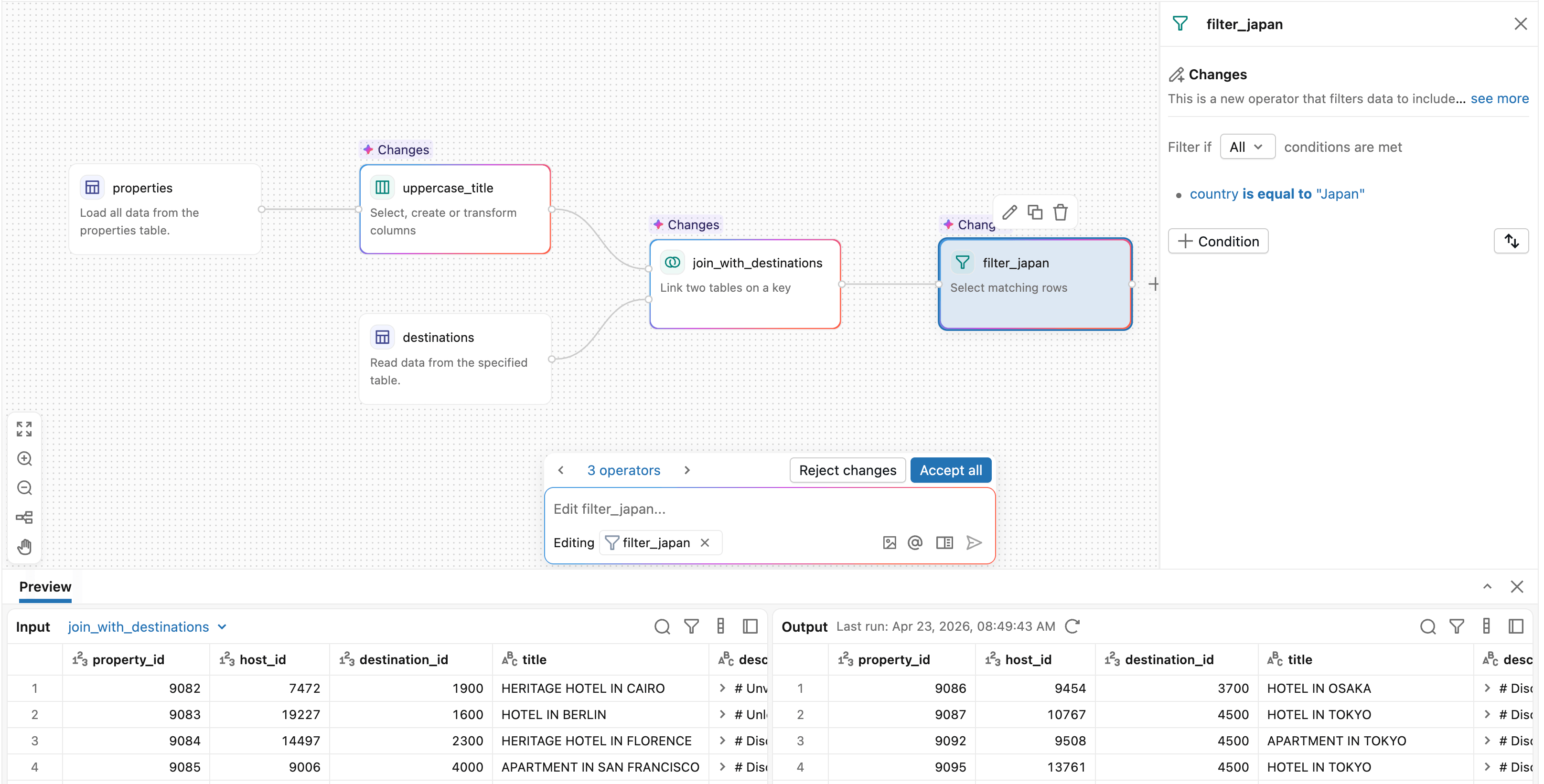

Chaque étape de Lakeflow Designer est représentée par un opérateur, donnant aux utilisateurs une image claire de la façon dont les données changent tout au long du workflow. Cela facilite la création, la validation et la compréhension des transformations au fur et à mesure.

Lakeflow Designer étend la puissance de Databricks Lakeflow à un plus large éventail d'utilisateurs, permettant la préparation de données sans code tout en générant du code prêt pour la production en coulisses. Les workflows peuvent être planifiés et opérationnalisés via Lakeflow Jobs, ce qui facilite le passage de la préparation interactive des données aux pipelines de production.

Lakeflow Designer élargit l'autonomie des équipes métier, permettant la création efficace de vues de données grâce au langage naturel et aux meilleures pratiques, tout en garantissant la cohérence, la gouvernance et la fiabilité des données. — Phelipe Naman, Data & Analytics Architecture Tech Lead, Sabesp

Qu'est-ce qui rend Lakeflow Designer différent ?

La préparation de données en libre-service n'est pas une nouvelle idée, mais les outils existants se situent en dehors de votre plateforme de données centrale. Cela entraîne des compromis :

- La déconnexion entre l'outil de préparation des données et la plateforme de données crée des lacunes en matière de gouvernance et une surcharge informatique supplémentaire

- L'IA est ajoutée et les suggestions sont génériques car l'outil n'a pas de réelle compréhension des données

- Les workflows visuels sont difficiles à mettre en production, la logique étant souvent piégée dans des langages spécifiques au domaine ou dans l'interface utilisateur

- La licence par utilisateur est coûteuse et limite l'accès

Lakeflow Designer adopte une approche différente.

1. Intégré nativement sur Databricks pour la gouvernance et la simplicité

Lakeflow Designer s'exécute directement là où vos données résident déjà - sur Databricks. Il n'est pas nécessaire de déplacer les données vers un outil séparé ou sur votre machine locale. Les données restent en place, gouvernées par Unity Catalog dès le départ, tout en simplifiant la pile de données globale. Au lieu de gérer un outil low-code séparé avec son propre modèle de licence, d'autorisations et d'administration, les organisations peuvent activer le travail en libre-service directement dans Databricks.

KPMG UK fournit des services d'audit et d'assurance à des milliers d'entreprises, chacune avec un paysage de données différent. Équiper nos praticiens de Lakeflow Designer permet un workflow visuel, low-code et assisté par l'IA qui évolue et démocratise notre capacité à traduire des ensembles de données complexes et variés en informations significatives. — Mark Wallington, Audit Data and AI Partner, KPMG UK

Commencez à travailler immédiatement avec des données sources natives

2. Conçu dès le départ pour l'IA, et conçu pour rendre l'IA examinable

Lakeflow Designer est construit sur Genie Code, l'assistant de codage agentique natif de Databricks. L'IA n'est pas un ajout ici. Elle est au cœur du fonctionnement du produit. Décrivez simplement ce que vous voulez en anglais courant, et Genie Code peut générer ou modifier le workflow directement.

Création native en IA qui fonctionne simplement

Étant donné que Lakeflow Designer est intégré directement dans l'espace de travail Databricks, Genie Code peut raisonner sur plus que de simples noms de colonnes. Il peut utiliser les métadonnées d'Unity Catalog, les descriptions de tables, la lignée, la popularité et les exemples de requêtes pour comprendre la signification sémantique des données et identifier les bons actifs pour une tâche. Cela conduit à des suggestions plus contextuelles et précises que les outils qui ne voient que le schéma.

Cette architecture ouvre également la voie à un comportement plus agentique. Au lieu de générer un résultat statique une fois, le système peut exécuter une transformation, inspecter le résultat et itérer si nécessaire. Par exemple, si une jointure échoue ou ne renvoie aucune ligne, Genie Code peut évaluer le résultat et essayer une approche alternative.

Peut-être tout aussi important, Lakeflow Designer rend les transformations générées par l'IA faciles à comprendre et à valider en les divisant en opérateurs visuels discrets avec des aperçus des données à chaque étape. Vous pouvez voir exactement ce qui a changé, où les lignes ont été filtrées, comment une jointure a été résolue et à quoi ressemble le résultat avant de passer à l'étape suivante.

Lakeflow Designer est un catalyseur clé pour faire évoluer l'ingénierie des données au-delà de l'équipe technique principale sur Databricks. En fournissant une interface visuelle intégrée à des capacités de langage naturel, il aide à réduire le « goulot d'étranglement SQL », permettant aux équipes métier de prototyper et d'itérer sur les pipelines avec une plus grande autonomie. Cela va au-delà de la facilité d'utilisation - il s'agit d'alignement organisationnel. Lorsque les transformations sont visuelles et accessibles, l'écart entre l'intention métier et l'exécution technique se réduit, accélérant le parcours des données brutes aux informations exploitables. — Matheus Polycaropo, Data Engineering Leader, Serasa Experian

3. Chaque transformation visuelle génère du code réel, prêt pour la production

Chaque transformation dans Lakeflow Designer génère du code Python prêt pour la production en coulisses. Ce code peut être examiné, versionné dans Git et intégré directement dans des workflows de production plus importants. Au fil du temps, Designer prendra également en charge davantage de sorties de production natives, telles que les vues matérialisées. Cela réduit finalement l'un des plus grands coûts des outils en libre-service : la transmission du travail à l'ingénierie pour le reconstruire pour la production. Au lieu de refaire le travail dans un autre système, les équipes de données centrales peuvent s'appuyer sur ce que les utilisateurs ont déjà créé.

4. Pas de licences par utilisateur

L'un des plus grands obstacles à l'adoption que nous avons rencontrés avec les outils low-code traditionnels est le prix. La licence par siège oblige les équipes à décider à l'avance quels utilisateurs méritent d'avoir accès, ce qui ralentit l'adoption et limite le libre-service avant même qu'il ne commence.

Avec Lakeflow Designer, il n'y a pas de modèle de licence par utilisateur. Vous ne payez que pour le calcul que vous utilisez. Tout le monde dans l'entreprise peut participer au travail sur les données sans créer de nouveau goulot d'étranglement d'approvisionnement.

Comment les équipes utilisent Lakeflow Designer

Nous voyons déjà des centaines d'équipes dans diverses industries utiliser Lakeflow Designer pour préparer et travailler avec des données de manière qui était auparavant difficile à adapter sans le soutien de l'ingénierie.

Par exemple :

- Les équipes de conseil et de services professionnels utilisent Lakeflow Designer pour nettoyer les données clients à partir de feuilles de calcul, de PDF et de fichiers partagés, puis appliquent des workflows d'audit ou d'analyse répétables pour produire des rapports.

- Les organisations de services financiers utilisent Lakeflow Designer pour la préparation de données en libre-service, le reporting réglementaire et l'analyse des risques.

- Les équipes métier dans le marketing, les opérations et la logistique l'utilisent pour combiner des données de plusieurs sources, répondre à des questions opérationnelles et préparer des données pour des tableaux de bord.

Nous voyons également Lakeflow Designer jouer un rôle important dans la plateforme Databricks au sens large. Les équipes l'utilisent pour préparer des données qui alimentent les Metric Views et les tableaux de bord IA/BI, créant ainsi une boucle complète de libre-service. Les analystes peuvent passer des tables brutes aux tableaux de bord polis sans écrire de code.

Avec l'adoption de Lakeflow Designer, nous avons simplifié la construction des pipelines de données et élevé la qualité des analyses grâce au développement low-code et aux capacités d'IA alimentées par le langage naturel. Les équipes non techniques ont commencé à créer des processus analytiques complexes de manière autonome, générant une réelle valeur commerciale et accélérant la prise de décision. De plus, la plateforme nous a permis de diffuser une culture axée sur les données dans toute l'entreprise, élargissant la portée de l'analyse avancée à davantage de domaines et démocratisant l'accès à l'intelligence des données dans toute l'organisation. — Carlos Gumz, Data Lead, Hering

Pour commencer

Le Designer est actuellement disponible dans tous les espaces de travail. Pour commencer, cliquez sur le bouton + Nouveau en haut à gauche de l'espace de travail et sélectionnez Préparation visuelle des données. Si vous ne voyez pas l'option Préparation visuelle des données, le Designer peut devoir être activé par un administrateur dans le portail de prévisualisation.

Voici d'autres étapes que vous pouvez suivre avec le Designer Lakeflow :

- Regardez une vidéo de démonstration de 8 minutes du Designer Lakeflow

- Consultez la page de documentation  pour des ressources plus détaillées sur la prise en main du Designer Lakeflow.

- Les commentaires des clients continuent de façonner le produit et de jouer un rôle clé dans notre feuille de route. Si vous avez des commentaires ou des questions, nous serions ravis d'avoir de vos nouvelles à l'adresse [email protected].

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.