Annonce des points de terminaison optimisés pour le stockage pour la recherche vectorielle

Échelle de plusieurs milliards de vecteurs, coût 7 fois inférieur

par Adam Gurary et Dima Kotlyarov

- Introduction de la recherche vectorielle optimisée pour le stockage : Échelle de milliards de vecteurs, coût jusqu'à 7 fois inférieur, indexation 20 fois plus rapide, filtrage familier de type SQL.

- Libérez plus de valeur des données non structurées pour l'IA : Créez des systèmes RAG, de résolution d'entités et de recherche sémantique haute performance sur des documents, des images, etc.

- Prêt pour l'entreprise et facile à adopter : Soutenu par la gouvernance Unity Catalog et intégré à des outils comme l'Agent Playground pour un prototypage RAG rapide et des politiques budgétaires pour la gestion des coûts.

La plupart des entreprises disposent d'une quantité massive de données non structurées — documents, images, audio, vidéo — pourtant seule une fraction se transforme en informations exploitables. Les applications basées sur l'IA, telles que la génération augmentée par récupération (RAG), la résolution d'entités, les moteurs de recommandation et la recherche par intention, peuvent changer cela, mais elles se heurtent rapidement à des obstacles familiers : limites de capacité strictes, coûts exorbitants et indexation lente.

Aujourd'hui, nous annonçons la préversion publique des points de terminaison optimisés pour le stockage pour Databricks AI Search — notre nouveau moteur de recherche vectorielle, spécialement conçu pour des données à l'échelle du pétaoctet. En dissociant le stockage du calcul et en tirant parti de l'échelle massive et du parallélisme de Spark au sein de la plateforme Databricks Data Intelligence, il offre :

- Capacité de plusieurs milliards de vecteurs

- Coût jusqu'à 7 fois inférieur

- Indexation 20 fois plus rapide

- Filtrage de style SQL

Mieux encore, c'est un véritable remplacement direct des mêmes API que vos équipes utilisent déjà, désormais optimisé pour la RAG, la recherche sémantique et la résolution d'entités en production réelle. De plus, pour soutenir davantage les équipes d'entreprise, nous introduisons également de nouvelles fonctionnalités conçues pour rationaliser le développement et améliorer la visibilité des coûts.

Nouveautés dans la recherche vectorielle optimisée pour le stockage

Les points de terminaison optimisés pour le stockage ont été construits en réponse directe à ce que les équipes d'entreprise nous ont dit qu'elles avaient le plus besoin : la capacité d'indexer et de rechercher dans des lacs de données non structurées entiers, une infrastructure qui évolue sans faire exploser les coûts, et des cycles de développement plus rapides.

Échelle de plusieurs milliards de vecteurs, coût 7 fois inférieur

L'échelle n'est plus une limitation. Alors que notre offre Standard prenait en charge quelques centaines de millions de vecteurs, l'offre optimisée pour le stockage est conçue pour des milliards de vecteurs à un coût raisonnable, permettant aux organisations d'exécuter des charges de travail complètes sur le lac de données sans avoir besoin d'échantillonner ou de filtrer. Les clients exécutant de grandes charges de travail constatent des coûts d'infrastructure jusqu'à 7 fois inférieurs, ce qui rend enfin réalisable l'exécution de GenAI en production sur d'énormes ensembles de données non structurées.

À titre de comparaison, le prix de l'offre optimisée pour le stockage serait d'environ 900 $/mois pour 45 millions de vecteurs et d'environ 7 000 $/mois pour 1,3 milliard de vecteurs. Ce dernier représente des économies significatives par rapport à environ 47 000 $/mois sur notre offre standard.

Indexation jusqu'à 20 fois plus rapide

Débloquez des cycles d'itération rapides qui étaient auparavant impossibles. Notre réarchitecture alimente l'une des améliorations les plus demandées : une indexation considérablement plus rapide. Vous pouvez désormais créer un index de 1 milliard de vecteurs en moins de 8 heures, et des index plus petits de 100 millions de vecteurs ou moins sont construits en quelques minutes.

« L'amélioration de la vitesse d'indexation avec l'offre optimisée pour le stockage est énorme pour nous. Ce qui prenait auparavant environ 7 heures ne prend plus qu'une heure, soit une amélioration de 7 à 8 fois. » — Ritabrata Moitra, Sr. Lead ML Engineer, CommercelIQ

Filtrage similaire à SQL

Filtrez facilement les enregistrements sans apprendre de syntaxe inconnue. Au-delà des performances et de l'échelle, nous nous sommes également concentrés sur la convivialité. Le filtrage des métadonnées se fait désormais à l'aide d'une syntaxe intuitive de type SQL, ce qui permet de réduire facilement les résultats de recherche à l'aide de critères que vous connaissez déjà.

Mêmes API, Backend entièrement nouveau

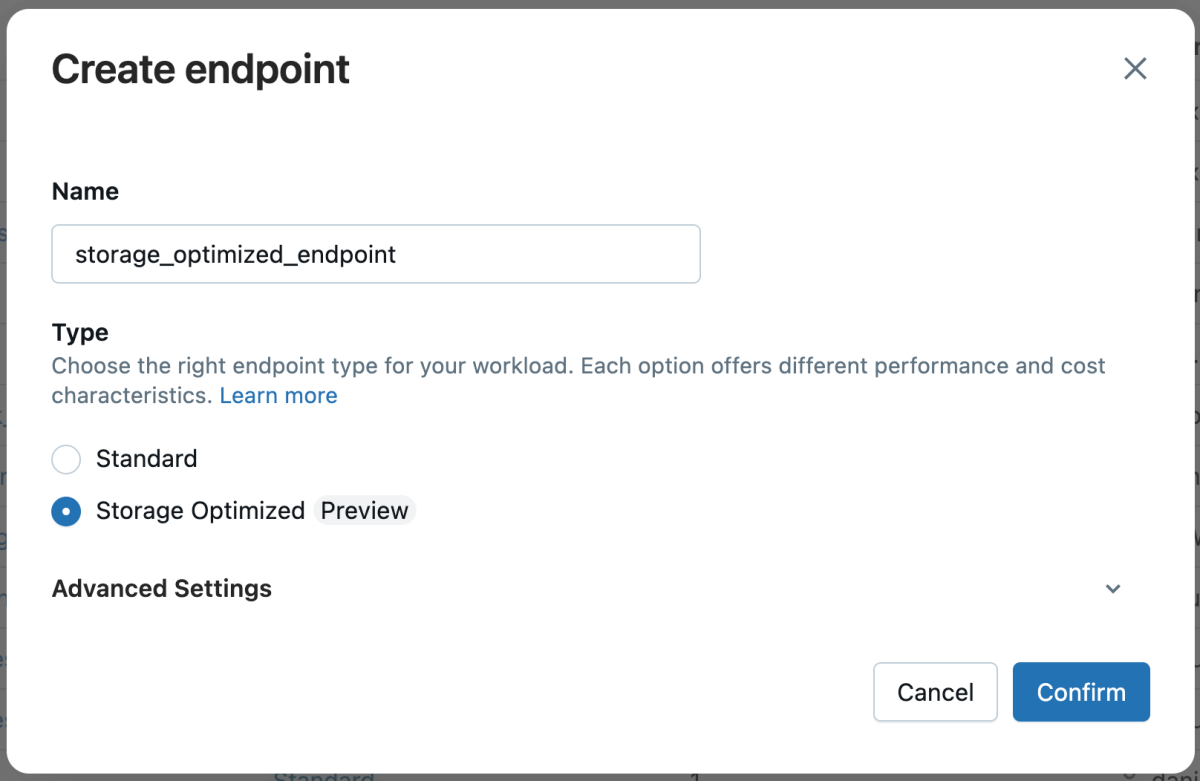

La migration vers les points de terminaison optimisés pour le stockage est facile : sélectionnez-le simplement lors de la création d'un nouveau point de terminaison et créez un nouvel index sur votre table. L'API de recherche de similarité reste la même, il n'y a donc pas besoin de modifications majeures du code.

« Nous considérons la recherche vectorielle optimisée pour le stockage comme un remplacement direct de l'offre standard. Elle débloque l'échelle dont nous avons besoin pour prendre en charge des centaines d'investisseurs internes interrogeant des dizaines de millions de documents par jour, sans compromettre la latence ou la qualité. » — Alexandre Poulain, Directeur, Équipe Science des Données et IA, PSP Investments

Comme cette fonctionnalité fait partie de la plateforme Databricks, elle bénéficie d'une gouvernance complète alimentée par Unity Catalog. Cela signifie des contrôles d'accès appropriés, des pistes d'audit et un suivi de lignage sur tous vos actifs de recherche vectorielle, garantissant la conformité avec les politiques d'entreprise en matière de données et de sécurité dès le premier jour.

Fonctionnalités améliorées pour rationaliser votre flux de travail

Pour soutenir davantage les équipes d'entreprise, nous introduisons de nouvelles capacités qui facilitent l'expérimentation, le déploiement et la gestion des charges de travail de recherche vectorielle à grande échelle.

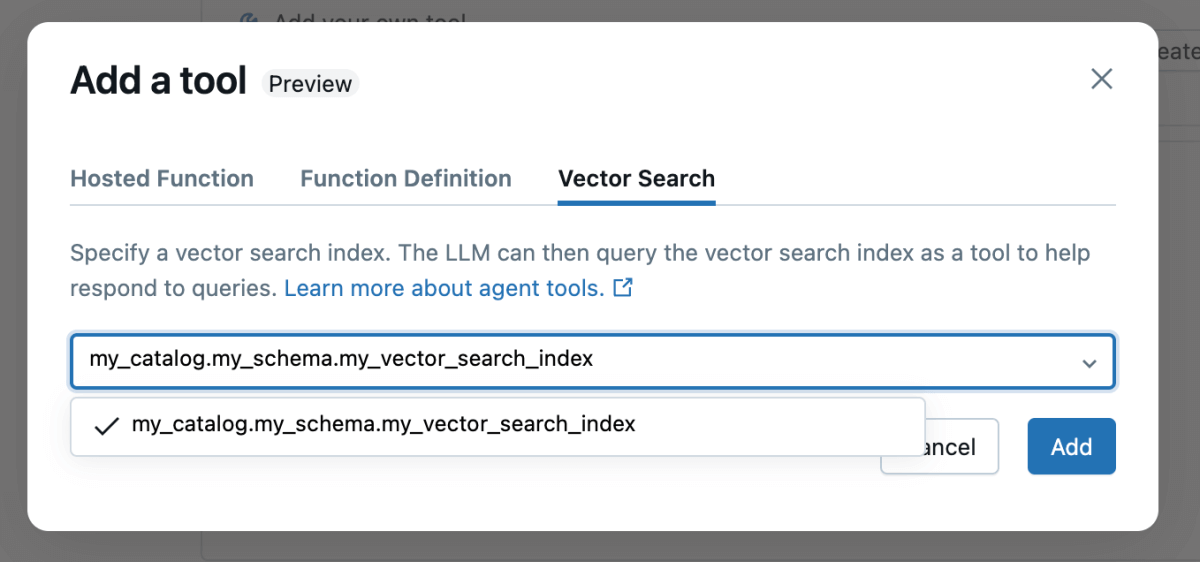

Les équipes peuvent désormais tester et déployer un agent de conversation basé sur un index de recherche vectorielle comme base de connaissances en deux clics – un processus qui nécessitait auparavant un code personnalisé important. Avec l'intégration directe dans l'Agent Playground, désormais en préversion publique, sélectionnez votre index de recherche vectorielle comme outil, testez votre agent RAG, et exportez, déployez et évaluez les agents sans écrire une seule ligne de code. Cela raccourcit considérablement le chemin du prototype à la production.

Notre visibilité améliorée des coûts grâce à la politique de balisage de budget des points de terminaison permet aux propriétaires de plateformes et aux équipes FinOps de suivre et de comprendre facilement les dépenses entre plusieurs équipes et cas d'utilisation, d'allouer des budgets et de gérer les coûts à mesure que l'utilisation augmente. Plus de support pour le balisage des index et des ressources de calcul sera bientôt disponible.

Ce n'est que le début

Le lancement des points de terminaison optimisés pour le stockage est une étape majeure, mais nous travaillons déjà sur des améliorations futures :

- Mise à l'échelle à zéro : Mise à l'échelle automatique des ressources de calcul lorsqu'elles ne sont pas utilisées pour réduire davantage les coûts

- Support QPS élevé : Infrastructure pour gérer des milliers de requêtes par seconde pour les applications exigeantes en temps réel

- Au-delà de la recherche sémantique : Capacités de récupération non sémantique efficaces pour les charges de travail basées uniquement sur des mots-clés.

Notre objectif est simple : construire la meilleure technologie de recherche vectorielle disponible, entièrement intégrée à la plateforme Databricks Data Intelligence sur laquelle vous comptez déjà.

Commencez à construire dès aujourd'hui

Les points de terminaison optimisés pour le stockage transforment la façon dont vous travaillez avec des données non structurées à grande échelle. Avec une capacité massive, une meilleure économie, une indexation plus rapide et un filtrage familier, vous pouvez créer en toute confiance des applications d'IA plus puissantes.

Prêt à commencer ?

- Essayez Databricks AI Search gratuitement : une configuration express vous donne un accès instantané et des crédits serverless gratuits.

- Consultez notre documentation pour voir comment faire !

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.