Au-delà de la feuille de calcul : comment Databricks façonne le directeur financier moderne dans les services financiers

Découvrez comment Databricks alimente un bureau du DAF piloté par l'IA en temps réel

par Jennifer Miller, Marcela Granados, Andrea DeSosa, Alex Oberlander, Kim Hatton, Pavithra Rao, Naeem Rehman, Pravin Varma, Olga Deriy et Prasanna Selvaraj

- Qu'est-ce que Databricks ? Une architecture unifiée qui intègre le streaming de données en temps réel, la modélisation pilotée par l'IA et une gouvernance centralisée – aidant les DAF à passer de la génération de rapports réactifs à une stratégie financière prospective.

- Quel problème résout-elle ? Les équipes financières passent jusqu'à 80 % de leur temps à nettoyer et à réconcilier des données provenant de systèmes fragmentés. Databricks élimine cette "Taxe sur les données et la gouvernance" en remplaçant les cycles de traitement par lots lents et les rapports cloisonnés par une base de données unique et gouvernée.

- Quels résultats les DAF peuvent-ils attendre ? Les organisations ont réduit le reporting réglementaire de 10 heures à 8 minutes, amélioré les ratios combinés d'assurance de 5 % et permis une clôture continue. Les DAF peuvent également interroger des données financières complexes en langage naturel grâce à des outils d'IA.

Dans les salles traditionnelles des services financiers, le bureau du directeur financier (CFO) a longtemps été perçu à travers le prisme de deux "visages" principaux : le Gardien, protégeant les actifs et assurant la conformité, et l'Opérateur, axé sur la planification et le reporting rétrospectif.

Mais un changement sismique est en cours. Les recherches de Deloitte sur le rôle évolutif des responsables financiers révèlent une ambition claire : les CFO devraient désormais passer plus de 60 % de leur temps en tant que Stratèges et Catalyseurs, pilotant la transformation de l'ensemble de l'entreprise et façonnant l'avenir de la société. Les responsables financiers d'aujourd'hui n'aident plus seulement le PDG à "gérer l'institution financière" ; ils sont chargés de "changer l'institution financière".

Cependant, pour la plupart, cette transition est entravée par une "Taxe sur les données et la gouvernance" fondamentale. Alors que l'ambition est de diriger la stratégie, la réalité est souvent une lutte contre une infrastructure héritée qui maintient les équipes liées au rôle d'"Opérateur". L'objectif est clair : passer de prévisions statiques mensuelles à un déploiement de capital dynamique en temps réel.

Le problème des données : la friction structurelle de la finance moderne

La plupart des organisations de services financiers sont actuellement entravées par une "Taxe sur les données" fondamentale qui empêche le bureau du CFO d'agir comme un moteur stratégique. Cette défaillance architecturale systémique maintient les CFO piégés dans la phase d'"Opérateur" :

- Le fossé de la fragmentation (systèmes découplés) : Les données sont piégées dans des silos hérités déconnectés ; sous-comptes, plateformes de fournisseurs et systèmes centraux fonctionnant sur des mainframes vieux de plusieurs décennies. Parce que le grand livre général est découplé des données de transaction brutes, les CFO paient une lourde "taxe de réconciliation". McKinsey constate que les utilisateurs de données peuvent passer 30 à 40 % de leur temps à rechercher des données et 20 à 30 % supplémentaires à les nettoyer, plutôt qu'à les analyser.

- La "taxe de traitement par lots" (latence J+1) : Les pipelines de données financières sont traditionnellement construits sur des cycles de traitement par lots nocturnes rigides. Dans un monde de transferts numériques 24h/24 et 7j/7 et de volatilité instantanée des marchés, J+1 est une responsabilité structurelle. Sans visibilité en temps réel sur la liquidité intra-journalière, les CFO doivent maintenir des tampons de trésorerie "paresseux" surdimensionnés, laissant du rendement sur la table et maintenant l'entreprise dans une posture réactive lors des tensions du marché.

- Le problème de la lignée (mathématiques opaques) : Les exigences de reporting mondiales, telles que CCAR, FR 2052a et LCR, exigent une granularité extrême. Sur les piles héritées, les "mathématiques" entre une transaction source et un rapport final sont souvent cachées dans une "boîte noire" de code ETL complexe. Cela crée une fragilité réglementaire, où chaque demande d'audit déclenche une reconstruction manuelle coûteuse du parcours des données.

- Le fossé sémantique : Il existe une déconnexion fondamentale entre la manière dont l'informatique stocke les données (schémas techniques) et la manière dont la finance en parle (PCGR/IFRS, NIM, HQLA). Les analystes passent 80 % de leur temps en tant que "concierges de données", traduisant les données brutes en signification commerciale avant même que l'analyse ne puisse commencer.

La solution : Databricks

Pour passer de Gardien à Catalyseur, les CFO ont besoin d'une plateforme qui ne se contente pas de stocker des données, mais qui les comprend. Databricks fournit une plateforme unifiée qui rassemble le streaming en temps réel, la gouvernance centralisée et les données et l'IA démocratisées.

1. Lignée et confiance unifiées avec Unity Catalog

Unity Catalog fournit une vue unique et gouvernée de tous les actifs de données, des transactions brutes aux modèles ML finaux utilisés dans le reporting réglementaire, la prise de décision stratégique et la prévision. En intégrant des normes sémantiques comme FIBO, il transforme cette vue d'une simple liste de fichiers en une colonne vertébrale ontologique. Cela garantit que les requêtes d'IA ne sont pas simplement pratiques, mais intrinsèquement fiables, car elles sont ancrées dans une logique standard de l'industrie plutôt que dans des conjectures statistiques.

Ce cadre élimine efficacement la "dette d'audit" en fournissant une lignée complète de bout en bout. Si un régulateur remet en question le calcul d'un ratio de liquidité, le CFO ne se contente pas de montrer un chemin de fichiers ; il peut retracer la logique sémantique, prouvant exactement comment un "actif liquide" a été défini et mis en correspondance avec la transaction individuelle. Ce niveau de transparence transforme un processus qui nécessitait autrefois des semaines de travail manuel médico-légal en un aperçu vérifiable disponible en quelques secondes.

2. Éliminer la "taxe de traitement par lots" avec Lakeflow

Avec Lakeflow et Spark Declarative Pipelines, le CFO moderne passe du "batch" au "continu". L'impact s'étend aux deux côtés du bureau du CFO. Pour la Trésorerie, le streaming de données dans le Lakehouse au fur et à mesure qu'elles se produisent fournit une vue en temps réel des concentrations de trésorerie et du risque intra-journalier, permettant à la banque de réduire les tampons de trésorerie non productifs et de redéployer la liquidité vers des actifs à rendement plus élevé instantanément. Pour le Contrôleur, Lakeflow permet le traitement en temps réel du grand livre général, en ingérant des messages d'origine (réservations de prêts, règlements de transactions, transactions de paiement) et en les enregistrant dans le sous-compte au fur et à mesure que les événements se produisent, plutôt que d'attendre les cycles de traitement de fin de journée. Cela élimine le décalage de réconciliation entre le moment où une transaction se produit et le moment où elle apparaît dans les livres, comprimant le cycle de clôture et gardant le grand livre prêt pour l'audit à tout moment.

3. Combler le fossé sémantique : "Parlez à vos données"

Databricks utilise les LLM pour comprendre la sémantique des données financières. Cela permet au bureau du CFO et aux responsables des activités de ligne d'utiliser Genie pour interroger l'ensemble de leur patrimoine financier en langage naturel. En tirant parti de l'IA sur des données gouvernées, le "Chat CFO" peut combler le fossé entre les "données brutes" et les "aperçus commerciaux", permettant aux analystes de se concentrer sur la stratégie plutôt que sur la préparation des données et les rapports.

4. Modélisation transparente et gouvernée avec Agent Bricks

Les modèles critiques de trésorerie tels que le bêta des dépôts, la prévision PPNR, les provisions CECL, l'efficacité de la couverture ont traditionnellement résidé dans des outils de fournisseurs en boîte noire ou des feuilles de calcul locales fragiles que personne d'autre ne peut auditer ou reproduire. Agent Bricks apporte ces modèles sur la même plateforme gouvernée que les données qu'ils consomment. Les modèles sont entraînés, enregistrés et versionnés dans Unity Catalog aux côtés des ensembles de données dont ils dépendent, créant une chaîne de lignée unique depuis les données de transaction brutes jusqu'à la sortie du modèle. Lorsqu'un régulateur ou un auditeur interne demande "comment cette prévision PPNR a-t-elle été produite ?", la réponse n'est pas le nom d'une personne, c'est un pipeline traçable et reproductible.

Databricks alimente le CFO moderne dans les services financiers

Dans les services bancaires et les marchés de capitaux

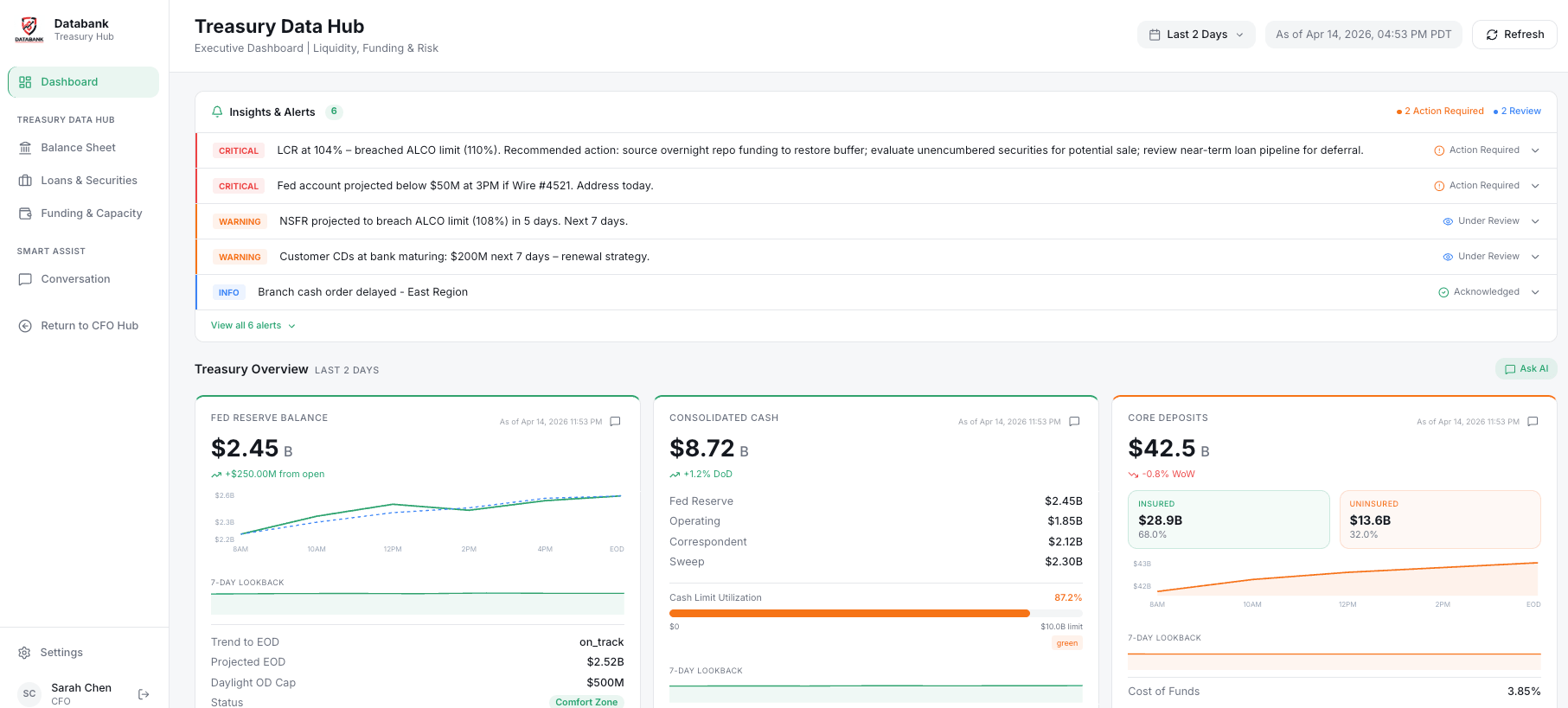

La banque moderne fonctionne désormais sur un Centre de trésorerie unifié. En décomposant les silos entre le grand livre général et les sous-comptes pour unifier les données de portefeuille et de marché, Databricks permet aux trésoriers de passer du reporting défensif à la gestion offensive du capital selon les piliers clés suivants :

Risque de taux d'intérêt et ALM : La gestion traditionnelle actif-passif (ALM) repose sur des agrégats. Databricks permet la simulation au niveau du prêt et la prévision du revenu net d'intérêts (NII) sous des milliers de scénarios de taux d'intérêt en quelques minutes. Cela permet aux trésoriers d'optimiser le bilan pour la marge plutôt que de simplement gérer des résultats "moyens".

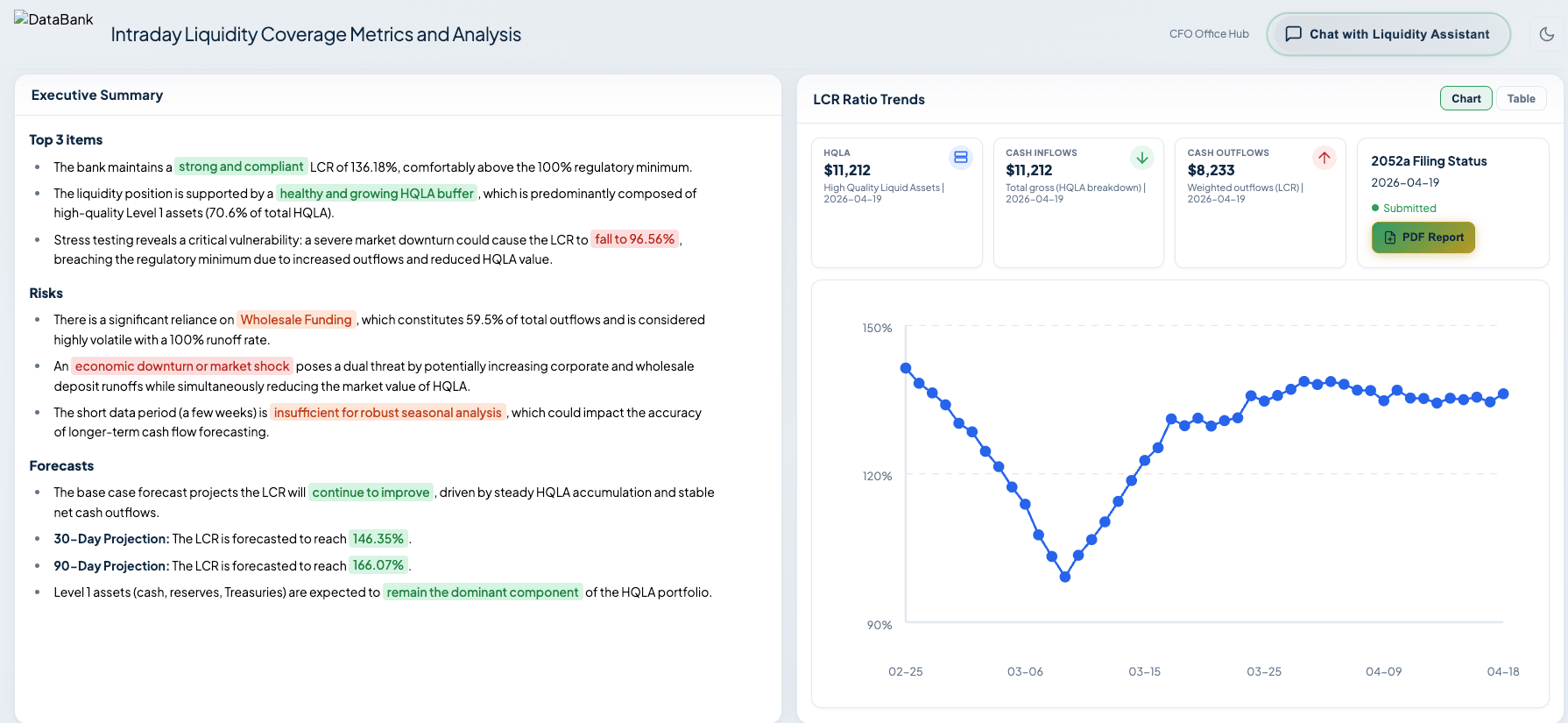

Financement et liquidité (LCR, ILST, FR 2052a) : En utilisant un centre de données unifié qui intègre les flux de trésorerie internes aux données de marché de référence, les équipes de trésorerie peuvent surveiller la liquidité intra-journalière et les risques de financement au fur et à mesure qu'ils se produisent. Les modèles prédictifs d'IA signalent les violations potentielles des ratios de couverture des liquidités (LCR) ou des tests de stress de liquidité internes (ILST) des heures avant qu'elles ne surviennent, permettant un rééquilibrage proactif.

Indicateurs et analyse de la couverture de liquidité intra-journalière - Planification et adéquation du capital (CCAR) : Au lieu d'être traitée comme un exercice annuel manuel, l'adéquation du capital devient un processus continu. En unifiant les données de risque et de finance, les équipes peuvent automatiser le travail fastidieux du reporting CCAR (Comprehensive Capital Analysis and Review), en exécutant des scénarios "what-if" sur les coussins de capital pour voir l'impact de nouvelles lignes d'activité ou de changements macroéconomiques en temps réel.

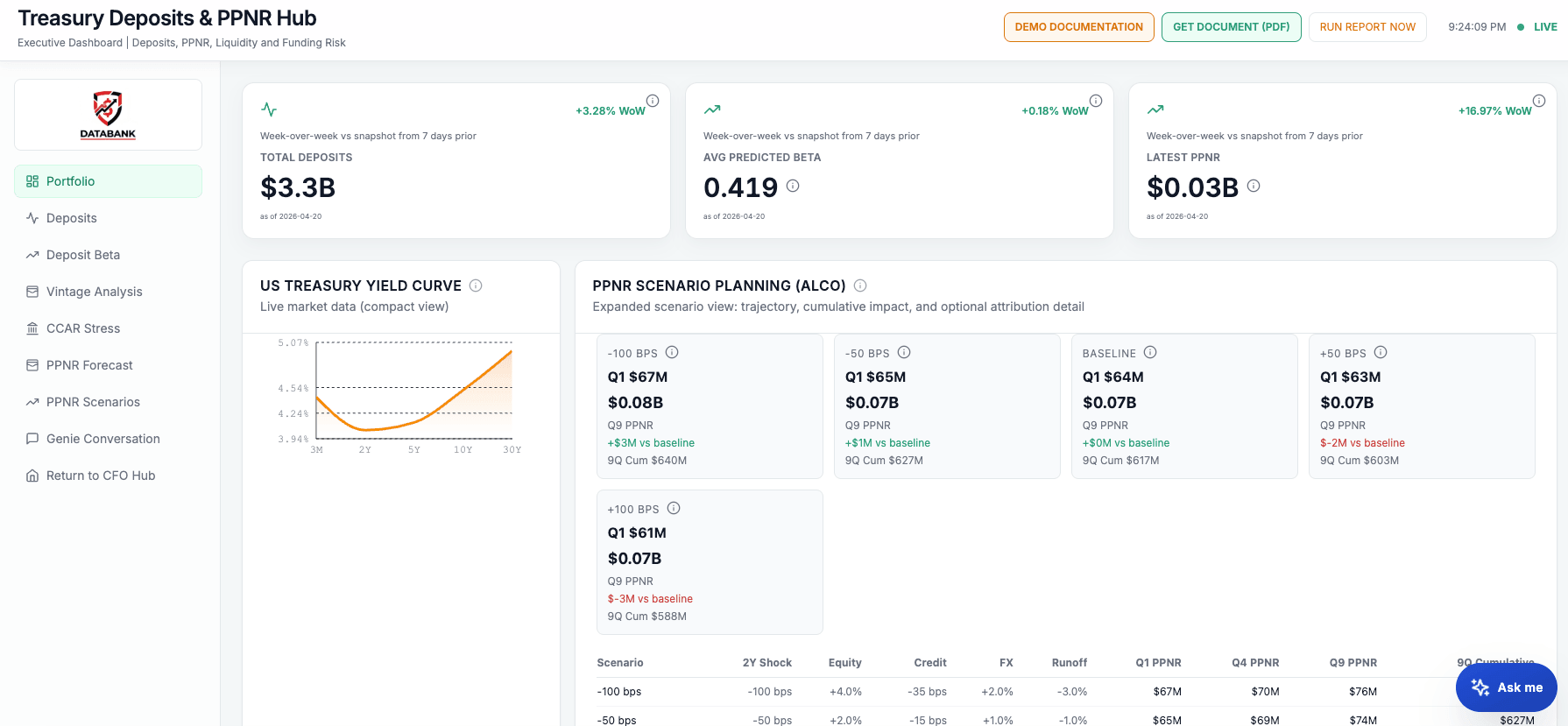

Planification de scénarios de dépôts pilotée par l'IA : Les trésoriers vont au-delà des moyennes historiques pour obtenir la précision de tarification nécessaire afin de maximiser le NIM et le PPNR. Les modèles d'IA évaluent la "persistance" des dépôts en période de stress et remplacent les ajustements globaux par des recommandations chirurgicales. Par exemple, suite à une augmentation du marché de 25 points de base, l'IA identifie les segments de détail "à forte inertie" nécessitant une augmentation de seulement 5 points de base pour maintenir la rétention, tout en recommandant une augmentation de 22 points de base pour les comptes commerciaux sensibles aux taux. Ce calibrage ciblé protège le bilan contre les sorties de "hot money" tout en défendant agressivement les dépenses d'intérêts, assurant une gestion optimale des écarts et une protection du bilan.

Dépôts de trésorerie et Hub PPNR. Tableau de bord exécutif pour les dépôts, le PPNR, la liquidité et le risque de financement - Reporting réglementaire adapté à l'usage : Databricks transforme la conformité d'une obligation périodique en une capacité continue. Les sorties FR 2052a et LCR dérivent des mêmes données en flux continu qui alimentent la surveillance de la trésorerie en temps intraday. Aucune extraction séparée, aucun décalage de réconciliation. Les questions des auditeurs sont répondues en quelques secondes, et non en semaines de reconstruction forensique. Les modèles de test de résistance sont versionnés et réutilisés dans les régimes CCAR, CECL et ILST, réduisant le coût d'adaptation à mesure que la réglementation évolue. Cela donne au DAF la confiance nécessaire pour garantir chaque chiffre avec certitude.

Dans le secteur de l'assurance

Tout comme dans le secteur bancaire, les fonctions financières des assurances sont contraintes par des frictions de données structurelles qui maintiennent le bureau du DAF dans une posture réactive, axée uniquement sur le reporting. Les problèmes fondamentaux font écho à la "Taxe sur les données et la gouvernance" plus large, mais se manifestent à travers des systèmes et des cadres réglementaires spécifiques à l'assurance :

Le fossé de la fragmentation des polices et des sinistres :

Les systèmes d'administration des polices, les plateformes de sinistres, les registres de réassurance et les portefeuilles d'investissement résident tous dans des silos déconnectés. Les équipes actuarielles passent 30 à 40 % de leur temps à réconcilier les données entre ces systèmes avant qu'une analyse significative ou un support à la décision ne puisse commencer.

La "Taxe sur les lots" dans la constitution des réserves et la clôture :

Les cycles de clôture mensuels ou trimestriels obligent les actuaires et les équipes financières à travailler à partir d'instantanés obsolètes. Dans un monde d'événements catastrophiques en temps réel et de marchés de capitaux volatils, T+1 ou T+30 devient une responsabilité structurelle pour la réservation dynamique, la surveillance de la solvabilité et le déploiement du capital.

Le problème de lignage dans le reporting réglementaire :

Les cadres mondiaux — IFRS 17, Solvabilité II, NAIC RBC et LDTI — exigent une auditabilité granulaire de bout en bout. Sur les piles héritées, les "calculs" entre une transaction de police et un chiffre final de réserve ou de capital sont enfouis dans des outils actuariels opaques et du code personnalisé, créant une fragilité réglementaire et des reconstructions manuelles coûteuses pour l'audit.

Le fossé sémantique entre l'actuariat et la finance :

Les actuaires s'expriment en triangles de développement des sinistres, unités d'exposition, facteurs de queue et courbes de catastrophe ; la finance s'exprime en postes comptables GAAP/IFRS, ratios combinés et ratios de capital. La traduction manuelle entre ces mondes consomme la bande passante des analystes, introduit un risque de réconciliation et ralentit la prise de décision.

Databricks pour la finance de l'assurance

Pour passer d'un reporting rétrospectif à une optimisation de la solvabilité, de la tarification et du capital en temps réel, les DAF d'assurance ont besoin d'une plateforme qui unifie les données, les modèles et la gouvernance sur une base unique et intelligente.

- Lignage et confiance unifiés avec Unity Catalog

Unity Catalog crée une vue gouvernée unique, des transactions brutes de polices et de sinistres aux modèles actuariels et aux états financiers finaux. En intégrant les normes sémantiques de l'assurance telles que le modèle de données ACORD comme colonne vertébrale ontologique, il fournit une piste d'audit de bout en bout pour les calculs de CSM IFRS 17, les remesures LDTI et le reporting RBC. Les régulateurs et les auditeurs obtiennent des réponses transparentes et traçables en quelques secondes au lieu de semaines de reconstruction manuelle. - Élimination de la "Taxe sur les lots" avec Lakeflow

Lakeflow ingère en continu les endossements de polices, les événements de sinistres et les transactions d'investissement dans le Lakehouse au fur et à mesure qu'ils se produisent. La comptabilisation en temps réel du sous-grand livre élimine le décalage de réconciliation entre les paiements de sinistres et les mouvements de réserves, permettant une posture de clôture continue où le grand livre est toujours prêt pour l'audit et où les cycles de clôture statutaires et GAAP sont compressés. - Combler le fossé sémantique : "Parlez à vos données"

Avec Genie au-dessus des données gouvernées, les DAF, les contrôleurs et les chefs de division peuvent interroger l'ensemble du patrimoine financier en langage naturel. Des questions telles que "Quel est notre ratio combiné actuel par segment d'activité si les pertes catastrophiques dépassent 500 millions de dollars ?" sont répondues en quelques secondes, pas en jours. Cela comble la couche de traduction actuariat-finance et libère les analystes du travail de janitorial de données afin qu'ils puissent se concentrer sur la stratégie de tarification, de réservation et de capital. - Modélisation transparente et gouvernée avec Agent Bricks

Les modèles critiques d'assurance — réserves de sinistres, IBNR, récupérations de réassurance, report de CSM, appariement actif-passif, etc. — sortent des feuilles de calcul fragiles et des outils propriétaires d'actuariat en boîte noire pour passer sur la même plateforme gouvernée que les données qu'ils consomment. Les modèles sont entraînés, versionnés et enregistrés dans Unity Catalog, créant une reproductibilité complète et une chaîne de lignage unique, des transactions brutes aux sorties de modèles. Lorsque les auditeurs ou les régulateurs demandent "Comment ce chiffre de réserve ou de capital a-t-il été produit ?", la réponse est un pipeline traçable et gouverné, et non le classeur d'un employé.

Ce n'est pas de la théorie : Databricks alimente le DAF moderne

- Une banque mondiale de premier plan : En résolvant le problème de fragmentation, ils ont réduit les temps de traitement des données réglementaires pour le reporting de liquidité de 10 heures à seulement 8 minutes. Ce gain de performance de 75x permet à leur équipe de trésorerie de réagir à la volatilité du marché avec une vitesse sans précédent.

- Nationwide Insurance : Les équipes financières et marketing de Nationwide s'appuyaient sur des modèles de risque fragiles basés sur des feuilles de calcul et des modèles de risque basés sur SAS. Les frais d'infrastructure et les cycles de reporting longs et manuels signifiaient que les informations critiques sur la tarification et les performances prenaient des semaines au lieu de minutes, limitant leur capacité à réagir aux conditions du marché. Ils ont construit un cadre d'harmonisation des données avec des pipelines déclaratifs Spark et des entrepôts SQL Serverless pour remplacer les flux de travail sur feuilles de calcul. Cela a entraîné une amélioration de 5 points de pourcentage du ratio combiné et une amélioration de 3 points de pourcentage du ratio des dépenses.

- Databricks fonctionne sur Databricks : Notre propre bureau du DAF utilise la plateforme pour unifier et gouverner les données transactionnelles (ERP, CRM, SIRH, planification) en une source de vérité unique et gouvernée. L'adoption interne de la plateforme Databricks en tant que client 0 génère des résultats mesurables

- Cycles de clôture et de prévision plus rapides

- Élimination du "quel est le bon chiffre" et ingestion transparente des données de feuilles de calcul via une source de vérité unique unifiée

- Analyses, informations et prévisions pilotées par l'IA en langage naturel avec Genie

- Préparation à l'audit pour la conformité SOX via Unity Catalog

Les systèmes hérités n'ont pas été conçus pour la vitesse de la révolution de l'IA. Le bureau du DAF doit dépasser l'ère des multiples solutions ponctuelles fragmentées pour les données + l'IA. Databricks est la colonne vertébrale de la pile du DAF du futur. En unifiant chaque signal transactionnel en une source de vérité unique et gouvernée, nous passons du reporting du passé à l'utilisation de l'IA pour gérer notre entreprise en temps réel. — Dave Conte, DAF de Databricks

Conclusion : La nouvelle norme pour le leadership du DAF

La "Pile du DAF du Futur" est une plateforme unifiée où convergent les transactions, l'analyse prédictive et l'IA.

Alors que le rôle du DAF continue d'évoluer, les enjeux n'ont jamais été aussi élevés. Ceux qui continueront à fonctionner en mode batch T+1 se retrouveront contraints par un "capital dormant" et des coûts réglementaires croissants. Inversement, les DAF qui adoptent une architecture Lakehouse transforment leurs départements de centres de coûts qui rendent compte de la valeur en hubs stratégiques qui créent de la valeur.

Ce post marque le début de notre exploration de la modernisation du bureau des finances. Bien que nous ayons établi les exigences architecturales pour le DAF moderne, le véritable test de cette plateforme réside dans son application aux variables les plus volatiles de l'industrie.

Dans la deuxième partie de cette série, nous passerons de la stratégie architecturale à l'exécution fonctionnelle. Nous approfondirons la planification de scénarios de dépôts pilotée par l'IA et l'optimisation du PPNR, en démontrant comment la modélisation pilotée par l'IA des dépôts de trésorerie et du PPNR permet aux dirigeants d'aller au-delà des moyennes historiques "bêta" pour atteindre la précision chirurgicale de tarification nécessaire pour protéger le bilan et maximiser les revenus en temps réel.

Voyez-le en action dès aujourd'hui

L'avenir de la finance n'est pas seulement piloté par les données ; il est dirigé par l'intelligence. La transition vers un bureau du DAF moderne commence par voir ce qui est possible sur vos propres données. Pour voir ces flux de travail en action, y compris une démo en direct du Unified Treasury Hub et de notre planification de scénarios pilotée par l'IA, contactez dès aujourd'hui votre équipe de compte Databricks.

Restez à l'écoute pour la partie 2 : « Améliorer les performances PPNR grâce à l'intelligence des dépôts en temps réel »

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.