Présentation du cadre de sécurité de l'IA Databricks (DASF)

Un cadre opérationnel pour gérer la sécurité de l'IA

par Omar Khawaja, Arun Pamulapati, Kelly Albano et Erika Ehrli

Nous sommes ravis d'annoncer la publication du livre blanc Databricks AI Security Framework (DASF) version 1.0 ! Ce cadre est conçu pour améliorer le travail d'équipe entre les groupes métier, informatique, données, IA et sécurité. Il simplifie les concepts d'IA et de ML en cataloguant la base de connaissances des risques de sécurité de l'IA, basée sur des observations d'attaques réelles, et offre une approche de défense en profondeur pour la sécurité de l'IA, tout en fournissant des conseils pratiques pour une application immédiate.

L'apprentissage automatique (ML) et l'IA générative (GenAI) transforment l'avenir du travail en améliorant l'innovation, la compétitivité et la productivité des employés. Cependant, les organisations sont confrontées au double défi de tirer parti des technologies d'intelligence artificielle (IA) pour saisir des opportunités tout en gérant les risques potentiels de sécurité et de confidentialité, tels que les violations de données et la non-conformité réglementaire.

Ce blog donnera un aperçu du DASF, expliquera comment l'utiliser pour sécuriser les initiatives d'IA de votre organisation, partagera une mise à jour sur notre élan externe et guidera en toute sécurité l'adoption de l'IA dans votre organisation.

Construire les fondations du Databricks AI Security Framework

L'IA impacte toutes les industries et transforme notre façon de travailler. Plus que jamais, les dirigeants souhaitent exploiter les données et l'IA pour transformer leurs organisations. La sécurité et la gouvernance de l'IA sont essentielles pour établir la confiance dans les objectifs d'IA de votre organisation. Selon Gartner, la gestion de la confiance, des risques et de la sécurité de l'IA est la tendance stratégique n°1 en 2024 qui influencera les décisions commerciales et technologiques, et d'ici 2026, les modèles d'IA des organisations qui opérationnalisent la transparence, la confiance et la sécurité de l'IA atteindront une augmentation de 50 % en termes d'adoption, d'objectifs commerciaux et d'acceptation par les utilisateurs.

Plus tôt cette année, nous avons annoncé l' acquisition de MosaicML par Databricks et avons partagé davantage sur notre engagement envers l'IA responsable. Au cours des derniers mois, nous avons continué à renforcer notre engagement et notre élan en tant que leader de l'industrie de l'IA grâce à de nouveaux partenariats. Pour compléter ces investissements, l'équipe de sécurité Databricks organise désormais des ateliers sur la sécurité de l'IA pour les RSSI afin d'éduquer les organisations sur la manière de mener à bien leur parcours IA de manière soucieuse des risques. Nous avons appris de nos clients que les équipes de sécurité et de gouvernance peinent à trouver du matériel fiable qui démystifie ce qu'est l'IA, comment elle fonctionne et quels risques de sécurité peuvent survenir lors du déploiement de ces technologies.

Nous avons utilisé ces apprentissages pour développer le cadre DASF afin d'aider les équipes métier, informatiques, de données, IA et de sécurité à mieux collaborer dans le déploiement de l'IA selon les principes suivants :

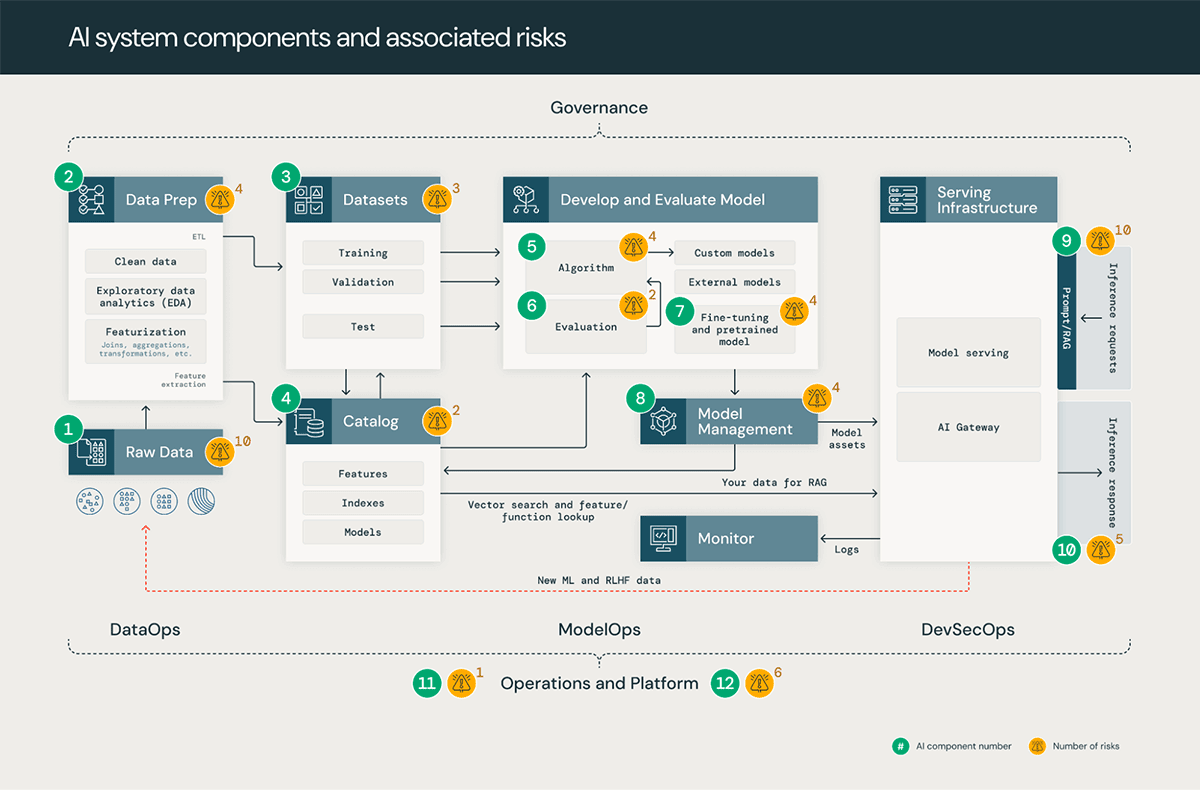

- Démystifier l'IA et le ML : Le DASF décompose les 12 composantes d'un système d'IA, les types de modèles d'IA existants et leur fonctionnement conjoint. Cela aide l'équipe à travailler ensemble en définissant une nomenclature commune des systèmes, processus et personas d'IA impliqués.

- Fournir une approche de défense en profondeur pour sécuriser l'IA : Dans nos conversations avec les leaders de la sécurité, il doit y avoir une clarté quant à savoir si la sécurité de l'IA est un problème de cybersécurité, un problème d'apprentissage automatique contradictoire ou quelque chose de complètement nouveau. La réalité est que c'est tout cela à la fois. Le DASF fournit un cadre pour comprendre les 55 risques de sécurité à travers les trois étapes de tout système d'IA en fonction de vos cas d'utilisation spécifiques de l'IA et de vos modèles de déploiement. Nous mettons également en correspondance les risques avec des cadres de sécurité IA courants tels que MITRE ATLAS, OWASP Top 10 pour les LLM, et la taxonomie AML du NIST.

- Fournir des recommandations actionnables : De nombreux cadres existants font un bon travail pour décrire les risques associés à l'IA, mais ils ne décrivent pas clairement les contrôles nécessaires pour les atténuer. Le DASF recommande 53 contrôles applicables à toute plateforme de données et d'IA que vous utilisez. Si vous êtes un client Databricks, nous allons plus loin : nous avons inclus des liens vers la documentation Databricks (par cloud) pour fournir des instructions spécifiques sur la mise en œuvre de chaque contrôle d'atténuation !

Démarrer avec le Databricks AI Security Framework

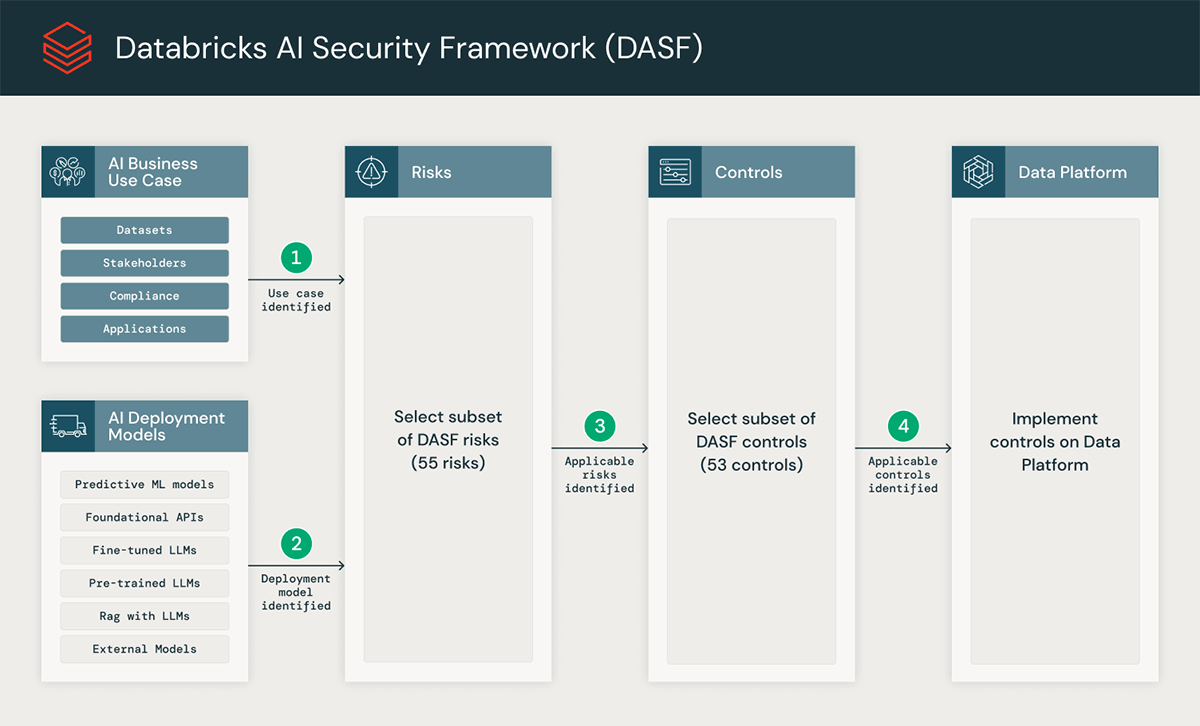

Le DASF a été conçu de telle sorte que, quelle que soit la plateforme de données et d'IA que vous utilisez, vous puissiez obtenir un profil de risque de bout en bout pour les besoins de déploiement d'IA de votre organisation, avec un ensemble concret de contrôles que vous devriez envisager de mettre en œuvre. Pour commencer avec le DASF, nous recommandons l'approche suivante, comme illustré dans la figure ci-dessous :

Étape 1 - Identifier le cas d'utilisation métier de l'IA : Travaillez avec vos parties prenantes, qu'ils soient déjà implémentés ou en phase de planification, sur les cas d'utilisation de l'IA de votre organisation. Nous recommandons d'utiliser les accélérateurs de solutions Databricks, qui sont des guides spécialement conçus pour accélérer les résultats sur vos cas d'utilisation d'IA et de ML les plus courants et les plus impactants. Examinez les jeux de données qui seront utilisés, les exigences de conformité applicables et les applications que ces systèmes d'IA impacteront afin de définir les capacités de base requises de votre plateforme de données et d'IA.

Étape 2 - Déterminer le modèle de déploiement de l'IA : Choisissez un modèle de déploiement approprié tel que les modèles ML prédictifs, les LLM RAG, les LLM affinés, les LLM pré-entraînés, les modèles fondamentaux et les modèles externes. Chaque modèle de déploiement a une répartition variable de responsabilité partagée entre les 12 composantes du système d'IA et entre votre organisation, votre plateforme de données et d'IA, et les partenaires impliqués.

Étape 3 - Sélectionner les risques les plus pertinents : Parmi notre liste documentée de 55 risques de sécurité, identifiez les plus pertinents pour votre organisation en fonction du cas d'utilisation et du modèle de déploiement que votre organisation met en œuvre. Pour la plupart des cas d'utilisation, seul un petit sous-ensemble des 55 risques devra être traité.

Étape 4 - Choisir et mettre en œuvre les contrôles : Sélectionnez les contrôles qui correspondent à l'appétit pour le risque de votre organisation. Ces contrôles sont définis de manière générique pour être compatibles avec n'importe quelle plateforme de données et d'IA. Notre cadre fournit également des directives pour adapter ces contrôles spécifiquement à la plateforme d'intelligence de données Databricks, avec des instructions de mise en œuvre spécifiques à Databricks par cloud. Vous utilisez ces contrôles parallèlement aux politiques de votre organisation et disposez de l'assurance adéquate.

Si cela vous semble encore beaucoup, nous continuerons d'organiser nos ateliers sur la sécurité de l'IA pour ceux qui souhaitent une expérience interactive.

Favoriser la sécurité de l'IA grâce aux alliés, partenaires et clients de l'industrie

Dans l'industrie de la sécurité, la culture de la collaboration entre pairs est impérative pour assurer la sécurité, la sûreté et le succès collectifs. Nous ne pourrions pas publier un document comme le DASF aujourd'hui sans les normes, les cadres et les outils tiers qui nous ont précédés, tels que les Guidelines for Secure AI System Development, le NIST AI Risk Management Framework, et le Multilayer Framework for Good Cybersecurity Practices for AI. Beaucoup d'autres sont référencés dans le DASF et peuvent être consultés dans la section ressources.

Bien que nous ayons effectué d'innombrables revues internes avec nos experts en IA, ML et sécurité chez Databricks, nous avons également rencontré 15 leaders de l'industrie de la sécurité de l'IA, y compris ceux de HITRUST, de l'Université Carnegie Mellon, de Capital One, de Protect AI et de Barracuda (et d'autres cités ci-dessous !). Nous les remercions pour leur temps, leurs idées et leurs commentaires sur la manière de rendre le DASF le plus pratique possible pour nos pairs. Une liste complète des examinateurs se trouve dans la section remerciements du DASF.

"Quand je pense à ce qui fait un bon accélérateur, il s'agit de rendre les choses plus fluides, plus efficaces et de favoriser l'innovation. Le DASF est un outil éprouvé et efficace pour les équipes de sécurité afin d'aider leurs partenaires à tirer le meilleur parti de l'IA. De plus, il s'aligne sur les cadres de risque établis comme le NIST, donc il ne s'agit pas seulement d'accélérer les choses – il s'agit de jeter des bases solides en matière de sécurité." — Riyaz Poonawala, Vice-président de la sécurité de l'information, Navy Federal Credit Union

"Les entreprises n'ont pas à sacrifier la sécurité pour l'innovation en IA. Le Databricks AI Security Framework est un outil complet pour permettre l'adoption de l'IA en toute sécurité. Il ne se contente pas de faire correspondre les préoccupations de sécurité de l'IA au pipeline de développement de l'IA, mais les rend actionnables pour les clients Databricks avec des contrôles pratiques. Nous sommes ravis d'avoir contribué au développement de cette précieuse ressource communautaire." — Hyrum Anderson, CTO, Robust Intelligence

"Le DASF est un excellent exemple du leadership de Databricks en matière d'IA et constitue une contribution précieuse à l'industrie à un moment critique. Nous savons que le plus grand risque associé à l'intelligence artificielle dans un avenir prévisible est les personnes malveillantes et ce cadre offre un contrepoids efficace à ces cybercriminels. Le DASF est un moyen pragmatique, opérationnel et efficace de sécuriser votre organisation." — Chris "Tito" Sestito, PDG et co-fondateur de HiddenLayer

Faites le premier pas pour étendre une solide base de sécurité IA – téléchargez le Databricks AI Security Framework et engagez-vous avec notre équipe

Le livre blanc Databricks AI Security Framework est disponible en téléchargement sur le Databricks Security and Trust Center. Nous avons fait un effort concerté pour assurer l'exactitude, et notre équipe est désireuse de recevoir vos commentaires. Si vous avez des commentaires ou des questions, veuillez nous contacter par e-mail à dasf@databricks.com. Cet alias est également l'endroit où vous pouvez demander plus d'informations sur la participation à un prochain atelier sur la sécurité de l'IA ou en planifier un dédié pour votre organisation. Consultez notre nouvelle page sur la sécurité de l'IA pour des ressources détaillées sur la sécurité de l'IA et du ML.

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.