Sécurité & Trust Center

La sécurité de vos données est notre priorité.

Sécurité de l'IA

Bonnes pratiques pour atténuer les risques associés aux modèles d'IA

La sécurité de l'IA fait référence aux pratiques, mesures et stratégies mises en œuvre pour protéger les systèmes d'intelligence artificielle, les modèles et les données contre tout accès non autorisé, toute manipulation ou toute activité malveillante. Les organisations doivent mettre en œuvre des protocoles de sécurité robustes, des méthodes de chiffrement, des contrôles d'accès et des mécanismes de monitoring pour protéger les assets d'IA et atténuer les risques potentiels associés à leur utilisation.

L'équipe de sécurité Databricks accompagne nos clients pour sécuriser le déploiement de l'IA et du machine learning sur Databricks, en recommandant des fonctionnalités adaptées aux exigences de leur architecture. Nous travaillons également avec des dizaines d'experts en interne chez Databricks et au sein de la Communauté plus large du ML et de l'IA générative pour identifier les risques de sécurité pour les systèmes d'IA et définir les contrôles nécessaires pour atténuer ces risques.

Comprendre les systèmes d'IA

Quels sont les composants d'un système d'IA et comment fonctionnent-ils ensemble ?

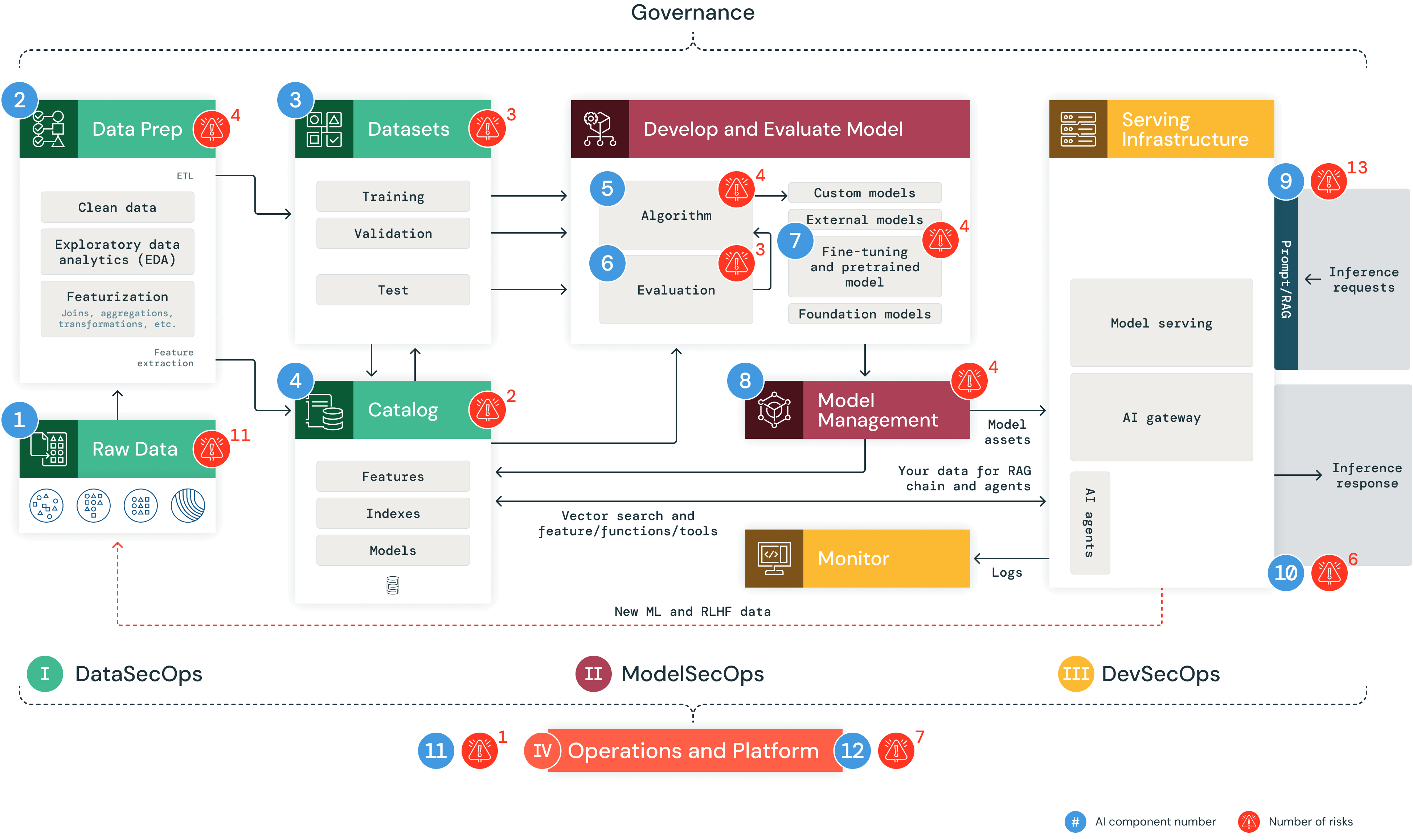

Les systèmes d'IA se composent de données, de code et de modèles. Un système d'IA de bout en bout classique comporte 12 composants d'architecture fondamentaux, généralement classés en quatre grandes étapes :

- Les opérations sur les données incluent l'ingestion et la transformation des données, ainsi que la garantie de leur sécurité et de leur gouvernance. De bons modèles de ML dépendent de pipelines de données fiables et d'une infrastructure sécurisée.

- Les Opérations sur les modèles incluent la création de modèles personnalisés, l'acquisition de modèles sur une marketplace de modèles ou l'utilisation de grands modèles linguistiques (LLM) en mode software-as-a-service (SaaS), tels qu'OpenAI. Le développement d'un modèle nécessite une série d'expérimentations et un moyen de suivre et de comparer les conditions et les résultats de ces expérimentations.

- Le déploiement et le service des modèles consistent à créer des images de modèles de manière sécurisée, à isoler et à servir les modèles de manière sécurisée, à effectuer une mise à l'échelle automatisée, à limiter le débit et à effectuer le monitoring des modèles déployés.

- Les opérations et la plateforme incluent la gestion des vulnérabilités de la plateforme et l'application de correctifs, l'isolation des modèles et les contrôles du système, ainsi que l'accès autorisé aux modèles avec une sécurité intégrée à l'architecture. Il comprend également des outils opérationnels pour le CI/CD. Cela garantit que l'ensemble du cycle de vie répond aux normes requises en sécurisant les environnements d'exécution distincts (développement, préproduction et production) pour le MLOps.

L'image ci-dessous met en évidence les 12 composants et la manière dont ils interagissent au sein d'un système d'IA.

Comprendre les risques de sécurité de l'IA

Quelles sont les menaces de sécurité qui peuvent survenir lors de l'adoption de l'IA ?

Dans notre analyse des systèmes d'IA, nous avons identifié 62 risques de sécurité techniques parmi les 12 composants fondamentaux de l'architecture. Dans le tableau ci-dessous, nous présentons ces composants de base, qui correspondent aux étapes de tout système d'IA, et mettons en évidence quelques exemples de risques de sécurité. La liste complète des 62 risques de sécurité techniques est disponible dans le Databricks AI Security Framework.

Étape du système d'IA | Composants du système d'IA | Risques de sécurité potentiels |

|---|---|---|

Opérations sur les données | 1. Données brutes 2. Préparation des données 3. datasets 4. Catalogue et gouvernance | 20 risques spécifiques tels que :

|

Opérations sur les modèles | 5. Algorithme de ML 6. Évaluation 7. Construction du modèle 8. Gestion des modèles | 15 risques spécifiques tels que :

|

Déploiement et mise en service de modèles | 9. Model Serving — requêtes d'inférence 10. Model Serving — réponses d'inférence | 19 risques spécifiques tels que :

|

Opérations et plateforme | 11. Opérations ML 12. Plateforme de ML | 8 risques spécifiques tels que :

|

Quels contrôles sont disponibles pour atténuer les risques de sécurité de l'IA ?

Il existe 64 contrôles prescriptifs pour atténuer les 62 risques de sécurité de l'IA identifiés. Ces contrôles comprennent :

- Meilleures pratiques en matière de cybersécurité, telles que le Single Sign On, les techniques de chiffrement, les contrôles de la bibliothèque et du code source et les contrôles d'accès au réseau avec une approche de défense en profondeur pour gérer les risques

- Contrôles spécifiques à la gouvernance des données et de l'IA, tels que la classification des données, le data lineage, la gestion des versions des données, le suivi des modèles, les autorisations sur les data et model assets et la gouvernance des modèles

- Des contrôles spécifiques à l'IA comme l'isolation du service de modèles, les outils de prompt, l'audit et le monitoring des modèles, le MLOps et le LLMOps, la gestion centralisée des LLM, l'affinement et le pré-entraînement de vos modèles

Si vous souhaitez obtenir une présentation approfondie des risques de sécurité associés aux systèmes d'IA et des contrôles à mettre en œuvre pour chaque risque, nous vous invitons à télécharger notre livre blanc sur la sécurité de Databricks AI.

Meilleures pratiques pour sécuriser les modèles d'IA et de ML

Les équipes chargées des données et de la sécurité doivent collaborer activement pour atteindre leur objectif d'amélioration de la sécurité des systèmes d'IA. Que vous implémentiez des solutions de machine learning traditionnelles ou des applications basées sur les LLM, Databricks vous recommande de suivre les étapes décrites dans le livre blanc sur la sécurité de l'IA de Databricks.

FAQ

Ressources sur la sécurité de l'IA

Cadre de sécurité de l'IA de Databricks (DASF)

L'équipe de sécurité de Databricks a créé le Databricks AI Security Framework (DASF) pour faire face aux vulnérabilités en constante évolution des systèmes d'IA avec une approche holistique visant à atténuer les risques au-delà de la sécurité des modèles.

Atelier sur les risques de l'IA Databricks

L'équipe de sécurité de Databricks organise des ateliers sur les risques liés à l'IA pour aider les responsables à comprendre les systèmes d'IA, leurs risques et les stratégies d'atténuation.

Formation sur les principes fondamentaux de la sécurité de l'IA

Ce cours explore les principes fondamentaux de la sécurité dans les systèmes d'IA au sein de la plateforme Databricks Data Intelligence Platform, en cinq modules complets.

Événements et webinaires sur la sécurité de l'IA

Les responsables de la sécurité de Databricks partagent régulièrement leur expertise lors d'événements avec des leaders du secteur, des entreprises, des agences et des fournisseurs.