Qu'est-ce que le protocole de contexte de modèle (MCP) ?

Permettre aux modèles d'IA d'accéder en toute sécurité à des sources de données et à des outils externes grâce à un cadre d'intégration standardisé.

- Comprendre le protocole MCP (Model Context Protocol) et comment il fournit une interface unifiée pour connecter les modèles d'IA aux ressources externes.

- Découvrir comment le protocole MCP permet aux agents d'interagir en toute sécurité avec les bases de données, les API, les systèmes de fichiers et les outils d'entreprise.

- Découvrir comment les protocoles standardisés améliorent la fiabilité, la sécurité et l'interopérabilité des agents sur différents systèmes et plateformes.

Introduction : Comprendre le Model Context Protocol

Le protocole MCP (Model Context Protocol) est un standard ouvert qui permet aux applications d'IA de se connecter de manière transparente à des sources de données, des outils et des systèmes externes. Considérez le Model Context Protocol comme un port USB-C pour les systèmes d'IA — tout comme un port USB-C standardise la manière dont les appareils se connectent aux ordinateurs, le MCP standardise la manière dont les agents d'IA accèdent aux Ressources externes telles que les bases de données, les APIs, les systèmes de fichiers et les bases de connaissances.

Le protocole de contexte s'attaque à un défi majeur dans la création d'agents d'IA : le « problème d'intégration N×M ». Sans protocole normalisé, chaque application d'IA doit s'intégrer directement à chaque service externe, ce qui crée N×M intégrations distinctes, où N représente le nombre d'outils et M le nombre de clients. Cette approche devient rapidement impossible de monter en charge. Le Model Context Protocol (MCP) résout ce problème en exigeant que chaque client et chaque serveur MCP n'implémentent le protocole qu'une seule fois, ce qui réduit le nombre total d'intégrations de N×M à N+M.

En permettant aux systèmes d'IA d'accéder à des données en temps réel au-delà des données d'entraînement de leur LLM, MCP aide les modèles d'IA à fournir des réponses précises et à jour plutôt que de se fier uniquement aux données d'entraînement statiques de leur phase d'apprentissage initiale.

Qu'est-ce qu'un protocole de contexte de modèle ?

Le Model Context Protocol est une norme open source unifiée pour l'interopérabilité qui permet aux développeurs de créer des applications d'IA contextuelles. MCP complète les LLMOps en exposant des contrôles d'intégration d'exécution, d'observabilité et de gouvernance qui simplifient le déploiement, le monitoring et la gestion du cycle de vie des applications LLM.

Les applications d'IA doivent avoir accès à des actifs tels que des ressources locales, des bases de données, des pipelines de données (en streaming/par lots), des moteurs de recherche, des calculateurs et des flux de travail pour le conditionnement des prompts et la génération ancrée. Le protocole de contexte normalise la manière dont les applications se connectent à ces actifs via une méthode structurée qui réduit le code d'intégration répétitif.

Le problème de mise à l'échelle signifie que les modèles d'IA (en particulier les grands modèles de langage) doivent généralement s'appuyer sur des données préexistantes et statiques pour leur entraînement. Cela peut entraîner des réponses inexactes ou obsolètes, car les modèles entraînés sur des datasets statiques nécessitent des mises à jour supplémentaires pour intégrer de nouvelles informations. En répondant aux problèmes d'évolutivité, le MCP permet aux applications d'IA d'être conscientes du contexte et de fournir des résultats à jour qui ne sont pas limités par les contraintes des données d'entraînement statiques.

Qu'est-ce que le MCP et pourquoi est-il utilisé ?

Le protocole de contexte de modèle (MCP) sert de moyen normalisé pour que les applications d'IA découvrent et interagissent avec des outils et des sources de données externes au moment de l'exécution. Plutôt que de coder en dur les connexions à chaque service externe, les agents d'IA utilisant le MCP peuvent découvrir dynamiquement les outils disponibles, comprendre leurs capacités via des appels structurés et les invoquer avec les autorisations d'outils appropriées.

Le MCP est utilisé parce qu'il transforme la manière dont les outils basés sur l'IA accèdent aux informations. Les systèmes d'IA traditionnels sont limités par leurs données d'entraînement, qui deviennent rapidement obsolètes. Le protocole de contexte permet aux développeurs de créer des agents d'IA capables d'effectuer des tâches en utilisant des données en temps réel provenant de systèmes d'entreprise populaires, d'environnements de développement et d'autres sources externes, le tout via un protocole unique et normalisé.

Le protocole ouvert réduit également le code d'intégration répétitif. Au lieu d'écrire des connecteurs personnalisés pour chaque nouvelle intégration, les développeurs implémentent MCP une seule fois, côté client et côté serveur. Cette approche est particulièrement précieuse pour les systèmes d'IA agentifs qui doivent découvrir et utiliser de manière autonome plusieurs outils dans différents contextes.

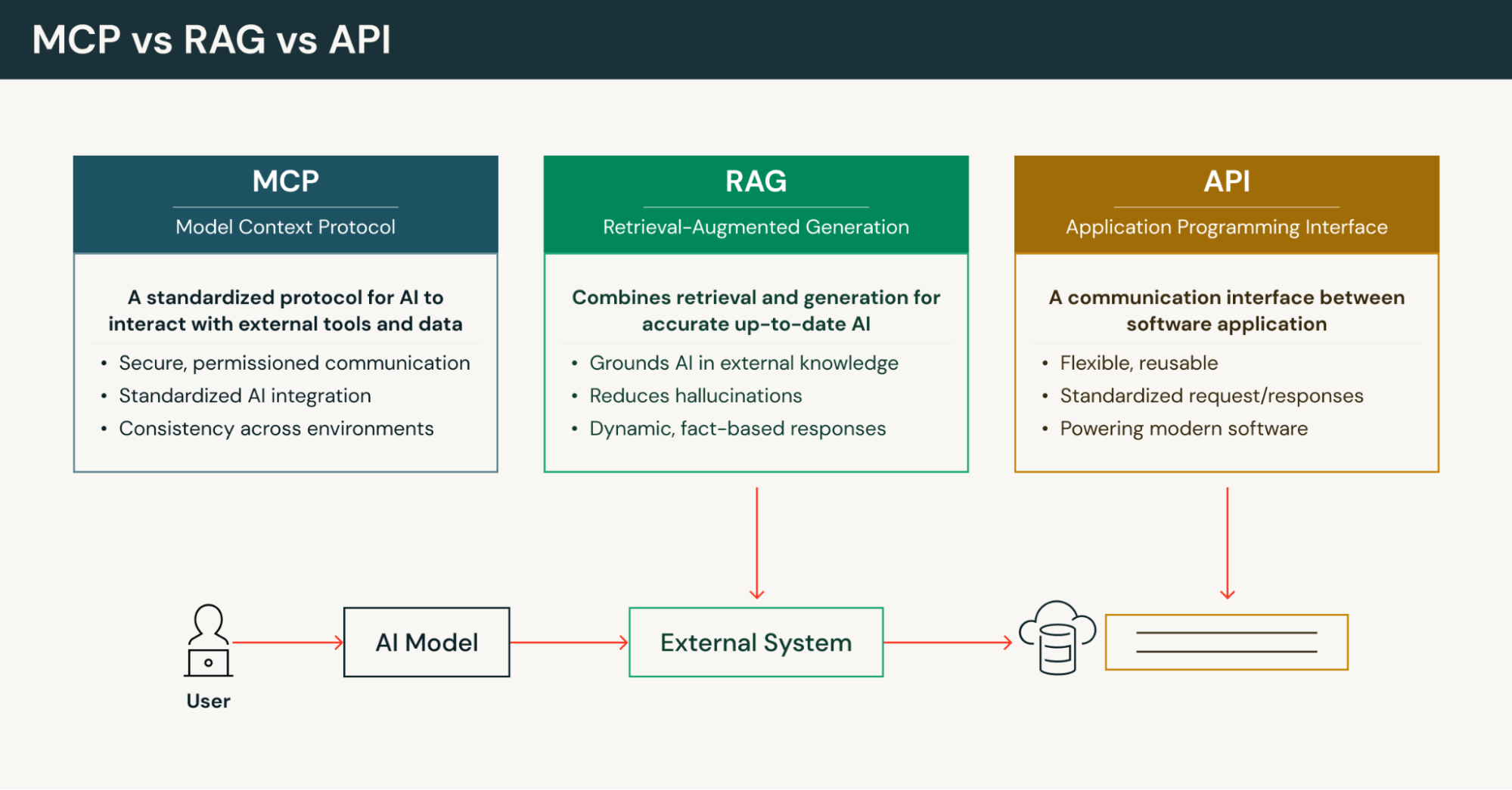

Qu'est-ce que le MCP par rapport à une API ?

Limitations des API classiques

Les API traditionnelles exposent des points de terminaison avec des paramètres typés que les clients doivent coder en dur et mettre à jour chaque fois qu'une API change. L'assemblage du contexte devient la responsabilité du client, car les API fournissent des indications sémantiques minimales sur la manière dont les données renvoyées doivent être utilisées. Une requête API suit généralement un modèle simple de type requête-réponse sans maintenir l'état ou le contexte entre les appels.

En quoi le protocole de contexte de modèle diffère

MCP définit une approche différente de celle des APIs classiques. Plutôt que des Endpoints codés en dur, les serveurs MCP exposent une surface de capacités lisible par une machine et découvrable à l'exécution. Les systèmes d'IA peuvent requêter les outils, les Ressources et les invites disponibles au lieu de s'appuyer sur des connexions prédéfinies. Le protocole de contexte de modèle normalise les formes des ressources (documents, lignes de base de données, fichiers), ce qui réduit la complexité de la sérialisation afin que les modèles d'IA reçoivent un contexte pertinent et optimisé pour le raisonnement.

Les implémentations MCP prennent en charge la communication bidirectionnelle avec état avec une sémantique de streaming. Cela permet aux serveurs MCP de pousser les mises à jour et les notifications de progression directement dans la boucle de contexte d'un agent d'IA, prenant en charge les flux de travail en plusieurs étapes et les résultats partiels que les APIs traditionnelles ne peuvent pas fournir en mode natif. Cette architecture client-serveur permet des modèles d'utilisation d'outils plus sophistiqués dans les systèmes agentifs.

MCP contre RAG : des approches complémentaires

La génération augmentée par récupération (RAG) améliore la précision de l'IA en convertissant les documents en embeddings, en les stockant dans des bases de données vectorielles et en récupérant des informations pertinentes pendant la génération. Cependant, la RAG s'appuie généralement sur des sources statiques et indexées provenant de repositories de contenu. Le protocole de contexte de modèle fournit un accès à la demande à des API, des bases de données et des Streams en direct, renvoyant un contexte fiable et à jour lorsque la fraîcheur des données est importante.

Contrairement au RAG, qui renvoie principalement un contexte en lecture seule, le protocole de contexte sépare les ressources des outils afin que les agents d'IA puissent à la fois récupérer des données et effectuer des tâches sur des systèmes externes avec des schémas contrôlés. Le MCP répond à des besoins d'intégration plus larges, en permettant des flux de travail d'agents, l'orchestration multi-tours, la découverte de capacités d'exécution et la gouvernance multi-locataire, ce que le RAG ne fournit pas en mode natif.

Le MCP peut compléter les implémentations RAG. Les organisations peuvent utiliser le RAG pour indexer le contenu permanent en vue d'une récupération rapide, tout en utilisant le Model Context Protocol pour les recherches transactionnelles, l'exécution de requêtes SQL et les actions nécessitant le contexte adéquat des systèmes en direct. Cette approche hybride offre à la fois rapidité et précision.

La valeur de la standardisation dans l'écosystème MCP

En tant que protocole bidirectionnel et découvrable à l'exécution, le protocole de contexte de modèle transforme les outils et données externes disparates en ressources adressables et en actions appelables. Un seul client MCP peut découvrir de manière uniforme des fichiers, des lignes de base de données, des extraits de vecteurs, des flux en direct et des Endpoints d'API. Coexistant avec les caches RAG indexés, le MCP offre des recherches de référence et juste-à-temps ainsi qu'une sémantique d'action.

Le résultat pratique est moins de connecteurs sur mesure, moins de code personnalisé, des intégrations plus rapides et des systèmes agentiques plus fiables avec une gestion des erreurs et des pistes d'audit appropriées. Cette méthode normalisée de connexion des assistants IA à des ressources distantes accélère les cycles de développement tout en maintenant les contrôles de sécurité de l'entreprise. L'écosystème MCP bénéficie de cette normalisation à mesure que de plus en plus d'implémentations de serveurs MCP deviennent disponibles pour les systèmes d'entreprise populaires.

Architecture MCP de base : comprendre le modèle client-serveur

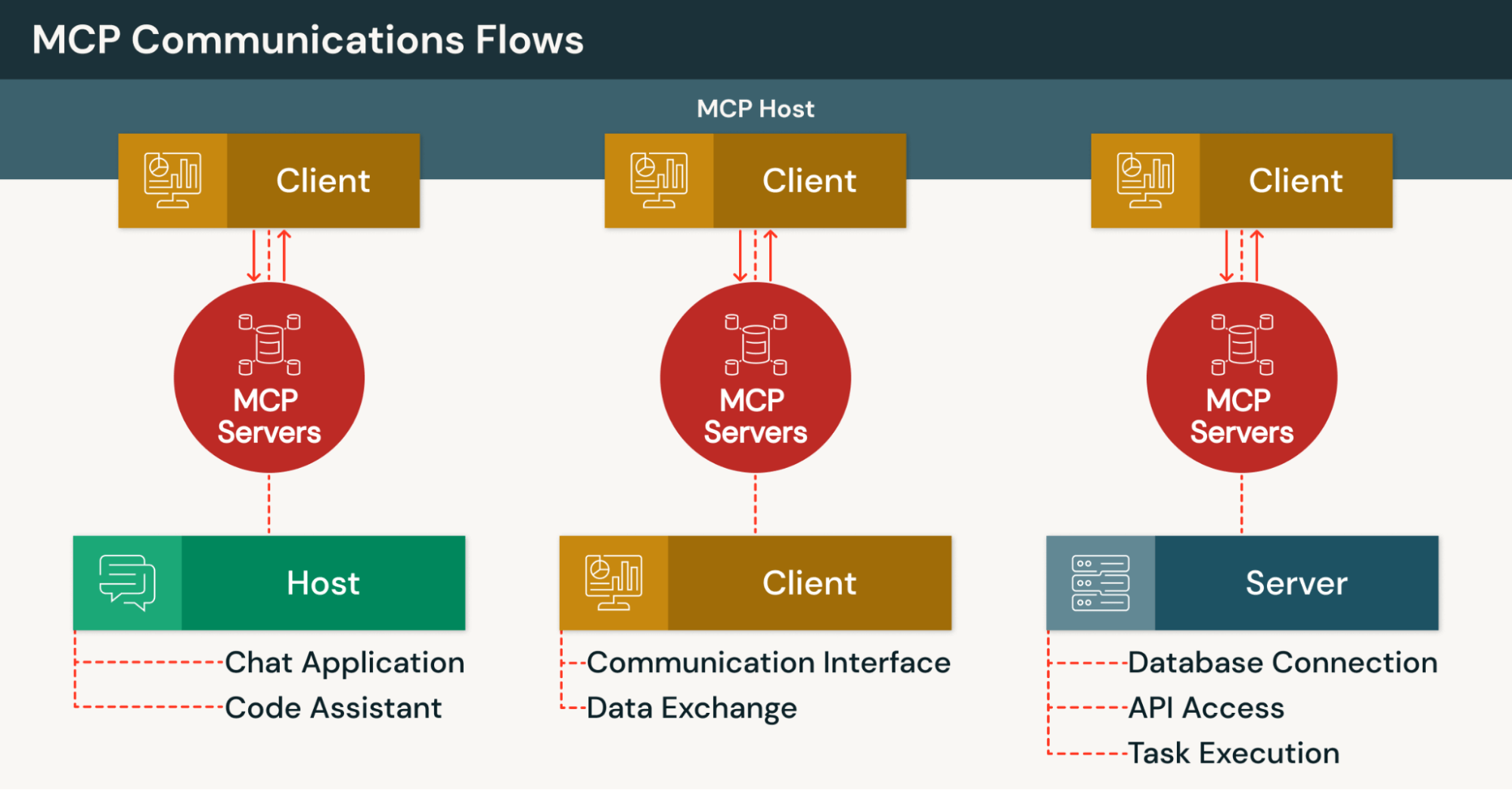

L'architecture MCP organise les intégrations autour de trois rôles clés (serveurs MCP, clients MCP et hôtes MCP) connectés via des canaux de communication persistants. Cette architecture client-serveur permet aux outils d'IA d'exécuter des workflows avec état et à plusieurs étapes plutôt que des interactions requête-réponse isolées.

Fonctionnement des serveurs MCP

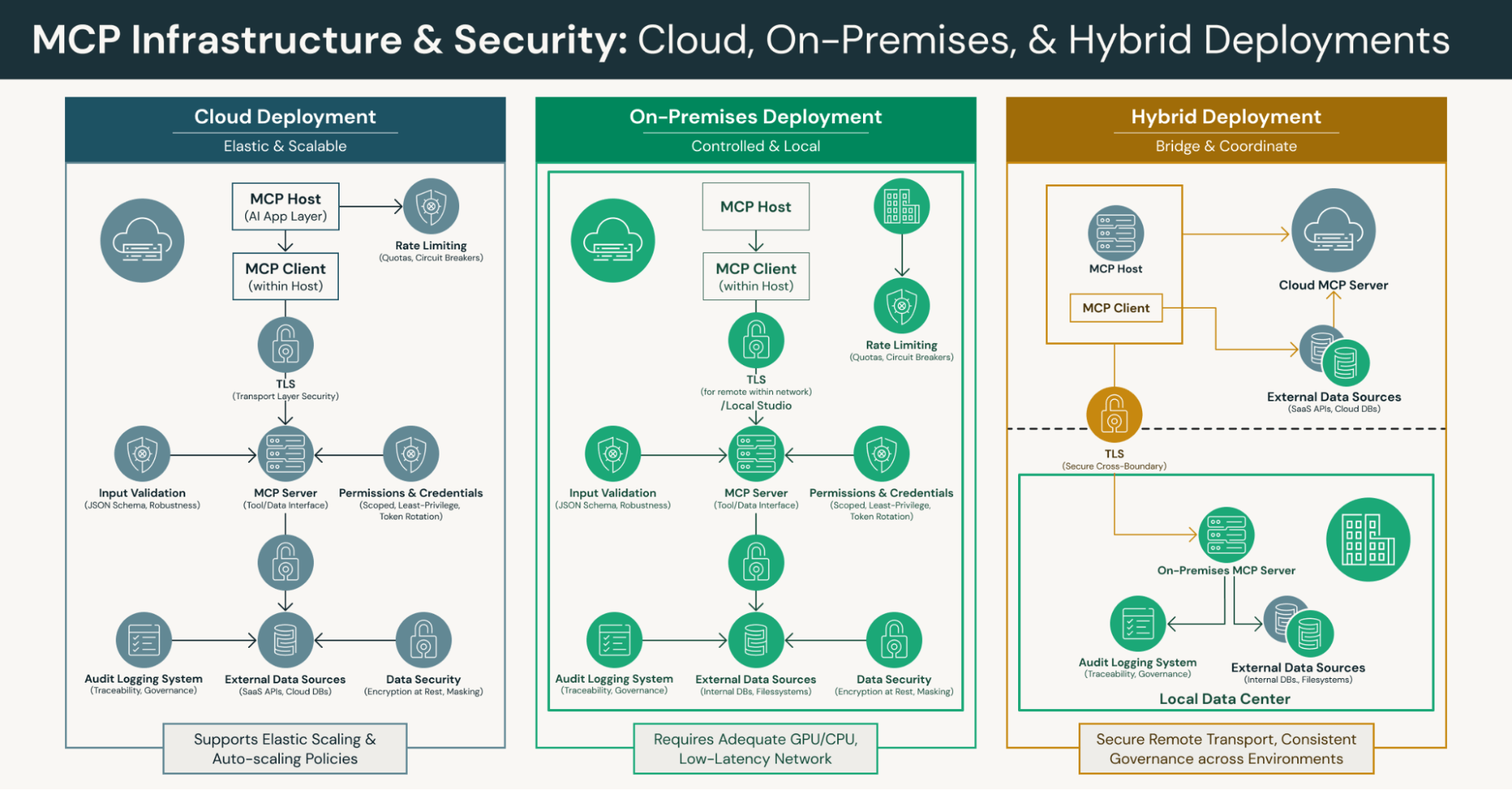

Les serveurs MCP exposent des données et des outils via des interfaces standardisées et peuvent fonctionner dans des environnements cloud, on-premise ou hybrides. Chaque serveur publie une surface de capacités de ressources nommées, d'outils appelables, d'invites et de hooks de notification. Les ressources peuvent inclure des documents, des lignes de base de données, des fichiers et des sorties de pipeline.

Les implémentations de serveur MCP utilisent les méthodes et notifications JSON-RPC 2.0, prennent en charge le streaming pour les opérations de longue durée et fournissent une découverte lisible par machine via la couche de transport. Cela permet aux hôtes MCP et aux modèles d'IA de query les capacités au moment de l'exécution sans nécessiter une connaissance prédéfinie des outils disponibles.

Les implémentations de serveurs MCP populaires connectent les systèmes d'IA à des services externes tels que Google Drive, Slack, GitHub et les bases de données PostgreSQL. Ces serveurs MCP gèrent l'authentification, la récupération de données et l'exécution d'outils tout en présentant une interface cohérente via le protocole standardisé. Chaque serveur de l'écosystème MCP peut servir plusieurs clients simultanément.

Fonctionnement des clients MCP

Les clients MCP sont des composants au sein d'applications hôtes qui traduisent les intentions de l'utilisateur ou du modèle en messages de protocole. Chaque client maintient généralement une connexion un-à-un avec un serveur MCP et gère le cycle de vie, l'authentification et les détails du transport de manière structurée.

Les clients MCP sérialisent les requêtes en appels structurés à l'aide de JSON-RPC, gèrent les notifications asynchrones et les Streams partiels, et présentent une API locale unifiée pour réduire la complexité de l'intégration. Plusieurs clients peuvent fonctionner depuis le même hôte MCP, chacun se connectant simultanément à différents serveurs MCP.

Ces clients permettent aux agents d'IA d'interagir avec des sources de données externes sans comprendre les détails d'implémentation de chaque service externe. Le client gère automatiquement tous les protocoles de communication, le traitement des erreurs et la logique de relance.

Le rôle des hôtes MCP

Les hôtes MCP fournissent la couche d'application d'IA qui coordonne les clients MCP et les capacités du serveur. Parmi les exemples, on peut citer Claude Desktop, Claude Code, les IDEs basés sur l'IA et d'autres plateformes sur lesquelles les agents d'IA opèrent. L'hôte MCP agrège les invites, l'état de la conversation et les réponses du client pour orchestrer des flux de travail multi-outils.

L'hôte MCP décide quand appeler les outils, demander des entrées supplémentaires ou afficher des notifications. Cette orchestration centralisée permet aux modèles d'IA de fonctionner sur des serveurs MCP hétérogènes sans code personnalisé par service, soutenant ainsi l'objectif de l'écosystème MCP d'interopérabilité universelle dans la connexion des assistants IA à divers systèmes.

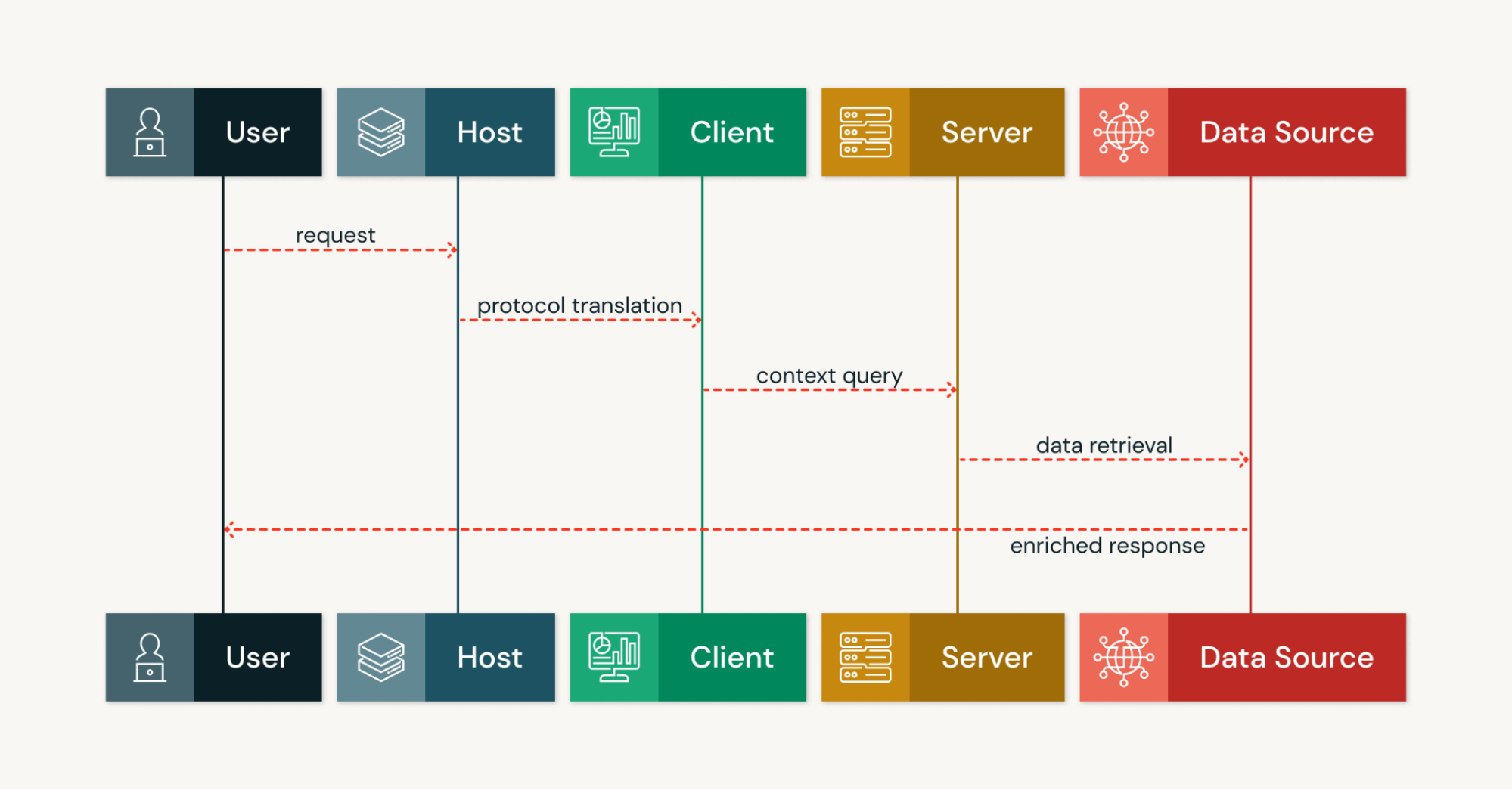

Flux de contexte et communication bidirectionnelle

La communication client-serveur dans le Model Context Protocol est bidirectionnelle et pilotée par message, à l'aide de JSON-RPC 2.0 sur la couche de transport. Les clients MCP appellent des méthodes pour récupérer des Ressources ou invoquer des outils, tandis que les serveurs MCP renvoient des résultats, diffusent en continu des sorties partielles et envoient des notifications contenant des information pertinentes.

Les serveurs MCP peuvent également lancer des requêtes, demandant aux hôtes MCP de proposer des options ou de solliciter une entrée utilisateur via des mécanismes d'appel de fonction. Cette capacité bidirectionnelle distingue le protocole de contexte des modèles d'API unidirectionnels traditionnels. Les recherches de référence en direct du MCP complètent le RAG en fournissant des enregistrements juste-à-temps avec des métadonnées de provenance pour la traçabilité.

Les transports persistants préservent l'ordre des messages et permettent des mises à jour en temps réel, autorisant les systèmes d'IA à itérer sur les résultats intermédiaires et à exécuter des boucles d'agents qui rendent possibles les agents d'IA autonomes.

Quelles sont les exigences du protocole de contexte de modèle ?

Exigences de sécurité et protection contre les menaces

Les implémentations MCP doivent appliquer la sécurité de la couche de transport (TLS) pour les transports distants, des autorisations d'outils strictes et des informations d'identification étendues pour se protéger contre les menaces de sécurité. Le protocole requiert une limitation du débit et une validation robuste des entrées via l'application du schéma JSON sur les clients et les serveurs MCP pour empêcher les attaques par injection et les requêtes malformées.

La journalisation d'audit, la rotation des jetons et l'octroi du moindre privilège sont des exigences essentielles pour la gouvernance des canaux de distribution à longue durée de vie. Ces mesures de sécurité protègent contre les accès non autorisés tout en préservant les capacités d'intégration détectables que le Model Context Protocol permet. Les organisations doivent mettre en œuvre le chiffrement en transit et au repos, le masquage et des autorisations délimitées pour les Canaux de distribution MCP à longue durée de vie afin de garantir la sécurité des données.

Infrastructure et exigences système

Les organisations qui déploient le MCP ont besoin d'une infrastructure de compute et de réseau capable d'héberger de grands modèles de langage, des serveurs MCP et des sources de données connectées. Cela inclut une capacité GPU/CPU, une mémoire et des E/S disque suffisantes, ainsi que des chemins réseau à faible latence entre les composants de l'architecture client-serveur.

Les plateformes cloud devraient prendre en charge la mise à l'échelle élastique des instances de modèle et des serveurs MCP. Les équipes doivent définir des politiques d'autoscaling pour les Streams simultanés et les opérations de longue durée. La couche de transport devrait prendre en charge à la fois le STDIO local pour les composants embarqués et les canaux de streaming à distance tels que HTTP/SSE ou WebSocket pour les déploiements distribués.

Exigences de mise en œuvre pour les travaux MCP

Le travail avec le MCP nécessite l'implémentation de la messagerie JSON-RPC 2.0, des Endpoints de découverte et de schémas de Ressources/outils. Les serveurs MCP doivent publier leurs capacités dans un format lisible par machine via le protocole standard. Cela permet aux développeurs de créer des intégrations basées sur la découverte qui prennent en charge la découverte d'outils sans connexions codées en dur.

La gestion des erreurs, les stratégies de reconnexion et la gestion de la contre-pression sont des exigences d'implémentation critiques pour la fiabilité en production. Les organisations doivent implémenter l'observabilité pour les flux persistants, les latences des méthodes et l'utilisation des Ressources à l'aide de métriques, de traces et de logs. Les limiteurs de débit, les disjoncteurs et les quotas protègent les systèmes en aval contre la surcharge.

Avantages pratiques : accès aux données en temps réel et réduction des hallucinations

Avec le Model Context Protocol, les modèles d'IA récupèrent à la demande des enregistrements en direct, des sorties de pipeline, des réponses d'API et des fichiers, plutôt que de dépendre uniquement des embeddings mis en cache ou des données d'entraînement statiques des LLM. Cela ancre les réponses dans des sources de données actuelles et fiables et réduit les hallucinations, où les systèmes d'IA génèrent des informations incorrectes.

Les Ressources renvoyées au moment de la requête incluent des métadonnées de provenance, telles que des ID de source et des Timestamps, ce qui permet aux hôtes MCP de consigner les origines et de rendre les résultats traçables. Cette transparence est cruciale lorsque les agents d'IA effectuent des tâches qui nécessitent une auditabilité dans les secteurs d'activité réglementés. Le protocole de contexte garantit que le contexte pertinent est toujours disponible à partir de systèmes externes faisant autorité.

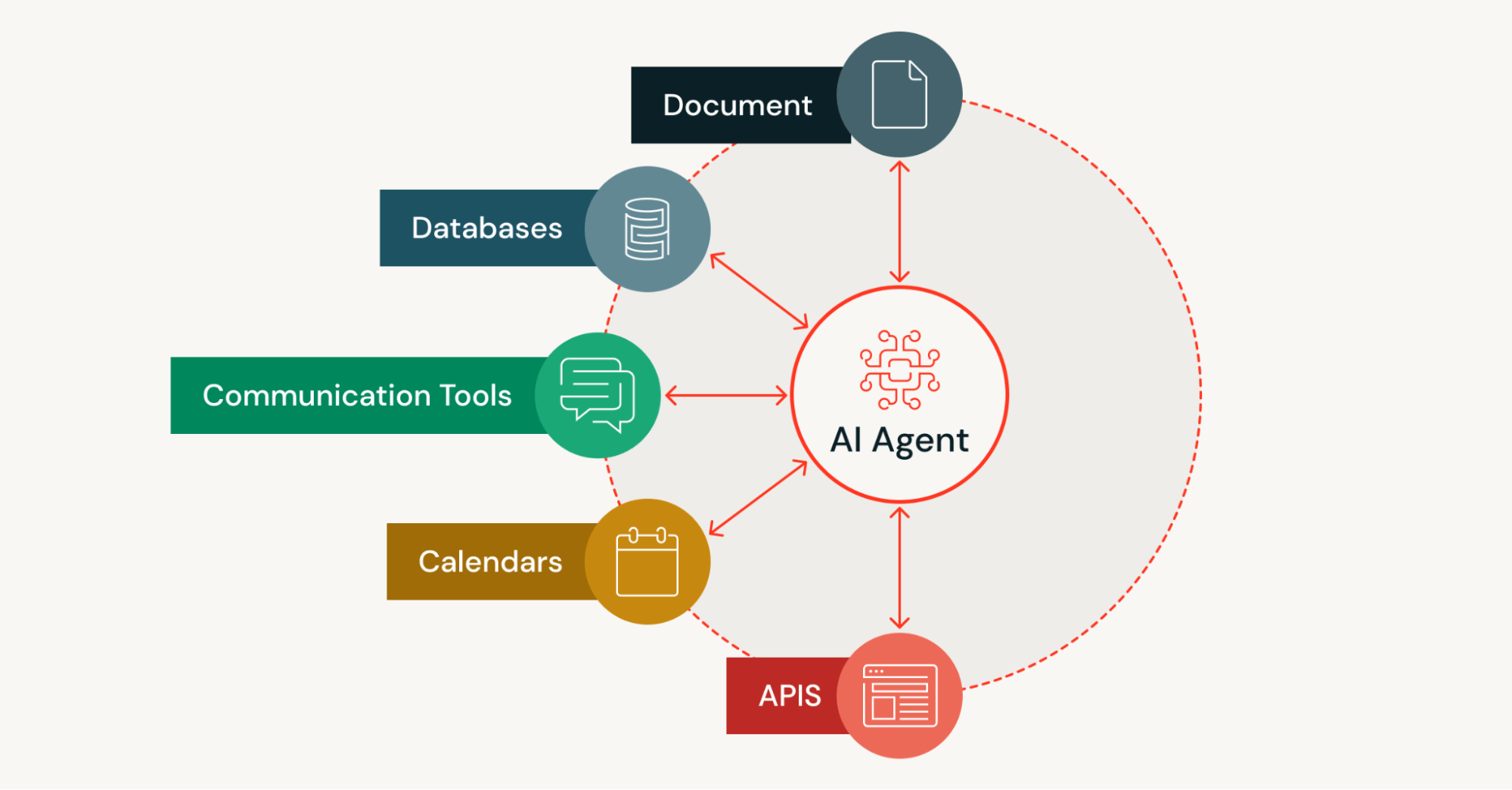

Prise en charge des workflows d'IA agentifs

Comme les serveurs MCP publient des Ressources, des outils et des invites de manière standardisée, les modèles d'IA peuvent découvrir et appeler des services sans endpoints codés en dur. Le standard ouvert prend en charge la sollicitation initiée par le serveur et les réponses en streaming des serveurs MCP, ce qui permet un raisonnement en plusieurs étapes, la clarification des entrées et l'itération sur des résultats partiels.

Les outils exposent des entrées/sorties définies par un schéma JSON avec des autorisations d'outils délimitées, permettant aux agents d'IA d'effectuer des actions contrôlées comme la création de tickets, l'exécution de requêtes SQL ou l'exécution de flux de travail. Cette découverte d'outils autonome, cette interaction bidirectionnelle et ces garde-fous intégrés fournissent la base d'une IA agentique fiable sur des systèmes externes.

Le protocole de contexte de modèle (MCP) permet explicitement des workflows agentiques qui reposent sur la découverte dynamique d'outils et des primitives d'action pour percevoir, décider et agir à travers les systèmes. Cela permet de créer des agents IA qui fonctionnent de manière autonome tout en maintenant des contrôles de gouvernance appropriés.

Le guide pratique de l'IA agentique pour l'entreprise

Développement simplifié grâce aux intégrations standardisées

Le protocole de contexte permet aux développeurs d'implémenter une surface de serveur unique que les hôtes MCP et les modèles d'IA peuvent réutiliser avec une sémantique de découverte et d'appel cohérente. Cela élimine le besoin de connecteurs distincts pour les services courants, réduisant ainsi l'effort d'ingénierie requis pour connecter les assistants d'IA à de nouvelles sources de données.

Les ressources typées et le schéma JSON réduisent le code personnalisé de sérialisation, de validation et de gestion des erreurs qui serait autrement nécessaire. Les transports STDIO locaux ou en streaming à distance permettent aux équipes de choisir des déploiements on-premise, dans le cloud ou hybrides sans modifier la logique de l'hôte MCP. Cette flexibilité accélère la manière dont les équipes créent des agents d'IA dans différents environnements de développement.

Le MCP offre un moyen pratique de normaliser les intégrations une seule fois plutôt que de créer des adaptateurs personnalisés pour chaque nouvelle intégration. Cette approche de protocole normalisé profite à l'ensemble de l'écosystème MCP à mesure que de plus en plus d'organisations adoptent la norme.

Potentiel d'automatisation accru pour les workflows complexes

Les canaux persistants et avec état de MCP permettent aux systèmes d'IA de combiner des recherches, des Transformations et des effets de bord sur plusieurs services externes en une seule boucle continue. Pour les opérations de longue durée, les serveurs MCP peuvent streamer des résultats partiels afin que les agents d'IA puissent prendre des décisions intermédiaires, bifurquer les workflows ou demander une intervention humaine si nécessaire.

La combinaison de la recherche indexée pour les repository de contenu permanent avec les consultations de sources faisant autorité à la demande du protocole de contexte de modèle permet d'obtenir des réponses rapides et précises. Cette approche hybride maintient les contrôles de gouvernance tout en permettant aux outils basés sur l'IA d'accéder à la fois aux bases de connaissances statiques et aux sources de données externes dynamiques.

La prise en charge par le protocole de contexte de l'orchestration multi-tours permet aux systèmes agentiques de gérer des workflows complexes qui nécessitent une coordination entre plusieurs outils et sources de données. Ce potentiel d'automatisation transforme la manière dont les organisations déploient les applications d'IA dans des environnements de production.

Bonnes pratiques de mise en œuvre : préparation du système

Validez que votre infrastructure peut prendre en charge l'hébergement de LLM, les serveurs MCP et les sources de données connectées. Assurez-vous de disposer de ressources GPU/CPU, d'une allocation de mémoire et d'une bande passante réseau adéquates pour l'architecture client-serveur. Choisissez des plateformes cloud qui prennent en charge la mise à l'échelle élastique pour les utilisateurs simultanés et définissez des politiques de mise à l'échelle automatique.

Standardiser les transports sécurisés à l'aide de TLS pour toutes les connexions à distance entre les clients et serveurs MCP. Documenter la gestion du cycle de vie des connexions, y compris les stratégies de reconnexion et les métriques observables sur l'état des streams. Implémentez des limites de débit, des disjoncteurs et des quotas pour protéger les systèmes externes en aval de la surcharge.

Les organisations devraient normaliser les canaux de streaming (HTTP/SSE, WebSocket) ainsi que le STDIO local pour les composants intégrés. Validez les charges utiles et le schéma JSON sur le serveur et le client pour empêcher les attaques par injection et garantir une gestion correcte des erreurs dans tout le système.

Exploitation des ressources open source dans les langages de programmation

L'écosystème MCP comprend des SDK communautaires dans plusieurs langages de programmation qui accélèrent le développement des clients et des serveurs. Ces SDK fournissent des modèles établis pour la messagerie JSON-RPC, le streaming et la validation de schémas, éliminant ainsi le besoin de réimplémenter la plomberie du protocole.

Les développeurs peuvent réutiliser les implémentations de serveur MCP existantes pour les systèmes d'entreprise populaires et les étendre à des cas d'utilisation spécifiques à un domaine grâce à la norme ouverte. La création de simulateurs qui imitent les notifications, les Streams de longue durée et les conditions d'erreur aide les équipes à tester les systèmes agentiques avant le déploiement en production.

Adoptez les ressources de la communauté pour accélérer le travail sur le MCP et éviter de reconstruire des fonctionnalités communes. Ces outils open source permettent aux développeurs de se concentrer sur la logique métier plutôt que sur les détails d'implémentation du protocole.

Stratégie d'intégration pour le déploiement en production

Commencez par des cas d'utilisation à fort impact qui démontrent un retour sur investissement mesurable, tels que des assistants IA contextuels ou des workflows automatisés utilisant des agents d'IA. Limitez les portées et les autorisations initiales des outils, collectez la télémétrie et les commentaires des utilisateurs, puis étendez les capacités après avoir stabilisé les fonctionnalités de base.

Équilibrez la latence et la fraîcheur des données en combinant les recherches en direct du MCP avec le RAG pour les grands corpus statiques provenant de repositories de contenu. Définissez les SLA, les pistes d'audit et les procédures d'escalade avant un déploiement à grande échelle en production. Cette approche progressive réduit les risques tout en renforçant la confiance de l'organisation dans les déploiements d'IA agentique.

Le MCP répond au besoin de plans d'intégration structurés qui peuvent monter en charge à mesure que de nouveaux serveurs et clients MCP sont ajoutés à l'écosystème. Les organisations doivent documenter leur architecture d'intégration et leurs politiques de gouvernance au début du processus de déploiement.

Idées reçues courantes : le MCP n'est pas simplement un autre framework d'API

Réalité : Le Model Context Protocol normalise l'intégration au niveau du protocole avec une gestion de contexte persistante et une découverte de capacité dynamique. Contrairement aux appels REST ou RPC, le MCP définit la manière dont les agents d'IA découvrent les capacités, s'abonnent aux Streams et maintiennent un état contextuel au fil des interactions via le protocole standard.

Ce protocole normalisé signifie que vous pouvez créer des outils une seule fois et les exposer uniformément à plusieurs agents d'IA et fournisseurs de modèles via l'écosystème MCP. Plutôt que de traiter le contexte du modèle comme une charge utile éphémère, le protocole de contexte traite le contexte comme une ressource de première classe, versionnée, avec une gestion de cycle de vie appropriée.

Les outils et les agents sont des composants différents

Réalité : les outils sont des capacités distinctes exposées via les serveurs MCP, telles que l'accès aux bases de données, les opérations sur les fichiers ou les intégrations d'API. Les agents d'IA sont des programmes informatiques décisionnels qui découvrent, orchestrent et invoquent les outils disponibles pour effectuer des tâches de manière autonome.

Le protocole de contexte permet aux agents d'IA de découvrir dynamiquement les métadonnées des outils, d'invoquer en toute sécurité les interfaces des outils avec une sémantique d'appel de fonction et d'intégrer les sorties dans les conversations via les clients MCP. Cette séparation permet à différents systèmes agentifs d'utiliser le même catalogue d'outils, tandis que les propriétaires d'outils mettent à jour les interfaces indépendamment de la logique de l'agent.

Le MCP gère une connectivité complète des données

Réalité : le protocole de contexte de modèle gère une connectivité complète aux sources de données externes au-delà de la simple utilisation d'outils. Il prend en charge les notifications en streaming, l'accès authentifié aux référentiels de contenu et aux banques de vecteurs, et une sémantique cohérente pour les opérations de longue durée et la gestion des erreurs.

MCP offre un moyen pratique d'unifier l'accès aux ressources locales, aux ressources distantes, aux requêtes de données en direct et aux actions opérationnelles de manière structurée. Cette approche unifiée facilite la montée en charge de la gouvernance, de l'observabilité et du contrôle d'accès parallèlement aux capacités d'IA dans les environnements d'entreprise. Le protocole de contexte gère d'autres outils et services externes via une interface cohérente.

Futures pistes de recherche et évolution

À mesure que le standard ouvert mûrit, les futures pistes de recherche incluent des cadres de sécurité améliorés pour les déploiements multi-tenants, une sémantique de streaming améliorée pour les workflows agentifs complexes et des modèles normalisés pour l'intégration avec d'autres langages de programmation et environnements de développement.

L'écosystème MCP en pleine croissance continue de s'étendre avec de nouvelles implémentations de serveurs MCP pour les outils et plateformes externes émergents. Les contributions de la communauté aux SDK, adaptateurs et architectures de référence accélèrent l'adoption tout en maintenant l'objectif principal du protocole : permettre à n'importe quelle application d'IA de se connecter à n'importe quel service externe de manière normalisée.

Les organisations qui explorent le protocole de contexte de modèle devraient surveiller les développements de l'écosystème, contribuer aux implémentations du MCP et participer aux groupes de travail qui façonnent l'évolution de la connexion des assistants d'IA aux systèmes externes. Cette approche collaborative garantit que les implémentations du MCP restent interopérables à mesure que les systèmes d'IA et les services externes continuent de progresser. Les futures orientations de recherche se concentreront probablement sur l'extension des capacités du protocole tout en conservant sa simplicité fondamentale.

Conclusion : Le protocole de contexte de modèle comme fondement de l'IA moderne

Le protocole de contexte de modèle représente un changement fondamental dans la manière dont les applications d'IA accèdent aux sources de données et aux outils externes. En fournissant un protocole ouvert pour une intégration basée sur la découverte, le protocole de contexte permet aux développeurs de créer des agents d'IA contextuels capables d'effectuer des tâches en utilisant des données en direct provenant de systèmes d'entreprise populaires sans code d'intégration répétitif.

Le protocole normalisé réduit la complexité grâce à l'architecture client-serveur, accélère les cycles de développement et permet aux systèmes d'IA de dépasser les limites des données d'entraînement statiques des LLM. Grâce à sa communication bidirectionnelle entre les clients MCP et les serveurs MCP, et à sa prise en charge des workflows d'IA agentique, le protocole de contexte de modèle (MCP) jette les bases d'outils d'IA plus capables et autonomes dans divers environnements.

À mesure que l'écosystème MCP se développe avec de nouvelles implémentations et intégrations de serveurs MCP, les organisations peuvent créer des agents d'IA sophistiqués qui découvrent et orchestrent plusieurs services externes tout en maintenant les autorisations d'outils, les contrôles de sécurité et les pistes d'audit appropriés. Cette approche standardisée pour connecter les systèmes d'IA à des outils et des sources de données externes continuera de façonner la manière dont les entreprises déploient les applications d'IA de production. Le protocole de contexte fournit l'infrastructure essentielle qui permet aux développeurs de créer des applications d'IA de nouvelle génération en toute confiance.

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.