Modello di Embedding SOTA per Flussi di Lavoro Agentivi Ora in Anteprima Pubblica

Qwen3-Embedding-0.6B è il primo modello di embedding multilingue su Foundation Model Serving con prestazioni best-in-class in tutti i compiti di embedding

di Felix Zhu, Cade Daniel e Wai Wu

- Qwen3-Embedding-0.6B è ora disponibile in Model Serving, offrendo prestazioni di recupero all'avanguardia in un modello compatto da 0.6B ottimizzato per la ricerca vettoriale e i carichi di lavoro degli agenti IA.

- Il primo modello di embedding multilingue su Databricks, che supporta il recupero cross-lingua su oltre 100 lingue per i dati aziendali globali.

- Gli embedding Matryoshka consentono compromessi flessibili tra costi e prestazioni, permettendo di troncare gli embedding da 1024 a 32 dimensioni per una ricerca più veloce e costi di archiviazione inferiori.

Il recupero è alla base dei moderni sistemi di IA e la qualità del modello di embedding determina l'efficacia con cui le applicazioni possono trovare e ragionare sui dati aziendali. Oggi lanciamo Qwen3-Embedding-0.6B su Databricks, un modello di embedding all'avanguardia che offre prestazioni di recupero elevate, copertura multilingue e distribuzione serverless sicura.

Insieme ad Agent Bricks e AI Search, questo modello consente ai team di creare agenti IA direttamente sui dati aziendali in Databricks, recuperando il contesto pertinente e ragionando sui dati governati senza spostare i dati al di fuori della piattaforma.

Crea Agenti Potenziati dal Recupero con Agent Bricks

I modelli di embedding all'avanguardia sono una base fondamentale per i moderni sistemi di IA, consentendo alle applicazioni di recuperare il contesto giusto da grandi raccolte di dati aziendali. Qwen3-Embedding-0.6B, ora disponibile su Databricks, offre prestazioni di recupero elevate per questi carichi di lavoro.

Qwen3-Embedding-0.6B è costruito sulla potente base di Qwen3 e proviene dallo stesso team di ricerca dietro la serie GTE ampiamente adottata. Con una lunghezza di contesto massima di 32k token, questo modello offre un'incredibile flessibilità per suddividere i documenti in varie dimensioni. Inoltre, il suo design consapevole delle istruzioni consente agli sviluppatori di adattare il modello a compiti e lingue specifiche con un semplice prompt, aumentando tipicamente le prestazioni di recupero dell'1-5%.

Su Databricks, questo può essere combinato con Agent Bricks e AI Search per creare agenti IA potenziati dal recupero direttamente sui dati aziendali. I team possono indicizzare documenti con AI Search e recuperare il contesto pertinente durante l'esecuzione dell'agente, basando gli agenti sui dati governati archiviati in Databricks.

Come Questo Modello di Embedding Migliora gli Agenti IA su Databricks

Qwen3-Embedding-0.6B offre una qualità all'avanguardia per le sue dimensioni. Nelle classifiche MTEB multilingue e inglese v2, supera la maggior parte degli altri modelli di classe 0.6B e supera i modelli di embedding di punta di OpenAI e Cohere, rivaleggiando con modelli molto più grandi da 7B+. Ciò significa che puoi ottenere prestazioni di recupero di prim'ordine senza la latenza e i costi di modelli molto grandi.

Il modello offre anche un controllo granulare sui costi e sul richiamo tramite Matryoshka Representation Learning (MRL), che concentra le informazioni più importanti nelle prime dimensioni del vettore. Ciò consente di troncare in modo sicuro gli embedding per un archiviazione più economica e una ricerca più rapida, preservando la maggior parte del segnale. Con Qwen3-Embedding-0.6B, puoi scegliere qualsiasi dimensione di embedding da 32 a 1024 dimensioni al momento della richiesta, utilizzando vettori più piccoli per indici di richiamo su larga scala e vettori di dimensioni complete per un reranking di maggiore precisione.

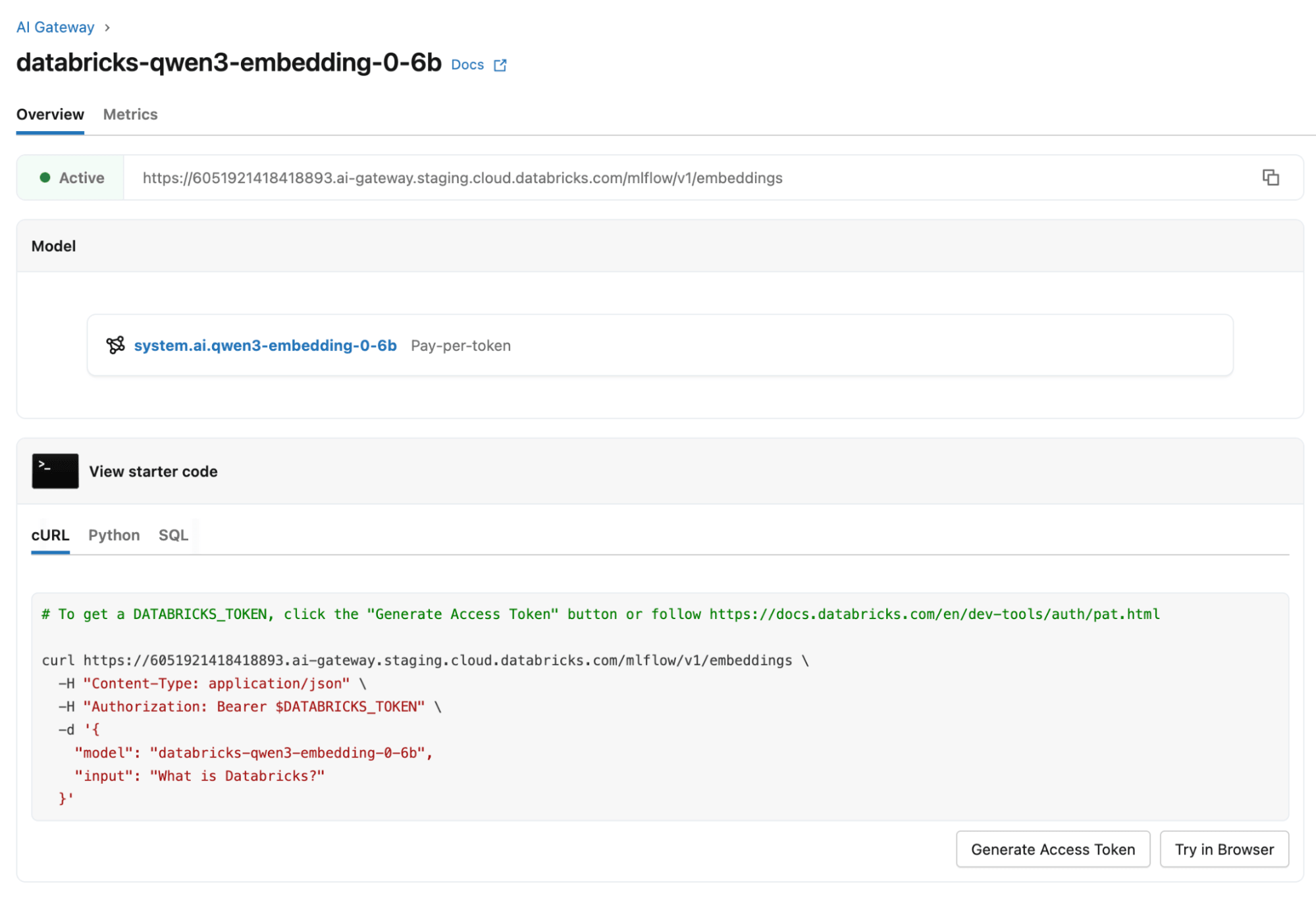

Per utilizzare questa funzionalità con databricks-qwen3-embedding-0-6b, imposta il campo opzionale dimensions nella tua richiesta API REST Embeddings alla dimensione di output desiderata (una potenza di due compresa tra 32 e 1024). Consulta la documentazione API REST dei Modelli Fondamentali per i dettagli.

Multilingue per Progettazione

Qwen3-Embedding-0.6B è il primo modello di embedding multilingue ospitato da Databricks, progettato fin dall'inizio per carichi di lavoro globali. Mentre molti modelli di embedding sono focalizzati sull'inglese con supporto multilingue limitato, Qwen3-Embedding-0.6B eredita un'ampia copertura linguistica dal modello base Qwen3, che è stato pre-addestrato su testi che coprono più di 100 lingue.

Ciò consente prestazioni elevate non solo per il recupero in inglese, ma anche per attività multilingue e cross-lingua. Le applicazioni possono cercare in una lingua e recuperare risultati in un'altra, oppure supportare set di dati misti e recupero di codice tra più linguaggi di programmazione.

Distribuzione Serverless Sicura

Come altri modelli fondamentali ospitati da Databricks, Qwen3-Embedding-0.6B viene eseguito su GPU serverless sicure e completamente gestite all'interno della piattaforma Databricks.

Basta chiamare le API dei Modelli Fondamentali e Databricks gestisce il provisioning, lo scaling automatico e l'affidabilità. Poiché il modello viene eseguito su un'infrastruttura conforme e consapevole della geolocalizzazione, puoi mantenere gli embedding vicini ai tuoi dati, rispettare i requisiti di residenza dei dati e integrare il recupero direttamente con i carichi di lavoro Databricks esistenti.

Prova subito Qwen3-Embedding-0.6B!

Sia che tu stia creando ricerca semantica, pipeline RAG, recupero multilingue o sistemi di classificazione del testo, Qwen3-Embedding-0.6B offre una combinazione eccezionale di velocità, efficienza e accuratezza all'avanguardia. Questo modello è disponibile come databricks-qwen3-embedding-0-6b su tutti i cloud in tutte le regioni che supportano Foundation Model Serving, e puoi provare questo modello nella pagina Databricks Serving. È disponibile su tutte le superfici di Model Serving: Pay-Per-Token, AI Functions (inferenza batch) e Provisioned Throughput. Puoi anche selezionare questo modello per casi d'uso di AI Search.

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.