Che cos'è Managed Spark?

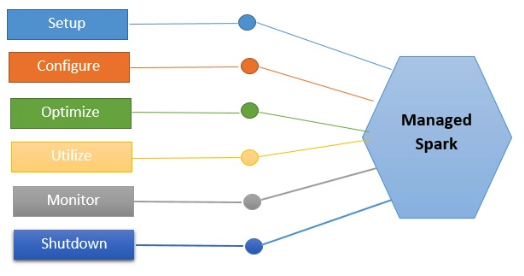

Servizio Spark automatizzato che consente la creazione rapida, il ridimensionamento dinamico e la gestione dei cluster su richiesta, in modo che gli utenti possano concentrarsi sull'analisi dei dati anziché sulle operazioni

- Offre la gestione automatizzata dei cluster con distribuzione, registrazione e monitoraggio configurati per le esigenze di ogni processo, mantenendo cluster stabili, scalabili e veloci mentre gli utenti si concentrano sui dati anziché sull'infrastruttura.

- Consente la creazione e la scalabilità rapida di cluster ridimensionabili su richiesta, con nodi ridotti quando non utilizzati, eliminando il provisioning e la configurazione ad alta intensità di risorse tramite il provisioning temporale dei cluster in base alle esigenze.

- Offre la configurazione automatica o manuale di hardware e software, semplificando la gestione senza problemi di allocazione delle risorse YARN, con modelli di prezzo convenienti basati sul pagamento solo per il calcolo consumato.

Che cos'è uno Spark gestito?

Un servizio Spark gestito consente di sfruttare gli strumenti open-source per l'elaborazione in batch, l'interrogazione, lo streaming e il machine learning. Utilizzando un'automazione di questo tipo, si possono creare rapidamente cluster su richiesta, gestirli con facilità e disattivarli una volta completata l'attività. È anche possibile dimensionare i cluster in base al carico di lavoro, alle prestazioni richieste o alle risorse esistenti. Inoltre, si avrà accesso a cluster Spark completamente gestiti che si possono scalare dinamicamente in pochi secondi, anche se vi sono dei job in elaborazione. È possibile spegnere i cluster quando non si utilizzano, risparmiando così denaro. I fornitori di Spark gestito creano cluster temporali invece di fornire e mantenere un cluster per tutti i job. In genere, utilizzano un cluster di macchine con un nodo master e dei nodi di lavoro. In questo modo è possibile concentrarsi sull'estrazione di valore dai dati dell'organizzazione invece di spendere preziose risorse in attività operative.

Il playbook sull'AI agentiva per l'enterprise

Vantaggi nell'utilizzo di un servizio Spark gestito:

Gestione automatizzata dei cluster

L'implementazione, il logging e il monitoraggio gestiti in base alle esigenze del job specifico consentono di concentrarsi sui dati anziché sul cluster. I cluster saranno stabili, scalabili e veloci.

Cluster ridimensionabili

La creazione e la configurazione dei cluster Spark richiede molte risorse, ma questo non rappresenterà più un problema per l'utente, dal momento che i cluster possono essere creati e scalati rapidamente. I nodi vengono eliminati quando non sono più necessari. Tutto viene fatto in base alle necessità del cliente.

Strumenti per sviluppatori

Generalmente vengono forniti più modi per gestire un cluster.

Configurazione automatica o manuale

L'hardware e il software sui cluster sono configurati automaticamente, pur restando comunque controllabili manualmente.

Semplicità di gestione

L'utente non dovrà più preoccuparsi di gestire l'allocazione dei cluster o delle risorse e di stabilire priorità con strumenti come il Resource Manager di YARN.

Economicamente vantaggioso

Gli utenti pagano solo le risorse di calcolo consumate durante il processo.

Risorse aggiuntive

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.