임베딩 모��델 미세 조정을 통한 검색 및 RAG 개선

작성자: Jacob Portes, 앤드류 드로즈도프, Erica Ji Yuen, Vincent Chen, 션 쿨린스키, Milo Cress, 콜튼 펠티어, Sam Havens , Michael Carbin

- 임베딩 모델 미세 조정을 통해 검색 및 RAG 정확도 향상

- 벤치마크 전반에 걸친 주요 성능 향상

- Databricks에서 임베딩 미세 조정 시작하기

더 나은 검색 및 RAG를 위한 임베딩 모델 미세 조정

요약: 도메인 내 데이터에 대한 임베딩 모델 미세 조정은 벡터 검색 및 검색 증강 생성(RAG) 정확도를 크게 향상시킬 수 있습니다. Databricks를 사용하면 수동 레이블링 없이 합성 데이터를 활용하여 특정 사용 사례에 대한 검색을 최적화하기 위해 임베딩 모델을 쉽게 미세 조정, 배포 및 평가할 수 있습니다.

중요성: 벡터 검색 또는 RAG 시스템이 최상의 결과를 검색하지 못하는 경우, 임베딩 모델 미세 조정은 성능을 향상시키는 간단하면서도 강력한 방법입니다. 금융 문서, 지식 기반 또는 내부 코드 문서를 다루든 관계없이 미세 조정을 통해 더 관련성 높은 검색 결과와 더 나은 다운스트림 LLM 응답을 얻을 수 있습니다.

발견 내용: 세 가지 엔터프라이즈 데이터셋에서 두 가지 임베딩 모델을 미세 조정하고 테스트한 결과, 검색 메트릭(Recall@10) 및 다운스트림 RAG 성능에서 상당한 개선을 확인했습니다. 이는 미세 조정이 수동 레이블링 없이 기존 데이터만 활용하여 정확도를 높이는 게임 체인저가 될 수 있음을 의미합니다.

임베딩 미세 조정을 시도해 보시겠습니까? 시작하는 데 도움이 되는 참조 솔루션을 제공합니다. Databricks는 벡터 검색, RAG, 재순위 지정 및 임베딩 미세 조정을 쉽게 만듭니다. 자세한 내용은 Databricks 계정 담당자 또는 솔루션 아키텍트에게 문의하십시오.

임베딩을 미세 조정하는 이유

임베딩 모델은 최신 벡터 검색 및 RAG 시스템의 기반입니다. 임베딩 모델은 텍스트를 벡터로 변환하여 키워드뿐만 아니라 의미를 기반으로 관련 콘텐츠를 찾을 수 있도록 합니다. 그러나 기성 모델이 특정 도메인에 최적화되어 있지 않을 수 있습니다. 바로 여기서 미세 조정이 필요합니다.

도메인별 데이터에 대한 임베딩 모델 미세 조정은 여러 가지 방법으로 도움이 됩니다.

- 검색 정확도 향상: 사용자 지정 임베딩은 데이터와 일치시켜 검색 결과를 개선합니다.

- RAG 성능 향상: 더 나은 검색은 환각을 줄이고 더 근거 있는 생성 AI 응답을 가능하게 합니다.

- 비용 및 지연 시간 개선: 더 작은 미세 조정 모델이 때때로 더 크고 비싼 대안보다 성능이 뛰어날 수 있습니다.

이 블로그 게시물에서는 임베딩 모델 미세 조정이 작업별 엔터프라이즈 사용 사례에 대한 검색 및 RAG 성능을 개선하는 효과적인 방법임을 보여줍니다.

결과: 미세 조정은 효과가 있습니다

세 가지 데이터셋에서 두 가지 임베딩 모델(gte-large-en-v1.5 및 e5-mistral-7b-instruct)을 합성 데이터로 미세 조정하고 Domain Intelligence Benchmark Suite (DIBS)(FinanceBench, ManufactQA 및 Databricks DocsQA)의 세 가지 데이터셋에서 평가했습니다. 그런 다음 OpenAI의 text-embedding-3-large와 비교했습니다.

주요 내용:

- 미세 조정은 데이터셋 전반에 걸쳐 검색 정확도를 향상시켰으며, 종종 기준 모델보다 훨씬 뛰어난 성능을 보였습니다.

- 미세 조정된 임베딩은 많은 경우 재순위 지정과 동등하거나 더 나은 성능을 보였으며, 강력한 독립형 솔루션이 될 수 있음을 보여줍니다.

- 더 나은 검색은 FinanceBench에서 더 나은 RAG 성능으로 이어져 엔드투엔드 이점을 입증했습니다.

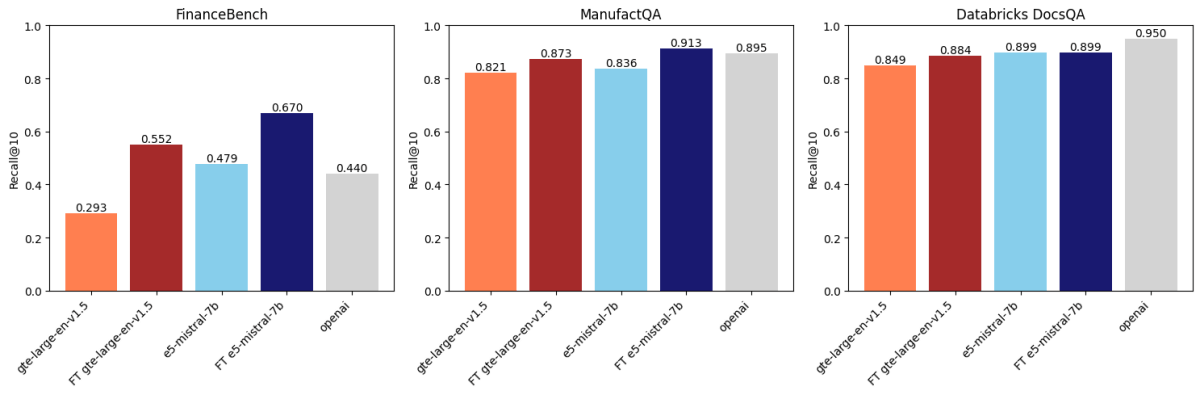

검색 성능

세 가지 데이터셋에 대한 비교 후, 임베딩 미세 조정이 두 데이터셋에서 정확도를 향상시킨다는 것을 발견했습니다. 그림 1은 FinanceBench 및 ManufactQA의 경우 미세 조정된 임베딩이 기본 버전보다 성능이 뛰어나며 때로는 OpenAI의 API 모델(연한 회색)보다도 뛰어났음을 보여줍니다. 그러나 Databricks DocsQA의 경우 OpenAI text-embedding-3-large의 정확도가 모든 미세 조정 모델을 능가합니다. 이는 해당 모델이 공개 Databricks 문서에 대해 학습되었기 때문일 수 있습니다. 이는 미세 조정이 효과적일 수 있지만 학습 데이터셋과 평가 작업에 크게 의존한다는 것을 보여줍니다.

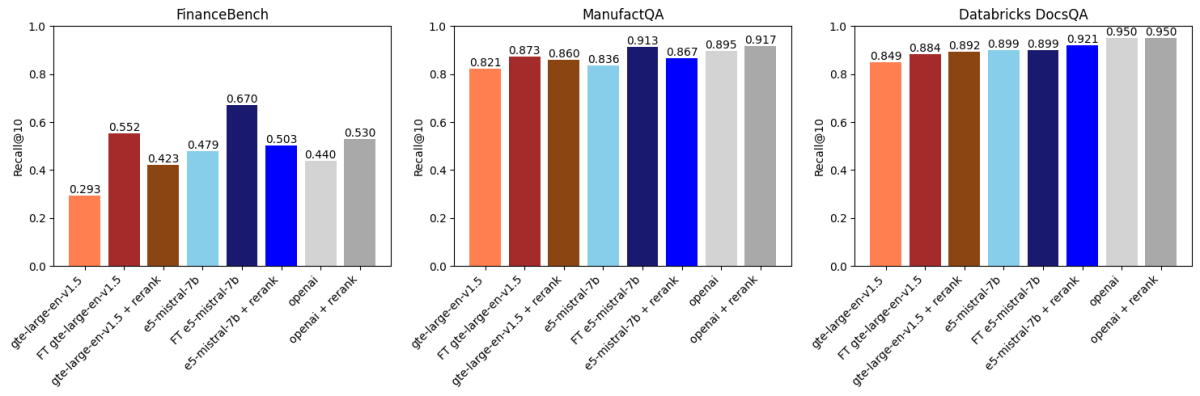

미세 조정 vs. 재순위 지정

그런 다음 voyageai/rerank-1을 사용한 API 기반 재순위 지정과 위의 결과를 비교했습니다(그림 2). 재순위 지정기는 일반적으로 임베딩 모델이 검색한 상위 k개의 결과를 가져와 검색 쿼리에 대한 관련성을 기준으로 이러한 결과를 재순위 지정한 다음 재순위 지정된 상위 k개(이 경우 k=30 후 k=10)를 반환합니다. 이는 재순위 지정기가 일반적으로 임베딩 모델보다 더 크고 강력한 모델이며 쿼리와 문서 간의 상호 작용을 더 표현력 있게 모델링하기 때문에 작동합니다.

우리가 발견한 것은 다음과 같습니다.

- gte-large-en-v1.5 미세 조정은 FinanceBench 및 ManufactQA에서 재순위 지정보다 뛰어난 성능을 보였습니다.

- OpenAI의 text-embedding-3-large는 재순위 지정의 이점을 얻었지만 일부 데이터셋에서는 개선이 미미했습니다.

- Databricks DocsQA의 경우 재순위 지정의 영향이 적었지만 미세 조정은 여전히 개선을 가져왔으며, 이는 이러한 방법의 데이터셋 종속성을 보여줍니다.

재순위 지정기는 일반적으로 임베딩 모델에 비해 추가적인 쿼리당 추론 지연 시간과 비용이 발생합니다. 그러나 기존 벡터 데이터베이스와 함께 사용할 수 있으며 경우에 따라 최신 임베딩 모델로 데이터를 다시 임베딩하는 것보다 비용 효율적일 수 있습니다. 재순위 지정기 사용 여부는 도메인 및 지연 시간/비용 요구 사항에 따라 달라집니다.

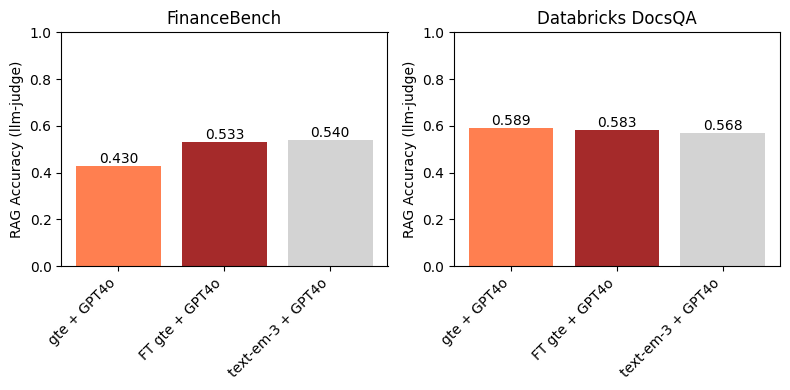

미세 조정은 RAG 성능을 향상시킵니다

FinanceBench의 경우, 더 나은 검색은 GPT-4o와 결합했을 때 더 나은 RAG 정확도로 직접 이어졌습니다(부록 참조). 그러나 Databricks DocsQA와 같이 검색이 이미 강력했던 도메인에서는 미세 조정이 큰 도움이 되지 않았습니다. 이는 미세 조정이 검색이 명확한 병목 현상일 때 가장 효과적임을 강조합니다.

임베딩 모델 미세 조정 및 평가 방법

다음은 합성 데이터 생성, 미세 조정 및 평가에 대한 기술적인 세부 정보입니다.

임베딩 모델

두 가지 오픈 소스 임베딩 모델을 미세 조정했습니다.

- gte-large-en-v1.5는 BERT Large(4억 3,400만 개 매개변수, 1.75GB)를 기반으로 하는 인기 있는 임베딩 모델입니다. 적당한 크기와 오픈 라이선스 때문에 이 모델에 대한 실험을 진행하기로 선택했습니다. 이 임베딩 모델은 Databricks Foundation Model API에서도 현재 지원됩니다.

- e5-mistral-7b-instruct는 강력한 LLM(이 경우 Mistral-7b-instruct-v0.1)을 기반으로 구축된 새로운 클래스의 임베딩 모델에 속합니다. e5-mistral-7b-instruct는 MTEB와 같은 표준 임베딩 벤치마크에서 더 뛰어나고 더 길고 미묘한 프롬프트를 처리할 수 있지만, gte-large-en-v1.5보다 훨씬 크고(70억 개 매개변수) 서비스 제공이 약간 더 느리고 비용이 많이 듭니다.

그런 다음 OpenAI의 text-embedding-3-large와 비교했습니다.

평가 데이터셋

다음은 Domain Intelligence Benchmark Suite (DIBS)의 FinanceBench, ManufactQA 및 Databricks DocsQA에 대한 모든 모델을 평가했습니다.

| 데이터셋 | 설명 | # 쿼리 | # 코퍼스 |

|---|---|---|---|

| FinanceBench | SEC 10-K 문서에 대한 질문으로, 전문가가 생성했습니다. 360개의 SEC 10-K 파일 모음에서 개별 페이지를 검색합니다. | 150 | 53,399 |

| ManufactQA | 전자 제품 제조업체의 공개 포럼에서 샘플링된 질문과 답변입니다. | 6,787 | 6,787 |

| Databricks DocsQA | Databricks 전문가가 생성한 공개 Databricks 문서를 기반으로 한 질문입니다. | 139 | 7,561 |

주요 검색 지표로 recall@10을 보고합니다. 이는 검색된 상위 10개 문서에 올바른 문서가 포함되는지 측정합니다.

임베딩 모델 품질의 황금 표준은 MTEB 벤치마크이며, 여기에는 BEIR와 같은 검색 작업뿐만 아니라 다른 많은 비검색 작업도 포함됩니다. gte-large-en-v1.5 및 e5-mistral-7b-instruct와 같은 모델이 MTEB에서 좋은 성능을 보이지만, 내부 엔터프라이즈 작업에서 어떻게 수행되는지 궁금했습니다.

학습 데이터

위의 각 벤치마크에 맞춰 조정된 합성 데이터로 별도의 모델을 학습했습니다.

| 학습 세트 | 설명 | 고유 샘플 수 |

|---|---|---|

| 합성 FinanceBench | 2,400개의 SEC 10-K 문서에서 생성된 쿼리 | ~6,000 |

| 합성 Databricks Docs QA | 공개 Databricks 문서에서 생성된 쿼리 | 8,727 |

| ManufactQA | 전자 제조 PDF에서 생성된 쿼리 | 14,220 |

각 도메인에 대한 학습 세트를 생성하기 위해 기존 문서를 사용하고 Llama 3 405B와 같은 LLM을 사용하여 각 문서의 내용을 기반으로 샘플 쿼리를 생성했습니다. 그런 다음 LLM-as-a-judge (GPT4o)를 통해 합성 쿼리의 품질을 필터링했습니다. 필터링된 쿼리와 해당 문서는 미세 조정을 위한 대조 쌍으로 사용되었습니다. 대조 학습을 위해 배치 내 네거티브를 사용했지만, 하드 네거티브를 추가하면 성능을 더욱 향상시킬 수 있습니다 (부록 참조).

하이퍼파라미터 튜닝

다음과 같은 항목에 대해 탐색을 수행했습니다.

- 학습률, 배치 크기, 소프트맥스 온도

- 에포크 수 (1-3 에포크 테스트)

- 쿼리 프롬프트 변형 (예: "쿼리:" 대 지침 기반 프롬프트)

- 풀링 전략 (평균 풀링 대 마지막 토큰 풀링)

모든 미세 조정은 Databricks 플랫폼에서 오픈 소스 mosaicml/composer, mosaicml/llm-foundry 및 mosaicml/streaming 라이브러리를 사용하여 수행되었습니다.

Databricks에서 벡터 검색 및 RAG 개선 방법

미세 조정은 벡터 검색 및 RAG 성능을 개선하는 한 가지 접근 방식일 뿐이며, 몇 가지 추가적인 접근 방식을 아래에 나열합니다.

검색 개선을 위해:

- 더 나은 임베딩 모델 사용: 많은 사용자가 자신도 모르게 오래된 임베딩을 사용합니다. 더 높은 성능의 모델로 교체하는 것만으로도 즉각적인 개선을 얻을 수 있습니다. 상위 모델은 MTEB 리더보드에서 확인하세요.

- 하이브리드 검색 시도: 밀집 임베딩과 키워드 기반 검색을 결합하여 정확도를 높입니다. Databricks Vector Search는 원클릭 솔루션으로 이를 쉽게 구현할 수 있습니다.

- 리랭커 사용: 리랭커는 관련성을 기준으로 결과를 재정렬하여 개선할 수 있습니다. Databricks는 이를 내장 기능으로 제공합니다 (현재 비공개 미리 보기). 체험하려면 계정 담당자에게 문의하세요.

RAG 개선을 위해:

- 프롬프트 최적화: LLM 프롬프트의 작은 조정으로 응답을 크게 개선할 수 있습니다. DSPy는 이 프로세스를 자동화하는 데 도움이 됩니다 (Databricks에서 DSPy를 사용하여 genAI 앱 빌드 참조: Build genAI apps using DSPy on Databricks).

- LLM 업그레이드: 검색은 강력하지만 답변이 약하다면 더 나은 생성 모델 사용을 고려하세요.

- LLM 미세 조정: 도메인이 고유하고 데이터가 충분하다면 Llama 3와 같은 모델을 미세 조정하여 RAG 품질을 더욱 높일 수 있습니다. 자세한 내용은 Databricks 모델 학습: 특정 작업 및 지식에 대한 LLM 미세 조정을 참조하세요.

Databricks에서 미세 조정 시작하기

임베딩 미세 조정은 AI 시스템에서 검색 및 RAG를 개선하는 쉬운 승리가 될 수 있습니다. Databricks에서는 다음을 수행할 수 있습니다.

- 확장 가능한 인프라에서 임베딩 모델을 미세 조정하고 제공합니다.

- 벡터 검색, 리랭킹 및 RAG를 위한 내장 도구를 사용합니다.

- 사용 사례에 가장 적합한 모델을 찾기 위해 다양한 모델을 신속하게 테스트합니다.

시도해 볼 준비가 되셨나요? 미세 조정을 더 쉽게 할 수 있는 참조 솔루션을 구축��했습니다. Databricks 계정 담당자 또는 솔루션 아키텍트에게 문의하여 액세스하세요.

부록

크기 | FinanceBench Recall@10 | ManufactQA Recall@10 | DocsQA Recall@10 | ||||

기준 | 미세 조정 | 기준 | 미세 조정 | 기준 | 파인튜닝됨 | ||

gte-large-en-v1.5 | 0.4B | 0.293 | 0.552 | 0.821 | 0.873 | 0.849 | 0.884 |

e5-mistral-7b-instruct | 7B | 0.479 | 0.670 | 0.836 | 0.913 | 0.899 | 0.899 |

text-embedding-3-large | 알 수 없음 | 0.44 | 해당 없음 | 0.895 | 해당 없음 | 0.95 | 해당 없음 |

Table 1: gte-large-en-v1.5, e5-mistral-7b-instruct 및 text-embedding-3-large 비교. Figure 1과 동일한 데이터.

합성 학습 데이터 생성

모든 데이터셋에서 학습 세트의 쿼리는 테스트 세트의 쿼리와 동일하지 않았습니다. 그러나 Databricks DocsQA의 경우(FinanceBench 또는 ManufactQA는 제외), 합성 쿼리 생성에 사용된 문서는 평가 세트에 사용된 문서와 동일했습니다. 저희 연구의 초점은 특정 작업 및 도메인에서의 검색 성능 향상에 맞춰져 있으므로(제로샷, 일반화 가능한 임베딩 모델과는 달리), 특정 프로덕션 사용 사례에 대해 유효한 접근 방식이라고 생각합니다. FinanceBench 및 ManufactQA의 경우, 합성 데이터 생성에 사용된 문서는 평가에 사용된 코퍼스와 겹치지 않았습니다.

대조 학습을 위한 부정적 구절을 선택하는 데는 여러 가지 방법이 있습니다. 무작위로 선택하거나 미리 정의할 수 있습니다. 첫 번째 경우, 부정적 구절은 학습 배치 내에서 선택되며, 이는 종종 "인배치 네거티브" 또는 “소프트 네거티브”라고 불립니다. 두 번째 경우, 사용자는 의미상 어려운 텍스트 예제를 미리 선택합니다. 즉, 쿼리와 관련이 있을 수 있지만 약간 부정확하거나 관련이 없는 예제입니다. 이 두 번째 경우는 때때로 "하드 네거티브"라고 불립니다. 본 연구에서는 인배치 네거티브만을 사용했습니다. 하드 네거티브를 사용하면 결과가 훨씬 더 좋아질 가능성이 있다는 문헌이 있습니다.

미세 조정 세부 정보

모든 미세 조정 실험에서 최대 시퀀스 길이는 2048로 설정되었습니다. 그런 다음 모든 체크포인트를 평가했습니다. 모든 벤치마킹을 위해 코퍼스 문서는 2048 토큰으로 잘렸으며(청크 분할 안 함), 이는 특정 데이터셋에 대해 합리적인 제약이었습니다. 쿼리 프롬프트 및 풀링 전략에 대한 조정을 거쳐 각 벤치마크에서 가장 강력한 기준 모델을 선택했습니다.

RAG 성능 향상

RAG 시�스템은 검색기와 생성 모델로 구성됩니다. 검색기는 특정 쿼리와 관련된 문서 세트를 선택한 다음 생성 모델에 전달합니다. 저희는 최상의 미세 조정된 gte-large-en-v1.5 모델을 선택하여 간단한 RAG 시스템의 첫 번째 검색 단계에 사용했습니다(Long Context RAG Performance of LLMs 및 The Long Context RAG Capabilities of OpenAI o1 and Google Gemini에 설명된 일반적인 접근 방식 따름). 특히, 각 최대 길이가 512 토큰인 k=10개의 문서를 검색했으며 생성 LLM으로 GPT4o를 사용했습니다. 최종 정확도는 LLM-as-a-judge(GPT4o)를 사용하여 평가되었습니다.

FinanceBench에서 Figure 3은 미세 조정된 임베딩 모델을 사용하면 다운스트림 RAG 정확도가 향상된다는 것을 보여줍니다. 또한 text-embedding-3-large와 경쟁력이 있습니다. 이는 gte 미세 조정이 기준 gte(Figure 1)에 비해 Recall@10에서 큰 향상을 가져왔기 때문에 예상된 결과입니다. 이 예는 특정 도메인 및 데이터셋에서 임베딩 모델 미세 조정의 효과를 강조합니다.

Databricks DocsQA 데이터셋에서는 미세 조정된 gte 모�델을 사용해도 기준 gte보다 성능 향상이 없었습니다. 이는 Figure 1과 2의 기준 모델과 미세 조정된 모델 간의 차이가 작기 때문에 어느 정도 예상된 결과입니다. 흥미롭게도, text-embedding-3-large가 gte 모델보다 (약간) 더 높은 Recall@10을 가지고 있음에도 불구하고, 다운스트림 RAG 정확도가 더 높지는 않습니다. Figure 1에서 볼 수 있듯이, 모든 임베딩 모델은 Databricks DocsQA 데이터셋에서 상대적으로 높은 Recall@10을 가지고 있었습니다. 이는 검색이 RAG의 병목 현상이 아니며, 이 데이터셋에서 임베딩 모델을 미세 조정하는 것이 반드시 가장 유익한 접근 방식은 아님을 나타냅니다.

이 블로그 게시물에 대한 피드백을 제공해주신 Quinn Leng와 Matei Zaharia께 감사드립니다.

(이 글은 AI의 도움을 받아 번역되었습니다. 원문이 궁금하시다면 여기를 클릭해 주세요)

최신 게시물을 이메일로 받아보세요

블로그를 구독하고 최신 게시물을 이메일로 받아보세요.