암묵지에서 즉각적인 답변으로: Databricks에서 Reffy 구축하기

작성자: 라피 컬란식, 개빈 에글리 , Sara Steffen

- Databricks 영업 및 마케팅 전반에 걸쳐 적시에 적절한 고객 레퍼런스를 찾는 것이 왜 지속적인 과제였는가.

- RAG, AI Search, AI Functions 및 Lakebase를 사용하여 2,400개 이상의 고객 사례를 즉시 검색할 수 있도록 풀스택 에이전틱 앱인 Reffy를 구축한 방법.

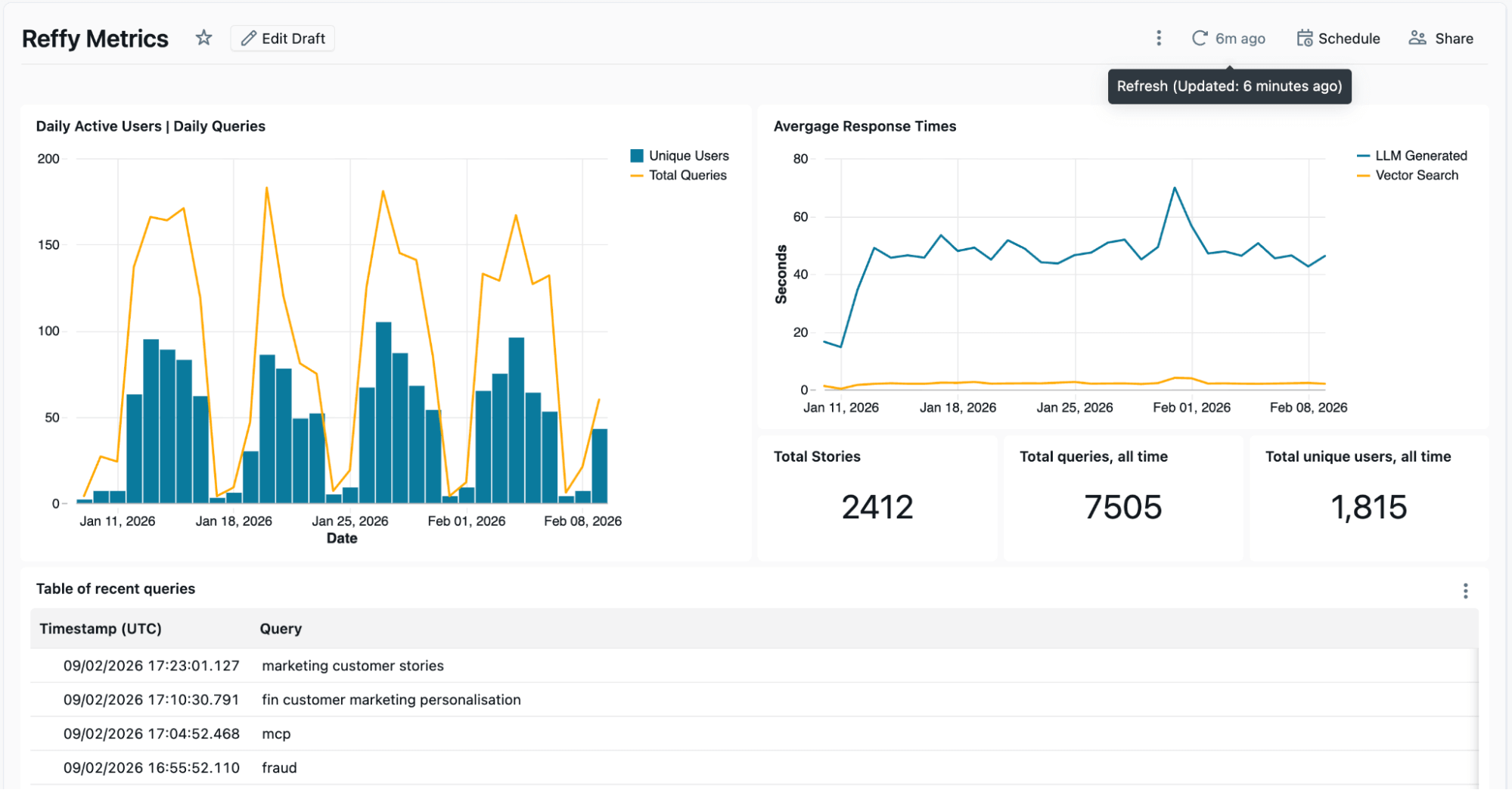

- 2025년 12월 출시 이후 1,800명 이상의 Databricks 직원이 Reffy에서 7,500건 이상의 쿼리를 실행했습니다.

적시에 딱 맞는 고객 사례를 찾는 것은 생각보다 훨씬 어렵습니다. 직원 생산성을 개선하기 위해 2,400개 이상의 Databricks 고객 레퍼런스를 검색하고 분석하여 개인화된 응답, 교차 사례 분석, 인용문 등을 제공하는 앱인 Reffy를 구축했습니다. 출시 후 첫 두 달 동안 Databricks 영업 및 마케팅 부서의 1,800명 이상이 Reffy에서 7,500건 이상의 쿼리를 실행했습니다. 이는 더 관련성 있고 일관된 스토리텔링, 더 빠른 캠페인 실행, 그리고 고객 증거가 대규모로 사용된다는 확신으로 이어집니다. 이러한 사례를 검색하고 이해하기 쉽게 만들어 고객 레퍼런스를 둘러싼 파편화된 지식 문제를 해결하고 수년간 이를 수집해 온 많은 사람들의 귀중한 작업을 활용할 수 있게 되었습니다.

이 아티클에서는 Reffy를 개발하게 된 동기, 완전한 Databricks 솔루션으로서 Reffy가 조직에 미친 영향, 그리고 앞으로 내부적으로 Reffy를 더욱 확장할 계획에 대해 자세히 알아봅니다.

부족 지식을 대중화해야 하는 과제

"다른 사람도 이걸 했나요?"는 모든 판매자가 듣는 질문입니다. 잠재 고�객이 귀사의 발표에 흥미를 보이지만, 다음 단계로 나아가기 전에 증거, 즉 자신들과 비슷하게 이미 이 길을 걸어본 고객 사례를 원합니다. 쉽게 답할 수 있어야 합니다.

마케팅팀에게 고객 사례는 캠페인, 제품 출시, 광고, PR, 애널리스트 브리핑, 경영진 커뮤니케이션 등 거의 모든 활동의 핵심적인 자료입니다. 이러한 사례를 쉽게 찾거나 평가할 수 없으면 가치 높은 레퍼런스가 과도하게 사용되고, 새로운 사용 사례나 산업을 놓치게 되며, 마케팅 효과는 소수만 아는 지식에 의해 제한되는 등 실제 문제가 복합적으로 발생합니다.

Databricks에는 수천 개의 YouTube 강연, databricks.com의 사례 연구, 내부 슬라이드, LinkedIn 기사, Medium 게시물이 있습니다. 그 어딘가에는 캐나다에서 실시간 사기 탐지를 수행하는 금융 서비스 회사, 레거시 데이터 웨어하우스를 교체한 소매업체, GenAI를 확장하는 제조업체와 같은 완벽한 레퍼런스가 있습니다. 하지만 그것을 찾는 것은요? 바로 그 지점에서 일이 어그러집니다. 사례들은 통합 검색 기능 없이 수십 개의 플랫폼에 흩어져 있으며, 무언가를 찾더라도 그것이 신뢰할 수 있는 비즈니스 성과를 담고 있는지 아니면 모호한 주장뿐인지 즉시 알 수 없습니다.

그래서 사람들은 으레 하던 대로 합니다. Slack으로 마케팅팀에 메시지를 보내고, 어렴풋이 기억나는 폴더를 뒤지거나, 누군가 쓸 만한 것을 찾아낼 때까지 주변에 물어봅니다. 때로는 골드를 찾기도 합니다. 하지만 더 자주 '이만하면 괜찮다'며 타협하거나, 완벽한 스토리가 어딘가에 있었을지도 모른다는 사실을 알지 못한 채 완전히 포기해 버립니다.

분명히 영업 및 마케팅팀이 가장 관련성 높은 고객 사례를 찾을 수 있는 더 �나은 방법이 필요했습니다.

Reffy: Databricks 기반의 풀스택 솔루션

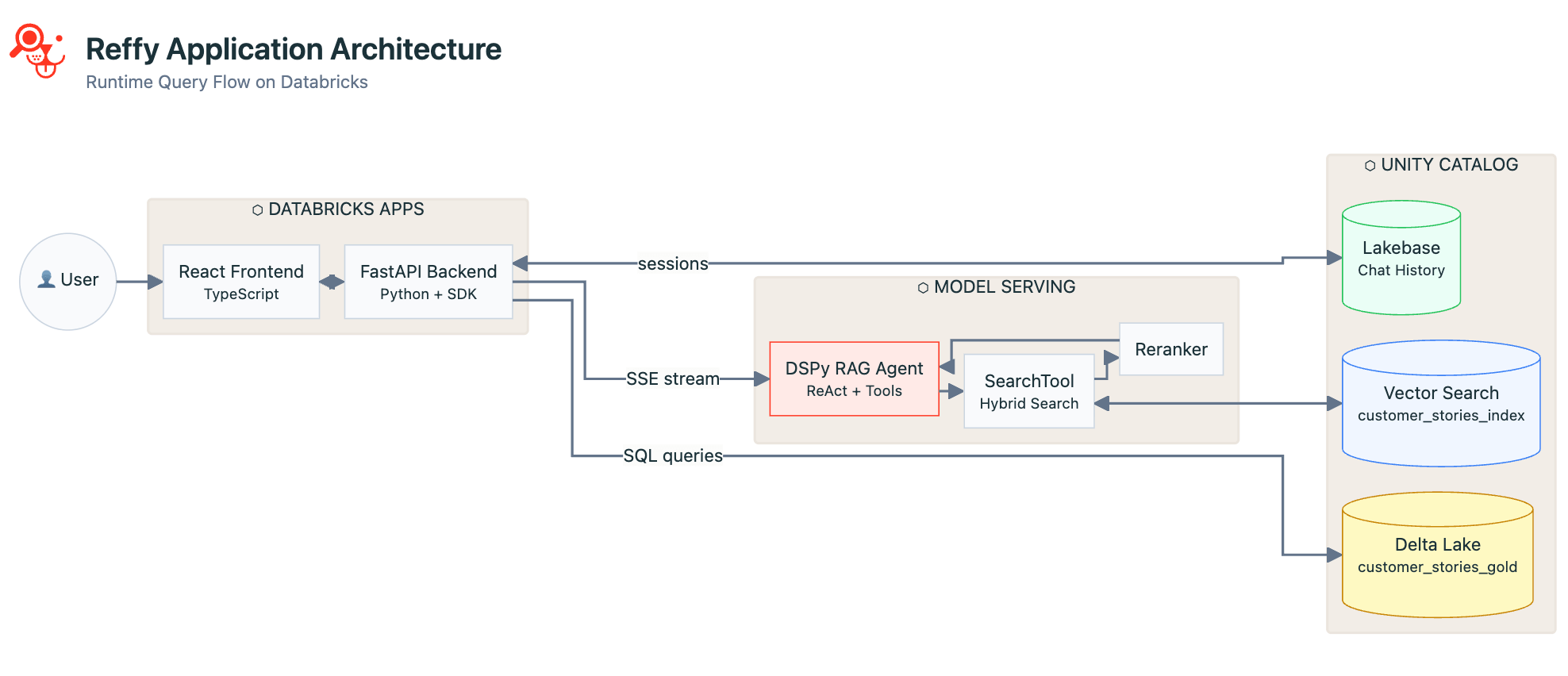

이 문제를 해결하기 위해 저희는 모든 사례를 단일 테이블로 통합하고 분류한 다음, RAG 기반 에이전트를 사용하여 검색 기능을 강화하며, 이 모든 것은 분위기에 맞게 코딩된 Databricks 앱을 통해 제공됩니다. 이 아키텍처는 전체 Databricks 플랫폼에 걸쳐 있습니다. 즉, Lakeflow Jobs는 ETL 파이프라인을 오케스트레이션하고, Unity Catalog는 데이터를 거버넌스하며, AI Search는 검색을 지원하고, Model Serving은 에이전트를 호스팅하며, Lakebase는 실시간 읽기 및 쓰기를 처리하고, Databricks Apps는 프런트엔드를 제공합니다. 자세한 내용을 살펴보겠습니다.

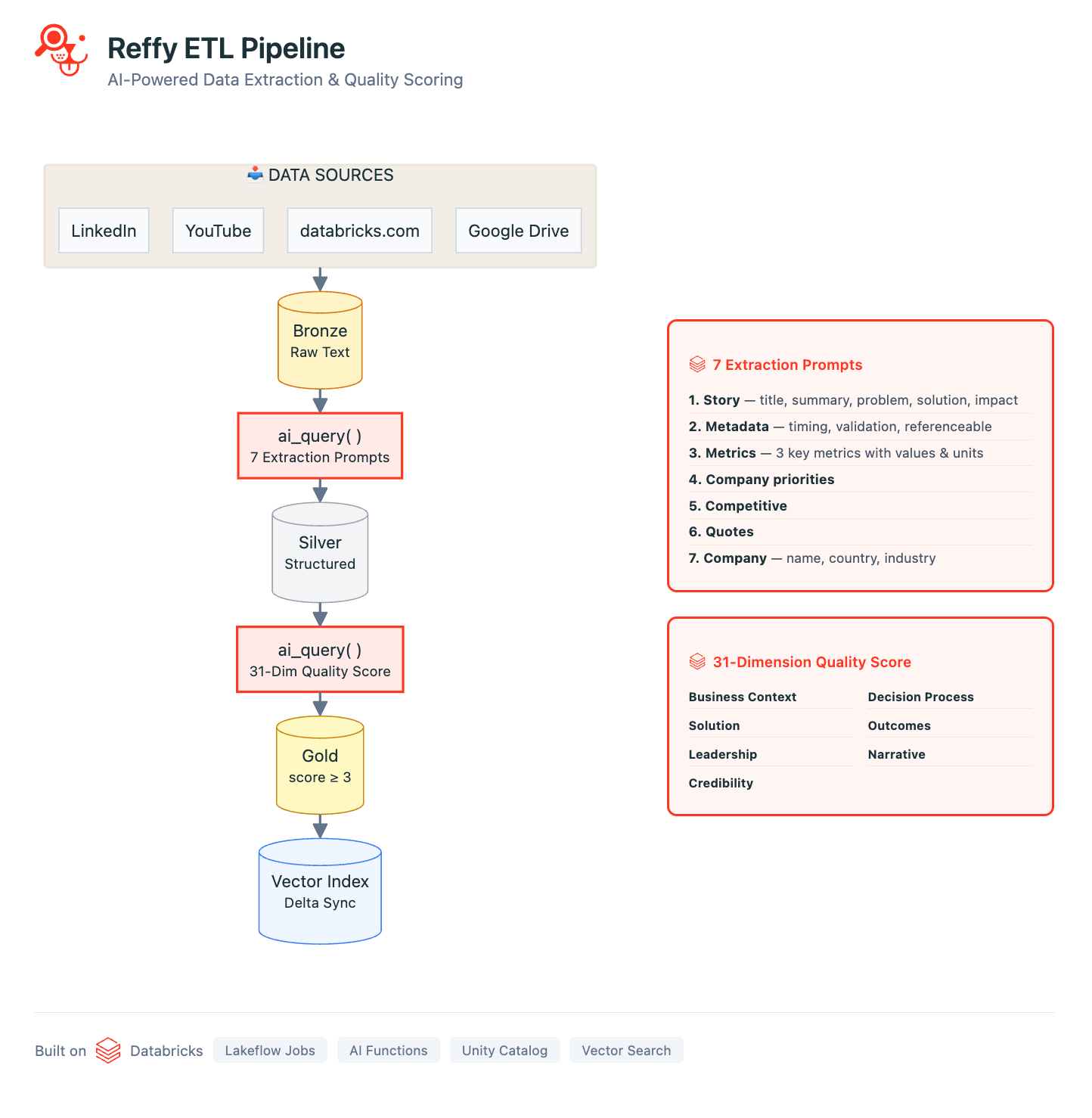

데이터 소스 및 ETL

파이프라인은 Lakeflow Jobs로 오케스트레이션되는 일련의 Databricks Notebook으로 정의됩니다. 파이프라인은 모든 데이터 소스에서 스토리 텍스트를 수집하는 것으로 시작됩니다. 표준 Python 웹 스크래핑 라이브러리를 사용하여 YouTube 스크립트, LinkedIn/Medium 기사 및 databricks.com의 모든 공개 고객 사례를 수집합니다. 또한 Google Apps 스크립트를 사용하여 수백 개의 내부 Google 슬라이드와 문서의 텍스트를 단일 Google Sheet로 통합합니다. 이 모든 소스는 기본 메타데이터로 처리되어 Unity Catalog(UC)의 'Bronze' Delta Lake 테이블에 저장됩니다.

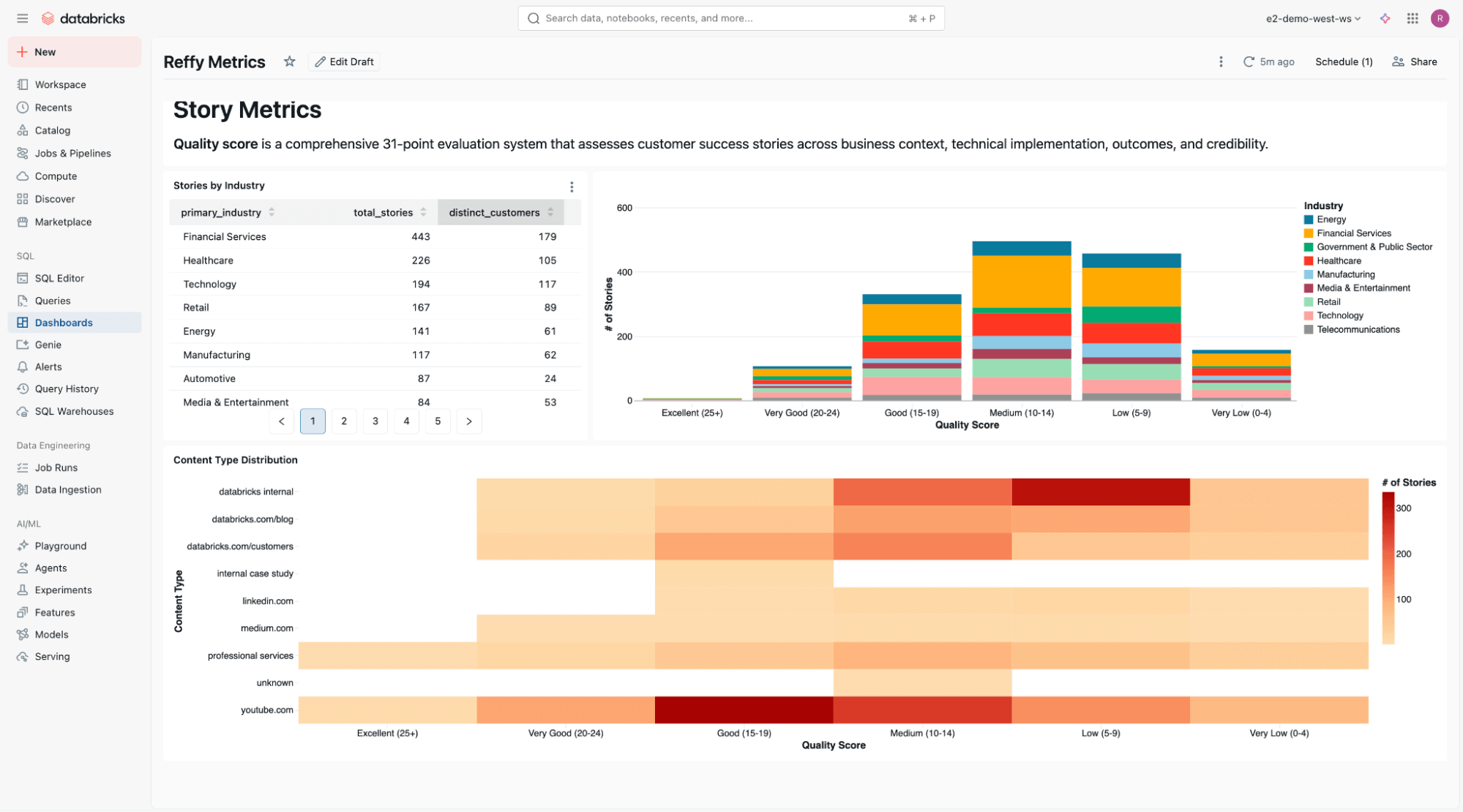

이제 모든 스토리를 한곳에 모았지만, 여전히 그 품질에 대한 인사이트는 없습니다. 이 문제를 해결하기 위해, 저희는 AI Functions를 통해 (저희 Value 팀이 개발한) 엄격한 31점 채점 시스템을 각 스토리에 적용하여 텍스트를 분류합니다. 저희는 Gemini 2.5에 프롬프트를 입력하여 비즈니스 과제, 해결책, 결과의 신뢰도, 그리고 Databricks가 가치를 제공하는 데 있어 왜 독보적인 위치에 있었는지를 파악함으로써 전반적인 스토리 품질을 판단하도록 합니다. 이처럼 스토리를 평가하면 Reffy에서 가장 품질이 낮은 스토리들을 걸러낼 수 있습니다. 또한 이 프롬프트는 국가 및 산업, 사용된 제품, 경쟁, 인용문과 같은 주요 메타데이터를 추출하고, 스토리가 공개적으로 공유 가능한지 또는 내부 전용인지에 따라 태그를 지정합니다. 이렇게 강화된 데이터 세트는 UC의 'Silver' 테이블에 저장됩니다.

ETL의 마지막 단계에는 점수가 낮은 사례를 필터링하고 필수적인 사례 구성 요소를 함께 연결하는 새로운 '요약' 열을 만드는 작업이 포함됩니다. 아이디어는 간단합니다. 이 '골드' 테이블을 Databricks AI Search 인덱스에 동기화하고, 요약 열에는 LLM이 고객 사례를 쿼리와 일치시키는 데 필요한 모든 필수 정보를 포함합니다.

에이전틱 AI

DSPy 프레임워크를 사용하여 하이브리드 키워드 및 시맨틱 검색으로 가장 관련성 높은 고객 레퍼런스를 조회할 수 있는 도구 호출 에이전트를 정의합니다. 저희는 DSPy를 정말 좋아합니다! DSPy로 구축된 에이전트는 매번 Model Serving 엔드포인트에 다시 배포할 필요 없이 Databricks 노트북에서 반복적으로 쉽게 테스트할 수 있어 개발 주기가 더 빨라집니다. 다른 인기 프레임워크에 비해 구문이 매우 직관적이며, 뛰어난 프롬프트 최적화 구성 요소를 포함합니다. 아직 확인해 보지 않으셨다면 꼭 DSPy를 확인해 보세요.

고객 사례 에이전트는 사용자 입력에 따라 번개처럼 빠른 순수 키워드 검색과 추론이 포함된 더 긴 형식의 LLM 응답을 모두 지원하도록 구성되었습니다. 질문을 하면 출처가 포함된 심층적인 답변을 얻을 수 있고, 키워드 몇 개만 입력하면 Reffy가 2초 이내에 최상위 결과를 반환합니다. 또한 RAG의 결과를 개선하기 위해 AI Search용 Databricks re-ranker 를 사용합니다.

균형 잡힌 전문적인 응답을 보장하기 위해 다음과 같은 시스템 프롬프트를 사용합니다.

에이전트는 당사의 Agent Framework 를 사용하여 MLflow에 기록되고 Databricks Model Serving 에 배포됩니다. 대부분의 처리가 모델 제공업체 측에서 수행되므로 소규모 CPU 인스턴스에 배포하여 GPU에 비해 인프라 비용을 절감할 수 있습니다.

Databricks 앱

이제 데이터를 정리 및 인덱싱하고 에이전트가 잘 작동하므로, 이 모든 것을 통합하여 비기술 사용자도 쉽게 접근할 수 있는 앱을 구축할 차례입니다. 저희는 React 프런트엔드와 FastAPI Python 백엔드를 선택했습니다. React는 브라우저에서 미려하고 빠르며, Model Serving endpoint의 스트리밍 출력을 지원합니다. FastAPI를 사용하면 앱에서 Databricks Python SDK의 모든 이점을 다음과 같이 활용할 수 있습니다.

- 통합 인증 — 개발 중 로컬에서 인증할 때와 Databricks Apps에 배포할 때 코드 변경이 필요 없습니다. 앱은 로컬 인증과 동일한 환경 변수를 가지므로 코드가 원활하게 작동합니다.

- 광범위한 API 적용 범위 — 단일 SDK를 통해 Model Serving을 호출하거나, SQL 쿼리를 실행하거나, Databricks Workspace에서 필요할 수 있는 모든 작업을 수행할 수 있습니다.

Reffy는 기본적으로 채팅 앱이므로 Lakebase 를 사용하여 빠른 읽기 및 쓰기, 품질 보증, 사용자가 재방문하거나 새 대화를 시작할 때 세심한 후속 조치를 위해 모든 대화 기록, 로그 및 사용자 ID를 영구적으로 저장합니다.

지속적인 모니터링 & 메트릭

Lakebase의 로그는 별도의 Lakeflow Job에서 처리되어 일일 활성 사용자 및 평균 응답 시간과 같은 주요 메트릭을 AI/BI Dashboard에 표시합니다. 이 대시보드는 또한 최근 입력과 응답을 보여주며, 한 단계 더 나아가 또 다른 AI 함수를 적용하여 입력과 응답을 최근 테마와 격차 분석으로 요약합니다. 우리는 어떤 고객 사례가 인기가 있고 어떤 부분에 격차가 있는지 파악하고자 하며, Reffy에서 수집하는 로그가 바로 이 작업을 도와줍니다. 예를 들어, 사용자들이 최신 Databricks 제품 중 두 가지인 Agent Bricks 와 Lakebase에 대한 사례를 특히 찾고 싶어 한다는 것을 발견했습니다.

대시보드 하단에는 산업 및 콘텐츠 유형 전반에 걸친 스토리 품질의 정적 분석이 포함되어 있습니다.

개발 설정에 대한 참고 사항

대부분의 프로젝트 개발은 Cursor에서 이루어지며, & 앞서 언급했듯이 Databricks CLI와 SDK 간의 통합 인증 덕분에 작업이 간단해집니다. CLI를 통해 한 번 로그인하면 SDK를 사용하는 모든 로컬 Reffy 빌드가 인증됩니다. Databricks Apps에서 테스트할 때는 CLI를 사용하여 최신 코드를 워크스페이스에 동기화한 다음 앱을 배포합니다. Databricks Apps는 로컬에 설정한 것과 동일한 인증용 환경 변수 를 확인하므로 SDK에 의존하는 Model Serving 및 SQL Warehouse에 대한 호출이 문제없이 작동합니다! 반복적인 개발 루프는 다음과 같습니다.

- CLI를 통해 Workspace에 로그인

- Cursor에서 코드 작성

- 로컬에서 테스트

- 코드를 워크스페이스에 동기화하고 & 앱 배포

- Databricks Apps에서 테스트

마지막으로 적절한 CI/CD와 이식성을 보장하기 위해 Databricks Asset Bundles 를 사용하여 Reffy가 사용하는 모든 코드와 리소스를 단일 패키지로 묶습니다. 그런 다음 이 번들은 GitHub Actions를 통해 대상 프로덕션 워크스페이스에 배포됩니다.

배운 점

Databricks 내 여러 팀이 이미 이 문제의 일부를 독립적으로 해결했으며, 자연스럽게 가장 흥미로운 작업인 AI 레이어에 끌렸습니다. 하지만 데이터 엔지니어링은 여전히 핵심이며, ETL을 올바르게 처리하고 스토리의 품질 점수를 매기고 효과적인 검색을 위해 데이터를 구조화하는 것이 에이전트 자체만큼이나 중요하다는 것이 입증되었습니다.

협업 또한 마찬가지로 중요했습니다. 고객 사례는 조직의 거의 모든 부분에 영향을 미칩니다. 영업, 마케팅, 필드 엔지니어��링, PR 모두가 각자의 역할을 합니다. 이러한 그룹과의 강력한 파트너십 구축은 제품과 그 기반이 되는 데이터를 형성하는 데 모두 영향을 미쳤습니다.

다음은 무엇인가요?

애플리케이션 프런트엔드가 즉각적인 가치를 제공하지만, 진정한 힘은 Reffy를 Databricks의 다른 솔루션과 연결하는 데서 나올 것입니다. 저희는 API 및 MCP 서버를 통해 이러한 연결성을 제공하여 팀이 기존 워크플로와 도구 내에서 직접 고객 인텔리전스에 액세스할 수 있도록 할 계획입니다.

Databricks와 Lakebase를 통해 시간의 흐름에 따라 수천 명의 사용자가 Reffy와 상호 작용하는 방식을 파악할 수 있습니다. 이러한 인사이트를 통해 도구를 지속적으로 개선하고 성장하는 이 생태계에 추가되는 스토리를 신중하게 만들어 나갈 수 있습니다.

오늘날 고객 레퍼런스 검색에 어려움을 겪고 있는 Databricks 팀에게 Reffy는 이러한 기능이 결합될 때 무엇이 가능한지에 대한 구체적인 예를 제공합니다. Databricks에서 자신만의 에이전틱 앱 구축을 시작하려면 Databricks 앱, RAG 가이드, Lakebase 및 Agent Bricks에 대해 자세히 알아보세요.

(이 글은 AI의 도움을 받아 번역되었습니다. 원문이 궁금하시다면 여기를 클릭해 주세요)

최신 게시물을 이메일로 받아보세요

블로그를 구독하고 최신 게시물을 이메일로 받아보세요.