Gefahrenvorhersage: Präzise Auszahlungen für eine volatile Welt

Katastrophen-Erkenntnisse in zeitnahe Reaktionen verwandeln

von Anindita Mahapatra, Timo Roest und Justin Monaldo

- Wie parametrische Versicherungen schnellere Katastrophenzahlungen durch objektive Auslöser ermöglichen.

- Warum Geodatenanalyse und Katastrophenmodellierung unerlässlich sind, um Basisrisiken zu reduzieren und genaue Auszahlungsbedingungen zu definieren.

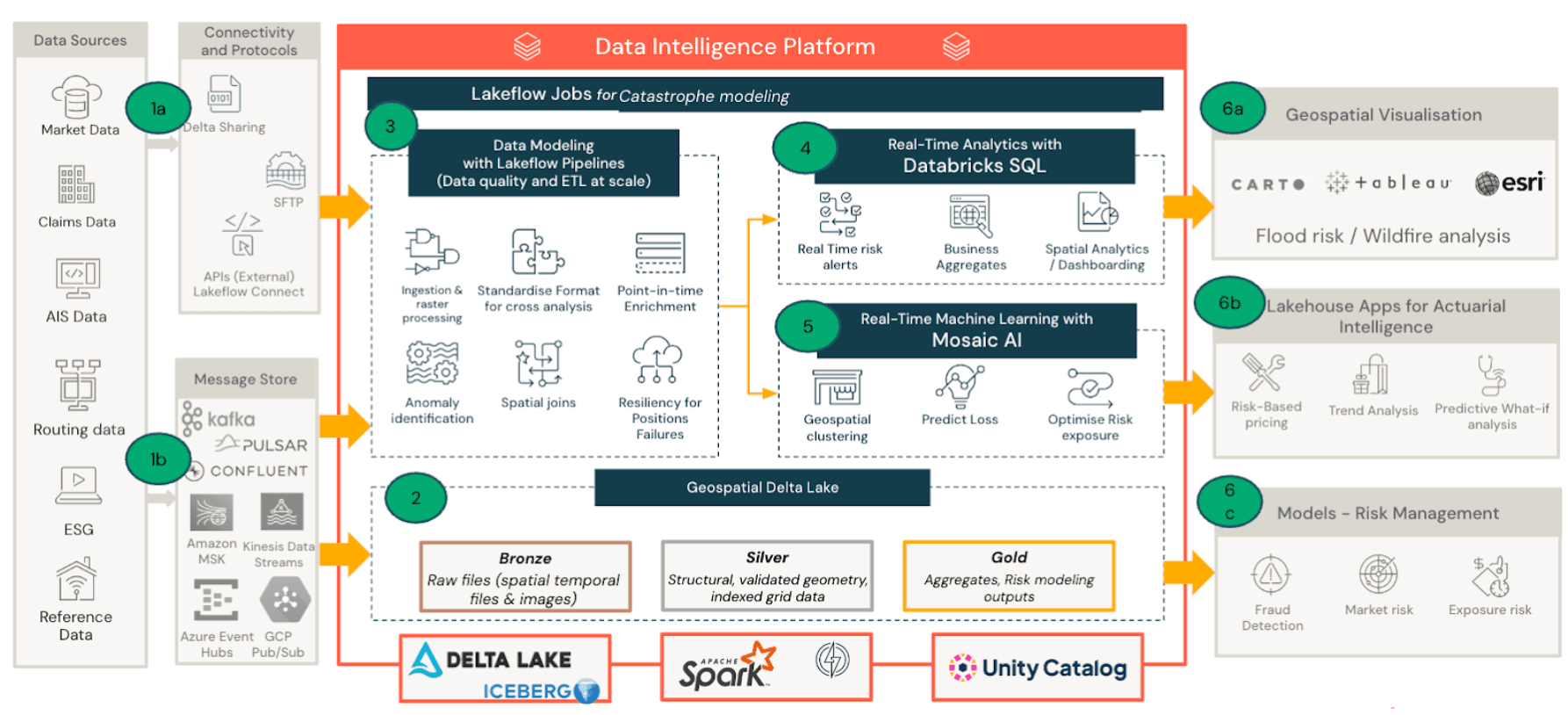

- Wie der Databricks Geospatial Lakehouse Versicherern hilft, Katastrophendaten zu erfassen, Risiken im großen Maßstab zu analysieren und parametrische Versicherungsworkflows zu operationalisieren.

Ein Kategorie-4-Hurrikan trifft auf die Golfküste Floridas. Innerhalb von Stunden – nicht Wochen – identifizieren Versicherer jede betroffene Immobilie im Sturmverlauf, gleichen sie mit Policenauslösern ab und beginnen mit der Auszahlung. Keine Gutachter werden entsandt. Keine Schadensformulare werden eingereicht. Die Daten sprechen für sich.

Das ist parametrische Versicherung in Aktion. Im Gegensatz zu herkömmlichen Entschädigungsmodellen, die verifizierte Verluste durch langwierige Schadensbewertungen erstatten, zahlen parametrische Policen automatisch aus, wenn vordefinierte Bedingungen erfüllt sind – Windgeschwindigkeiten, die einen Schwellenwert überschreiten, Niederschläge, die einen bestimmten Pegel überschreiten, oder ein Erdbeben, das eine bestimmte Stärke erreicht. Auszahlungen sind an objektive Ereignisdaten von vertrauenswürdigen Drittanbietern wie NOAA und USGS gebunden, was schnellere Gelder, klarere Bedingungen und weitaus geringeren Verwaltungsaufwand bedeutet.

Der Wandel wird durch Fortschritte in der Katastrophenmodellierung ermöglicht. Moderne Katastrophenmodelle kombinieren Geodaten, Wetterbeobachtungen, technische Erkenntnisse und historische Schadensaufzeichnungen, um die Wahrscheinlichkeit und die Auswirkungen extremer Ereignisse – Hurrikane, Überschwemmungen, Waldbrände, Erdbeben – abzuschätzen. Diese Modelle treiben eine wachsende Bandbreite von Anwendungsfällen an: Hochwasserrisikobewertung, Klimaszenarioanalyse, Höhenmodellierung, Dachflächenanalysen und Grundstücksbewertung. Insbesondere für parametrische Programme bilden sie die Grundlage für die Definition von Auslösern, die sowohl zuverlässig als auch fair sind.

Aber Modellierung allein reicht nicht aus. Die Operationalisierung der parametrischen Versicherung bedeutet die Verarbeitung riesiger Mengen an Geodaten und Umweltdaten in nahezu Echtzeit. Satellitenbilder, Wetterdaten, Expositionsdatensätze und Katastrophenmodellausgaben müssen zusammengeführt werden, damit bei einem auslösenden Ereignis die richtigen Policen sofort die richtigen Beträge auszahlen. Hier kommt die Databricks Geospatial Lakehouse ins Spiel – sie vereinheitlicht diese Datenquellen auf einer einzigen Plattform, damit Versicherer Katastrophenanalysen von der Erkenntnis bis zur Auszahlung skalieren können.

Geschäftseinblicke nach Persona

Das Databricks Lakehouse liefert Katastropheninformationen für jede Funktion in der Versicherungswertschöpfungskette. Jedes Team beginnt mit denselben einheitlichen Daten, stellt aber unterschiedliche Fragen:

| Persona | Schlüsselfrage |

| Underwriter | Welche Immobilien liegen in der Hurrikan-Einflusszone, wie hoch ist unsere Gesamtexposition und wie sollen wir diese Region zukünftig bepreisen? |

Risikomanager | Wie konzentriert ist unsere Exposition in Hochrisikogebieten und liegen wir innerhalb der Risikotoleranzschwellen? |

Schaden | Welche Policen sollten eine sofortige Auszahlung auslösen und können wir den Schaden schnell validieren? |

Finanzen | Wie hoch ist der geschätzte Verlust im Vergleich zur Rückversicherungsdeckung und wie wirkt sich das auf die Portfolioprofibilität aus? |

Underwriter

Geospatiale Portfoliofilterung ermöglicht es Underwritern, Policen innerhalb eines Sturmgebiets anzuzeigen, überlagert mit Hurrikanbahnen, Windzonen oder Überschwemmungsgebieten. Exposition-Heatmaps zeigen auf einen Blick hoch bewertete Cluster, und immobilienbezogene Detailansichten zeigen versicherten Wert, Deckungsgrenzen und Standortrisiken. Genie ermöglicht die Erkundung derselben Daten in natürlicher Sprache.

Risikomanager

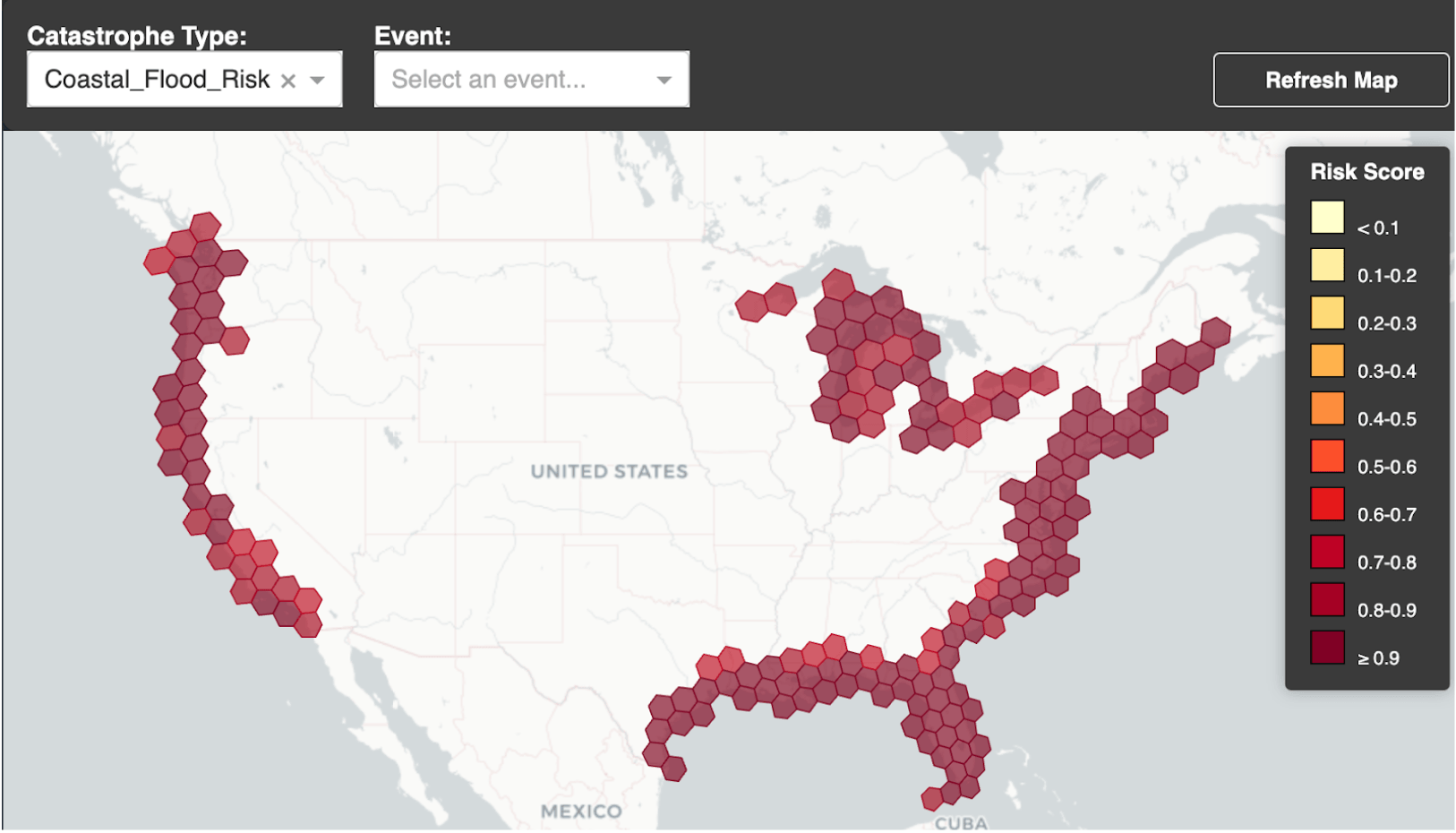

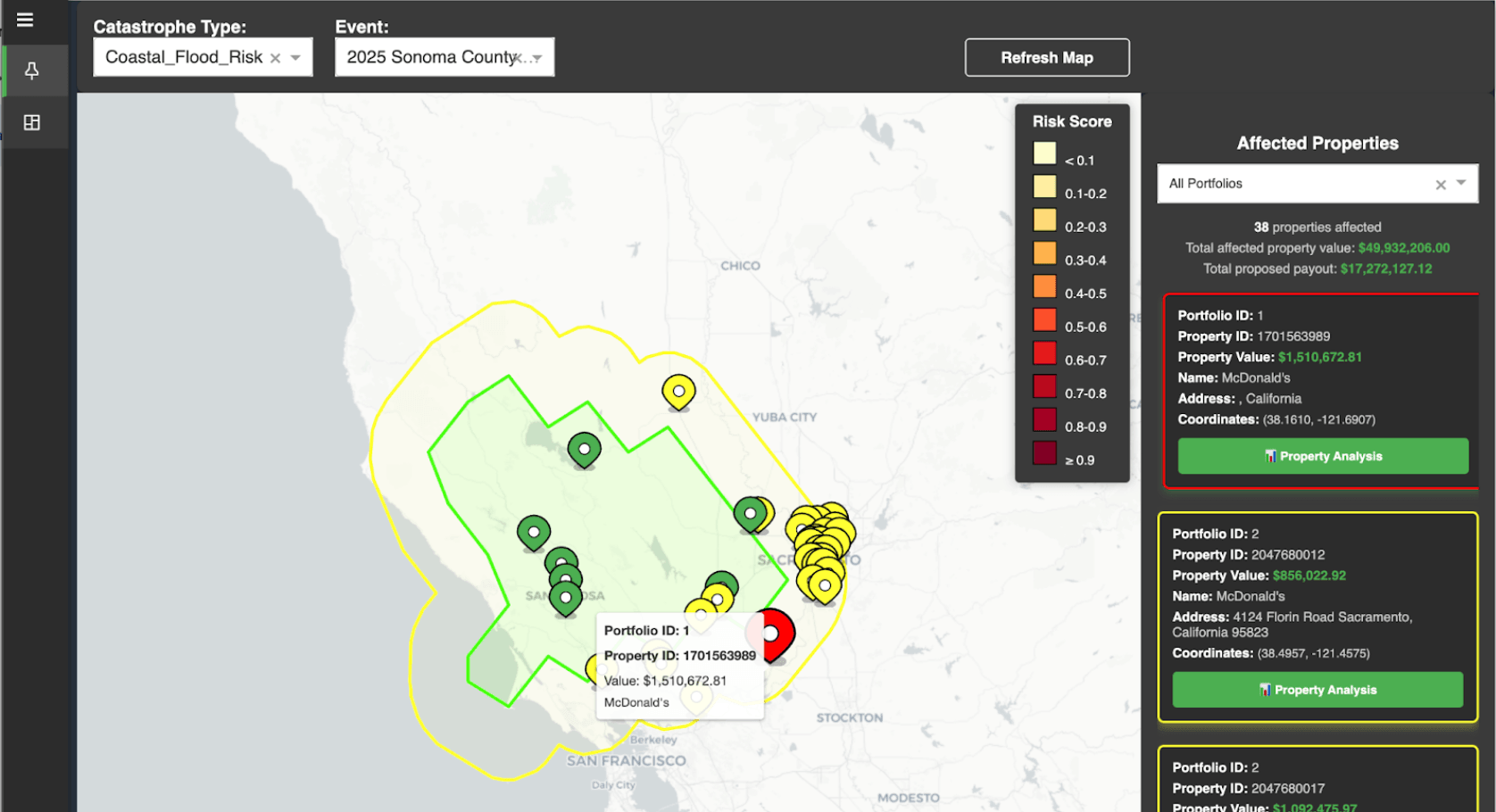

Risikomanager überwachen die geografische Konzentration und die Katastrophenakkumulation im gesamten Portfolio. Die Filterung nach Katastrophentyp oder spezifischem Ereignis rendert betroffene Immobilien auf einer Karte – farblich nach Schweregrad kodiert – mit zugänglichen Portfoliodetails pro Immobilie.

Schadenermittler

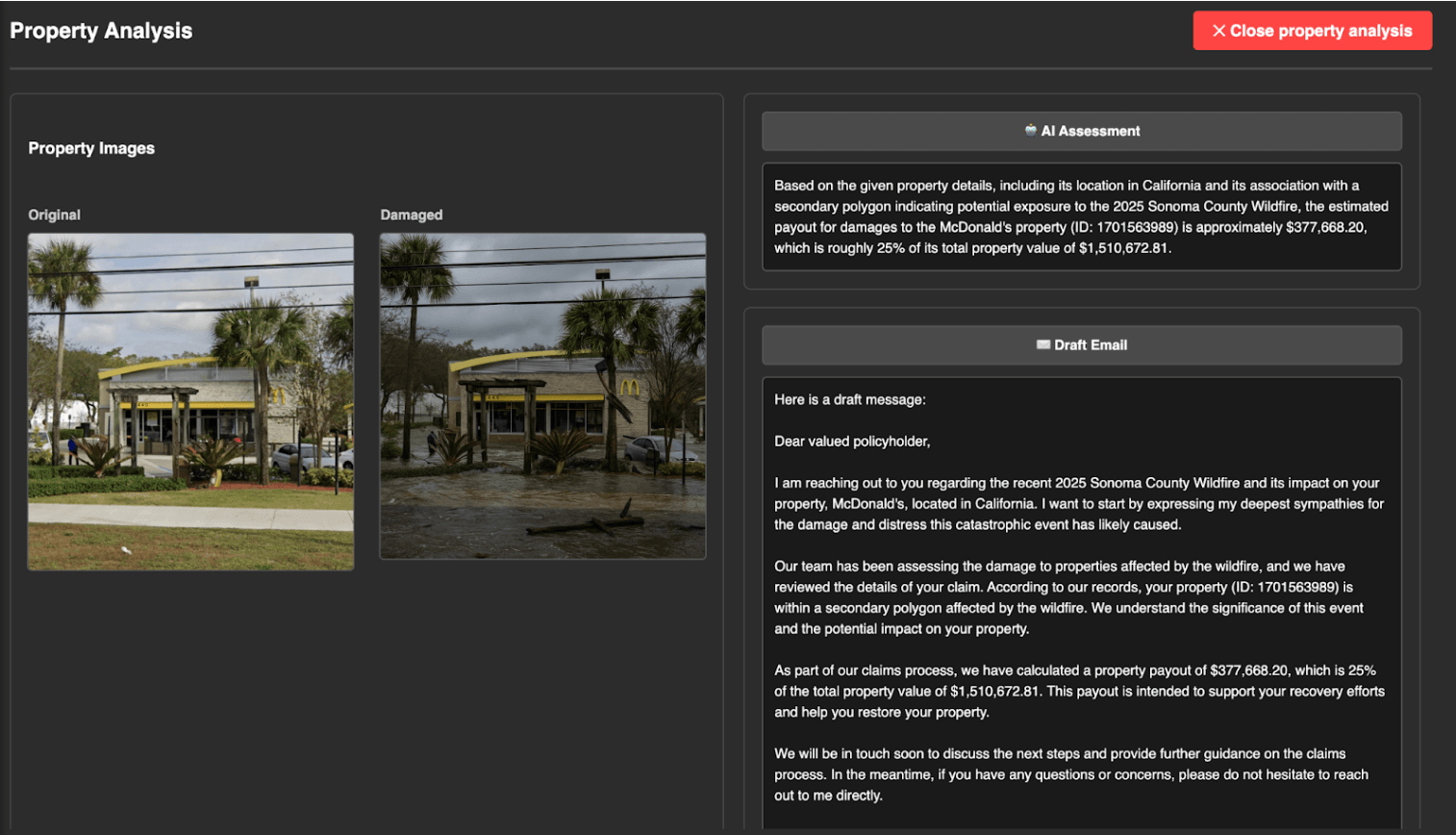

Parametrische Auslöser werden automatisch erkannt, wenn Ereignisschwellenwerte überschritten werden, wodurch berechtigte Policen und geografische Auszahlungszonen angezeigt werden. Zur Validierung werden durch Klicken auf eine Immobilie Vorher-Nachher-Luftbilder angezeigt. Multimodale KI-Modelle auf Databricks können diese Bilder analysieren, um Schadenmuster zu bestätigen, Betrug zu erkennen und Auszahlungen zu beschleunigen – alles gesteuert über das AI Gateway.

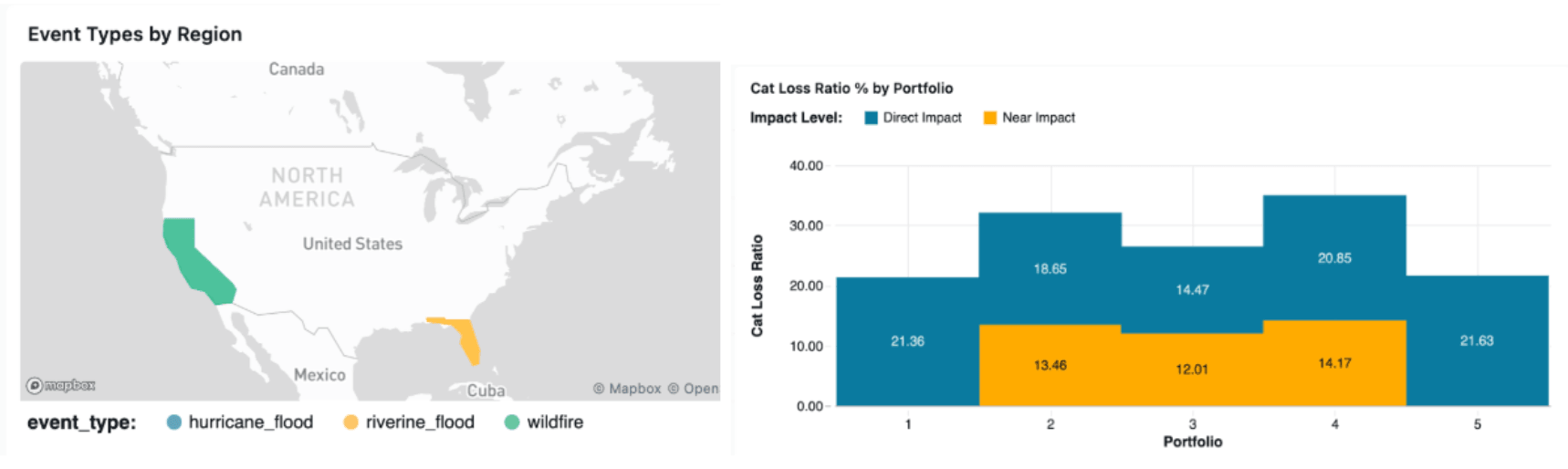

Finanzen

Dashboards zur Schätzung von Ereignisschäden geben Finanzteams eine Echtzeitansicht der Kapitalexposition und der Portfolioperformance, während Katastrophenereignisse eintreten.

Lakehouse-Architektur für parametrische Versicherungen

Die Lakehouse-Architektur vereinheitlicht schwer zu beschaffende Geodaten für Analysen und ML. Das Geospatial Lakehouse von Databricks hilft Versicherern, Rückversicherern und Risikomodellierern, standortbasierte Daten in großem Maßstab zu verwalten, zu analysieren und darauf zu reagieren, was eine entscheidende Voraussetzung für parametrische Versicherungen, Katastrophenmodellierung und Risikotechnik ist.

- Datenerfassung: Satellitendaten, Gefahrenfeeds und Expositionsdatensätze landen im Delta Lake.

- Geospatiale Verarbeitung und Modellierung: räumliche Joins, Näheanalysen und Katastrophenmodellierungs-Pipelines laufen auf Spark.

- Geschäftliche Nutzung: Dashboards, Lakehouse Apps und Genie ermöglichen es Analysten und Führungskräften, Katastrophenexpositionen zu untersuchen und Auszahlungen auszulösen.

Hier ist eine Zusammenfassung der wichtigsten Vorteile:

Daten landen im Lake

Wenn sich ein Hurrikan bildet, beginnen Satellitenbilder, NOAA-Windbeobachtungen, Hochwassermodellausgaben und seismische Feeds, zusammen mit den eigenen Expositions- und Policendaten des Versicherers, in Delta Lake zu strömen. Delta Live Tables und Structured Streaming halten diese Ebenen kontinuierlich auf dem neuesten Stand, sodass die Plattform bis zum Landfall des Sturms bereits ein nahezu Echtzeitbild der Bedingungen vor Ort hat. Typische Datenquellen umfassen:

Gefahrenereignisdaten (Auslöserquellen) |

|

Expositions- & Asset-Daten |

|

Validierungs- und Marktdaten |

|

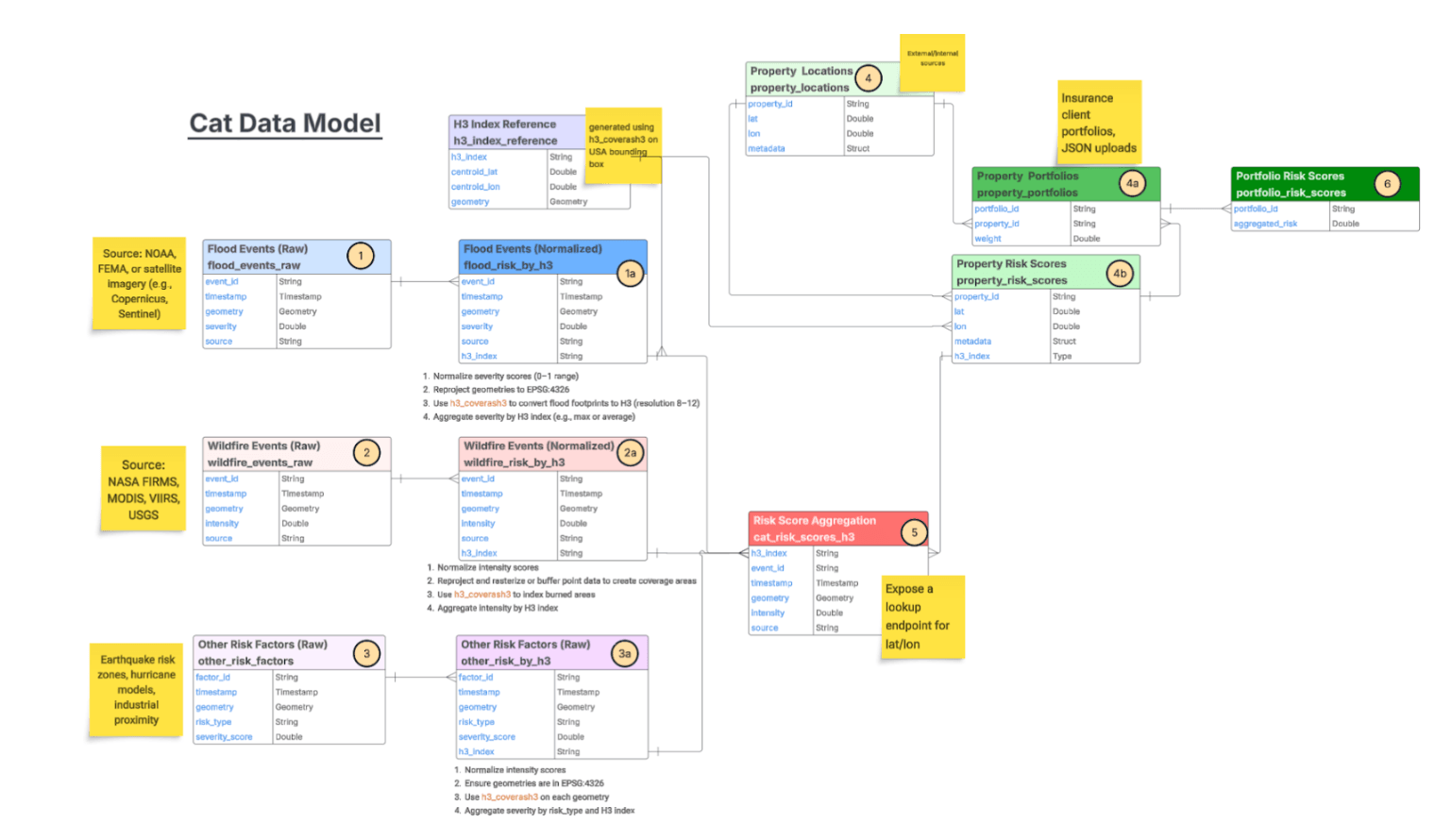

Georäumliche Verarbeitung gleicht Ereignisse mit Policen ab

Während Gefahrendaten eingehen, normalisiert die Medaillon-Architektur diese in H3-Indizes und Risikobewertungen. Die über 100 nativen räumlichen Funktionen von Spark SQL wie ST_Intersects, ST_Within, ST_Buffer, ST_Distance ermöglichen verteilte räumliche Joins, um jedes versicherte Vermögen mit Sturm-Footprints, Überschwemmungsgebieten und konzentrischen Auszahlungsstufen abzugleichen. Operationen, die ein herkömmliches GIS-Tool überfordern würden, skalieren hier auf Milliarden von Geotag-Zeilen.

Löst Feuer und Auszahlungen aus

Wenn Ereignismessungen Policenschwellenwerte überschreiten, identifiziert die Plattform berechtigte Policen, berechnet gestaffelte Auszahlungen basierend auf der Nähe zum Epizentrum und stellt die Ergebnisse den Schadensteams über Dashboards, Lakehouse Apps und Genie zur Verfügung. KI-Modelle validieren Schäden anhand von Luftbildern, bevor Auszahlungen freigegeben werden.

Governance hält alles zusammen

Unity Catalog bietet feingranulare Zugriffskontrolle, Abstammungsverfolgung und Metadatenverwaltung für jeden räumlichen Datensatz in der Pipeline. Wenn Broker, Rückversicherer oder Aufsichtsbehörden Zugriff benötigen, stellt Delta Sharing diesen ohne Datenverdopplung bereit.

Wichtige Erkenntnisse

- Parametrische Versicherungen verändern die Katastrophenhilfe und ermöglichen schnellere Auszahlungen, die durch objektive Ereignisdaten ausgelöst werden.

- Georäumliche Analysen und Katastrophenmodellierung sind entscheidend für die Definition genauer Auslöser und die Reduzierung von Basisrisiken.

- Das Databricks Geospatial Lakehouse vereinheitlicht Satellitendaten, Expositionsdaten und Katastrophenmodelle, sodass Versicherer Risiken im globalen Maßstab analysieren können.

- KI und maschinelles Lernen verbessern parametrische Programme weiter und unterstützen die Schadensvalidierung, die Betrugserkennung und die verbesserte Risikomodellierung.

Da klimabedingte Katastrophen häufiger und schwerwiegender auftreten, müssen Versicherer zu schnelleren, datengesteuerten Ansätzen für den Risikotransfer übergehen. Durch die Kombination von groß angelegten georäumlichen Analysen mit vereinheitlichten Daten und KI-Funktionen ermöglicht das Databricks Lakehouse Versicherern, Katastropheneinblicke in schnelle, transparente Auszahlungen umzuwandeln.

(Dieser Blogbeitrag wurde mit KI-gestützten Tools übersetzt.) Originalbeitrag

Erhalten Sie die neuesten Beiträge in Ihrem Posteingang

Abonnieren Sie unseren Blog und erhalten Sie die neuesten Beiträge direkt in Ihren Posteingang.