Une approche axée sur l'IA pour l'ingénierie des données avec Lakeflow et Agent Bricks

Comment Lakeflow et Agent Bricks apportent l'automatisation optimisée par l'IA à chaque étape de votre pipeline ETL

par Joanna Zouhour

- Lakeflow offre une plateforme d'ingénierie des données axée sur l'IA qui leur permet d'exploiter et de mettre en production des modèles d'IA dans leur ETL avec les AI functions d'Agent Bricks

- Les data engineers peuvent facilement orchestrer leurs modèles d'IA pour monter en charge avec Lakeflow Jobs, en automatisant leur pipeline ETL dans le contexte de leur entreprise

- Du rapprochement approximatif (fuzzy matching) à l'extraction et à la synthèse de données, les utilisateurs de Lakeflow Jobs peuvent débloquer des cas d'utilisation de pipeline et extraire de nouveaux key insights qui peuvent alimenter leurs cas d'utilisation en aval pour l'analytique, la BI et le ML.

Les ingénieurs de données se concentrent de plus en plus sur un problème central : utiliser l'IA pour améliorer l'ETL et créer des pipelines fiables et de qualité production sans introduire de complexité supplémentaire. Ils ont besoin d'une IA réellement performante, qui rationalise les workflows sans ajouter d'outils déconnectés ni supprimer le contexte.

Databricks Lakeflow fournit une plateforme de Data Engineering unifiée avec une IA intégrée et sécurisée qui automatise l'ensemble de votre traitement de données, révèle davantage d'insights et prend en charge un plus large éventail de problèmes métier. Que ce soit avec du code de pipeline généré par l'IA ou en orchestrant des workloads d'IA, les data engineers qui utilisent Lakeflow peuvent éviter de passer des heures sur des tâches manuelles fastidieuses et se concentrer plutôt sur des modèles stratégiques à plus forte valeur ajoutée qui ont un impact réel sur leur activité.

Dans ce blog, nous verrons comment vous pouvez industrialiser et monter en charge vos modèles d'IA en les implémentant dans votre pipeline de données afin de dégager automatiquement des insights.

Extrayez sans effort plus d'insights de vos données à grande échelle

Les équipes de données croulent sous les entrées non structurées, qu'il s'agisse de contrats, de factures, de transcriptions ou d'avis. Leur traitement implique souvent de jongler avec des modèles NLP fragiles, des règles rigides ou un nettoyage manuel. Résultat : des sorties peu fiables, des délais d'exécution lents et de précieuses insights bloquées dans les documents, tandis que les ingénieurs perdent du temps sur des analyses répétitives au lieu de générer de l'impact.

Avec Databricks Lakeflow, vous pouvez résoudre ce problème en intégrant en toute transparence des transformations basées sur l'IA dans vos flux de travail existants grâce aux AI Functions de Databricks Agent Bricks. Ces fonctions vous permettent d'intégrer une IA de haute qualité directement dans votre processus ETL, en automatisant l'extraction, la transformation et la classification des données structurées et non structurées à grande échelle.

Il existe plusieurs types de fonctions d'IA dans Agent Bricks parmi lesquelles vous pouvez choisir. Certaines d'entre elles ne nécessitent pas de prompts et sont spécifiques à une tâche, telles que :

ai_extract: extrayez des entités spécifiques du texte d'entrée en fonction des étiquettes que vous fournissez. Par exemple, personne, lieu, organisationai_classify: Classifiez le texte d'entrée en fonction des étiquettes que vous fournissez. Par exemple, « urgent » ou « non urgent », ou des catégories de sujets.ai_translate: Traduire du texte dans une langue cible spécifiée.

Nous sommes particulièrement enthousiastes à propos de notre fonction d'IA récemment lancée ai_parse_document, qui peut être utilisée pour transformer n'importe quelle donnée non structurée dans les formats structurés requis. À l'aide de modèles de fondation multimodaux, ai_parse_doc vous permet d'analyser du texte, d'extraire des tableaux, de raisonner sur des chiffres et de transformer des images en descriptions générées par l'IA. Cette fonction ouvre de nouvelles possibilités pour le traitement de données qu'il était auparavant presque impossible d'analyser. En savoir plus ici

Nous proposons également une fonction plus générale appelée ai_query(), basée sur notre plateforme d'inférence par lots serverless. Cette fonction vous permet d'exécuter des transformations basées sur l'IA sur de grands jeux de données en utilisant n'importe quel LLM de votre choix en une seule fois.

Pour maximiser les performances sur des millions de lignes, notre moteur d'inférence batch serverless provisionne et monte en charge automatiquement les ressources compute et exécute les charges de travail en parallèle. Cela supprime la surcharge par requête et offre un traitement nettement plus rapide, réduisant les temps d'exécution de plusieurs heures à quelques minutes tout en améliorant la rentabilité des charges de travail d'IA à volume élevé.

Avec Lakeflow, vous pouvez facilement mettre en production vos modèles d'IA et les orchestrer en mode natif dans votre solution de Data Engineering à l'aide de Lakeflow Jobs. Avec les AI functions, vous pouvez améliorer l'efficacité de votre orchestration et débloquer davantage de cas d'utilisation, tels que :

- Générer de nouvelles données. Utilisez l'IA pour rédiger des résumés sur les insights client afin d'accélérer le reporting ou pour prévoir les revenus futurs.

- Structurez et organisez les données en catégories commerciales spécifiques et pertinentes. Effectuez des analyses de sentiments sur des millions d'avis multilingues ou automatisez la segmentation des clients à l'aide d'invites en langage naturel à grande échelle.

- Améliorez la qualité des données. Utilisez la correspondance floue et la résolution d'entité pour corriger les doublons et les incohérences lorsque vous montez en charge.

L'association de Lakeflow et d'Agent Bricks vous permet d'exécuter vos modèles d'IA sur une plateforme de données unique, unifiée et gouvernée, afin que votre IA, et les insights qu'elle en extrait, disposent du contexte commercial et d'entreprise approprié.

Cas d'usage pratiques des fonctions d'IA et de Lakeflow

Exemple 1 : Transformer des transcriptions d'appels brutes en insights

Imaginez que votre équipe de ventes ait besoin d'un moyen fiable pour transformer de longues transcriptions d'appels non structurées en résumés clairs et exploitables. Avec des centaines d'appels par jour, dont beaucoup durent de 45 à 60 minutes, l'examen manuel devient rapidement impossible.

Avec Databricks, vous pouvez exploiter les fonctions d'IA intégrées pour analyser facilement et rapidement toutes ces transcriptions, en extraire les insights clés et générer des recommandations de suivi.

Au lieu de créer un service d'IA distinct ou de gérer des agents personnalisés, vous pouvez simplement écrire une requête et l'exécuter dans le cadre de votre orchestrateur avec Lakeflow Jobs. Votre modèle d'IA est ensuite implémenté directement dans une plateforme de Data Engineering gouvernée et unifiée, où vous bénéficiez d'un traitement par batch évolutif qui reste entièrement intégré à vos flux de travail de pipeline de Ventes existants tout en restant dans le bon contexte commercial et d'entreprise.

Voyons comment cela fonctionne en pratique. Après avoir ingéré les transcriptions d'appels dans votre pipeline, vous pouvez appliquer des fonctions d'IA pour convertir du texte non structuré en signaux exploitables :

ai_analyze_sentimentpour faire ressortir le sentiment général de l'appel (positif, négatif, neutre)ai_extractpour extraire les informations clés des appels, y compris le nom du client, le nom de l'entreprise, l'intitulé du poste, le numéro de téléphone, etc.ai_classifypour classer le type d'appel (urgence, sujet, etc.)

Vous disposez ainsi d'une base structurée pour l'analytique et l'automatisation en aval.

Ensuite, utilisez ai_query pour résumer chaque appel à l'aide du modèle d'IA de votre choix (dans notre exemple, nous utilisons un LLM « databricks-meta-llama-3-3-70b-instruct ») :

Cette requête produit des résumés cohérents et de haute qualité que les équipes commerciales et comptables peuvent consulter en un clin d'œil.

Vous pouvez ensuite générer des suivis personnalisés dans le même workflow :

Ces notes peuvent ensuite être transférées directement dans votre CRM ou vos outils de Ventes à grande échelle, afin que vos équipes sachent exactement la marche à suivre peu de temps après la fin de l'appel. Vous pourriez également partager ces notes avec votre équipe BI pour découvrir les lacunes et aider à améliorer l'expérience client globale.

Exemple 2 : Rationalisation du traitement des demandes d'indemnisation

Imaginez que vous développez un pipeline de traitement des sinistres pour un assureur qui a besoin d'approbations plus rapides et plus cohérentes. Aujourd'hui, les demandes de sinistre arrivent souvent par e-mail avec des pièces jointes non structurées, telles que des documents numérisés, des photos et des PDF, ce qui les rend difficiles à ingérer et à traiter à grande échelle.

Avec Agent Bricks et Lakeflow, les ingénieurs de données peuvent utiliser ai_parse_document et ai_query pour extraire, normaliser et consolider automatiquement les données des e-mails entrants dans le cadre de leurs pipelines ETL. Cela permet une automatisation de bout en bout fiable qui réduit la révision manuelle, accélère les décisions et s'intègre de manière transparente aux workflows de données existants.

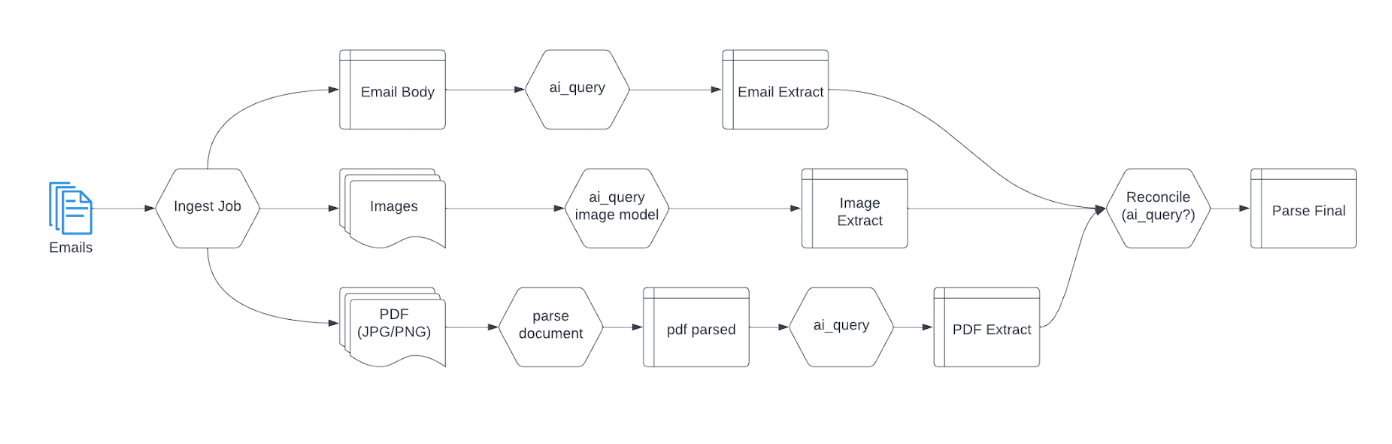

Voici comment cela fonctionnerait :

Avec Lakeflow et Agent Bricks, vous pouvez ingérer vos fichiers d'e-mails dans votre lakehouse, puis extraire les données dont vous avez besoin avec :

ai_querypour lire le corps de l'e-mail et en extraire les informations clés (par exemple : nom, date de naissance, adresse, numéro de sécurité sociale)ai_queryavec un modèle capable de lire spécifiquement le type d'image entrant. Cette fonction d'IA générera du texte décrivant l'image jointe et extraira ses métadonnées. Voici un exemple de requête SQL de cette fonction :

- et

ai_parse_documentpour lire tout PDF (jpg ou png) joint à l'e-mail

Une fois les données extraites, vous pouvez à nouveau utiliser ai_query pour consolider toutes les informations dans un fichier qui peut être soit réutilisé dans un autre flux de travail, soit partagé directement avec une équipe en aval (analyste BI, équipe IA/ML, etc.), en fonction de votre cas d'utilisation.

Voici un exemple de DAG de ce à quoi ce workflow ressemblerait dans Lakeflow Jobs :

Vous pouvez faire tellement plus en combinant Lakeflow et Agent Bricks : regardez cette vidéo pour découvrir comment transformer des données de vente désordonnées en campagnes marketing pilotées par l'IA.

Applications concrètes de l'IA dans Databricks

De nombreux clients et data engineers de Databricks ont résolu avec succès divers problèmes commerciaux (Tarifs, réussite client et Marketing) en utilisant l'IA et Lakeflow pour obtenir des insights et améliorer la productivité.

Kard, une entreprise de technologie financière basée à New York, utilise les fonctions d'IA d'Agent Bricks pour alimenter un système de catégorisation des transactions évolutif et précis qui remplace les méthodes héritées manuelles et incohérentes. Cette approche moderne permet à Kard de traiter efficacement des milliards de transactions, d'offrir des récompenses personnalisées et de fournir des insights plus riches qui favorisent la fidélité et la valeur commerciale.

L'équipe d'ingénierie des données de Banco Bradesco, l'une des plus grandes banques d'Amérique latine, a été confrontée à des goulots d'étranglement en matière de productivité en raison de longs processus de codage, de débogage et de documentation. En adoptant Databricks Assistant, elle a réduit le temps de codage de 50 % et a permis aux utilisateurs techniques et non techniques de générer et de dépanner du code en utilisant le langage naturel, démocratisant ainsi l'accès aux données, réduisant les coûts et accélérant les décisions data-driven.

Locala, une plateforme publicitaire omnicanale mondiale, a utilisé Lakeflow Jobs pour orchestrer des pipelines d'entraînement de LLM complexes, que son ordonnanceur précédent, Airflow, ne pouvait pas gérer. En rationalisant l'ETL, l'entraînement et l'expérimentation de modèles, ainsi que la sélection de compute, Lakeflow Jobs a éliminé la charge opérationnelle de la gestion de workflows complexes, permettant à un seul data scientist de créer un assistant GenAI qui est devenu une fonctionnalité Ventes clé pour l'entreprise ad-tech.

Avec Lakeflow, vous pouvez facilement intégrer des capacités d'IA dans votre plateforme d'ingénierie des données et orchestrer des flux de travail d'IA, ce qui rend vos processus de données plus efficaces, plus accessibles et davantage axés sur les informations. Et ce n'est pas tout ! Bientôt, vous pourrez utiliser Databricks Genie pour alimenter votre plateforme de Data Engineering afin de créer et de debugging des pipelines à l'aide du traitement du langage naturel.

- Commencez avec Databricks Free Edition

- Consultez la documentation produit de nos fonctions d'IA Databricks

- En savoir plus sur Databricks Genie

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.