Comment les plus grandes entreprises technologiques éliminent la taxe du constructeur avec Lakebase

Les applications natives d'IA nécessitent que les données opérationnelles et les analyses coexistent — voici comment les équipes suppriment cette barrière.

par Amey Banarse et Madelyn Mullen

- Réduire les couches de déplacement des données : Les organisations leaders utilisent Databricks Lakebase, éliminant l'ETL et l'ETL inversé en unifiant les données opérationnelles et analytiques sur une seule plateforme gouvernée.

- Activer l'intelligence en temps réel : Les applications et les systèmes d'IA fonctionnent directement sur des données fraîches à faible latence, sans décalage de synchronisation.

- Mettre en production des systèmes d'IA : Une architecture unifiée réduit la surcharge opérationnelle et permet des boucles d'apprentissage continues à grande échelle.

Le coût caché qui freine la feuille de route de vos applications IA

Dans les principales organisations technologiques qui développent des applications natives d'IA, la principale contrainte est passée de la capacité du modèle à l'architecture de données sous-jacente, et plus spécifiquement, aux pipelines de données. Les exigences des systèmes d'IA en matière d'accès à un contexte étatiste et en temps réel, ainsi qu'un faible coût marginal pour un développement rapide et expérimental, ont révélé le défaut critique des architectures de données traditionnelles et séparées.

Les charges de travail opérationnelles s'exécutent généralement sur des bases de données transactionnelles cloud (par exemple, des moteurs Postgres/MySQL gérés), tandis que l'analytique, les pipelines ML et l'ingénierie des caractéristiques résident dans le lakehouse. La synchronisation entre ces couches repose sur un réseau complexe de pipelines CDC, de jobs ETL/ELT et de frameworks ETL inversés. Cela entraîne des inefficacités systémiques :

- Données obsolètes : les systèmes d'IA fonctionnent sur des instantanés retardés plutôt que sur un état en temps réel

- Fragmentation architecturale : la gouvernance, la lignée et le contrôle d'accès sont dupliqués sur plusieurs systèmes

- Surcharge opérationnelle : l'effort d'ingénierie passe du développement de produits à l'orchestration de pipelines et à la gestion des défaillances

Nous appelons cela la taxe du développeur : une inefficacité structurelle découlant de piles opérationnelles et analytiques découplées. Pour les personnes au sein des entreprises technologiques qui développent les plateformes, les produits SaaS et les outils de développement sur lesquels tout le monde s'appuie, cette taxe est particulièrement dommageable. Chaque nouvelle fonctionnalité d'IA engendre une nouvelle base de données, un nouveau pipeline, un nouveau trimestre de retard.

Changement architectural : co-localisation des applications et des données

Pour rompre ce schéma, les principales entreprises technologiques redéfinissent l'architecture, allant au-delà de l'adoption d'un simple outil spécialisé. Nous les voyons exécuter des applications et de l'IA directement sur la même fondation gouvernée que leur analytique.

Cette fondation est Lakebase : un moteur Postgres serverless entièrement géré, nativement intégré à la plateforme Databricks.

- Les applications lisent et écrivent directement sur les données gérées par le lakehouse

- La gouvernance est centralisée via Unity Catalog pour toutes les charges de travail

- Données opérationnelles fiables avec des instantanés automatisés et une récupération intégrée des défaillances

Cela établit une Fondation d'Applications Interopérables : une couche unique et gouvernée où les applications, l'IA et l'analytique partagent le même magasin opérationnel.

Scénario réel

Amey Banarse a présenté « From Transactions to Agents: PostgreSQL in Modern AI Applications » à PostgresConf 2026 [Diapositives]. Amey présente une démonstration en direct d'une application de réclamations santé entièrement construite sur Lakebase + l'AI DevKit, montrant comment l'intelligence du lakehouse, les informations opérationnelles et une boucle d'apprentissage continue s'exécutent sur une seule fondation Databricks.

Les organisations adoptent généralement cette architecture par trois vecteurs principaux :

- Élimination des pipelines ETL inversés : les jeux de données analytiques (tables de couche or) sont synchronisés directement dans Lakebase via une intégration native. Cela supprime la dépendance aux outils externes et réduit la fragilité des pipelines.

- Applications natives d'IA et outils internes : exécutez Databricks Apps + Lakebase comme une pile unique et serverless avec service de modèles, magasin de caractéristiques et analytique. Aucune infrastructure supplémentaire à provisionner.

- Mémoire et état de l'agent : Lakebase avec pgvector pour la recherche sémantique devient la couche de mémoire opérationnelle pour les agents construits avec Agent Bricks, aux côtés des données sur lesquelles ils raisonnent.

Ce que les entreprises technologiques constatent réellement

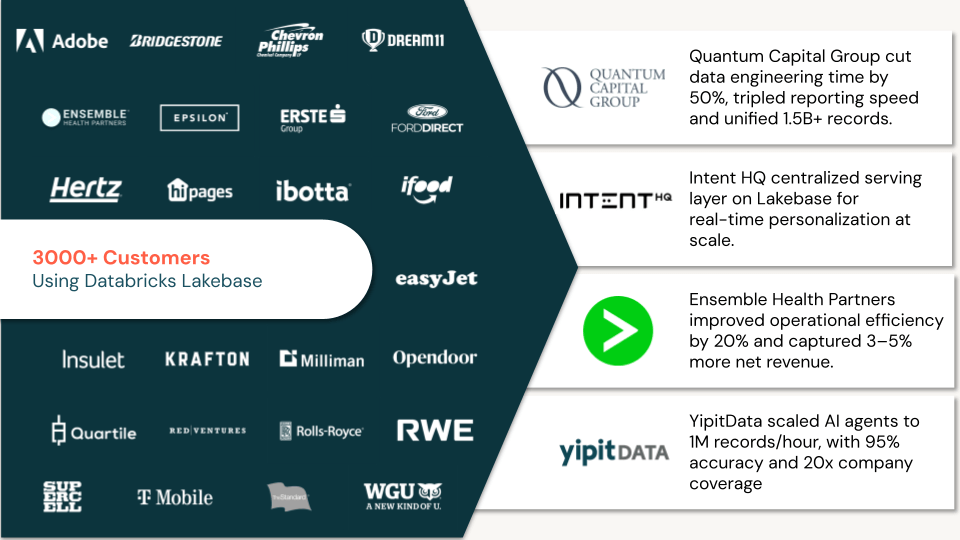

Les résultats ci-dessous proviennent d'entreprises technologiques qui sont passées à une architecture Lakebase :

YipitData a mis à l'échelle son pipeline d'agents IA pour traiter 1 million d'enregistrements par heure, atteignant une précision de marquage de 92 à 95 % et une couverture de 20 fois plus d'entreprises. En utilisant Lakebase comme système relationnel de référence au sein d'Unity Catalog, leurs agents fonctionnent avec un état durable et gouverné — pas de magasins externes fragiles, pas de décalage de synchronisation.

Quantum Capital Group gérait plus de 1,5 milliard d'enregistrements répartis sur six sources de données fragmentées. Après consolidation sur Lakebase, ils ont éliminé plus de 100 tables redondantes, réduit le temps d'ingénierie des données de 50 % et triplé la vitesse de reporting — les équipes travaillent désormais à partir d'un seul jeu de données fiable au lieu de lutter contre la prolifération des versions.

Ensemble Health Partners a unifié plus de 15 systèmes SQL Server fragmentés. Avec Lakebase comme couche transactionnelle, ils ont déployé des flux de travail de cycle de revenus pilotés par l'IA qui ont amélioré l'efficacité opérationnelle de 20 % et aidé les clients à capturer 3 à 5 % de revenus nets supplémentaires d'une année sur l'autre.

Replit, dont la plateforme permet à des millions de développeurs de créer et déployer des logiciels, utilise Lakebase + l'AI DevKit de Databricks pour aider les clients à lancer des IA de génération de code en production en 3 semaines avec une vélocité de développement 10 fois supérieure, éliminant l'écart entre les systèmes opérationnels et analytiques dès le premier jour.

IntentHQ, une plateforme d'intelligence consommateur, a centralisé sa couche de service sur Lakebase pour alimenter la personnalisation en temps réel à grande échelle — donnant aux modèles d'IA un magasin opérationnel à faible latence qui reste synchronisé avec ses données de lakehouse sans pipelines personnalisés.

Le modèle architectural derrière les résultats

Malgré des cas d'utilisation variés — des agents IA et moteurs de personnalisation aux flux de travail de santé et plateformes de développement — ces organisations ne réussissent pas grâce à des optimisations isolées. Elles convergent vers un modèle architectural fondamentalement différent.

À son cœur, ce modèle architectural élimine la séparation traditionnelle entre les systèmes transactionnels, les plateformes analytiques et les pipelines d'IA, la remplaçant par une fondation de données partagée et interopérable.

Ce modèle comprend constamment trois couches étroitement intégrées :

Couche d'intelligence du lakehouse

Une fondation gouvernée et évolutive où s'exécutent les données batch et de streaming, l'ingénierie des caractéristiques et les charges de travail IA/ML. Cette couche fournit le système de connaissance, permettant le traitement à grande échelle, l'entraînement de modèles et l'analytique sur des données unifiées.

Couche de données opérationnelles

Une interface transactionnelle à faible latence (Lakebase) qui sert de système d'exécution pour les applications et les agents. Cette couche permet des lectures/écritures en temps réel, la gestion de l'état et la logique applicative directement sur des données gouvernées — sans surcoût de réplication ou de synchronisation.

Boucle d'apprentissage continu

Un système de rétroaction fermé où les interactions applicatives, les sorties des agents et les signaux des utilisateurs sont capturés et réintégrés dans les pipelines de modèles. Cela établit un système d'amélioration continue, permettant aux capacités d'IA d'évoluer en fonction du monde réel.

Lorsque ces trois couches partagent une fondation, les systèmes d'IA passent de charges de travail isolées à des systèmes de production en amélioration continue.

Éliminer la taxe du développeur

La taxe du développeur n'est pas une fatalité. C'est la conséquence de la construction d'IA sur une infrastructure conçue pour une autre époque — lorsque les bases de données étaient monolithiques, les applications sans état et l'intelligence un projet distinct.

Lakebase change les calculs ! Les applications s'exécutent là où résident les données. Les agents disposent du contexte dont ils ont besoin. Et le temps d'ingénierie que votre équipe consacrait aux pipelines est réaffecté à la livraison.

Regardez la session d'Amey Banarse à PostgresConf 2026, « From Transactions to Agents: PostgreSQL in Modern AI Applications » [Slides] pour voir une application complète native à l'IA construite sur Lakebase en action.

Databricks Lakebase est un Postgres serverless conçu pour les agents et les applications. En savoir plus sur databricks.com/product/lakebase.

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.