Optimisation prédictive à grande échelle : une année d'innovation et les prochaines étapes

Requêtes plus rapides, coûts de stockage réduits et automatisation complète sur les tables gérées par Unity Catalog

par Jeffrey Gong et Kelly Albano

- L'Optimisation prédictive s'exécute désormais par défaut pour les nouvelles tables gérées par Unity Catalog et fonctionne à très grande échelle

- Les nouvelles fonctionnalités de 2025 ont permis d'accélérer les requêtes, de réduire les coûts de maintenance du stockage et d'améliorer les fonctionnalités

- En 2026, l'Optimisation prédictive s'étendra à l'automatisation du cycle de vie des données et à une observabilité plus approfondie

Introduction

Le lakehouse le plus performant et le plus rentable est celui qui s'optimise lui-même au fur et à mesure que les volumes de données, les schémas de query et l'utilisation par l'organisation évoluent. L'optimisation prédictive (PO) dans Unity Catalog active ce comportement en analysant en continu la manière dont les données sont écrites et interrogées, puis en appliquant automatiquement les actions de maintenance appropriées sans nécessiter d'intervention manuelle de la part des utilisateurs ou des équipes de plateforme. En 2025, l'optimisation prédictive est passée d'une fonctionnalité d'automatisation facultative au comportement par défaut de la plateforme, gérant les performances et l'efficacité du stockage sur des millions de tables de production tout en supprimant la charge opérationnelle traditionnellement associée à l'optimisation des tables. Voici un aperçu des jalons qui nous ont menés jusqu'ici, et de ce qui nous attend en 2026.

Adoption à grande échelle sur le lakehouse

Tout au long de 2025, l'optimisation prédictive a connu une adoption rapide sur la Databricks Platform, car les clients se sont de plus en plus appuyés sur la maintenance autonome pour gérer un patrimoine de données en pleine croissance. L'Optimisation prédictive a connu une croissance rapide au cours de l'année écoulée :

- Des exaoctets de données non référencées ont été vacuumés, ce qui a permis de réaliser des dizaines de millions de dollars d'économies sur les coûts de stockage

- Des centaines de pétaoctets de données ont été compactés et clusterisés pour améliorer les performances des requêtes et l'efficacité de l'élagage des fichiers.

- Des millions de tables ont adopté le Clustering liquide automatique pour la gestion autonome du layout des données.

Sur la base des améliorations de performance constantes observées à cette échelle, l'Optimisation prédictive est désormais activée par défaut pour toutes les nouvelles tables, tous les nouveaux espaces de travail et tous les nouveaux comptes gérés par Unity Catalog.

Fonctionnement de l'optimisation prédictive

L'optimisation prédictive (PO) fonctionne comme la couche d'intelligence de la plateforme pour le lakehouse, optimisant en continu le layout de vos données, réduisant l'empreinte de stockage et conservant les statistiques de fichiers précises requises pour une planification efficace des queries sur les tables gérées par UC.

En fonction des modèles d'utilisation observés, PO détermine automatiquement quand et comment exécuter des commandes telles que :

- OPTIMIZE, qui compacte les petits fichiers et améliore la localité des données pour un accès efficace

- VACUUM, qui supprime les fichiers non référencés pour maîtriser les coûts de stockage

- CLUSTER BY, qui sélectionne les colonnes de clustering optimales pour les tables avec le Clustering liquide automatique

- ANALYZE, qui maintient des statistiques précises pour la planification des queries et l'omission des données

Toutes les décisions d'optimisation sont basées sur la charge de travail et adaptatives, ce qui élimine le besoin de gérer des planifications, d'ajuster des paramètres ou de revoir les stratégies d'optimisation à mesure que les schémas de requête évoluent.

Principales avancées de l'optimisation prédictive en 2025

Statistiques automatiques pour des requêtes 22 % plus rapides

Des statistiques précises sont essentielles pour créer des plans de requête efficaces, mais leur gestion manuelle devient de moins en moins pratique à mesure que le volume de données et la diversité des requêtes augmentent.

Grâce aux statistiques automatiques (maintenant en disponibilité générale), l'optimisation prédictive détermine les colonnes importantes en fonction du comportement observé des requêtes et garantit que les statistiques restent à jour sans commandes ANALYZE manuelles.

Les statistiques sont maintenues via deux mécanismes complémentaires :

- Les statistiques à l'écriture capturent les statistiques au fur et à mesure que les données sont écrites avec une surcharge minimale, une méthode 7 à 10 fois plus performante que l'exécution d'ANALYZE TABLE

- Le refresh en arrière-plan met à jour les statistiques lorsqu'elles deviennent obsolètes en raison de modifications de données ou de l'évolution des schémas de query.

Sur les charges de travail de production réelles des clients, cette approche a permis d'accélérer les queries jusqu'à vingt-deux pour cent, tout en éliminant le coût opérationnel de la gestion manuelle des statistiques.

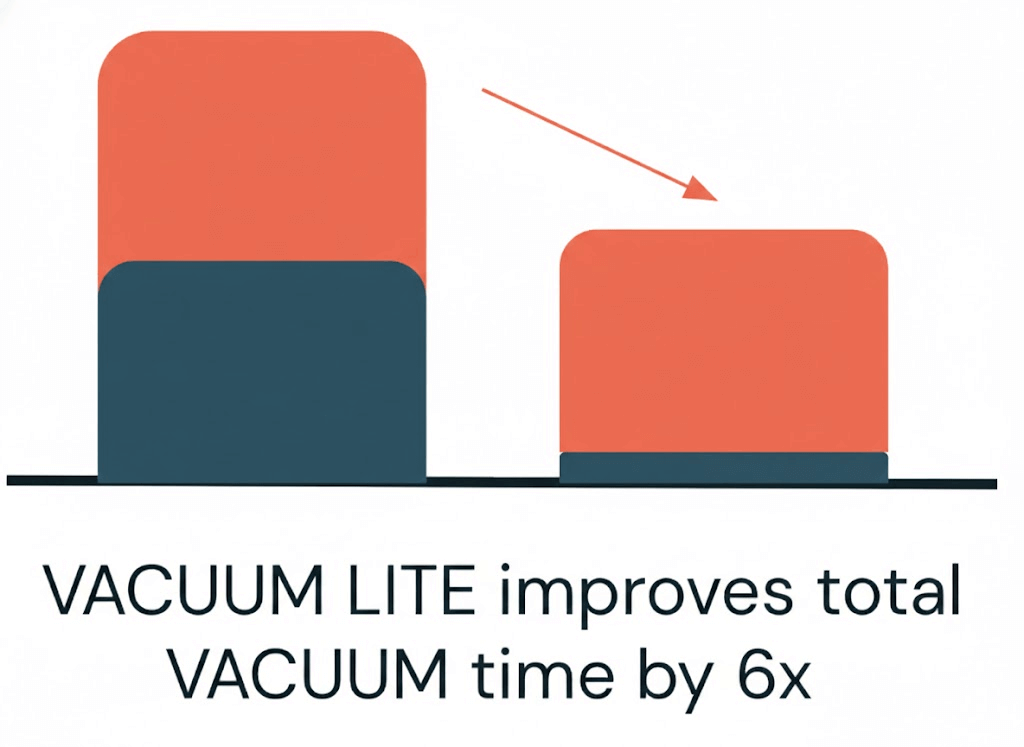

VACUUM 6x plus rapide et 4x moins cher

VACUUM joue un rôle essentiel dans la gestion des coûts de stockage et de la conformité en supprimant les fichiers de données non référencés. L'opération VACUUM standard nécessite de lister tous les fichiers d'un répertoire de table pour identifier les candidats à la suppression, une opération qui peut prendre plus de 40 minutes pour les tables contenant 10 millions de fichiers.

L'Optimisation prédictive applique désormais un chemin d'exécution VACUUM optimisé qui s'appuie sur le journal des transactions Delta pour identifier directement les fichiers amovibles, évitant ainsi les listages de répertoires coûteux chaque fois que possible.

À grande échelle, cela s'est traduit par :

- Une exécution de VACUUM jusqu'à 6 fois plus rapide

- Coût de compute jusqu'à 4 fois inférieur par rapport aux approches standard.

Le moteur détermine dynamiquement quand utiliser cette approche basée sur les Logs et quand effectuer une analyse complète du répertoire pour nettoyer les fragments de transactions interrompues.

Clustering liquide automatique

Le Clustering liquide automatique a atteint la disponibilité générale en 2025 et optimise déjà des millions de tables en production.

Le processus est entièrement piloté par la charge de travail :

- Tout d'abord, PO analyse la télémétrie de toutes les requêtes sur votre table, en observant les métriques clés comme les colonnes de prédicat, les expressions de filtre, ainsi que le nombre et la taille des fichiers lus et élagués.

- Ensuite, il effectue une modélisation de la charge de travail, en identifiant et en testant diverses combinaisons de clés de clustering candidates (p. ex., clusterisées par date, par customer_id ou les deux).

- Enfin, PO effectue une analyse coûts-bénéfices pour sélectionner la meilleure stratégie de clustering qui maximisera l'élagage des requêtes et réduira les données analysées, déterminant même si l'ordre d'insertion existant de la table est déjà suffisant.

Vous obtenez des requêtes plus rapides sans aucun réglage manuel. En analysant automatiquement les charges de travail et en appliquant la disposition optimale des données, PO supprime la tâche complexe de sélection de la clé de clustering et garantit que vos tables restent très performantes à mesure que vos modèles de requête évoluent.

Couverture à l'échelle de la plateforme

L'Optimisation prédictive s'est étendue au-delà des tables traditionnelles pour prendre en charge un ensemble plus large de la plateforme Databricks.

- PO s'intègre désormais en mode natif avec les Lakeflow Spark Declarative Pipelines (SDP), apportant une maintenance autonome en arrière-plan à la fois aux vues matérialisées et aux tables de streaming.

- PO fonctionne sur les tables gérées Delta et Iceberg

- PO est activé par défaut pour toutes les nouvelles tables, tous les nouveaux espaces de travail et tous les nouveaux comptes gérés par Unity Catalog.

Cela garantit une maintenance autonome sur l'ensemble de votre patrimoine de données plutôt qu'une optimisation isolée de tables individuelles.

Quelles sont les prochaines nouveautés pour 2026 ?

Nous nous engageons à fournir des fonctionnalités qui remplacent le réglage manuel des tables par une maintenance automatisée. En parallèle, nous prévoyons d'aller au-delà de l'intégrité de la table physique pour aborder l'intelligence totale du cycle de vie des données : économies de coûts de stockage automatisées, gestion du cycle de vie des données et suppression de lignes. Nous donnons également la priorité à l'observabilité améliorée, en intégrant les informations de l'Optimisation prédictive dans les opérations de table courantes et dans le Governance Hub afin d'offrir une visibilité plus claire sur les opérations de PO et leur ROI.

Auto-TTL (Suppression automatique des lignes)

La gestion de la rétention des données ou le contrôle des coûts de stockage est une tâche essentielle, mais souvent manuelle. Nous sommes ravis de présenter Auto-TTL, une nouvelle fonctionnalité d'Optimisation prédictive qui automatise complètement la suppression de lignes. Grâce à cette fonctionnalité, vous pourrez définir une simple politique de durée de vie directement sur n'importe quelle table gérée par UC à l'aide d'une commande comme :

Une fois la politique définie, l'Optimisation prédictive s'occupe du reste. Il automatise l'ensemble du processus en deux étapes en exécutant d'abord une opération DELETE pour supprimer de manière non définitive les lignes expirées, puis en poursuivant avec un VACUUM pour les supprimer définitivement du stockage physique.

Contactez votre équipe de compte dès aujourd'hui pour l'essayer en avant-première privée !

Observabilité améliorée

Observabilité améliorée de l'Optimisation prédictive

Vous pourrez suivre l'impact direct et le ROI de l'Optimisation prédictive dans le nouveau hub de gouvernance des données. Ce tableau de bord d'observabilité sera fourni prêt à l'emploi avec une vue centralisée des opérations de PO, faisant remonter les métriques clés qui quantifient sa valeur.

Utilisez ceci pour voir exactement ce que PO fait en arrière-plan, avec des visualisations claires des octets compactés, des octets clusterisés par Liquid, des octets nettoyés par VACUUM et des octets analysés. Plus important encore, le hub traduit ces actions en valeur commerciale directe en affichant vos économies estimées sur les coûts de stockage. Il sera ainsi plus facile que jamais de comprendre et de communiquer l'impact positif de PO sur vos coûts de stockage et les performances de vos queries.

Dans DESCRIBED EXTENDED, vous pourrez également voir les raisons pour lesquelles l'Optimisation prédictive a ignoré l'optimisation (p. ex. table déjà bien clusterisée, table trop petite pour bénéficier du compactage, etc.).

En outre, nous avons ajouté la possibilité de consulter les sélections de colonnes pour le data skipping et l'Auto Liquid dans la table système PO.

Contactez votre équipe de compte dès aujourd'hui pour essayer le Hub de gouvernance des données en avant-première privée !

Observabilité améliorée du stockage au niveau des tables

Pour offrir une plus grande clarté sur votre empreinte de stockage, nous introduirons des fonctionnalités d'observabilité améliorées pour l'Optimisation prédictive. Vous pourrez surveiller la santé et l'évolution de vos tables grâce à des métriques de haut niveau telles que le nombre de fichiers et la croissance du stockage. En présentant directement ces insights, nous facilitons la visualisation de l'impact de la maintenance automatisée et l'identification de nouvelles opportunités pour réduire les coûts et rationaliser votre parc de données.

Démarrer avec l'Optimisation Prédictive

L'Optimisation prédictive est disponible dès aujourd'hui pour les tables gérées par Unity Catalog et est activée par default pour les nouvelles charges de travail.

Lorsqu'elle est activée, les clients bénéficient automatiquement d'une exécution VACUUM plus rapide, de statistiques automatiques tenant compte de la charge de travail et d'une disposition autonome des données grâce au Clustering liquide automatique.

Vous pouvez également explorer l'observabilité d'Auto-TTL et de l'Optimisation prédictive (Hub de gouvernance des données) via l'avant-première privée en contactant votre équipe de compte.

(Cet article de blog a été traduit à l'aide d'outils basés sur l'intelligence artificielle) Article original

Recevez les derniers articles dans votre boîte mail

Abonnez-vous à notre blog et recevez les derniers articles directement dans votre boîte mail.