Protezione dall'esfiltrazione dei dati con la Databricks Lakehouse Platform su AWS

Scopri come configurare un'architettura Databricks sicura su AWS per proteggere dall'esfiltrazione dei dati

Sebbene questa guida contenga preziosi dettagli tecnici specifici per il cloud, ora consigliamo il nostro Approccio unificato alla protezione contro l'esfiltrazione dei dati su Databricks che fornisce un framework completo su AWS, Azure e GCP con controlli prioritari e indicazioni sull'implementazione.

La Databricks Lakehouse Platform fornisce un set unificato di strumenti per la creazione, distribuzione, condivisione e manutenzione di soluzioni dati di livello enterprise su larga scala. Databricks si integra con lo storage cloud e la sicurezza nel tuo account cloud, e gestisce e distribuisce l'infrastruttura cloud per tuo conto.

L'obiettivo generale di questo articolo è mitigare i seguenti rischi:

- Accesso ai dati da un browser su Internet o da una rete non autorizzata utilizzando l'applicazione web Databricks.

- Accesso ai dati da un client su Internet o da una rete non autorizzata utilizzando l'API Databricks.

- Accesso ai dati da un client su Internet o da una rete non autorizzata utilizzando lo Storage Cloud (S3).

- Un carico di lavoro compromesso sul cluster Databricks che scrive dati su una risorsa di storage non autorizzata su AWS o su Internet.

Proteggere i dati in transito e a riposo con gli strumenti nativi AWS in Databricks

Databricks supporta diversi strumenti e servizi nativi AWS che aiutano a proteggere i dati in transito e a riposo.

Gruppi di Sicurezza

I Gruppi di Sicurezza sono firewall virtuali stateful collegati alle istanze EC2. Consentono di definire quale traffico in entrata e in uscita è consentito. La restrizione delle regole di uscita (outbound) impedisce alle istanze EC2 di inviare dati a indirizzi IP non autorizzati o a Internet, bloccando efficacemente perdite di dati non intenzionali.

- Previene: Connessioni in uscita non autorizzate dalle risorse di calcolo Databricks.

Policy degli Endpoint VPC

Le policy degli endpoint VPC controllano l'accesso ai servizi AWS tramite endpoint VPC. Consentendo solo le operazioni richieste su specifiche risorse AWS (come i bucket S3), è possibile impedire ai workspace Databricks di esfiltrare dati verso altri account o servizi AWS.

- Previene: L'invio di dati da parte di Databricks a servizi o risorse AWS non autorizzati.

Endpoint VPC

Gli endpoint VPC stabiliscono connessioni private tra il tuo VPC e altri servizi AWS senza attraversare Internet. Ciò garantisce che i dati sensibili non vengano mai esposti a reti esterne, mitigando i rischi di esfiltrazione dei dati tramite percorsi Internet.

- Previene: L'esposizione del traffico a Internet durante la comunicazione dei servizi.

- Documentazione: Endpoint VPC AWS

Ruoli IAM

I Ruoli IAM consentono di controllare a quali risorse AWS Databricks può accedere e quali azioni può eseguire. L'uso attento delle policy di trust e delle policy di autorizzazione garantisce che gli utenti e i cluster Databricks possano interagire solo con risorse esplicitamente autorizzate, bloccando l'uso di bucket S3 o servizi esterni non autorizzati.

- Previene: Scritture di dati su risorse AWS non autorizzate utilizzando credenziali compromesse o eccessivamente permissive.

Tabelle di Routing

Le Tabelle di Routing determinano il flusso del traffico di rete all'interno del tuo VPC. Impedendo i percorsi di uscita verso Internet (o consentendo solo destinazioni necessarie), controlli dove i dati possono viaggiare, riducendo il rischio che i dati vengano instradati verso posizioni non sicure.

- Previene: Percorsi di rete verso Internet o reti non autorizzate.

AWS PrivateLink

AWS PrivateLink consente la connettività privata tra VPC e servizi AWS tramite interfacce di rete dedicate e crittografate, eliminando l'esposizione a Internet. Ciò fornisce un percorso sicuro per i piani di controllo e dati di Databricks, rendendo più difficile l'esfiltrazione dei dati al di fuori di AWS.

- Previene: Intercettazione o esfiltrazione di dati su reti pubbliche.

Sottoreti Private

Le sottoreti private non hanno una rotta diretta verso Internet, il che significa che le risorse al loro interno non possono avviare connessioni in uscita verso Internet. Questa barriera architetturale impedisce ai cluster e ai nodi di inviare direttamente dati all'esterno di AWS.

- Previene: Qualsiasi comunicazione Internet in uscita dalle risorse di calcolo.

Chiavi KMS

AWS Key Management Service (KMS) consente di crittografare i dati a riposo, inclusi i bucket S3. Anche se i dati vengono accessibili, rimangono protetti a meno che l'attaccante non abbia anche accesso alle chiavi di crittografia.

- Previene: Esfiltrazione utilizzabile di dati senza compromettere il materiale delle chiavi.

Policy dei Bucket S3

Queste policy delle risorse concedono o negano l'accesso a specifici bucket S3. Limitando l'accesso solo da origini approvate (come dal VPC Databricks o da ruoli IAM specifici), garantiscono che anche se qualcuno tenta l'esfiltrazione, non possa scrivere o copiare dati sensibili al di fuori dei bucket controllati.

- Previene: Scritture/letture da posizioni S3 indesiderate.

Ciascuno di questi controlli, individualmente e insieme, applica un approccio di difesa in profondità contro l'esfiltrazione dei dati, garantendo molteplici checkpoint prima che i dati possano lasciare il tuo ambiente protetto.

La crittografia è un altro componente importante della protezione dei dati. Databricks supporta diverse opzioni di crittografia, tra cui chiavi di crittografia gestite dal cliente, rotazione delle chiavi, crittografia a riposo e in transito. Le chiavi di crittografia gestite da Databricks sono utilizzate per impostazione predefinita e abilitate immediatamente, i clienti possono anche portare le proprie chiavi di crittografia.

Audit Logging

L'audit logging è una funzionalità fondamentale di sicurezza e conformità, che consente alle organizzazioni di tracciare l'attività degli utenti, le azioni amministrative e gli eventi di sistema nell'ambiente Databricks. Nel contesto dell'esfiltrazione dei dati, i log di audit svolgono un ruolo critico nel consentire il rilevamento, l'indagine e la risposta a potenziali minacce o comportamenti inappropriati.

I log di audit aiutano a rispondere a domande fondamentali come:

- Chi ha acceduto a quali dati e quando?

- Quali operazioni (lettura, scrittura, modifica, eliminazione) sono state eseguite?

- Ci sono stati tentativi di accedere o esportare dati sensibili al di fuori delle policy?

Tracciando questi eventi, i log di audit supportano sia il monitoraggio della sicurezza che la reportistica di conformità.

Capacità di Audit Logging di Databricks

Databricks fornisce robuste funzionalità di audit logging sia a livello di workspace che di account. Le capacità chiave includono:

- Log di audit a livello di workspace: Catturano azioni utente e di sistema all'interno di un workspace Databricks.

- Log di audit a livello di account: Tracciano le azioni su tutti i workspace dell'account.

- Log di audit verbosi: Cattura di eventi opzionale e più granulare per una maggiore visibilità.

- Integrazione con le tabelle di sistema di Unity Catalog: Espone i log di accesso, calcolo, query, serving e storage come parte dei flussi di lavoro di governance dei dati e di indagine.

I log di audit possono essere consegnati a un bucket Amazon S3 designato dal cliente quasi in tempo reale. Possono essere integrati direttamente con sistemi SIEM o di analisi della sicurezza per il monitoraggio continuo e gli avvisi.

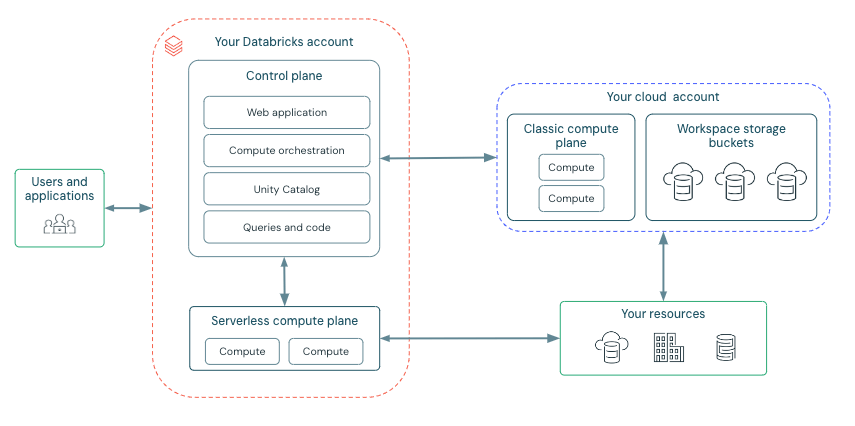

Architettura Databricks

Prima di iniziare, diamo una rapida occhiata all'architettura di deployment di Databricks qui:

Databricks è strutturato per consentire la collaborazione sicura tra team interfunzionali, mantenendo una quantità significativa di servizi backend gestiti da Databricks in modo che tu possa concentrarti sui tuoi compiti di data science, data analytics e data engineering.

Databricks opera attraverso un piano di controllo e un piano di calcolo.

- Il piano di controllo include i servizi backend che Databricks gestisce nel proprio account AWS Cloud. I comandi dei notebook e molte altre configurazioni del workspace sono archiviati nel piano di controllo e crittografati a riposo.

- Il piano di calcolo, dove vengono elaborati i tuoi dati, ha tipi diversi a seconda del calcolo specifico che stai utilizzando. Puoi trovare maggiori informazioni su questi tipi di calcolo.

- Per il calcolo serverless, le risorse di calcolo serverless vengono eseguite in un piano di calcolo serverless nel tuo account Databricks.

- Per il calcolo Databricks classico, le risorse di calcolo si trovano nel tuo account AWS Cloud.

Architettura di Alto Livello

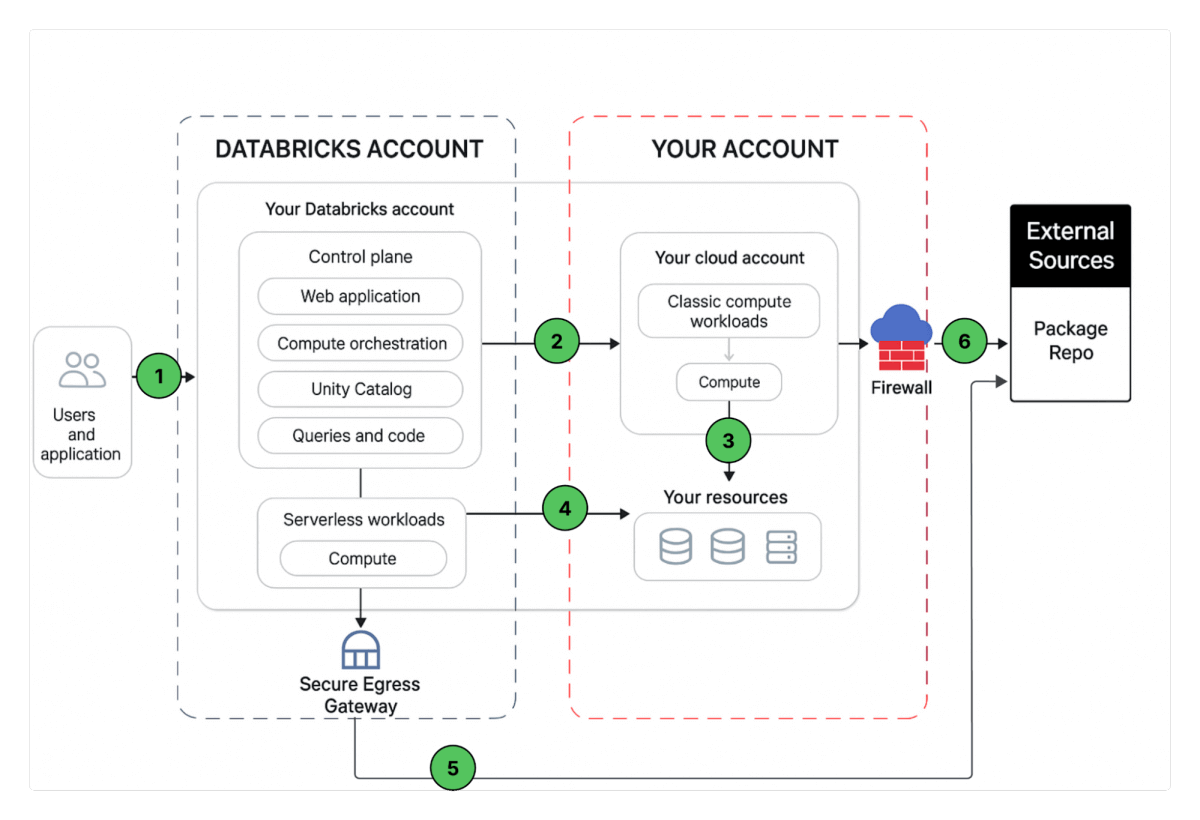

Percorso di Comunicazione di Rete

Per comprendere le misure di sicurezza che miriamo a implementare, esaminiamo i vari modi in cui utenti e applicazioni interagiscono con Databricks, come illustrato di seguito.

Una distribuzione di un workspace Databricks include i seguenti percorsi di rete che è possibile proteggere.

- Utente o Applicazioni verso l'applicazione web Databricks nota anche come workspace o le API REST di Databricks.

- Rete VPC del piano di calcolo classico Databricks verso il servizio del piano di controllo Databricks. Questo include il relay di connettività sicura del cluster e la connessione del workspace per gli endpoint delle API REST.

- Piano di calcolo classico verso i tuoi servizi di storage (es: S3, Kinesis, ecc.).

- Piano di calcolo serverless verso i tuoi servizi di storage (es: S3, Kinesis ecc.).

- Egress sicuro dal piano di calcolo serverless tramite policy di rete (firewall in uscita) verso origini dati esterne, ad esempio repository di pacchetti come pypi o maven.

- Egress sicuro dal piano di calcolo classico tramite firewall in uscita verso origini dati esterne, ad esempio repository di pacchetti come pypi o maven.

Dalla prospettiva degli utenti finali, 1 richiede controlli in ingresso e 2, 3, 4, 5, 6 controlli in uscita.

In questo articolo, la nostra area di interesse è proteggere il traffico in uscita dai tuoi carichi di lavoro Databricks, fornire al lettore una guida prescrittiva sull'architettura di distribuzione proposta e, mentre ci siamo, condivideremo anche le best practice per proteggere il traffico in ingresso (utente/client verso Databricks).

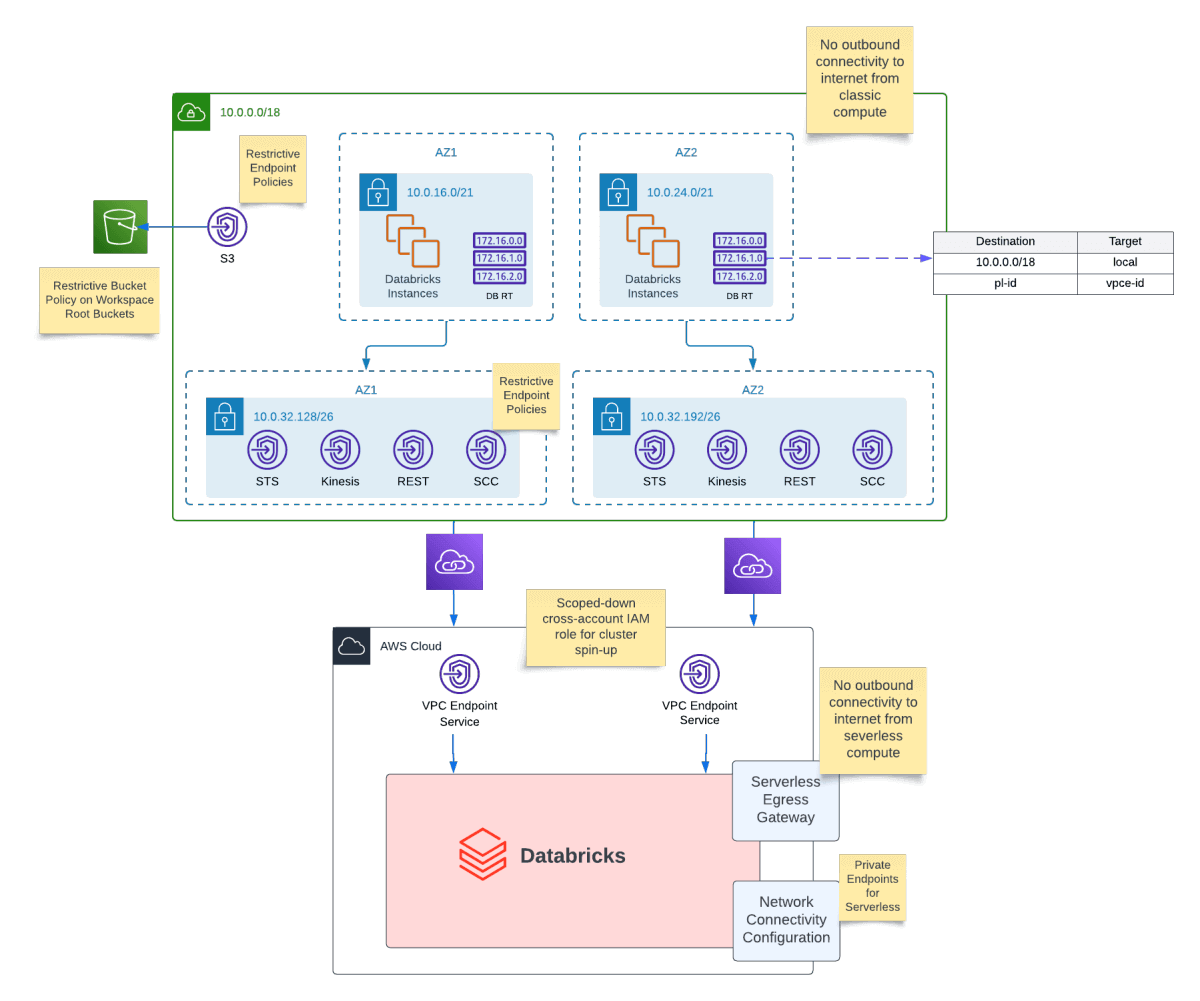

Architettura di Distribuzione Proposta - Architettura di Riferimento per la Sicurezza AWS

Distribuire Databricks in modo sicuro su AWS può sembrare complesso; sono necessari VPC, ruoli IAM, networking privato, Unity Catalog e guardrail che si allineino alla sicurezza aziendale. La Databricks Security Reference Architecture (SRA) per AWS raggruppa queste best practice in modelli Terraform pronti all'uso, offrendo ai team un punto di partenza rafforzato per le distribuzioni di produzione.

Cos'è

- Moduli Terraform opinionati per Databricks sicuro su AWS.

- Copre networking, IAM, Unity Catalog, policy out-of-the-box.

- Agisce come un blueprint orientato alla sicurezza per accelerare l'adozione.

Perché è importante

- Velocità: Automatizza l'infrastruttura + configurazione del workspace in pochi minuti.

- Sicurezza: VPC preconfigurati, networking privato, logging di controllo.

- Scalabilità: Pattern riutilizzabili tra account/workspace.

Struttura generale del repository

- aws/ → Creazione dell'infrastruttura AWS + workspace.

- /modules/databricks_account/unity_catalog_metastore_creation/ → creazione del metastore

- aws/tf/modules/sra/credential.tf → ruolo cross-account che utilizza l'ID esterno

- template.tfvars.example → compila le tue variabili

Cosa ottieni

- VPC AWS, subnet, ruoli IAM.

- Workspace Databricks collegati a Unity Catalog.

- Opzioni rafforzate: egress limitato, logging, monitoraggio.

Come usarlo

Avvertenze

- Snapshot puntuale, rivedere prima degli aggiornamenti.

- Non è "gestito" → i team sono responsabili dei test e dell'adattamento.

- Richiede conoscenza di Terraform + AWS + provider Databricks.

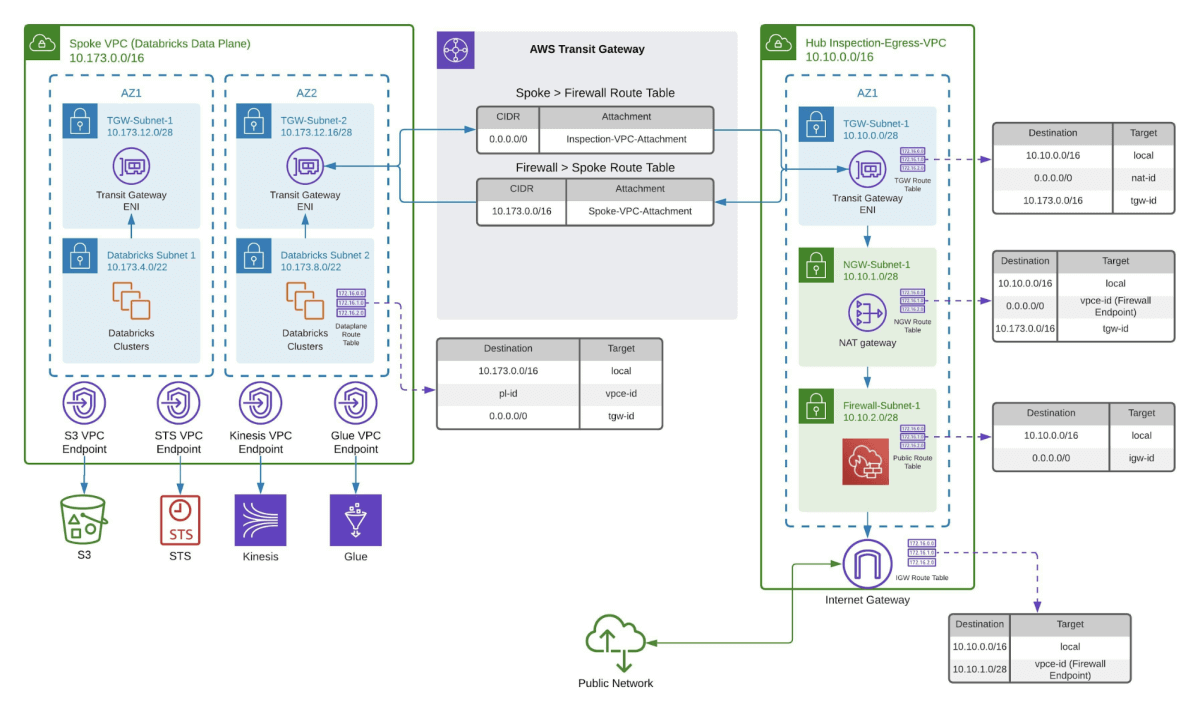

Se richiedi l'accesso a Internet per pypi o maven, ti consigliamo la seguente architettura per scansionare qualsiasi traffico che esce dal tuo VPC, in modo da poter scansionare qualsiasi traffico in uscita. Un numero di servizi AWS può essere utilizzato per scansionare il traffico in uscita verso il tuo VPC. Ad esempio, AWS Network Firewall o Gateway Load Balancer. Ti consigliamo di seguire la documentazione AWS, ad esempio qui, per iniziare con la configurazione di AWS Network Firewall.

Controlli di Protezione contro l'Esfiltrazione dei Dati su Databricks

Oltre al monitoraggio del traffico in uscita, implementa i seguenti controlli per rafforzare il tuo ambiente Databricks contro l'esfiltrazione dei dati. Tieni presente che alcune funzionalità, come il private link, sono supportate solo nel tier Enterprise di Databricks:

Provisioning SCIM

Automatizza la gestione del ciclo di vita di utenti e gruppi dal tuo IdP a Databricks.

Guida al Provisioning SCIM

Single Sign-On (SSO)

Richiedi l'autenticazione centralizzata tramite il tuo identity provider (SAML o OIDC).

Configurazione SSO

Autenticazione Multi-Fattore (MFA)

Applica l'MFA a livello di IdP per aggiungere un ulteriore livello di sicurezza all'accesso.

Autenticazione Multi-Fattore

Liste di Controllo Accessi (ACL) per la Console dell'Account Databricks

Restringi l'accesso alla console dell'account Databricks definendo intervalli IP consentiti.

Liste di Controllo Accessi IP

Endpoint Privati nella Configurazione della Connettività di Rete

Assicura che il traffico del workspace fluisca solo attraverso endpoint privati (nessun internet pubblico).

Configurazione della Connettività di Rete

Controlli Egress Serverless

Applica restrizioni per limitare le destinazioni esterne dal calcolo serverless di Databricks.

Sicurezza del Calcolo Serverless

Evitare di Memorizzare Dati di Produzione in DBFS

Non persistere dataset sensibili in DBFS; utilizza storage sicuro (es: S3, ADLS).

Panoramica DBFS

Durata del Token del Destinatario di Delta Sharing

Riduci la validità dei token per Delta Sharing per diminuire l'esposizione in caso di fuga.

Sicurezza Delta Sharing

Isolare Carichi di Lavoro Sensibili in Reti Diverse

Utilizza VPC/subnet separati per isolare logicamente e fisicamente i carichi di lavoro.

Isolare Carichi di Lavoro Sensibili in Workspace Diversi

Distribuisci più workspace (prod, dev, test) per imporre la separazione degli ambienti.

Strategia Multi-Workspace

Federazione Token OIDC per CI/CD

Utilizza la federazione OIDC per scambiare in modo sicuro token di breve durata quando le pipeline CI/CD interagiscono con Databricks.

Federazione Token OIDC

L'applicazione congiunta di questi controlli fornisce una difesa a più livelli (defense-in-depth), riducendo al minimo il rischio di fuga accidentale o malevola dei dati.

Add-on con Conformità di Sicurezza e Monitoraggio Avanzati:

Se la tua organizzazione ha requisiti di sicurezza elevati, come la necessità di supportare HIPAA, PCI o standard simili, considera l'abilitazione del Monitoraggio di Sicurezza Avanzato per i tuoi carichi di lavoro Databricks.

Questa funzionalità avanzata si basa sulle capacità di sicurezza fondamentali di Databricks, offrendo maggiore visibilità, rilevamento proattivo delle minacce e ulteriore rafforzamento sia per gli ambienti di calcolo classici che serverless. L'Enhanced Security Monitoring offre vantaggi come Canonical Ubuntu con rafforzamento di livello 1 CIS, monitoraggio continuo basato sul comportamento di malware e integrità dei file, scansione completa di malware e antivirus e report dettagliati sulle vulnerabilità per il sistema operativo host.

Con questa funzionalità abilitata (tramite il profilo di sicurezza di conformità), i log degli eventi di sicurezza, inclusi avvisi per escalation di privilegi, shell interattive sospette, connessioni in uscita non autorizzate, modifiche impreviste ai file di sistema o tentativi di esfiltrazione, vengono registrati automaticamente. Questi log vengono forniti insieme ai log di audit standard di Databricks, fornendo informazioni ricche e contestuali al SIEM della tua organizzazione o all'interno di Databricks stesso. Ciò consente agli analisti della sicurezza di tracciare e rispondere rapidamente a comportamenti anomali o rischiosi, supportando il rilevamento immediato e la risposta rapida agli incidenti senza la necessità di indagini approfondite.

Conclusione e Passi Successivi

Una solida difesa contro l'esfiltrazione dei dati per Databricks su AWS non è un'impostazione una tantum, richiede un miglioramento continuo. Oltre a implementare controlli architetturali, rendi il monitoraggio continuo, l'audit rigoroso e la gestione proattiva delle modifiche centrali nella tua pratica di sicurezza. La revisione regolare dei log di audit, l'aggiornamento delle policy di accesso e di rete e la collaborazione con i team di sicurezza e conformità aiutano a garantire che le protezioni si evolvano per contrastare le minacce emergenti. Per approfondire la tua strategia, consulta risorse attendibili sulle migliori pratiche di monitoraggio del cloud e sull'audit logging. Questi riferimenti ti aiuteranno a mantenere vigilanza e resilienza man mano che il tuo panorama di dati e i rischi aumentano.

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.