Espansione della Governance degli Agenti con Unity AI Gateway

Controlla e verifica agenti AI e assistenti di codifica con governance, visibilità e guardrail unificati

di David Nasi

- Ora supporta la governance MCP: controlla quali agenti possono accedere ai sistemi esterni con autorizzazioni granulari, incluso l'accesso per conto terzi (OBO).

- Osservabilità end-to-end per gli agenti: monitora le chiamate LLM e MCP, monitora l'utilizzo e attribuisci i costi tra modelli, team e flussi di lavoro.

- Accesso ai modelli più flessibile e affidabile: utilizza un'API unificata tra i modelli con fallback integrati, limiti di frequenza e guardrail.

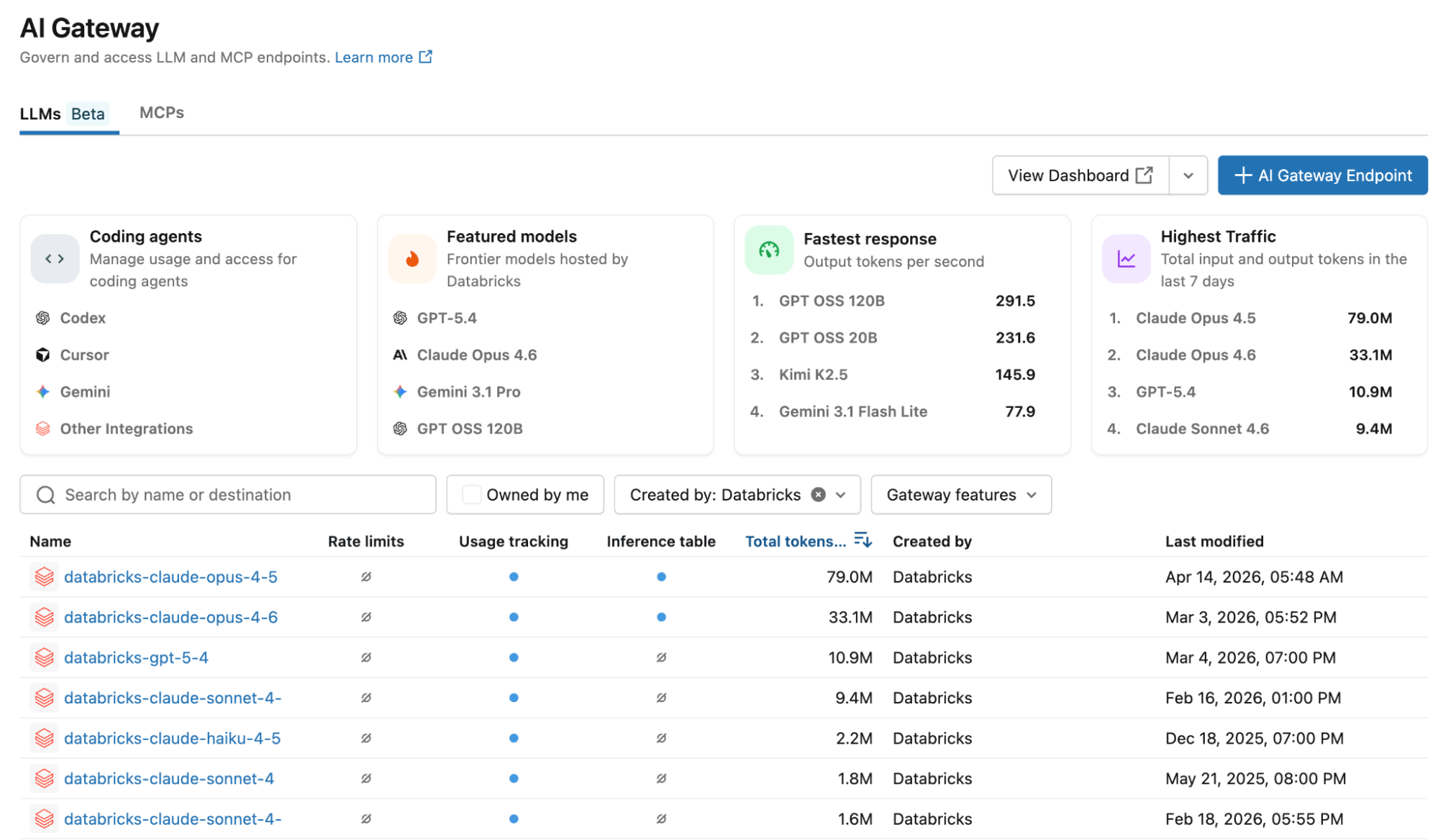

Oggi annunciamo importanti miglioramenti ad AI Gateway. Come parte di questa release, AI Gateway fa ora parte di Unity Catalog come Unity AI Gateway. Questo estende il modello di governance di Unity Catalog all'IA agentiva, in modo da poter applicare le stesse autorizzazioni, audit e controlli delle policy su come gli agenti accedono agli LLM e interagiscono con strumenti come server MCP e API.

Ecco cosa succede quando un agente AI risponde a una domanda di un cliente: chiama un LLM per interpretare la query, recupera la cronologia degli ordini da Salesforce tramite un server MCP, controlla i dati di spedizione in tempo reale tramite un'API interna e quindi chiama nuovamente l'LLM per redigere una risposta. Tempo totale: meno di un secondo. Visibilità totale su chi ha avuto accesso a quali dati, quali sistemi sono stati chiamati e se le policy sono state rispettate: quasi nulla.

Ciò che è cambiato non sono solo gli strumenti, ma l'architettura. Gli agenti AI ora orchestrano flussi di lavoro multi-step tra modelli e sistemi, toccando spesso dati sensibili in ogni passaggio. Ciò potrebbe significare interrogare un database, chiamare un'API esterna o utilizzare agenti di codifica come Cursor, Codex o Claude Code per generare o modificare codice.

E questo solleva nuove domande: Chi ha autorizzato ogni azione? Quali dati sono stati condivisi con quale modello? Le policy sono state applicate in modo coerente? Se qualcosa si rompe, è possibile tracciare l'intera catena?

Gli strumenti di governance tradizionali non sono stati creati per questo mondo. Operano in silos e non possono fornire una visione unificata attraverso l'intero ciclo di vita delle azioni di un agente.

Con questa release, stiamo espandendo le capacità di governance di Unity Catalog per coprire gli agenti AI. Unity AI Gateway consente di controllare l'accesso agli LLM, governare come gli agenti utilizzano i server MCP e le API, e applicare policy coerenti su modelli e strumenti. Ciò include un nuovo supporto per la governance MCP, in modo da poter controllare quali agenti possono accedere a quali sistemi esterni e tracciare come tali dati vengono utilizzati. Per un'analisi più approfondita, leggi il nostro blog how-to su come connettere gli agenti a MCP esterni in modo sicuro.

Ottieni anche un'osservabilità dettagliata sia per le chiamate LLM che MCP, insieme a un tracciamento granulare dei costi su modelli, team e flussi di lavoro. Inoltre, Unity AI Gateway fornisce un modo unificato per lavorare tra modelli, con fallback integrati, limiti di frequenza e guardrail per aiutarti a eseguire agenti in modo affidabile in produzione.

Alcune delle funzionalità descritte di seguito sono disponibili in Beta

Ora puoi configurare un nuovo endpoint LLM o un server MCP in pochi secondi: scegli il tuo modello (Claude Opus 4.6, GPT-4, Gemini, Llama o qualsiasi API nativa del provider) e configura la governance una sola volta. Lo stesso framework si applica ai modelli Anthropic, OpenAI, Google e open-source.

Dai al tuo team di supporto un endpoint Claude per l'IA conversazionale. Usa GPT-4 per l'estrazione di dati strutturati. Fornisci ai tuoi ingegneri Codex o Claude per agenti di codifica. Integra Gemini per flussi di lavoro multimodali. Puoi scegliere il modello giusto per ogni attività senza dover riconfigurare la governance ogni volta. Le policy rimangono coerenti tra i provider, senza configurazioni duplicate o separate da gestire.

Permessi granulari e Guardrail

Permessi granulari e guardrail impediscono che ciò che non dovrebbe accadere accada in primo luogo.

Controllo accessi granulare per gli strumenti

Quando gli agenti chiamano i server MCP per accedere ai sistemi interni, Unity AI Gateway supporta l'esecuzione on-behalf-of user. L'MCP viene eseguito con le autorizzazioni esatte dell'utente richiedente, non con un account di servizio condiviso. Se un utente non può accedere a un record Salesforce, nemmeno l'agente potrà farlo, anche con privilegi elevati.

Guardrail flessibili basati su giudici LLM (Beta)

I guardrail di Unity AI Gateway utilizzano un approccio prompt + modello: configurali per essere eseguiti su richieste, risposte o entrambi:

- Rilevamento e Redazione PII: Rileva e maschera email, SSN, numeri di telefono prima che raggiungano i modelli esterni

- Sicurezza dei contenuti: Blocca contenuti tossici, dannosi o inappropriati con filtri personalizzabili

- Rilevamento di Iniezione di Prompt: Cattura tentativi di jailbreak che cercano di sovrascrivere le istruzioni di sistema

- Prevenzione Esfiltrazione Dati: Impedisce l'esposizione di dati di addestramento o contenuti proprietari

- Guardrail contro le Allucinazioni: Valida le risposte rispetto alle fonti di grounding

- Guardrail Personalizzati: Definisci i tuoi con un prompt e un modello personalizzati

Ogni guardrail è supportato da un prompt modificabile e un modello configurabile, non da una logica rigida predefinita. Quando violato, Unity AI Gateway può rifiutare la richiesta o mascherare dati sensibili. Tutte le azioni vengono registrate per l'audit. Questa funzionalità è attualmente in fase di rollout e sarà disponibile in tutte le regioni supportate entro la prossima settimana.

Osservabilità End-to-End

Tre team necessitano di risposte quando gli agenti AI entrano in produzione: FinOps vuole sapere cosa sta costando, l'ingegneria ha bisogno di eseguire il debug dei fallimenti, la sicurezza necessita di tracce di audit. Unity AI Gateway fornisce a ciascun team ciò di cui ha bisogno dalla stessa infrastruttura di logging unificata.

Per FinOps: Traccia i costi in base a ciò che conta per te

Ogni richiesta viene registrata nelle tabelle di sistema di Unity Catalog con costi effettivi in dollari, non solo conteggi di token. L'uptime del throughput provisionato, l'utilizzo pay-per-token e i prezzi dei modelli esterni vengono tutti calcolati automaticamente. Suddividi i costi come preferisce la tua organizzazione:

- Tag endpoint: Raggruppa per team, ambiente o centro di costo

- Tag richiesta: Attribuzione dinamica per piattaforme SaaS che agiscono come proxy per i clienti finali

- Identità: Aggrega per utente o principal di servizio, mappa la spesa ai responsabili del budget

- Modello e provider: Traccia quali modelli (Opus vs Sonnet) e provider (Anthropic vs OpenAI) generano i costi

Per l'Ingegneria: Payload completi per il debug

Abilita le tabelle di inferenza che catturano payload completi di richiesta/risposta, latenza, codici di stato ed errori nelle tabelle Delta. Quando un agente fallisce, traccia esattamente quale prompt è stato inviato, cosa ha restituito il modello e dove si è verificato il problema, e utilizza strumenti come Genie Code e MLflow per eseguire rapidamente il debug e risolvere i problemi.

Per la Sicurezza: Audit trail completi

Ogni richiesta registra l'identità richiedente, il timestamp e, per le chiamate MCP, il nome della connessione, il metodo HTTP e se la chiamata è stata effettuata on-behalf-of user. Le autorizzazioni di Unity Catalog controllano chi vede cosa.

Un'unica infrastruttura di logging alimenta tre casi d'uso critici, basata su tabelle Delta di tua proprietà e controllo.

Affidabilità e Flessibilità per la Produzione

Unity AI Gateway ti offre flessibilità nel modo in cui chiami i modelli, a seconda delle esigenze della tua applicazione.

API unificate per un'agevole commutazione del provider (Beta)

Se la portabilità è importante, e dovrebbe esserlo, utilizza l'API di Unity AI Gateway compatibile con OpenAI. Il tuo codice rimane lo stesso per ogni provider. Scrivi la tua applicazione una volta, quindi passa da un modello all'altro aggiornando la configurazione dell'endpoint. Nessuna modifica al codice, nessun redeploy.

Il failover automatico mantiene i sistemi in esecuzione (Beta)

Configura modelli di fallback e Unity AI Gateway gestisce automaticamente i fallimenti. Se il tuo modello principale raggiunge i limiti di frequenza o restituisce errori, le richieste vengono instradate al tuo modello di backup in sequenza finché uno non ha successo. Quota Opus esaurita? Il traffico passa a Sonnet. Provider inattivo? La tua applicazione viene instradata a un'alternativa. Nessun intervento manuale, nessun downtime.

Infine, Unity AI Gateway ti consente di impostare limiti di frequenza a livello di endpoint, utente o gruppo per prevenire costi eccessivi e proteggere il tuo SLA prima che i problemi inizino.

Inizia con Unity AI Gateway

Le nuove funzionalità descritte sopra sono disponibili nelle regioni Databricks supportate. Apri il tuo workspace, naviga in Unity AI Gateway nella barra laterale e inizia a governare il tuo stack GenAI — LLM e MCP — da un unico posto. Ulteriori informazioni nella documentazione e nel blog su come connettere in modo sicuro gli agenti a MCP esterni.

(Questo post sul blog è stato tradotto utilizzando strumenti basati sull'intelligenza artificiale) Post originale

Ricevi gli ultimi articoli nella tua casella di posta

Iscriviti al nostro blog e ricevi gli ultimi articoli direttamente nella tua casella di posta.